はじめに

前回までで基本的な入出力を触ったので,今回からはVIVE Pro Eyeの目玉でもあるアイトラッキング機能を使っていきます.

環境一覧

SteamVR 1.16.10

Unity 2019.4.27f1 or 2020.1.17f1(動作確認済み,非対応なSDKあり)

SteamVR Plugin 2.7.3

Vive SRanipalRuntime Plugin 1.3.2.0

追加アクセサリー

VIVEトラッカー2018

Ovrvision Pro(ステレオカメラ)

Leap Motion

使用PCスペック

インテル® Core™ i7-7700K

NVIDIA GeForce GTX 1070

- 環境作成編

#1 Unityのセットアップをする 2021年 1月更新

#2 プロジェクトを作ってみる 2021年 1月更新

#3-α Unity2019でVR開発のための環境を整える(SteamVR Plugin2.7.Xをインストールする):推奨 2021年 6月更新

#3-β Unity2020でVR開発のための環境を整える(SteamVR Plugin2.7.Xをインストールする) 2021年 5月更新

#3-おまけ UnityでVR開発のための環境を整える(SteamVR Pluginの最新版をインストールする):非推奨 2021年 2月更新

#4 SteamVRのダウングレードと自動アップデートの停止(上級者向け) 2021年 5月更新

- コントローラの入力やトラッカー,HMDの位置座標,回転座標を得る+α

#5 VIVEコントローラのボタン入力を取得する 2021年 2月更新

#6 トリガーの押し具合やトラックパッドの位置情報の入力を取得する 2021年 2月更新

#6-おまけ VIVEコントローラを使った開発をする時のおすすめ設定(独断と偏見) 2021年 5月更新

#7 ヘッドマウントディスプレイとコントローラの位置座標と回転を取得する 2021年 2月更新

#8 VIVEトラッカー2018を有効化してUnity上で位置座標と回転を取得 2021年 5月更新

#9 VIVEコントローラの振動機能を開発してみる 2021年 4月更新

- VIVE Pro Eyeのアイトラッキングを使ってみる

#10 VIVE Pro Eyeの視線トラッキングを有効化(セットアップ)する(この記事) 2021年 4月更新

#11 VIVE Pro Eyeのアイトラッキングを使ってUnity上で瞬きや視線のデータを取得する 2021年 4月更新

#11-おまけ VIVE Pro Eyeのアイトラッキングで計測できるデータについて(適宜更新) 2021年 4月更新

- VIVE Pro Eyeのカメラを使ってみる

#12 VIVE Pro Eyeのフロントカメラの解像度(性能)とAR機能を有効化について 2021年 5月更新

- 小技

プレイエリアの境界線(シャペロン境界)が表示されないように設定を変更する 2021年 6月更新

Unity上でカメラを複数台追加してHMDやコントローラの動きを見る 2021年 6月更新

- Ovrvision Pro(ステレオカメラ)を使ってAR開発してみる

$1-1 Ovrvision Pro(ステレオカメラ)のセットアップをして実際に動かしてみる 2021年 6月更新

$1-2 Ovrvision Pro(ステレオカメラ)とHMDを使ってARアプリ開発する 2021年 6月更新

- Leap Motionを使ってハンドトラッキングしてみる

$2-1 Leap Motion(ハンドトラッキング)のセットアップをして実際に動かしてみる 2021年 6月更新

$2-2 Leap Motion(ハンドトラッキング)とHMDを使ったインタラクティブなアプリ開発する 2021年 6月更新

-

アプリを作ってみる

VR(仮想空間)上に曲面ディスプレイを作成して大画面で広角WEBカメラ映像を見る 2021年 5月更新

1.SDKのダウンロードとインストール.

2.アイトラッキングのキャリブレーションを行う.

3.サンプルを動かしてみる.

という流れ.

1.SDKのダウンロードとインストール.

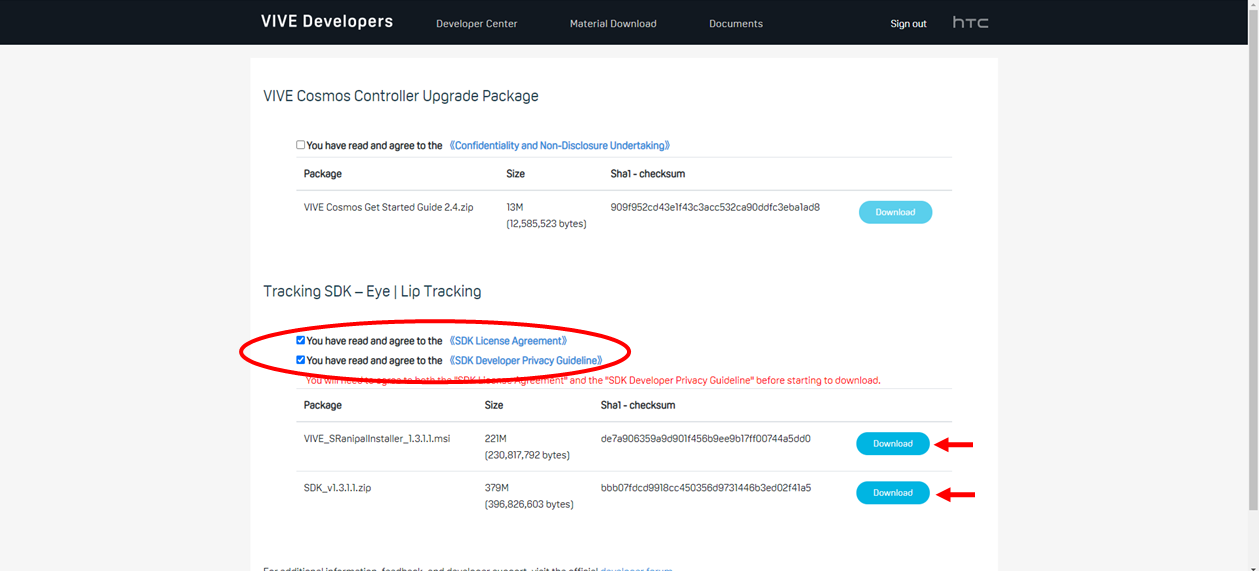

ここか「VIVE Eye and Facial Tracking SDK」と調べてSDKのダウンロードページを開く.

ログインを求められるのでVIVEポートのアカウントでログインする.

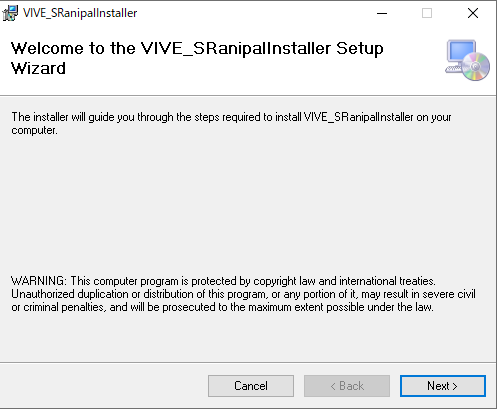

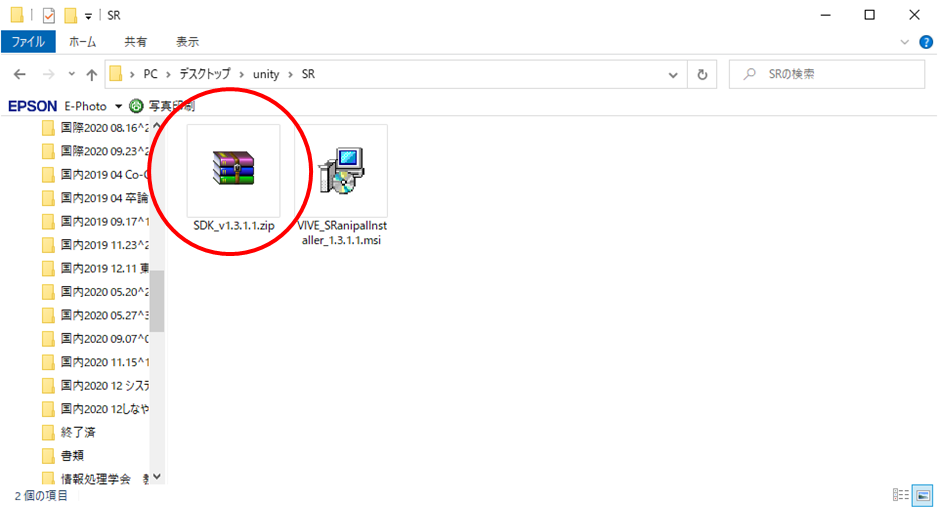

SDKのダウンロードページを開くとVIVE_SRanipalRuntimeとSDKのダウンロードあるので規約に同意してダウンロードする.

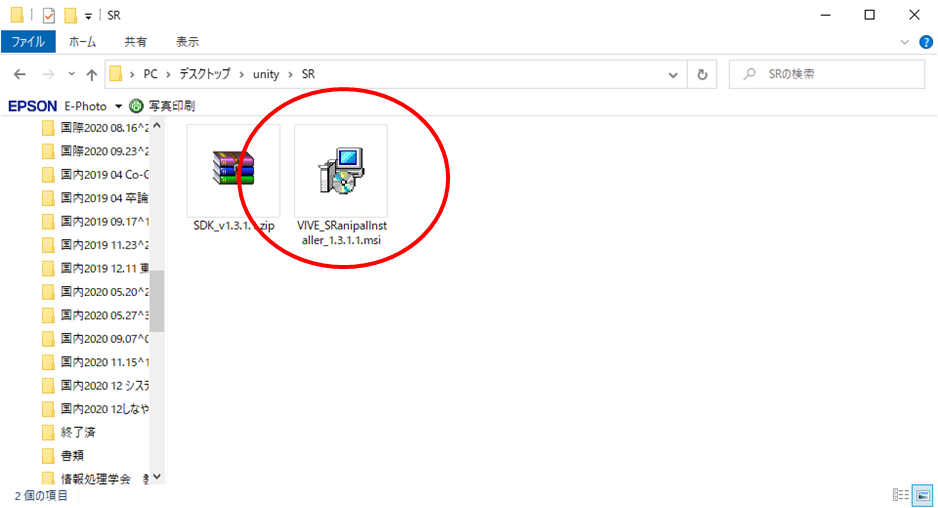

まずダウンロードしたVIVE_SRanipalRuntimeをインストールする.

ロボットがアイコンのSRanipalRuntimeがインストールされる.

SRanipalRuntimeが動いているかはタスクバーのインジケータから確認ができる.ロボットのアイコンが表示されていれば問題なく起動している.

2.アイトラッキングのキャリブレーションを行う.

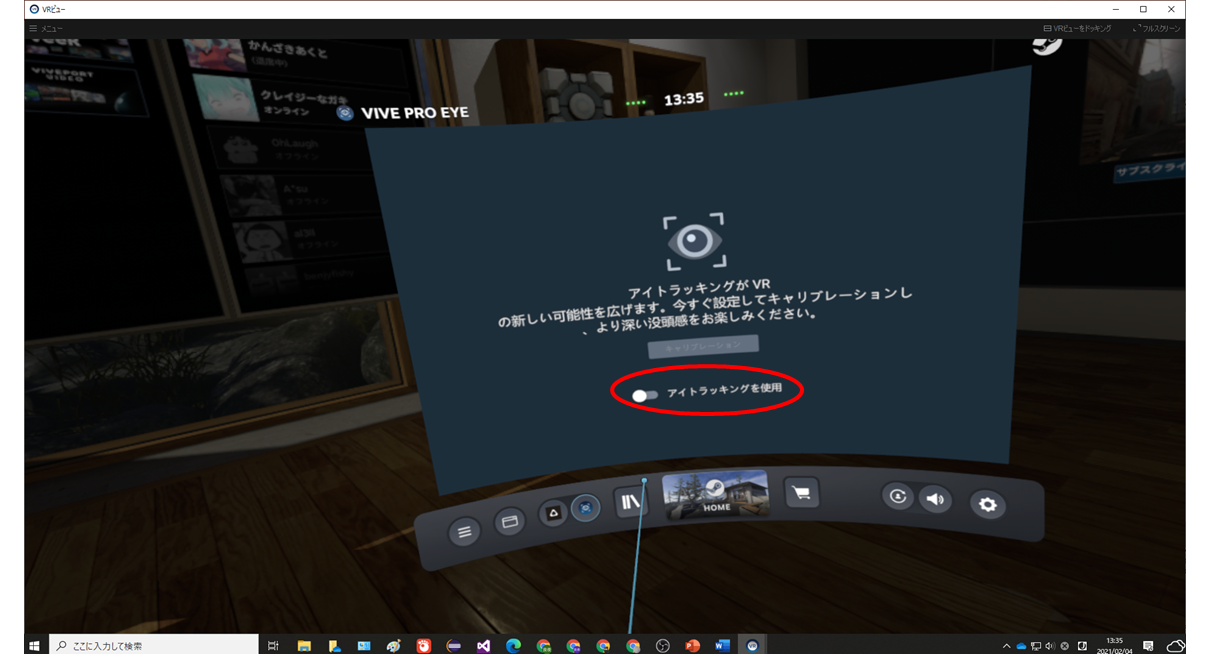

SteamVRを起動し,メニューを開き「VIVE PRO EYE」アイコンを選択する.

アイトラッキングの設定画面が表示されるのでアイトラッキングを使用を有効にする.

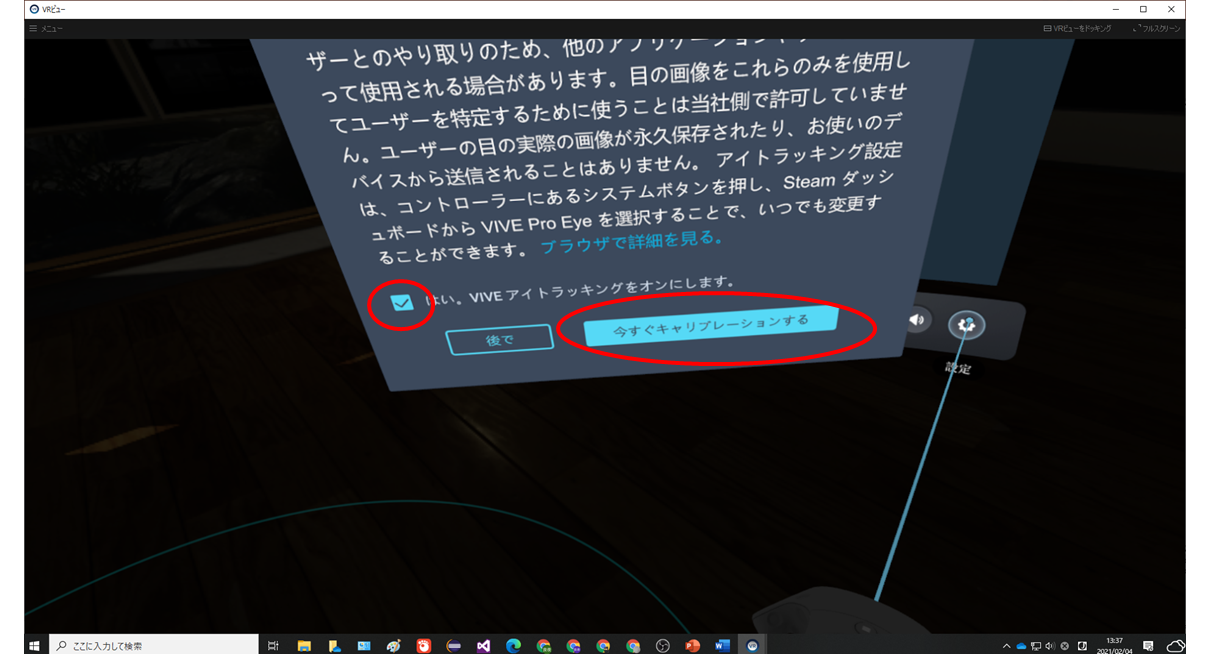

初回起動時には注意事項等が表示されるのでチェックした後「今すぐキャリブレーション」を選択.

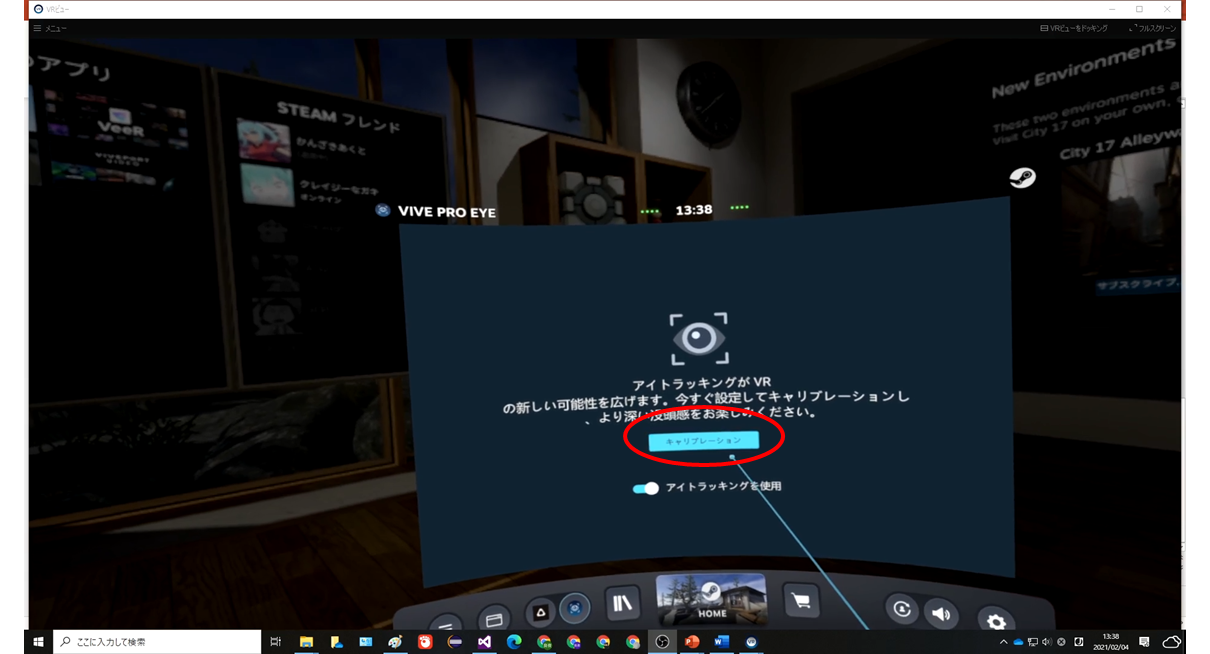

アイトラッキングが有効になっているので「キャリブレーション」を選択する.

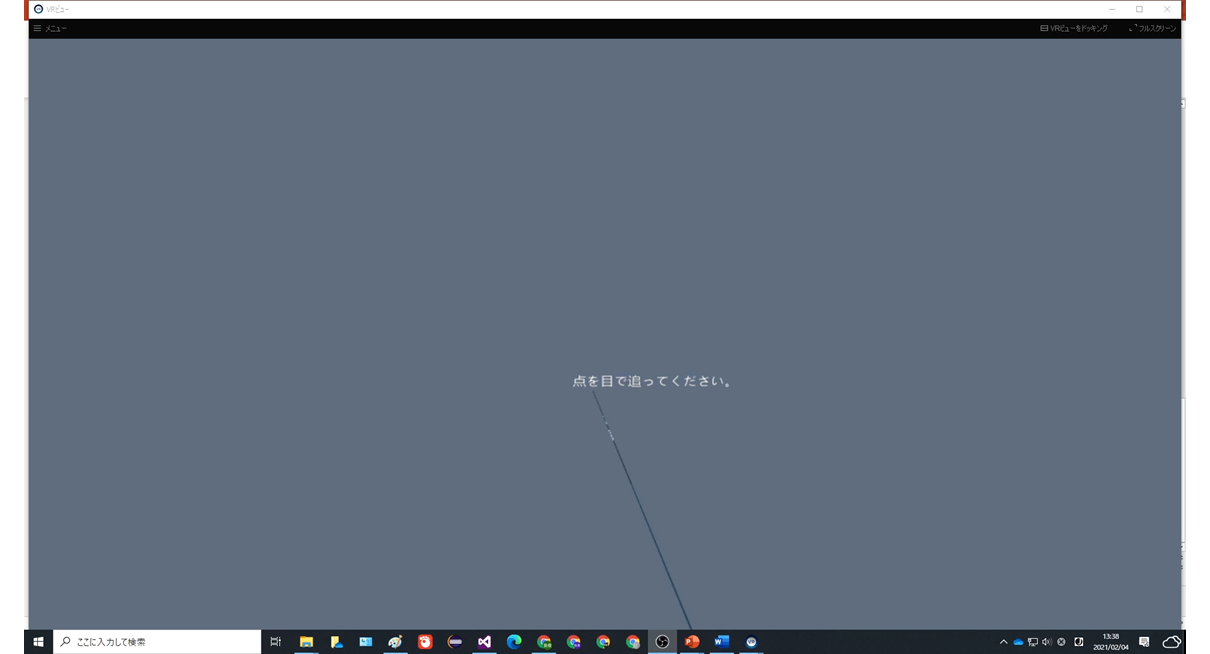

キャリブレーションのための指示が表示されるのでそれに従って設定していく.

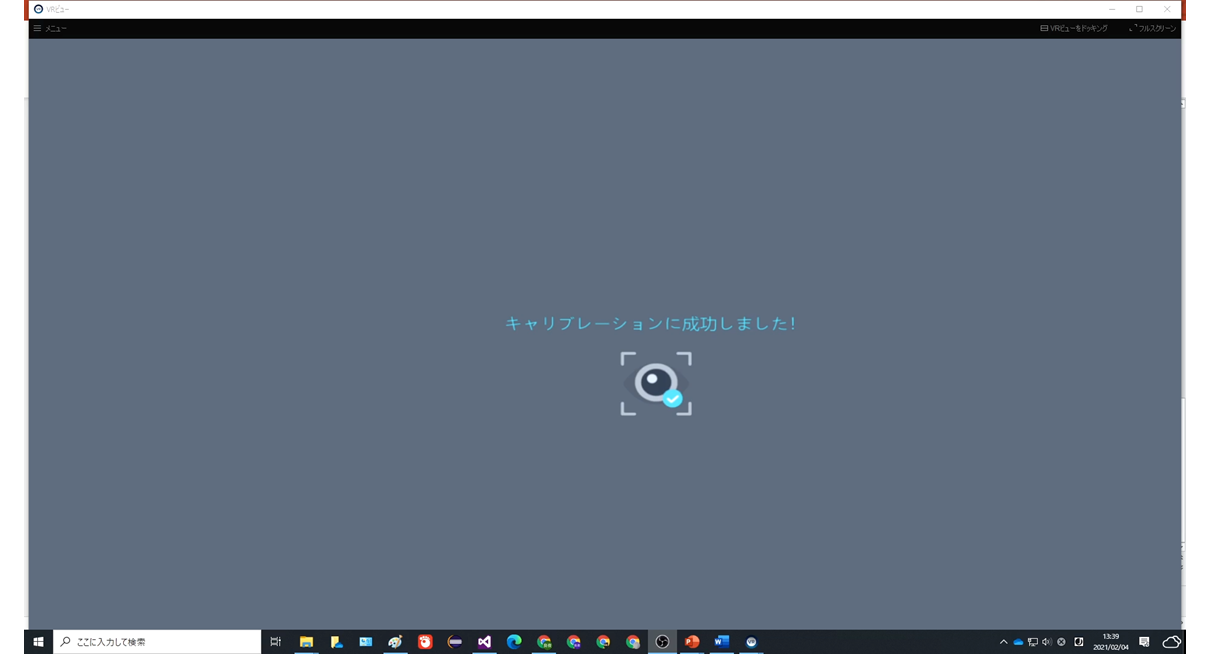

すべて終了するとキャリブレーションに成功しましたと表示される.

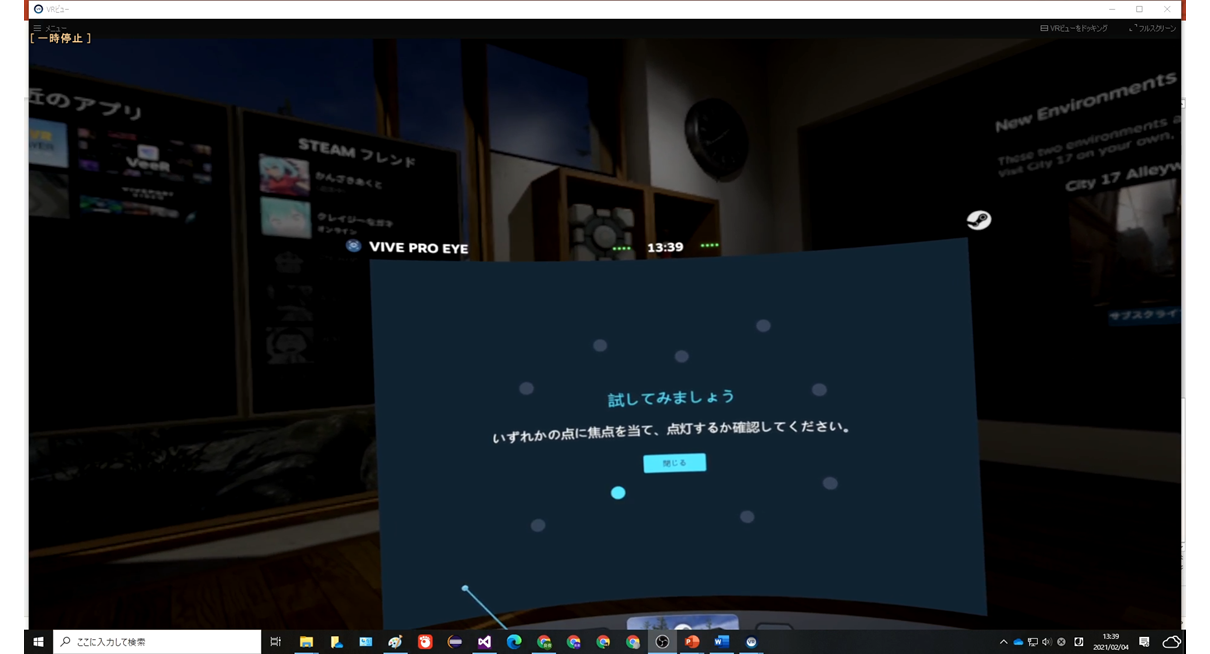

しっかりとキャリブレーションされていれば視線を合わせた点が点灯するので確認してみる(精度は相当いいので違和感があればキャリブレーションしなおしてみる).

3.サンプルを動かしてみる.

次にUnity上でアイトラッキングのデータを使用するために先ほどダウンロードしたSDKを解凍する.

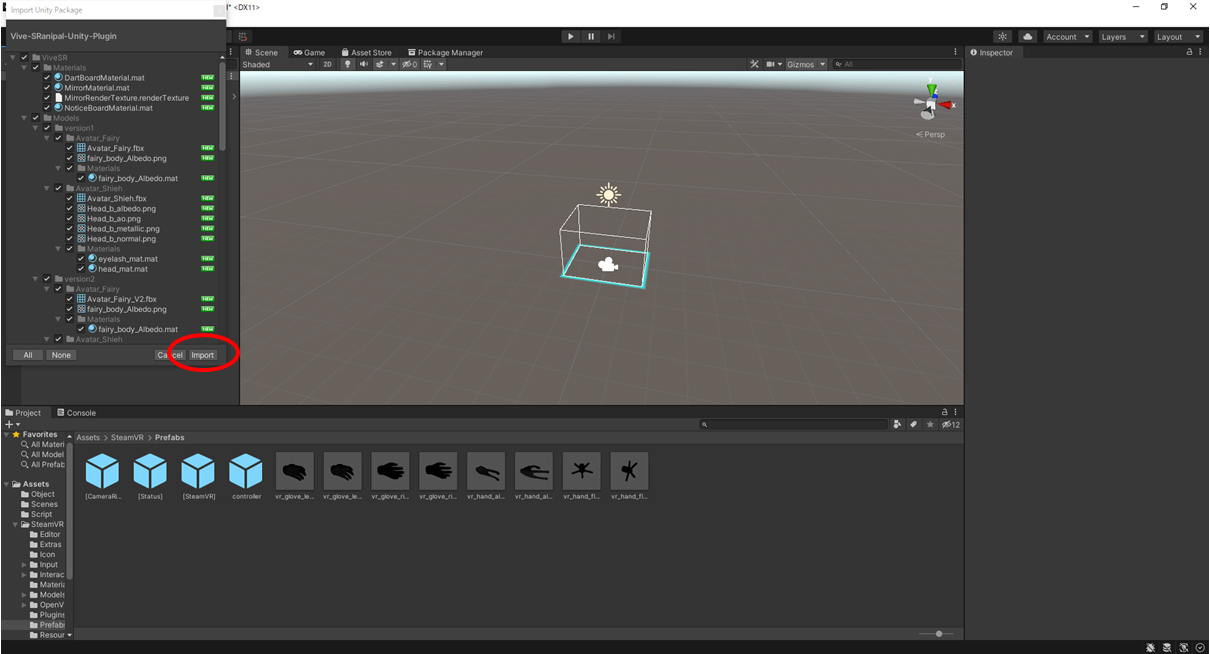

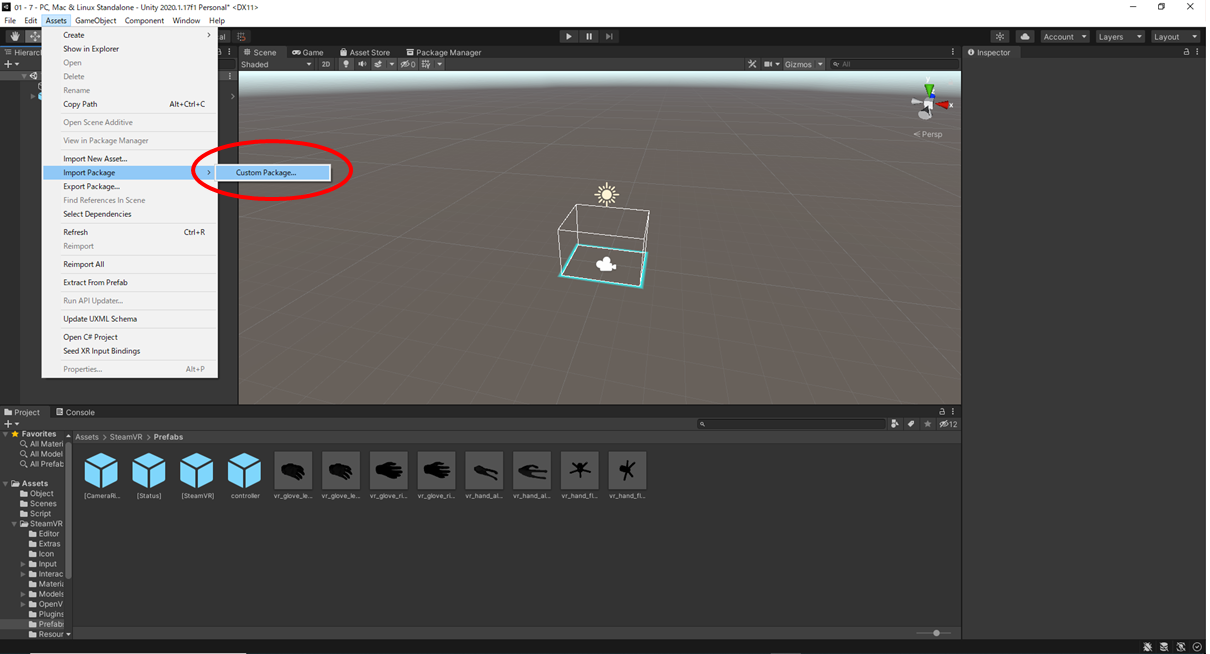

あらかじめSteamVR Pluginがアセットに追加されているUnityプロジェクトを開きAsetsタブからImport Package→Custem Packageを開く.

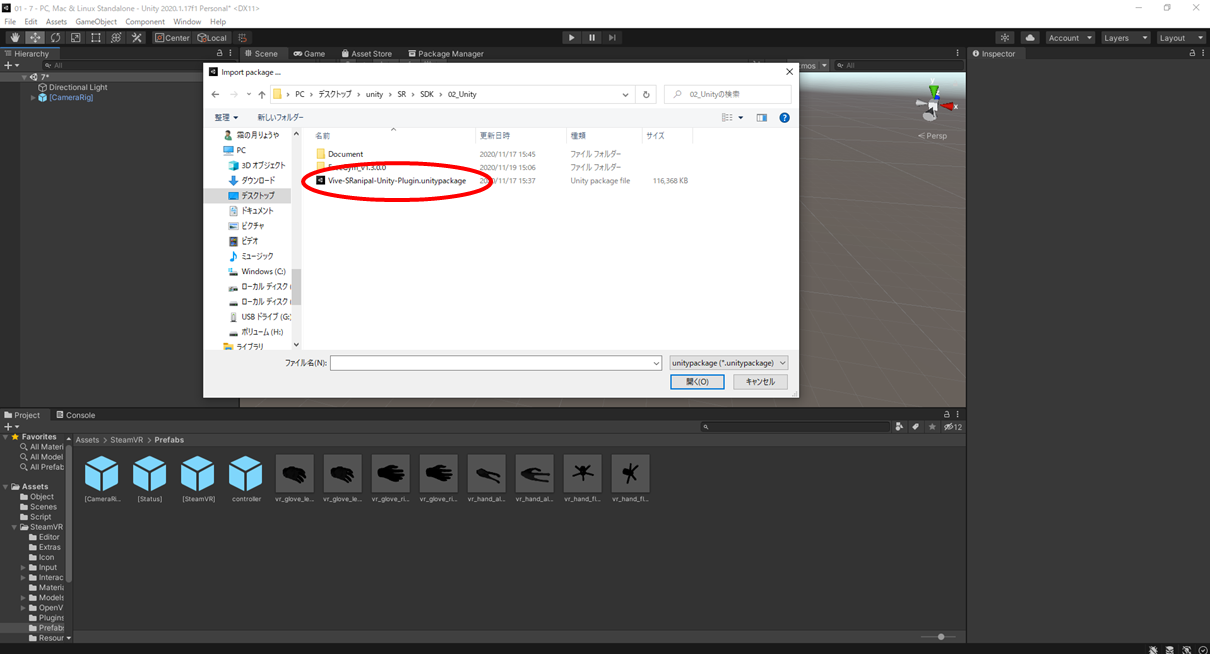

先ほど解凍したSDKの..SDK(v1.3.3.0等)/SDK/2_Unity/にある「Vive-SRanipal-Unity-Plugin.unitypackage」を追加する.

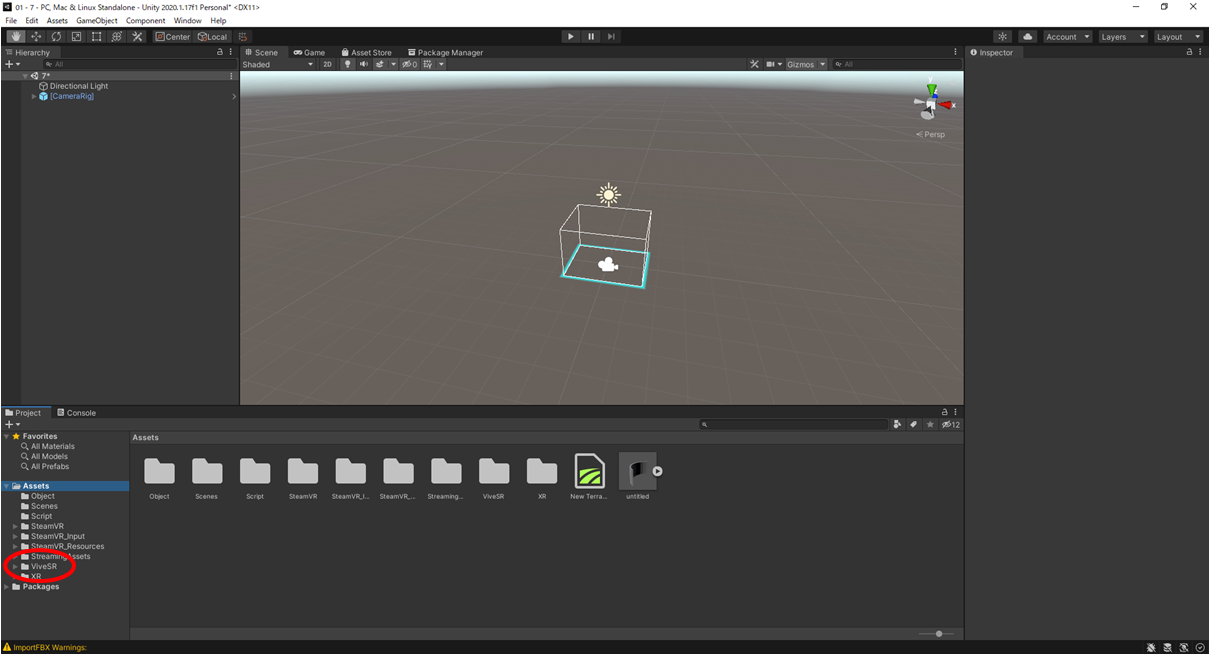

ViveSRというフォルダが追加されていれば問題なく追加されている.

追加されたViveVR/Scenes/Eyeフォルダ内にあるEyeSampleを開いて実行するとおっさんが自分の目と連動して動く(正直キモイ).

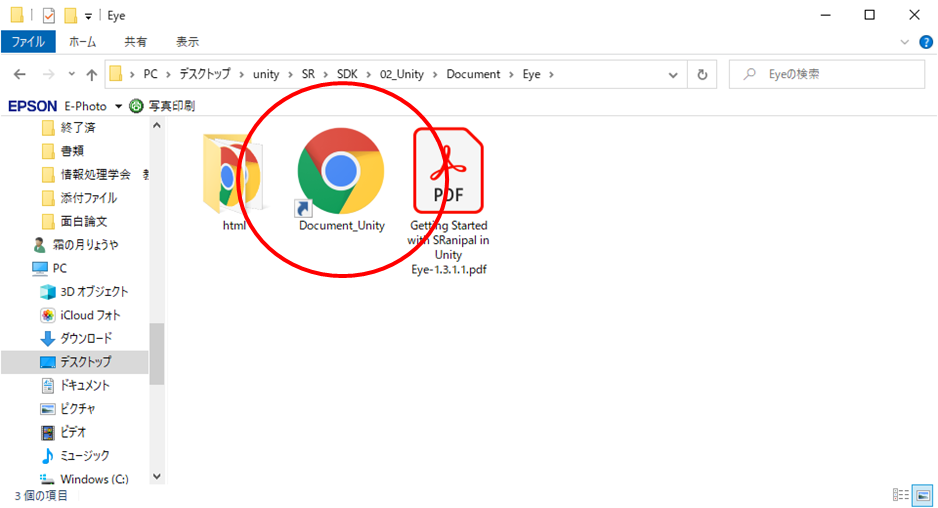

解凍したフォルダ内の..SDK(v1.3.3.0等)/SDK/2_Unity/Document/EyeにあるDocument_Unityから開発のためのドキュメントを見ることできる(次回は実際にこれを使ってプログラミングします).

とりあえずこれでHTC VIVE Pro Eyeを使ったアイトラッキングのセットアップと開発環境の準備ができました.次回は実際にデータを瞳孔や瞼の開き具合,注視点等のデータを取得していきます.