はじめに

MIDIデータではドレミが60、62、64など数字になっており、それが時系列順に並んでいます。

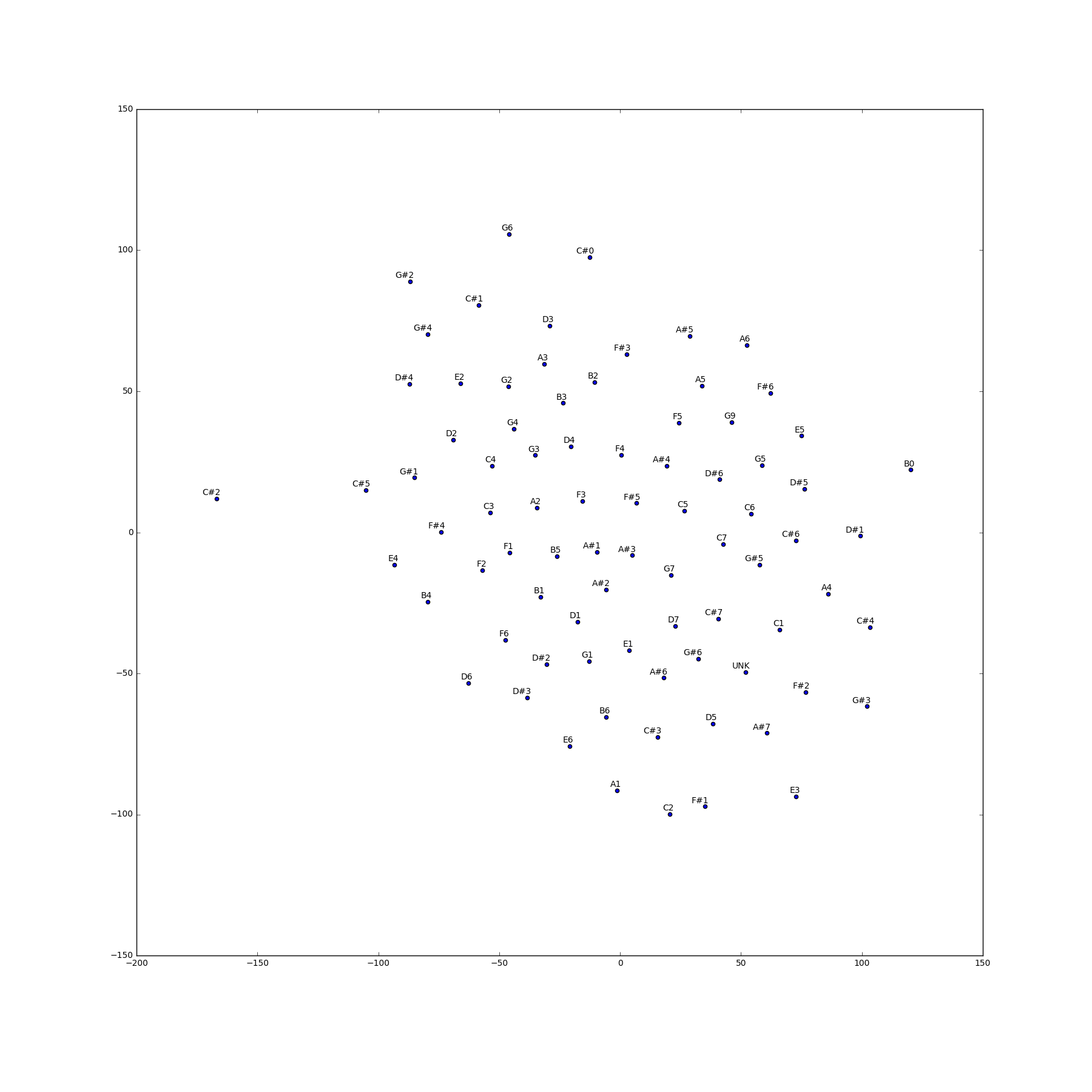

そこでMIDIデータを元に、word2vecで、音をベクトル化し、類似度を画像で表現したいとおもいます。

word2vecについては、下記の記事などを参考にしました。

下記のページなどを参考にさせていただきました。

- 絵で理解するWord2vecの仕組み

- TensorFlow Tutorial / Vector Representations of Words

- TensorFlow Tutorial / word2vec_basic.py

用いたデータセット

コード

GitHubにJupyter Notebookを置いてあります。

結果

感想

あまり画像を見ても納得感が得られず。。

C3,C4,G3,G4が近くにあるところは、それっぽいかな。

パラメータの調整をもっとすべきかと思います。

また学習データは、10万曲を全て1つに繋げてしまっており、曲と曲の接続部分が考慮できてないことなどは修正できそうです。