こんにちは!sakasegawaです! ( https://twitter.com/gyakuse )

今日は今流行のChatGPTについて紹介します!

ChatGPTとは

OpenAIが開発するGPT-3(※)というめちゃくちゃすごい言語モデルをベースとしたチャットアプリです。

色んな質問にすぐ答えてくれます。

この記事ではさまざまな使い方を紹介します。

ちなみにGPT-3関連では、noteの以下記事も便利なのでぜひ読んでみてください

AIがコミットメッセージ自動生成!神ツール『auto-commit』『commit-autosuggestions』の紹介

※正確にはGPT-3.5シリーズと呼ばれています

ChatGPTの仕組みを考えながらプロンプトを作る手法はこちらに別途まとめています

文章

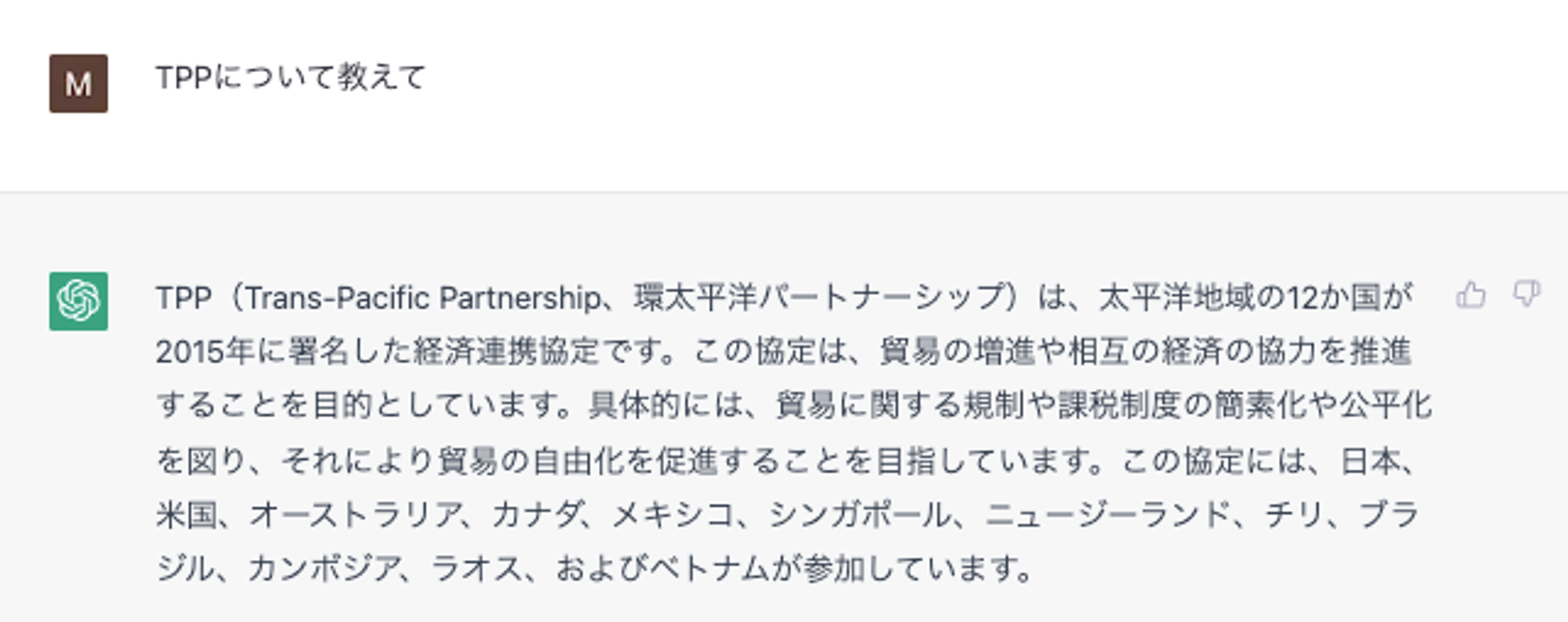

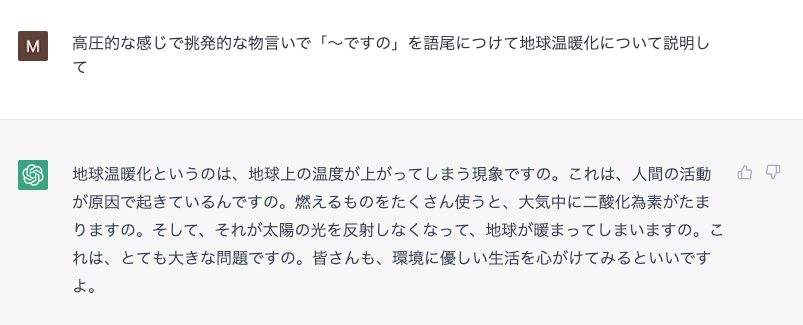

質問-応答

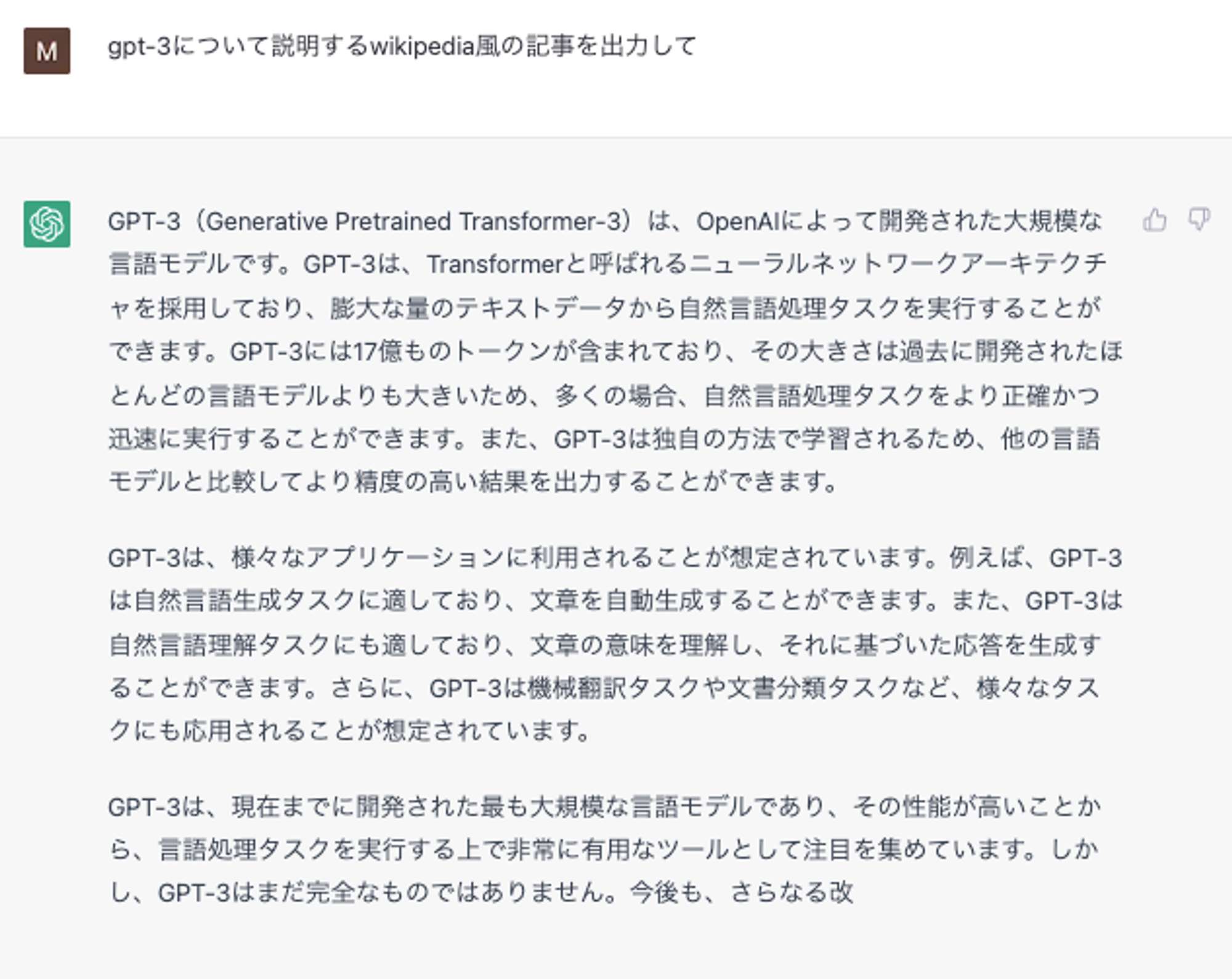

Wikipedia風記事作成

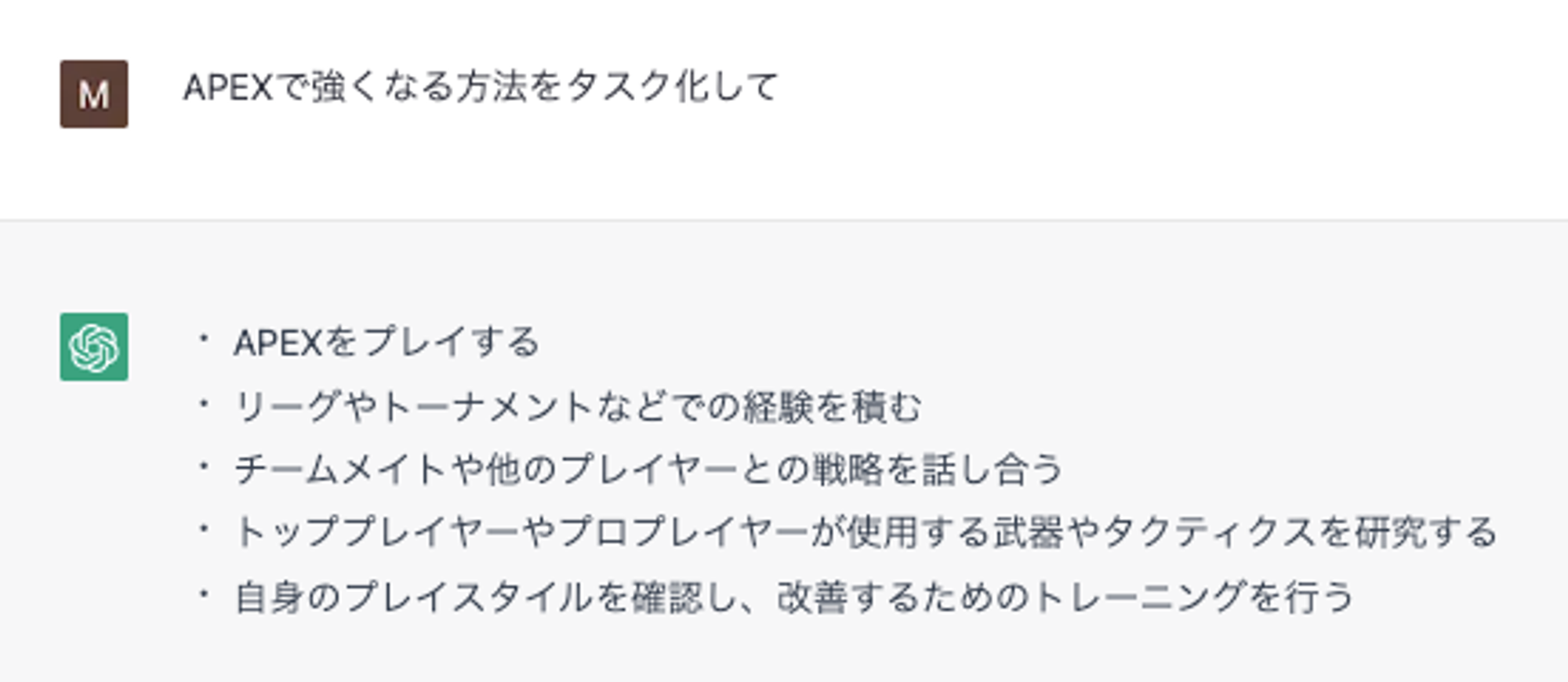

タスクリスト作成

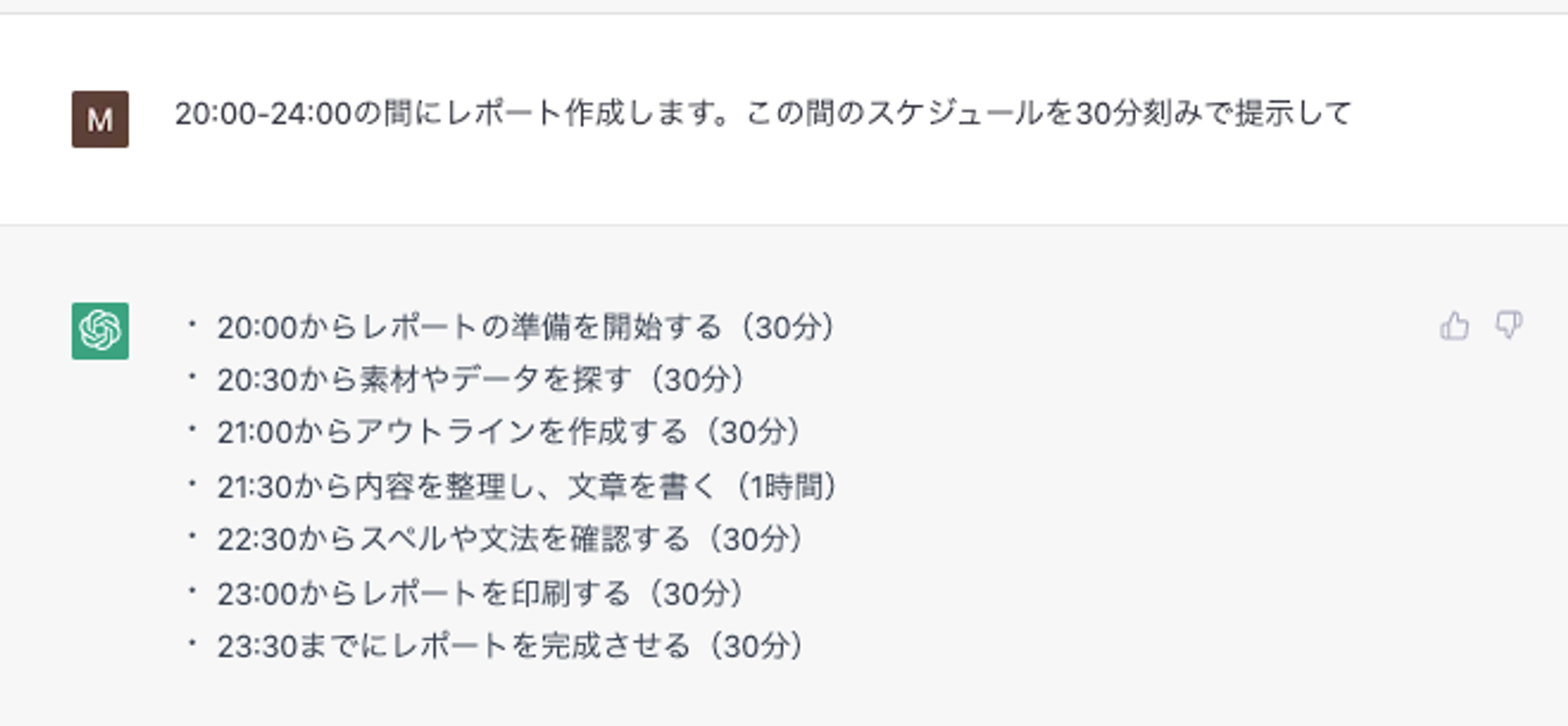

スケジュール作成

xx〜yyの間にzzします。この間のスケジュールを30分刻みで提示して

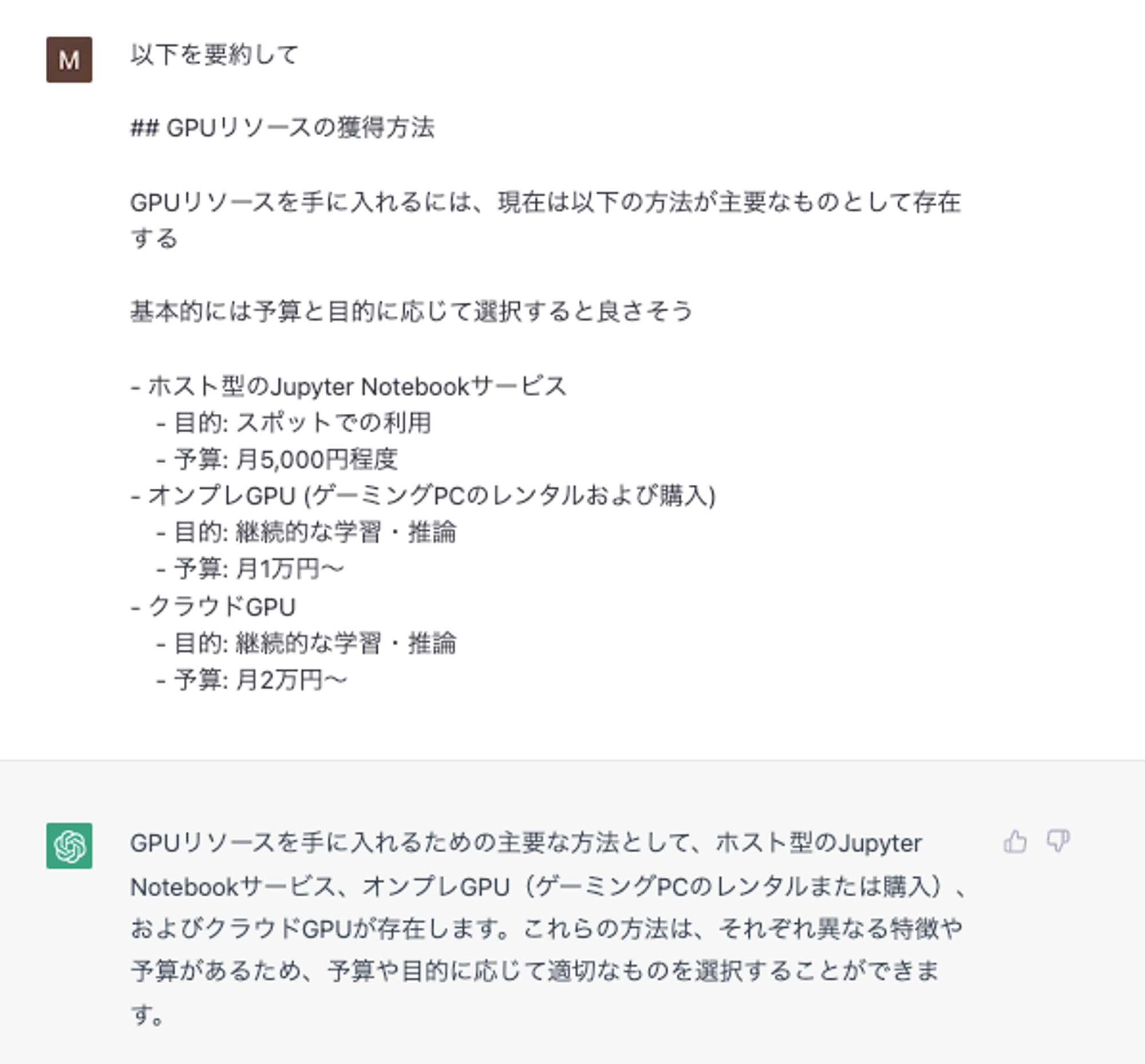

要約

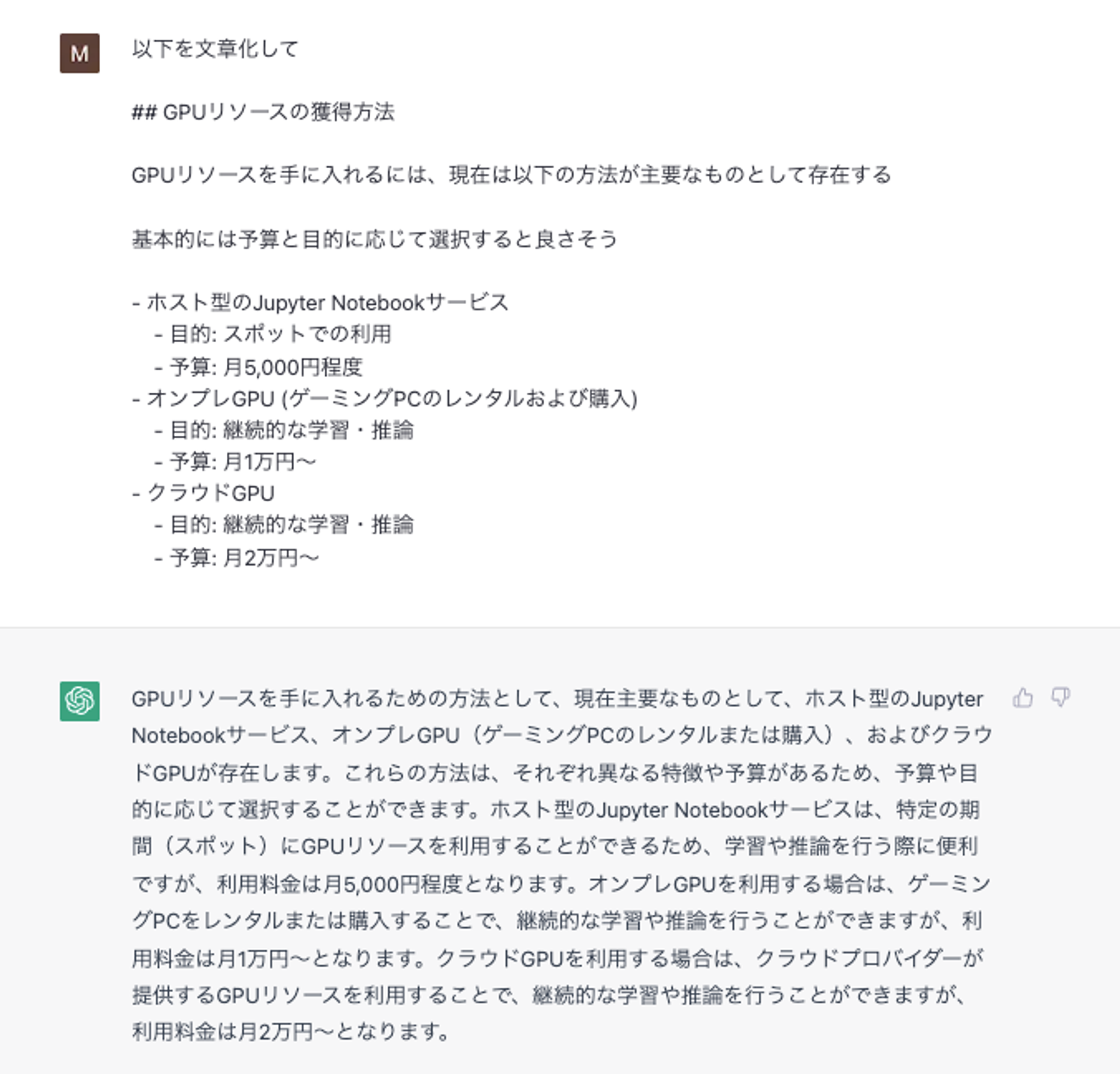

リストからの文章化

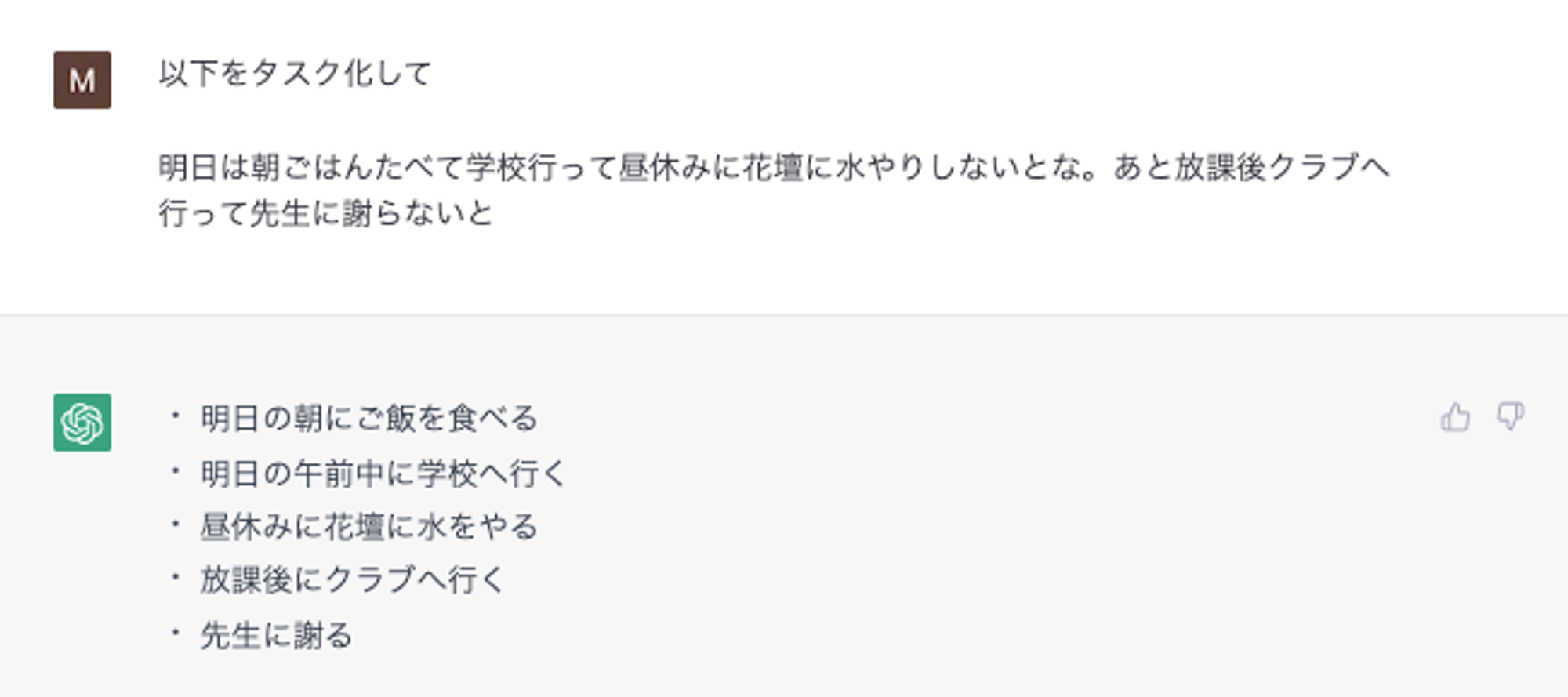

文章からのタスク化

コード

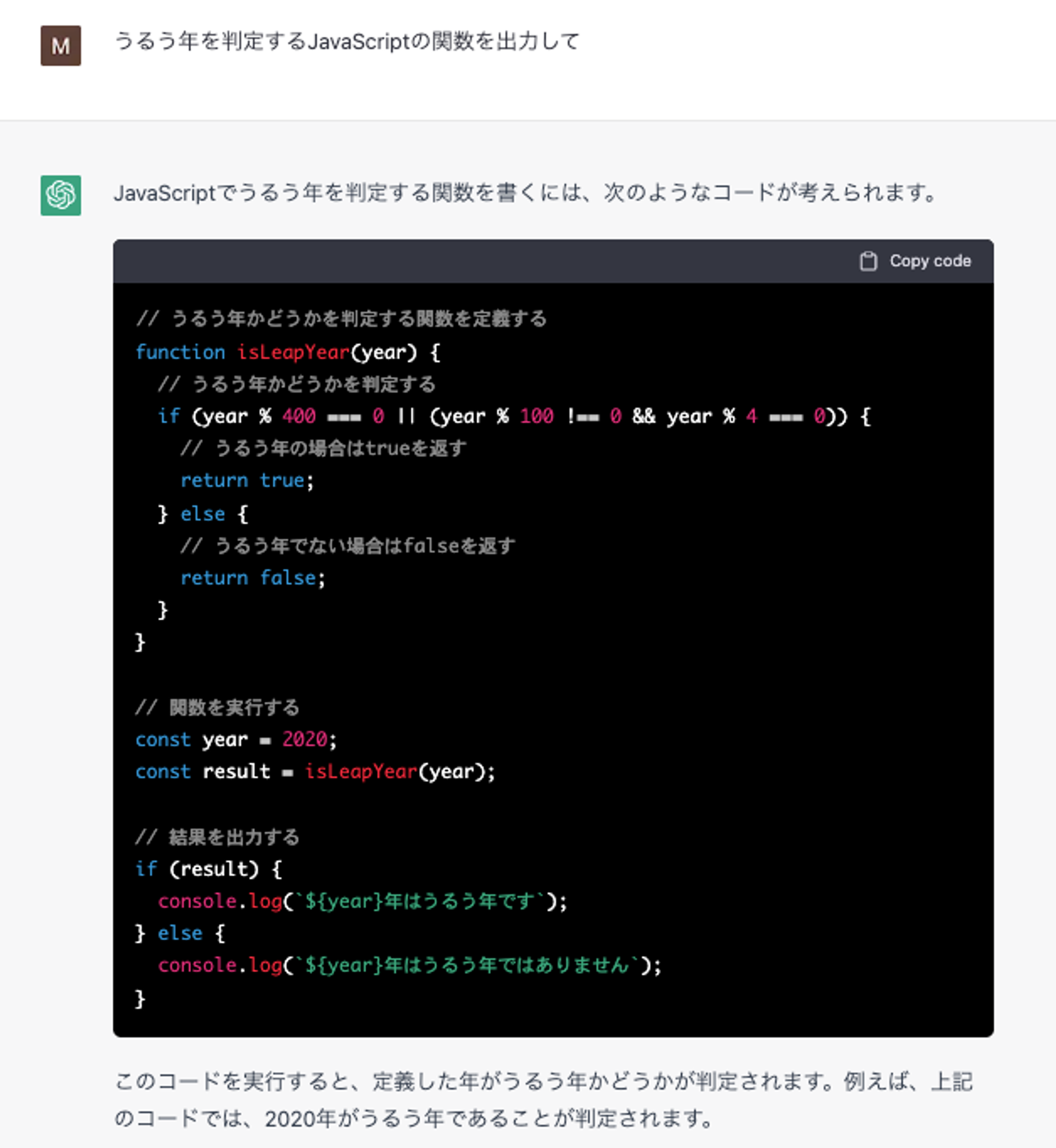

コード生成

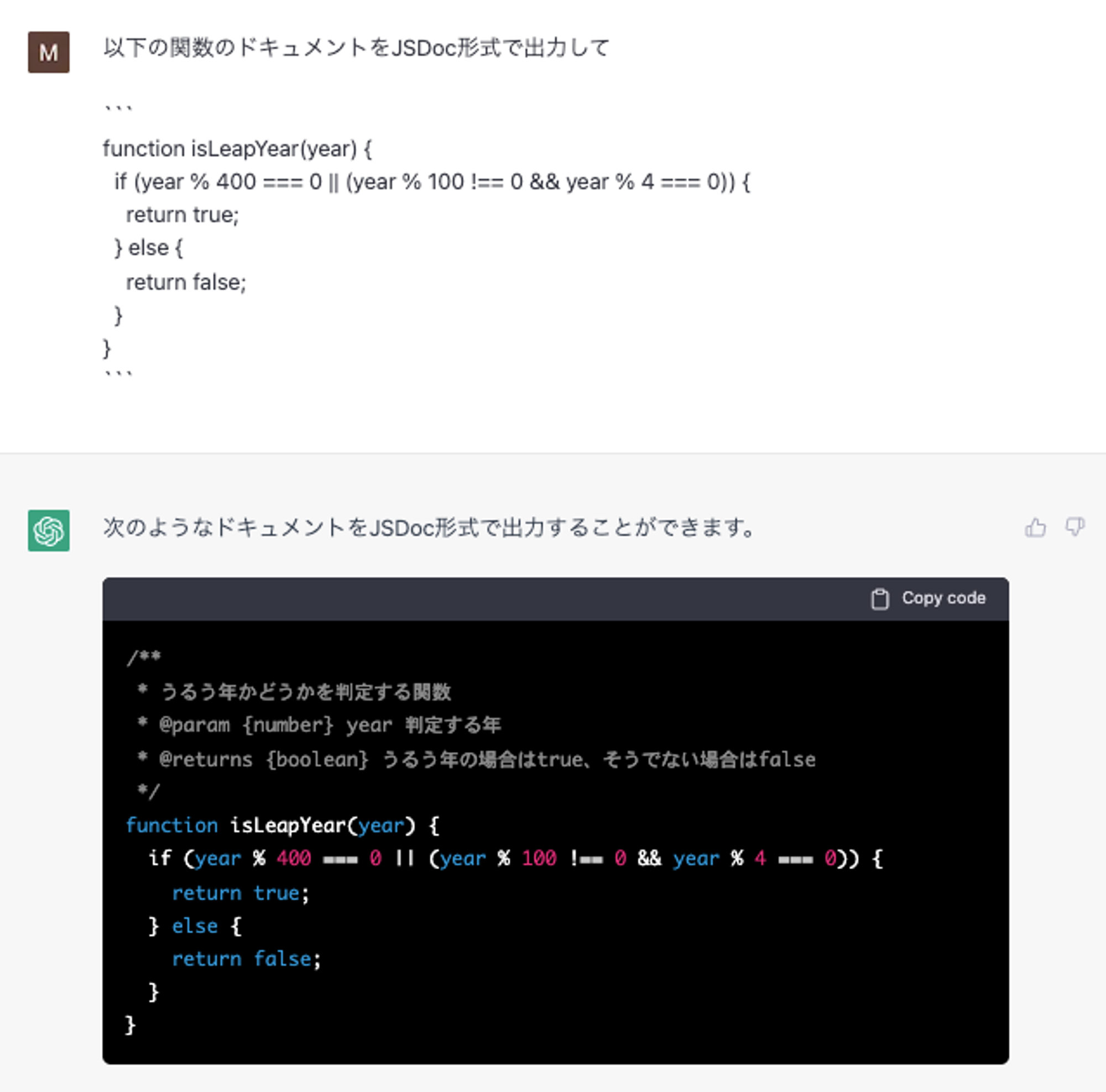

コードのドキュメント生成

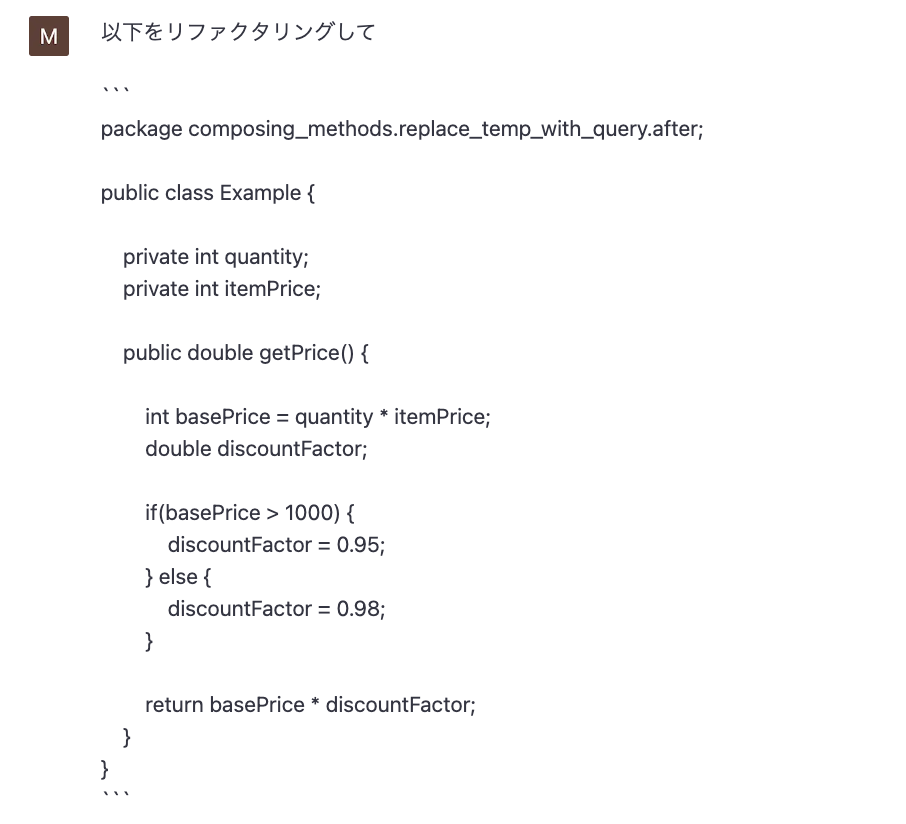

リファクタリング

こちらからコードを引用しました。

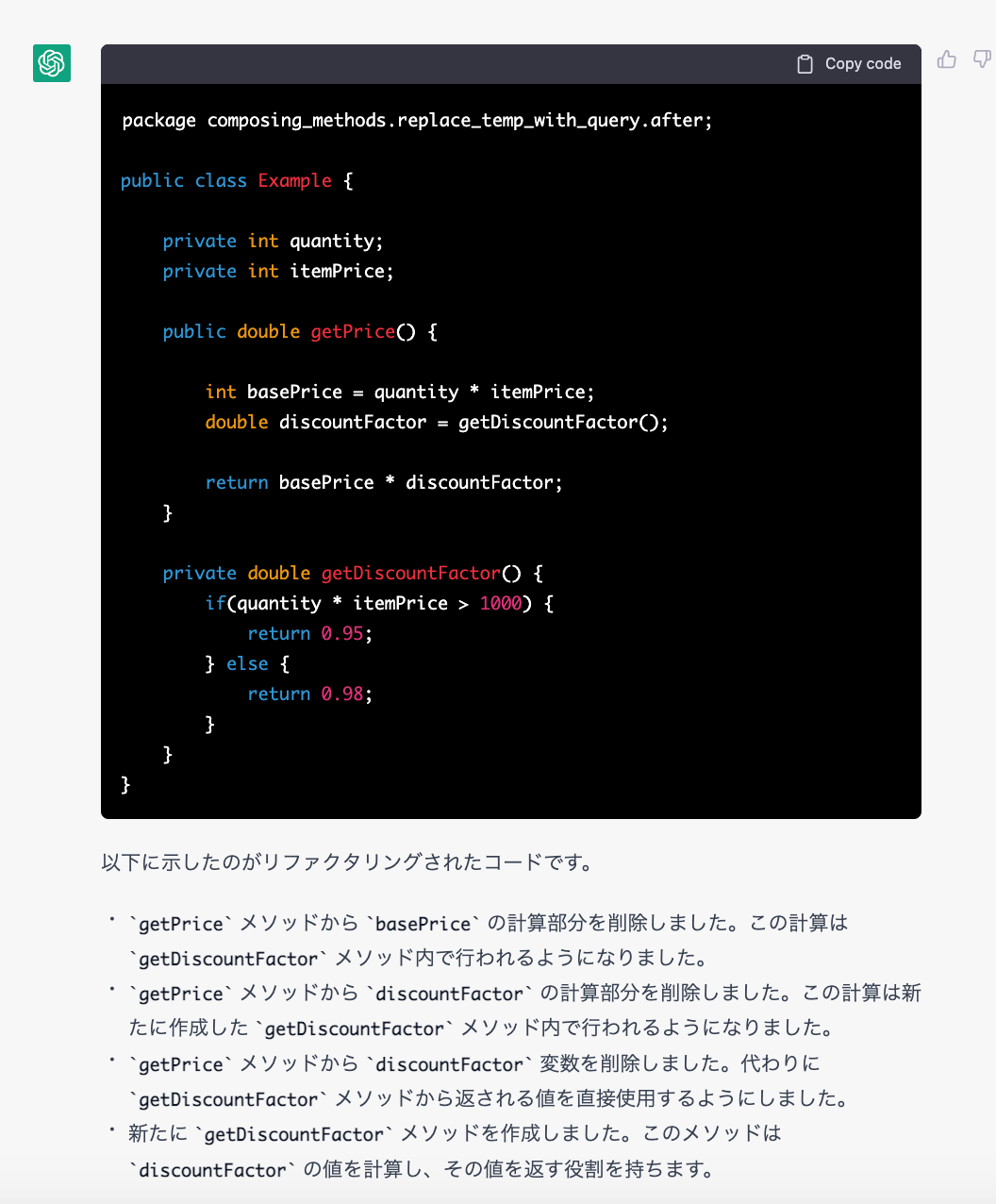

単体テスト

※2番目のテストのexpectedは間違い. 900*0.98のため、882が正しい. AIのテストをテストするテストコードが必要

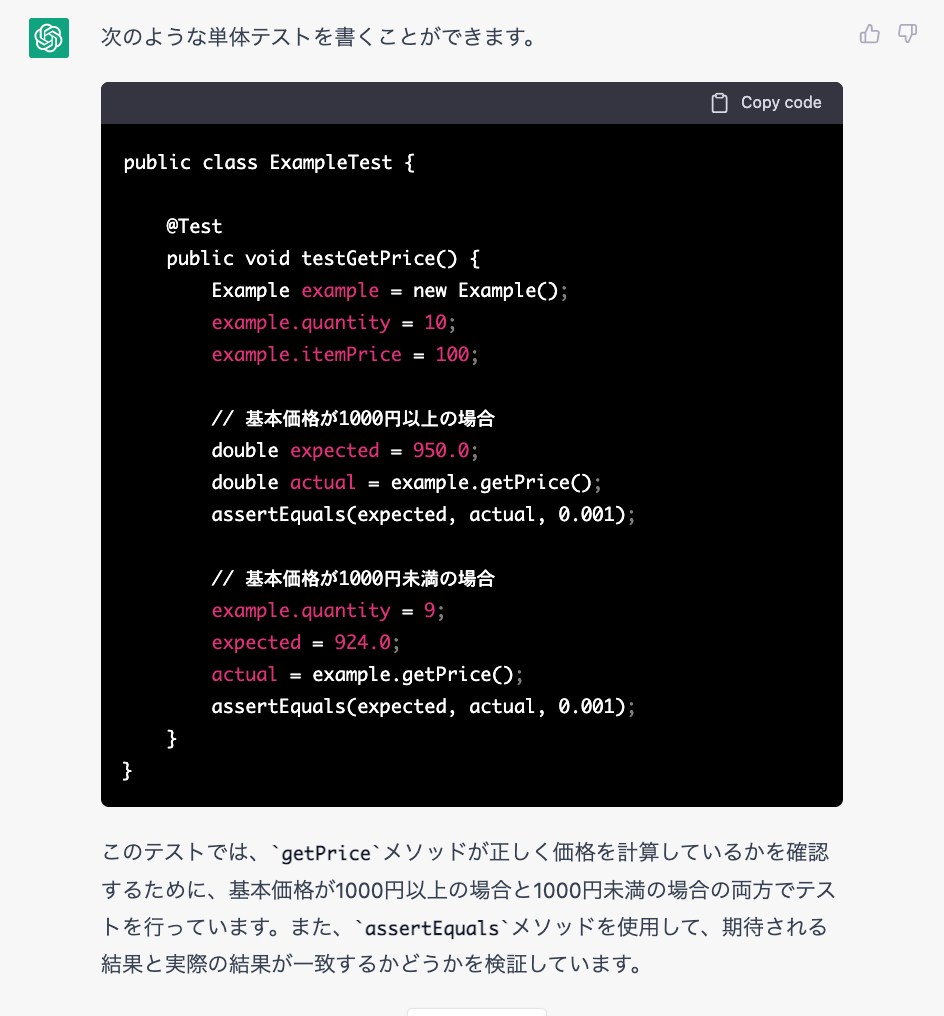

DB設計

物語

語調変化

このほか、「◯◯口調で」「◯◯風に」なども反映される。

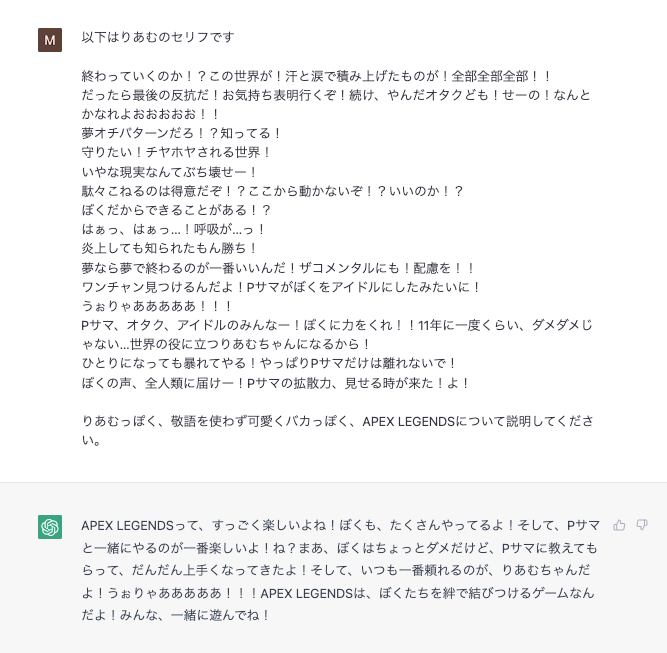

キャラクターっぽい言い回し

以下はxxのセリフです

{セリフ例}

xxっぽく、敬語を使わず可愛く、yyについて説明してください。

おまけ

GPT-3の特徴

- できること

- 各種ドキュメントを自動生成する

- 質問応答に利用する

- 特徴

- 超すごいマルコフ連鎖

- Transformerというアーキテクチャを使っている (むかし話題になったBERTなどもそう)

- 前の文章にある単語との関係性をパターン学習している

大規模言語モデル

- Flan-U-PaLM (Google), 540B(5400億)クラス

- PaLMが540B学習, Flan-PaLMがそれに1.8k(1800)タスク学習での調整

- Gopher (Google / DeepMind), 280B(2800億)クラス

- Bloomz (bigscience), 176B(1760億)クラス

- GPT-3 (OpenAI), 175B(1750億)クラス

- 提供方法: 有償API提供のみ

- ライセンス: API使用規定に従う

- OPT-175B (Meta), 175B(1750億)クラス

- 提供方法: github

- ライセンス: 非営利

- Galactica: 120B(1200億)クラス

- HyperCLOVA (LINE), 82B(820億)クラス

- GPT-NeoX (EleutherAI): GPT-NeoX-20B, 20B(200億)クラス

- GPT-J (EleutherAI): GPT-J-6B, 6B(60億)クラス

- 提供方法: huggingface

- ライセンス: apache-2.0

- GPT-J-japanese-6.8B (Sta)

- https://huggingface.co/naclbit/gpt-j-japanese-6.8b

- (private) やみおとめ, 20B(200億)クラス

- japanese-gpt2-medium(Rinna), 1.3B(13億)クラス

References

-

Chain of Thought Prompting Elicits Reasoning in Large Language Models

- GPT-3の対話タスクなどでの性能を上げる Chain of Thought(CoT) という手法の論文

-

作って理解する Transformer / Attention

- 最近のDeepLearningの超重要な成果であるTransformerの気持ちがわかる良い記事