はじめに

生成AIを使った開発支援に興味はあるけれど、

- Claude Code / Cursor / GitHub Copilot は有料で、試すのにハードルが高い

- まずは無料や従量課金で小さく試してみたい

という方に向けて、今回は 「VSCode拡張 Continue × AWS Bedrock × MCP」 を組み合わせて使ってみた内容を備忘録としてまとめてみました。

この記事では、VSCode拡張「Continue」を使って、

- 公式ドキュメントを検索して要点の整理

- Terraformコードの生成

- GitHubプライベートリポジトリへの「Issueの解析 → 作業ブランチの作成 → コード修正 → Commit・Push → MR作成」という一連のフローの自動化

といった開発支援を簡易的ですが、試しています。

使用する技術

-

- オープンソースのVSCode拡張

- GPT / Claude と接続可能

- チャット・コード補完・コード生成などの支援ができる。

-

- AWSの生成AI基盤

- Claude 3.7 / Claude 4.5 / Llama など複数モデルが利用可能

- 従量課金制なので、少額から試せる。

-

- LLMを外部ツールやデータソースに接続するプロトコル

- AIエージェントと外部システムを連携させ、AIの能力を拡張できる。

- 詳細解説はこちらがわかりやすかったので、参照ください。

- 公開されているMCPサーバ例

初期設定

1.AWS Bedrockのセッティング

Bedrock用IAMユーザーの作成

-

ContinueからBedrockを使用するためのIAMユーザーを作成

- 許可するポリシー:AmazonBedrockLimitedAccess

-

アクセスキーを払い出す

-

補足:

- 2025/7/8以降、BedrockはAPIキーの発行も可能ですが、

Continueではまだ未対応 - 参考

- 2025/7/8以降、BedrockはAPIキーの発行も可能ですが、

-

注意:

- アクセスキーが漏洩した場合、第三者による不正リクエストで高額料金が発生するリスクがあります。

- 必要に応じて特定IPアドレス以外の使用を制限するIAMポリシーを適用すると安全です。

2.Continueの導入

環境:

OS:Windows

VSCode:1.106.3

Continue:1.2.11

Continueのインストール

- VSCodeの拡張機能から「Continue」をインストールする。

Bedrockとの連携

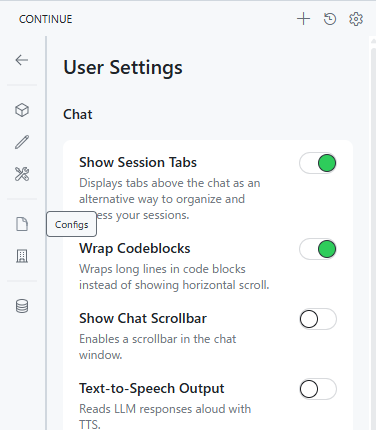

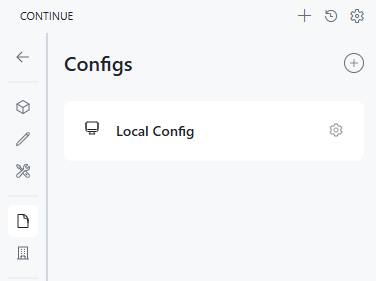

- Continue画面上部の歯車マークを押下する。

- 左メニューバーの「Config」を押下し、Local Configの歯車マークを押下する。

-

config.yamlが開くので、設定を行う。- 今回は低コストでお手軽に利用したいという目的のため、「Claude Haiku 4.5」を選定しています。

name: Local Agent

version: 1.0.0

schema: v1

models:

- name: Claude Haiku 4.5

provider: bedrock

model: arn:aws:bedrock:ap-northeast-1:<AWSアカウントID>:inference-profile/global.anthropic.claude-haiku-4-5-20251001-v1:0

env:

region: ap-northeast-1

profile: bedrock

roles:

- chat

- edit

- apply

defaultCompletionOptions:

contextLength: 200000

capabilities:

- tool_use

-

設定ポイント

-

(参考)Bedrock上の各AIモデルごとの設定例:https://hub.continue.dev/amazon

デモ ① 「簡単な問い合わせ」

デモ ② 「Terraform コードの生成」

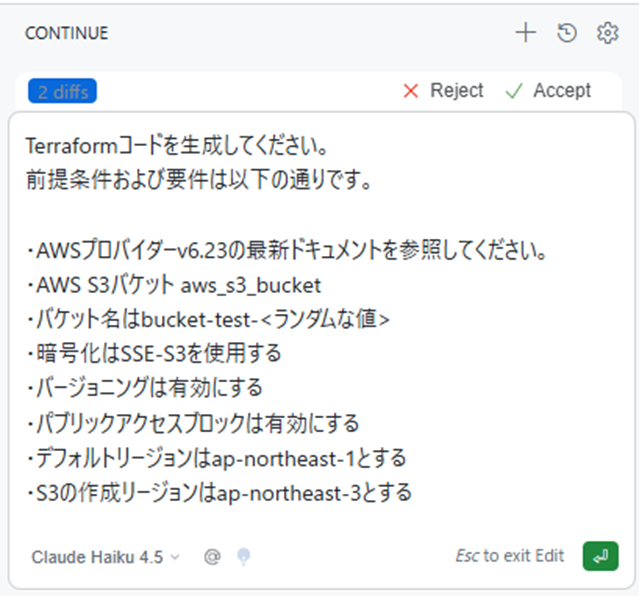

- シンプルにTerraformコードの自動生成を試してみます。

手順

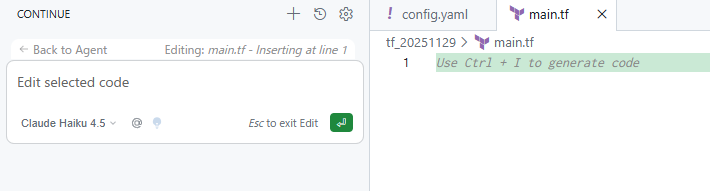

- VSCodeで任意のTerraformファイルを開く。

- 「Ctrl + I」を押下して、ContinueのEditモードを起動する。

- 「コード生成してほしい内容」を入力する。

↓

↓

→ コードが自動生成されました。

※「Claude Haiku 4.5」のトレーニングデータは「2025/07(詳細)」を使用しているため、「2025/06/19」リリースのAWSプロバイダーVersion 6 で実装された「リージョン対応」を使用したコードになっていることもわかります。

- コードレビューし、問題ない場合、

Acceptを押下することでファイルに保存されます。

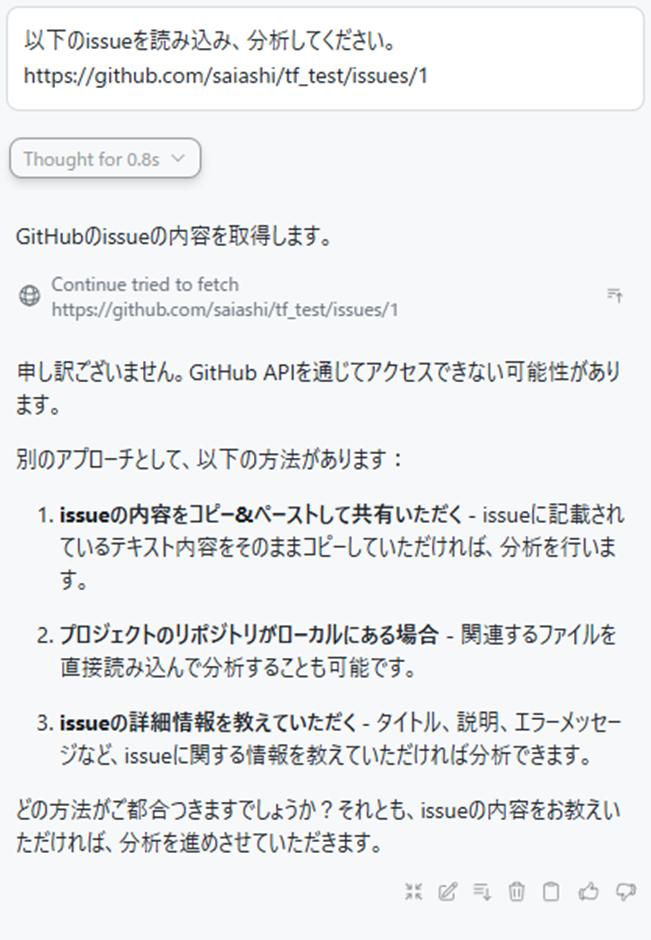

デモ ③ 「GitHub プライベートリポジトリの操作(MCPなし)」

MCPサーバの追加

-

AIモデルだけでは、プライベートリポジトリへの操作は対応できないため、MCPサーバを追加して、

操作できるようにしてみます。 -

今回は、GitHub-MCP-Serverの「Local GitHub MCP Server」を使用します。

-

以下を事前に用意します。今回は詳細な手順は省略とします。

- Docker環境(DockerDesktopなど)

- GitHub PATの生成(アクセストークンの詳細)

※今回のデモでは、「Issueの解析→作業ブランチの作成→コードの修正→Commit/Push→PR作成、コメント投稿」をAIに実施させたいため、以下の権限を付与したものでトークン生成しています。

MCPサーバの設定

- Continue画面で歯車マークをクリックする。

- 「Configs」から

config.yamlを開く。 - 以下を設定に追加する。

mcpServers:

- name: GitHub Local MCP

command: docker

args:

- run

- -i

- --rm

- -e

- GITHUB_PERSONAL_ACCESS_TOKEN

- ghcr.io/github/github-mcp-server:latest

env:

GITHUB_PERSONAL_ACCESS_TOKEN: <事前に生成したPAT>

- 設定後、左メニューバーの「Tools」に、MCPサーバが表示されます。

もし正しく設定されていない場合、この時点でエラーが表示されます。

- 設定ポイント

- PATをOS環境変数から渡そうとしましたが、Continueからコンテナへ渡すことができなかったため、

config.yamlに記述する形を取っています。

- PATをOS環境変数から渡そうとしましたが、Continueからコンテナへ渡すことができなかったため、

デモ ④ 「GitHub プライベートリポジトリの操作(MCPあり)」

→ 「Claude Haiku 4.5」単体では、取得できなかった情報がMCPサーバを使用することでできるようになりました。

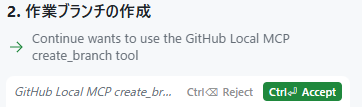

- 注意

- MCPを使用する際は、毎回「許可するか拒否するか」を選択できます。

- 自動承認の設定も可能ですが、MCP利用時には 入力トークン使用量が増加します。

- 特にBedrockのように「トークン単位で従量課金される」場合、常時自動承認するより必要なときだけ承認する方が安心です。

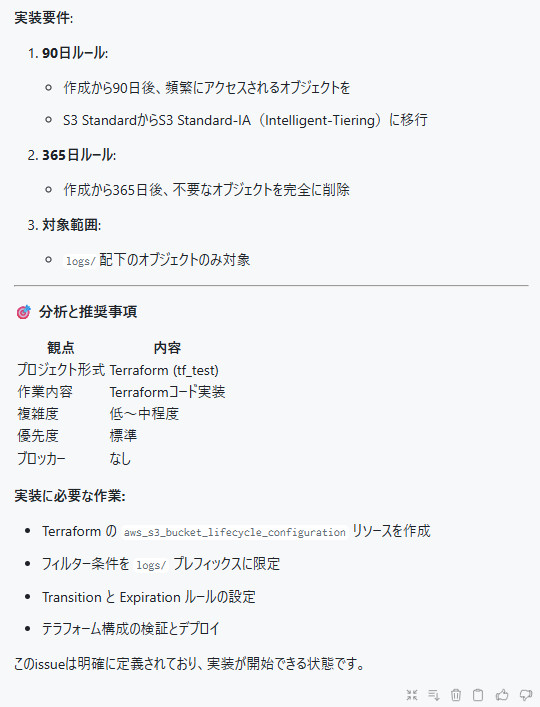

デモ ⑤ 「GitHubプライベートリポジトリへの操作(応用)」

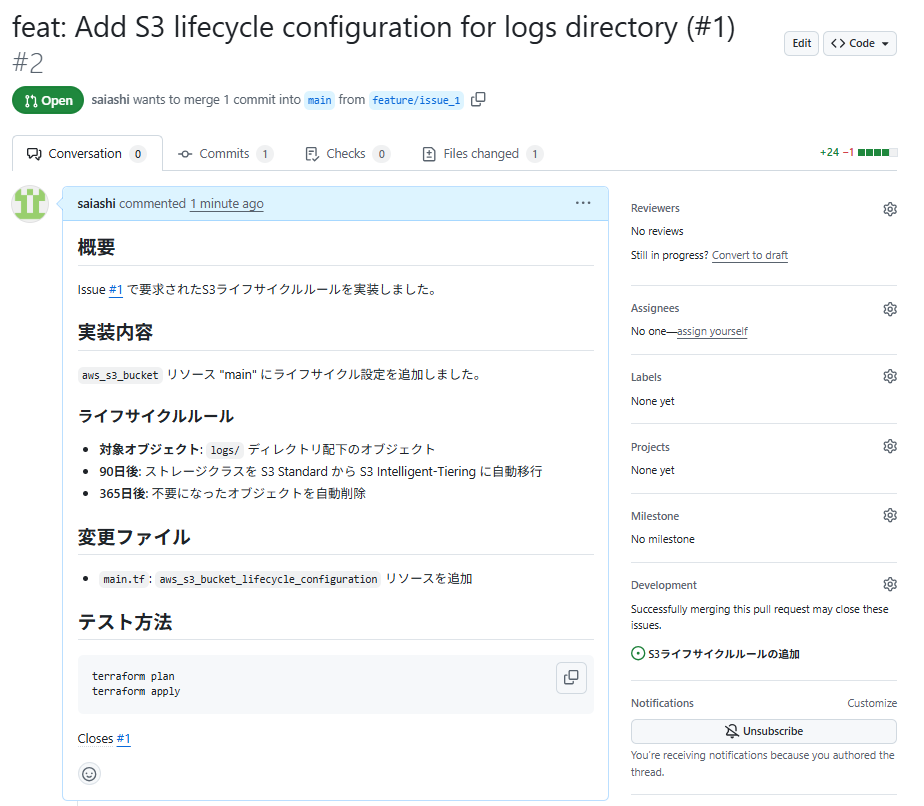

- GitHubのプライベートリポジトリに対して、以下の作業をAIにやってもらおうと思います。

- Issue解析

- 作業ブランチの作成

- コード修正

- Commit・Push

- MR作成

依頼

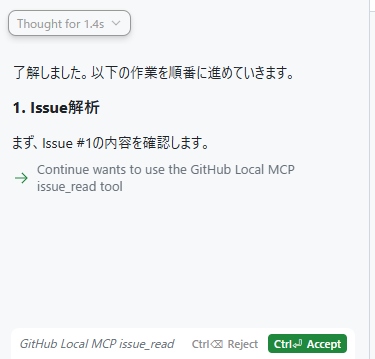

Issue解析

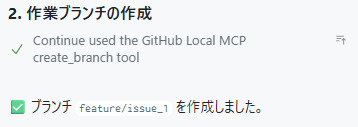

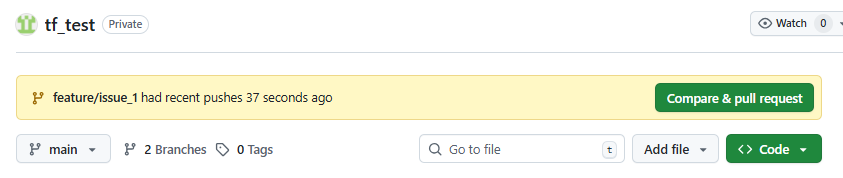

作業ブランチの作成

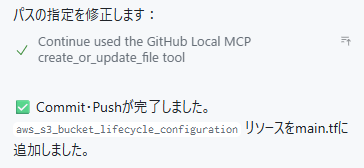

コード実装 → Commit・Push

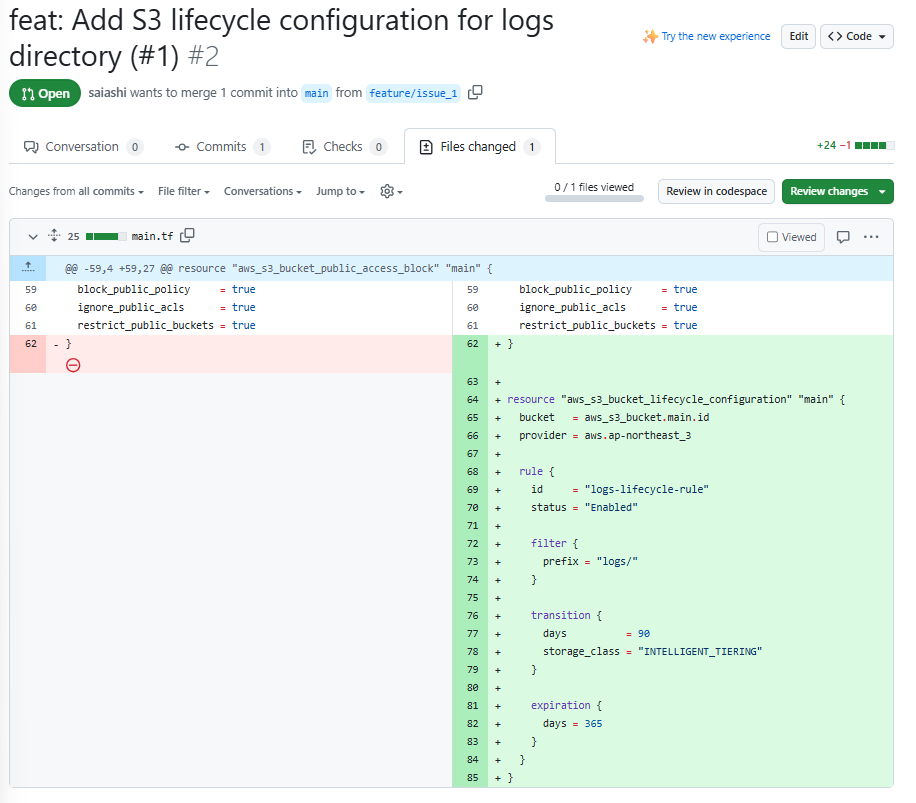

MR作成

- ほんの数秒でMR作成まで実施してくれました。コードもissueの内容をしっかりと網羅されたものになっていました。

注意点

「VSCode拡張 Continue × AWS Bedrock × MCP」 を活用していく上では、いくつか押さえておくべき注意点があります。以下に整理します。

-

ハルシネーション(AIの誤回答)

- Issueを誤って解釈したり、実際には存在しないAPIや構成案を提案する可能性があります。

- AIの回答はあくまで "提案" に過ぎず、必ず人間がレビューして判断することが重要です。

- 特にコード生成やMR自動作成は「正しく見える誤り」が紛れ込みやすいため、細心の注意が必要です。

-

セキュリティ

- GitHub PAT(Personal Access Token)は必要最小限の権限のみ付与する。

- PATやその他の認証情報はローカルでの管理を徹底し、誤ってリポジトリにコミットされないように十分注意が必要です。

- AIへの入力データは外部送信される可能性があることを理解し、入力データには機密情報や内部情報などは含めないようにする。

-

コスト

- Bedrockは従量課金制のため、使い方次第では予想以上にトークン消費することがあります。

- Bedrockの使用トークン量はCloudWatchメトリクスで確認できるため、少額で試したい場合はこまめにチェックすることをおすすめします。

- 特にMCPを使用すると、入力トークンが増加するため、コストが跳ねやすい点に注意が必要です。

- 入力トークン:ユーザーの質問 + MCPの実行結果

- 出力トークン:AIモデルが返す回答部分

実際にかかったBedrockのコスト

参考レベルですが、今回の記事内容以外にも試行錯誤をしつつ、

MCPも組み合わせて20回程度チャットやコード生成を実施した場合のコストは0.52USDでした。

まとめ

- VSCode拡張「Continue」とAmazon Bedrockを組み合わせることで、低コストかつ柔軟性を持った生成AI開発環境を構築することができました。

- 今回のデモでは、ContinueとGitHub MCPサーバーを連携させることで、Issueの解析 → 作業ブランチの作成 → コード修正 → Commit・Push → MR作成という一連のフローを自動化でき、まるで優秀なペアエンジニアが横で作業してくれているような体験が得られました。

- もちろん、誤った修正をそのままPushしてしまう可能性はあるため、最終的な確認やレビューは人間が行う必要があります。しかし、AIに「作業」を任せ、人間は「指示」や「判断」に集中できるという点で、「AIと人間のペアプロ」がより実用段階に入ってくると感じました。