(2020/10/21追記: Visual Recognitionサービスは2020/10/16より使用料金のかからないLite Planでの新規利用ができなくなりました。新規は有料のStandard Planのみとなりました)

IBM CloudのVisual Recognitionは自分の写真を学習させてカスタムクラスを作成することができます。たとえば複数の猫を飼っていたら、それぞれの猫の写真を学習させて、写真による名前当てなんてこともできるのです。

ここでは、Visual RecognitionのWebからのカスタムクラスの作成方法を解説します。尚Web画面やその操作はコロコロ変わりますので、ある時点で操作方法が変わってしまっているかもしれないのでご了承くさい。

こちらは 以下の時点の情報です:

- 2020年5月13日

コマンドの操作であれば、時間が経ってもほぼ変わっていませんので、コマンドがお得意な方は、公式のこちらを参照ください。

0. 前提はIBM Cloudのアカウントがあること

前提は有効なIBM Cloudのアカウントがあることです。

お持ちでないかたは こちら から取得お願いします。

取得方法の動画はこちらです: https://youtu.be/Krn1jQ4iy_s

1. 学習用写真ファイルの準備

分類させたいもの2種類以上、それぞれ10枚以上のイメージファイルを準備してください。画像のフォーマットは.gif, .jpg, .png, .tifのどれかで準備お願いします。

このサンプルでは10円硬貨と100円硬貨の写真を使います。

10円硬貨の写真10枚以上、100円硬貨の写真10枚以上を準備することになります。

それぞれ種類ごとに、「半角英数字」のファイル名をつけて、ZIPファイルにしておきます。ファイル名はのちのち分類クラス名となりますので、「半角英数字」でわかりやすい名前をつけてください。

記号も一部使用できますが、\ | * { } [ ] $ - / ' ` ". の文字は使用しないでください。

- 例:

100_YEN.ZIP,10_YEN.ZIPなど

尚、ZIPしなくともカスタムクラス作成はできますが、手順を簡単にするためZIPファイルが作成済みの手順としています。

写真を取るのは面倒だけどカスタムクラスは作ってみたい! という方は公式チュートリアルのサンプルファイルを使ってみてください:

- ビーグル犬 beagle.zip

- ハスキー犬 husky.zip

- ゴールデンレトリバー golden-retriever.zip

- テスト用の犬の画像 dogs.jpg

2. Watson Visual Recognitionサービスの作成

(2020/10/21追記: Visual Recognitionサービスは2020/10/16より使用料金のかからないLite Planでの新規利用ができなくなりました。新規は有料のStandard Planのみとなりました。)

まずは使いたいWatson Visual RecognitionサービスをIBM Cloudから作成しましょう!

既に作成済みの方はここは飛ばしてください。

Watson APIを使うための前準備: サービスの作成と資格情報の取得を参照して、 Visual Recognitionサービスを作成してください。

3. Watson StudioサービスとProjectの作成

カスタムモデルはWatson StudioというIBM Cloud上のツールで作成します。そのためWatson Studioのセットアップが必要です。

表示された「Watson Studio」の起動をクリックします。

既に作成済みの方はここは飛ばしてください。

Watson Studio サービスとProjectの作成を参照して、 Watson StudioサービスとProjectを作成してください。「Watson Studio サービス」作成の際はロケーションはダラスを選択し作成お願いします。

4. Watson StudioのProjectとVisual Recognitionサービスの関連付け

3で作成したProjectと2で作成したVisual Recognitionサービスを関連付けます。

3が終わった状態の場合は、Watson Studioの画面で作成したProjectのOverviewが表示された状態だと思います。

もしWatson Studioの画面で作成したProjectが表示されてない場合は、ログイン後、作成済Projectの表示方法を参照の上、Projectを表示させてください。

4-1: 上部メニューから「Settings」をクリックします。

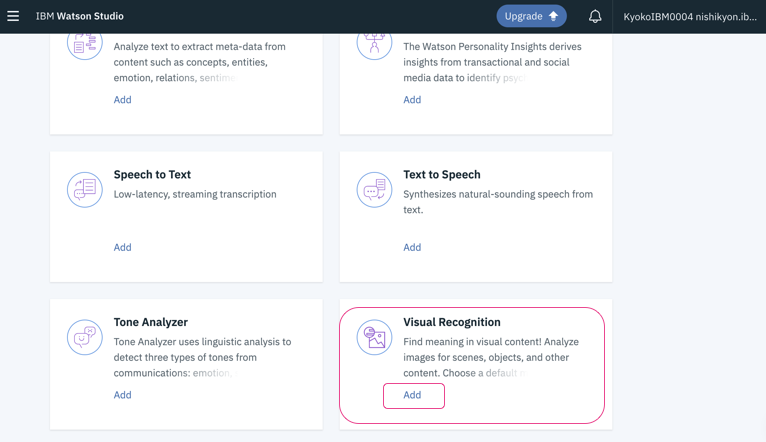

4-2: 下にスクロールして、「Associated services」の右上の「Add service」をクリックし、表示されたリストから「Watson」をクリックします。

4-3: 下にスクロールして、「Visual Recognition」の「Add」をクリックします。

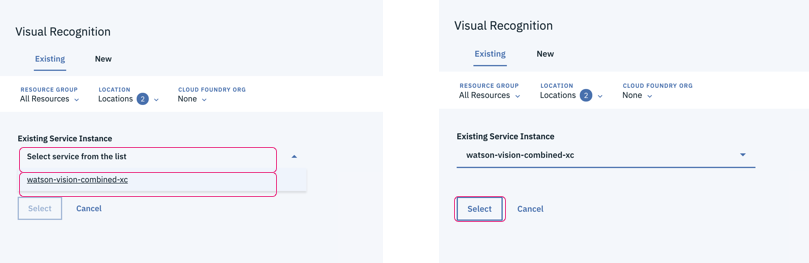

4-4: 「Existing Service Instance」の「Select seevice from the list」をクリックすると、2で作成したVisual Recognitionのサービス名が表示されるので、クリックします。

2で作成したVisual Recognitionのサービス名がセットされたら、「Select」をクリックします。

4-5: Settingsの画面に戻るので、下にスクロールして、、「Associated services」にセットしたVisual Recognitionのサービス名が表示されていることを確認します。

これでWatson Studio関連のセットアップは完了しました!

5. Visual Recognitionサービスの管理画面の表示

カスタムモデルはWatson Studioで作成します。カスタムモデル作成画面の表示方法は3通り1ありますが、ここではIBM CloudのVisual Recognitionサービスから開く方法を紹介します。

https://cloud.ibm.com よりIBM Cloudにログイン後、

[こちら]

(https://qiita.com/nishikyon/items/9b8f697db7ad0a693839#2-%E3%82%B5%E3%83%BC%E3%83%93%E3%82%B9%E3%81%AE%E8%B3%87%E6%A0%BC%E6%83%85%E5%A0%B1%E5%8F%96%E5%BE%97)を参考に、作成した Visual Recognitionサービスの管理画面の表示をしてください。

6. Watson Studioの起動

Visual Recognitionサービスの管理画面に表示された「Watson Studio」の起動をクリックします。

7. モデル作成画面の表示

Classify Imagesの中にある「Create Model +」をクリックします。

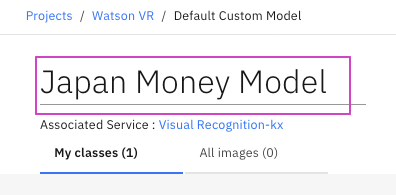

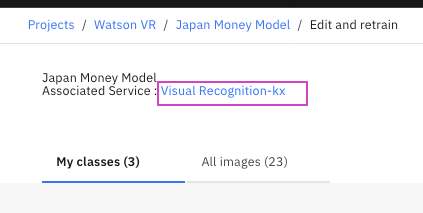

8. カスタムモデル作成画面 & モデル名変更(変更はオプション)

尚、モデルの名前はDefault Custom Modelとなるので、変更したい場合は、名前をクリックして変更します。学習後は変更できません。モデルを表すわかりやすい名前に変更するとよいです。

変更後:

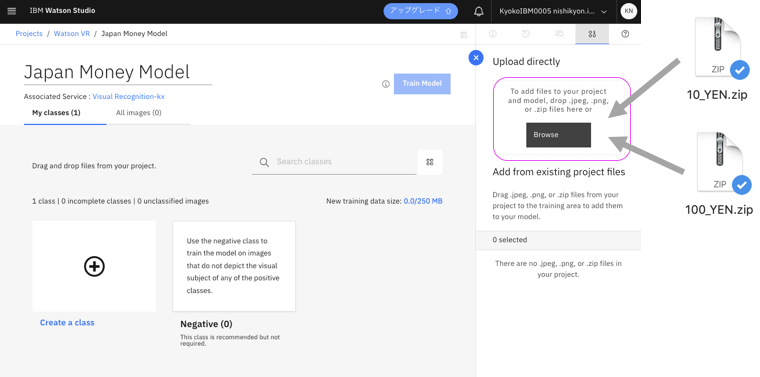

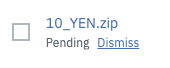

9. 学習する写真のZIPファイルを、Cloud上にアップロード

「1. 学習用写真ファイルの準備」で作成したファイルCloud上にアップロードします。

右側のUpload to projectの点線の四角内に、作成したZIPファイルをドラッグ&ドロップしてください。

尚、ドラッグ後、Pendingの状態が長く続く場合は、「Dismiss」をクリックして一旦アップロードを中止し、再度ドラッグしてみてください。

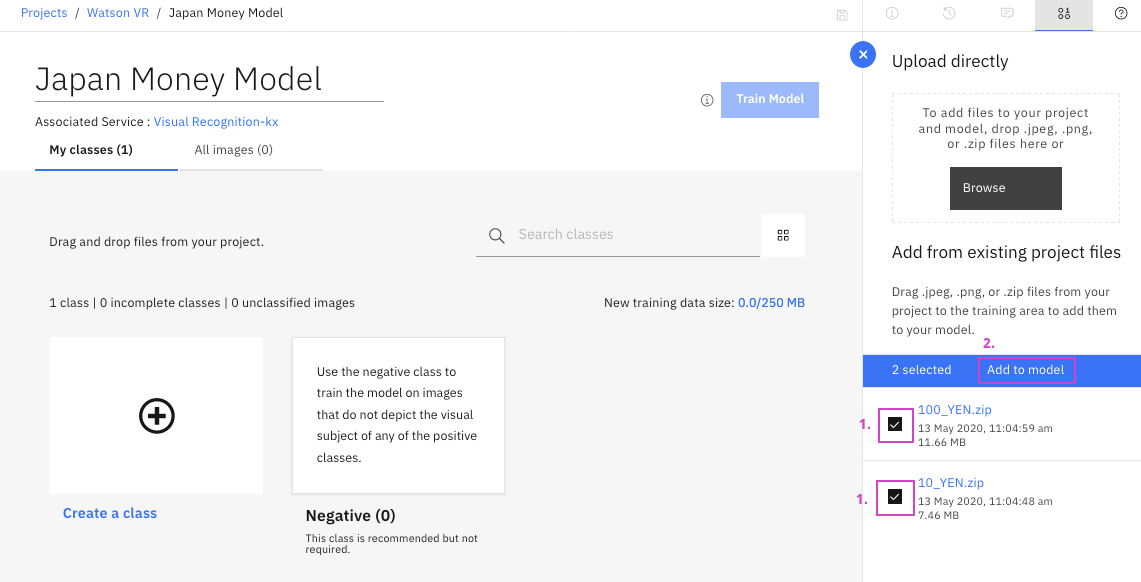

10. 学習用写真をモデルに追加

アップロードが完了すると自動で左側のエリアにZIPファイル名をクラス名としてイメージが追加されます。

もし自動で追加されなかった場合は、チェックボックスをクリックしてチェックしてください。

その後「Add to model」クリックしてください。

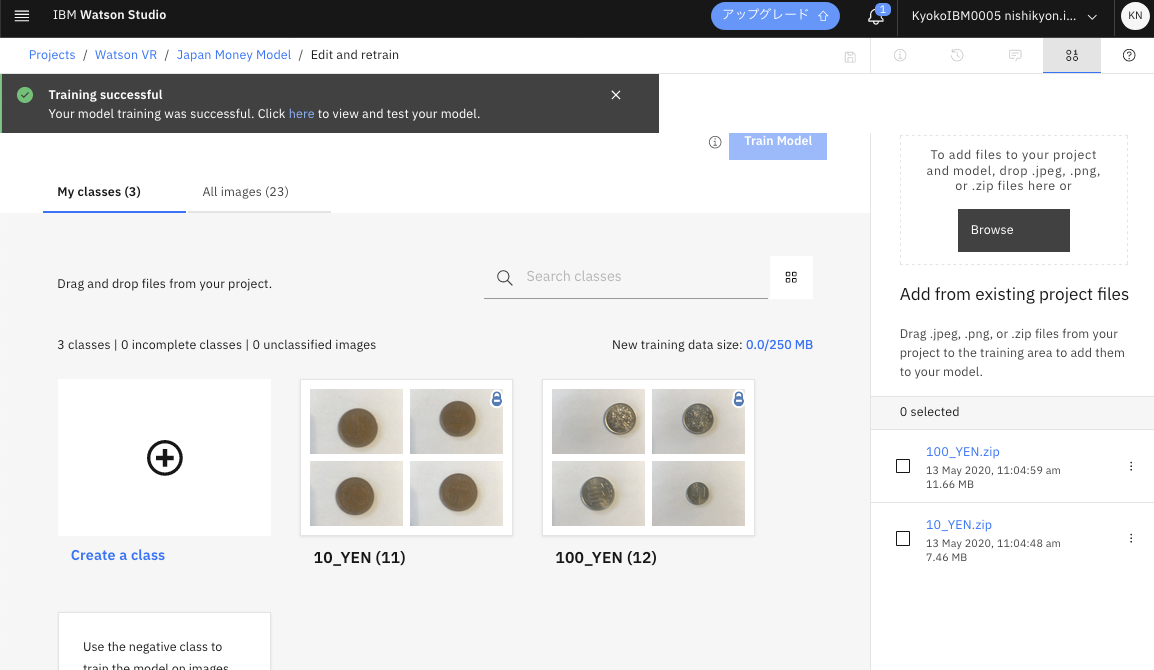

11. トレーニング開始

以下のイメージのように

尚、「Train Model」ボタンが青色でクリックできる状態 になっていない場合は、写真の枚数が足りない、写真の分類が1種類しかない等が考えられますので、確認してみてください。

学習には時間がかかりますので(データ量によりますが約10分以上かかります)、しばらくこのままにしておきます。そのままにできない場合は、ブラウザーを閉じてしまっても問題はありません。

そのままにしておいた場合は、学習が終了すると上部に「Training successful」とメッセージが表示されます。

これで学習が完了してカスタムモデルが使える状態になりました。

画面を閉じてしまった場合は、次のステップでStatusが確認できます。

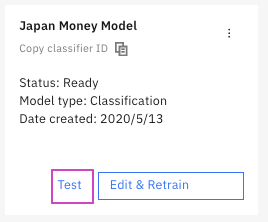

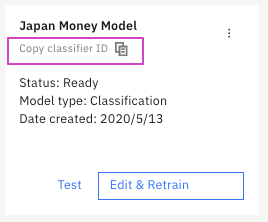

12. モデルの表示

「5. Visual Recognitionサービスの管理画面の表示」と「6. Watson Studioの起動」の手順でモデルを表示します。

あるいは 画面を閉じてなかった場合は、「Training successful」とメッセージを「X」をクリックして閉じ、Associated Serviceの横のVisual Recognitionのサービス名のリンクをクリックしてもOKです。

Custom Modelsの下に先ほど学習させたモデルが表示されています。

StatusがReadyの場合は学習が完了しています。 Trainingの場合はまだ学習中ですので、Readyになるまで待つようにします。

13. Classifier IDの取得

既にAPIを使用したモデルがテストできるアプリケーション等がある場合は、「Copy classifier ID」をクリックしてClassifier IDを取得し、アプリケーションにセットして使用してください。

またアプリケーションがなくとも、Watson Studio上でモデルのテストができます。次のステップに進んでください。

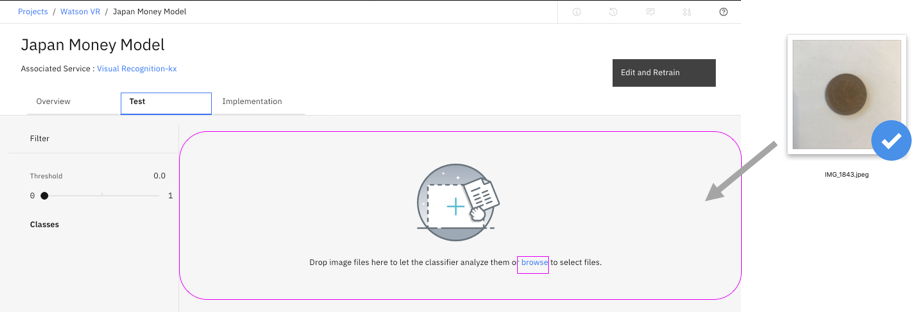

14. 作成したカスタムモデルのテスト

14−2: ModelのOverviewが表示されるので。「Test」をクリックしてください。

14−3: 「Drop image files here to let the classifier analyze them or browse to select files.」 と書いてあるエリアに認識させたい写真ファイルをドラッグ&ドロップします。または「browse」をクリックしてファイルダイアログから選択します。

14-4: 認識結果を確認します。認識されたクラスが、確信度と共に表示されます。

15. (オプション)作成したカスタムモデルを使ったアプリケーションの作成

「Implementation」をクリックすると、代表的な言語でのCode snipetが表示されますので、アプリケーションの作成の参考にしてください。

またAPIリファレンスは以下にあるので参考にしてください:

https://cloud.ibm.com/apidocs/visual-recognition

以上です。

16. おまけ

以下にカスタムクラスが使えるサンプルコードがありますので、お試しください。

-

nodejsのサンプルアプリ: https://github.com/kyokonishito/watson-vr-node

-

pythonのnotebookサンプルコード: https://github.com/kyokonishito/python_watson のLab3

-

python flaskのサンプルコード: https://github.com/kyokonishito/watson-vr-flask のserverフォルダ

-

/server/app.pyのdef classifyCustomImages():内のclassifier_ids=["food"]のfoodをClassifier IDに変更してください。

-

-

Node-REDのサンプルアプリ: https://github.com/kyokonishito/watson-vr-nodered

-

ちなみにあと2つは以下です。1. Watson Studioのログイン時に表示されるダッシュボードのWatson Serviceから「Launch Tool」をクリック。 2. Watson StudioのProjectに入って、「Add to project」から「Image Classification Model」をクリック ↩