基本的な事項で恐縮だが,L1ノルムとL2ノルムの違いを意識する必要がある場面に遭遇したため,メモ.

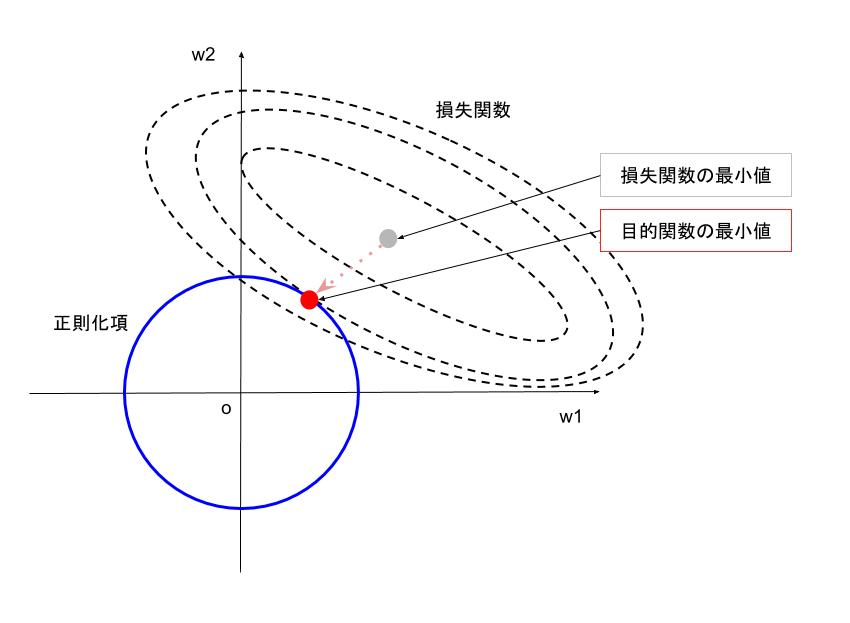

- 一般的には過学習を防ぐための正則化項として用いられている

- GANでもpix2pixなどで極端な画像を生成しないように使う.正則化的に.

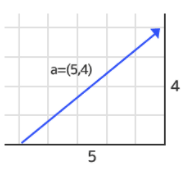

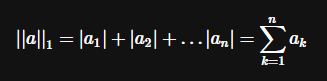

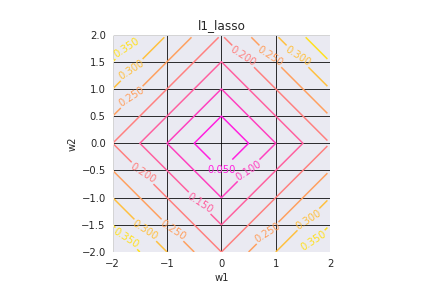

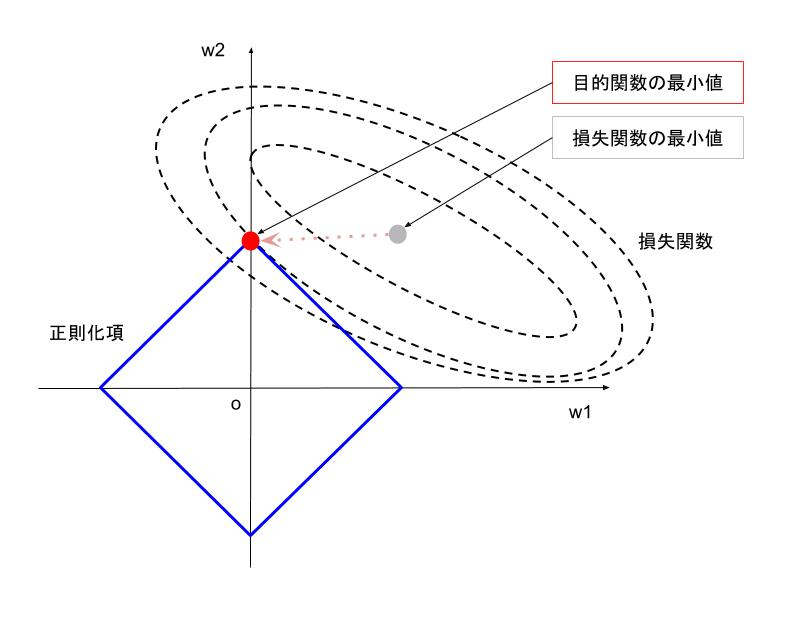

L1ノルム

- この例ではw1=0である.疎な解,スパースになりやすい.

- ゆえに,次元削減,余分な説明変数を省くことができる

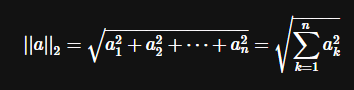

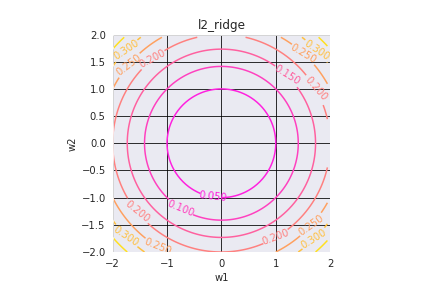

L2ノルム

結論

- L1正則化もL2正則化も,過学習を抑制する(パラメータが大きくなりすぎないようにする)

- L2正則化の方がL1正則化よりも過学習をうまく抑制する(表現力が豊かなため)

- L1正則化により疎な解を得られる可能性が高く,次元削減の効果がある