Robust Semi-Supervised Monocular Depth Estimation with Reprojected Distances

この論文ではReprojection LossというLossを新たに提案している。

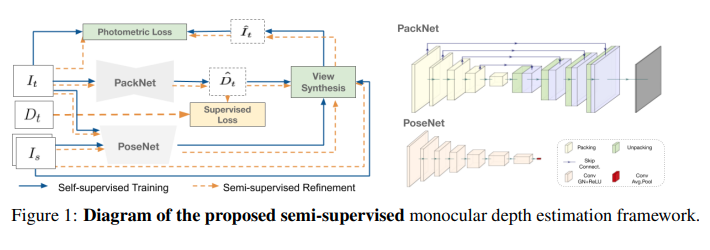

アルゴリズム

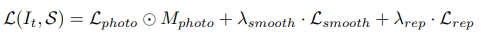

Lphoto => per-pixel photometric loss

Mphoto => カメラと同じ速度で動いている物体とカメラが動いていない時のマスク

Lsmooth =>Depthの2回微分

Lrep =>今回提案されるreprojection loss

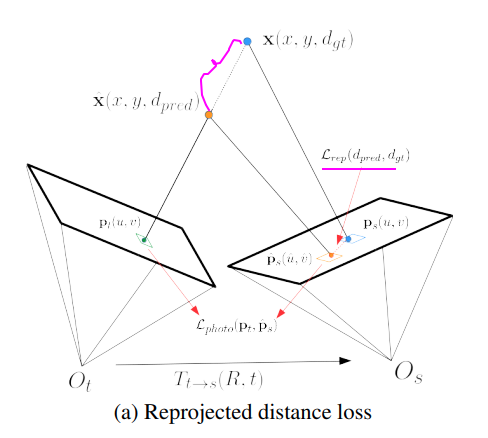

新規性

LiDARを使ったSupervise LossはDepth Mapの距離を比較するのだが、

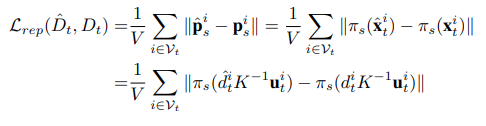

Lrepでは"推定したDepth"と"Ground TruthのDepth"をPoseNetによって推定されたTt->sによってwarpさせる

warpした時にDepthが違えばReprojectionされる位置がずれる。その差分をlossとして定義する。

数式で表すとこうなるらしい。

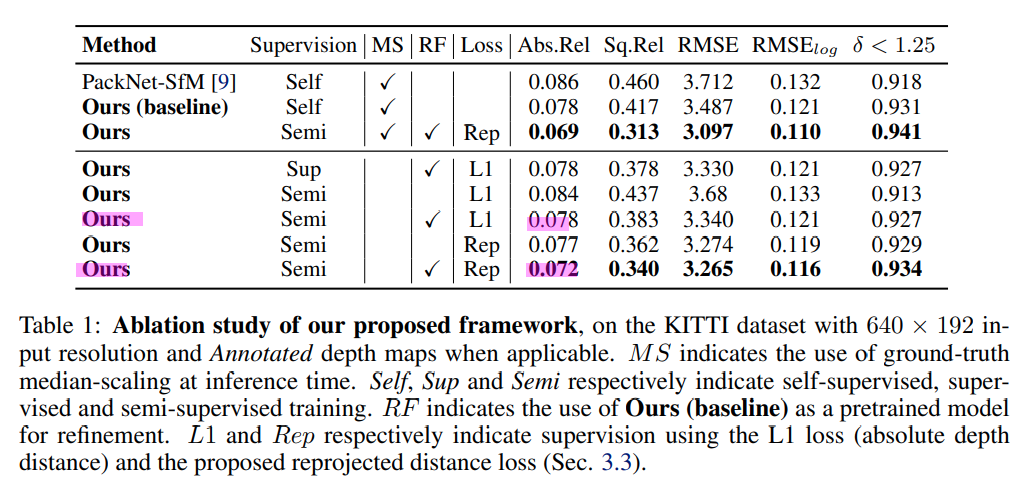

結果

DepthのLossをL1よりReprojection lossにしたほうが精度が出たらしい。

結論

・なぜだか理解できていないが、L1 LossよりReprojection Lossの方が精度が上がるらしい。

参考文献

Robust Semi-Supervised Monocular Depth Estimation with Reprojected Distances

https://arxiv.org/pdf/1910.01765.pdf