はじめに

AIをプロダクションに投入すると、何が起きているのか。Datadogが2026年4月21日に発表した State of AI Engineering 2026 は、数千の本番環境を実際に観測した結果から、LLMアプリケーション運用の実態を明らかにしたレポートです。

このレポートの核心は「モデルの性能ではなく、運用上の複雑性こそがスケールの壁」という主張です。

この記事では、エンジニアとして知っておくべきデータと対策を整理します。

この記事で解説すること

- なぜ本番LLMの約5%がエラーになるのか

- 69%の組織が3つ以上のモデルを使う「マルチモデル時代」の課題

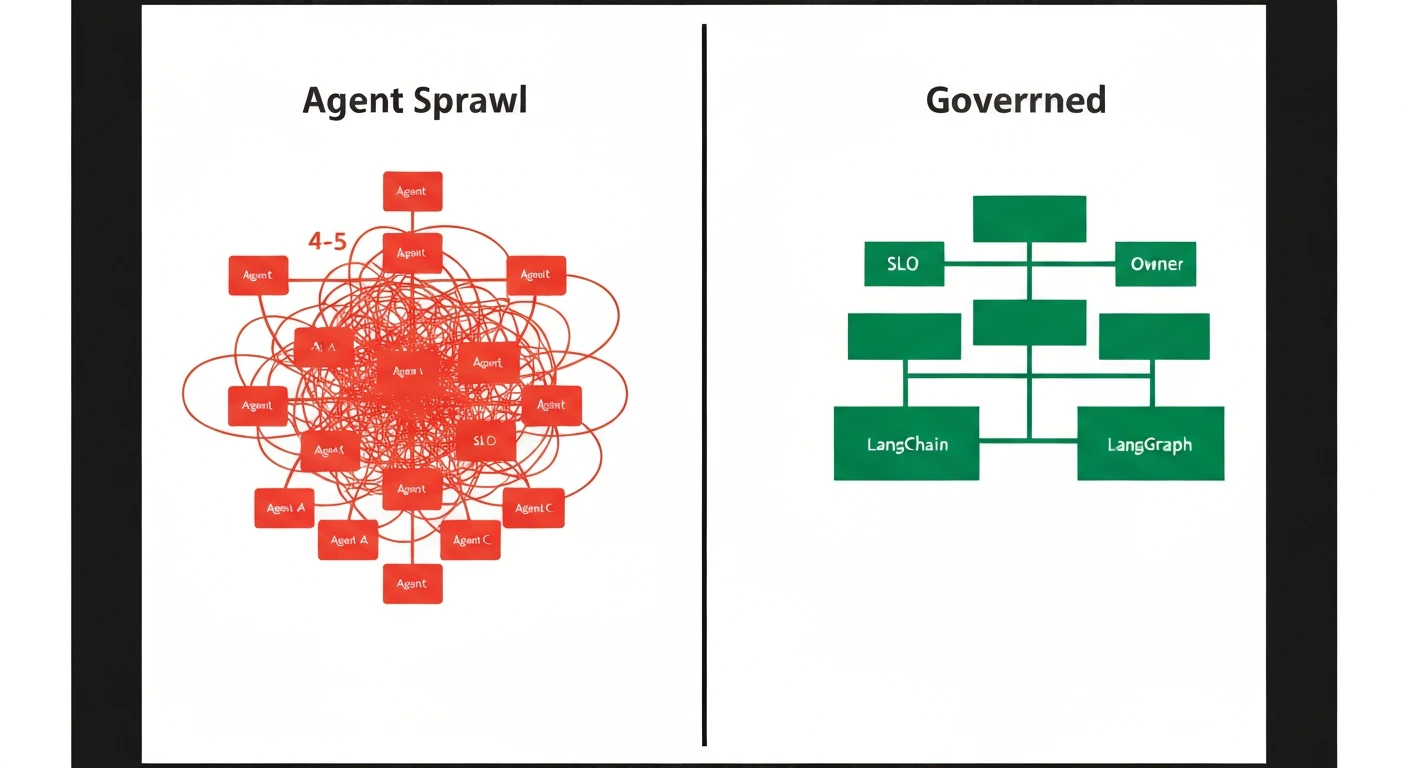

- エージェントフレームワーク採用が倍増した結果に生まれた「Agent Sprawl」問題

- プロンプトキャッシュが28%しか使われていない現実と対策

対象読者

- LLMをプロダクションで運用している、または検討しているエンジニア

- AIエージェントの信頼性・コストに課題を感じているチーム

- LLMオブザービリティの導入を検討している方

前提条件

- LLM APIの基本的な利用経験

- Python/REST APIの基礎知識

TL;DR

- 5%のLLMリクエストが本番で失敗しており、その60%はレートリミット超過が原因

- 69%の組織が3つ以上のモデルを並行運用。モデル選択よりも運用設計が成功の鍵

- プロンプトキャッシュの利用率はわずか28%。コスト削減の大きなチャンスが眠っている

レポートの概要

Datadogの State of AI Engineering 2026 は、Datadogの LLM Observability 製品から収集した匿名テレメトリデータを分析したもので、主に2026年2月〜3月のデータを使用しています。

AI is hitting operational limits as companies rush to scale.

— Datadog, State of AI Engineering 2026 Press Release(2026-04-21)

「スケールを急ぐ企業が、AIの運用上の限界に直面している」というテーゼで、モデルの知能ではなく、システム設計の問題がボトルネックになっていることをデータで示しています。

課題1: レートリミット・クライシス — 5%が失敗、60%は容量の壁

失敗率の実態

2026年2月のDatadogのデータによると、全LLMコールスパンの約5%がエラーを報告しており、そのうち60%はレートリミット超過が原因です。

| 期間 | エラー率 | レートリミット起因 |

|---|---|---|

| 2026年2月 | 約5% | 60% |

| 2026年3月 | 約2% | 約33%(840万件) |

月次で改善が見られますが、3月だけで約840万件のレートリミットエラーが発生しています。

なぜレートリミットが頻発するのか

LLMのレートリミットは単純な「リクエスト数制限」ではなく、トークン消費量によっても発動します。Datadogのレポートでは、以下の傾向を指摘しています。

- 平均トークン数が2倍以上に増加(中央値ユーザー)

- 上位10%のヘビーユーザーは前年比4倍のトークン消費量

- 一部モデルでは128Kから最大200万トークン規模まで拡大し、「入れられるから入れる」という設計になりがち

対策: 指数バックオフとトークン予算

単純なリトライでは問題が悪化します。推奨される対策は以下です。

import anthropic

import time

import random

client = anthropic.Anthropic()

def call_with_backoff(messages, max_retries=5):

"""指数バックオフ付きAPIコール"""

for attempt in range(max_retries):

try:

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=2048,

messages=messages

)

return response

except anthropic.RateLimitError as e:

if attempt == max_retries - 1:

raise

# 指数バックオフ + ジッター

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"Rate limit hit. Waiting {wait:.1f}s...")

time.sleep(wait)

ポイントは「リトライは対症療法」という認識です。根本的にはトークン予算の設計とキュー導入によるバックプレッシャーが必要です。

ループするエージェントはトークン消費が爆発しやすい設計です。task budgets(タスクあたりの最大トークン数上限)を設定することで、ランナウェイループを防止できます。

課題2: マルチモデル展開の複雑性 — 69%が3つ以上のモデルを並行運用

プロバイダ動向

| プロバイダ | 採用率 | 前年比 |

|---|---|---|

| OpenAI | 63% | -12pp(ただし絶対量は2倍以上に増加) |

| Anthropic Claude | ▲23pp成長 | — |

| Google Gemini | ▲20pp成長 | — |

OpenAIのシェアは63%(前年比低下)ですが、LLM市場全体が拡大しているため、絶対量は2倍以上に増えています。Claude Sonnet 4.6はリリース後1ヶ月で17%の採用率に達しています。

モデルの「退役遅延」問題

Datadogが指摘する興味深い現象が「モデルの退役遅延」です。

- 新モデルは急速に採用されるが、古いモデルはなかなか廃止されない

- Sonnet 4.5やGPT-4oは2026年3月時点でも19〜22%の利用率を維持

- 廃止通知から実際の移行まで数ヶ月かかるチームが多い

これは**「Agent Sprawl」**の温床になります。古いモデルを参照するエージェントチェーンが放置されると、静かな品質低下(Decision Quality Rate の低下)につながります。

実践: モデルインベントリの管理

# モデルインベントリの例(設定ファイルで管理)

MODEL_INVENTORY = {

"chat_general": {

"model": "claude-sonnet-4-6",

"owner": "team-a",

"deprecated_at": None,

"slo_target": 0.99,

},

"code_review": {

"model": "claude-opus-4-7",

"owner": "team-b",

"deprecated_at": None,

"slo_target": 0.995,

},

"fast_classification": {

"model": "claude-haiku-4-5-20251001",

"owner": "team-c",

"deprecated_at": "2026-07-01", # 廃止予定

"slo_target": 0.98,

},

}

推奨される管理ポリシー:

- 各モデルにオーナーチームを設定

- 廃止予定日を60/30/7日前にアラート

- フレームワークアップグレード前後でSLOベースラインをスナップショット取得

課題3: Agent Sprawl — フレームワーク採用倍増が生む新たな複雑性

フレームワーク採用の急拡大

| 指標 | 2025年初頭 | 2026年初頭 |

|---|---|---|

| フレームワーク採用率 | 約9% | 約18%(2倍) |

| 採用フレームワーク | LangChain主流 | LangChain, LangGraph, Pydantic AI, Vercel AI SDK |

フレームワークはエージェント開発を高速化しますが、問題はフレームワークのレイヤーが可視性を遮断する点です。

- フレームワーク内部のリトライロジックがアプリコードとオブザービリティの間に入り込む

- Tool Invocation Efficiency(ツール呼び出し効率)がフレームワークアップグレードで30〜40%ドリフトすることがある

- 障害がカスタマークレームとして表面化し、アラートで検知できない

現実のエージェントアーキテクチャ

59%のエージェントリクエストが単一サービス呼び出しのみ(モノリシック)というデータは、エージェントエンジニアリングがまだ成熟途上にあることを示しています。

| アーキテクチャタイプ | 割合 |

|---|---|

| 単一サービス(モノリシック) | 59% |

| 2サービス呼び出し | 〜23% |

| 3サービス以上(真のマルチエージェント) | 18% |

真のマルチエージェントシステムを本番で動かしているのはまだ少数派です。

対策: SLOとトレーシングの導入

from anthropic import Anthropic

import time

client = Anthropic()

def traced_agent_call(task: str, session_id: str):

"""オブザービリティメタデータ付きエージェントコール"""

start_time = time.time()

try:

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=4096,

system="You are a helpful assistant.",

messages=[{"role": "user", "content": task}],

metadata={

"user_id": session_id,

}

)

latency = time.time() - start_time

# メトリクスを外部に送出(DatadogやPrometheusなど)

# emit_metric は疑似コード。実際は dd-trace-py や Datadog SDK 等で実装する

emit_metric("llm.latency", latency, tags=["model:claude-sonnet-4-6"])

emit_metric("llm.tokens.input", response.usage.input_tokens)

emit_metric("llm.tokens.output", response.usage.output_tokens)

return response

except Exception as e:

emit_metric("llm.errors", 1, tags=[f"error:{type(e).__name__}"])

raise

見過ごされているプロンプトキャッシュ — 利用率わずか28%

Datadogのレポートで「最も改善余地が大きい」領域として挙げられているのがプロンプトキャッシュです。

現状

- 全LLMコールのうち、キャッシュヒットしているのは28%のみ

- 残り72%は同じシステムプロンプトを毎回再処理

- システムプロンプトがinputトークンの69%を占めるため、キャッシュの効果は絶大

なぜ72%がキャッシュを使えていないのか

最も多い原因は「プレフィックスの破壊」です。

# ❌ キャッシュが効かないパターン

# ユーザー依存の動的情報をシステムプロンプトの冒頭に入れてしまう

messages = [

{

"role": "user",

"content": f"Current time: {datetime.now()}\n\nHello, I need help with..."

}

]

# ✅ キャッシュが効くパターン(Claudeの場合)

# 静的なシステムプロンプトをcache_control付きで送る

import anthropic

client = anthropic.Anthropic()

SYSTEM_PROMPT = """

あなたはAIエンジニアを支援するアシスタントです。

[以下、数千トークンの静的な指示・ツール定義...]

"""

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1024,

system=[

{

"type": "text",

"text": SYSTEM_PROMPT,

"cache_control": {"type": "ephemeral"} # ← キャッシュを明示的に有効化

}

],

messages=[{"role": "user", "content": user_message}]

)

キャッシュ利用によるコスト削減試算

| 条件 | 従来 | キャッシュ有効 |

|---|---|---|

| システムプロンプト | 2,000トークン/リクエスト | 200トークン(90%削減) |

| 1日1万リクエスト | 2,000万入力トークン | 200万入力トークン相当 |

| Claude Sonnet 4.6の費用 | $60.00 | $6.00〜(最大90%削減) |

実際の削減率はキャッシュヒット率に依存しますが、Anthropicは最大90%のコスト削減を報告しています1。

エンジニアへの実践チェックリスト

以上のデータを踏まえ、本番AI運用の改善に向けた実践的なチェックリストを整理します。

1. レートリミット対策

- 指数バックオフ + ジッターのリトライ実装

- エージェントループへのトークン予算(task budget)設定

- キューによるバックプレッシャー設計

- プロバイダ別のレート上限をモニタリング

2. マルチモデル管理

- モデルインベントリの作成(モデル名・オーナー・廃止予定日)

- SLOベースラインの取得(フレームワークアップグレード前後)

- 廃止通知アラートの設定(60/30/7日前)

- 古いモデルへの依存を定期的に棚卸し

3. Agent Sprawl防止

- エージェントに使用するフレームワークの棚卸し

- 全エージェントにオーナーチームを設定

- フレームワーク内部のリトライ・フォールバックを可視化

- エージェントSLOの設定と定期レビュー(四半期ごと推奨)

4. プロンプトキャッシュ最適化

- システムプロンプトを静的部分と動的部分に分離

-

cache_control: {"type": "ephemeral"}を静的プロンプトに付与 - キャッシュヒット率をメトリクスで計測

- プロンプトのプレフィックス破壊要因(タイムスタンプ、ユーザーID等)をシステムプロンプトから除外

まとめ

Datadogの State of AI Engineering 2026 が示すのは、AIエンジニアリングの成熟過程そのものです。

- 5%失敗・60%レートリミット: モデルの問題ではなく、容量設計の問題

- 69%がマルチモデル: 「最強モデルを1つ使う」時代から「モデルポートフォリオを運用する」時代へ

- Agent Sprawl: フレームワークが加速した複雑性は、SLOとインベントリ管理で制御する

- 28%しかキャッシュ使わず: 最もコストパフォーマンスが高い改善は、プロンプトキャッシュの最適化

Datadogの CPO が述べているように、「どのモデルを選ぶかよりも、AIをどう運用するかが重要になった」という段階に、2026年のAIエンジニアリングは到達しています。

参考リンク

- State of AI Engineering 2026 | Datadog — レポート本体

- Datadog State of AI Engineering 2026 Press Release(2026-04-21)

- LLM Observability | Datadog — 製品ページ

- Managing OpenAI Rate Limits at Scale: A Practical Guide

- Prompt caching with Claude | Anthropic — プロンプトキャッシュ公式ドキュメント

-

Prompt caching — Anthropic Documentation(2026年5月時点) ↩