Kota Yoshida, Munetaka Minoguchi, Kenichiro Wani, Akio Nakamura, Hirokatsu Kataoka

arxiv, pdf

1.どんなもの?

画像を入力するとその画像に対してボケ(ジョーク)を返すネットワーク

2.先行研究と比べてどこがすごいの?

画像に対してボケを書き込んで投稿するサイト"bokete"のデータベースを利用して面白さの指標を定義して利用する.

3.技術や手法のキモはどこにあるか?

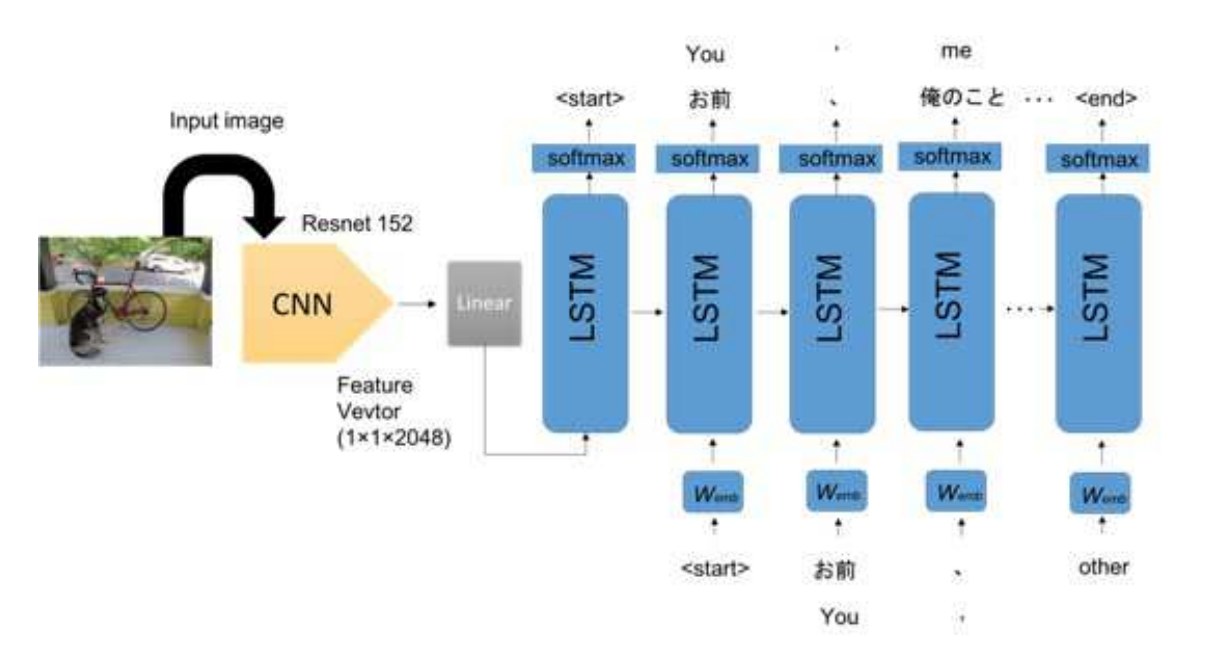

CNN+LSTM

画像に適したCNNとテキスト処理に適したRNNを組み合わせたものとしてCNN+LSTMによる画像のキャプション生成がある[1].

CNN+LSTMを用いて画像からボケを生成する.

CNNはResnetを用いて特徴抽出を行う.

Funny score

面白さを表す指標としてFunny scoreを定義する.

このFunny scoreは画像に対する大喜利の投稿サイト"bokete"の星の数を利用して定義される.

星の数が100個以下ならscoreは損失Lを返し,星が100個以上ならL-1.0を返す.

損失Lはミニバッチの平均としてLSTMで計算される.

4.どうやって有効だと検証した?

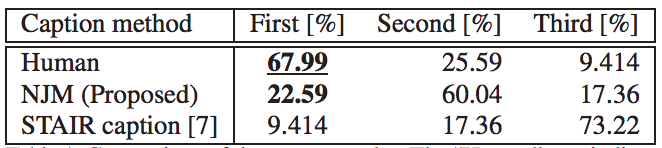

bokete に投稿されたものを人のつけたキャプションとし,人のつけたキャプションと提案手法により生成されたキャプション,STAIR[2]により生成されたキャプションを比較する.

比較方法は16人のアンケートを行い,それぞれが生成したキャプションに面白さの順位をつけてもらった.

この結果から人よりは面白くないがSTAIRよりは面白いキャプションが生成できていることがわかる.

実際にboketeに投稿してみたらSTAIRは平均1.71個の星を獲得したのに対して,提案手法は3.23個獲得できた.

5.議論はあるか?

6.次に読むべき論文はあるか?

[1]Show and Tell: A Neural Image Caption Generator

[2]STAIR Captions: Constructing a Large-Scale Japanese Image Caption Dataset