7月合格目標で、G検定の勉強を始めました。

まずはシラバスの内容をgeminiに流して、自作のチートシートを作るために表にまとめてみた。

ちょっとずつ解説を見ながら自分なりに理解した内容を記載して更新してく!

[追記]

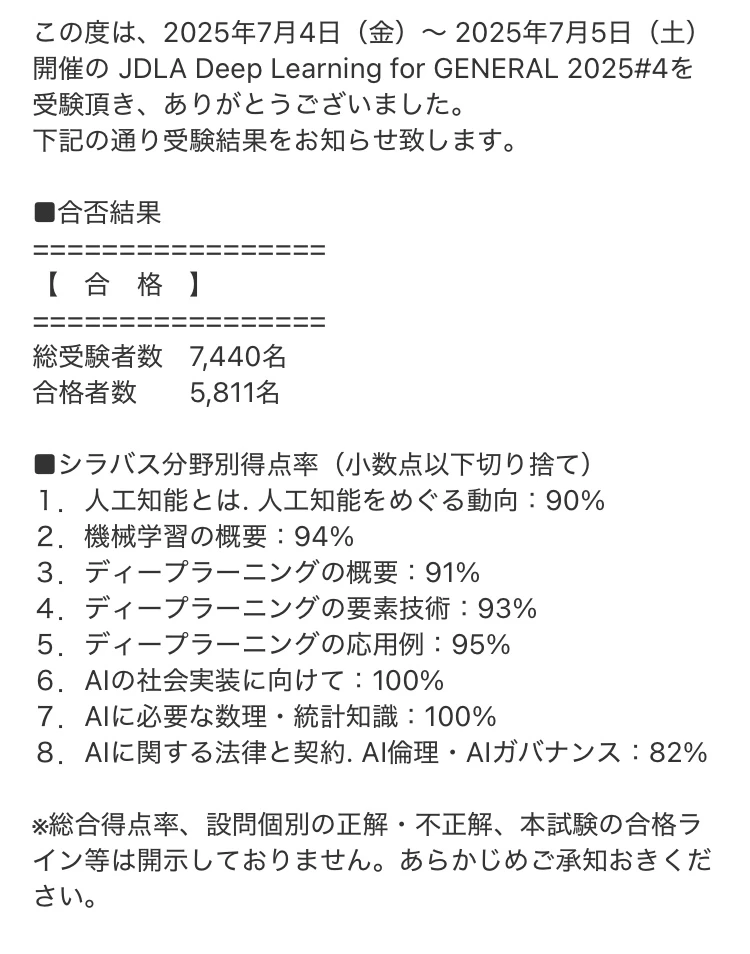

2025/07/05(土)に受験し、合格できました。

かなり難しく感じましたが、このようにアウトプットとしてまとめる経験がかなり生きたので、受験する方は自分だけの最強無敵チートシートを作っちゃおう!

合格体験記も書きましたのでよければ。

目次

技術分野

人工知能とは

人工知能をめぐる動向

機械学習の概要

ディープラーニングの概要

ディープラーニングの要素技術

ディープラーニングの応用例

AIの社会実装に向けて

AIに必要な数理・統計知識

法律・倫理分野

技術分野

人工知能とは

1.人工知能の定義

目標

- 人工知能とは何か、具体例を用いて説明できる

- 人工知能のレベルを「単純な制御プログラム」「古典的な人工知能」「機械学習」「深層学習」の4つに分類し、それぞれがどのようなものか説明することができる

- AI効果を説明できる

- 人工知能とロボットの違いを説明できる、人工知能とは何か、具体例を用いて説明できる

キーワード

| キーワード | 意味など |

|---|---|

| AI効果 | ある技術がAIと呼ばれていたが、当たり前になるとAIと認識されなくなる現象。 AIの仕組みを知ると、「ただの自動化に過ぎない」と考えてしまう(人工知能を認めたくない心理がはたらく) |

| エージェント | 強化学習の主体。 環境から情報を受け取って、何らかの行動を行う存在で、知能を持たない/学習を行わないものでもよい。 例)ゲームのプレイヤー、センサーが反応したらドアを開けるプログラム |

| 人工知能 | 人間の知的なふるまい(判断・学習。推論など)をコンピュータに模倣させるための技術や学問分野のこと |

| 機械学習 | 大量のデータから自動的にルールやパターンを学習し、判断できるようにするAIの一分野 |

| ディープラーニング | 機械学習の手法の一つ。 ニューロン(人間の脳神経)を模した、ニュートラルネットワークを多層化したもの。 複雑な特徴量を自動でとらえることができる |

2. 人工知能分野で議論される問題

目標

- 人工知能分野で議論されている代表的な問題について説明できる

- 汎用的な人工知能の実現可能性について、いくつかの例を取り上げて説明できる

キーワード

| キーワード | 意味など |

|---|---|

| シンギュラリティ | 日本語に訳すと、技術的特異点。 AIが、人間より賢いAIを作り出し、人間の知能を超える地点のこと。 |

| シンボルグラウンディング問題 | 記号接地問題とも呼ばれる。AIは、シンボル(記号)をルールに従って処理することは得意だが、その記号は現実の意味とは結び付いていない、という問題。 例)AIはリンゴという単語を扱えても、甘酸っぱい、丸いなどの感覚とは結び付いてない |

| 身体性 | 知能の発達には、物理的な身体で現実世界とかかわることが重要ではないかという考え方 |

| ダートマス会議 | 1956年、アメリカのダートマス大学で行われた会議。 人工知能という言葉がはじめて公に使われたといわれている。 |

| トイ・プロブレム | 特定のルールが定められたパズルなどのような、おもちゃのような問題のこと。 現実の複雑な問題に対処するのは難しいことが示された。 |

| 知識獲得のボトルネック | 初期のAIは、専門家の知識を人間が正確にルールに記述してコンピュータに入力する必要があった。 手間と時間がかかるので、性能向上の妨げ(ボトルネック)となった。 |

| チューリングテスト | 計算機科学者アラン・チューリングが提唱したテスト。 離れた場所にいる相手と文字のみで対話して、人間なのか機械なのかを判別する。 判別できなかったら、「知的である」とみなす。 |

| 中国語の部屋 | 哲学者ジョン・サールが提案した思考実験。 部屋の中に中国語を理解できない人がおり、中国語の質問に対しルールに従って記号操作を行い、完璧な中国語の回答を返す。 部屋の外から見れば、中国語を理解できてるように感じるが、実際は全く理解していない。 |

| 強い AI と弱い AI | 強いAI→あらゆる知的作業を人間と同等以上にこなす汎用的なAI。(まだ実現してない,SFの世界のやつ。) 弱いAI→特定のタスクに特化して能力を発揮するAI。 例)画像認識AIや将棋AIなど。 |

| 統計的機械翻訳 | 大量の対訳データ(日本語と英語のペア、など)を統計的に分析して、単語やフレーズがどのように対応付けられるかを学習して翻訳を行う手法。 ディープラーニングをつかったニューラル機械翻訳が出てくるまで、主流だった。 |

| フレーム問題 | AIが何かを計画・実行する際に、関係することだけを考慮し、関係ないことは無視するという判断をどのように行わせるか、という問題。 人間は無意識に、関係ない情報を考慮から外しているが、AIに教えるのはむずかしい。 |

| ルールベース機械翻訳 | 人間の言語学者がつくった文法ルールや辞書に基づいて翻訳を行う手法。 開発初期には一定の成果があったが、あいまいさや例外対応が難しく、品質に限界があった。 |

| ローブナーコンテスト | チューリングテストを競技形式でおこなうコンテスト。 参加するAIが、どれだけ人間と自然な会話をできるかを競う。 自然言語処理能力の進歩をはかる場になっている。 |

人工知能をめぐる動向

3. 探索・推論

- 探索・推論の具体例を説明できる

- 探索・推論を実現する代表的な手法を説明できる

- 探索:多数の選択肢の中から、最適な答えや手順を見つけること

- 推論:既知の情報に基づいて、新たな結論を導き出すこと

キーワード

| キーワード | 意味など |

|---|---|

| プランニング | ゴールに到達するための、一連の行動計画を立てること。 状態遷移モデルを用いて、行動系列を計画するプロセス |

| Mini-Max 法 | チェスや将棋などで使われる。 自分の番では自分の利益が最大になるように、相手の番では自分の損失が最小になるように先読みして、最善手を選ぶ。 深さ優先探索で探索する。 |

| αβ 法 | Mini-Max 法を改良して、無駄な探索を減らし計算コストを大幅に削減する手法。 Mini-Max 法はゲーム木をすべて探索して最善手を見つけるが、αβ 法では「これ以上探索しても意味がない」と分かった枝を枝刈り(プルーニング)してスキップする。 具体的には、2つの変数を管理: α(アルファ)カット:現状のMaxプレイヤーの「これ以下はもう取らない」確定値。Min側がこのα以上の値を出せないと分かった時点で、その枝以下を探索しない。 β(ベータ)カット:現状のMinプレイヤーの「これ以上は許さない」確定値。Max側がこのβ以下の値を出せないと分かった時点で、その枝以下を探索しない。 この仕組みで、理論上はMini-Maxと同じ結果を保証しつつ、大幅に探索ノード数を減らせる。 チェス、将棋、オセロなどの二人零和ゲームAIの基礎的なアルゴリズム。 |

| SHRDLU | 読み方:シュルドゥルー。 1968~1970年にかけて、テリー・ウィノグラードによって開発された、自然言語理解の初期の対話システム。 英語の指示を受けて、コンピュータ画面に描かれる「積み木の世界」に存在するブロックなどの物体を動かすことができた。 |

| STRIPS | 行動の前提条件/行動によって変化すること/行動によって達成される結果 を記述して、計画を自動生成すること。 |

| 探索木 | 問題の選択肢を木の枝のように図で表したもの。 スタートからゴールにも向かって、最適ルートを探すときにつかう |

| ハノイの塔 | トイ・プログレムの一つで、古典的なパズル。 複数の円盤を特定のルールに従って別の杭に移動させる問題。 解く手順を見つけることが、探索にあたる。 |

| 幅優先探索 | 現在地に近い階層の選択肢から順番に調べていく方法。 迷路でいうと、1歩で行ける場所を全部調べてから、2歩で行ける場所を全部調べる。 最短経路を見つけやすいが、選択肢が多いとメモリを大量消費する |

| 深さ優先探索 | 一つの選択肢を奥深くまで調べて、行き止まりになったら手前に戻って別の選択肢を調べる方法。 迷路でいうと、1つの道を一番奥まで進んで、行き止まりなら戻って別の道に進む。 メモリ消費が少ないが、最短経路が見つかるとは限らない。 |

| ブルートフォース | 日本語に訳すと「力任せ探索」(俗にいうごり押し) 4桁の暗証番号の解除に、0000~9999を1つずつ試す方法。 選択肢が膨大になると、時間がとてもかかる。 |

| モンテカルロ法 | ランダムな試行を多数回行って、結果を統計的に処理することで、近似解や確率的な評価を得る手法。 |

4.知識表現とエキスパートシステム

- 知識表現とは何か説明できる

- エキスパートシステムとは何か説明できる

- 知識表現に係る代表的な研究や手法について理解する

- エキスパートシステムに係る代表的な研究や手法について理解する

キーワード

| キーワード | 意味など |

|---|---|

| Cyc プロジェクト | 読み方:サイクプロジェクト。 人間の持っている膨大な常識知識をコンピュータに入力して、推論できるようにしようというプロジェクト。 1984年から、いまでも続いている。とても壮大。 |

| DENDRAL | 1960年代に開発された、初期のエキスパートシステム。 有機化合物の分子構造を推定する。 特定の分野では専門家と同等以上の性能を示して、エキスパートシステムの可能性を示した。 |

| is-a の関係 | 「~は~である」というクラス階層を表す関係。 例:犬 is-a 哺乳類。 上位概念と下位概念をつなぐ。 推移律あり(犬 is-a 哺乳類、哺乳類 is-a 動物 → 犬 is-a 動物)。 |

| has-a の関係 | 「~は~を持つ」という所有・属性の関係。 例:車 has-a エンジン。 部分的な構成要素を示すが、一般に推移律は成り立たない(車 has-a エンジン、エンジン has-a ピストン → 車 has-a ピストンとは限らない)。 |

| part-of の関係 | 「~は~の一部である」という包含・部分構造の関係。 例:エンジン part-of 車。 一般に階層的な部品構成を表すが、part-ofの種類が異なる場合は推移律が成立しないこともある。 例:手 part-of 会社員、会社員 part-of 会社 → 手 part-of 会社 は自然ではない。 |

| Question-Answering | 質問応答。 人間が自然な言葉で質問すると、AIが質問の意図を理解し、適切な回答を提示する技術。 検索エンジン・チャットボットなどに応用されている。 |

| 意味ネットワーク | 物事の概念や関係性を、ノード(点)とリンク(線)で結び付けて表現する方法。 例)「犬は動物である」、「犬は尻尾を持つ」といった関係を図で表す。 |

| イライザ (ELIZA) | 1960年代に開発された、超初期の自然言語処理プログラム(チャットボットの原型)。 特定パターンにマッチするユーザの発言に対して、用意された返答をする単純な仕組みだったが、人間と会話しているような錯覚を与えることがあり話題になった。 |

| インタビューシステム | ELIZAなどのような、ユーザと対話形式で情報収集をしたりカウンセリングをしたりするシステムを指す。 |

| ウェブマイニング | データマイニングの対象を、Web上のデータ(webページ、リンク構造、アクセスのログなど)に特化したもの。 |

| オントロジー | ある分野の知識を体系的に整理して、概念間の関係や意味を明確に定義したもの。 意味ネットワークをより厳密にしたもののイメージ。 |

| セマンティック Web | web上の情報に意味(セマンティック)を持たせることで、コンピュータにも理解しやすくする仕組みや考え方のこと。 |

| データマイニング | 大量のデータの中から、統計的な手法や機械学習などをつかって、人間にとって有用な知識やパターンを発見する技術 |

| 東ロボくん | 日本の国立情報学研究所が中心となって進めていた、「ロボットは東大に入れるか」というプロジェクトで開発されたAI。 大学入試問題を解くことを目標として、いろんな科目の問題に挑戦した。 |

| マイシン (MYCIN) | 1970年代に開発された、細菌感染症の診断と治療法を助言するエキスパートシステム。 不確実な情報(患者は頭痛がしてるかもしれない、などのあいまいな情報)を扱う仕組みも持っていた。 |

| ワトソン | IBMが開発した質疑応答システム。 Wikipediaの情報をもとにした、ライトウェイトオントロジーが使われている。 2011年、アメリカのクイズ番組「ジェパディ!」で人間のチャンピオンに勝利して大きな注目を集めた。 自然言語処理・知識探索・推論の技術を高度に組み合わせている。 |

5.機械学習の歴史と背景

- 機械学習とは何か説明できる

- 機械学習とルールベース手法の差異、およびメリットデメリットについて説明できる

- 機械学習が注目されるようになった背景を説明できる

- 機械学習がどのような場面において、効果を発揮するのか理解する

- 機械学習の代表的な応用例について理解する

キーワード

| キーワード | 意味など |

|---|---|

| 次元の呪い | 機械学習において、扱うデータの特徴(次元数)が多くなると、必要なデータ量が指数関数的に増加して、学習が困難になったり、モデルの性能が低下したりする現象のこと。 適切な特徴を選択したり、次元削減という手法で対処したりする。 |

| スパムフィルター | 大量のメールデータの中から、迷惑メール(スパム)に共通する特徴を学習して、新しいメールがスパムかどうかを判定するフィルターのこと。 |

| ビッグデータ | 生成速度と交信速度が非常に速い、大規模なデータ。 |

| レコメンデーションエンジン | 通販サイトの購買履歴や閲覧履歴などのデータから、ユーザが興味を持ちそうな商品を予測して推薦する。 |

6.ディープラーニングの歴史と背景

- ディープラーニングがどのように発展してきたのか、その歴史を説明できる

- 古典的な機械学習とディープラーニングの差異を説明できる

- ディープラーニングの代表的な応用例について理解する

キーワード

| キーワード | 意味など |

|---|---|

| ImageNet | 1000万枚以上のラベル付き画像を含む、大規模な画像データベース。 |

| ILSVRC | ImageNetをつかった画像認識の国際的なコンペ。 2012年、ディープラーニング(特に畳み込みニューラルネットワーク)を用いたチームが圧勝して、いままでの手法を大きく上回る精度を達成した。 これにより、ディープラーニングブームの大きなきっかけとなった。 |

| LeNet | 読み方:ルネット。 1998年にヤン・ルカン博士らによって開発された、手書き数字認識のための畳み込みニューラルネットワーク。 現在の一般的なCNNの活性化関数ではReLUが多く用いられるが、LeNetではシグモイド関数を用いている。プーリング層を持たず、代わりに同じ役割のサブサンプリング層を用いている。 郵便番号の自動読み取りなどで実用化された。 |

| アルファ碁 (AlphaGo) | 2016年に、Google DeepMindが開発した囲碁AI。 ディープラーニングと強化学習を組み合わせていて、人間のトッププロ棋士に勝利したことで、AIの能力を世に示した。 |

| 人間の神経回路 | ディープラーニングの基本的なアイデアの源泉。 人間の脳は、多数の神経細胞(ニューロン)が互いに結合して、情報を伝達することで高度な情報処理を行っている。 ニュートラルネットワークは、脳の神経細胞の働きを数学的なモデルで模倣したものとなるが、実際の脳の複雑さとは、大きな隔たりがある。 |

| ネオコグニトロン | 1979年に日本の福島邦彦博士によって提案された、視覚野の神経細胞の構造と働きを模倣した階層的なニューラルネットワークモデル。 特徴抽出を行う「S細胞」と、位置ずれに対して頑健な出力を与える「C細胞」の層を交互に重ねることで、視覚パターンを段階的に認識していく構造を持つ。 学習には、「選択学習(selective learning)」と呼ばれる手法が用いられており、誤差逆伝播法(Backpropagation)は使用されていない。 このモデルは、後の畳み込みニューラルネットワーク(CNN)の構造的な基礎を築いた原型の一つとされている。 |

| LLM (大規模言語モデル) | Transformerというニューラルネットワーク構造をベースに、非常に大量のテキストデータで学習させることで、人間のような自然な文章の生成・質問への回答・要約などの能力を持つモデル。 代表例はChatGPT,Gemini,Perplexity など。 |

機械学習の概要

7.教師あり学習

- 教師あり学習には、特徴量と教師データのペアが必要であることを理解する

- 教師あり学習における、分析対象に応じた問題の種類を列挙・説明できる

- 代表的な教師あり学習モデルの基本概念を理解する

- 目的やデータの特性・量に応じて、適切な教師あり学習モデルを選択できる

- ビジネスにおける教師あり学習の応用例を説明できる

- 教師あり学習:人間があらかじめ付けた正解ラベル付きデータに基づき、未知の値を予測するモデルを構築する

キーワード

| キーワード | 意味など |

|---|---|

| カーネル | 分類ができないデータを、高次元に変換して、分けられるようにする手法。 |

| カーネルトリック | 実際にデータを高次元に変換しなくても、変換後の計算結果だけを求めることができるテクニック。 線形分離できるようにする。裏技的な感じ |

| 回帰問題 | 連続的な数値を予測する問題。被説明変数が連続値をとる。 例)売上予測,株価予測 |

| 分類問題 | データがどのカテゴリに属するかを当てる問題。被説明変数が離散値をとる。 例)手書き文字認識,クレジットカードの不正利用検知 |

| 決定木 | 質問(はい,いいえで回答)を重ねて、分類や予測をする木の形のモデル。人間が見ても判断基準が明確。 大元となる根ノードから、条件分岐を経て先端の葉ノードにたどり着くと、数値・クラスなどの値が出力される。 解釈性が高いのがポイントだが、木の幅や深さを増やす(条件分岐を増やす)と過学習しやすくなるため、剪定(訓練データで決定木を学習させた後、検証データで性能低下に寄与した分岐を切り取る)により過学習を抑えたり、決定木を複数組み合わせるアンサンブル学習を行ったりする。 |

| 勾配ブースティング | 予測の誤差を少しずつ減らしていくように、弱いモデルを順番に足して強くする手法。 勾配とは、「どう変えたら誤差が減るか」のヒントをくれる方向ガイドのようなイメージ |

| サポートベクターマシン (SVM) | データを分類するためのアルゴリズムの一つ。 データのグループを一番きれいに分けられる境界線(or面)を探す方法。 マージン(データ同士の距離)を最大になるような線を引く。 カーネルトリックのおかげで、高速に分類できる。 |

| 線形回帰 | 説明変数と目的変数の関係を直線や超平面などで表すモデル。 大きく「単回帰分析」と「重回帰分析」に分けられる。 |

| 重回帰分析 | 回帰分析(数値の予測を目的とする手法)の一種で、特徴量(説明変数)が2つ以上ある。2次元の場合平面で、3次元以上の場合は超平面となる。 例)広さ・築年数・駅からの距離で、家賃を予測する |

| 多クラス分類 | 3つ以上の判定対象に対し、どれか一つに分類をするタスク。 教師(正解ラベル)ありなので、正解ラベルがないクラスタリングとは別物になる。 例)メールを、「重要/迷惑/その他」に振り分ける |

| アンサンブル学習 | 複数の学習器(≒モデル)を組み合わせることで、未知のデータに対してより精度の高い予測を得る(汎化性能を向上させる)ことを目的とする手法。 個々のモデルの弱点を補い合い、より頑健な予測を実現する。 代表例:バギング、ブースティング、スタッキングなど。 |

| バギング | アンサンブル学習の代表的な手法の一つで、各モデルを並列に学習させる。 「ブートストラップサンプリング」という手法で、元の訓練データから重複ありでランダムにサンプルを複数生成し、それぞれのサンプルで独立にモデルを学習させる。 複数のモデルを並列的に学習させ、最終的に多数決(分類)や平均(回帰)で予測を統合する。 ばらつきを減らし(分散を抑制)、過学習を防ぐ効果があるが、計算コストは増える。 |

| ブートストラップサンプリング | バギングなどで使われる再サンプリング手法。 元データから、同じサイズのデータを重複ありでランダムに抽出することで、新たな訓練データを作る。 「シャッフルして何度も引き直すイメージ」で、元データの多様性を活かしつつモデルの汎化性能を高める。 |

| ランダムフォレスト | バギングを拡張したアンサンブル学習の手法。 多数の決定木を構築し、それぞれの予測を多数決(分類)や平均(回帰)で統合。 各決定木を学習する際、ブートストラップサンプリングでデータを用いるだけでなく、分岐ごとに使う特徴量をランダムに選ぶことで相関を減らし、モデル全体の多様性を確保する。 高精度・高安定性を両立し、医療診断や需要予測など幅広いタスクで活用される。 |

| ブースティング | アンサンブル学習の代表的な手法の一つで、各モデルを直列(逐次的)に学習させる。 一つ前のモデルで誤認識してしまったデータに対して重みをつけて、次は重点的に学習することで間違った部分を補っていく。 |

| AdaBoost | 読み方:アダブースト。 ブースティングの一種。弱い学習器(簡単なモデル)を何個も順番に組み合わせて、正確な予測を作る手法。 間違いを治すモデルを次々に足していって、全体を強くする仕組みのイメージ |

| 自己回帰モデル (AR) | 時系列データにおいて、現在の値を過去の自分の値(ラグ)に基づいて予測するモデル。 式の形は「Yt = a₁Yt−1 + a₂Yt−2 + … + aₙYt−n + εt」のようになる。 売上・気温・株価など、単一の時系列データの傾向を予測する際に用いられる。 例:「昨日・一昨日の売上を使って今日の売上を予測する」など。 |

| ベクトル自己回帰モデル (VARモデル) | 自己回帰モデル(AR)の多変量拡張版。 複数の時系列変数(例:金利・為替・株価など)が互いに影響しあう関係を同時にモデリングできる。 各変数が、自分自身だけでなく他の変数の過去値にも依存する点が特徴。 採用する変数が増える(多変量になる)と、パラメータ数が増え、過学習リスクが高まるため、本当に必要な変数に絞り込むことが重要。 式の形は「Yt = A₁Yt−1 + A₂Yt−2 + … + AₙYt−n + εt」のように、Yがベクトル、Aが行列となる。 経済・金融・需要予測など、複数の時系列データが相互に関連している現象に適用される。 |

| マージン最大化 | 境界線を、両クラスからできるだけ遠ざけることで、分類の安定性を高める工夫。 マージンが広くなると、少しずれても、正しく分類ができる。 ソフトマージン:誤差を許容。 ハードマージン:誤差を許容しない。 |

| ロジスティック回帰 | 「回帰」と名前についてるが、分類問題に使われる手法。 ある出来事が起こる「確率」を予測し、一定の基準(一般的には50%)より高ければAグループ,低ければBグループに分類するイメージ。出力にはシグモイド関数が使われる。 |

8.教師なし学習

- 教師なし学習には、特徴量のみが必要であることを理解する

- 教師なし学習における、分析対象に応じた問題の種類を列挙・説明できる

- 代表的な教師なし学習モデルの基本概念を理解する

- 目的やデータの特性・量に応じて、適切な教師なし学習モデルを選択できる

- ビジネスにおける教師なし学習の応用例を説明できる

- 教師なし学習:ラベル(正解)のないデータから、データの持つパターンや構造を見つけることを目的とするモデルを構築する

キーワード

| キーワード | 意味など |

|---|---|

| k-means 法 | 読み方:ケイミーンズ法。 クラスタリングの中で特に基本的でよく使われるアルゴリズムで、データを事前に決めた数(k個)のグループに分けたい」というときに使う。 k個のグループの中心点を決め、各データがどの中心点に一番近いかを計算し割り当てる。 その後中心点を更新して、割り当てが変わらなくなったら終了。 例)全校生徒を、体力テストの成績に応じて「運動得意グループ」「普通グループ」「運動苦手グループ」の3つに分ける |

| t-SNE | 次元削減の手法の一つで、t-Distributed Stochastic Neighbor Embedding の略。 たくさんの特徴量を持ったデータを、人間が見やすい2次元や3次元に変換して可視化する。 |

| ウォード法 | 階層的クラスタリングの一種で、似たものをペアで少しずつまとめていく(クラスタ間の距離の増加を最小化するようにクラスタをマージする)方法。 データがそれぞれ別の小さなグループと考え、似ているグループ同士を順番にくっつけて、最終的に一つの大きいグループになるまで続ける。 クラスタリング結果はツリー構造(デンドログラム)として可視化され、上から順にたどっていくことで、事後にクラスタ数を決めることができる。 |

| 協調フィルタリング | 似た行動をしている人同士の好みを使ってレコメンドを行う手法。 コールドスタート問題に弱い。 例)「この商品を買った人は、次にこんな商品も買っています」 |

| クラスタリング | 似た特徴を持つデータを自動でグループ分けするアルゴリズム。 正解(ラベル)はなく、データの傾向やまとまりを見つけたいときに使う。 |

| ★クラスタ分析 | (シラバス未記載) クラスタリングした(分類を分けた)結果の意味やパターンを解釈・分析すること。 例)マーケティングにおける、顧客セグメンテーション |

| ★クラスタ分類 | (シラバス未記載) クラスタリングした(分類を分けた)結果をもとに、新しいデータがどのクラスタに属するかを判断する作業。 属するクラスタは、人ではなく機械がまとめたグループ。 |

| コールドスタート問題 | 新規ユーザは行動情報などがないため、適切なレコメンドが出せないという問題。 |

| コンテンツベースフィルタリング | 商品の特徴とユーザの好みを照らし合わせてレコメンドする手法。 例)「あなたが過去に見た映画と似たテーマのおすすめ映画があります」 |

| 次元削減 | たくさんの情報を、大事なところだけ残してコンパクトにする問題。 データの項目数(=次元)が多いと扱いが大変になる(次元の呪い)ため、本質的な情報を残したまま、項目数を減らしてデータを表現しなおす。 例)高次元を低次元にマッピング。 |

| 主成分分析 (PCA) | 次元削減の代表的手法で、高次元データをより少ない次元で効率よく表現するための統計的手法。 多数の特徴量を持つデータから、最もデータのばらつき(分散)が大きい方向を主成分として見つけ出し、その方向に沿ってデータを新しい座標軸(主成分)に変換する。 第1主成分は分散が最大となる方向、第2主成分は第1主成分と直交しつつ次に分散が大きい方向…というように順に定義される。 主成分は元の特徴量の線形結合であり、互いに直交する(無相関)。 画像圧縮や可視化、ノイズ除去などに応用される。 |

| 潜在的ディリクレ配分法 (LDA) | トピックモデルの代表格。 各文書が複数のトピックから構成されているという仮定に基づいて、文書のトピック構造を推定するアルゴリズム |

| 多次元尺度構成法(MDS) | データ間の距離(類似度)をつかって、各データ点を低次元の空間に配置する手法。 クラスタリングの前段階で、似ているデータほど近くに配置する地図のようなものを作り、可視化できるようにする |

| デンドログラム (樹形図) | 階層的クラスタリングの結果を、ツリー状で可視化する手法。 顧客や商品を段階的にグルーピングしたい際に便利。 例)売れている商品を、売れ方や使い方の傾向で自動でまとめる |

| 特異値分解 (SVD) | 次元削減の代表的な手法。 データの行列(数字が縦横に並んだもの)を、行側の特徴×重要度×列側の特徴に分解するテクニック。 推薦システムでよく使われる。 例)ユーザ×商品の行列を、ユーザの特徴×重要度×商品の特徴に分解する |

| トピックモデル | 文章の集まりから、潜在的に含まれているトピック(話題)を見つける統計的なモデル。 |

9.強化学習

- 強化学習の基本概念を理解する

- 強化学習と、教師あり学習および教師なし学習との差異を説明できる

- 価値関数の学習と、方策の学習の2つの代表的なアプローチを理解する

- 各アプローチに属する代表的な強化学習手法について概要を理解する

- ビジネスにおける強化学習の応用例を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| ★方策 | (シラバス未記載) 英語だとPolicy(ポリシー)。 「どの状態のときに、どんな行動をとるか」を決めるルールや戦略のこと。 方策はπという記号で表し、強化学習の目的は、「報酬が最大になるような方策πを見つけること」にある。 方策の改善で使われるのは、「状態価値関数」や、「行動価値関数」などがある。 |

| Actor-Critic | Actor(アクター:演者)+Critic(クリティック:批評家)。 Actorは方策に従って状態に応じた行動を選択したり、Criticの評価を受けて方策そのものを更新したりする。 Criticは、Actorが行った行動を価値関数で評価する。(実際の学習ではTD誤差が使われることが多い) ロボット操作やゲームAIなど、柔軟な動きが求められる場面で活躍する。 |

| TD誤差 | 英語だと、Temporal Difference Error。 価値の予測がどれくらい外れたかを測るもので、価値関数の更新に使う。 TD誤差が大きいと、ズレの修正が多くなり、学習のアップデート量も多くなる。 |

| ★Actor-Criticについて補足 | ①Actorが行動𝑎を方策πに基づいて選ぶ ②Criticが①の行動に対して評価する。 評価基準は、行った行動がどれだけ価値があるか=行動価値関数や、(行動後の)今の状態がどれだけ価値があるか=状態価値関数によって決まる。 ③Actorが、②の評価をもとに、方策自体を更新し、あらたな方策を基に、現在の状態に応じて行動を選ぶ。 以下②と③をループ。 ※厳密には、方策の改善と評価は並行して行われる。 |

| 行動価値関数 | Action Value Function:Q関数。𝑄(𝑠,𝑎)で表される。 ある状態で、ある行動(方策に従ってなくてもよい)をとったあと、それ以降は現在の方策πに従って行動をとった際に得られる、期待割引報酬の合計。 |

| 状態価値関数 | State Value Function:V関数。 ある状態にいるときに、現在の方策 π に従って行動したときに得られる、期待割引報酬の合計。 |

| ★期待割引報酬 | (シラバス未記載) 今の報酬と将来の報酬に段階的に割引をかけて合計した、期待される報酬の合計。 強化学習においては、「今の報酬のほうが価値が高く、将来の報酬ほど価値が低くなる」という考え方が一般的なため、割引率をかけて、期待値を計算する。 |

| 割引率 | 「今の報酬のほうが価値が高く、将来の報酬は、時間がたつほど価値が下がる」という前提のもと、報酬にどれくらいの価値を置くかを決めるためのパラメータ。 γで表され、0~1の間の値をとる。 |

| Q 学習 | Q値を少しずつ学習しながら更新することで、方策(最適な行動ルール)を見つける、モデルフリーな強化学習手法。 行動価値関数を学習し、状態ごとに最適な行動を選択する方式。 |

| Q値 | Q関数(行動価値関数)の値のこと。 |

| ε-greedy方策 | 読み方:イプシロン・グリーディ。 最適行動が分かっている際に、確率1-εで最適行動を行い、確率εでランダムな行動を行う。 探索と活用のバランスを取るために、Q学習で得た知識を使いつつ、たまに新しい行動を試すための行動選択ルール。 例)ゲームで強武器とされている武器ばかり使いがちだが、あまり使ってない別武器のほうが後々強いこともあるので、たまに別の武器も使ってみる。 |

| UCB 方策 | Upper Confidence Bound(上限信頼界)。 「今までの報酬が良いもの」+「まだあまり試していないもの」をバランスよく選ぶための方策。 ε-greedyと異なり、行動ごとの「不確かさ(信頼区間)」を考慮した選択ができるため、理論的に保証された探索性能を持つ。 |

| バンディットアルゴリズム | 状態が固定されていて、「どの行動が一番儲かるか」を少ない試行で見つけるための、問題設定と戦略のこと。 例)目の前に5台のスロットマシンがあり、それぞれ出る確率はバラバラ。最も稼げる台を探したいけど、何回も試せない!というときに使う |

| 方策勾配法 | 報酬がたくさんもらえるように、「どう行動するかのルール(方策 π)そのもの」を改善する手法。 |

| REINFORCE | モデルフリー(学習済み環境モデルを使わない)の方策勾配法。 1回の行動の流れ(エピソード)が終わった後に、得られた報酬に応じて、方策を強化する。 モンテカルロ法に基づいており、価値関数は使わない。 デメリットは、 毎回の学習がエピソード全体を終えてからでないと行えないので、学習に時間がかかりやすく、途中で入ってくるノイズにも弱い。 例)ゲームで高得点を出せたプレイを見て、良い行動とみなして繰り返す |

| マルコフ決定過程 | 強化学習の問題をモデル化するための枠組み。 状態(State),行動(Action),報酬(Reward),遷移確率(ある行動を行った際、次にどうなるかの確率)により構成されている。 |

| ★マルコフ性 | (シラバス未記載) 「未来は“今の状態”だけで決まり、過去の情報はいらない」という性質のこと。 例)サイコロの目が出る確率は、過去に何の目が出たかは関係ない |

| ★マルコフ過程 | (シラバス未記載) マルコフ性を持つ「状態の遷移だけ」に注目したモデル。 例)人が部屋をランダムに移動するゲーム。どの部屋に次行くかは今の部屋だけで決まる |

| ★マルコフ報酬過程 | (シラバス未記載) マルコフ過程に、「報酬」を追加したもの。状態を移動するたびに、得点がつくイメージ。 例)歩いて次の部屋に移動したら、コインがもらえるorコインを失う。部屋ごとに得点がある |

10.モデルの評価

- 基本的なモデルの選択基準、評価方法並びに評価指標を理解する

- 訓練誤差と汎化誤差の違いを説明できる

- データの量や目的に応じて、汎化性能を推定する検証方法を適切に選択できる

- 汎化性能の悪化につながる代表的な現象を列挙・説明できる

- モデルの適用環境、ビジネス課題、並びに目的に応じて、適切な評価指標・モデルを選択できる

- モデルの複雑さを上げることによるメリット・デメリットを理解した上で、モデル選択の指針を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 汎化性能 | 学習したモデルが、「未知のデータにどれだけ正しく対応できるか」という能力のこと。 例)「猫の写真」を見せて学習させたモデルが、「別の猫の写真」を見せたときに、「猫」と認識できるかどうか。 |

| 過学習 | 訓練データに合わせすぎて、新しいデータに対応できなくなっている状態を指す。 例)テスト対策で、答えを丸暗記して高得点をとれるようになったが、実際の問題は言い回しが少し変わっており、さっぱり解けなかった。←過学習が起きた |

| 訓練誤差 | モデルが訓練データに対してどれだけ正確に予測できるか(どれだけ間違えたか)を示す指標。 |

| 汎化誤差 | モデルが新しい(未知の)データに対してどれだけ正確に予測できるか(どれだけ間違えたか)を示す指標。 |

| ホールドアウト検証 | データセットをあらかじめ1回だけ「訓練用」と「テスト用」に分割し、以下の手順でモデルを評価する方法。 ① 訓練データでモデルを学習 ② テストデータで性能を評価 シンプルで計算コストが低く、実装も容易。分割の仕方によって評価結果が大きく変動しやすいため、評価の信頼性が低くなることがある。 |

| 交差検証 | データの分割による評価のばらつきを抑えるための方法。 データを複数回分割して繰り返し学習・評価を行い、結果を平均することで安定した評価を得る。特にデータ量が限られている場合に有効。 |

| k-分割交差検証 | 交差検証の代表的な手法。 ① データを均等にk個のグループ(fold)に分ける ② 各foldを1回ずつテスト用データにし、残りのk-1個を訓練用データとして学習・評価を実施(合計k回) ③ k回の評価結果を平均して、モデルの性能を評価する すべてのデータが訓練とテストの両方に使われるため、評価の安定性が高い。 k回分のモデル学習が必要となるため、計算コストが高くなる点に注意が必要。 |

| 混同行列 | モデルの予測結果と実際の正解の対応関係を表にまとめたもの |

| 偽陽性 | 陰性なのに、陽性と予測したもの。 例)スパムメールじゃないのに、スパムメールと判定した) |

| 偽陰性 | 陽性なのに、陰性と予測したもの。 例)スパムメールなのに、スパムメールじゃないと判定した |

| 正解率 | どれくらい全体で当たっているか。 |

| 適合率 | 「陽性」と予測した中で本当に正しかった割合。予測確実性を上げたい場合に、評価指標として利用される。 例) ①間違って陽性とするのを避けたいケース→スパム分類や採用選考など ②「どれだけ正解の予測が当たっているか」の指標が重要なケース→レコメンドシステムや検索結果など |

| 再現率 | 実際に陽性だった中で、ちゃんと当てられた割合。病気の検出などは、陽性を正しく検知する必要があるので、再現率重視のほうが良い。 |

| F値 | 適合率と再現率のバランス(調和平均)を評価する指標。 |

| MSE・RMSE・MAE | 回帰モデルの評価に使う誤差指標。 MSE:Mean Squared Error(平均二乗誤差)。予測値と実際の値の差(誤差)を2乗して平均。大きな誤差を強くペナルティとするため、医療・金融など、ミスが致命的となる場面に向いている。 RMSE:Root Mean Squared Error(平方根平均二乗誤差)。MSEの平方根を取ったもの。単位が元のスケールと揃うため、評価を人間感覚に合わせたいときに向いている。 MAE:Mean Absolute Error(平均絶対誤差)。誤差の絶対値を取って平均するため、測定値と同じ単位になり、誤差の解釈に使いやすい。MSEより外れ値に強いやさしい評価となるため、売上予測など、外れ値があっても安定した評価をしたいときに向いている。 |

| ROC曲線・AUC | ROC曲線:予測モデルが、閾値を変えながら、陽性・陰性をどれくらいうまく判別できているか?」を可視化する曲線。縦軸には真陽性率、横軸には偽陽性率をとったグラフとなる。 AUC(Area Under the Curve):「ROC曲線の下の面積」のこと。0~1の値で、1に近いほど判別性能が高いことを表す。 データの偏りに左右されにくいが、陽性自体が少ない場合、その中で陽性と判定した数が多ければ、値は高くなってしまう。そのため予測の確実さや再現性は直接保証していない。 |

| 赤池情報量規準 (AIC) | モデルの予測性能と複雑さのバランスを見る指標。 過学習を防ぐため、より少ないパラメータでよい精度が出るモデルを評価する。 |

| ベイズ情報量規準 (BIC) | AICに比べると、データ量が多い場合に、よりペナルティが多くなる。 そのため、AICに比べると保守的で、シンプルさを重視している指標となる。 |

| オッカムの剃刀 | 「同じ予測性能なら、よりシンプルなモデルの方が望ましい」という、モデル選択の考え方で出てくる哲学的な原則。 |

ディープラーニングの概要

11.ニューラルネットワークとディープラーニング

- ニューラルネットワークの基礎的な知識を理解する

- ニューラルネットワークとディープラーニングの関係を説明できる

- ディープラーニングの学習に必要なデータ量や計算リソースについて理解し、ディープラーニングが適用可能な場面を挙げることができる

- CPU・GPU・TPUの特徴をそれぞれ説明できる。

- GPUやTPUがディープラーニングの学習・推論に適する理由を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 用語 | 説明 |

| ------ | ------ |

| 単純パーセプトロン | 人工ニューラルネットワークの最も基本的な構成要素で、入力層と出力層のみからなる1層のモデル。 各入力に重みをかけて合計し、閾値を超えたら出力するというシンプルな仕組み。 線形分離可能な問題(直線で分けられる問題)しか解けず、XORのような非線形問題には対応できない。 例:AND、ORは解けるが、XORは解けない(Minsky & Papert, 1969 によって指摘) |

| 多層パーセプトロン(MLP) | 単純パーセプトロンを多層に積み重ねた構造(1つ以上の隠れ層を含む)を持つニューラルネットワーク。 隠れ層に非線形活性化関数(例:ReLU, tanhなど)を挟むことで、非線形な関係も学習可能になる。 構造上、画像などの空間構造(位置関係)を考慮できないため、画像処理ではCNNなどの特殊なネットワークが好まれる。 ディープラーニングの基本構造となるため、自然言語処理や表形式データなど多くのタスクで活用されている。 |

| 隠れ層・入力層・出力層 | 入力層:最初にデータを受け取る層 隠れ層:入力を処理して特徴を抽出する層。層の数が増えるとネットワークの表現力が高まる一方、計算量増加や、過学習リスク増加が懸念される。 出力層:最終的な予測や分類結果を出力する層 補足:入力層・出力層は、「可視層」とも呼ばれる。 |

| CPU | Central Processing Unitの略。 汎用型の計算装置。少数の高性能コアで、1つずつの処理を効率よくこなすことが得意。 複雑な判断や操作も対応できるが、並列処理は苦手。 |

| GPU | Graphics Processing Unitの略。 並列処理が得意で、映像処理やAIモデル学習で計算が速い。 |

| TPU | Tensor Processing Unitの略。 GoogleがAI用に開発した専用のチップで、TensorFlowというGoogleのライブラリ向けに最適化されている。 大規模な推論処理や学習処理に強いが、汎用性は低く、GPUのように幅広いアプリケーションには使えない。 |

12.活性化関数

- 代表的な活性化関数の定義・使い分け・注意点について、それぞれ説明できる

- ディープラーニングにおける活性化関数の役割を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| ★活性化関数 | (シラバス未記載) ニュートラルネットワークの各ノード(ニューロン)で使われる関数。 入力値を受け取り、その情報を次の層にどれだけ伝えるか、を決める役割。 |

| シグモイド関数 | Sigmoid関数。 曲線状でSのような形になり、主に確率のような値を出す際に使われる。 出力は0~1の間だが、入力が大きいと勾配がほぼ0になり、勾配消失(学習が止まる)が起きやすい。 点(0,0.5)を中心とする点対称で、下限値は0。 |

| tanh 関数 | Hyperbolic tangent function, 双曲線正接関数。 原点対称で、出力が-1~1の間となるため、シグモイド関数よりも中心が0に近く、扱いやすくなるが、こちらも勾配消失が起きやすい。 |

| ReLU 関数 | Rectified Linear Unit関数。正規化線形関数と呼ばれる 入力が正の値ならそのままの値、負の値なら0の値を出力する。 計算が簡単で、勾配消失が起こりにくい。 負の入力がすべて0になるため、学習が止まる(ニューロンが死ぬ)ことがある。 |

| Leaky ReLU 関数 | ReLUの改良版活性化関数。 ReLUは負の入力を0にするため、ニューロンが死んで勾配が流れなくなる「Dead ReLU」問題が起こることがある。 Leaky ReLUでは負の値でも小さい傾きを持たせて(例:f(x) = x if x>0, αx if x≤0、αは0.01などの小さい値)、勾配を残すことで学習が止まりにくくする工夫をしている。 例:負の領域でも微小な勾配が流れるため、パラメータ更新が続き、表現力が向上する。 |

| ソフトマックス関数 | 複数の出力がある場合に、それぞれ0~1の範囲で出力する。 すべての出力の合計が1になるため、確率的解釈が可能だが、絶対的な確率ではなく、スコアに基づいた相対的な重みづけと考える。 主に多クラス分類(例:画像をライオン・パンダ・カラスに分類する)で使用される。 |

| 勾配消失問題 | 活性化関数の勾配(傾き)が小さいと、誤差(微分)が出力層から入力層にうまく伝わらず、学習が進まなくなること。 シグモイド関数やtanh関数は、入力が大きいと出力がほぼ一定となってしまうので、うまく伝わらなくなる。 例)伝言ゲームで、前の人の声が小さいと、どんどん聞き取りにくくなり、最終的にはうまく伝わらなくなる。 |

13.誤差関数

- 誤差関数の基礎的な知識を理解する

- 代表的な誤差関数を理解する

- 適用するタスクに応じて、適切な誤差関数を選択できる

キーワード

| キーワード | 意味など |

|---|---|

| 誤差関数 | 損失関数とも呼ばれる。 「モデルの予測が、どれだけ正解からズレているか」を数値で表す関数。 誤差をできるだけ小さくすることが、ニュートラルネットワークの学習の目標。 |

| 平均二乗誤差 | Mean Squared Error(平均二乗誤差)。 予測値と実際の値の差(誤差)を2乗して平均した値で、回帰タスク(数値の予測)で使われる。 外れ値に厳しく、大きな誤差を強くペナルティとするため、医療・金融などミスが致命的となる場面に向いている。 |

| 交差エントロピー(Cross Entropy) | 分類タスク(犬or猫or鳥?)で使われる。 モデルが予測した「確率的な予測」と、実際の「正解の確率」の誤差を測ることで、モデルの答えの正確性を評価する指標。誤差を直接測る。 正解クラスに高い確率を割り当てるほど、損失が小さくなる。 |

| カルバック・ライブラー情報量 (KL) | Kullback–Leibler divergence。 2つの確率分布(何かが起きる確率のパターンのようなもの)が、どれだけ違っているかを測るための指標。 交差エントロピーと違い、2つの分布の情報量の損失を測る。 「交差エントロピー − エントロピー = KL」となる。 |

| Contrastive loss | コントラスト損失。 「2つのデータが、似ているか似ていないか」を学習させるときに使う。 似ているペア間の距離はできるだけ小さく、逆に似ていないペアは一定のマージンより大きくなるように学習する(ある程度離れていないと損失がゼロにならないため)。 例)顔認証や、類似画像検索(似てるor似てない) |

| Triplet Loss | トリプレット損失。 3つのデータの組(トリプレット)を使って学習する。 Anchor(基準)を基に、Positive(似てる)は近くに、Negative(違う)は遠くに配置する。 例)Aさんの顔写真を基に、Aさんの別の写真は近くに、Bさんの顔写真は遠くに配置する。 コントラスト損失に比べると、相対距離が学習するため、より細かい判別が必要な際に使われる。 |

14.正則化

- 正則化を導入する目的を説明できる

- 代表的な正則化手法の特徴を説明できる

- 獲得したいモデルの特性に応じて、適切な正則化手法を選択できる

キーワード

| キーワード | 意味など |

|---|---|

| 正則化 | モデルの過学習を防ぐため、「余計な学習をおさえるペナルティ」を加える仕組み。 訓練データだけに過度に適合するモデルを避けることで、汎化性能が向上し、未知のデータに対しても予測精度が高まる。 |

| L0 正則化 | 少ないパラメータ数でモデルを作るため、使っているパラメータの数に直接ペナルティをかける方法。 現実では、近似的にL1正則化が使われる。 |

| L1 正則化 | 不要な一部のパラメータをゼロにするため、パラメータの絶対値の合計にペナルティをかける方法。 変数が多すぎるときや、重要な特徴のみ残したいときに使う。 スパースな(ゼロの重みが多い)モデルを作りやすい。 |

| L2 正則化 | すべてのパラメータをなだらかに小さくするため、パラメータの二乗の合計にペナルティをかける方法。 特徴はすべて使いたいが、特定の特徴量の重みが極端に大きくなるのを避け、モデルを安定させたいときに使う。 重みの大きさに制約を与えることを、荷重減衰と呼ぶ。 |

| ドロップアウト | 学習中に、一部のノード(ニューロン)をランダムに無効化する手法。 モデルが特定のノードに依存しすぎて、過学習しやすくなるのを防ぐのが目的。 |

| ラッソ回帰 | L1正則化を使った回帰モデルのこと。 例)ECサイトで顧客が商品を購入するかの予測モデル。 顧客データの中には、購入の意思決定に関係のない特徴量も含まれる可能性が高いので、あまり関係ない(と判断される)特徴量の影響力はゼロにする。そうすると、本当に効いている特徴だけを自然に選び出すことができる。 |

| リッジ回帰 | L2正則化を使った回帰モデルのこと。 例)中古車価格の予測モデル。 予測する際の情報はそれぞれ似通っていて、関係ないかどうかの判断が難しいが、全部少しずつ使いたい。 そのため、すべての特徴量の影響力を全体的に少しずつ小さくする。 |

★L1→絶対値の合計にペナルティ

★L2→二乗の合計にペナルティ

15.誤差逆伝播法

- 誤差逆伝播法の概要を説明できる

- 誤差逆伝播法の適用時に生じる問題とその主たる原因について説明できる

キーワード

| キーワード | 意味など |

|---|---|

| ★誤差逆伝播法(バックプロパゲーション) | (シラバス未記載) ニューラルネットワークの学習時に、出力層での誤差を入力層までさかのぼって伝え、各重みを調整する(誤差を逆方向に伝播する)仕組み。 損失関数の微分(変化率)を使って、重みの更新量を決める。決まった重みを、勾配降下法で更新する。 |

| 連鎖律 | 複数の関数が組み合わさってできている関数(合成関数)の微分(変化率)を計算するためのもの。 「全体の変化率=部分的な変化率の掛け算」という考え方。例)いくつかの歯車が連動して動いている機械をイメージ。 「一番最初の小さな歯車を一回転させたとき、真ん中の歯車を介して、最終的に一番大きな歯車はどれくらい動くのか?」というのを、それぞれの歯車の関係性(微分=変化率)を掛け合わせて計算するのが連鎖律の役割。 |

| 勾配爆発問題 | 誤差を逆伝播している途中に、勾配(微分の値)が異常に大きくなってしまう現象。 逆伝播時は、各層の勾配を掛け合わせて乗算が繰り返すので、勾配が大きい層があると、どんどん乗算され、勾配が爆発(無限大に近づく)してしまう。 勾配爆発が起きると、学習が進まなくなったり、ロスが非数(計算不能)になったりする。 例)伝言ゲームをしているとき、1人だけ長い言葉を言いすぎると、次の人が思考停止してしまう。 |

| 信用割当問題 | Credit Assignment Problem(信用配分問題)。 「ある出力結果が得られたとき、その結果に対してどの要素(中間層のニューロンや入力特徴量など)が、どれだけ貢献したのかを正しく評価することが難しい」という問題。 深層学習では特に、多層構造の中で各層・各ニューロンの貢献度が直感的に把握しづらいことから、学習や可視化の難しさにつながる。 強化学習では、「報酬が得られた行動が、どの過去の行動や状態によるものか?」という因果関係を特定することが困難であるという形で現れる。 この問題を解決するために考え出されたのが、誤差逆伝播法である。 |

16.最適化手法

- 勾配降下法の概要を理解する

- 勾配降下法の問題とそれを解決するための手法を列挙できる

- 勾配降下法の計算を効率化する方法を説明できる

- ハイパーパラメータの概要と代表的な調整方法を列挙・説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 勾配降下法 | Gradient Descent。 誤差(損失)が小さくなるように、最小値の方向に、少しずつパラメータ(重み)を調整する方法。 学習率(η)の調整が難しく、勾配が小さくなると、学習が進まなくなる。 |

| ハイパーパラメータ | 訓練開始前に、人間が事前に設定する必要があるパラメータのこと。一般的には人間が手動で調整を行っている。 チューニング時は、訓練データの中から取り出した検証データを使う。 適切な値を選択すれば、モデルの性能が向上する。 勾配降下法においては、学習率がパラメータとなる。 |

| 確率的勾配降下法 (SGD) | Stochastic Gradient Descentの略で、1件または少数のデータをランダムに使って勾配を更新する方法。 変数(次元)毎の傾きを考慮せず、単純に勾配方向に進む。 そのため、特定の次元の傾きが大きくて、別の次元の傾きが緩やかであるような目的関数では、非効率な経路をたどる。 ミニバッチ確率的勾配降下法、とも呼ぶ。 |

| 学習率 | 勾配を使ってパラメータをどれだけ更新するかを決める「歩幅」のこと。 |

| バッチ学習 | すべてのデータを使って1回学習する方法。 安定した勾配が得られるが、メモリや時間のコストが大きい。 |

| ミニバッチ学習 | 複数件ずつ(例:32件、64件など)に分けて学習する方法。 バッチとSGDの中間的手法で、効率と安定性のバランスが良い。 |

| オンライン学習 | 1件ずつリアルタイムでデータが届くたびに学習する方法。 大量のストリーミングデータに対応でき、逐次的な学習が可能。 |

| エポック | 学習に使う「全データを1回使い終えること」 例)1000件のデータ × エポック数10→全体で10回繰り返し学習 |

| イテレーション | 反復。パラメータを1回更新すること。→ミニバッチ32件なら、1エポックに1000÷32≈32イテレーション 1イテレーションあたりに用いるデータの数は、バッチサイズで表す。 例)60,000個の訓練データを用意.イテレーションを12,000回、バッチサイズ100で学習を行う場合・・・ 1エポックあたりのイテレーションは60000÷100=600回。全体のイテレーションが12,000回なので、エポックは12000÷600=20回 |

| 局所最適解 | 一時的に「これ以上良くならない」と思える場所。 もっと良い答え(大域最適)があっても、途中で引っかかってしまう場所。 |

| 大域最適解 | 本当に誤差が最小になる場所(=最も良いパラメータ)。 モデルがゴールとして目指したい場所。 |

| 早期終了 | Early Stopping。 検証データの誤差が悪化し始めたら、学習を途中でやめる方法。 |

| ノーフリーランチの定理 | どんな問題にも必ず優れた学習手法なんて存在しないという考え方。 |

| 二重降下現象 | モデルが複雑になると、一度エラーが増えたあと、再び減るという不思議な現象。 モデルの複雑さが増すと、誤差は減って→増えて→また減る。 |

| モーメンタム | SGDに「前回の更新量に比例した項(勢い)」を加えることで、局所最適を回避しつつ谷底に早くたどり着くようにする手法。 坂道にリンゴを転がすように、滑らかに進むことで収束を速める。 |

| AdaGrad | 特徴量ごとに学習率を調整する手法。 頻繁に更新されるパラメータの学習率は小さく、あまり更新されないパラメータの学習率は大きく保たれる。 学習が進むと学習率が極端に小さくなって、最終的に学習が停滞しまう問題がある。 |

| RMSprop | AdaGradの欠点である「学習率がどんどん小さくなる」問題を解決。 過去の勾配の二乗平均(指数移動平均)を使って、学習率を安定して調整する。 勾配が変化する問題にも安定して対応可能。 |

| AdaDelta | RMSpropに似た手法で、学習率(パラメータ)を明示的に設定する必要がないのが特徴。 勾配と更新量の両方の移動平均を使い、更新を正規化することで安定性を向上。 |

| Adam | MomentumとRMSpropを組み合わせた最適化手法。 勾配の一階・二階モーメント(平均と分散)を用いて学習率を自動調整。 現在最も広く使用されており、多くのディープラーニングモデルで標準的に使われる。 |

| ★AMSGrad | (シラバス未記載)Adamの欠点である「収束性の保証がない」問題を修正した手法。 学習率を決定する際の勾配の二乗の移動平均を、単調非減少(常に増えるか、少なくとも減らない)にするという工夫が施されている。 |

| AdaBound | AdamとSGDのハイブリッド。 Adamの学習初期の高速性と、SGDの収束時の安定性を併せ持つ。 学習率に上下限(バウンド)を設けることで、暴走を抑えつつ徐々に安定した学習率に収束する。 |

| AMSBound | AdaBoundの派生手法で、AMSGradの「収束の安定性向上」の特徴も組み合わせたもの。 学習率の下限と上限を徐々に絞りながら、勾配の最大値保持で安定性も確保。 |

| 鞍点(あんてん / Saddle Point) | 一見すると最小にも最大にも見えるけど、どちらでもない“停滞点”のこと。 鞍点は馬の背中のように中央がへこんでいるけど、横から見ると盛り上がっているため、「もう最適解に着いた」と勘違いして学習が止まる可能性がある。 鞍点のような“局所的に変化のない”部分にとどまることも、広義にはプラトーと呼ばれる。 |

| グリッドサーチ (Grid Search) | あらかじめ設定したハイパーパラメータの最適な組み合わせを網羅的に探す方法。 実装が簡単だが、すべてのパターンを試すため計算コストが高く、次元の呪いにかかりやすい。 |

| ランダムサーチ | ハイパーパラメータの最適な組み合わせを、ランダムにサンプリングして探す方法。 いろんな組み合わせをランダムに試すことで、効率よく最適解に近づける可能性が高い。 高次元問題では、ランダムサーチのほうが効果的な場合がある。 |

ディープラーニングの要素技術

17.全結合層

- 全結合層の概要を理解する

- 全結合層のパラメータ数について理解する

- ディープラーニングにおける全結合層の役割を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 重み | 入力の重要度を決めるための「調整つまみ(係数)」 |

| 線形関数 | 「足し算と掛け算だけ」で表されるまっすぐな関数 |

18.畳み込み層

- 畳み込み層の基礎的な知識を理解する

- 全結合層と畳み込み層の差異について、説明できる

- 畳み込み層の役割について説明できる

- 畳み込み層のパラメータ数について理解する

- 畳み込み層が適用できるデータの特性について理解する

キーワード

| キーワード | 意味など |

|---|---|

| 畳み込み層 | Convolutional Layer。ε-greedyのε画像や時系列データのように「並び・位置」が重要なデータの特徴を、自動で抜き出すための層 |

| 畳み込み操作 | 画像などのデータに「小さな窓(カーネル)」を滑らせながら、特徴を抽出する処理 |

| カーネル | 畳み込み演算に使われる「小さな重みの行列(フィルタ)」。 画像や前段の特徴マップにスライドしながら適用され、特定のパターン(例:エッジ・色・模様など)に強く反応する。 1つの畳み込み層には複数のカーネルがあり、それぞれが異なる特徴を抽出し、対応する出力の特徴マップを生成する。 |

| 特徴マップ | カーネルによる畳み込み処理の結果得られるマップで、画像内のどこに、どんな特徴があるかを表す。 1つのカーネルから1つの特徴マップが出力され、各マップは異なる特徴(エッジ、色、模様など)に対応している。 CNNの中間層では「活性マップ」「アクティベーションマップ」とも呼ばれる。 |

| フィルタ | カーネルとほぼ同義で使われることが多く、文脈によっては「1つのカーネル(重み行列)」の意味でも、「1つの出力チャネルを構成する一連のカーネル群」の意味でも使われる。 実装や論文によって意味が揺れることに注意。 |

| ストライド | カーネルを入力画像上でどれだけの幅でスライドさせるかを決めるパラメータ。通常は1以上の整数値。 ストライドが大きいほど、特徴マップのサイズが小さくなり(ダウンサンプリング効果)、計算量も減少するが、細かい情報が失われやすくなる。 |

| パディング | 畳み込み演算を行う前に、入力画像(特徴マップ)の周囲を0などの値で埋める処理。 これにより、出力のサイズが小さくなるのを防いだり、画像の端の情報も考慮できるようにすることができる。 最も一般的なのはゼロパディング(0で埋める)で、特に「出力サイズを入力と同じに保ちたい」場合や、「端の特徴を見落としたくない」場合に使われる。 |

| 畳み込みニューラルネットワーク (CNN) | 畳み込み層を中心に構成されたニューラルネットワーク。 主に画像認識で活躍する構造になっている。 畳み込み層+プーリング層+全結合層で構成されるのが一般的。 |

| Dilation Convolution | 拡張畳み込み。 畳み込みカーネルの間にスキップ(空白)を入れて適用範囲を拡大することで、受容野(receptive field)を広げつつ、パラメータ数や計算コストを増やさずに広範囲の情報を捉える手法。 小さな物体を捉えつつ、広い文脈も考慮したい場合(例:セマンティックセグメンテーション、医療画像)に効果的。 |

| Atrous Convolution | Dilation Convolutionの別名。(主にTensorFlow系で使われる呼び方) |

| Depthwise Separable Convolution | 通常の畳み込みを2段階に分けて処理することで、計算量とパラメータ数を大幅に削減できる手法。 1つ目のステップ「Depthwise Convolution」では、各チャンネル(例:RGB)ごとに独立して畳み込みを行い、空間的特徴を抽出する。 2つ目のステップ「Pointwise Convolution(1×1畳み込み)」では、チャンネル方向に対して独立に畳み込みを行う。 この構造により、通常の畳み込みと比べて軽量で高速なモデルを実現できるため、MobileNetなどの小型モデルで多く用いられている。 |

19.正規化層

- 正規化層の基礎的な知識を理解する

- 代表的な正規化手法について理解する

- 正規化層がディープラーニングモデルの学習において、どのような役割を果たすのか説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 正規化(Normalization) | ニューラルネットワークの学習の安定性と収束速度を改善するための処理。 特に深層学習では、層ごとの出力(特徴量)のスケールが大きく異なると学習が不安定になるため、平均0・分散1などのスケーリング処理を行う。 正規化には複数の種類があり、入力の単位や適用タイミングによって分類される。 |

| バッチ正規化(Batch Normalization) | 各層の出力を、同じバッチ内のデータ全体で統計的に正規化(平均0、分散1)する手法。(前処理ではない) 内部共変量シフトを抑制し、初期値や学習率への依存を減らすことで、過学習の抑制効果がある。 ただし、バッチサイズが極端に小さい場合には不安定になることがある。 |

| レイヤー正規化(Layer Normalization) | 各サンプルごとに、層(チャネルや特徴量)全体を対象に正規化する手法。 バッチサイズに依存しないため、RNNなど時系列モデルや、Transformerでよく使用される。 |

| インスタンス正規化(Instance Normalization) | 各サンプル・各チャンネルごとに独立して正規化する手法。 主にスタイル変換(画像の画風変換)で使われる。画像ごとの特徴を際立たせるのに適している。 |

| グループ正規化(Group Normalization) | チャンネルを複数のグループに分けて、グループ単位で正規化を行う手法。 バッチサイズの影響を受けにくく、画像認識での高精度モデルに適する。 バッチ正規化とレイヤー正規化の中間的な位置付け。 |

20.プーリング層

- プーリング層の基礎的な知識を理解する

- 代表的なプーリング操作について理解する

- プーリング層がディープラーニングモデルの学習において、どのような役割を果たすのか説明できる

キーワード

| キーワード | 意味など |

|---|---|

| プーリング層 | 画像などの特徴マップを簡略化(ダウンサンプリング)し、情報を圧縮する層。 最大値(Max Pooling)や平均値(Average Pooling)などを用いて、小さな領域から代表的な値を取り出すことで、重要な特徴を強調しつつ、ノイズを除去しやすくなる。 これにより、「物体が少し位置を変えても正しく認識できる」ような位置の変化に対する不変性(平行移動に強い)」が向上する。 位置の精密な情報を一部失う代わりに、特徴そのものの存在有無を重視する処理である。 例)写真の中の犬と猫の位置が変わっても、写真に犬と猫が写っていることを正しく認識できるようにする。 |

| 最大値プーリング | 小さい範囲(領域)の中で「一番大きな値(=一番強い特徴)」だけを残す方法。 もっとも一般的で、エッジ(輪郭)など、目立つ特徴を強調することができる。 物体検出や、画像認識で使われる。 |

| 平均値プーリング | 小さい範囲(領域)の中で「平均値」を取って縮小する方法。 なめらかな出力になり、ノイズが小さくなる。 特徴が均等に分布している場合に効果的だが、細部の情報は弱まりやすい。 |

| グローバルアベレージプーリング (GAP) | 畳み込みニューラルネットワーク(CNN)の最後の畳み込み層の出力である複数の特徴マップに対して適用されるプーリング手法。 各特徴マップ内のすべての値の平均を計算し、その特徴マップを1つの代表値(スカラ値)に縮約することで、各特徴マップが捉えている特定のパターンや概念の「画像全体における活性度」を示すベクトルが得られる。 このベクトルは、従来のCNNで使われていた全結合層の代わりとして、直接分類層(出力層)に接続することができ、全結合層を削減できるため、モデルのパラメータ数を大幅に削減することにつながり、結果として過学習を抑制する効果も期待できる。 このため、GAPはCNNモデルの最終層(分類層の直前)で非常によく使われる。 |

| 不変性の獲得 | 物体の位置や形が少しズレても、同じように認識できるようになる性質。 プーリングでは、最大値や平均値だけを拾うため、細かい位置の違い・回転・スケールなどに左右されにくくなる。 |

21.スキップ結合

- スキップ結合の概要を理解する

- ディープラーニングにおけるスキップ結合の役割を説明できる

- スキップ結合を活用したResidual Network (ResNet) の概要を理解する

キーワード

| キーワード | 意味など |

|---|---|

| スキップ結合 | ニューラルネットワークで、ある層の出力を“飛び越えて”後ろの層に直接つなげる仕組み。 深いネットワークでは、勾配消失により誤差がうまく伝わらず学習が進まない問題が起こりやすい。 そこでスキップ結合を使うことで、入力の一部をそのまま後方に渡し、勾配の流れを助け、学習を安定化させることができる。 |

| Residual Network (ResNet) | Microsoftが開発した、スキップ結合を活用した深層ネットワーク。 従来の深いネットワークでは、層を増やすと精度が下がる「劣化問題」があったが、ResNetでは「入力そのままを後ろに渡す(恒等写像)」という構造でこれを解決。 これにより、152層のような超深層でも学習が可能となり、精度と学習効率が大きく向上した。 |

22.回帰結合層

- 回帰結合層の概要を理解する

- 回帰結合層を含むネットワークであるRNNを理解する

- RNNがどのような特性のデータに適したモデルか説明できる

- RNNの学習方法について理解する

- RNNの学習における課題とその解決手法を説明できる

キーワード

| キーワード | 意味など |

|---|---|

| 回帰結合層 | 「時系列データ」など、過去の情報を考慮して処理するニューラルネットワークの仕組み。 通常のニューラルネットワーク(CNNなど)は、入力と出力が1対1で独立している。 回帰結合層では出力を次の入力として使用することで、情報を記憶しながら処理ができて、音声・文章などの順序のあるデータに対応可能となる。 |

| リカレントニューラルネットワーク (RNN) | 回帰結合層を持つニューラルネットワークのこと。 前の出力を記憶しながら処理を続けることで、順序のあるデータに対応できる。 入力が時系列であっても、1ステップずつ処理しながら結果を出し、各ステップの処理は同じ重み(パラメータ)を繰り返し使用する。 通常のRNNでは、長期依存(遠い時点の情報を使いたいとき)で勾配が消失しやすく、学習がうまく進まないという問題がある。 そのため、記憶の制御ができるゲート構造(LSTM/GRU)が開発された。 例)A→B→Cという文字列を予測するときに、今がBなら、次はCかも。と予測するモデル |

| エルマンネットワーク(Elman Network) | 1990年代初期の、RNNの原型となったネットワーク。 入力層、隠れ層、出力層で構成されている。 前の隠れ層の出力+今の入力により、出力を出す構造(隠れ層の出力を次の出力に渡している=出力を再帰的に入力に戻している)。 内部状態を重視している。現代のRNN、LSTM、GRUなどの先駆けとなった。 音声認識で使われていた。 |

| ジョルダンネットワーク(Jordan Network) | エルマンネットワークに似ているが、前の出力層の出力を記憶して、次の隠れ層に渡す構造。 見えている出力に依存している。 |

| 時系列データ | 時間の順序が意味を持つデータ(例:株価、天気、音声、文章など) |

| Back Propagation Through Time (BPTT) | 日本語に訳すと「時間方向の誤差逆伝播」。 RNNの学習時に、時間をさかのぼって誤差を伝える手法。 通常のニューラルネットワーク(Feedforward NN)では、層構造の順方向に計算し、逆方向に1層ずつ誤差を伝播させるが、RNNでは時間にも依存関係があるため、「時間軸上で展開(Unroll)」して誤差を逆方向に伝える必要がある。 中間層同士の接続(再帰構造)を考慮することで、過去の情報を保持して現在の出力を決定する仕組みを学習可能。 時系列的な計算依存があるため並列処理が難しく、シーケンシャルに計算する必要がある。 各時刻の状態は、一つ先の時刻の結果にのみ影響を与える(マルコフ性を仮定)、このため誤差も「一つ先の時刻の出力」から逆方向に伝搬していく。 長期依存を学習すると勾配消失・爆発が起こりやすいため、LSTMやGRUなどの改良RNNがよく使われる。 |

| Long Short Term Memory (LSTM) | 長期記憶と短期記憶を3つのゲートでコントロールし、勾配消失を防ぐために設計されたRNNの改良型。 3つのゲート(入力ゲート・忘却ゲート・出力ゲート)とセル状態(cell state)を使って情報を制御し、長期間にわたる依存関係を持つデータの学習に適している。 主に自然言語処理(翻訳、文生成)や音声認識などで活躍。 |

| Gated Recurrent Unit (GRU) | LSTMの簡略版で、2つのゲート(更新ゲート・リセットゲート)のみを使用。 セル状態を持たず、隠れ状態のみで情報を保持・更新するため、LSTMよりも構造がシンプルで学習が高速。 軽量ながらも多くのタスクでLSTMと同等の性能を示す。 |

| 教師強制(Teacher Forcing) | 正解データを次のデータの入力データとして利用しながら予測をする方法で、系列形成(文章生成など)で使われる。 モデルが間違っても「正解データを使って先に進む」ことで、誤差の蓄積を避けてモデルの学習が安定する。 ただし、テスト時(実際の運用時)は正解データがなく、ギャップが起きる問題(露出バイアス)がある。 |

| ゲート機構 | 「情報をどれだけ残すか・忘れるか・出すか」を決めるスイッチのような構造。 記憶を制御することによって、過去の重要な情報だけを残せる。 |

| 双方向 RNN (Bidirectional RNN) | 「過去→未来」だけでなく、「未来→過去」にも処理を行うRNN。 入力データを前方と後方の両方向から同時に処理することができる。 例)英語の翻訳を行う際には、単語の前と単語の後も必要なので、両方とも利用する。 |

| 勾配消失問題 | (解説済のため省略) |

| 勾配爆発問題 | (解説済のため省略) |

23.Attention

- Attention の基礎的な知識を理解する

- Attention がどのような役割を果たすのか説明できる

- RNN の問題点を Attention はどのように解決できるか説明できる

- Attention を用いた代表的モデルのTransformerについて理解する

- Self-AttentionとEncoder-Decoder Attention(Source Target Attention)について理解する

キーワード

| キーワード | 意味など |

|---|---|

| Attention | 注意機構。「入力の中で、どの情報に注目するか」を学習的に決める仕組み。 従来のRNNでは前から順番にしか処理できないため、長期依存が苦手で、計算が遅かった。 そのため、Attentionでは入力全体を一度確認して、予測するのに大事な部分を重みづけすることで、柔軟で高精度な処理が可能になった。 翻訳・応答などで活躍している。 Transformerの元ネタ。 |

| クエリ | 今「何に注目したいか」を表すベクトル(質問) |

| キー | 各単語の「特徴(見出し)」で、注目すべきか判断される指標 |

| バリュー | 実際に取り出す情報(答え)の中身。クエリとキーで計算された重みに応じて、どのバリューをどれくらい使うかを決める |

| Self-Attention | 自己注意機構。 入力分のすべての単語が、ほかのすべての単語に注目する仕組み。 各単語のクエリ・キー・バリューを用いて他の単語との関連度を計算し、それをSoftmaxで正規化する(=重みを決める)。 その重みに基づいて新たな出力を生成する。 各単語が、「文中のどの単語に注目すべき?」を自分で判断するため、全体の意味や構造を一度でとらえることができる。 |

| Multi-Head Attention | 多頭注意機構。 Self-Attentionを「複数の異なる視点(=head)で同時並行して行う。 あるheadは文法的なつながりに注目し、別のheadは意味の類似性に注目する、といったイメージ。 |

| Transformer | 2017年にGoogleが発表した、Attentionのみで構成された革新的なモデル。 従来のRNNやCNNを使用せず、Self-AttentionとFeedForward層を基本要素とし、大きく Encoder(符号化器)とDecoder(復号器)から構成される。 【Encoder】では、入力文をSelf-Attentionで処理し、各単語が他の単語との関係を加味したベクトル表現に変換する。 【Decoder】では、以下3段階で処理が行われる: ① Masked Self-Attention:過去の出力のみを参照して次の単語を予測できるようにする(未来の単語を見ない) ② Source-Target Attention(Encoder-Decoder Attention):エンコーダの出力とデコーダの内部表現を結びつける層。入力文(ソース文)の意味を考慮しながら、出力文(ターゲット文)を生成するために使われる。 ③ FeedForward層で出力を調整。 この構造により、並列計算が可能で、長文や文間の依存関係も高精度に処理できる。 BERT(エンコーダのみ使用)やGPT(デコーダのみ使用)、ChatGPTなど、現在の多くの大規模言語モデルの基盤となっている。 |

| 位置エンコーディング | TransformerはRNNのように単語を順番に一つずつ処理をせず、文中すべての単語を同時に処理できてしまうため、「単語の順番」という時系列的な情報が失われてしまう。 そのため、各単語の位置情報を、特別なベクトル(数値の組)として表現する。 これにより、単語の出現順序の情報を保持しながら処理ができる。 |

| Seq2Seq | エンコーダー・デコーダモデルの一種で、入力された時系列(Sequence)から新しい時系列に変換して出力するモデル。 AutoEncoder(入力を圧縮して復元する構造)をベースに、エンコーダ・デコーダ部分をRNN系(RNN、LSTM、GRUなど)で置き換えたもの。 エンコーダでは入力系列データの情報を圧縮して内部状態(コンテキストベクトルなど)に保持し、デコーダはその情報をもとに出力系列を生成する。 また、エンコーダとデコーダで異なる種類のモデルを使うことも可能。 ただし、系列が長くなると全ての情報を中間ベクトルに詰め込めず情報が失われる課題があり、その解決策の1つとしてAttention機構を導入することで、入力全体から重要な情報を動的に参照できるようになった。 |

24オートエンコーダ

- オートエンコーダの概要を理解する

- ディープラーニングにおけるオートエンコーダの役割を説明できる

- オートエンコーダの代表的な亜種を理解する

キーワード

| キーワード | 意味など |

|---|---|

| オートエンコーダ(Autoencoder) | 日本語では、自己符号化器とも呼ばれる。入力データをいったん圧縮(=エンコード)し、そこから元のデータを復元(=デコード)するニューラルネットワーク。 特徴抽出や次元削減、異常検知などに用いられる。 中間層(ボトルネック)に「データの本質的な特徴」が表れるように学習する。 ラベルなしの教師なし学習の一種で、隠れ層のノード数は、データの次元を削減するために、可視層のノード数よりも少なくする。 例)データを大事なところだけ残して圧縮し、復元することで、大事な特徴を把握する。 |

| 積層オートエンコーダ(Stacked Autoencoder) | 2006年、ヨシュア・ベンジオによって提案された、複数のオートエンコーダを層として積み重ねて学習する手法。 深い構造を持つことで、より抽象的な特徴をとらえることができる。 学習は1層ずつ順番に行い、(層ごとの事前学習) 最後に全体を微調整する。(ファインチューニング) これにより、適切な重みの初期値を得ることができる。 |

| 次元削減 | 高次元データをより少ない次元に圧縮する処理。PCAのような線形手法と異なり、オートエンコーダでは非線形な特徴抽出が可能。 画像・音声などの圧縮や可視化、特徴量選択に使われる。 |

| 事前学習 | 深層学習モデルの初期重みを賢く設定するために、先にオートエンコーダなどで学習させること。 ランダム初期化よりも安定した学習ができる。主に学習データが少ないときや、ラベルがないときに有効。 |

| 変分オートエンコーダ(VAE) | 通常のオートエンコーダに「確率的なゆらぎ(ノイズ)」を加えたモデルで、低次元への圧縮を前提としている。主に以下の2つの部分から構成される。 エンコーダ (Encoder): 入力データ(例:画像)を受け取り、それを低次元の潜在空間と呼ばれる空間にマッピングする。 通常のオートエンコーダでは、この潜在空間のベクトルは固定値として扱われるが、VAEでは、入力データが特定の潜在変数の確率分布からサンプリングされたものであると仮定するため、エンコーダは、この**確率分布のパラメータ(平均と分散)**を出力する。 デコーダ (Decoder): エンコーダによって得られた潜在空間の確率分布からランダムにサンプリングされた潜在変数を受け取り、それを元のデータ形式(例:画像)にデコード(復元)する。デコードの過程を通じて、新しいデータを生成する能力を獲得する。 データ生成や異常検知、画像の変換などに応用される。 補足:損失関数には再構成誤差+KL情報量を含む。 |

| B-VAE(β-VAE) | VAEの変種で、KL情報量に重み(β)をかけて制御するモデル。 潜在変数の意味的な分離(disentanglement)を促し、より解釈しやすい特徴を得ることが目的。生成モデルとしての制御性が高まる。 |

| infoVAE | VAEの拡張で、潜在変数がデータの意味的特徴をより反映するよう工夫されたモデル。 KL情報量の扱い方を調整し、「情報損失を抑えつつ」「多様性も保つ」ことができる。 生成と再構成のバランスを取る設計。 |

| VQ-VAE(Vector Quantized-VAE) | 潜在変数を「離散的な値(コードブック)」に変換することで、生成されるデータに構造を持たせるモデル。 音声合成や画像生成などに応用され、後の大規模モデル(VQ-GANや音声系のWaveNet)に影響を与えた。 |

25.データ拡張

- データ拡張の基礎的な知識を理解する

- 代表的なデータ拡張手法について理解する

- ディープラーニングにおけるデータ拡張の役割を説明できる

- タスクやデータセットに応じて、使用するデータ拡張手法を選択できる

キーワード

| キーワード | 意味など |

|---|---|

| データ拡張 | 少ない学習データを増やすため、元データに様々な変換を加えることで、より汎化性能が高いモデルを目指す手法。 過学習を防いだり、環境変化に強いモデルを作ることができる |

| Random Flip | 画像をランダムに左右や上下に反転。 左右非対称な特徴を持つ画像(例:動物・人など)に有効。 |

| Rotate | 画像そのものをランダムに回転。 文字認識や物体検出で「回転に強いモデル」を作るのに役立つ。 |

| Crop | 画像の一部を切り取って拡大。 中心や周辺をランダムに切り取ることで、位置のずれに強くなる。 |

| Brightness | 画像全体の明るさを一定の割合で増減。 照明条件の違いへの耐性を高める。 |

| Contrast | 画像のコントラスト(明暗差)を調整。 見え方の違いに強くなる。 |

| Random Erasing | 画像分類のデータ拡張手法の一つ。 入力画像の一部をランダムな位置・サイズで矩形に削除し、黒塗り・ランダムノイズ・定数値などで埋める。 局所領域への過剰な依存を防ぎ、ロバスト性や一般化性能の向上が期待される。 長方形でノイズ |

| Cutout | Random Erasingに似ているが、画像の中央やランダム位置に一定サイズの矩形マスク(通常は黒)を挿入する。 Random Erasingとの主な違いは、マスクのサイズやアスペクト比が固定されている点。 CNNが画像の一部だけに依存しすぎるのを防ぐ。 正方形で黒塗り |

| Mixup | 2つの異なる画像とそのラベルを線形に混合する手法。 入力画像とラベルをそれぞれλ倍ずつ加重平均して新たな訓練データを生成。 例:画像 = λ×犬 + (1−λ)×猫,ラベル = λ×[1,0] + (1−λ)×[0,1] これにより、境界領域での曖昧さに強いモデルが育つ。 ランダムな比率で混ぜて、2つの教師ラベルをつかう |

| CutMix | ある画像の一部を矩形で切り取り、他の画像に貼り付けることで画像を合成する手法。 ラベルも切り取った領域の面積比に応じて線形に合成。 Cutoutの「マスク」+Mixupの「ラベル合成」を組み合わせた手法。 視覚的・空間的な整合性を保ちつつ、多様な合成が可能。 画像のランダムな位置+サイズを別の画像でおきかえる |

| noising | 文章データに単語の追加や削除を行う手法。意味がちがうデータや文法が破綻したデータの発生する可能性がある。 |

| Paraphrasing | テキスト(自然言語)の拡張手法。 意味は同じだが言い回しを変えることで、表現のゆれに対応する力を高める(例:「私は行く」→「私は向かう」)。 |

| RandAugment | 多数のデータ拡張手法の中から、ランダムに選び、ランダムな強さで適用する総合的な手法。 手動チューニングが不要で、分類精度が安定しやすい。 |

ディープラーニングの応用例

26.画像認識

- 画像認識タスクの種類とその概要について理解する

- 代表的な画像認識モデルについて理解する

- 画像認識が実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| 物体識別 | 画像が「何の物体か」を分類する(例:犬・猫・自動車)。 画像全体が1つの物体である前提で、犬が何匹いる等は判別しない。 |

| 物体検出 | 画像の中の「複数の物体の位置」と「種類」を特定する(例:画像中に猫2匹と犬1匹を四角で囲む)。 |

| 一般物体認識 | 画像の中にある「何が写っているか」を特定するタスク。 分類問題(画像全体にラベルをつける)とは異なり、「複数の物体を、それぞれの位置とクラスで認識する」ことが求められる。 |

| セマンティックセグメンテーション | 画像の各ピクセルごとに「物体の種類」が何であるかのラベルを割り当てるタスク。(例:背景、道路、人など) 輪郭が細かく分類されるが、同じ種類の物体は個別に認識しない。 zoomなどで人物だけ切り出して背景を変更する技術がこれにあたる。 「人」「犬」「道路」など、物体のクラス情報のみを付与。個別の区別はなし。 背景や構造物の認識、シーン全体の把握に有効。 |

| インスタンスセグメンテーション | 画像の各ピクセルごとに「物体の種類」が何であるかのラベルを割り当てるが、セマンティックセグメンテーションとはちがい、同じ種類の物体も「個別に認識」して、ピクセル単位で分類する。 例:犬Aと犬Bの境界も区別。 物体検出(位置)+セマンティックセグメンテーション(輪郭)の両方の要素を持つ。 複数人の追跡、医療画像での病変領域ごとの識別などに用いられる。 |

| パノプティックセグメンテーション | セマンティック+インスタンスの両方を同時に実現する最も詳細な認識手法。 背景(空、道路、木などのstuff)と、個体ごとの物体(人1、犬2などのthing)をピクセル単位で一括で識別・統合する。 シーン全体の意味理解や、自動運転・ロボティクス分野の高度な解析に使われる。 たとえば、「人1」「人2」「道路」「空」などを1つのマップに正確に重ねて出力可能。 |

| 姿勢推定 | 人や動物の関節点(肩・肘など)の位置を推定し、ポーズを把握するタスク。 スポーツやARで活用される。 |

| AlexNet | 2012年の画像認識ブレイクスルー。 CNNを大規模に用いた最初期のモデルで、畳み込み層とプーリング層を交互に重ねた、シンプルな構成となっている。活性化関数はReLUを使用する。 |

| GoogLeNet | Googleが開発し、2014年のILSVRCで優勝したCNNモデル。 Inception構造(インセプションモジュール)と呼ばれる特殊なモジュールを導入し、異なるサイズの畳み込み(1×1, 3×3, 5×5)や3×3の最大プーリングを並列に行うことで、複数スケールの特徴を同時に抽出することを可能にした。 また、1×1畳み込みによる次元圧縮(計算量削減)の工夫もあり、高精度と効率を両立したモデル構造となっている。 さらに、補助的な損失(Auxiliary Loss)を中間層に導入することで、深いネットワークでの勾配消失問題を緩和し、学習を安定化させる仕組みを採用しており、ネットワークの途中からも分類損失を計算し、誤差を逆伝播させることで、浅い層への学習信号を強化する役割を果たす。 |

| VGG | オックスフォード大学とGoogle DeepMindの共同研究チームによって開発され、2014年のILSVRCで2位の成績を収めたCNNモデル。 特徴は非常にシンプルな構造で、3×3の畳み込み層と2×2のプーリング層を繰り返し積み重ねることで、深いネットワークを構築している点。 ネットワークの深さ(16層または19層)が高い表現力を実現し、多くの後続モデル(ResNetやU-Netなど)にも影響を与えた。 構造が規則的で実装しやすく、転移学習などでもよく使われる。 |

| ResNet | スキップ結合(残差学習)を導入したモデル。 一部の層の出力を次の層に直接足し合わせることができるようになり、勾配消失問題や性能劣化が解決し、超深層ネットワークの学習を可能にした。 |

| Wide ResNet | ResNetの改良版で、ネットワークの深さを増やすのではなく、各残差ブロック内の畳み込み層のチャンネル数(幅)を増やすことで、1層あたりの表現力(フィルタ数)が増え、性能を向上させたモデル。 深いネットワークにありがちな「学習の困難さ(勾配消失・過学習など)」を回避しつつ、パラメータ効率が良く、学習が安定しやすいという特徴がある。 ResNetに比べて計算資源はやや増えるが、学習速度や精度の面で優れている。 |

| DenseNet | 2017年に提案されたCNNモデルで、各層をその前のすべての層と“密に(Dense)”接続するのが特徴。 具体的には、第ℓ層の入力が、それ以前の全ての層の出力の連結(concat)で構成される。 この構造により、特徴の再利用が促進され、パラメータ効率が高まり、勾配消失問題も緩和される。 ResNetと異なり、「加算」ではなく「結合(concat)」で接続されるのが大きな違い。 |

| EfficientNet | モデルサイズと性能(精度)のバランスを最適化した軽量な画像認識モデル。 「コンパウンドスケーリング」という手法により、解像度(画像サイズ)・深さ(層の数)・幅(チャンネル数)の3つの要素を同時に効率よくスケーリングする。 この設計により、少ない計算コストで高い精度を実現している。 MobileNetと同様に、スマートフォンやエッジデバイスなどリソースが限られた環境でも高性能を発揮できるモデルとして注目されている。 |

| MobileNet | 画像認識のための軽量な畳み込みニューラルネットワーク(CNN)。 モバイル端末や組み込み機器でも使えるよう、Depthwise Separable Convolution(深さ方向に分離された畳み込み)を活用しているため、計算量とモデルサイズを大幅に抑え、少ない計算資源でリアルタイムに推論が可能。 例)スマホ上での顔検出,ARアプリ |

| NAS (Neural Architecture Search) | ニューラルネットワークの構造(アーキテクチャ)を自動で設計・最適化する技術。 通常は人手で行っていた層の種類や順序、フィルタサイズなどの設計を、強化学習・進化的アルゴリズム・勾配ベースなどの探索戦略によって自動化する。これにより、モデルの演算レイヤーのつながりを最適化する。 初期のNASでは、RNNによるコントローラーと強化学習を用いてCNNの構造を探索。 EfficientNetやMnasNetなどは、NASを用いて効率と性能のバランスを自動で最適化した代表例である。 |

| MnasNet | Googleが提案したモバイル向けCNNモデルで、「NAS(Neural Architecture Search)」という手法で自動的に設計されたネットワーク。 モデル精度とモバイルフォン上での実行速度を元に、強化学習を行っている。 画像認識タスクだけでなく、物体検出、姿勢推定、セマンティックセグメンテーションなどのタスクでも利用されている。 精度とレイテンシ(処理速度)のバランスを考慮した探索戦略を採用しており、ネットワークの軽量化もおこなっている。 |

| ★NASNet | (シラバス未記載) 2017年にGoogle Brainの研究者(Zoph & Le)によって提案された、ニューラルアーキテクチャ探索(NAS)により自動生成されたCNNモデル。 RNNベースのコントローラーが「セル構造(Normal CellとReduction Cell)」を強化学習で探索し、それを深くスタック(繰り返し積み重ねる)して全体のネットワークを構成する。 CIFAR-10やImageNetで高い性能を示し、手作業による設計を凌駕する設計の可能性を示した。 計算コストが高く、学習に多大なGPU資源を必要とするという課題もある。 |

| SENet(Squeeze-and-Excitation Network) | 2017年に提案された、CNNの各チャンネル(特徴マップ)に対して「重要度(重み)」を学習して強調する、Attention機構を導入したモデル。 従来の畳み込み層の出力に、Squeeze(圧縮)→ Excitation(再重み付け)という処理を加えることで、重要な特徴を強調し、不要な特徴を抑える。 これにより、性能向上を実現しつつ、既存のCNN(ResNetなど)にも容易に組み込めるため、多くのモデルに応用されている。 |

| Vision Transformer | 画像をパッチ(小さなブロック)に分けて単語とみなし、Self-Attentionを用いて画像内の関係性を学習する新アーキテクチャ。 画像内の全体構成と細部を両方とも学習することができ、CNNを使わずに高性能を実現。 |

| Fast R-CNN | 物体検出手法 R-CNN の改良版。 画像全体にCNNを1回だけ適用し、得られた特徴マップ上で ROI(Region of Interest/関心領域)プーリングを行い、各領域を分類・位置補正(バウンディングボックス回帰)する。 特徴抽出が効率化され、高速かつ高精度な処理が可能になった。 |

| Faster R-CNN | Fast R-CNN をさらに改良し、領域提案(Region Proposal)自体もCNNで学習する構造にしたモデル。 RPN(Region Proposal Network)と呼ばれるサブネットワークを導入し、ROI(物体がありそうな領域)の抽出も高速化・自動化された。 提案→分類・回帰までがすべてエンドツーエンドで学習できるようになった。 |

| Mask R-CNN | Faster R-CNN に ピクセル単位のマスク(セグメンテーション)出力を追加したモデル。 各検出された物体に対して、インスタンスごとの領域(マスク)を出力できるため、分類・位置推定に加えて、インスタンスセグメンテーションが可能になる。 ROIプーリングの代わりに ROI Align を導入し、ピクセル精度の向上も図っている。 |

| SSD(Single Shot MultiBox Detector) | 畳み込みニューラルネットワーク(CNN)をベースに、複数のスケールやアスペクト比を持つ特徴マップから、物体の位置(バウンディングボックス)とクラスを一度に予測する手法。 画像を複数のサイズの特徴マップでスキャンし、多様なサイズ・形の物体検出に対応可能。 YOLOより精度が高いことが多く、速度と精度のバランスが良い。 |

| YOLO(You Only Look Once) | 入力画像を固定グリッドに分割し、各グリッドで物体の位置とクラスを一括で予測する高速な物体検出モデル。 1回のCNN処理で予測を完結させるため、非常に高速でリアルタイム処理向き。 ただし、小さな物体や密集した物体の検出にはやや不向きな場合がある。 |

| FPN (Feature Pyramid Network) | 物体検出やセグメンテーションで使われる、マルチスケール特徴抽出のためのネットワーク構造。 特徴ピラミッド(Feature Pyramid)を構築し、複数の解像度の特徴マップを融合することで、大小さまざまなスケールの物体を検出可能にする。 主な仕組みは、①ボトムアップ経路(通常の畳み込みによる特徴抽出)、②トップダウン経路(高レベルの抽象的な情報を下位層へ伝搬)、③横方向接続(スキップ接続で階層間の特徴を結合)。 結果として、高レベルの意味情報と低レベルの空間解像度情報を組み合わせた高品質なマルチスケール表現を生成する。 代表的な適用例:Faster R-CNN + FPN、Mask R-CNNなどで使われ、小さい物体から大きい物体まで安定して検出可能。 さらに、パノプティックセグメンテーションなど高度なタスクでも、FPNをバックボーンとして拡張することで一貫した画素単位の「物体の領域分割」を実現する。 |

| FCN (Fully Convolutional Network) | 画像全体のピクセルごとにクラスラベルを割り当てるセマンティックセグメンテーションモデルの一つ。 従来のCNNの「全結合層(Fully Connected Layer)」を畳み込み層に置き換えることで、入力画像サイズに依存しない構造を実現。 最後の特徴マップをアップサンプリング(逆畳み込み)して元の画像サイズに戻し、ピクセルごとの予測を行う。 |

| U-Net | FCNに「スキップ結合」を追加。 セマンティックセグメンテーションに使われるモデルで、医療画像などでよく使われる。 少量データでも強い。 |

| SegNet | セグメンテーション専用に設計されたモデルで、エンコーダとデコーダが対になっており、ダウンサンプリング時の位置情報を再利用して、きれいに元の画像サイズに復元できる。 |

| PSPNet | シーン全体の文脈情報を捉えるために、ピラミッドプーリングモジュール(PPM)を導入したセマンティックセグメンテーションモデル。 入力画像を異なるスケールでプーリングし、グローバルな文脈とローカルな特徴を統合することで、高精度なピクセル分類を実現。 特に、広い視野でシーン全体の意味(例:空と道路の関係など)を理解できるのが強み。 |

| DeepLab | Googleが開発したセマンティックセグメンテーション用のディープラーニングモデルファミリー。 主な特徴は、解像度を保ったまま広い受容野(広域文脈)を獲得する仕組みと、マルチスケール情報の統合。 ① Atrous Convolution(空洞畳み込み、Dilated Convolution)を使い、解像度を下げずに受容野を拡大し、細部まで文脈を捉える。 ② Atrous Spatial Pyramid Pooling (ASPP)で複数のスケールで並列に畳み込みを行い、異なるサイズの情報を同時に取得。 ③ DeepLabV3+では、エンコーダ・デコーダ構造を導入し、物体の境界線をより滑らかかつ正確に分割可能にした。 応用例:街並み画像で道路・建物・人などをピクセル単位で分類する自動運転、医療画像の臓器セグメンテーションなど。 |

| OpenPose | 人間の関節(骨格)を高精度に検出できるモデル。 複数人の姿勢推定にも対応。ダンスやフィットネス、医療で活用。 |

| ★Part Affinity Fields | (シラバス未記載)OpenPoseなどの2D人体姿勢推定で使われる手法。 人体の各部位(キーポイント)の位置を予測するだけでなく、「関節をつなぐ方向情報(ベクトル場)」も同時に学習する。 各ペアの関節間を結ぶベクトル場(PAF)を用いることで、画像内に複数の人物がいても、どの部位同士が同じ人物に属するかを正確に組み合わせられる。 例:左肩と左肘のキーポイントを正しくペアリングするために、それをつなぐベクトル方向を出力し、個体ごとに一貫した骨格を抽出する。 |

27.自然言語処理

- 自然言語処理タスクの種類とその概要について理解する

- 自然言語処理タスクにおける特徴表現とその手法について理解する

- 代表的な自然言語処理モデルについて理解する

- 自然言語処理が実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| BERT | Bidirectional Encoder Representations from Transformers の略。 Transformer の Encoder部分のみを用いた構造で、双方向の文脈理解が可能なモデル。 事前学習(Pre-training)と、ファインチューニング(再学習)から成る。 事前学習では以下の2つのタスクを同時に解く: ・Masked Language Model(MLM):文中の単語の一部を[MASK]に置き換え、それが何だったかを予測することで、文脈からの単語予測能力を学ぶ。 ・Next Sentence Prediction(NSP):2文が連続した文章か否かを判定し、文と文の関係性を学習する。 上記にて得られた事前学習済みモデルは、多くのNLPタスク(文分類・質問応答・固有表現抽出など)にファインチューニングすることで高精度な性能を発揮する。 |

| BoW (Bag-of-Words) | テキストを単語(形態素)に分割し、各単語の出現回数をカウントして特徴ベクトル化する手法。 文法や単語の順序は無視されるが、テキストの特徴をシンプルに数値化できる。 形態素解析後の単語集合を集計することで作られ、テキスト分類やスパム判定などの基礎的な自然言語処理でよく用いられる。 計算コストが低く、前処理としてTF-IDFや機械学習アルゴリズムと組み合わせて使われることも多い。 |

| word2vec | 単語を「意味が近いもの同士がベクトル的に近くなる」ように学習する(単語を多次元ベクトルに変換する)手法。 CBOWやSkip-gramが代表的な学習アルゴリズム。 周辺の単語から特定の単語の分散表現を得るため、対義語や多義語に弱い。そのためELMoなどの改良モデルが登場した。 |

| fastText | 2016年にFacebook AI Research(FAIR)が開発した、単語をサブワード(部分文字列)に分解して扱う自然言語処理ライブラリ。 word2vecの発展型であり、単語ベクトルの学習や高速なテキスト分類に対応。 サブワード単位の学習により、未知語(例:新語やスペルミス)にも強く、文法的なバリエーションにも対応できる。 モデルは軽量で学習・推論が高速。精度・汎用性の両面でword2vecより優れることもある。 |

| CBOW | Continuous Bag-of-Words。word2vecの一種で、周囲の単語(コンテキスト)から中央の単語を予測する手法。 例えば「I ___ to school」の場合、「I」「to」「school」から中央の単語を予測する。 仕組みとしては、周囲の単語のベクトルを足し合わせて(平均化して)、中央単語を予測する出力層に送る。 学習が高速で、大量のテキストコーパスから語の意味を連続空間上のベクトル(分散表現)として捉えることができる。 多義語の平均的な意味を捉えやすいが、低頻度語の学習はやや弱い。 |

| スキップグラム(skip-gram) | word2vecの一種で、中央の単語から周囲の単語を予測する方式。 例)「I go to school」の「go」を中心単語として「I」「to」「school」を予測する。 仕組みとしては、入力層に分散表現を獲得したい単語の初期ベクトルを渡し、出力層にその周辺に出現する単語群を渡して「ある単語から周辺単語を推測する」タスクを学習。 このとき、中間層の重みが単語の分散表現となる。 CBOWより計算コストは高いが、低頻度語でも周辺文脈を効果的に学習できる特長があり、大量テキストから単語埋め込みを生成する前処理に広く利用される。 |

| CEC(Constant Error Carousel) | LSTM(長短期記憶)セル内部の構造の一部(セルステート)であり、誤差(勾配)を時間的に一定に保つための仕組み。 通常のRNNでは誤差が時間とともに消失(勾配消失)しやすいが、CECによって情報を長期間記憶できるようになる。 具体的には、セル状態が「足し算によって更新」され、重みが1の再帰接続(ループ構造)を持つことで、誤差が一定のまま巡回し、忘れられにくくなる。 |

| ChatGPT | GPT(Generative Pretrained Transformer)を対話用にファインチューニングしたモデル。 質問応答、文章生成、翻訳、コーディングなど幅広く対応可能なLLM(大規模言語モデル)。 |

| ELMo | Embeddings from Language Models の略。 双方向LSTM(BiLSTM)を用いた言語モデルで、単語の意味を前後の文脈に応じて動的に表現できる「文脈化単語表現(contextualized word embeddings)」を実現した。 各単語について、すべてのBiLSTM層の出力を学習可能な重み付きで加算して最終的なベクトルを構成する。 BiLSTMでは、順方向と逆方向のLSTMの出力を結合(concat)して単語ごとの文脈表現を得る。 同じ単語でも文脈により異なるベクトルが得られるのが特徴で、様々なNLPタスクにおいて既存モデルに組み込むことで性能を向上させた。 |

| GLUE | General Language Understanding Evaluation。 自然言語理解のベンチマークタスク集で、モデル性能を統一的に評価する基準。BERTやGPTが比較に使われる。 |

| GPT-n | OpenAIが開発した、文章生成に強いTransformerベースのモデル群。 GPT-2、GPT-3、GPT-4などがあり、次の単語を順に予測する形式で学習されている。 新しくなるごとにパラメータ数が多くなる。1文のすべての単語を逐次的に生成する。 |

| N-gram | 単語や音素などの「連続したN個の要素」をひとかたまりとして特徴にする手法で、テキストや音声の予測モデルに使われる。 2-gramなら「私は」「は学生」など。 語順をある程度保持できる。 |

| PaLM | Pathways Language Model。 Googleが開発した超巨大なLLMで、多言語対応・推論性能・創造性に優れた性能を持つ。 |

| Seq2Seq | Sequence-to-Sequenceモデル。 エンコーダーとデコーダーからなり、文章→別の文章(例:翻訳・要約)への変換を行う。 RNNやAttentionと併用される。 |

| TF-IDF | Term Frequency-Inverse Document Frequency。 その文書内での単語の出現頻度(Term Frequency)と、他の文書含めた全体での希少性(Inverse Document Frequency)から、単語の重要度を評価する手法。他の文書にあまり現れない単語ほど重要とみなす。検索や要約などで活用。 |

| 感情分析 | テキストがポジティブかネガティブかを分類するタスク。 レビューやSNS投稿の分析に利用される。 |

| 機械翻訳 | ある言語を別の言語に自動変換するタスク。 現在はニューラル機械翻訳(NMT)が主流。 |

| 形態素解析 | テキストを意味を持つ最小単位(形態素)に分割する処理。 例えば「私は学生です」を「私 / は / 学生 / です」に分割し、品詞情報も付与する。 日本語など単語の区切りが明示されない言語で特に重要で、検索エンジン、翻訳、要約など多くのNLPタスクで使われる。 |

| 構文解析 | 文法構造を解析し、主語・述語・目的語などの関係を明らかにする処理。 例えば「私はりんごを食べる」で「私→食べる(主語)」「りんご→食べる(目的語)」という依存関係を特定する。 意味理解や機械翻訳、質問応答など高度な自然言語処理に活用される。 |

| 質問応答 | 自然言語の質問に対して、適切な回答を自動で返すタスク。 検索エンジンやチャットボットに活用される。 |

| 情報検索 | ユーザーのクエリに対して、適切な文書やデータを返す処理。TF-IDFやベクトル検索が活用される。 |

| 単語埋め込み | 単語を意味的な関係が反映されたベクトルで表現する手法。word2vecやBERTなどで実現される。 |

| 局所表現 | (シラバス未記載)単語とベクトルを1対1対応で表現する単語埋め込みの手法。ワンホットベクトルが使われる。 |

| 分散表現 | 単語や文書を多次元の連続値ベクトルで表す方法。似た意味の単語は似たベクトルになる。 |

| 文書要約 | 長い文書から重要なポイントを抜き出して短くする技術。検索、ニュース、レポート作成などで活用。 |

| ワンホットベクトル | 単語を、語彙数と同じ長さのベクトルで表し、その単語に対応する1つの次元だけが1、他はすべて0となる単純な表現手法。 語彙間の意味的な距離や類似性は表現できず、大規模語彙(例:10,000語)では疎なベクトルとなり、メモリ・計算コストの面で非効率。 例)りんご、バナナ、りんご、みかん →[1,0,0,0],[0,1,0,0],[1,0,0,0],[0,0,0,1] |

| LLM (大規模言語モデル) | 数十億〜数千億のパラメータを持つ自然言語モデルの総称。 推論・生成・翻訳・要約など多くのタスクで高精度を実現。 例)BERT、GPT、PaLMなど |

| 統計的機械翻訳 | 翻訳前後の対訳データを使って、統計的に最も確からしい訳語を選ぶ手法。 現在はニューラル翻訳に置き換えられている。 |

28.音声処理

- 音声処理タスクの種類とその概要について理解する

- 音声処理タスクにおける特徴表現とその手法について理解する

- 代表的な音声処理モデルについて理解する

- 音声処理が実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| A-D変換 | アナログ信号をデジタル信号に変換する一般的な処理。 マイクで拾った連続的な波形を、コンピュータが扱えるデジタルデータに変える。音声以外にも、画像・映像なども含まれる。 |

| WaveNet | 2016年にDeepMind社が開発した音声合成モデルで、パラメトリックTTS(音声波形とテキストデータをパラメータで記述することでテキストから音声合成を行う手法)をディープニューラルネットワークを用いて行うことで大量の音声データの学習と処理を可能にし、より人間に近い自然な音声生成を実現した。 PixcelCNNという画像生成モデルを用いて波形そのものを生成するため、非常に自然な音声合成が可能。 畳み込みニューラルネットワークが基盤。 |

| 音韻 | 文中の意味のまとまりや発音のタイミングを表す構造的な単位で、話し方に関する概念。 |

| 音声合成 | テキストから人間のような音声を生成するタスクで、Text-to-Speechとも呼ばれる。 ナビ音声やアシスタントで使われる。 |

| 音声認識 | 音声をテキストに変換する処理。 スマートスピーカーや自動字幕などで使われる。 |

| 音素 | 言語を構成する最小の音の単位。音声認識や音声合成で基本となる。 日本語の場合、おはよう →o/h/a/y/o/u |

| 隠れマルコフモデル(HMM) | 音声認識などで使われた時系列モデル。 状態が見えない(隠れ)まま観測データから遷移を予測する。 近年はRNNやTransformerに置き換えられつつある。 |

| 高速フーリエ変換 (FFT) | 信号(時系列データ)を周波数成分に分解する処理。 音の高さや成分を分析するために使われるが、株価・脳波などでも利用可能。 |

| スペクトル包絡 | 音声のスペクトル(周波数成分。音色の特徴のこと)の輪郭。 音の高さではなく、声質や音色の違いを捉える指標。 |

| パルス符号変調(PCM:Pulse Code Modulation) | アナログ信号(例:音声、連続値)を一定間隔でサンプリングし、その値を量子化(数値化)・符号化(ビット列に変換)することで、デジタル信号に変換(例:テキスト、離散値)する方式。 主にCD音質(例:44.1kHz、16bit)などの高音質オーディオ記録で用いられる。 非圧縮型の方式であり、音質劣化がなく高精度。 構成は主に以下の3ステップ: ① サンプリング(一定間隔で信号を測定) ② 量子化(測定値を離散的な数値に丸める) ③ 符号化(その数値を2進数に変換) 圧縮を行うMP3などとは異なり、元の音に忠実なデジタル表現を目的とする。 |

| フォルマント | 母音の識別などに関係する音声の共鳴周波数。 人間の声の「個性」を表す成分。 |

| フォルマント周波数 | 母音などで生じる音の共振周波数成分を指す。 フォルマントは音色にかかわる情報で、声の高さや性質に関係し、話者識別にも利用される。 |

| メル周波数ケプストラム係数 (MFCC) | 音声信号を人間の聴覚特性(メルスケール)に近づける非線形変換を行って、特徴量として抽出する方法。 音声認識で最もよく使われ、機械学習や深層学習の音声入力として非常に広く使用されている。 |

| メル尺度 | 実際の周波数を、人間の聞き取りやすさに基づいて非線形に変換した尺度。 MFCCの計算で使用。 |

| 話者識別 | 音声から、声の周波数分布や話し方のくせなどを捉えることで、「誰が話しているか」を識別するタスク。 本人確認やセキュリティ用途に活用。 |

| CTC | Connectionist Temporal Classification(コネクショニスト時系列分析)と呼ばれる。 RNNやLSTMなどの出力で、入力と出力の系列長が違う時に「空白文字」を用いることで、うまく処理できるようにするアルゴリズム。 時系列の入力とラベルを整合させるための損失関数としても機能する。 音声や手書き文字の認識で使われる。 ニューラルネットワークの出力から最終的なシーケンス(文字や単語の並び)を生成するためのルールや、その学習のための損失関数(評価指標)の枠組みであるため、それ自体が End-to-End モデルの名称や特定の出力形式そのものではない。 例)AIモデルが音声を聞いて「あ、あ、り、い、が、と、う、う」のように出力したとき、CTCは空白文字や重複した文字をうまく処理し、最終的に「ありがとう」と正しいテキストに変換する |

29. 深層強化学習

- 代表的な強化学習モデルについて理解する

- 強化学習が実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| A3C | Asynchronous Advantage Actor-Critic。 複数のエージェントが並列に学習し定期的に共有ネットワークと同期、効率よく行動方策を更新する手法。 学習の安定性/探索の多様性/学習速度 の向上を目的としたアルゴリズム。 |

| Agent57 | DeepMindが2020年に発表した強化学習モデルで、Atari 57ゲーム全てにおいて人間の平均スコアを超えた初のエージェント。 様々な種類のゲームに対応するため、DQN系のアーキテクチャをベースに、複数の探索戦略(ε-greedy、RNDなど)やメモリ、複数のポリシーの重み付けなどを組み合わせている。 特に、報酬の少ないゲームや長期的な戦略が必要なゲームにも対応可能な設計が評価された。 Atariゲームの中でも特に難しい「Montezuma’s Revenge」や「Pitfall!」などでも高スコアを記録。 |

| APE-X | 複数のエージェントが分散して学習を進める強化学習手法。 DQNを拡張し、効率よく経験を蓄積できる。 |

| DQN (Deep Q-Network) | 2013年にDeepMindが発表し、2015年にNature論文として掲載された、Q学習にディープニューラルネットワークを組み合わせた強化学習手法。 Atari 2600ゲーム群で人間を超える性能を達成し、強化学習研究に大きな影響を与えた。 大規模・高次元な状態空間でもQ関数の近似が可能になったが、離散的な行動空間を扱うため、連続的な行動空間には適さない。 また、Q値の推定にノイズがあると、最大値を取る際に偶然大きく出た値を選んでしまいQ値を過大評価(overestimation bias)する問題がある。これを解決する手法としてDouble DQNなどが提案されている。 |

| ★状態空間 | (シラバス未記載)エージェントが今どんな状況にいるかを表す情報の範囲。 例)迷路なら自分のいる位置 |

| ★行動空間 | (シラバス未記載)エージェントが今どんな行動をとれるかの選択肢。 例)迷路なら、「前に進む」・「止まる」など。 |

| OpenAI Five | Dota2というチームベースのMOBAゲームで、2018年〜2019年に OpenAI によって開発・発表されたAI。 2019年に世界トップクラスの人間チーム「OG」に勝利し、大きな話題になった。 使用手法は、PPO(Proximal Policy Optimization)という強化学習アルゴリズムで、大規模な分散環境で実行(1日あたり数万試合分のプレイを高速学習)した。 探索と安定性を両立したアルゴリズムにより、5体のAIが同時に協調して戦う「チーム戦略」を学習した。 |

| PPO | Proximal Policy Optimization。 方策の大きな変化を防ぐことで、安定性と性能のバランスが取れた強化学習手法。 Actor-Critic系の中で特に人気。 |

| Rainbow | 2017年に発表された、複数のDQN改良手法(Double DQN, Prioritized Replay, Duelingなど)を統合した最強版DQN。 |

| RLHF | Reinforcement Learning with Human Feedback。 人間のフィードバックを報酬として活用し、モデルを「人間らしい出力」へ誘導する手法。 ChatGPT など大規模言語モデルの仕上げ学習に採用される。 代表的なワークフロー(例:OpenAI GPT 系): ① 教師あり微調整 (SFT) ─ 高品質な人間回答でモデルを初期微調整する。 ② 比較データ収集 ─ 同じプロンプトに対しモデルが出した複数回答を人間が順位付け。 ③ 報酬モデル学習 ─ ②の順位情報を使って「より好ましい回答に高いスコア」を与える報酬モデルを訓練。 ④ 強化学習 (PPO など) ─ ③の報酬モデルを用いてポリシーを強化学習で最適化。 ⑤ 反復改善 ─ 新しい回答を人間が再評価→報酬モデルを更新→ポリシーを再学習、を繰り返し品質を向上させる。 |

| sim2real | シミュレーション(sim)で学習したモデルを、現実の環境(real)でもうまく動作させる手法や課題設定。 |

| アルファスター (AlphaStar) | 2019年にDeepMindが発表した、StarCraftIIでプロプレイヤーを打ち負かした AI。 観察が部分的で行動の自由度も高い RTS(リアルタイム戦略)ゲームにおいて、戦略・マイクロ操作・長期的計画立案を含む難易度の高い環境を攻略。 使用手法は、強化学習(Actor-Critic法)+模倣学習(プロプレイヤーのデータ)+自己対戦による自己強化(self-play)を組み合わせている。 Transformerベースのネットワーク構造を採用し、ユニット間の関係性を学習している。 |

| オフライン強化学習 | すでに蓄積されたデータ(事前に収集されたデータセット)から学習する強化学習。 現実の実験が難しい場面(医療、自動運転、ロボットの学習)で有効。 |

| 残差強化学習 | 既存の方策(ルールベース・古いAIモデル・人の制御則など)をベースに、その上に新たな補正(=残差)を学習して加えることで、全体の性能を向上させる手法。 「ゼロから最適な行動を学習する」のではなく、「すでにある方策+αを学ぶ」ため、学習効率が良く、初期の安定性も高い。 たとえばロボット制御では、すでに使われているPID制御のようなルールベースの方策をベースとして、それを微調整する残差(小さな追加操作)をニューラルネットワークで学習させることで、より賢く動けるようになる。 |

| 状態表現学習 | 観測データ(画像や音声など)から、強化学習に適した状態ベクトルを自動的に抽出する方法。 |

| ダブルDQN | Q学習で起こりやすい「行動価値の過大評価」問題を防ぐため、行動選択と価値評価を別々のネットワークで行うDQNの改良版。 具体的には、ターゲットQ値を計算する際に、行動選択をオンラインネットワーク、価値評価をターゲットネットワークで分けることで、バイアスを抑える。 |

| デュエリングネットワーク | Q関数を「状態価値(V(s))」と「行動ごとの優位性(Advantage A(s,a))」に分解して学習する手法。 Q(s,a) = V(s) + A(s,a) の形で表現し、行動の選択肢が少ない状態でも状態の価値を効率的に学習できる。 |

| ドメインランダマイゼーション | シミュレーションと現実の差を埋めるため、学習時にシミュレーターの設定をランダムに変えて学習する方法。 現実世界を完全に模倣できない場合に、訓練データを多様化することで対応する考え方。 シミュレーション上で収集されたデータを用いて学習すると、現実世界とのギャップ(現実の側面を再現しきれない)により、過学習が起きるため、環境パラメータをランダムに変更させることにより、多様な環境で性能が発揮できる。 |

| ノイジーネットワーク | ニューラルネットワーク内にパラメトリックな「ノイズ」を注入し、重みをランダムに揺らすことで、探索と活用(exploration vs. exploitation)のバランスを改善する手法。 ε-greedyなど外部的な探索パラメータを使わず、学習の過程でノイズを最適化する。 |

| 報酬成形 | 学習を促進するために、本来の報酬に人工的な報酬を加える、または報酬を変換する手法。 例:中間ゴールを達成したら小報酬を与えるなど、エージェントが効率よく望ましい行動を学習するよう設計する。 設計次第で学習の安定性や速度が大きく変わる。 |

| マルチエージェント強化学習 | 複数のエージェントが同じ環境で同時に学習・相互作用する強化学習の枠組み。 協力型(協調して目標を達成)や競争型(相手を打ち負かす)など多様な設定が可能。 例:自動運転車同士の交差点通過、チームスポーツ戦略、経済エージェントの交渉など。 |

| 連続値制御 | ロボットの動作や車のハンドル操作など、離散でなく連続的な行動を扱う強化学習タスク。 |

30.データ生成

- データ生成タスクの種類とその概要について理解する

- 代表的なデータ生成モデルについて理解する

- データ生成モデルが実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| 敵対的生成ネットワーク (GAN) | Generative Adversarial Network。 Generator(ジェネレータ、生成器)とDiscriminator(ディスクリミネータ、識別器)の2つのニューラルネットワークが対立的に競い合うことで、リアルなデータを生成する仕組み。 ジェネレータは、通常「ランダムノイズ(潜在変数)」を入力として受け取り、それを「本物そっくりのデータ」に変換するように学習する。(「ノイズ→画像」などの変換関数を学習する) ディスクリミネータは、ジェネレータが作った「偽物データ」と、本物のデータを区別する二値分類器。 本物・偽物を見分ける能力を高めることで、ジェネレータに「よりリアルなデータを生成するよう」プレッシャーをかける。 この対戦ゲーム(ミニマックスゲーム)を繰り返すことで、ジェネレータは現実データと区別がつかない高品質なデータを生成できるようになる。 応用例:顔画像生成、画像補完、スタイル変換、画像超解像など。 |

| DCGAN | Deep Convolutional GAN。 2015年に発表された、畳み込みニューラルネットワーク(CNN)を用いた基本的なGANモデル。 従来のGANに比べて画像生成の安定性が向上し、高解像度でリアルな画像を生成可能となった。 GeneratorとDiscriminatorの両方にCNNを用いる点が特徴。 |

| Diffusion Model | 画像にノイズを段階的に加えていき、ノイズを取り除くプロセスから画像を徐々に生成するモデル。 高画質な生成で近年注目されており、画像生成AIなどで利用される。 例)Stable Diffusion |

| NeRF | Neural Radiance Fields。 画像から3D空間を再構築する手法。 3D復元やメタバース分野などで活用。 |

| Pix2Pix | 画像から画像への変換(Image-to-Image Translation)を行う、条件付きGAN(Conditional GAN、cGAN)ベースの手法。 入力画像と対応する出力画像のペア(例:線画とカラー画像、地図と航空写真など)を使って、変換を学習する教師あり学習。 Generator(G)はU-Net構造を用い、入力画像をエンコード・デコードしつつスキップ接続を活用することで、高解像度かつ局所的な詳細を保つ変換を実現する。 Discriminator(D)はPatchGANを使用し、全体画像ではなく小さなパッチごとに本物・偽物を識別することで、局所的なテクスチャのリアリティを向上させる。 損失関数は、対敵損失(GAN Loss)に加えてL1損失を組み合わせることで、結果画像のリアリズムとピクセルレベルの忠実度を同時に確保。 応用例:白黒写真の自動色付け、エッジ→写真変換、衛星画像→地図変換など。 |

| CycleGAN | Pix2Pixとは違い、ラベル付きペアデータなしでも画像変換が可能なGANで、教師なしの画像変換モデル。 学習結果を利用することで、双方向の画像変換が可能。(循環一貫性と呼ぶこともある) 例:ウマの写真→シマウマの写真に変換もできるし、シマウマの写真→ウマの写真に変換もできる。 |

| ★StackGAN | (シラバス未記載)2016年に提案(発表は2017年)された、テキストから画像を生成する2段階構成のGAN。 Stage-Iでは粗い低解像度画像を生成し、Stage-IIでより詳細な高解像度画像へと補完する。 例:「A cat is walking」と入力すれば、歩く猫の画像を生成するよう学習できる。 |

| ★StyleGAN | (シラバス未記載)2018年にNVIDIAが発表した、高品質な画像生成を実現するGAN。 特徴ベクトルからスタイル(色、模様、顔の形状など)を段階的にコントロールできる。 潜在ベクトルを中間層で操作することで、細部から大局的な特徴まで編集が可能となった。 顔画像生成や画像合成の分野で広く活用されている。 |

| 音声生成 | テキストなどから音声を生成する技術で、Text-to-Speechとも呼ばれる。 AIナレーションなどに利用。 |

| 画像生成 | 条件やノイズから新しい画像を生成するタスク。 広告やゲーム、創作支援などで応用。 |

| 文章生成 | 入力に基づき、自然な文章を自動生成するタスク。 AIライティングやチャットボットに活用。 |

31.転移学習とファインチューニング

- 転移学習とファインチューニングの基礎的な知識を理解する

- どのような場面やタスクにおいて、転移学習・ファインチューニングが効果を発揮するのか理解する

- 転移学習・ファインチューニングによって、様々なタスクにおいて大幅な精度向上を果たした代表的なモデルについて理解する

キーワード

| キーワード | 意味など |

|---|---|

| 転移学習 | ある問題を解くために学習した知識やモデルを、他の問題を解くために転用(再利用)する考え方。 例)フランス料理のベテランシェフが、イタリア料理店に転職。経験が役立つ。 |

| ファインチューニング | 転移学習の具体的な手法の一つで、再学習とも呼ばれる。 事前学習済みモデルのパラメータを活用しながら、部分的に重みを更新し再学習を行うことで適応する、教師あり学習。 特徴抽出層(畳み込み層)を固定し、出力層だけを学習(微調整)する方法がよく使われる。 例)ImageNetで事前学習されたResNetを使い、医療画像や衛星画像などの異なるタスクに適用する。 |

| Few-shot | 少数の例(数件)で新しいタスクを学習する手法。 |

| One-shot | 1つの例だけで新しいタスクをこなす手法。 人間のような柔軟な適応ができるモデルを目指す。 |

| 自己教師あり学習 | ラベルなしデータで特徴を学習する方法。 事前学習で多く活用される。 |

| 事前学習 | 大規模なデータで汎用的な知識を先に学習するステップ。 BERTなどはその例。 |

| 事前学習済みモデル | 既に大規模データで学習されており、そのまま別タスクへ転用できるモデル。 |

| 破壊的忘却 | 転移学習中に、以前の知識が上書きされて忘れてしまう現象。 連続学習では問題になる。 |

| 半教師あり学習 | ラベルありデータとラベルなしデータを組み合わせて学習する方法。 ラベルコスト削減に有効。 |

32.マルチモーダルタスク

- マルチモーダルタスクの種類とその概要について理解する

- 代表的なマルチモーダルモデルについて理解する

- マルチモーダルモデルが実世界において、どのように活用されているか理解する

キーワード

| キーワード | 意味など |

|---|---|

| ★マルチモーダルAI | (シラバス未記載) 異なる種類の情報(=モーダル)を同時に処理・理解するAI。 GPUなど並列処理とは関係がない。 例)①画像+テキスト②音声+映像 |

| CLIP | OpenAIが開発したマルチモーダルモデルで、画像とテキストの意味的な埋め込みを同じベクトル空間にマッピングすることで、画像に最も関連のあるテキストを検索したり、ラベルがない状態での分類(zero-shot分類)を可能にする。 補足:テキストと画像の間のコサイン類似度を計算することで画像データを分類している。 また、CLIPは主に画像とテキストの関係性を捉えることで分類や検索ができるモデルで、画像やテキストを生成する際は、他のモデルと組み合わせて使われる。 |

| DALL-E | テキストを元に画像を生成するモデル。 抽象的な表現も画像化可能。 |

| Flamingo | 少数の例だけでマルチモーダルなタスク(画像+テキスト)をこなせるモデル。 |

| Image Captioning | 画像の内容をテキストで説明するタスク。 例:写真→「子どもが遊んでいる」。 |

| Text-To-Image | 入力されたテキストに基づいて画像を生成するタスク。 創作やプロトタイプ生成に活用。 |

| Visual Question Answering | 画像を見て、それに関する質問に答えるAI。 例:「この画像には何が写っている?」→「犬」。 |

| Unified-IO | 画像・テキスト・音声などをまとめて処理できる統合マルチモーダルモデル。 |

| zero-shot | 学習していないタスクでも、事前知識を活かして推論できる能力。 例:未知の言語にも対応。 |

| 基盤モデル | 多用途に対応可能な大規模汎用モデル。 LLMやCLIPなど、多様なタスクに応用可能。 |

| マルチタスク学習 | 1つのモデルで複数のタスクを同時に学習し、各タスクの性能を向上させる学習手法。 知識の共有が鍵。 |

33.モデルの解釈性

- モデルの解釈性が必要な背景について理解する

- 解釈性が必要なユースケースについて理解する

- 解釈性の向上に寄与する代表的な手法について理解する

キーワード

| キーワード | 意味など |

|---|---|

| CAM (Class Activation Mapping) | 2015年に提案された、画像分類モデルがどの領域に注目して分類を行ったかを可視化するために、出力層の重みと特徴マップの積を足し合わせる手法。 グローバル平均プーリング(GAP)層と全結合層を前提とするため、特定の構造を持つCNNモデル(例:GoogLeNetなど)にしか使えない。 |

| Grad-CAM (Gradient-weighted CAM) | CAMの制約を解消した拡張版。勾配情報を用いて、任意のCNNベースのモデルでも、分類に寄与した領域をヒートマップで可視化できる。 GAP層がなくても対応でき、画像分類・物体検出・キャプション生成など様々なタスクで活用される。 |

| Guided Grad-CAM | Grad-CAMのヒートマップ(注目領域)と、Guided Backpropagationの高解像度な勾配情報を掛け合わせて、モデルがどのピクセル特徴に強く反応しているかを可視化する手法。 Grad-CAMの「どこに注目しているか」と、Guided Backpropの「どの特徴が強く反応したか」を融合することで、より鮮明なピクセル単位の可視化が可能となる。ヒートマップは内部で使用される。 |

| LIME | Local Interpretable Model-agnostic Explanations。 どんなモデルにも使える「局所的な説明手法」。 対象のサンプル周辺をランダムにノイズで生成し、その入力と予測結果の関係を線形モデルで近似することで、「この予測を支えた特徴量の重み」を解釈可能にする。 ポイントは「局所的に単純な線形モデルを当てはめる」ことで、ブラックボックスモデルの予測理由を人間に理解しやすくする。 |

| Permutation Importance | (シラバス未記載)特徴量の値をシャッフルし、モデル全体の性能(精度)がどれだけ悪化するかを評価することで、その特徴量の重要度を測る手法。 直感的で実装が簡単、特に表データ分析でよく使われる。 モデルに依存しない(モデル非依存型)なので、ランダムフォレストやXGBoostなど様々なモデルに適用可能。 |

| SHAP | SHapley Additive exPlanations。 ゲーム理論の「シャープレイ値」に基づき、各特徴量が予測にどれだけ貢献したかを厳密かつ公平に定量化する手法。 特徴量を一つずつ加える順序をすべての組み合わせで考え、「その特徴量が加わったときに予測値がどれだけ変化するか」を計算し、全順序の平均を取って貢献度を求める。 このため、理論的な一貫性と公平性が保証されるが、計算コストが高い。 特徴量ごとの貢献度を可視化しやすく、モデルの解釈性を高める用途で広く使われる。 |

| 説明可能AI(XAI) | Explainable AI。 2017年にアメリカの国防高等研究計画局(DARPA)がAIの説明可能性に関する研究プロジェクトを発表したころから使われ始めた言葉。 AIの判断理由や根拠を人間が理解できるようにする取り組み全般を指しており、医療や金融など、透明性(AIの予測/判断の根拠が明確なこと)が求められる場面で重要。 |

34.モデルの軽量化

- モデルの軽量化が必要な背景について理解する

- モデルの軽量化が必要なユースケースについて理解する

- 代表的なモデル軽量化手法について理解する

キーワード

| キーワード | 意味など |

|---|---|

| エッジ AI | ネットワークではなく、端末(スマホやセンサーなど)側でAI処理を行う技術。 小型・軽量なモデルが必要。 |

| 蒸留 | 知識蒸留(Knowledge Distillation)とも呼ばれ、 大きなモデル(教師)から小さなモデル(生徒)へ知識を引き継ぎ、精度を保ちながら軽量化する技術。 教師ラベルをhard target、大きいモデルの出力をsoft targetと呼び、どちらにも推論結果が近づくように学習を行うが、必ずしも精度があがるわけではない。 |

| 宝くじ仮説 | 学習初期のランダムな重みの中に「当たりくじ(良い初期値)」が含まれていて、それだけで高性能になるという仮説。モデル圧縮にも応用。 元のネットワークからパラメータを除いた小さなサブネットワークが、同様の精度になる可能性があるとされている。 |

| プルーニング | 重要でない重みやノードを削除して、モデルを軽くする手法。剪定とも言う。 計算量やメモリを削減。 学習データではなく、ネットワーク内部の不要な構造を削る。 |

| モデル圧縮 | パラメータの削減・変換・構造最適化などによって、モデルの容量や計算負荷を小さくし、推論速度を改善する手法。 |

| 量子化 | 重みや入力データの精度(例:64bit → 32bit)を落として、計算を軽くする技術。 性能を落とさずに省電力化ができるが、丸め込み誤差により精度が変動する可能性がある。 |

AIの社会実装に向けて

35.AIプロジェクトの進め方

- AIプロジェクトをどのように進めるか、全体像と各フェーズで注意すべき点などを理解する

- AIプロジェクトを進めるにあたって、考えるべき論点や基本となる概念、国内外の議論、並びに事例を理解する

- サービスやプロダクトとしてAIシステムを世に出す局面で注意すべきことを理解する

- AIの運用に必要となるモデルのヘルスモニタリングやライフサイクル管理等を理解する

- AIの運用にあたって、どのようなことが必要か理解する

キーワード

| キーワード | 意味など |

|---|---|

| AIのビジネス活用 | AIを単なる技術としてでなく、「課題解決の手段」として、ビジネス上の目的(業務効率化・売上向上など)に活かすこと。 導入の前に、何を解決したいのかを明確にすることが重要。 |

| AIプロジェクトの進め方 | ビジネス課題の把握 → データ収集 → モデル開発 → 評価 → 実運用といった流れで進める。 技術だけでなく、関係者との調整や課題設定の重要性も問われる。 |

| BPR | Business Process Re-engineering。 業務の流れ(プロセス)自体を抜本的に見直して改善する手法。 AI導入時に、単に今の業務を自動化するのではなく、プロセス全体を再設計する場面で使われる。 |

| CRISP-DM | データ分析プロジェクトの進め方の標準的なフレームワーク。 ①業務理解→②データ理解→③データ準備→④モデル構築→⑤評価→⑥展開、の6ステップで構成される。 |

| CRISP-ML | CRISP-DMを、機械学習(ML)向けに拡張したフレームワーク。 AIモデルの開発から運用、改善までを一貫して管理する考え方。 |

| Docker | アプリやシステムを「コンテナ」と呼ばれる仮想環境で実行する技術 。AIモデルを、どんな環境でも同じように動かせるようにするために使われる。 |

| Jupyter Notebook | Pythonコードを、画像・説明・グラフ・実行結果つきで記録・共有できるツール。 AIやデータ分析で、実験や報告書作成に広く利用される。 |

| MLOps | Machine Learning + Operations。 AIモデルを安定して運用・管理するための考え方や技術。 モデルの更新、性能監視、再学習などを自動化する。 |

| PoC | Proof of Concept(概念実証)。 本格導入の前に、「AIで本当に実現できるのか?」を小規模に検証する取り組み。 |

| Python | 機械学習やAIで最もよく使われているプログラミング言語。 豊富なライブラリ(scikit-learn, TensorFlowなど)を持つ。 |

| Web API | AIを他のシステムと連携させるためのインターフェース。 Web上でモデルを呼び出して使えるようにする仕組み。 |

| アジャイル | 小さな単位で素早く開発→改善を繰り返す手法。 AIプロジェクトのように要件が変化しやすい現場で向いている。 |

| ウォーターフォール | 要件定義→設計→実装→テスト→運用のように、一方向に進む開発手法。 変化への対応がしにくいため、AIプロジェクトには不向きなこともある。 |

| オープン・イノベーション | 自社の枠を超え、外部の技術や知見(大学・他社など)を取り入れてイノベーションを進める考え方。 AI開発では特に重要。 |

| クラウド | ネットワーク経由でサーバやAI開発環境を使える仕組み。 自社に設備がなくても、AI開発・実行が可能になる。 |

| 産学連携 | 企業と大学・研究機関が共同で研究開発を進めること。 AIの先端研究や人材育成、PoCに活かされる。 |

| ステークホルダーのニーズ | AIプロジェクトに関わるすべての関係者(経営層・現場・顧客など)が何を求めているか。 モデル精度だけでなく、使いやすさや説明性などの視点も重要。 |

| データサイエンティスト | データを分析し、課題解決につなげる職種。 AIプロジェクトの設計・評価・分析を担う中心人物。 |

| 他企業や他業種との連携 | AI導入は一社だけでは難しいことも多いため、他社や異業種との協業で強みを補い合う取り組み。 データ連携や共同研究の例もある。 |

36.データの収集・加工・分析・学習

- AIの学習対象となるデータを取得・利用するときに注意すべきことを理解する

- 集めたデータを加工・分析・学習させるときの注意点を理解する

- データを共有しながら共同開発を進める場合の留意点を理解する

キーワード

| キーワード | 意味など |

|---|---|

| アノテーション | データに対して「これは猫」「これはポジティブな感情」などのラベル付けをすること。 教師あり学習では必須の作業で、手作業で行うことも多い。 |

| オープンデータセット | 誰でも自由に使えるよう公開されたデータセット。 AIの学習や評価に活用される。 商用利用については制限が設けられている場合があるため、ライセンスに注意を払う必要がある。 例)画像認識ではCIFAR-10、自然言語ではWikipediaコーパスなど。 |

| コーパス | 自然言語処理で使われる大量のテキストデータの集まり。 翻訳、要約、分類などの学習に使われる。例)新聞記事のコーパスなど。 |

| データリーケージ(Data Leakage) | 学習時に本来知り得ない情報が、学習データや特徴量設計に混入し、それがテストデータや本番環境にも影響を与えてしまうことで、実際よりも高い性能が出てしまう問題。 たとえば、目的変数に直結する情報が特徴量に含まれている場合などが典型例。 本来の汎化性能を正しく測れず、モデルの実運用時に大きく精度が低下するリスクがあるため、特徴量設計や前処理の段階で特に注意が必要。 |

AIに必要な数理・統計知識

37.AI に必要な数理・統計知識

- 最適化に必要な数学基礎知識や微分を理解する

- 機械学習で必要となる統計学基礎を理解する

- 基本的な統計情報を計算できる

キーワード

| キーワード | 意味など |

|---|---|

| 移動平均 | 時系列データの「変動をなめらかにする」ための手法。 例えば株価のように日々変動するデータを平均して、全体のトレンドを見る。 |

| 確率分布 | データが「どの値をどれくらいの確率でとるか」を示すもの。 代表的なものに正規分布やベルヌーイ分布がある。 |

| 確率変数 | 試行のたびに結果が変わるような変数のことで、例えばサイコロの出目など。 確率分布はこの変数に基づいて定まる。 |

| 確率密度 | 連続的な値をとる確率変数において、ある範囲の値が出る確率の濃さを示す。 面積で確率を表す。 |

| 疑似相関 | 実は直接の関係がないのに、偶然に相関して見えること。 共通の別要因がある場合などに起きる。 |

| 期待値 | 平均的にどれくらいの値が得られるか、という「理論的な平均値」。 確率と値の積を合計して求める。 求め方としては、期待値=(結果1の値×結果1の確率)+(結果2の値×結果2の確率)+… |

| 帰無仮説 | 「差がない」「効果がない」という前提の仮説。 統計的検定では、まずこの仮説を否定(棄却)できるかどうかを調べる。 |

| 共分散 | 2つの変数が「一緒に増えるか減るか」を見る指標。 正の値なら一緒に増減しやすい、負なら逆に動く。 |

| コサイン類似度 | ベクトル同士の向きをもとに、どれだけ似ているかを測る指標。 自然言語処理や推薦システムでよく使われる |

| 最小二乗法 | 誤差の二乗の合計を最小にすることで、データに最も合う直線などを求める手法。 回帰分析の基本。 |

| 最頻値 | データの中で最もよく出現する値。モードとも呼ばれる。 |

| 最尤法 | モデルが観測データを最もよく説明するようなパラメータを求める手法。多くの機械学習モデルで使われる。 |

| 条件付き確率 | 「ある条件が分かっているときに、そのうえで起こる確率」のこと。 事象が独立かどうかに関係なく定義可能。例)雨の日に傘を持っている確率。 |

| 正規分布 | 鐘の形をしたよくある分布。平均の周りにデータが集まっている。 多くの自然現象で見られる。 |

| 相関係数 | -1から1の間の値で、2つの変数の相関の強さを表す。 1に近いと強い正の相関、-1に近いと強い負の相関。 直線的な関係性の強さを示すが、因果関係は示さない。 |

| 相互情報量 | 「特徴量が目的変数にどれだけ情報を与えているか」を測る指標。 特徴量によって目的変数の“わからなさ(不確実性)”がどれくらい減ったかを表している。 非線形な関係もとらえることができ、分類や特徴選択で使われる。 |

| 対立仮説 | 帰無仮説に対して、「効果がある・差がある」と主張する仮説。 検定の目的はこの仮説を支持できるかを調べること。 |

| 中央値 | データを小さい順に並べたときの真ん中の値。 外れ値の影響を受けにくい。 |

| 度数分布 | データの各範囲にどれだけの件数(度数)があるかを表す分布。 ヒストグラムなどで可視化される。 |

| 二項分布 | 「成功・失敗」のような2択の試行を何回か繰り返したときの成功回数の分布。 例)コイントス10回で表が出る回数。 |

| 外れ値 | 明らかに他と異なる極端な値。 分析結果に大きく影響するため、注意が必要。 |

| 標準偏差 | データが平均からどれくらい散らばっているかを表す指標で、偏差値に使われている。 値が大きいほどばらつきが大きい。分散の平方根であり、データの散らばり具合をもとの単位で示す。 |

| 平均 | すべての値の合計を件数で割った値。 一般的な「平均」としてよく使われる。 |

| 分散 | 標準偏差の2乗(データと平均の差の2乗の平均)。 データのばらつきを数式で表すときに使われる。 |

| 偏相関係数 | 他の変数の影響を取り除いた上で、2つの変数の相関を見る指標。 因果関係の分析で使われることがある。 |

| ベルヌーイ分布 | 成功 or 失敗のような、2択の結果を表す確率分布。 試行1回の二項分布ともいえる。 |

| ポアソン分布 | 一定時間内に起きる「まれなイベントの発生回数」を表す分布。 例)救急車の出動回数、クレームの数など。 |

| マハラノビス距離 | 多次元のデータ間の距離を測る方法。 単なるユークリッド距離とは異なり、分散を考慮するため、異常検知などに強い。 |

| ユークリッド距離 | 2点間の「直線距離」。一般的な距離の測り方。 画像処理やクラスタリングなどで使われる。 2つの点A(x₁, y₁)とB(x₂, y₂)のユークリッド距離は以下<で求められる。 ユークリッド距離= √{(x₂ - x₁)² + (y₂ - y₁)²} |

法律・倫理分野

AIに関する法律と契約

1.個人情報保護法

- 個人情報保護法が適用される場面を理解できている

- 個人情報等の定義に従い、基本的な事例について個人情報かのあてはめができる

- 個人情報等に関して生じる常識的な義務について理解しており、具体的な場面において判断ができる

- 匿名加工情報、仮名加工情報の制度趣旨や最基本事項について理解している

- GDPRが適用される場合の概要を理解している

個人情報保護法について

- 保護の対象: 生存する個人に関する情報で、特定の個人を識別できるもの(氏名、生年月日、その他の記述等により)。氏名等と容易に照合できる情報も含む。

- 個人情報取扱事業者: 個人情報データベース等を事業の用に供している者。営利・非営利を問わない。

- 外国の個人情報: 2020年改正(2022年施行)により、国外にいる外国人の個人情報も一定の条件で保護対象となる(域外適用)。

- 仮名加工情報・匿名加工情報: 個人情報から特定の個人を識別できないように加工した情報。それぞれルールが異なる。

キーワード

| キーワード | 意味など |

|---|---|

| 個人情報 | 生存する個人に関する情報で、氏名・住所・顔写真・メールアドレスなど、単体で本人を特定できるものや、他の情報と組み合わせて識別できる情報。 |

| 個人識別符号 | 指紋・顔認証・マイナンバーなど、その人固有の情報。 これ自体が個人を識別できる符号。個人情報に含まれる。 |

| 個人データ | デジタル形式などで体系的に整理されており、検索できるように管理されている個人情報のこと。 例:顧客データベースなど 個人情報保護法の第 22 条にて、利用の必要がなくなったときには、個人データは遅滞なく消去する努力義務が定められている。 |

| 保有個人データ | 事業者が「6か月以上」保有している個人データで、本人が開示・訂正・利用停止などを請求できる対象。 |

| 匿名加工情報 | 氏名など個人を特定できる情報を削除し、元に戻せないように加工した個人情報保護法上の概念。 復元できないことを条件に、第三者提供も可能で、マーケティング分析などで活用される。 以下の処理をすべて行う必要がある。 ・特定の個人を識別できる記述等を削除または置換(例:氏名の削除)。 ・個人識別符号を全て削除(例:顔画像、指紋データ)。 ・他の情報と連結する符号を削除(例:社内のID番号など)。 ・特異な記述を削除(例:年齢116歳など、少数で特定される可能性が高いデータ)。 |

| 仮名加工情報 | 匿名加工情報とは異なり、事業者内では復元可能な形で加工された情報。 社内分析などに使われ、本人の同意なく利用可能だが、他の情報と照合してはならない。 外部提供には制限がある。 |

| 要配慮個人情報 | 人種・信条・病歴・犯罪歴・障害の有無など、差別・偏見につながりやすいため特に取り扱いに注意が必要な個人情報。 法令に基づく場合などを除き、原則として本人の同意が必要。 |

| 利用目的 | 個人情報を取得する際に、何のために使うかを明確にして通知または公表する必要がある。 目的外利用は禁止される。 |

| 第三者提供 | 本人以外に個人情報を提供すること。 原則として本人の同意が必要で、記録の保存も義務づけられる。 |

| 委託 | 個人情報の取り扱いを第三者に委託すること。 提供ではないが、委託先への監督責任が委託元に課せられる。 |

| GDPR | EU一般データ保護規則。 日本よりも厳格で、域外適用(日本企業がEU市民のデータを扱う場合にも適用)や、忘れられる権利などがある。 名前・メールアドレス・住所・遺伝子情報・オンライン識別子(クッキーやIPアドレス)などが個人情報として保護される。 |

2.著作権法

- AI開発における生成物の著作権の成否について、具体的な事例であてはめができる

- 著作権法違反となるコードやデータ等の利用方法をAIの場面に即して理解している

- AI生成物に関する著作権について、論点と確立されている考え方について理解している

- ライセンスの必要性及びライセンス契約の理解をしている

- データの利活用に関する著作権法上の留意点を理解している

- 著作権法30条4のについて、制度趣旨と制度概要を理解している

キーワード

| キーワード | 意味など |

|---|---|

| 著作物 | 思想または感情を「創作的に表現」したもの。 プログラムやデータベース、イラスト、文章なども含まれる。人間による創作性が要件のため、データは特許権による保護は受けられない。 |

| 創作性 | 他の人が容易に思いつかないような「作者の個性」が感じられるかどうか。 単なるデータ集計や事実には創作性がない。 |

| AI生成物 | AIが自動で作成した文章・画像など。 人間が創作に関与していない場合は「著作物」として認められないケースが多い。著作権が発生しない可能性がある。 |

| 著作権 | 著作物を創作した人がもつ権利。 無断複製・配布・改変などを制限できる。 登録不要で、自動的に発生する。著作権者の利益を不当に害しない限りは、情報解析を目的とする著作物の加工や複製は許諾なしで認められている。 |

| 著作権侵害 | 著作権者の許諾なくコピー・アップロード・販売などを行うこと。 AIで学習に使う場合も、著作権者の権利を侵害しないよう注意が必要。 |

| 利用規約 | Webサイトやデータセット等の利用条件を示した規則。 ライセンス条項も含まれるため、著作物を利用する際には必ず確認する。 |

3.特許法

- 特許権と著作権のすみ分け、異同についてAIの場面に即して基本を理解している

- 職務発明について基本を理解している

- 発明、新規性、進歩性について、その趣旨を理解している

- 特許権と営業秘密との違いについて理解している

- 特許権

- 技術内容が公にされるが、独占的な権利を得る

- 法的に他社の利用を禁止できるが、審査の手間や出願料などのコストがかかる

- 原則、出願日から20年間保護される

- 法的に他社の利用を禁止できるが、審査の手間や出願料などのコストがかかる

- 第三者による模倣品や侵害に対して、差止請求や損害賠償請求が可能

- ライセンス供与により、技術を他者に利用させて収益を得ることも可能

- 他社に模倣されたくない革新的な技術に適している

- 技術内容が公にされるが、独占的な権利を得る

- 営業秘密

- 技術内容が公にされないが、社内で厳格に管理する必要がある

- 管理が続く限りは、保護期間は無制限

- 秘密管理が不十分だと、営業秘密として認められない可能性がある

- 不正競争防止法により保護され、不正な取得・開示・利用に対して差止請求や損害賠償請求が可能

- 他社が独自に同一の技術を開発および公開した場合、権利行使できず、営業秘密としての保護を失う

- 特許にできないノウハウや顧客情報なども保護の対象となる

- 技術内容が公にされないが、社内で厳格に管理する必要がある

- 特許権

キーワード

| キーワード | 意味など |

|---|---|

| 発明 | 技術的思想に基づく創作で、自然法則を利用したもの。 AIにおいては、モデル構造やアルゴリズムの一部が該当する場合もある。 |

| 新規性 | 公開された技術と比べて「まったく新しい」こと。 出願前に公開してしまうと、特許が取れない場合がある。 |

| 進歩性 | 既存の技術から「容易には思いつかない」こと。 単なる組み合わせでは特許にならない。 |

| 特許権 | 発明者が一定期間、その技術を独占的に利用できる権利。 申請・審査が必要。 |

| ★実施権 | (シラバス未記載) 特許権者がもっている特許発明の実施権を、第三者でも利用できるようにする権利。以下の二つに分かれる。 専用実施権:特許権者が他者に対して、その特許発明を特定の範囲で独占的に利用する権利を与える制度。設定された範囲では、特許権者も自由に実施できなくなる。 通常実施権:特許権者が他者に対して、その特許発明を特定の範囲内で利用できるが、独占的でなく、特許権者は他の者に通常実施権を許諾することもできる。 |

| 職務発明 | 会社員などが職務として行った発明のこと。 原則として特許は会社に帰属するが、報奨制度の整備も求められる。 |

| 発明者 | 実際に技術的な着想をした人物。 会社が出願しても、発明者として登録される。 |

| 知的財産権 | 特許・著作権・商標・意匠など、創作や技術に関する権利の総称。 AIやソフトウェアは多くの知財に関係する。 |

★データそのもの→保護対象ではない

★データの構造→保護対象となる

4.不正競争防止法

- 不正競争防止法による保護を特許権との差異において理解している

- 営業秘密の三要件の基本事項を理解している

- 限定提供データの制度趣旨や制度の最基本事項を理解している

キーワード

| キーワード | 意味など |

|---|---|

| 不正競争防止法 | 営業秘密の不正取得やAIの学習データの不正利用などを防ぐ日本の法律。 AI開発においては、学習データやアルゴリズムに関わる機密情報の漏洩・盗用を防ぐ観点で重要。 |

| 営業秘密 | ①秘密として管理されている ②事業活動に有用 ③公知でない という3要件を満たす情報。 例えば、顧客リスト、製造方法、アルゴリズムなど。秘密管理が明確でないと保護されない。 |

| 限定提供データ | ①限定提供性②電磁的管理性③相当蓄積性 という3要件を満たすことで、第三者に提供される技術データなど。 営業秘密ではないが、不正取得や不正利用から保護される。AI学習用データなどが該当する。2018年改正法で導入。 【補足】 限定提供性:特定の者に対し事業活動に用いるため提供され、かつ、これに制限を加えて提供していること(反復継続的な提供が想定)。 電磁的管理性:電磁的方法(デジタルデータ)により管理されていること。 相当蓄積性:相当量蓄積されていること。 ※営業秘密との大きな違いは、「秘密管理性」が不要であること。 |

5.独占禁止法

- AIと独占禁止法として、どのような事項が論点とされているかについて理解している

キーワード

| キーワード | 意味など |

|---|---|

| 競争制限 | 企業間の競争を妨げる行為。 カルテルや優越的地位の乱用などが該当する。AIによる価格調整やデータ独占なども今後の論点。 |

| 公正競争阻害性 | 自由で公正な競争を妨げる特性。独立禁止法などの法律で禁止されている。 AIプラットフォームの利用条件や、学習データの独占供給なども対象となり得る。 |

6.AI開発委託契約

- AI開発の各フェーズの内容とそれらのフェーズが置かれている趣旨を理解している

- 各フェーズの内容と適切な契約関係を理解している

- 知的財産の帰属と利用条件について理解している

- 秘密保持契約(NDA)に関する基本的事項について理解している

キーワード

| キーワード | 意味など |

|---|---|

| AI・データの利用に関する契約ガイドライン | 経済産業省が策定した、AI開発・データ利用における契約・権利関係のトラブルを避けるための指針。 知財・学習データ・成果物の取扱いなどを明記。 また、「探索的段階型」という開発プロセス(①アセスメント → ②PoC → ③開発 → ④追加学習)を提唱しており、段階的に責任範囲を明確化しやすくする。 |

| NDA | 秘密保持契約。 機密情報を外部に漏らさないよう契約で義務づける。 開発前の情報共有段階で締結する。 |

| 請負契約 | 成果物の完成を目的とし、成果の納品が契約の中心。開発失敗は発注側のリスクになる。検収基準が明確。 |

| 準委任契約 | 業務の遂行が目的で、結果は保証されない。 AI開発では「学習がうまくいく保証ができない」ため、準委任契約がよく使われる。 |

| 精度保証 | モデルの精度に関する取り決め。 事前に「100%正確に動作する」とは言えないため、免責や検証手順を含めた慎重な契約が必要。 |

| PoC | Proof of Concept。 AI導入の実現性を確認するための試験的取り組み。 精度検証や実行可能性調査を目的とする。 |

| 保守契約 | 開発後の運用・不具合対応・モデル再学習などを行う契約。 SaaS提供時には運用・保守契約も重要。 |

7.AIサービス提供契約

- SaaS型における特殊性を理解している

- SaaS型の特殊性を踏まえ、保守や知的財産等に関する契約条項について基本事項を理解している

キーワード

| キーワード | 意味など |

|---|---|

| SaaS | Software as a Service。 AIをクラウド経由で提供する形式。 ユーザーは利用権を得るだけで、ソースコードは触れない。 著作権やデータ利用の取り決めが重要。 |

| データ利用権 | 利用者が提供するデータを、サービス提供者がどの範囲で学習等に使ってよいかを明示した権利。 契約で明文化する必要がある。 |

| 利用規約 | SaaS提供時に公開される契約条件。 著作権、免責、データの取り扱いなどの重要事項が含まれる。 |

| 精度保証 | 契約上、モデルの予測精度をどのように保証するか、あるいは保証しないかの明示。 過度な保証は避け、現実的な数値や再学習条件を記載する。 |

AI倫理・AIガバナンス

8.国内外のガイドライン

- 各ガイドラインを通じ共通で議論されている事項を理解している

- ソフトロー・ハードローやリスクベースアプローチなどの重要な概念を理解し、そのメリット・デメリットを理解している

キーワード

| キーワード | 意味など |

|---|---|

| AI倫理 | AIを「安全・公平・人権に配慮して」開発・運用すべきという考え方。 説明可能性・差別の回避・透明性などが重視される。 |

| AIガバナンス | AIの社会的影響を監視・制御する枠組み。ルール・制度・監督などを含む。 リスクの識別・制御が目的。 |

| 価値原則 | 信頼性・安全性・人間中心性・説明責任など、AIに求められる基本的価値観。 EU・OECD・内閣府など各国で共通して提案されている。 |

| ハードロー | 法律や政令など、法的拘束力のある強制的なルール。 違反すれば罰則の対象。 |

| ソフトロー | ガイドラインや倫理指針など、法的拘束力はないが、実質的な影響力を持つルール。 業界内の合意形成に使われる。 |

| リスクベースアプローチ | リスクの大きさに応じて規制の強さを変える考え方。 医療や金融などリスクの高い分野は厳格に規制し、低リスクな用途には柔軟に対応する。 |

9.プライバシー

- プライバシー上の問題の所在と、プライバシーが問題となった著名な事例を理解している

- データ収集段階と推論段階でプライバシー上の問題が区別できることを理解している

- プライバシー上の問題に対応するための方策を理解している

- カメラ画像利活用ガイドブックなどに照らし、カメラ画像を利用するAIにおけるプライバシー上留意すべき事項や対応策などを理解している

キーワード

| キーワード | 意味など |

|---|---|

| カメラ画像利活用ガイドブック | カメラ映像をAIで活用する際のプライバシー配慮に関する実務的な手引き。 経産省と総務省が策定。 映像解析を行うAIの開発・運用時に、何を配慮すべきか(例:本人の同意取得、匿名加工など)を示している。 |

| プライバシー・バイ・デザイン | システムやサービスを設計する初期段階からプライバシー保護を組み込むという考え方。 問題が起きてから対処するのではなく、設計時点でリスクを最小限にする「予防的アプローチ」を重視する。 GDPRでも重要な概念とされている。 |

10.公平性

- 公平性の問題としてどのような問題が存在するのか理解している

- 公平性に関する代表的な事例について理解している

- 公平性の問題が生じる原因について理解している

- 公平性に対処するための要検討事項を理解している

- 公平性に対処するための技術の基礎について理解している

キーワード

| キーワード | 意味など |

|---|---|

| アルゴリズムバイアス | データは偏りがなくても、AIのアルゴリズム(計算の仕組み)が、結果として特定グループに対し不利益となる結果を生み出すこと。 データに存在する偏りが、アルゴリズムによって増幅することもある |

| 公平性の定義 | AIにおける「公平性」とは、「特定の属性(性別、人種、年齢など)によって不当に扱われないこと」を意味する。 |

| サンプリングバイアス | データ収集の時点で、特定のグループのデータに偏って(または少なく)集まること。 例)ネット利用者に対するアンケートだと、ネットを使わない人の意見はそもそも集まりにくい。 |

| センシティブ属性 | 差別につながりうる、配慮が必要な個人属性(人種、宗教、障害の有無、性別、など) |

| 代理変数 | 本来使ってはいけない属性に、強く相関する別の変数 |

| データの偏り | AIの学習に使うデータセットの内容が、現実社会の構成比を正しく反映してなかったり、特定のグループに偏ってしまってること。 |

| ★観察者バイアス | (シラバス未記載)観察者・分析者自身が持つ期待や仮説によって、無意識に特定のデータや事象に注目してしまうことで生じるバイアス。医療・心理学の研究などでよく問題視される。 |

| ★除外バイアス | (シラバス未記載)分析者の先入観や判断により、本来必要な特徴量やデータ項目を除外してしまうことで生じるバイアス。重要な要因の見落としや偏ったモデルの原因になる。 |

11.安全性とセキュリティ

- 安全性に関する論点の所在と代表的な事例を理解している

- セキュリティ上の課題としてどのような攻撃等が存在しているのか理解している

- 安全性やセキュリティの課題への対応手段を理解している

キーワード

| キーワード | 意味など |

|---|---|

| Adversarial Attack (Adversarial Examples) | 日本語に訳すと、敵対的攻撃。 AIモデルに対して、微細なノイズや改変を加えた入力データを用いて、誤った出力を引き出す攻撃手法。 例)りんごの画像に特殊なノイズを加えて、AIにはバナナと誤認識させる。 自動運転時の道路標識誤認など、深刻な脅威が懸念される。 |

| セキュリティ・バイ・デザイン | システム開発の初期段階からセキュリティを組み込む設計思想。 AIシステムにおいても、開発プロセス全体でセキュリティリスクを考慮し、対策を講じることが求められる。 |

| データ汚染 (Data Poisoning) | AIモデルの学習データに不正なデータ(摂動)を混入させ、モデルの性能を低下させたり、特定の出力を誘導したりする攻撃手法。 |

| モデル汚染 | データ汚染と同様。 意図した誤作動を引き起こすなど、セキュリティの脆弱化が目的。 |

| データ窃取 | 学習済みのAIモデルから、学習データやモデルのパラメータを不正に取得する攻撃手法。 APIとして提供されているAIに対し、大量に問い合わせることによって、入力と出力のペアを大量に記録・収集したり、同様のモデルを模倣・再構築する。 |

| モデル窃取 | データ窃取と同様。 例)有料の翻訳AIに入力した内容と翻訳した結果を大量に収集して、内部構造やパラメータをコピーしたAIをつくる。 |

12.悪用

- AI技術の悪用の例とその影響の意味を理解している

- 悪用事例ごとに対応策を理解している

キーワード

| キーワード | 意味など |

|---|---|

| ディープフェイク | AI技術を用いて、実在する人物の顔や声を模倣し、偽の映像や音声を生成する技術。 悪用されると、偽情報の拡散や名誉毀損などの問題を引き起こす。 |

| フェイクニュース | AIを活用して、虚偽の情報を本物のニュースのように見せかけて拡散する行為。 社会的混乱や信頼の低下を招く可能性がある。 |

13.透明性

- 透明性,説明可能性について求められる根拠と内容を理解している

- 説明可能性や透明性を確保するにあたって考慮すべき事項を理解している

- 説明可能性確保技術の代表例の概要を理解している

- 透明性を与える対象について代表的な事項を理解している

キーワード

| キーワード | 意味など |

|---|---|

| ★透明性 | (シラバス未記載)システムやモデルの中で「何が、なぜ、どのように」行われているのかを、人間が理解・把握できる状態のこと。 モデルが「どの特徴に注目して、どのような理由で、どのような予測や判断を下したのか」が分かる状態。 |

| データの来歴 | AIモデルの学習に使用されたデータの出所や加工履歴などの情報。 データの信頼性やバイアスの有無を評価するために重要。 |

| 説明可能性 | AIモデルの判断や出力結果について、人間が理解できる形で説明する能力。 特に、医療や金融などの分野で求められる。 |

| ブラックボックス | 内部の処理過程が不透明で、出力結果の理由が分からないAIモデルのこと。 説明可能性の欠如が問題視される。 |

14.民主主義

- 民主主義に対してどのような影響があるのかを理解している

キーワード

| キーワード | 意味など |

|---|---|

| エコーチェンバー | 自分と同じ意見や情報ばかりが集まり、異なる意見が排除される情報環境。 AIによるレコメンド機能がこれを助長する可能性がある。 |

| フィルターバブル | 個人の興味や関心に基づいて情報がフィルタリングされ、多様な情報に触れる機会が減少する現象。 |

15.環境保護

- 環境保護とAIについてどのような点が議論されているのか理解している

キーワード

| キーワード | 意味など |

|---|---|

| 気候変動モデル | 気候変動の予測や分析にAIを活用するモデル。 大量のデータを処理し、精度の高い予測が可能となる。 |

| 学習の電力消費 | AIモデルの学習には大量の計算資源が必要であり、それに伴う電力消費が環境負荷となる。 |

16.労働政策

- AIが雇用に与える影響について理解している

キーワード

| キーワード | 意味など |

|---|---|

| AIとの協働 | AIと人間が協力して作業を行うこと。 AIが得意な部分を担当し、人間が創造性や判断力を発揮する。 |

| スキルの喪失 | AIの導入により、人間が特定のスキルを使う機会が減少し、そのスキルが失われる可能性。 |

| 労働力不足 | 少子高齢化などにより労働力が不足する中、AIの活用がその補完手段として期待される。 |

17.社会への影響

- インクルージョン、軍事利用、自律性などのAIの様々な課題について問題の所在を理解している

キーワード

| キーワード | 意味など |

|---|---|

| インクルージョン | 日本語では、「包摂」や「受容」を意味する。 属性(人種・障害の有無・環境・年齢・性別・知識レベルなど)によって排除されることなく、多様な人々がAI技術の恩恵を受けられるようにすること。 バリアフリーや多言語対応などが含まれ、デジタルデバイドをなくすこととも解釈できる。 |

| 軍事利用 | AI技術が兵器や軍事戦略に利用されること。倫理的な議論や規制の必要性が指摘されている。 |

| 死者への敬意 | AIが故人の声や姿を再現する技術に対して、倫理的な配慮や尊厳の保持が求められる。 |

| 人間の自律性 | AIの判断に依存しすぎることで、人間の意思決定や行動の自由が制限される懸念。 |

18.AIガバナンス

- AI倫理アセスメントの必要性について理解している

- 人間やステークホルダー関与について、その意味と必要性を理解している

- AI倫理を実現するための組織体制の在り方について理解している