2019年6月のハンズオン参加報告です。

6月8日(土)、本格的なDeep Learningを実装したAI自律動作ロボット、JetBotを実際に作って動かすハンズオン ワークショップに参加しました。会場は大手町のNTT Communicationsさんです。

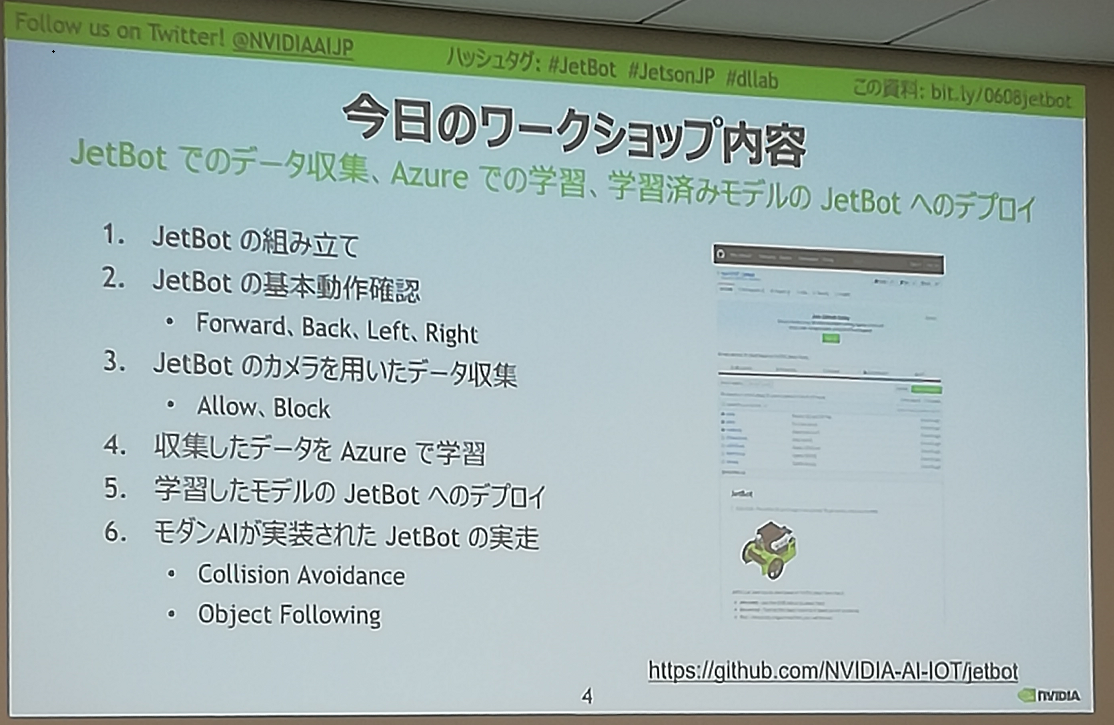

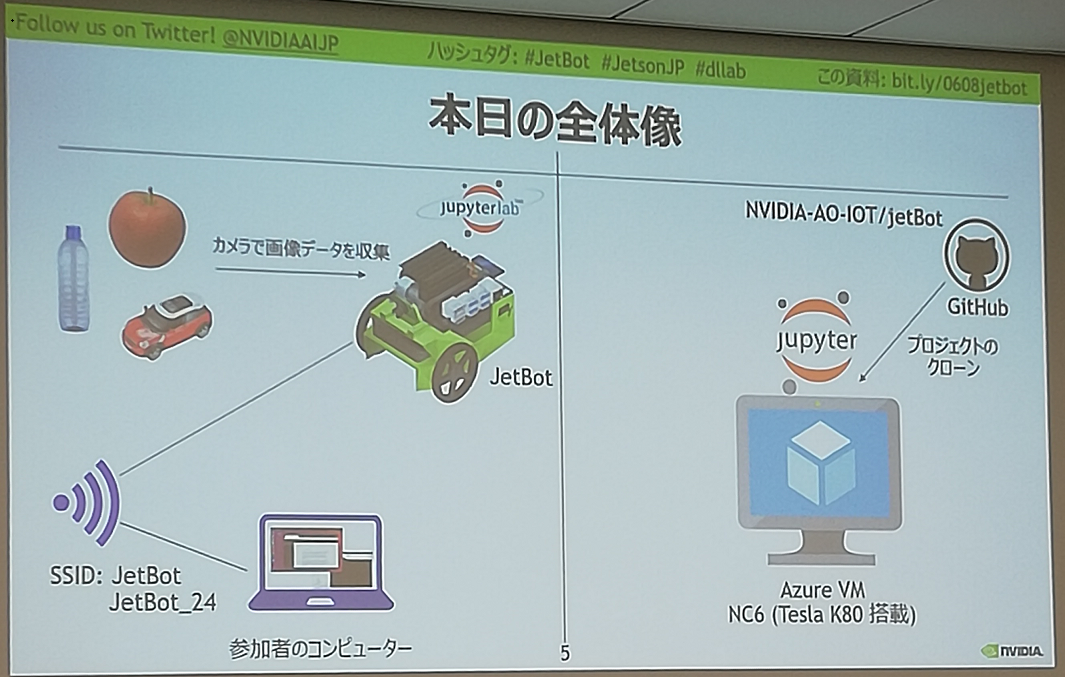

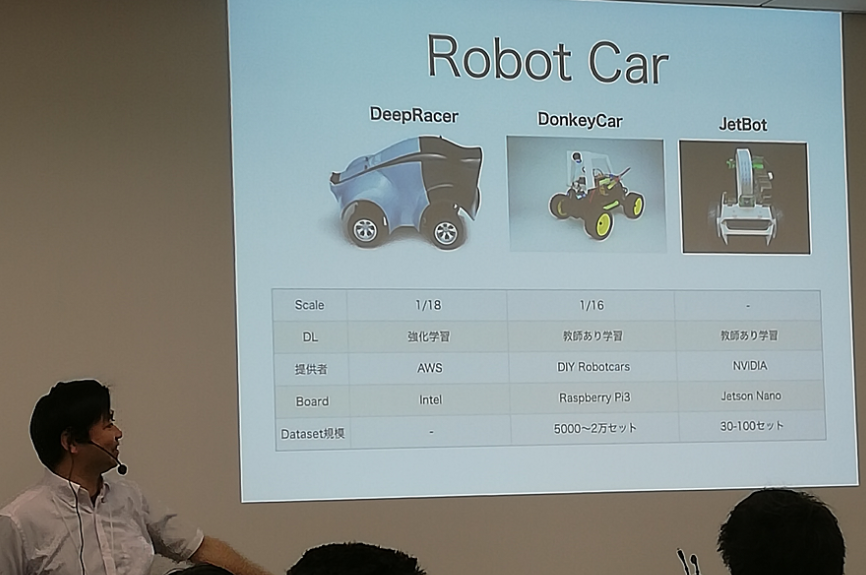

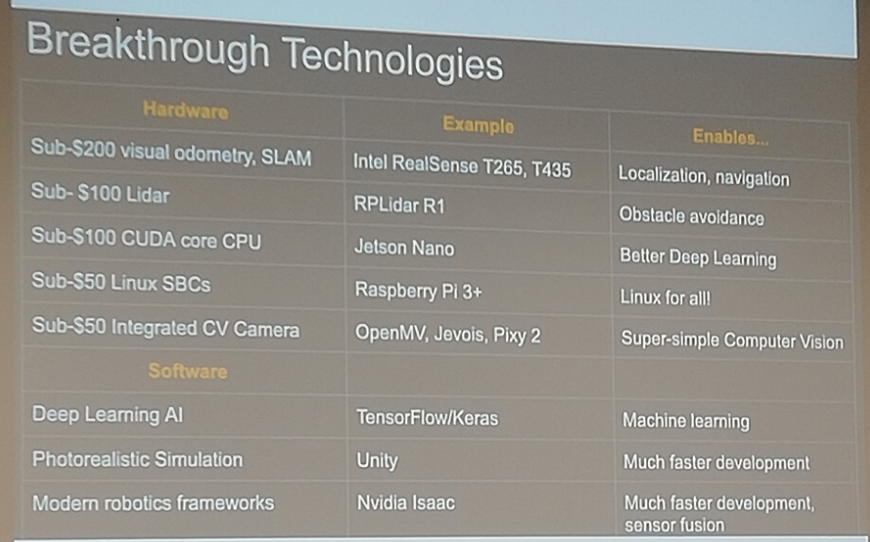

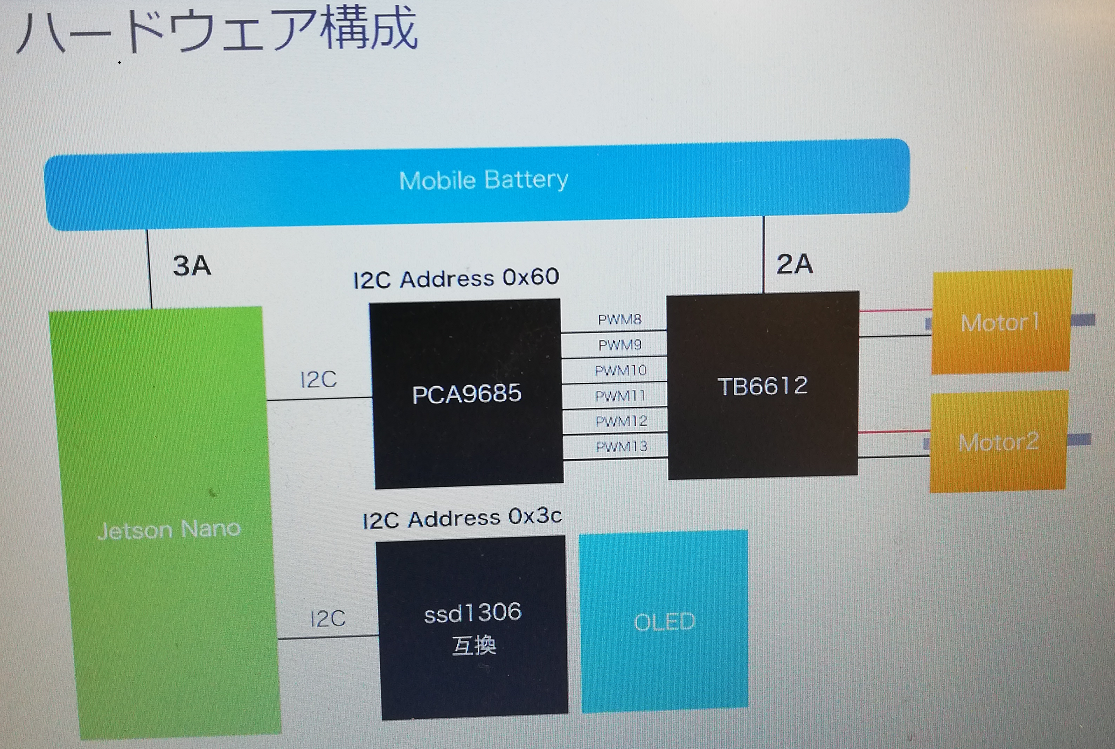

流れはこうです。この春に発表された NVIDIA社のシングルボードコンピュータJetson Nano とその他の部品でJetBotを組み立てます。そしてJetBotのカメラで収集した画像データを用いてAzure環境でニューラルネットワークの学習を行い、その学習済みモデルをIoTエッジデバイスであるJetBotにデプロイして衝突回避、物体追従といった機能を実現します。そして最後はみんなでJetBotを走らせてAI x ロボティクスのパワーを体験する。

こちらがメディアの紹介記事です。

残念ながら時間切れでJetBotへのデプロイまでしかできませんでしたが、一通りの流れは理解したので、なんとかモノにしたいと思っています。

以下はそのフォトレポートです。

講師はGClueの佐々木さん。NVIDIAさん、マクニカさんがバックでサポートして下さって最強の布陣で支えて頂きました。

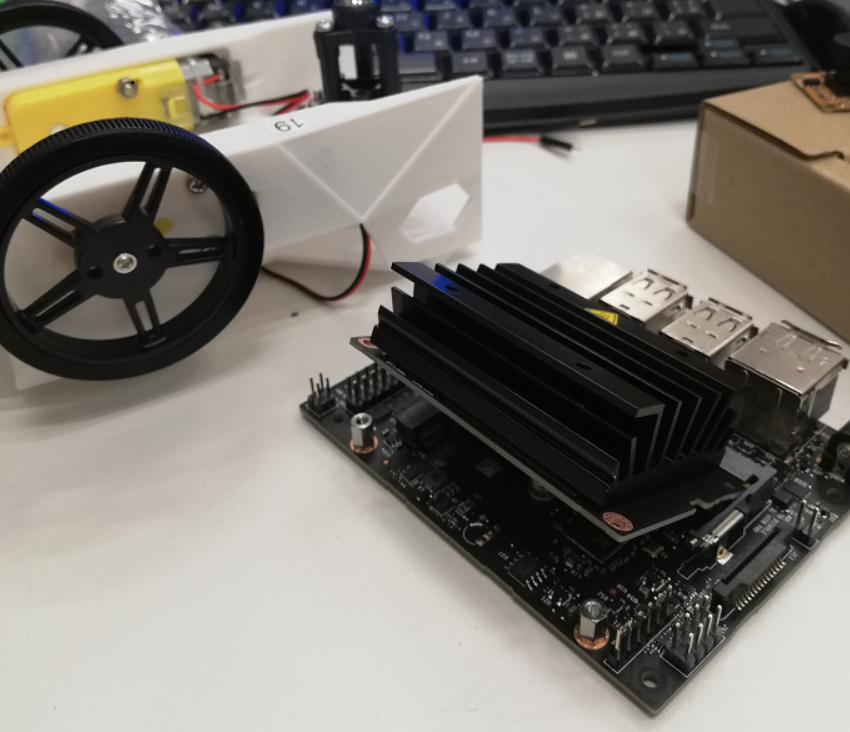

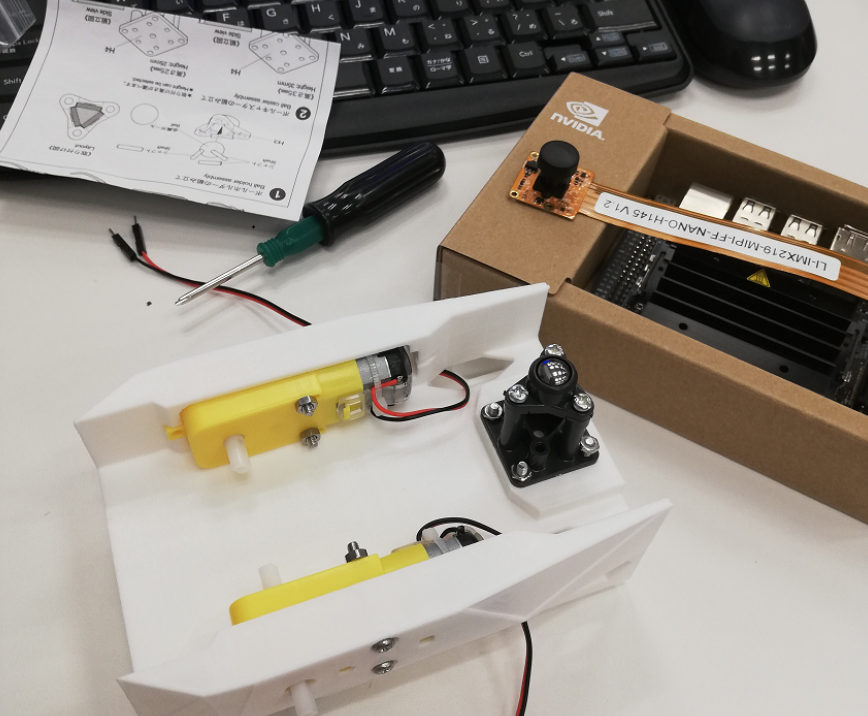

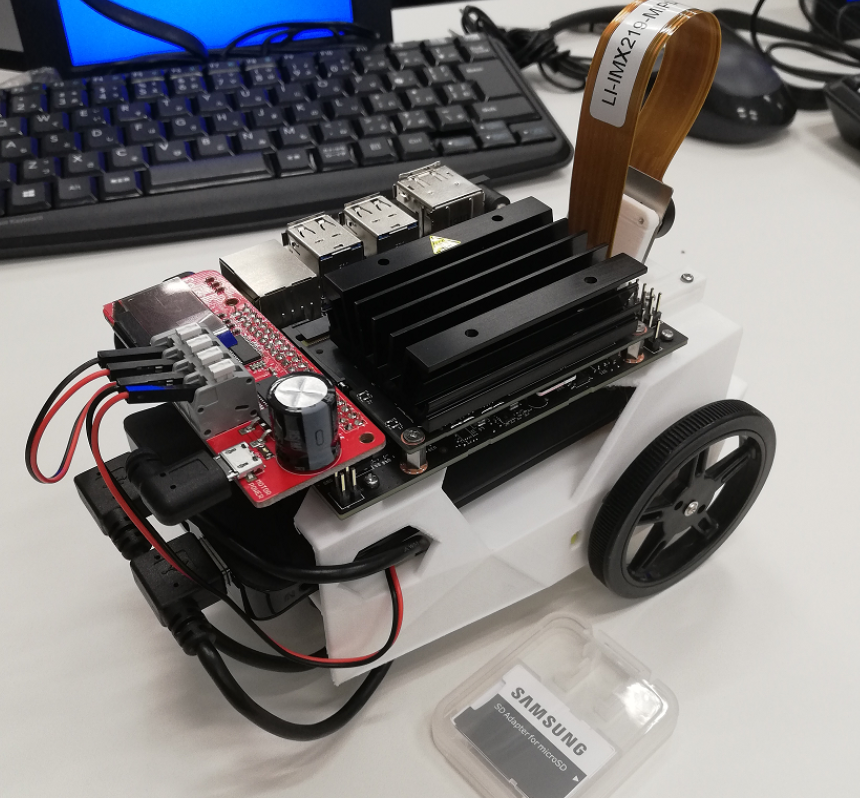

組み立て開始。ボールキャスターの組み立ては少し手間取ります。シャーシにギヤモーターを取り付けます。

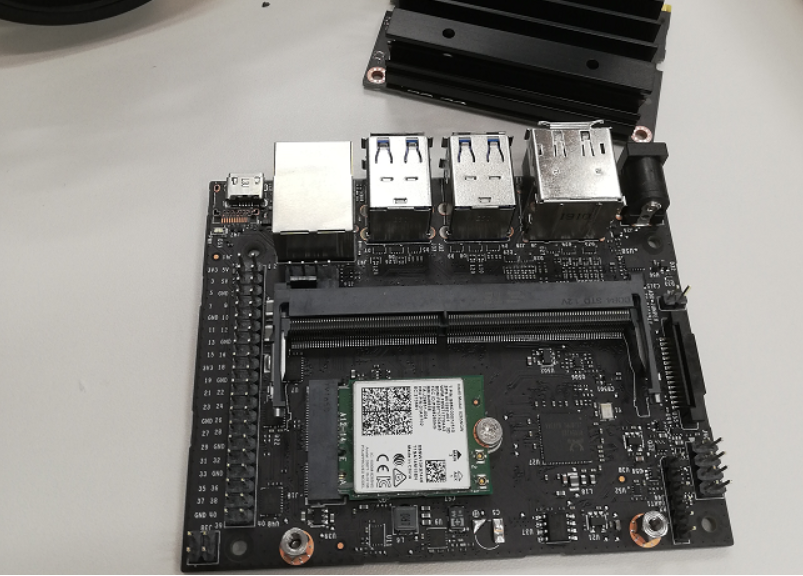

Wifi Moduleを取り付ける。USB Wifi Dongle型は速度がでないため mini PCI-Express型のWifi Moduleを使用するのだそうです。

カメラはフラットケーブルをJetson nano 側のコネクタに取り付けるのでゆっくりていねいに。Controller Boardに配線するときは白いポッチを上から押してその隙間に差し込みます。

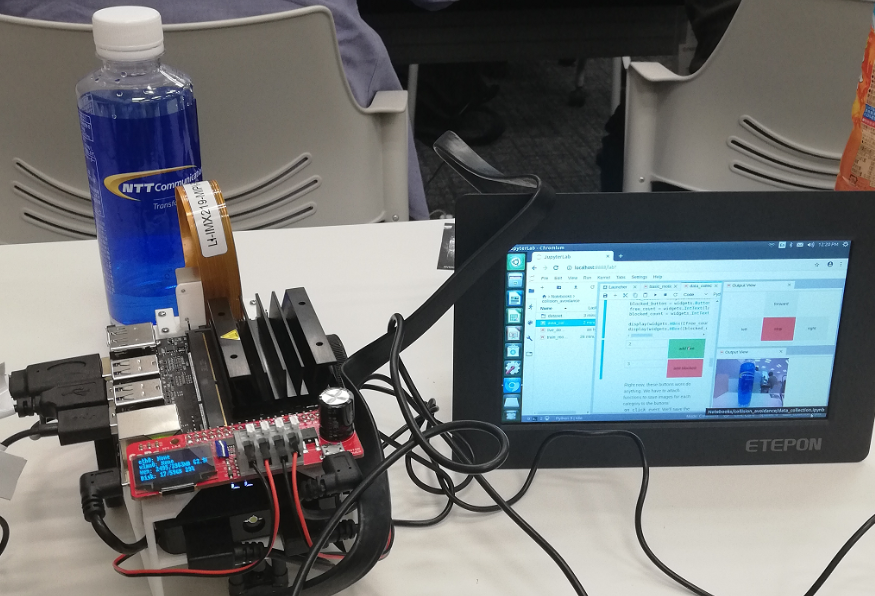

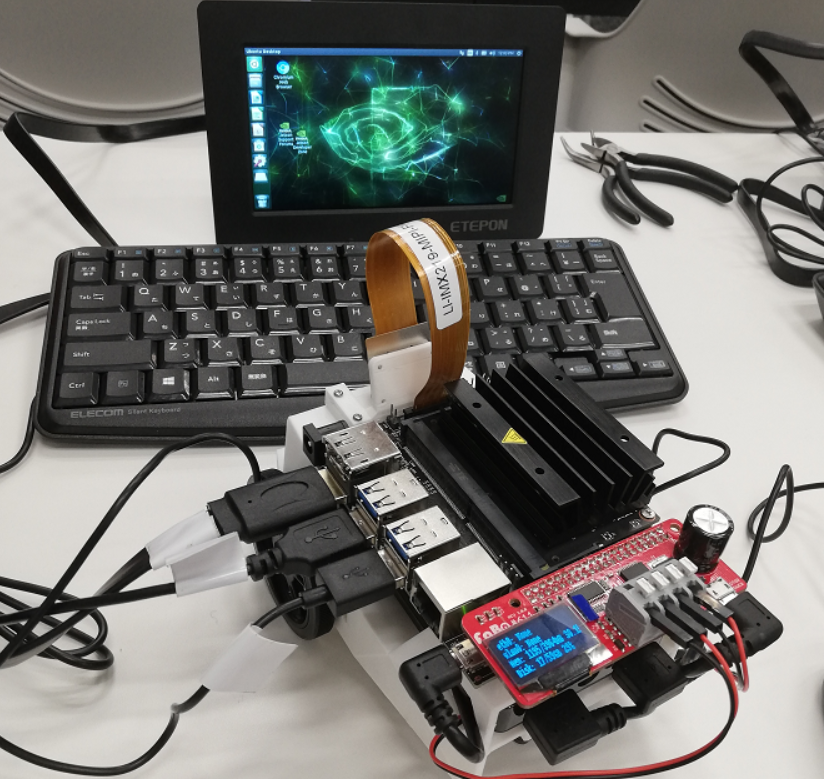

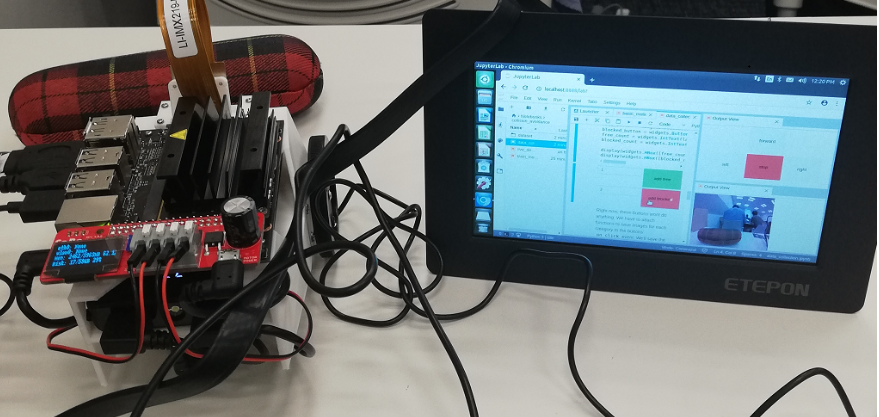

ディスプレイとキーボードにつなげてバッテリーの電源をつなぎます。

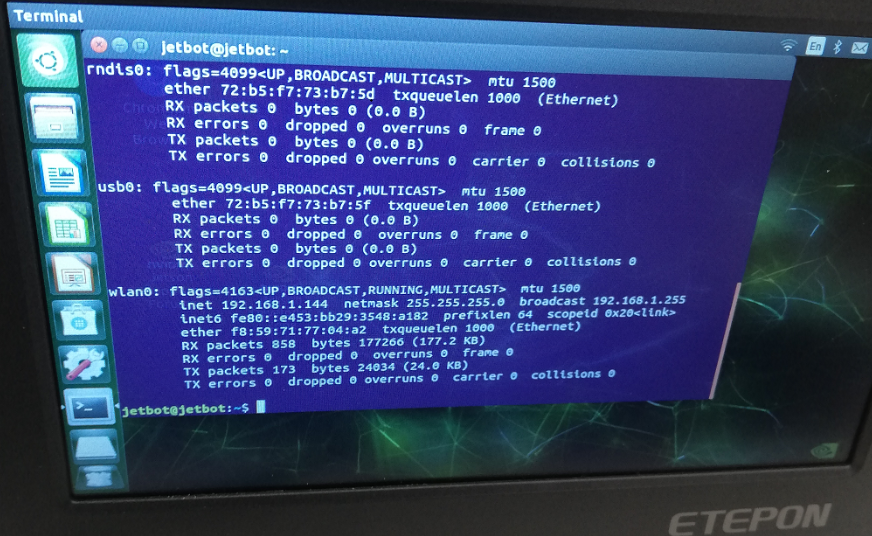

WiFi spotに接続したら ifconfig -a でwlan0のIPアドレスを確認します。 アドレス 192.168.1.144が取得できました。

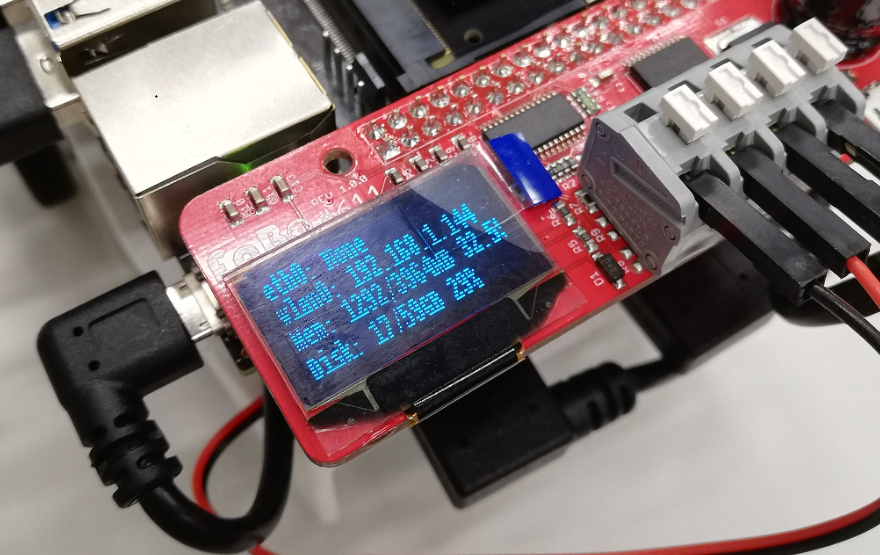

Controller Board側のOLEDにもネットワークアドレスが表示されます。

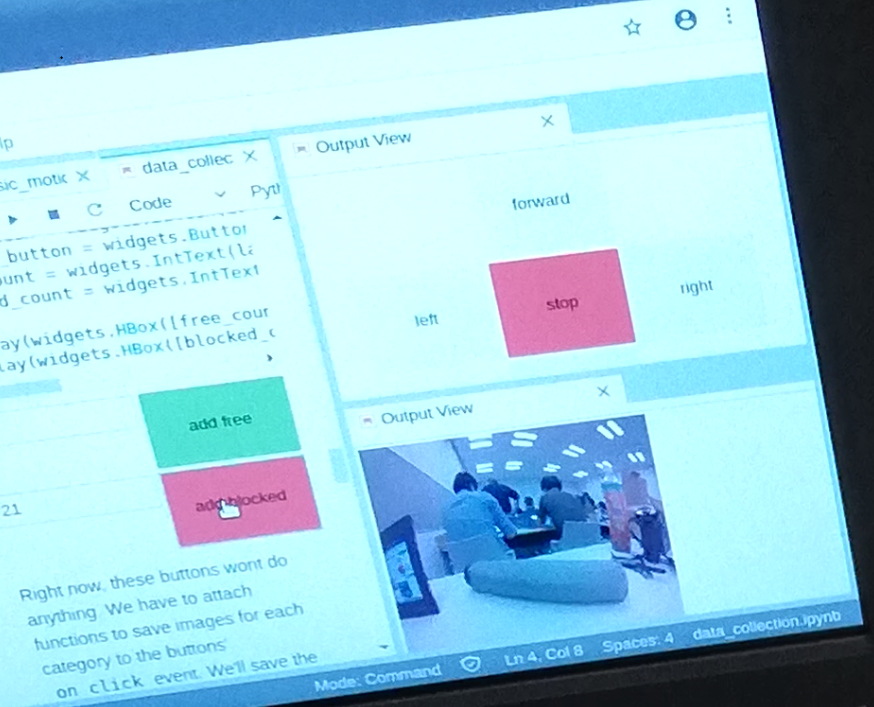

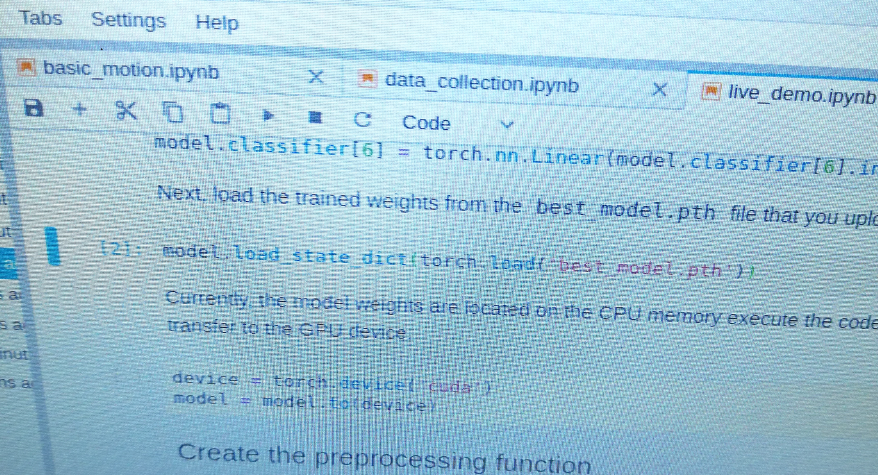

JetBotのポート8888にhttp接続します。最新版のjetbotプロジェクトをインストールしたり、いろいろやってJupyterからモーター制御周りのサンプル basic_motion.ipynb を起動します。モーターが動いて foward, left などマウスで操作できるようになります。次に画像による境界線認識のための data_collection.ipynb を起動します。カメラで撮影した画像が障害物の時はadd blocked, 開放エリアの時はadd freeで写真を登録していきます。

メガネケースを を障害物にして add blockedで登録。

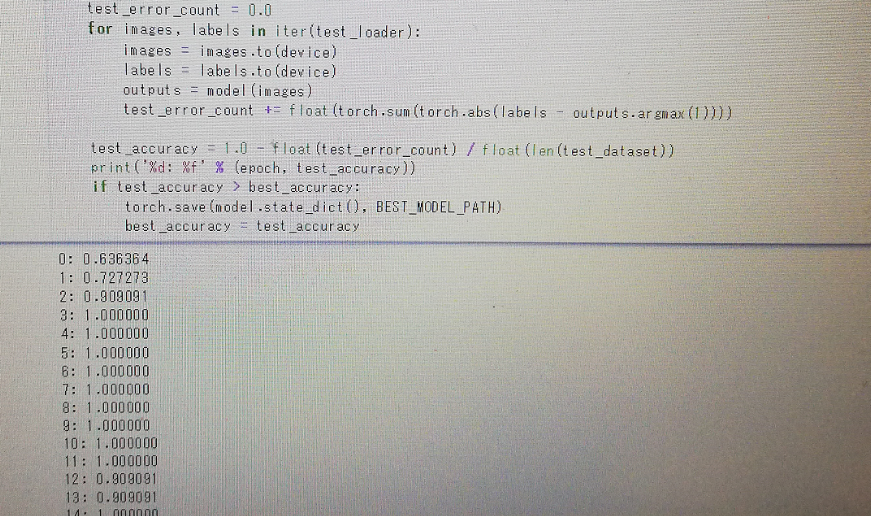

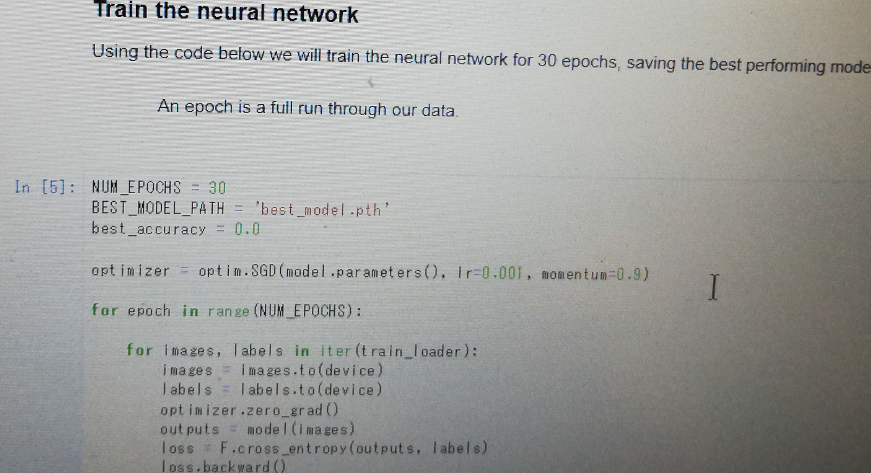

train_mode.ipynpを実行してクラウド(Azure環境)で学習をさせます。

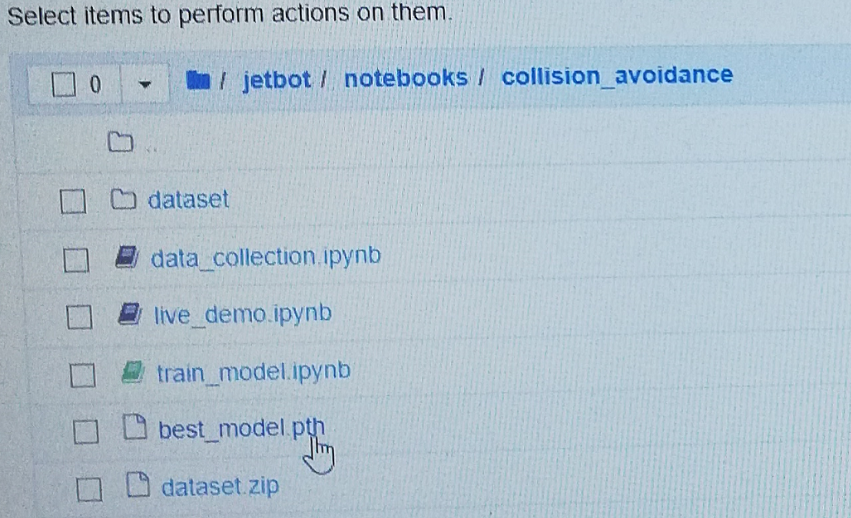

学習済みモデル best_model.pth が生成されています。

生成されたモデルをJetBotにデプロイします。ぎりぎり粘ってここで時間切れ。

ここまで来るのに途中何度も手を挙げてサポートして貰いました。ぎりぎり粘ってここで時間切れ。

あとは帰って続きをやります。