本記事は 生成AIセキュリティ by ナレコム Advent Calendar 2024 の6日目の記事です。

本Advent Calendarは、国内で唯一の技術領域 責任あるAI の MVP受賞者 を中心に、生成AIを含めたAIやデータを企業が利活用するときに気をつけるセキュリティやガバナンスを中心に紹介します。

Microsoft Responsible AI Standard, v2とは

Microsoftは、早くから 責任あるAI を実現すべく指針やガイドラインを設け、Microsoftが提供する多くのサービスに対して自ら評価や改善を行っております。その内容を具体的にまとめたものが Microsoft Responsible AI Standard となります。

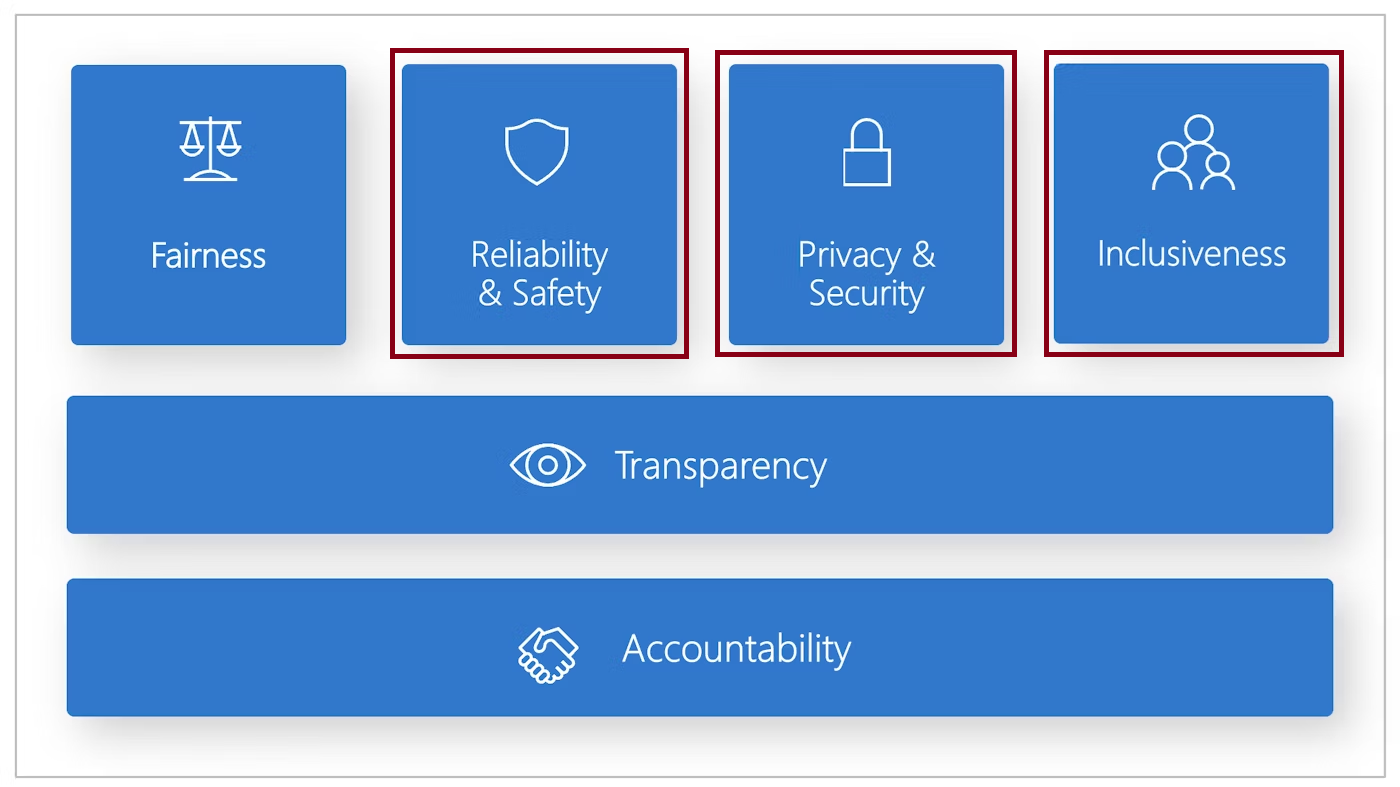

本記事では、6つのAI原則(公平性、信頼性と安全性、プライバシーとセキュリティ、包括性、透明性、説明責任)から、信頼性と安全性、プライバシーとセキュリティ、包括性の3つについて紹介いたします。

信頼性と安全性(Reliability & Safety)

Goal RS1: 信頼性と安全性のガイダンス

Microsoftは、AIシステムが信頼性と安全性の基準を満たすための運用要因と範囲を評価し、問題の修正を行い、関連情報を顧客に提供します。

対象: すべてのAIシステム

要点

Microsoftは、AIシステムが信頼性と安全性の基準を満たすために必要な要因を評価し、問題解決のための措置を講じます。また、顧客にその結果を提供することが求められます。

要件

RS1.1 システムの信頼性と安全な挙動の定義方法、および意図された使用の文脈でのシステムパフォーマンスに対する許容エラーレートを文書化してください。

タグ: 継続的評価 チェックポイント

RS1.2 訓練およびテストデータセットを評価し、それが意図された使用、運用要因、および各要因の設定範囲を含むことを確認してください。評価結果を文書化してください。

タグ: 継続的評価 チェックポイント

RS1.3 信頼性と安全性を確保するために管理が重要な運用要因(システム入力の質、使用状況、運用コンテキストなど)を特定し、文書化してください。

タグ: 継続的評価 チェックポイント

RS1.4 信頼性と安全な使用をサポートするために重要な運用要因の許容範囲を定義し、これらの範囲内で動作する際の許容エラーレートを定義して文書化してください。

タグ: 継続的評価 チェックポイント

RS1.5 信頼性と安全性を確保するために、追加の運用要因、狭いまたは異なる許容範囲、または低い許容エラーレート(偽陽性および偽陰性エラーレートを含む)が推奨される意図された使用を定義し、その結論を文書化してください。

タグ: 継続的評価 チェックポイント

RS1.6 要件RS1.1、RS1.3、RS1.4、およびRS1.5に基づいた評価計画を定義し、システムが評価される環境を含めて文書化してください。

タグ: 継続的評価 チェックポイント

RS1.7 要件RS1.6で定義された評価計画に基づき、システムを評価して信頼性と安全性を確保してください。評価結果を文書化し、継続的な評価の実施頻度を決定して文書化してください。

タグ: 継続的評価 チェックポイント

RS1.8 運用要因および定義された範囲内での失敗事例が発生した場合、問題の解決に取り組んでください。要件RS1.1、RS1.3、RS1.4、RS1.5で定めた責任あるリリース基準が満たされない場合、意図された使用の再評価と文書の更新が必要です。

タグ: 継続的評価 チェックポイント

RS1.9 顧客および潜在的な顧客に対して、要件RS1.2、RS1.7、およびRS1.8の結果、および影響評価およびRS1.8で定義されたサポートされない使用に関する情報を提供してください。システムが外部顧客またはパートナーに提供されるプラットフォームサービスである場合、この情報を必要な透明性ノートに含めてください。

タグ: 影響評価、透明性ノート

ツールおよび実践の推奨事項

- RS1.1.1 安全の専門家にインタビューを行い、システムが影響を及ぼす可能性のある領域で関連する文献を確認してください。

- RS1.4.1 顧客にインタビューを行い、運用要因とその変動を理解してください。

Goal RS2: 予測可能な失敗の修正時間の最小化

MicrosoftのAIシステムは、予測可能または既知の失敗の修正時間を最小限に抑えるように設計されています。

対象: すべてのAIシステム

要点

Microsoftは、予測可能な失敗に対する修正措置を速やかに行い、システム全体での影響を最小限に抑える方法を定義しています。

要件

RS2.1 システム全体の予測可能な失敗(偽陽性および偽陰性を含む)を定義し、それらが各意図された使用に対してどのように利害関係者に影響を与えるかを文書化してください。影響評価テンプレートを使用して、これらの失敗が利害関係者に与える悪影響を文書化してください。

タグ: 影響評価

RS2.2 予測可能な失敗で利害関係者に悪影響を与える可能性がある場合、失敗管理アプローチを文書化してください。

- 可能であれば、この失敗を回避するようにシステムを設計・構築します。設計解決策を説明し、予測可能な失敗を解決するための時間範囲を見積もるか、失敗が設計で防止されることを示してください。

- 設計で防止できない場合、失敗が発生した際に使用できる代替案を構築します。代替案を説明し、その使用にかかる時間を文書化してください。

- システムの監視を担当する利害関係者が失敗を解決できるようにするためのトレーニングおよびドキュメントを提供します。トレーニングとドキュメントを説明してください。

RS2.3 システムが使用中に明らかになる未知の失敗を管理するための計画を文書化してください。

- システムのロールバック計画を説明し、すべてのエンドポイントでシステム全体をロールバックできるまでの時間を文書化してください。

- 機能をオフにするためのサポートを説明し、機能がすべてのエンドポイントでオフにできるまでの時間を文書化してください。

- 各モデルの更新とリリースのプロセスを説明し、システムがすべてのエンドポイントで更新されるまでの時間を文書化してください。

- 顧客、パートナー、エンドユーザーに対して、システムの変更、失敗に関する最新の理解、およびそれらに対する最良の緩和策を通知する方法を説明してください。

RS2.4 要件RS2.1で定義された予測可能な失敗の修正および緩和をサポートするために、システムのオーナー、開発者、カスタマーサポート、およびその他の利害関係者向けのトレーニングおよびドキュメントを提供してください。提供されたトレーニングとドキュメントを文書化してください。

ツールおよび実践の推奨事項

- RS2.1.1 故障モードおよび影響分析(FMEA)を実施してください。

- RS2.2.1 失敗管理を支援するために、システム設計時に「ヒューマン-AIインタラクションガイドライン」を遵守してください。

Goal RS3: 継続的な監視、フィードバック、および評価

MicrosoftのAIシステムは、新しい利用方法の特定、問題の特定と解決、システムの管理と維持、改善のために、継続的な監視、フィードバック、および評価を受けます。

対象: すべてのAIシステム

要点

Microsoftは、システムの運用中に継続的な評価を行い、新たな利用方法や運用要因の変化に対応し、システムを改善していきます。

要件

RS3.1 システムの健康監視方法の詳細なインベントリを確立し、文書化してください。これには以下を含みます:

- データリポジトリ、システム分析、および関連するアラートから生成されたデータとインサイト

- 顧客が失敗や懸念を報告するためのプロセス

- 一般の人々がフィードバックを提出するためのプロセス

RS3.2 システムの各監視チャネルについて、標準運用手順および健康監視アクションプランを定義し、文書化してください。これには以下を含みます:

- トラブルシューティングおよび将来の失敗の防止を支援するためにシステムの失敗を再現するプロセス

- 監視するイベント

- イベントのレビュー優先順位

- レビューの予想頻度

- 事象の優先順位および解決までのタイミング

- 標準およびその目標をサポートする高優先度の問題が「責任あるAIオフィス」にエスカレーションされる方法

- 顧客サービスを巻き込んで、システムの問題に対応する方法を認識させるプロセス

RS3.3 新しい利用方法、重要な運用要因、または運用要因のサポート範囲の変更が特定された場合、既存のシステムでその利用方法または運用要因がサポートできるか、追加作業が必要か、サポートできないかを判断してください。

- 新しい利用方法や運用要因がサポートされる場合、RS1.6に従ってシステムを評価し、影響評価に新しい利用方法を追加し、RS1.9に従って更新した情報を公開してください。

- サポートできない場合は、RS1.9で顧客向け文書を更新し、サポートされない利用方法として記載してください。システムが外部顧客やパートナー向けのプラットフォームサービスである場合、この情報を必要な透明性ノートに含めてください。

タグ: 影響評価、透明性ノート

RS3.4 システムが意図された利用方法や運用要因範囲を超える資格または品質管理要件を課す敏感な用途に使用される場合、この用途に特化した評価を実施してください。責任あるリリース基準を満たせない場合、責任あるAIオフィスが評価結果を確認し、対応方法を決定します。変更点と評価結果を文書化してください。

RS3.5 他の目標にタグ付けされた「継続的評価チェックポイント」を継続的に実施してください。

RS3.6 継続的評価チェックポイントで満たされていない目標がある場合、指名されたレビュアーと相談し、敏感な用途の場合は責任あるAIオフィスと協力してギャップを埋めるための計画を立て、実施します。プロセス、結果、および結論を文書化してください。

RS3.7 システムの使用中に意図された使用に対して適合性がない証拠が明らかになった場合:

- 意図された使用方法を顧客向け資料から削除し、現在の顧客に問題を通知して、ギャップを埋めるためのアクションを取るか、システムを終了します

- 意図された使用に関連する文書を改訂します

- 改訂された文書を顧客に公開します

システムが外部顧客やパートナー向けのプラットフォームサービスである場合、この情報を必要な透明性ノートに含めてください。

タグ: 透明性ノート

RS3.8 以下のイベントが発生した場合、Goal T2に必要な文書をレビューおよび更新してください:

- 新しい利用方法が追加された場合

- 機能が変更された場合

- 信頼性と安全性に関する新しい情報が知られるようになった場合(RS3.3で定義された通り)

- システムの精度およびパフォーマンスに関する新しい情報が得られた場合

システムが外部顧客やパートナー向けのプラットフォームサービスである場合、この情報を必要な透明性ノートに含めてください。

タグ: 透明性ノート

RS3.9 標準およびその要件をサポートするために解決されていない問題を責任あるAIオフィスにエスカレーションしてください。

プライバシーとセキュリティ(Privacy & Security)

Goal PS1: プライバシー基準の遵守

MicrosoftのAIシステムは、Microsoftプライバシー基準に従ってプライバシーを保護するよう設計されています。

対象: Microsoftプライバシー基準が適用される場合

Goal PS2: セキュリティポリシーの遵守

MicrosoftのAIシステムは、Microsoftセキュリティポリシーに従ってセキュリティが確保されるよう設計されています。

対象: Microsoftセキュリティポリシーが適用される場合

包括性(Inlusiveness)

Goal I1: アクセシビリティ基準の遵守

MicrosoftのAIシステムは、Microsoftアクセシビリティ基準に従ってインクルーシブであるよう設計されています。

対象: Microsoftアクセシビリティ基準が適用される場合

まとめ

Microsoftが提供するMicrosoft Responsible AI Standard v2を中心に、AIシステムにおける信頼性と安全性、プライバシーとセキュリティ、包括性の遵守基準が解説されています。

信頼性と安全性については、AIシステムが運用中に予測可能な失敗を最小化し、問題解決のための明確な手順と透明性を提供することが強調されています。Microsoftは、システムのパフォーマンスや失敗の影響を評価し、必要な改善を行い、その結果を顧客に報告することが求められます。

プライバシーとセキュリティのガイドラインにおいては、Microsoft AIシステムがプライバシーとセキュリティ基準に基づいて設計され、顧客情報を保護しつつ、セキュリティの脅威に対応する方法が示されています。

包括性については、アクセシビリティ基準を遵守し、すべてのユーザーがAIシステムを公平に利用できるよう配慮されている点が説明されています。

本記事を通じて、企業がAIを導入・運用する際に注意すべきセキュリティやガバナンスの要素について理解を深めることができます。