背景

「手元の端末上で対話可能なAIを動かす」というロマンを実現すべく、普段利用しているAndroid端末にOllama(※)を導入し、生成AIを動かしてみました。意外と簡単に行えたため、方法を共有します。

※Ollamaはローカル環境でLLMを動作させるPC向けアプリケーション。コマンド一つでLLMを取得できたり、外部アクセス用のAPIが用意されていたりと使い勝手が良い。

※2025/4/30 記述ミスを修正

概要

- OllamaにはLinux向けバージョンが存在する

- Androidには仮想的なLinux環境を提供する「UseRAnd」というアプリケーションが存在する

- 「UseRAnd」上に「Ollama」をインストールしてみたところ、特に問題なく動作した

手順

Ollamaのインストール

- PlayStore等から「UseRAnd」をインストールする

- 「UseRAnd」を起動する

- 「Distribution」欄に表示されるOSの中から[Ubuntu]を選択する

※他のOSを利用する場合は適宜操作を読み替えること - 「desktop environment」を訊かれたら「Minimal」を選択する

- 「connection type」を訊かれたら「Terminal」を選択する

- ターミナルに入ったらソフトウェアをアップデートする

$ sudo apt update && sudo apt -y upgrade - 必要なアプリをインストールする

$ sudo apt install tmux - Ollamaのインストール用ファイルをダウンロードする

$ wget https://ollama.com/install.sh - ダウンロードしたファイルを解凍する

$ tar xf ollama.tgz - 解凍したインストーラを実行する

$ sh install.sh - Ollamaがインストールできたことを確認する

$ command -v ollama

→「/usr/local/bin/ollma」など、ollamaの実行コマンドの保存先が表示されたらOK

Ollamaを使ってみる

- Ollamaサービスを動作させるための仮想ターミナルを開く

$ tmux - Ollamaサービスを起動する

$ /usr/local/bin/ollama serve - 仮想ターミナルから抜ける(Ctrl+b→d)

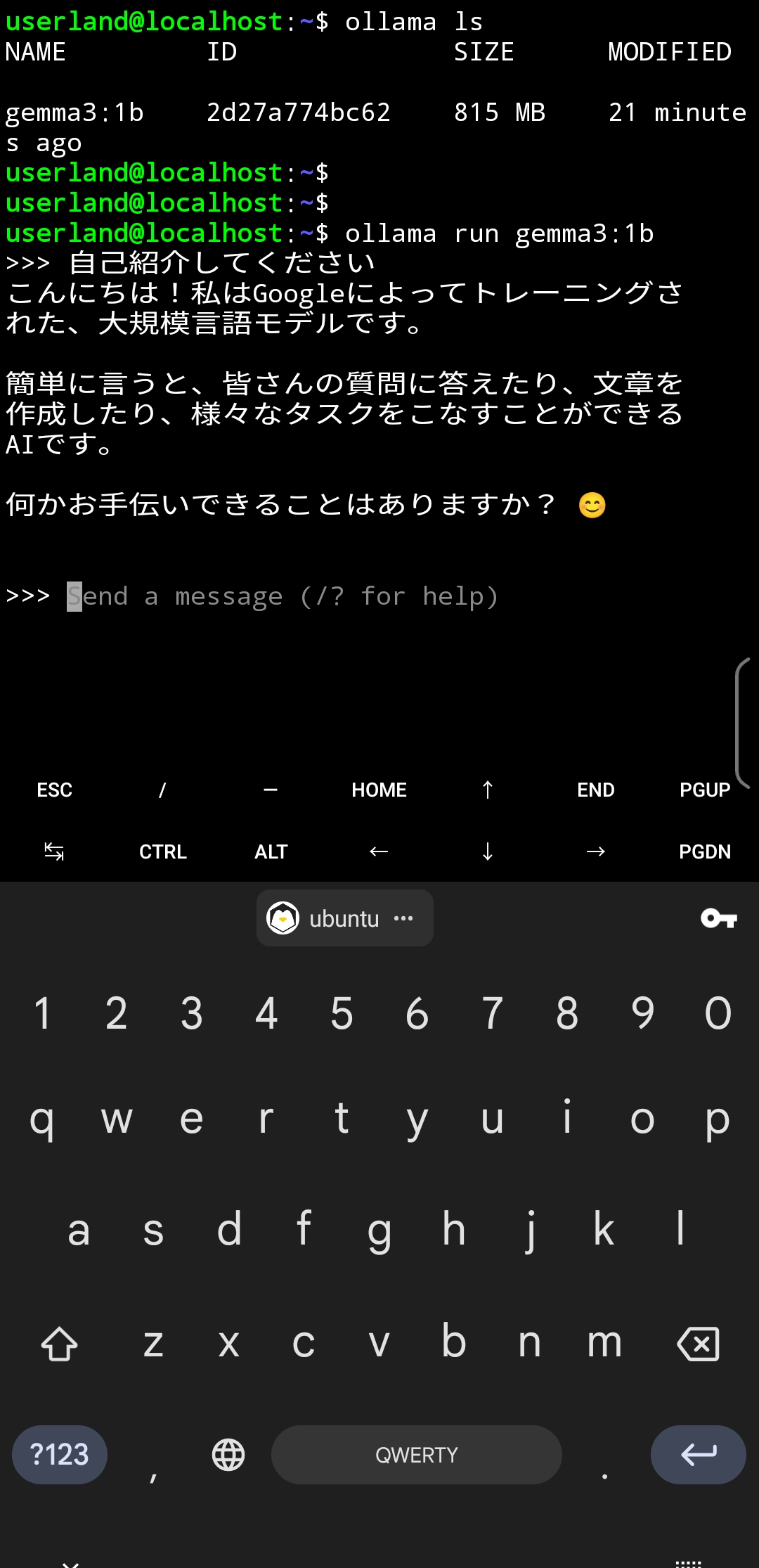

- LLMをダウンロードする(例:gemma3:1b)※

$ ollama pull gemma3:1b

→しばらく待って「success」と表示されたら成功 - LLMを起動する

$ ollama run gemma3:1b

→対話型コンソールに入る - 任意の文章を入力して[改行]する

→LLMの回答が生成される

※Ollamaでは公式のライブラリに保存されたLLMを「ollama pull」コマンド一発で追加できます。(記述は省きますがライブラリにないLLMを追加することも可能です)

雑記

昨年リリースされたGemma2の際にも驚かされましたが、先日発表されたGemma3もなかなか高性能で驚きました。特にこのサイズ感でマルチモーダルモデルというのは色々と遊べそうですね。

参考