機械学習

線形回帰モデル

回帰問題

- 回帰問題とは入力された数値から、連続値を予測する問題のことをいう。

- 回帰問題では入力にベクトルを使い、スカラー値を出力する。このとき入力に使う変数を説明変数(特徴量)と呼び、出力値を目的変数と呼ぶ。

- 例) 住宅の価格予測

- 説明変数:敷地の広さ、築年数など

- 目的変数:家の価格

- 例) 住宅の価格予測

線形回帰

-

線形回帰とは回帰問題を解くための機械学習モデル

-

教師あり学習(正解付きデータでの学習)で学習が行われる。

-

入力がm次元ベクトルの場合、m次元のパラメータの各要素を掛け算した結果の和(線形結合)に切片を足したものが出力される。(入力の次元にかかわらず出力はスカラーになる。)

-

パラメータは入力ベクトルの各要素がどの程度出力に影響を与えるかを決める。パラメータが正の値だと出力を増加させ、パラメータが負の値だと出力を減少させる。パラメータが0に近い場合は出力にあまり影響を与えない。

-

このパラメータを最適な値にすることで正しい予測が可能になる。

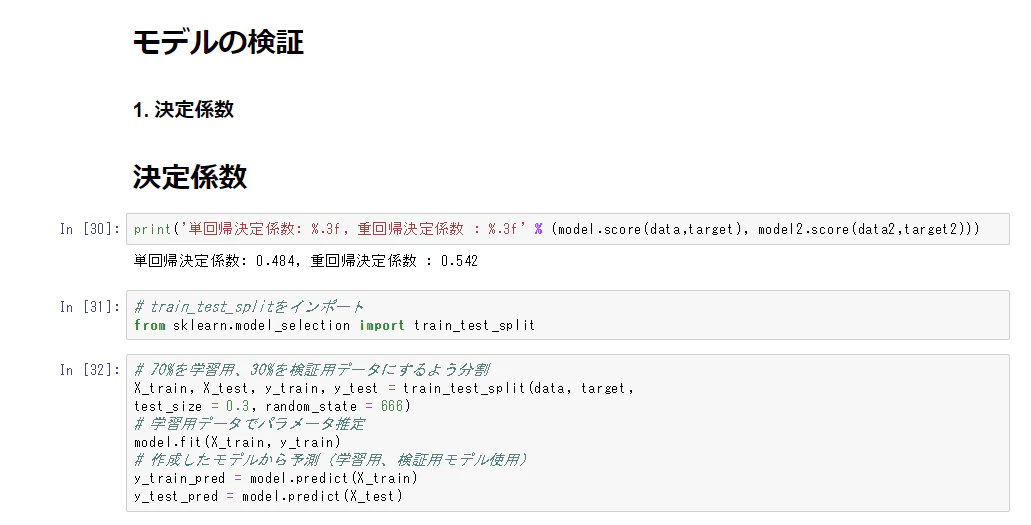

モデルの選択

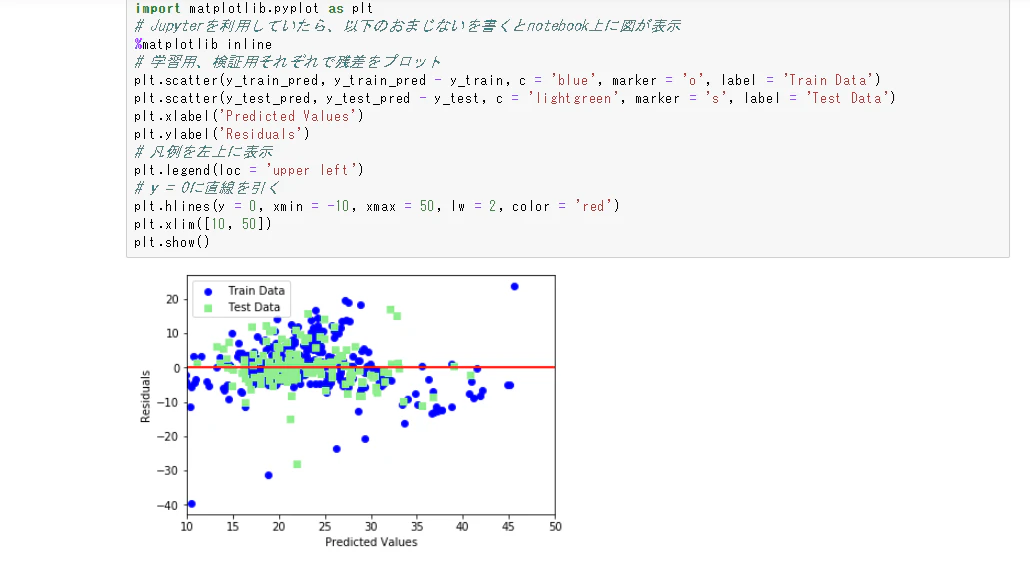

- 手元にあるデータをすべて学習させてしまうと未知のデータに対する予測精度(汎化性能)を評価するのが困難になってしまう。そこで手元にあるデータを学習用とテスト用で分けるのが一般的である。

パラメータの推定

-

データは回帰直線に誤差が加わり観測されていると仮定し、この誤差が最小になるときのパラメータを求めることが機械学習のゴール。

-

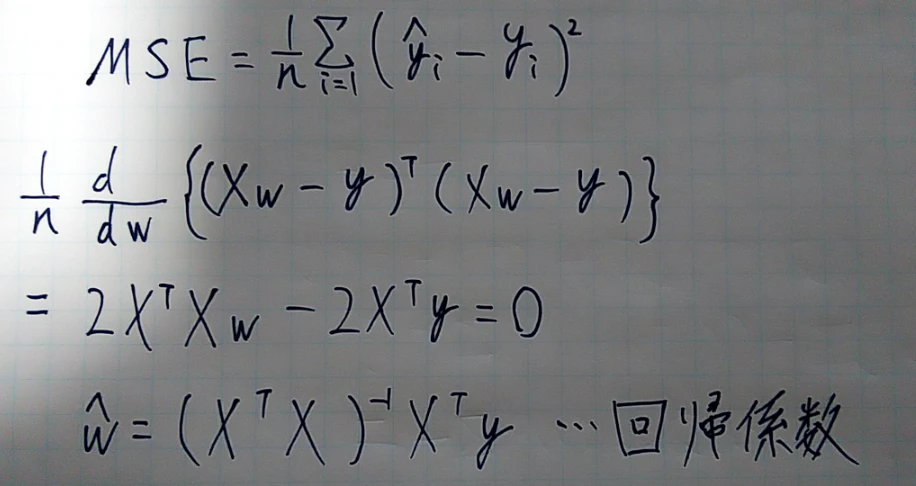

誤差の大きさは平均二乗誤差で表すことができる。平均二乗誤差とは各データとモデルの出力の差を二乗して、それらを足し合わせたものである。平均二乗誤差が小さいほど誤差が少ないと言える。

-

平均二乗誤差を最小にするパラメータを求める方法を最小二乗法という。最小二乗法とは平均二乗誤差の勾配が0になる点、つまり平均二乗誤差をパラメータで微分した値が0になる点を求める方法である。

-

このようにして求められたパラメータをもとにできた回帰直線が各データに当てはまっているかを決定係数を用いて評価することができる。

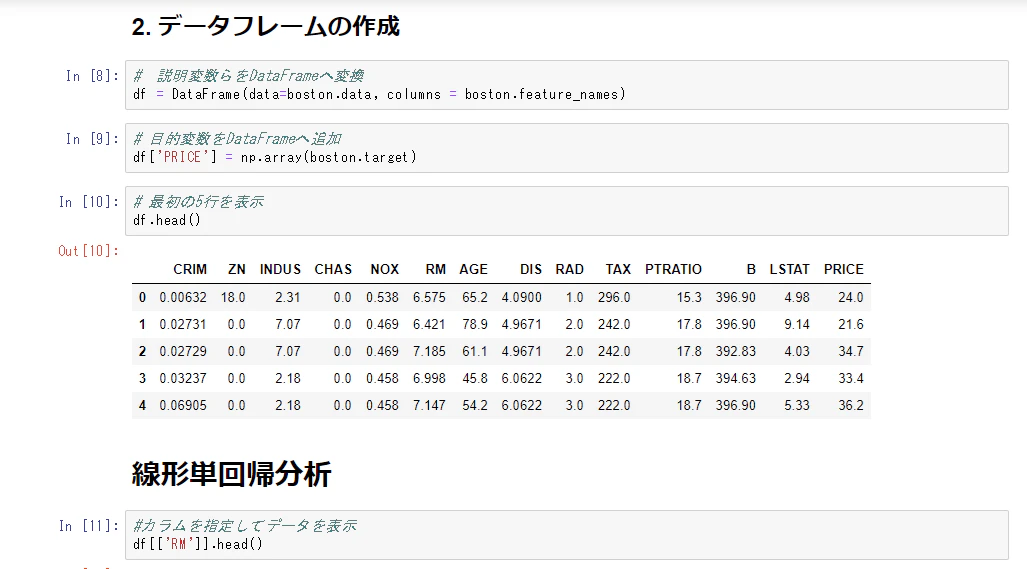

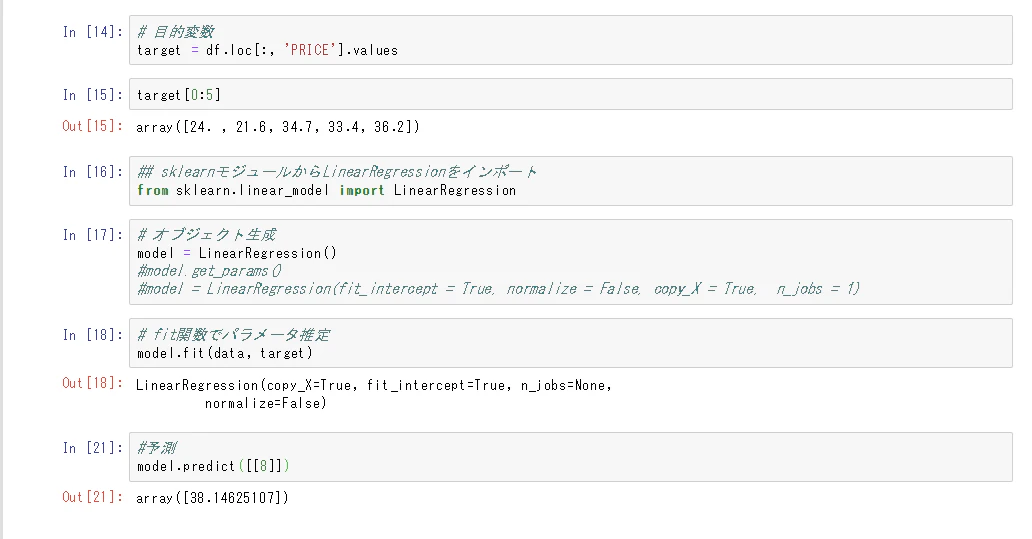

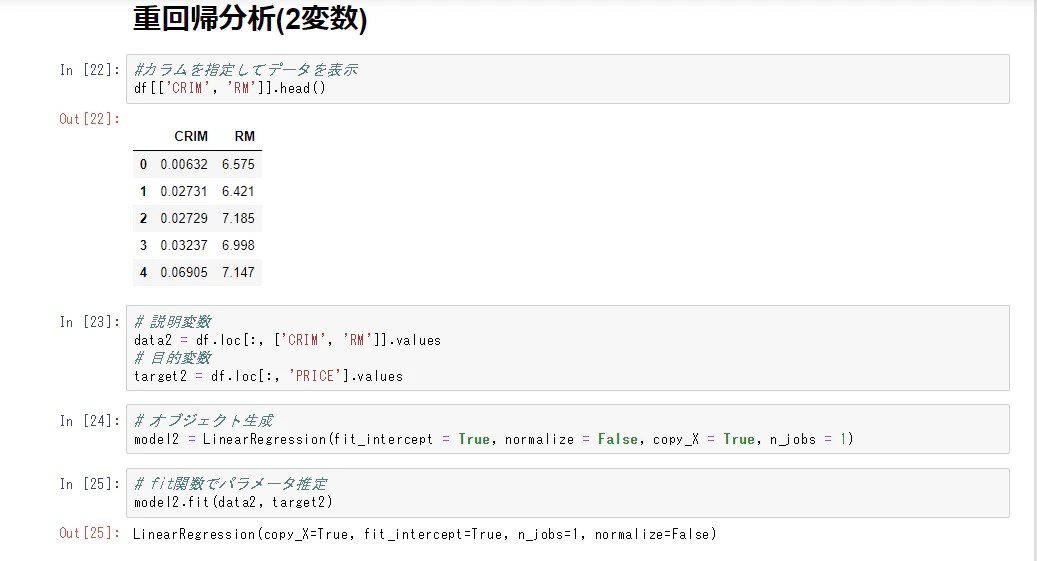

ハンズオン

サマリーと考察

- 単回帰分析では部屋数を説明変数とし、重回帰分析では部屋数と犯罪率を説明変数としてモデルを作成した。

- train_test_splitをインポート時にエラーが発生したため修正した。

- 重回帰分析時に説明変数として築年数や面積の広さを増やしてみたところ、過学習をおこしたようだった。グラフを見る限り予測データに対しての当てはまりは現状でも良さそうに見えるが、より精度を高めたい場合は別の機械学習モデルを使うほうが良いと考える。