非線形回帰モデル

基底展開法

-

非線形回帰モデルとは出力値が直線ではなく曲線を描く予測を行うモデル。

-

線形回帰モデルと違い、複雑な現象に対して使われる。

-

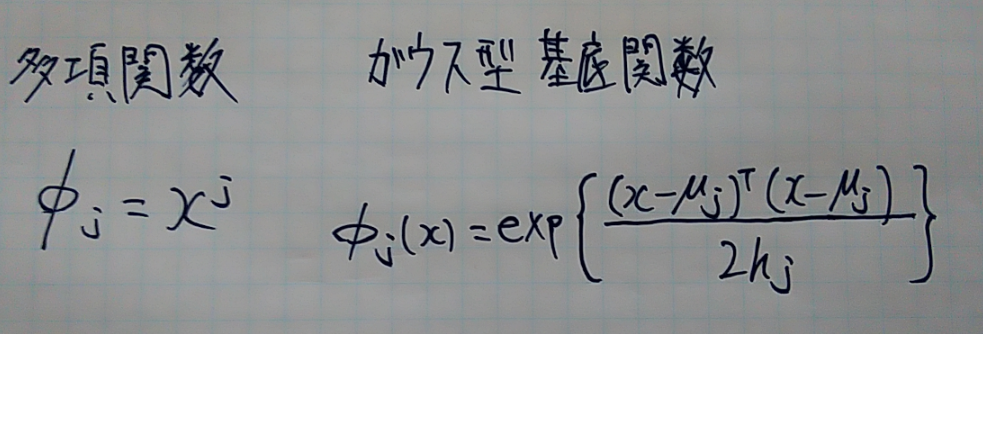

基底関数と呼ばれる関数とパラメータの線形結合で予測値を出力する。

正則化法

- 学習データに対して十分に小さな誤差を求められない状態を未学習と呼び、小さな誤差を得ることができたがテスト時の誤差が大きい場合を過学習と呼ぶ。

- 正則化法は過学習を回避するための方法。(ただし正則化しすぎると未学習となる)

- 正則化を行うことで、未知のデータに対する予測性能(汎化性能)を高めることができる。汎化性能はテストデータとの誤差の期待値で定義される。

- 未学習または過学習かどうかを判断する指標としてバイアスとバリアンスが存在する。バイアスとは作成したモデルと学習データのズレをのことを指し、バリアンス(分散)はモデルの複雑さを表す。バイアスの数値が高いと過学習の状態を示し、バリアンスが高いと未学習の状態を示す。バイアスとバリアンスがトレードオフの関係にあり、この2つの数値を可能な限り低くすることで正確な予測値を出力することができる。

- モデルが複雑になるにつれて値が大きくなるペナルティ項を加えた関数の最小化をすることで正則化を行う。

-ペナルティ項にはL2ノルムを利用したRidge推定量とL1ノルムを利用したLasso推定量がある。

モデル選択

- 正則化パラメータはクロスバリデーションという方法で選択する。

- クロスバリデーションとはモデルの評価の方法の1つで、ほかにはホールドアウト法というものも存在する。

- ホールドアウト法

- 手元のデータを2つに分割し一方を学習に使い、もう一方は学習に使わず汎化性能の測定などに使う方法。

- 学習用データを増やすとテスト用データが減り、テスト用データを減らすと学習用データが減ってしまう。そのためデータの数が十分でないとモデルの学習も汎化性能の評価も適切に行えないという欠点がある。

- クロスバリデーション法

- ホールドアウト法の欠点を補う方法として使われる。

- 手元のデータをそれぞれm個のグループに分割しm-1個のグループを学習に使い、残りの1グループをテストに使用する(分類問題の場合は各グループに全種類のクラスが入るように分割すると性能が高くなる)

- 上記をm回繰り返し、それらの平均二乗誤差の平均を汎化性能とする。

- 手元にあるすべてのデータを学習とテストに使用するので、データ数が少ない場合でも良い性能評価をすることができる。

- ホールドアウト法と違い分割の仕方で制度の違いが出にくいので、複数のモデルをクロスバリデーション法で評価し、一番精度の良いモデルを使用するという方法がとられる。