エイプリルフールのお祭り騒ぎに乗っかったテストで

現状では業務には使用してない方式です

アニメ等のテクスチャマッピングの方式に カメラの方向からテクスチャマッピングする

カメラマップやプロジェクションマッピングと言われる方式があります。

ラフな3Dモデルを作成してから作画をすることが多いため

レイアウトがきっちり定まって 下絵や詳細なモデリングの手間は省力化できる一方

カメラから遮蔽された部分に回り込むような動きには弱いです

今回は3D下絵で描いてみた この絵から生成を試してみたいと思います

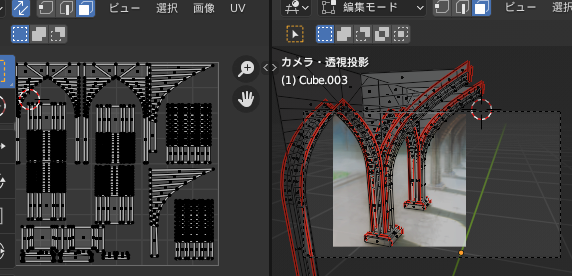

処理用画像の用意

カメラマップ画像をUVテクスチャにベイクすることで生成AI処理できる状態にするので

UV展開をします

できるだけ テクスチャ自体が面の正面像になるような展開をしています

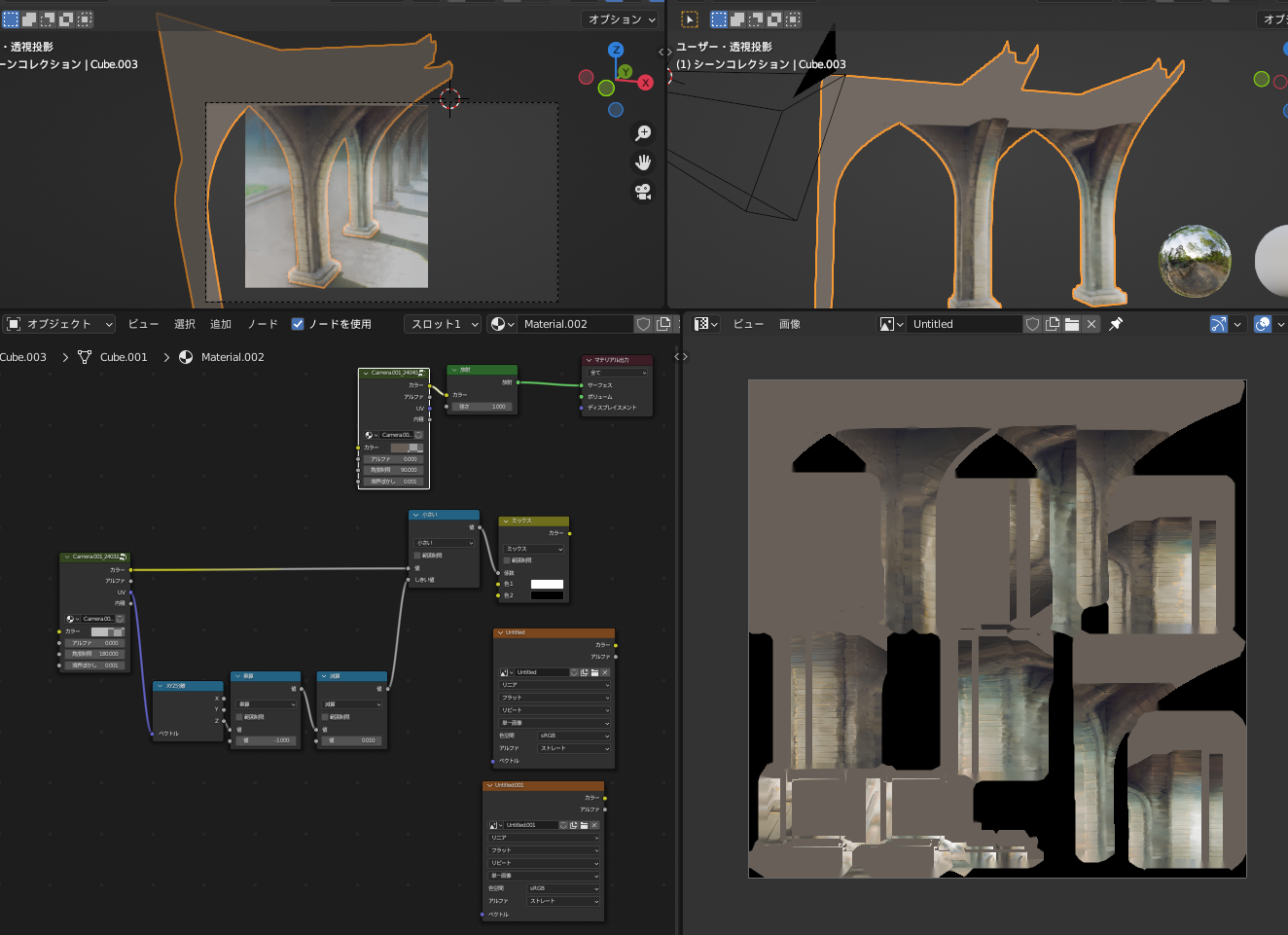

次に描いた画像をカメラマップで投影してベイクします

この辺りは 他で解説している拙作のカメラプロジェクションアドオンの操作で 今回の主題から外れるので割愛します

またカメラに映る範囲・影になる部分を区別するシェーダーで作ったカメラからの遮蔽部分やAO画像もベイクしておきます

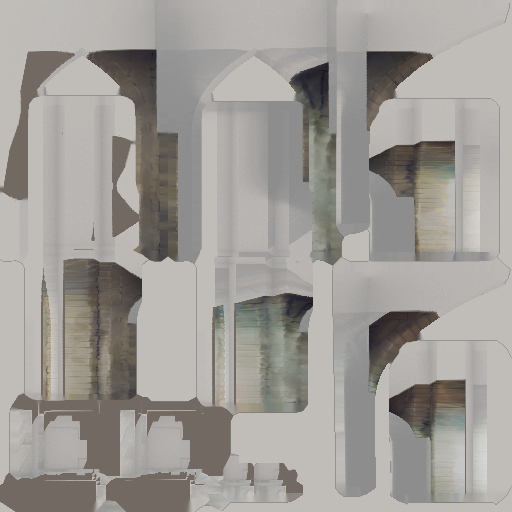

ベイクデータを処理して最終的にこんな感じの画像を作成しました

薄い色で表示されている部分は アルファで半透明になっていて 生成AIでデータの作成を試行した部分です

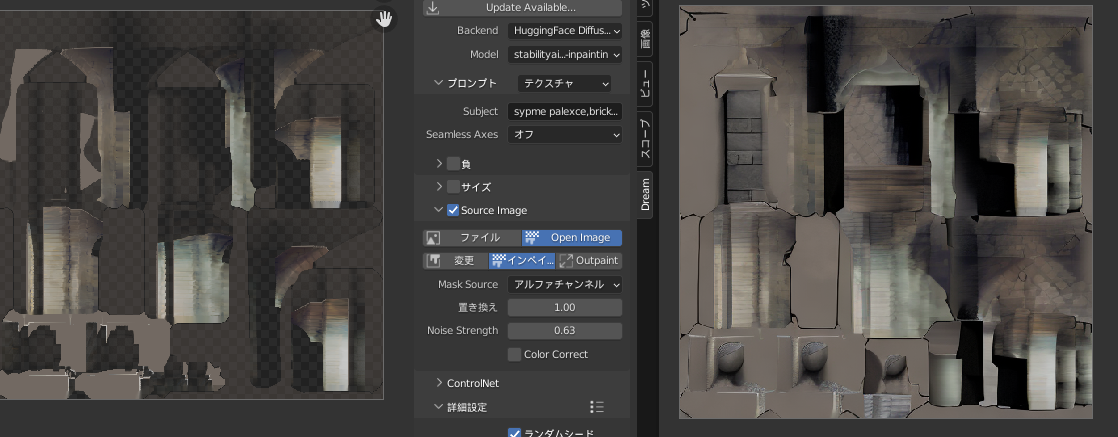

StableDiffusionでのインペイント

画像処理は Zip版Blender上でStableDiffusionを動かすDream Texturesアドオンを動かし

stable-diffusion-2-inpaintingのモデルを使用しています

アルファを Mask Sourceとして指定しています

Noise Stremgthを60-90等いくつかの設定を変動させて何枚か生成してみました

背景部分も同様にインペイントで背後部分をインペイントしました

今回の成果はこんな感じです

いくらか途中のミスもありますし なんとかできた程度の品質ですが

一応は描いていなかった部分の生成はできました

一連の手順を自動化すれば もしかしたら使い道があるかもしれないですね

とりあえず 今回の試作はここまでです。