はじめに

- 以前にRTX4080(16GB)で27Bモデルを動かしてみたら、すごく遅かった。

- 128GBの大容量メモリを誇るDGX Sparkをせっかく購入したので、120Bの大きなモデルを動かしてみたい。

- LM Studio環境を利用する。

DGX Spark

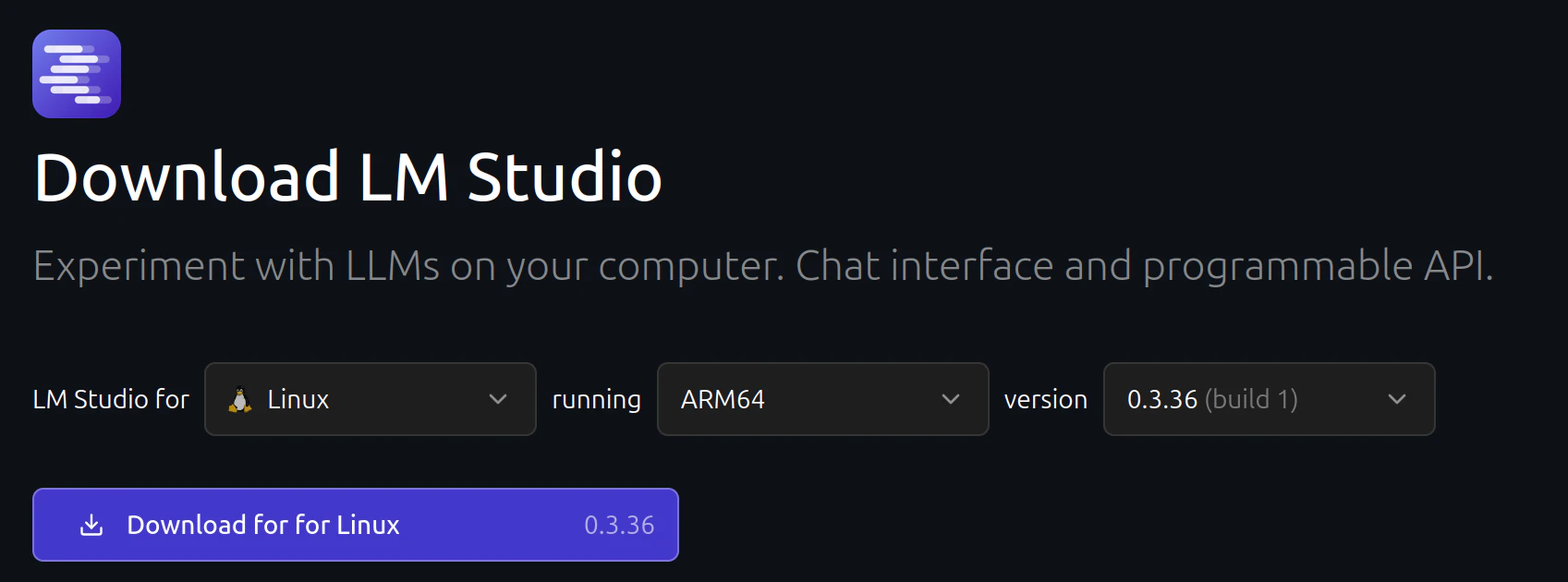

LM Studio公式ページからダウンロード

ARM64版を選ぶ。

DGX Sparkは Ubuntu + ARM64(aarch64)環境のためx86_64版は動かない点に注意。

ダウンロードしたファイルからインストール

プロパティから実行可能なプログラムのチェックを入れる。その後 ダブルクリック →「実行」(Run)で起動、、、いや、動かないぞ?

からあげさんの記事を参考にインストールする。

https://zenn.dev/karaage0703/articles/985ddbd8fa15d3

sudo apt install -y libfuse2

cd ~/Downloads

chmod a+x LM-Studio-*-arm64.AppImage

LM Studioの起動

cd ~/Downloads

./LM-Studio-*-arm64.AppImage --no-sandbox

DGX SparkでLLM実行

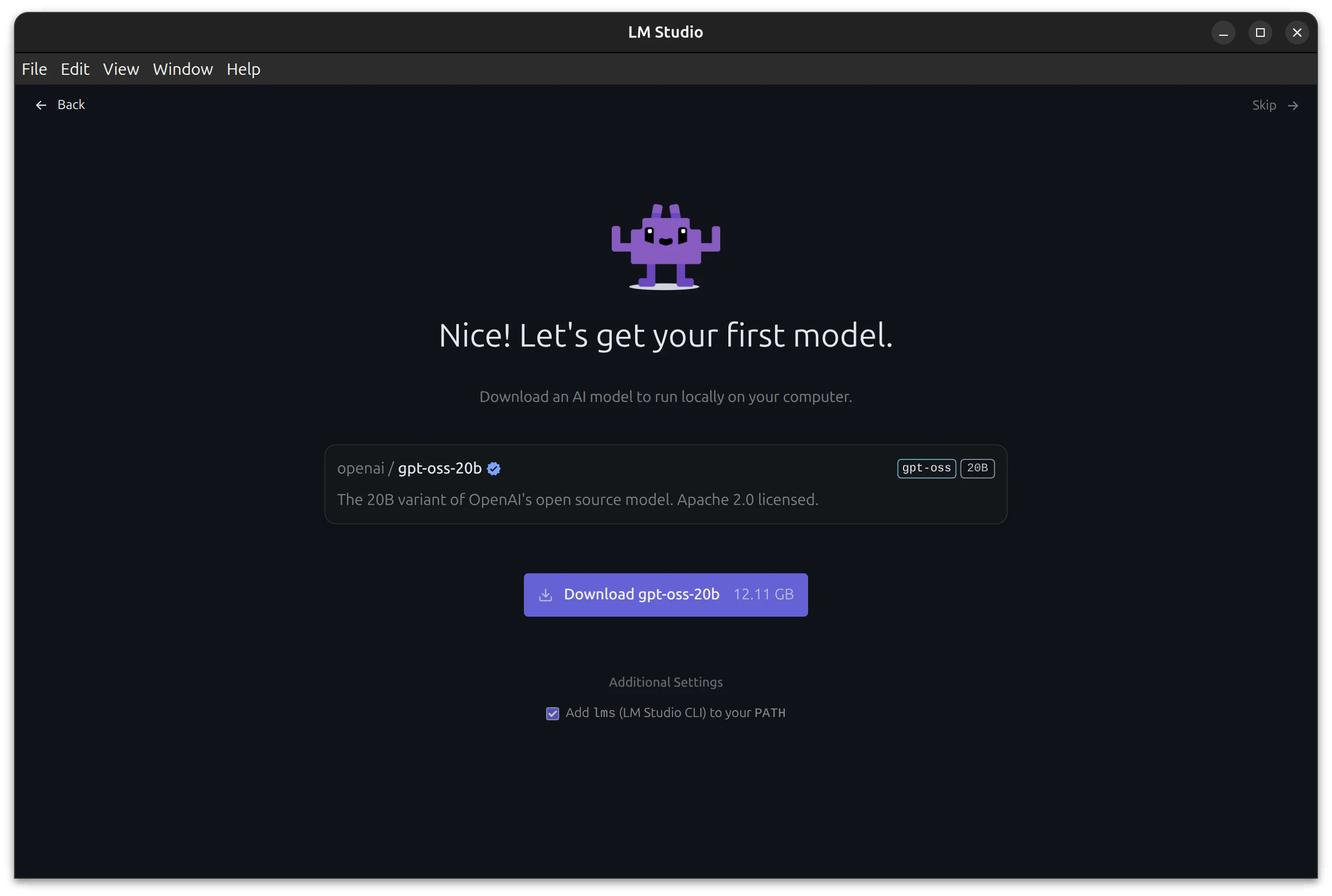

20Bモデル:openai/gpt-oss-20b

前回のRTX4080マシンで試してみたときと同様に、openai/gpt-oss-20bを最初のモデルとしておすすめされた。

せっかくだからこのモデルを選ぶぜ。

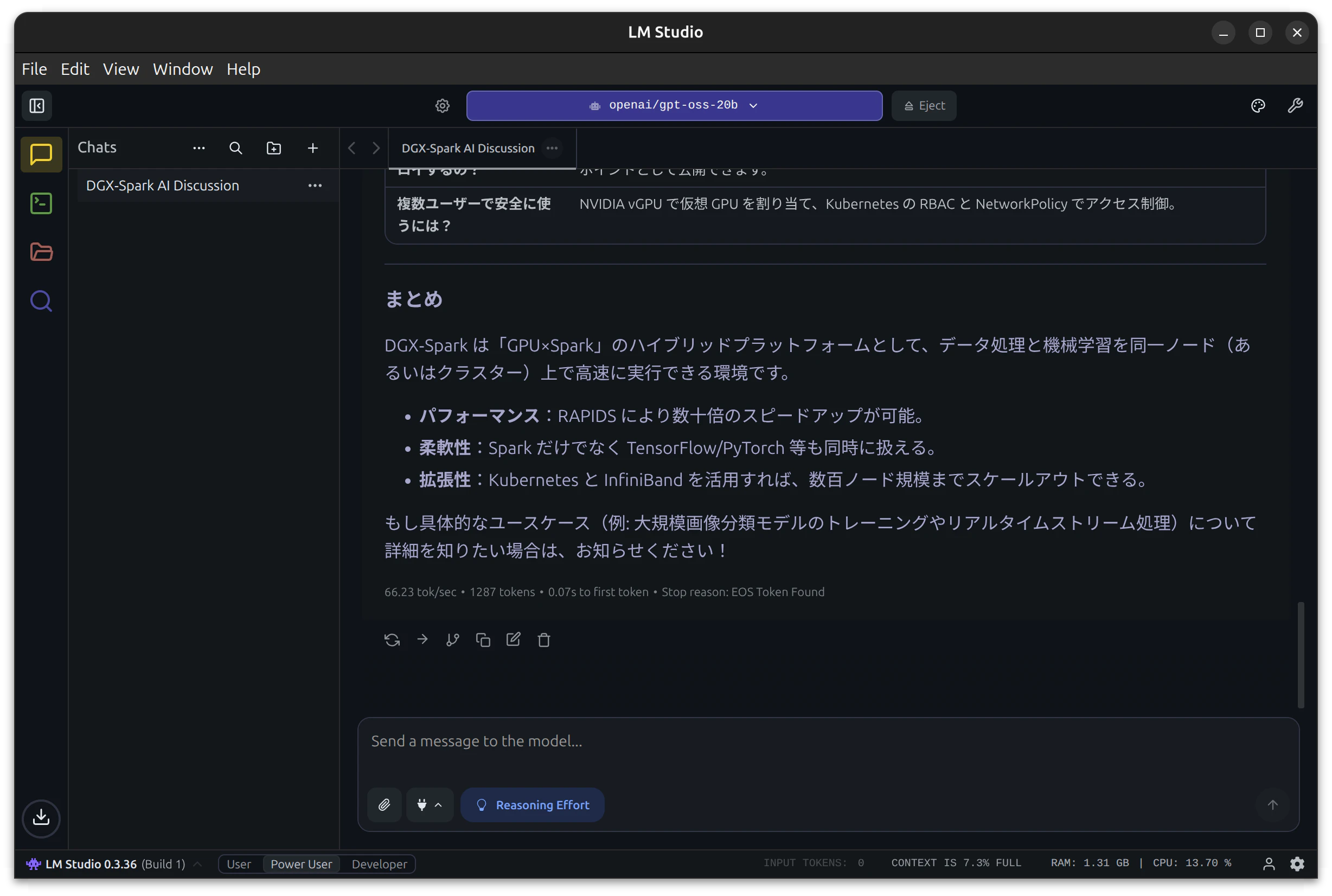

DGX Spark上でopenai/gpt-oss-20bで動かしてみると、こちらが入力してから反応するまでが一瞬。

67tok/secぐらい出て、非常に快適。

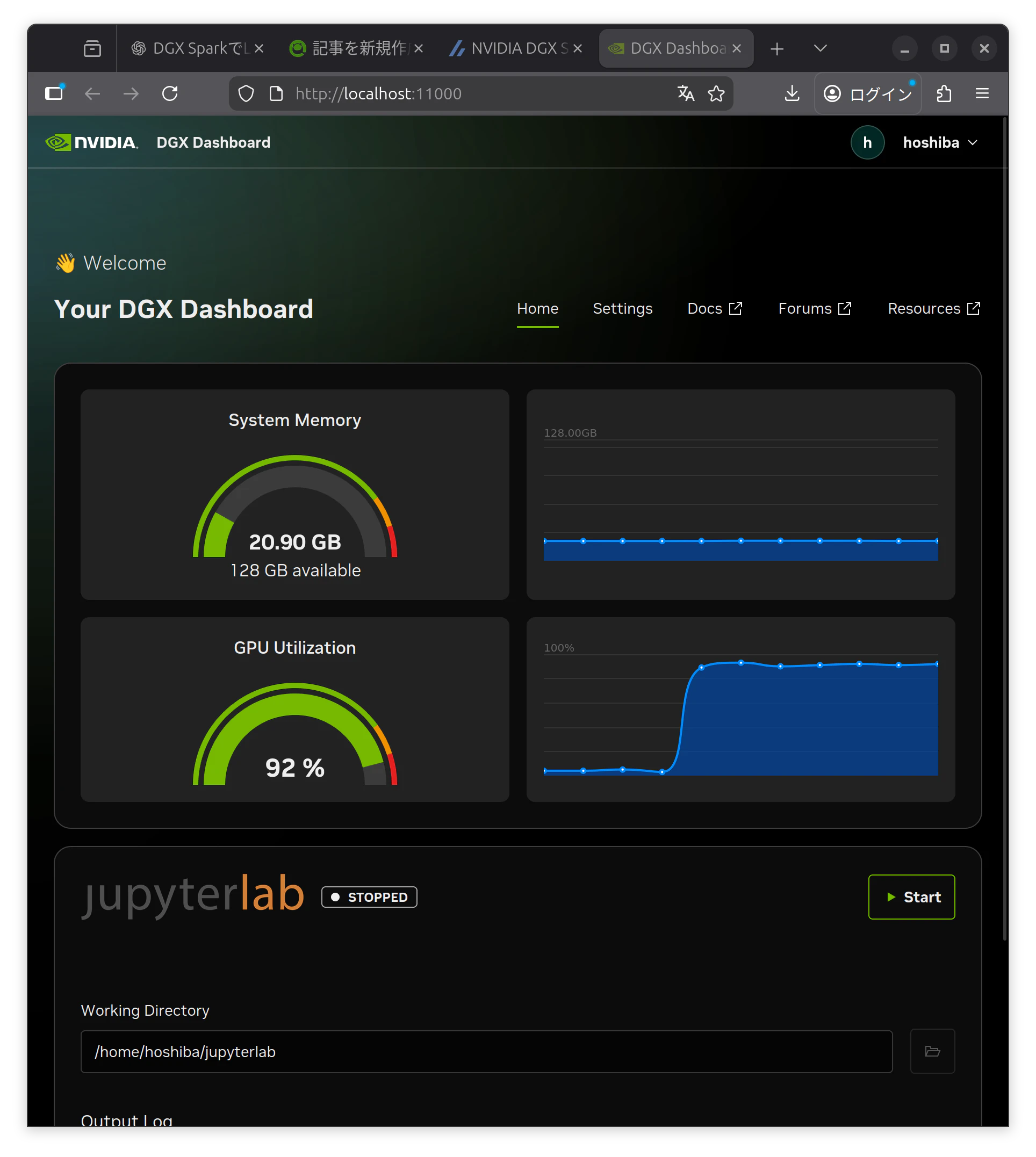

メモリ消費量は20/128GB。すでにRTX4080(僕が所有しているGPU)の16GBを超えているけど、まだまだ余裕。さすが80万円マシン!

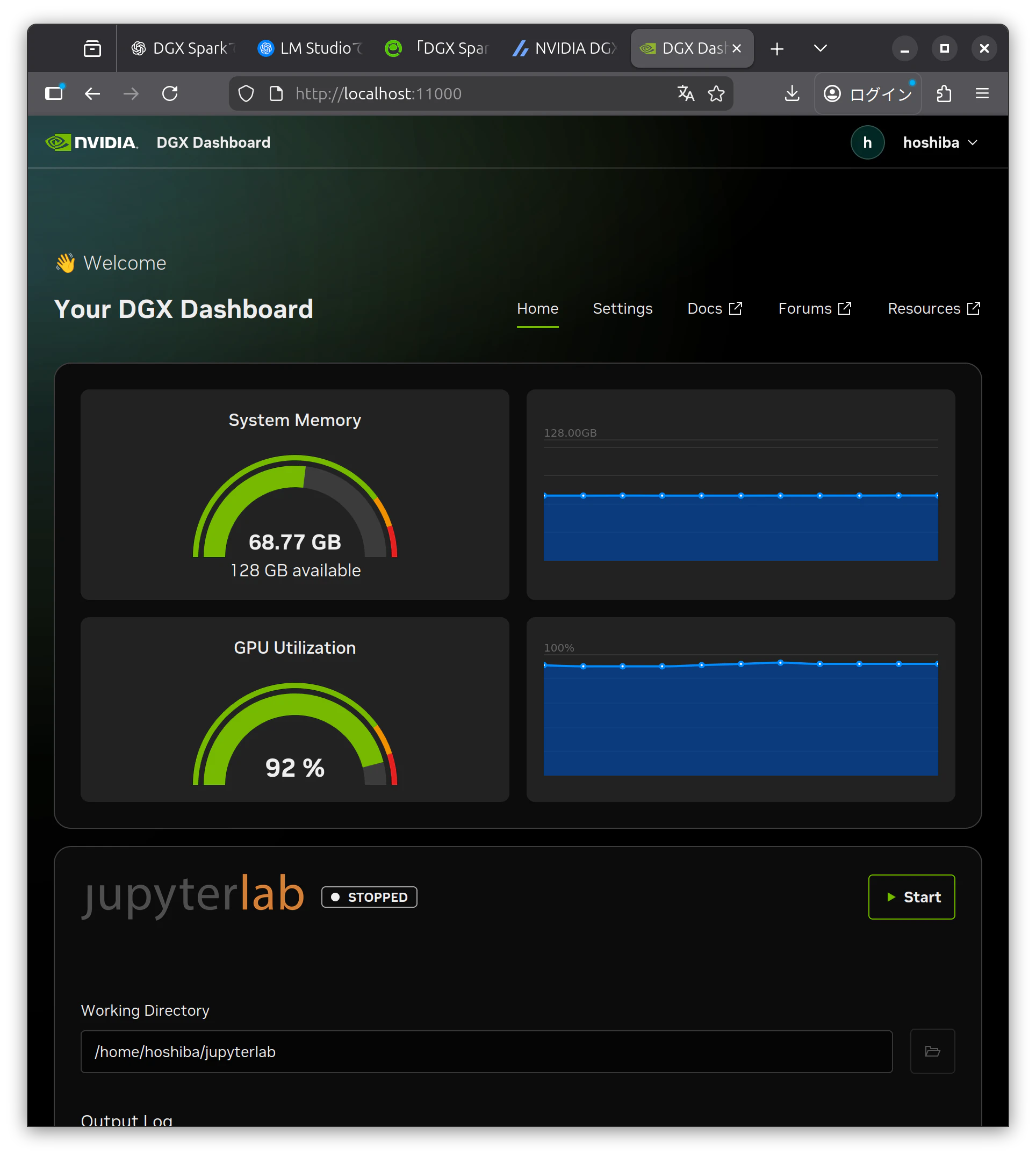

推論中のGPU使用率は90%以上。

120Bモデルopenai/gpt-oss-120b

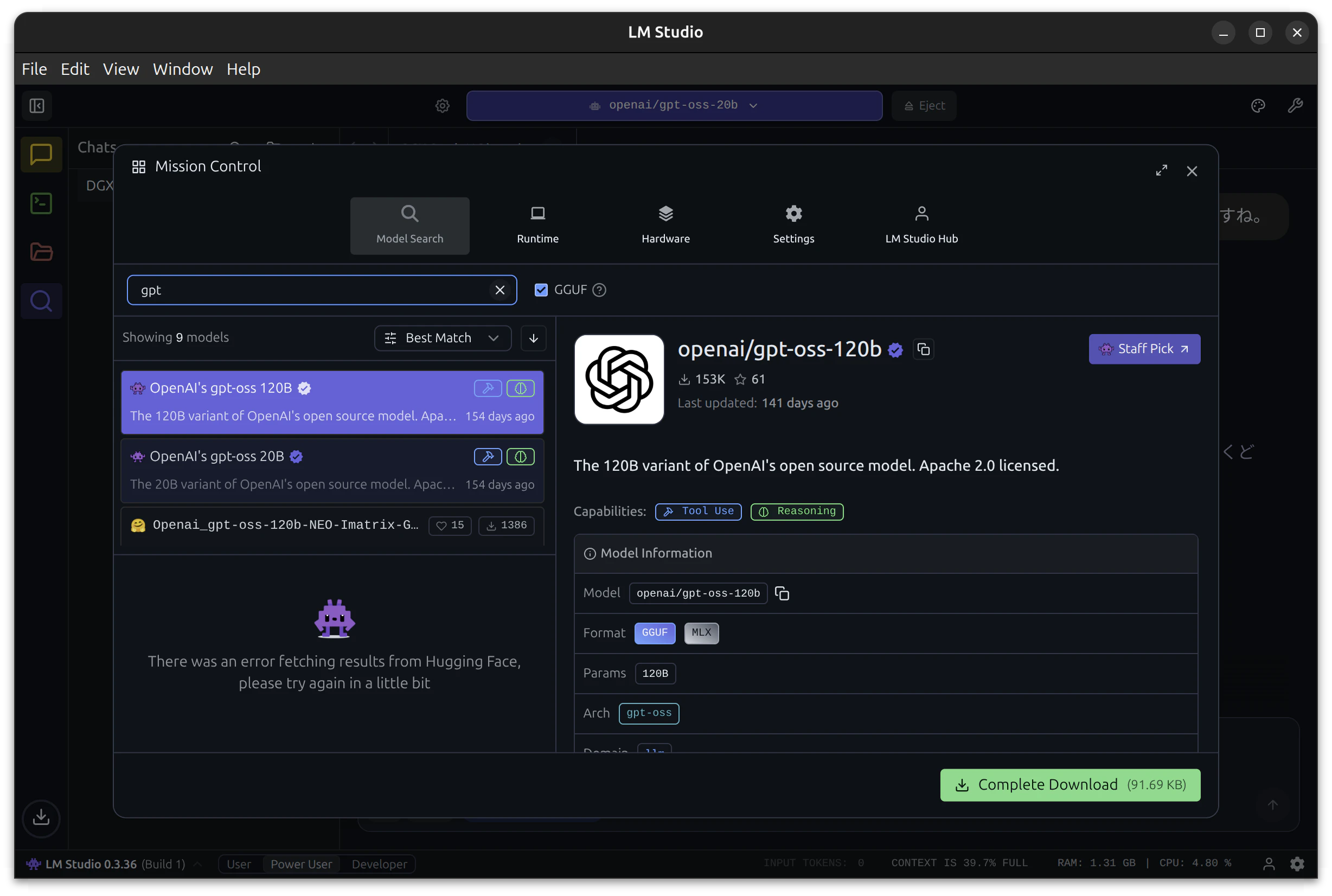

いよいよ120Bを試してみよう。openai/gpt-oss-120b。

って、なぜかこのGUIからダウンロードできないぞ!?

そんなときはターミナルから以下を実行するとダウンロードが始まる。

lms get openai/gpt-oss-120b

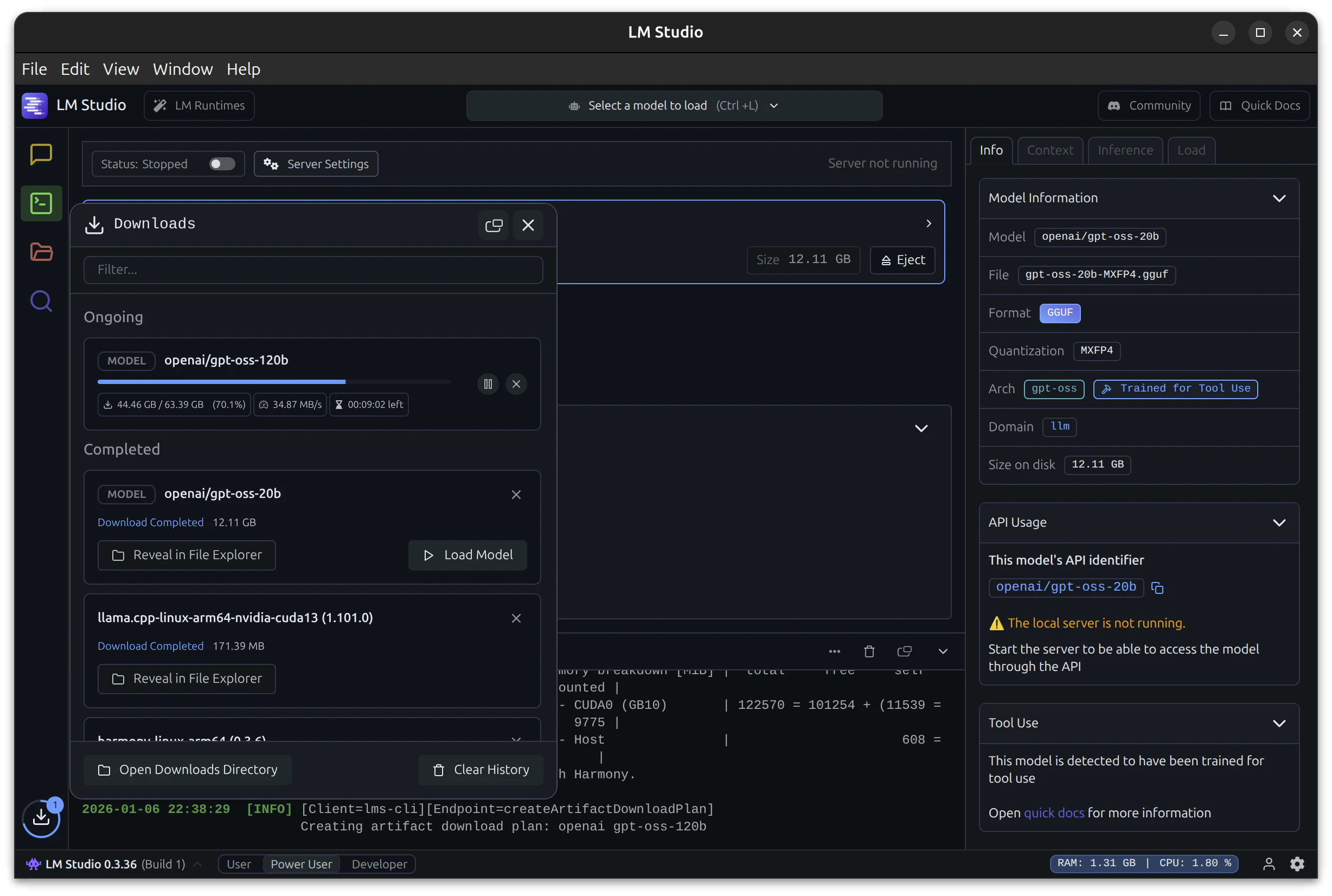

途中でダウンロードが止まったときは、GUIのダウンロード進行中画面で一時停止マークをクリックしてから、再開マークをクリックしてみよう。ダウンロード再開できた。

2回ほど再開を繰り返して、なんとかダウンロード完了。

openai/gpt-oss-120bモデルの読み込みには結構時間がかかる。

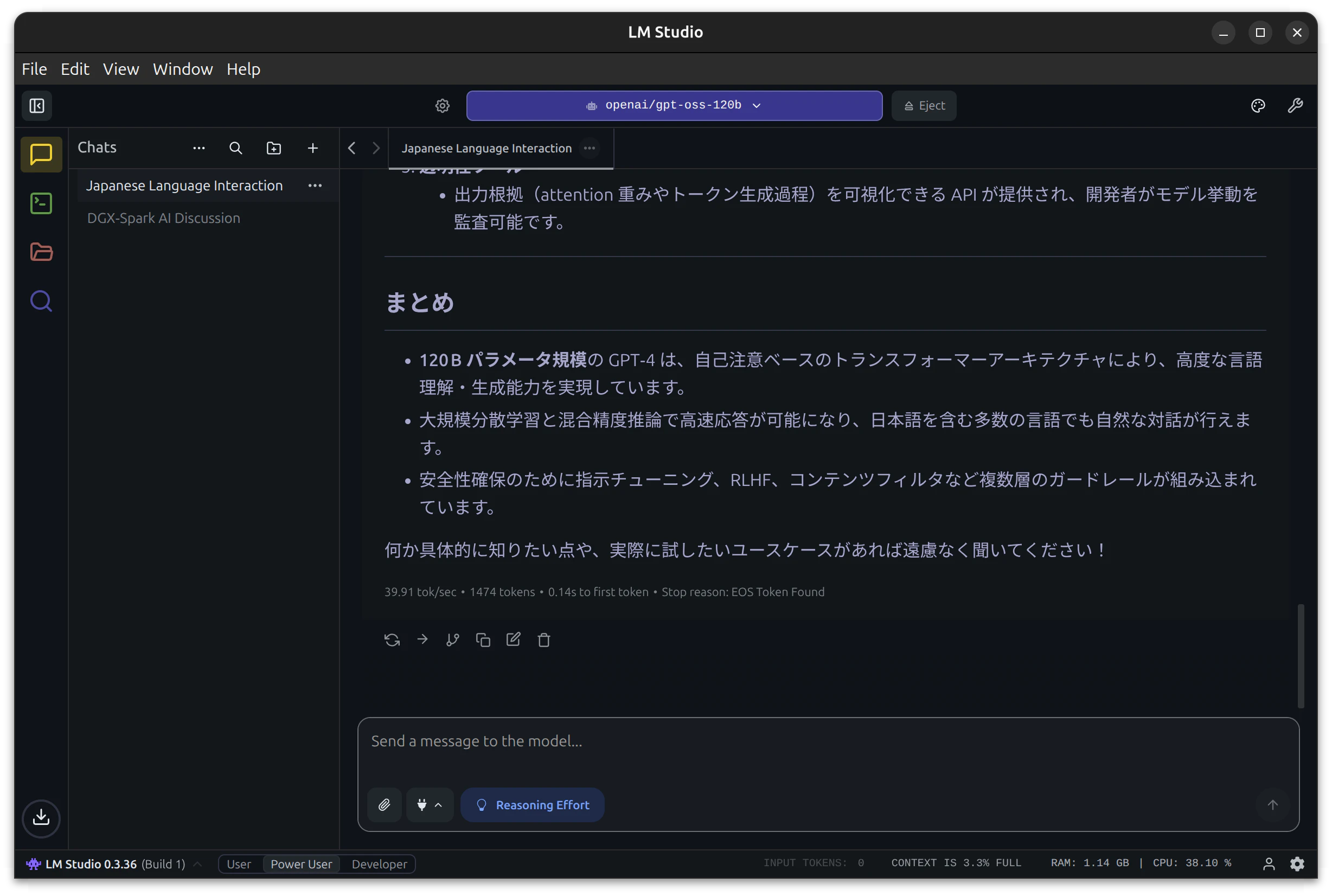

会話してみると、40tok/sec程度でサクサク動く。

openai/gpt-oss-120bをロードした状態で、メモリ使用率は69/128GB程度。まだ余裕があるね。すごい!

まとめ

- DGX Sparkの128GBの大容量統合メモリ(と量子化)のお陰で、120Bモデルもサクサク動いた。気持ちいい!

- メモリ的にはまだまだ余裕があるので、もっと大きいモデルを入れるとか、複数モデルを同時に使うとかできそう。大きなLLMですごいプロンプトを作ってもらって、そのまま画像生成モデルに投げるとか。夢が広がる。