Qwen3.5ローカル運用Tips 20選

自分用メモとして書きました。Qwen3.5をローカルで動かすときに知っておくと助かる実践的なポイントをまとめたもの。

1. MoEアーキテクチャの読み方を理解する

Qwen3.5はMixture of Experts(MoE)を採用している。モデル名の「122B-A10B」は「総パラメータ122B、アクティブパラメータ約10B」という意味。つまり推論時に実際に動くのは10B分だけなので、122Bフルモデルほどの計算資源は必要ない。同様に「35B-A3B」は総パラメータ35Bだがアクティブは3Bだけ。

このおかげで「パラメータ数の割にVRAMが少なくて済む」という大きなメリットがある。ただしモデルの重み自体は全パラメータ分をメモリに乗せる必要があるので、ストレージとメモリ帯域は相応に必要。

⚠️ この記事の情報は2026年3月時点のものです。 AI/LLM分野は変化が極めて速いため、モデル名・推奨設定・ベンチマーク値などは記事作成時点から変わっている可能性があります。最新情報は各公式ドキュメント等で確認してください。

2. Thinkingモードはデフォルトでオン — 簡単なタスクではオフにする

Qwen3.5はデフォルトでthinking(推論チェーン)が有効。単純な質問でも延々と考え込む「オーバーシンキング」が起きやすい。簡単なタスクや雑談用途ではthinkingをオフにすると速度が大幅に改善する。

ただしthinkingオフにすると品質は落ちるので、タスクの難易度に応じて切り替えるのが現実的。

3. LM Studioでthinkingを無効化する方法

LM Studioの場合、Chat Template Editorでenable_thinkingをfalseに設定する。GUIから簡単に切り替えられるので、thinking有効/無効を試しながら使うのに便利。

モデルのダウンロードもlms get unsloth/qwen3.5-27bのようにCLIから一発でできる。

4. アプリ側でthinkingを無効化する方法

OpenWebUIやSillyTavernなどのアプリ側では「Start Reply With」等の返答開始フィールドに以下を入れるとthinkingをスキップできる:

<think>

</think>

空のthinkingブロックをプリフィルすることで、モデルが思考フェーズを飛ばして直接応答を開始する。あるいは/no_thinkをプリフィルとして使う方法もある。

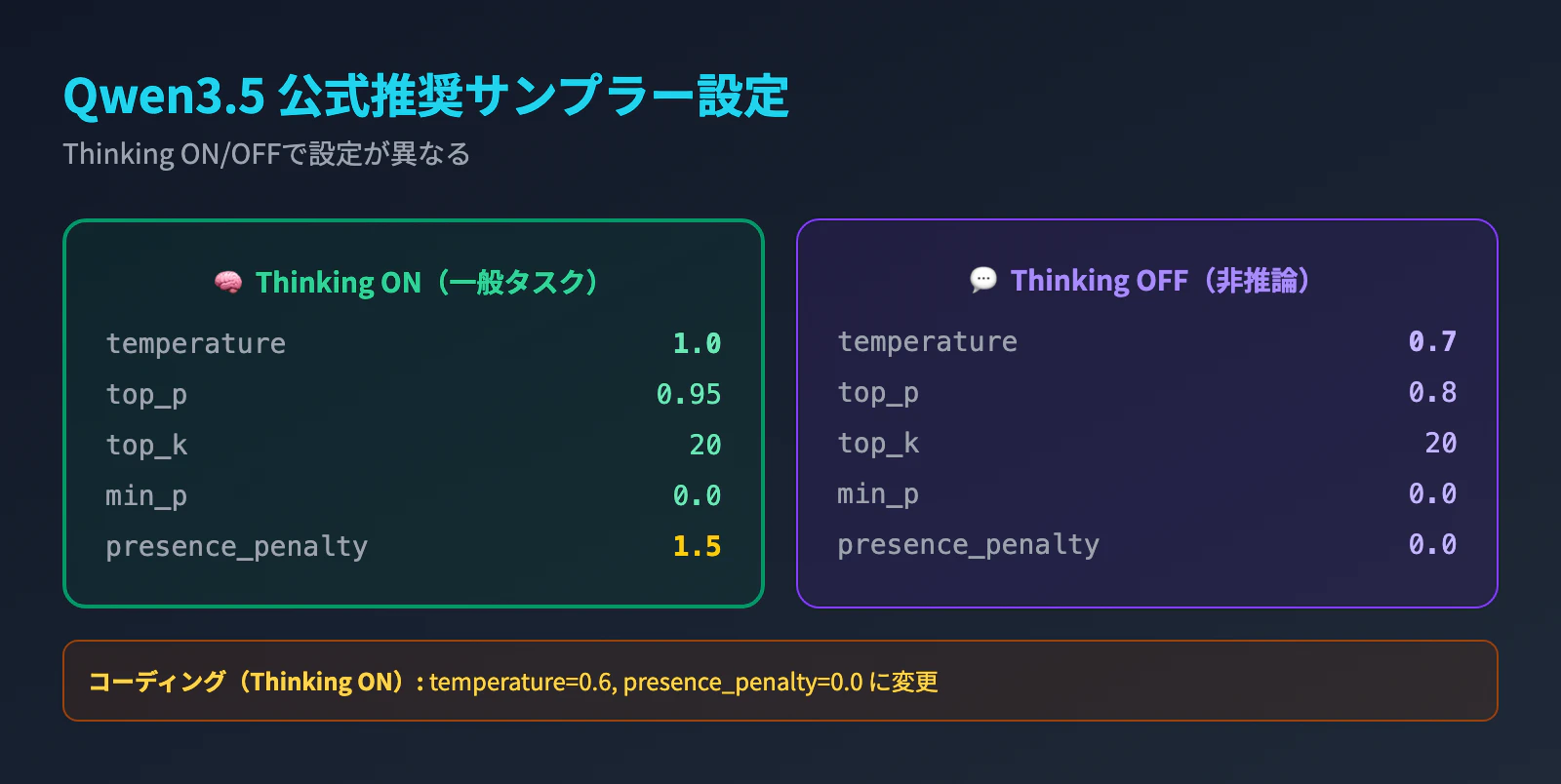

5. Thinking有効/無効で推奨サンプラー設定が違う

Qwen公式が推奨しているサンプラー設定:

Thinkingモード有効時:

- temperature: 1.0

- top_p: 0.95

- top_k: 20

- min_p: 0.0

- presence_penalty: 1.5

Thinkingモード無効時:

- temperature: 0.7

- top_p: 0.8

- top_k: 20

- min_p: 0.0

特にthinking有効時のpresence_penalty: 1.5は、推論ループを防ぐのに効果的。デフォルトのまま使うとループに入りやすい。

6. 量子化はQ4_Kがスイートスポット

ほとんどのユースケースでQ4_K系の量子化がバランスが良い。特にUnslothのUD-Q4_K_XLが評判が良い。

品質の序列としては:

- FP16 → FP8(ほぼロスレス) → Q8 → Q6_K → Q5_K → Q4_K(ここが実用ライン) → Q3 → IQ3_XXS

4-bit以下になると品質劣化が目立ち始めるが、VRAM制約がきつい場合はIQ3_XXSでも実用に耐える。

7. Unslothの量子化は最新版を使う

Unslothの量子化ファイルは初期バージョンでループ(同じ内容を繰り返す)問題が報告されている。必ず最新バージョンをダウンロードすること。HuggingFaceのファイル更新日を確認して、古いものを掴まないようにする。

問題が起きたらまずモデルファイルの再ダウンロードを試すのが定石。

8. KVキャッシュの量子化はBF16かQ8_0にする

KVキャッシュの量子化でVRAMを節約できるが、下げすぎると品質が崩壊する。特にreasoningモデルではKVキャッシュ品質の影響が大きい。

- BF16:推奨。品質劣化なし

- Q8_0:許容範囲。ほぼ劣化を感じない

- Q4以下:推論品質に影響が出る。特にthinkingモード使用時は避ける

長いコンテキストを使うほどKVキャッシュのVRAM消費が増えるので、コンテキスト長との兼ね合いで決める。

9. VRAM別おすすめモデルサイズ

MoEモデル(35B-A3B、122B-A10B)はアクティブパラメータが少ないので、同じVRAMでも密なモデルより大きいサイズが動く。

10. 35B-A3Bは低VRAMの救世主

35B-A3Bはアクティブパラメータがたった3Bなのに、35B分の知識を持っている。8GBのGPUでQ3_K_Sが動く上に、RTX 3050 8GBで128kコンテキストでも約20tok/sが出る。

リソースが限られた環境では最初に試すべきモデル。9Bの密なモデルより知識量が多く、推論速度も速い場合がある。

11. 122B-A10Bは「プロプラに近い」品質

Redditのr/LocalLLaMAコミュニティなどでは122B-A10Bが「クラウドモデルに迫る品質」と評価されている。48GB以上のVRAMがあるなら最有力候補。Q4_K_Mで動かせば実用的な速度が出る。

ただしDGX SparkでのINT4量子化で約25tok/sという報告もあり、ハードウェアによっては速度面で不満が出ることも。

12. ik_llama.cppでQwen3.5を高速化する

ik_llama.cppはQwen3.5に特化した最適化を含むllama.cppのフォーク。特に長いコンテキストでの速度が標準llama.cppより大幅に速い。ARM NEON向けのfused delta-netカーネルが実装されており、Apple Siliconでも恩恵がある。

122Bモデルを動かすなら標準llama.cppより先にik_llama.cppを試す価値あり。

13. バックエンド選びの指針

- LM Studio:GUI操作で楽。初めてローカルLLMを動かすならこれ

-

llama.cpp / llama-server:細かい制御ができる。コマンド例:

llama-server -hf unsloth/Qwen3.5-35B-A3B-GGUF:Q3_K_S --ctx-size 131072 --temp 0.6 --top-p 0.95 --top-k 20 --min-p 0.00 - vLLM:マルチGPU環境向け。テンソル並列・MTPに対応。27BでMTP有効時に105tok/sという報告も

- Ollama:導入が簡単だが、Qwen3.5アーキテクチャへの対応が遅れることがある。アップデート確認必須

- KoboldCPP:動くがQwen固有の最適化は少ない

速度を重視するならllama.cppをソースからビルドするのがOllamaより速い。

14. 速度ベンチマーク(参考値)

MoEモデルはアクティブパラメータが少ないので、同サイズの密なモデルよりtok/sが高く出る傾向。

15. マルチGPUでの運用

デュアルRTX 3090(合計48GB)が人気の構成。vLLMのテンソル並列やパイプライン並列を使って分割する。

vLLMはテンソル並列のサポートが成熟しているので、マルチGPUならvLLMを第一候補にすると良い。llama.cppもマルチGPU対応しているがセットアップがやや面倒。

16. チャットテンプレートによるコンテキストキャッシュミスに注意

Qwen3.5のチャットテンプレートは、前のターンの<think>ブロックを除去する仕様。そのため毎ターン、KVキャッシュが無効化されてコンテキスト全体を再処理することになる。

長い会話ではこれが速度低下の原因になる。回避策としてはthinkingを無効にするか、テンプレートを改変して思考ブロックを保持する方法がある(ただし保持するとコンテキスト消費が増える)。

17. リピート・ループ問題への対処

Qwen3.5では同じフレーズを繰り返す「ループ」が報告されている。対処法:

- サンプラー設定を見直す:presence_penalty を1.5に設定(thinking有効時)

- Unslothの最新版に更新:古い量子化ファイルでループが発生しやすい

- llama.cppを最新ビルドに更新:繰り返し問題のパッチが入っていることがある

- KVキャッシュ量子化を上げる:Q4以下のKVキャッシュで挙動が不安定になる場合がある

それでも直らない場合はモデルサイズを上げるか、量子化レベルを上げてみる。

18. 検閲はアーキテクチャレベルで組み込まれている

Qwen3.5の検閲(セーフティフィルタ)はモデルのアーキテクチャレベルで深く組み込まれており、プロンプトだけでは完全に回避できない。

コミュニティではいくつかのアプローチが試されている:

- Abliterated版:特定のレイヤーを無効化した派生モデル

-

Derestricted版:

Qwen-3.5-27B-Derestrictedなど -

蒸留版:

Qwen3.5-9B-Claude-4.6-Opus-Uncensored-Distilledのように、非検閲モデルから蒸留したもの

特定の人格を持たせるようなロールプレイ用途にはAbliterate + 軽いfinetuneの組み合わせが推奨されている。ただしこれらは非公式の派生モデルなので品質にばらつきがある。

19. Mac / Apple Siliconでの運用

Qwen3.5-27BはMacBook Proで動作する。選択肢として:

- ik_llama.cpp:ARM NEONの最適化が入っているので速い

- MLX版:Apple Silicon向けに最適化されたMLXフォーマットが利用可能

- LM Studio:Mac版があり、GUIで手軽に動かせる

M5 Maxでのベンチマーク報告もあり、Apple Siliconのユニファイドメモリを活かせば大きめのモデルも動かせる。VRAM(=メモリ)が多い構成ほど有利。

20. AMD GPU(ROCm)は注意が必要

AMD GPUでROCmを使う場合、Qwen3.5の一部モデルが起動しないケースが報告されている。対処法としてはVulkanバックエンドへのフォールバックが挙げられている。

AMD環境で動かすなら、まずllama.cppのVulkanバックエンドを試してみるのが安全。ROCm対応は改善途上なので、安定性を重視するならNVIDIA GPUのほうが無難。

モデルやツールのアップデートで状況が変わる可能性があるので、最新情報はHuggingFaceやGitHubで確認してください。