1. 概要

Point Cloudの3次元点群情報から3次元物体の表面を正確に再構成する技術を提案している。従来技術では、3次元ボリュームの特徴空間でImplicit Learning(学習時にモデルに明示的な教師を与えずに入力と出力の関係性を自動でモデル化させる手法)が用いられたが、例えばスカートの揺れなど動的に変化する物体は表現できなかった。

2. 新規性

この研究では、非剛体の3D表面を効率的にモデリングするために、明示的に教師されるポイントベースのコンピュータグラフィックスの技術と、Implicit Learningで暗黙的にモデル化される動的モデリング技術を組み合わせる”Dynamic Point Fields”を提案している。

3. 実現方法

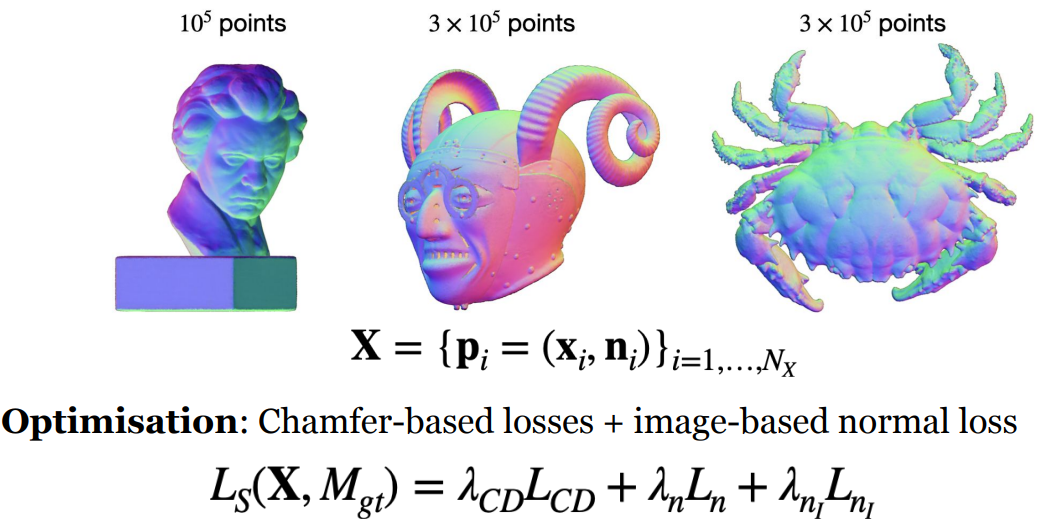

Point Cloudの3次元点群から、Chamfer-based Loss(点群や3次元モデルの生成や復元タスクでよく用いられる損失関数)と画像特徴ベースのLossを組み合わせて、モデリング時にChamfer距離を用いて生成された点群やモデルと目標となる真の点群やモデルとの間の距離を評価する。

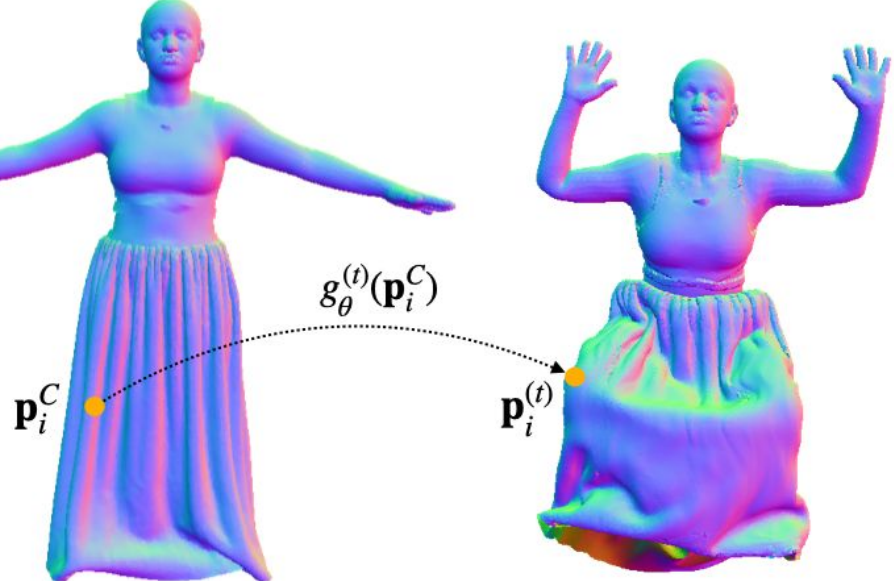

3次元物体の表面の動的な変化をモデル化するために、Implicit Deformationを採用しており、各点とその関連する特徴量を持つ点群を新しい位置にマッピングするためにコンパクトなニューラルネットワークを用いている。このマッピング手法では、点ごとの個別変形手法がニューラルネットワークによって暗黙的にモデル化されており、動的な物体表面の汎化を効率的かつ柔軟にモデル化することが可能となった。

4. 結果

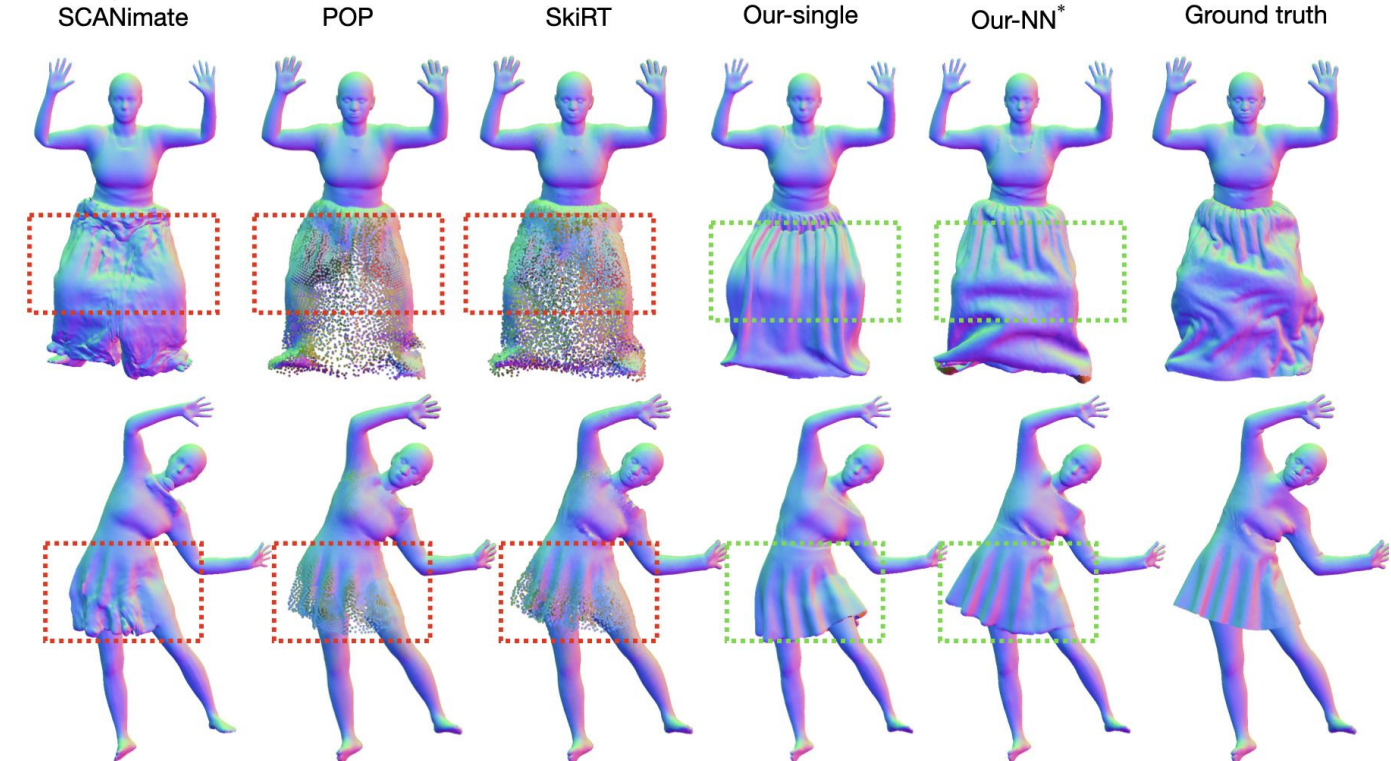

従来手法では、例えば長いスカートなど複雑な衣類の外観に対処する際にモデルの表現力が制限されていたが、提案手法では非剛体の表現力や学習効率などが各段に向上しており、新しいポーズに対する頑健性が向上している。

last updates: Oct 10 2023