1. 概要

通常のニューラルネットワークは入力データと出力データの間の明示的な関係を学習するが、その中間表現を学習する手法のことをImplicit Neural Representations(INRs)と呼ぶ。INRsではデータを表現するための関数そのものを学習するのではなく、その関数を生成するためのパラメータを学習することが特徴となっている。従来手法では各学習データセットごとにMLPを学習する方法が一般的だったが、この研究ではモダリティの異なるデータセットに対しても共通する表現を学習することでより一般化を図っている。

2. 新規性

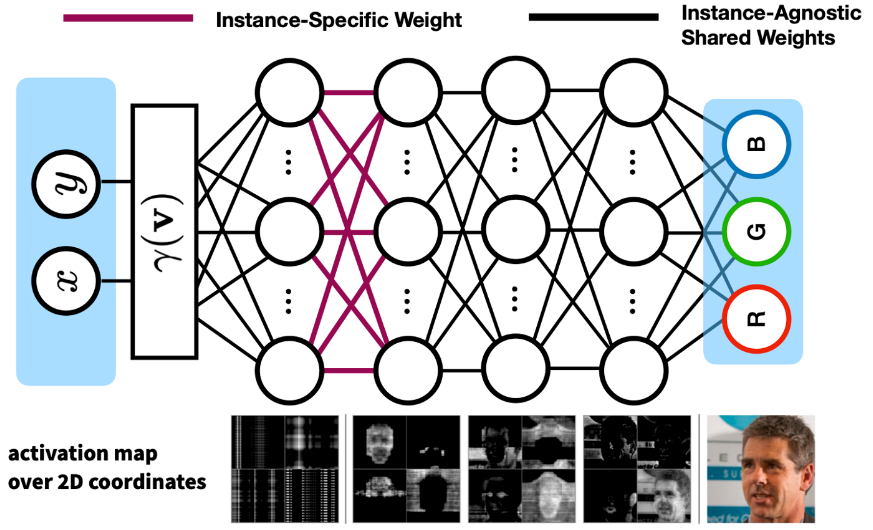

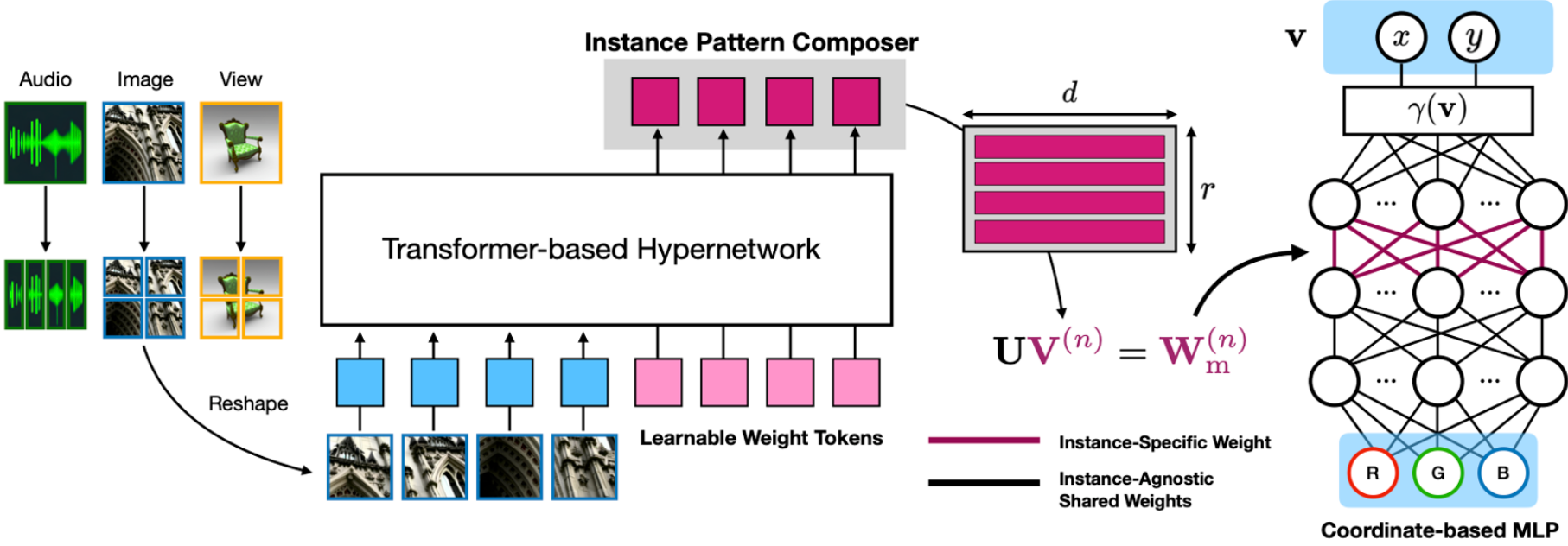

各学習データセットに固有の特徴はINRsの第二レイヤーで獲得できることを特定した。より汎用的なINRsモデルを学習するために、データセット間に共有される表現を学習しMLPの中間特徴や重みをチューニングする手法を提案している。特に、第二レイヤーの一つの重み行列だけをチューニングすることで、汎化性を持ったINRsを実現した。

3. 実現方法

ベースラインにはトランスフォーマーを使用し抽出した中間表現を行列の要素分解し、第二レイヤーのデータセットやインスタンスに依存する重みをチューニングする。残りの重みは、データセットやインスタンスに依存しない特徴を学習する。

4. 結果

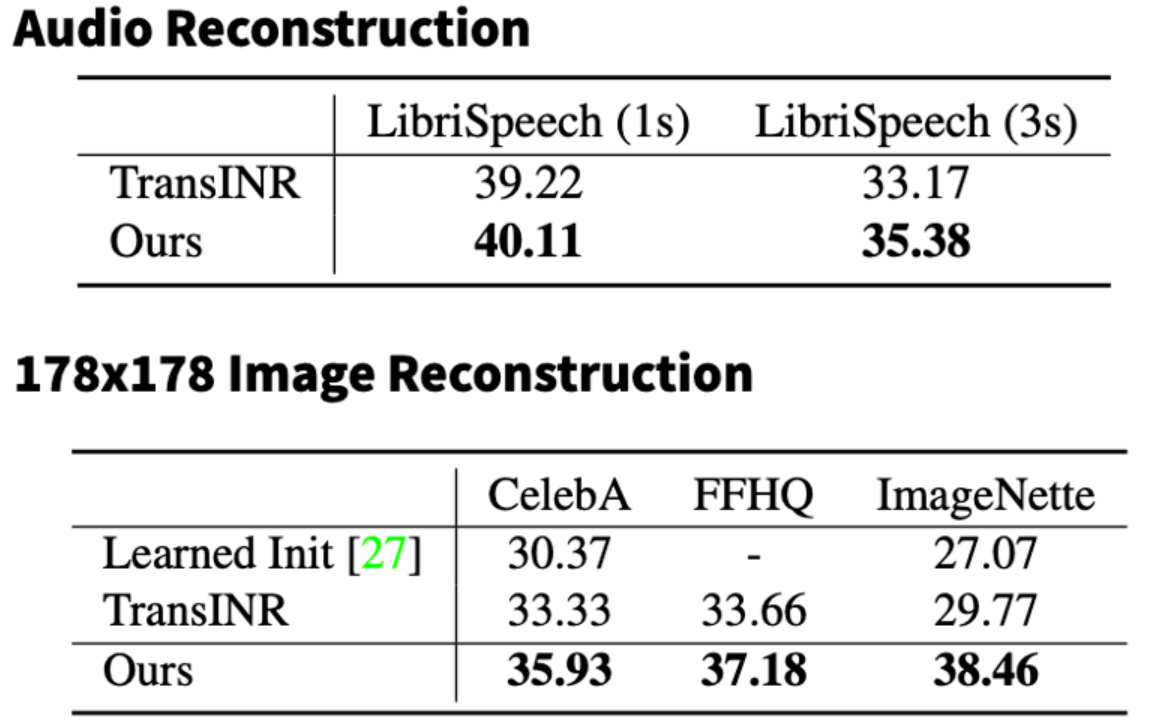

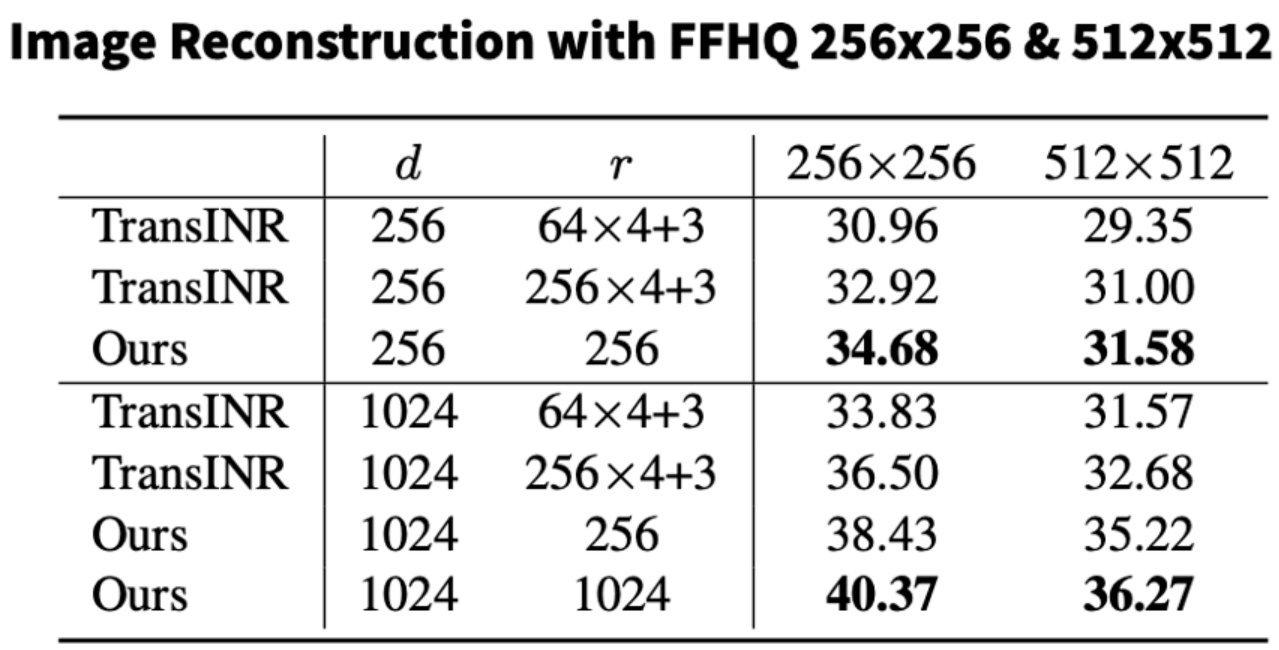

音声、画像、3Dモデルなどの様々なドメインで高いパフォーマンスを達成しており、第二レイヤーだけの重みを調整する効果を検証している。

last updates: July 3 2023