StreamDiffusion: A Pipeline-level Solution for Real-time Interactive Generation

好きで読んでまとめるだけなので、研究的な視点の不備が多数ある場合あります。

画像生成系で2023年の末ごろに大きな話題になっていたもの。

日本人の方が発表されているの論文で、Youtubeでご本人の解説動画まであります(日本語だし、最高すぎる)。

概要

論文では、リアルタイムの対話型画像生成を実現するための新しいディフュージョンパイプライン「StreamDiffusion」を紹介している。従来のディフュージョンモデルはテキストや画像プロンプトからの画像生成には優れているけど、リアルタイムのインタラクションには対応しきれていない。特にメタバースやビデオゲームのグラフィックスレンダリング、ライブビデオストリーミングなどのシナリオでは高いスループットが求められる。

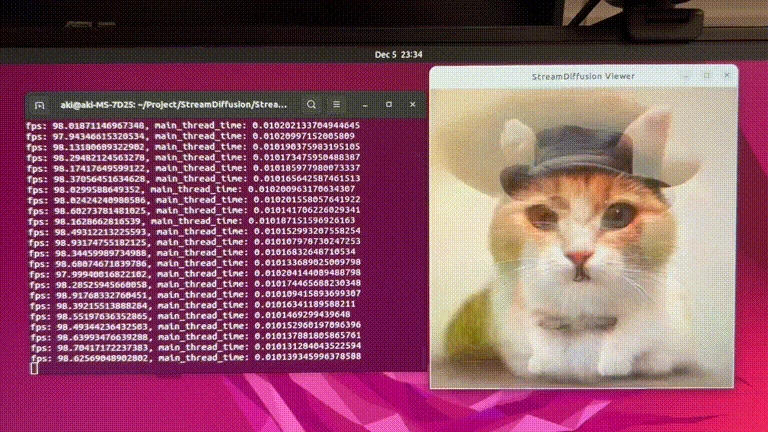

早すぎて、、、すごすぎ

提案手法

StreamDiffusionは、以下の技術を組み合わせることで高いスループットとエネルギー効率を実現している:

-

ストリームバッチ処理:

- 従来の逐次的なノイズ除去処理をバッチ処理に変換。

- ノイズ除去ステップをバッチで処理することで、処理時間を大幅に短縮。

-

Residual Classifier-Free Guidance (RCFG):

- クラス分類器を用いないガイダンス手法を改良し、負の条件付けによる冗長な計算を削減。

- 一回またはゼロ回の負の条件付けで済む新しいアルゴリズムを提案。

-

入力-出力キュー:

- 入力データとモデルの処理スループットの不一致を解消するためのキュー戦略を設計。

- 非同期処理により、画像の前処理と後処理を並列化。

-

確率的類似性フィルタ:

- GPUの使用率を最適化し、エネルギー消費を削減するための確率的類似性フィルタリング戦略を採用。

-

モデル加速および小型オートエンコーダー:

- TensorRTを利用してU-NetとVAEエンジンを構築し、推論速度を向上。

- 高速かつ効率的な小型オートエンコーダーを使用。

この辺のアイディアを他のdiffusion研究にも流用することができたら非常に有用

実験結果

提案されたStreamDiffusionパイプラインは、以下のような結果を示している:

- RTX 4090 GPUでの画像生成において91.07fpsを達成。

- 従来のAutoPipelineと比較して、最大59.6倍のスピードアップを実現。

- 静的なシーン入力では、RTX 3060 GPUで2.39倍、RTX 4090 GPUで1.99倍のエネルギー消費削減を達成。

結論

StreamDiffusionは、インタラクティブなディフュージョン生成を実現するためのパイプラインレベルのソリューション。高いスループットとエネルギー効率を提供することで、メタバースやオンラインビデオストリーミング、放送などの分野での実用性を大幅に向上させることができる。

この論文の内容は、リアルタイムの画像生成における効率性とエネルギー消費の最適化に関するもので、特にインタラクティブなアプリケーションにおいて非常に有用。