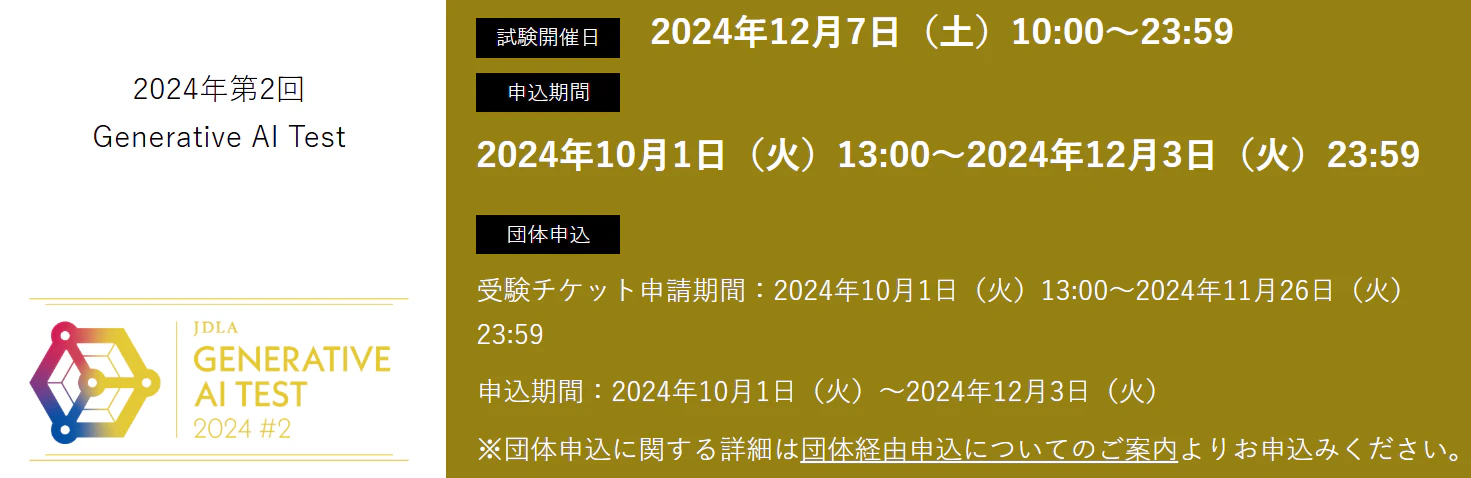

昨日、12/7(土)が「JDLA Generative AI Test 2024 #2」の開催日でした。

若干、止め時を逃した感はありますが、今回も受験をしてきましたので、受験期をおこしておきます。

「JDLA Generative AI Test」とは?

日本ディープラーニング協会が主催する、生成AIのスキルを評価するためのミニテストです。

自身のスキルを客観的に評価し、合格するとオープンバッジがもらえて自信を持てる、そんなテストになっています。

今回は第4回目の開催となります。

勉強法などの対策は第3回の記事に詳しく書いてありますので、対策をされたい方はそちらをご参照下さい。

【過去の試験の受験記】

第1回(2023年6月) https://qiita.com/t_horumon/items/56c9b16c17bc8e7b3b3a

第2回(2023年12月) https://qiita.com/t_horumon/items/12db83fabd9c15fbe7a8

第3回(2024年6月) https://qiita.com/t_horumon/items/267264b20e2f9741bccb

https://www.jdla.org/certificate/generativeai/

試験形式の変更点

前回の試験からは、レギュレーションは全く変更がございませんでした。

| 2023#1 | 2023#2 | 2024#1 | 2024#2 | |

|---|---|---|---|---|

| 受験資格 | どなたでも受験可能 | どなたでも受験可能 | どなたでも受験可能 | どなたでも受験可能 |

| 試験時間 | 15分 | 20分 | 20分 | 20分 |

| 試験形式 | 択一式/多肢選択式 20問 | 択一式/多肢選択式19問、記述式1問 | 択一式/多肢選択式19問 ・ 記述式1問 | 択一式/多肢選択式19問 ・ 記述式1問 |

| 受験費用 | 2,200円 | 2,200円 | 2,200円 | 2,200円 |

| 申込期間 | 2023年6月7日~2023年6月20日(14日間) | 2023年10月16日~2023年11月28日(1ヵ月半) | 2024年4月1日~2024年6月4日(2カ月) | 2024年10月1日~2024年12月3日(2カ月) |

シラバスの変更点

シラバスは、最近の状勢を踏まえたキーワード修正のみ、数点ございました。

微修正の良いレベルでして、シラバスも大きな変更はないと言って良いかと思います。

| 区分 | 項目 | 2023#2変更点 | 2024#1変更点 | 2024#2変更点 |

|---|---|---|---|---|

| 生成AIの技術(特徴) | 大規模言語モデルにおける生成の仕組みを理解している。 | キーワードに"Chain-of-Thought"が追加 | ||

| 大規模言語モデルの性能評価について知っている。(リーダーボード、ベンチマーク) | 項目から新規追加 | |||

| 生成AIの技術(動向) | 大規模言語モデルのオープン化の動向と原因について理解している。 | キーワードに"推論の効率化"を追加 | キーワードの"推論の効率化"を"量子化や蒸留による推論の効率化"に変更 | |

| 大規模言語モデルの性能を決める要素の動向と原因について理解している。 | キーワードに"LoRA"を追加 | |||

| 生成AIの利活用(動向) | 生成AIの新たな活用方法を生み出すためのアプローチを理解している。 | キーワードから"ハッカソン"を削除 | ||

| 業界に特化した生成AIの活用方法を理解している。 | キーワードに"LLMを利用したサービス(ChatGPT・Bardなど)"、"RAG (Retrieval-Augmented Generation)の利用"、"エージェント・コード生成"、"外部ツール呼出し"を追加 | キーワードに"Claude"を追加 | キーワードを変更("Bard"→"Gemini"、"RAGの利用"→"RAGの利活用"、"エージェント・コード生成"→"エージェント""ソフトウェア開発"、"広告クリエイティブへの応用"→"クリエイティブへの応用") | |

| 生成AIのリスク(特徴) | 生成AIが、技術面・倫理面・法令面・社会面などで多様なリスクを孕むことを理解している。 | キーワードに"悪用、誤情報の拡散"、"敵対的プロンプト"、"特定の生成AIサービスへの依存"、"環境問題"が追加 | キーワードの"敵対的プロンプト"を"プロンプトインジェクションなどの敵対的プロンプト"に変更 |

所感

レギュレーションやシラバスに変更点があまりないことからわかるように、試験自体の問題傾向や難易度は安定してきたように思います。(4回も受けると、良くも悪くも、おっと思うような問題はなくなっています)

逆に言えば、最新のニュースを追わないと解けないような問題は減ってきており、個人的には、世の中に付いていけているかを確認するために受けていたので、少し寂しく感じております。

定点観測の目的は自身と世の中の認識のギャップ確認でしたので、そろそろその役割を終えるタイミングかなぁと思いつつあります。

そりゃそうですよね、生成AIの用途は多種に及ぶようになってきており、利用者の幅も広がっていますので、受験者全体がおっと思うような問題はもう作りにくいですよね。

難易度としては、前回と求められる知識レベルはさほど変わらない印象です。

一時よりも意地悪な問題が減って素直な問題が多く、その点で解きやすかった印象があります。

慣れもありますが、素直な問題だった分だけ時間に余裕があり、選択式19問で10分、記述式で4分、見直し6分って感じでした。

やはり記述式は、あらかじめ練習する必要はないかと思いますが、どれくらいの文量を何分で書くのかのイメージは持っておくべきでしょう。

参考(2024#1のシラバス)

生成AIの技術

| 項目 | 確認点 | キーワード |

|---|---|---|

| 特徴 | テキスト、画像、音声等の生成モデルに共通する技術的な特徴を俯瞰して理解している。 | 確率モデル、ハルシネーション (Hallucination) |

| 大規模言語モデルの基本構造を理解している。 | 基盤モデル、言語モデル、大規模言語モデル (LLM)、トランスフォーマー (Transformer)、アテンション (Attention)、GPT-3 | |

| 大規模言語モデルにおけるモデルの学習方法を理解している。 | 教師あり学習、自己教師あり学習、事前学習、ファインチューニング | |

| 大規模言語モデルのアラインメントを理解している。 | アラインメント (Alignment)、人間のフィードバックによる学習 、インストラクション・チューニング (Instruction Tuning) | |

| 大規模言語モデルにおける生成の仕組みを理解している。 | コンテキスト内学習 (In-Context Learning)、Zero-Shot、Few-Shot、Chain-of-Thought、サンプリング手法 | |

| 大規模言語モデルの性能評価について知っている。 | リーダーボード、ベンチマーク | |

| 動向 | テキスト、画像、音声等の生成モデルの技術動向を俯瞰して理解している。 | 条件付き生成、拡散モデル (Diffusion Model) |

| 大規模言語モデルのオープン化の動向と原因について理解している。 | オープンコミュニティ、オープン大規模言語モデル、オープンデータセット、オープンソース、量子化や蒸留による推論の効率化 | |

| 大規模言語モデルの性能を決める要素の動向と原因について理解している。 | スケーリング則 (Scaling Laws)、データセットのサイズ、データセットの質、モデルのパラメーター数、計算資源の効率化、LoRA、GPU | |

| 大規模言語モデルのマルチモーダル化の動向と原因について理解している。 | マルチモーダル | |

| 大規模言語モデルの外部ツール・リソースの利用の動向と原因について理解している。 | 学習データの時間的カットオフ、大規模言語モデルの知識、大規模言語モデルの不得意タスク |

生成AIの利活用

| 項目 | 確認点 | キーワード |

|---|---|---|

| 特徴 | 生成AIには何ができるのかを理解している。 | ケイパビリティ |

| 生成AIをどのように使うのかを理解している。 | 活用事例 | |

| 生成AIの性能を拡張する使い方を理解している。 | プロンプトエンジニアリング | |

| 動向 | 生成AIの新たな活用方法を生み出すためのアプローチを理解している。 | 自主的なユースケース開発、インターネット・書籍、活用の探索 |

| 生成AIの活用を制限する要因を理解している。 | 生成AIの学習データ、生成AIの性能評価、生成AIの言語能力 | |

| 業界に特化した生成AIの活用方法を理解している。 | LLMを利用したサービス (ChatGPT, Gemini, Claude など)、RAG (Retrieval-Augmented Generation)の利活用、エージェント、ソフトウェア開発、外部ツール呼出し、クリエイティブへの応用、ドメイン固有 |

生成AIのリスク

| 項目 | 確認点 | キーワード |

|---|---|---|

| 特徴 | 生成AIが、技術面・倫理面・法令面・社会面などで多様なリスクを孕むことを理解している。 | 正確性、ハルシネーション (Hallucination)、セキュリティ、公平性、プライバシー、透明性、悪用、誤情報の拡散、プロンプトインジェクションなどの敵対的プロンプト、特定の生成AIサービスへの依存、環境問題 |

| 生成AIの入力(データ)と出力(生成物)について注意すべき事項を理解している。 | 著作権、個人情報、機密情報、商用利用、利用規約 | |

| 動向 | 生成AIについて、現時点では認識されていない新たなリスクの出現とそれに伴う規制化の可能性を理解している。 | 新たなリスク、規制化、情報収集 |

| 生成AIの活用に伴うリスクを自主的に低減するための方法を把握している。 | 自主対策 |