はじめに

流行りのChatGPTなどのLLMを使ったデモアプリを簡単に作れる方法としてGradioを用いて検証したので、備忘録的にまとめます。

開発環境

- python3.9

- langchain

- gradio

- Google Colab

想定読者

- LLMを使った簡単なアプリを作りたい人(langchainの詳細な技術については省略します)

- Gradioを使った機械学習アプリを作成したい人

- Google Colabなどを使って、LLMの機能検証を行い、アプリ化しようとしている人

やりたいこと

- いい感じのインターフェースでデモアプリを作りたい

- デモのインターフェースとしてnotebook環境は万人受けしない

実行コード

必要な手続き

- Google検索のAPIキー作成

- OpenAIのAPIキー作成

- https://openai.com/blog/openai-api にアクセスし、ログイン(アカウント未発行の場合、作成)

- APIをクリック

- 画面右上の【Personal】をクリック

- 【View API keys】から【Create new Secret key】を実行

- APIキーの名前を入力し、コピーする。【sk-XXX】の文字列がAPIキー

- huggingfaceのアカウント作成

- Gradioで作成したアプリをデプロイするのに必要

- https://huggingface.co/ からアカウント作成

デモ実行

作成したAPI情報をコピー、貼り付け

from langchain.agents import load_tools, initialize_agent, Tool, AgentType

from langchain.utilities.google_search import GoogleSearchAPIWrapper

from langchain.chat_models import ChatOpenAI

import gradio as gr

import os

os.environ["OPENAI_API_KEY"] = "XXXXX"

os.environ["GOOGLE_API_KEY"] = "YYYYY"

os.environ["GOOGLE_CSE_ID"] = "ZZZZ"

ログを出力

(なくても問題ない)

from logging import getLogger

logger = getLogger(__name__)

LLM検証機能

今回はグーグル検索を活用して、生成を行ってもらいたいため、グーグル検索のツールを利用

他にも色んなツールがあるので、LLMの利用用途に応じて利用してください。

def search_llm(query: str, model_name: str):

llm = ChatOpenAI(temperature=0, model=model_name)

google_search = GoogleSearchAPIWrapper()

search_tools = [Tool(

name = "Google Search",

func=google_search.run,

description="最新の話題について答える場合に利用することができます。また、今日の日付や今日の気温、天気、為替レートなど現在の状況についても確認することができます。入力は検索内容です。"

),]

search_agent = initialize_agent(search_tools, llm, agent=AgentType.ZERO_SHOT_REACT_DESCRIPTION, verbose=True)

search_result = search_agent.run(f"{query}")

return search_result

Gradioアプリ関数

関数名と入力、出力の内容が重要

関数内の処理は適宜変更してよい

def app(query: str, model_name: str):

search_result = search_llm(query, model_name)

logger.info(search_result)

return search_result

アプリ実行

デモアプリのインターフェース上にテキストでの説明を付与可能

title : str = "デモアプリ"

description : str = "このデモンストレーションは、Gradio(ユーザーインターフェースのライブラリ)を使用しています"

article : str='''このデモンストレーションは、ユーザーインターフェースを作成するためのPythonのライブラリであるGradioを使用しています。

'''

先ほどアプリ化した関数を実行するインターフェースを設計

- fnにアプリ化する関数名

- inputsに該当する関数の入力。今回は自由入力のテキストとOpenAIで利用するChatモデルの種類の2つを入力。

- outputsに該当する関数の出力。今回はテキストのみが出力。

- examplesに入力例。chache_examplesと併用することで、1クリックでexamplesの実行結果を確認できる。

iface1 = gr.Interface(

fn=app,

inputs=[

gr.Textbox(lines=1, placeholder="query Here"),

gr.Dropdown(["gpt-3.5-turbo-16k", "gpt-4", "gpt-4-0613"]),

],

outputs=["text"],

cache_examples=True,

examples=[

["ChatGPTでできること", "gpt-3.5-turbo-16k"],

["ChatGPTでできること", "gpt-4-0613"],

["日本で一番高い山", "gpt-4-0613"],

],

title=title,

description=description,

article=article

)

- queue()を入れることで、実行時間による処理停止がなくなるため、処理時間がかかるものには入れるのがおすすめ。

- launch()でアプリを実行します。

- Google Colabの場合、share=Trueにすることで、URLを使えば、他端末からデモを確認可能。

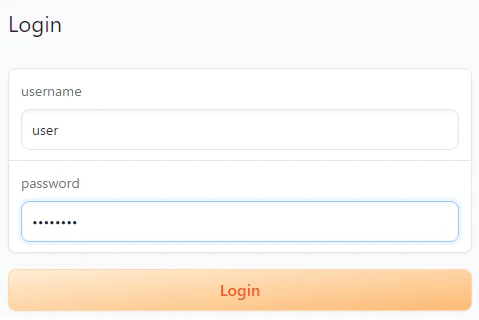

- authに認証を入れることで、利用者を限定可能。例ではusername=user、password=passwordを入力することでデモにログインできる。

iface1.queue()

iface1.launch(share=True, auth=("user", "password"), debug=True)

デモ画面

この画面でuserとpasswordを入力

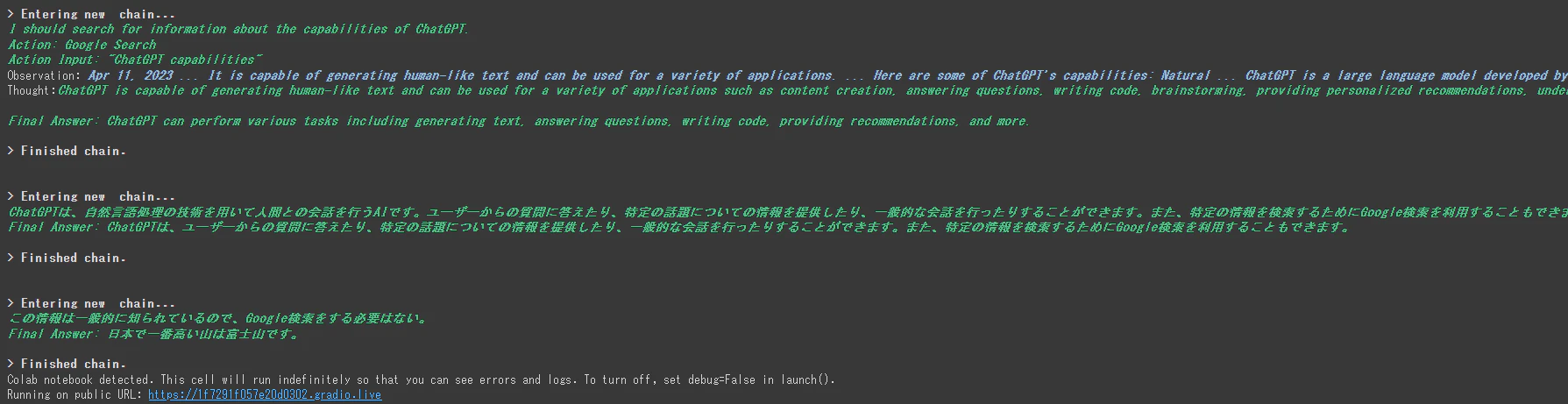

アプリ実行時にexamplesの内容が実行されます

デモ実行

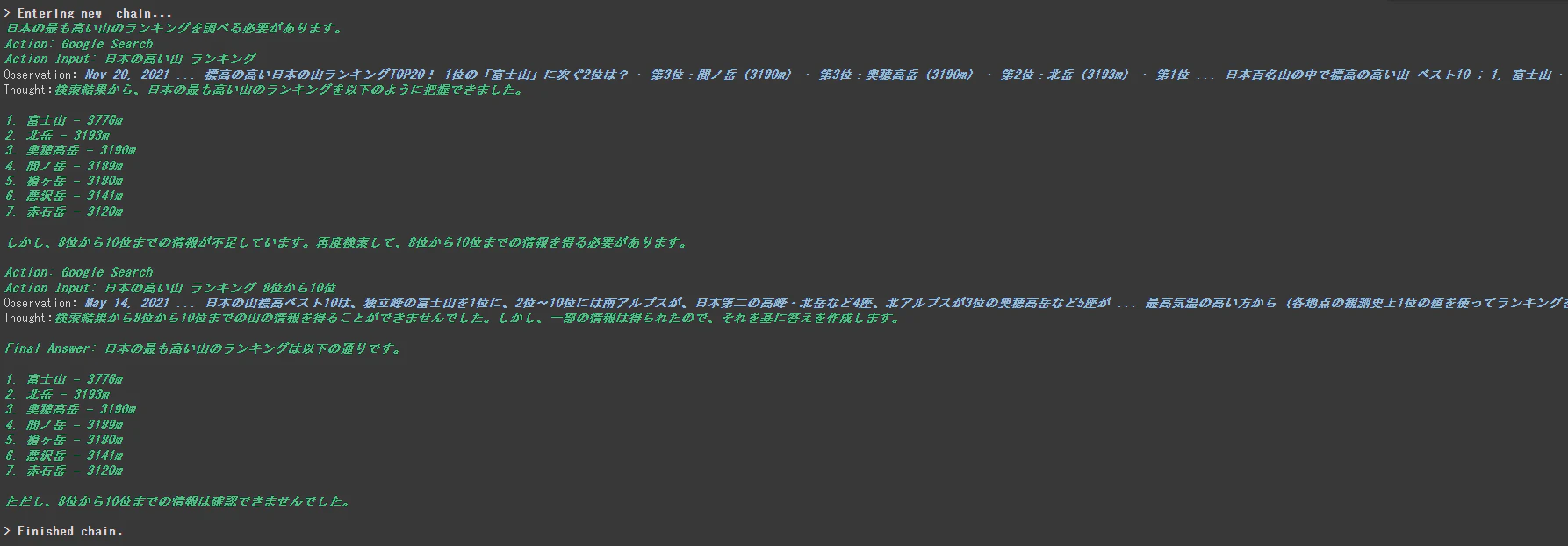

examplesを見る限り、日本で一番高い山は周知の事項のようなので、1位から10位までを教えてもらいましょう。

結果として、1位~7位までしか分からなかったようです...が、不足している情報を補うような検索クエリの試行をしています。

これはlangchainで指定したagentの中にあるプロンプト内に答えが出るまで繰り返し実行するようになっているためです。(場合によっては何回かやって結果が出ないとエラーメッセージが出ます)

デプロイ

アプリの機能は上手くできていることが確認できたので、デプロイしましょう。

- https://huggingface.co/spaces からCreate new Spaceをクリック

- 適切な内容を入力後、Create Space(一部除いて後からでも変更可能)

- spacesの内容をgit cloneし、app.pyとrequirements.txtを該当のリポジトリに格納

- commitとhuggingfaceのアカウントでpushの実行