ディープラーニングを勉強していて、ベクトルの表現や、線形結合などの概念に詰まって気持ち悪かったので、まとめてやっつけます!

目次

1 ベクトル基礎1 (ディープラーニング学習に関わりの深いベクトル基礎知識)

2 ディープラーニングへの応用

3 ベクトル基礎2 (より、ベクトルの理解を深める)

ベクトル基礎1

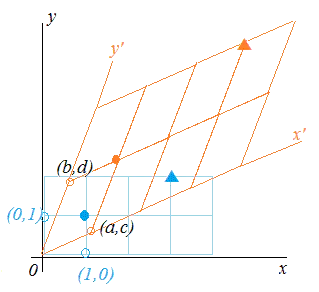

一次変換(線形変換) ・・ある点に行列を掛け算し、別の点に移動させる。 (ベクトルの方から見た数学的な定義)

つまり、値を変換するということです。

線形(linear)とは、”直線にする”と言う意味

つまり、 入力x に対して、出力y(u)を求めるプロセスとして、 y(u) = wx + b の形にして求めるということ。

ここで,y(u)は線形変換の結果出力されるもの。つまり隠れ層に渡すされる出力の値。

なぜuが出てくるかいというと、いきなり入力 x→y を求めてしまっては、ディープラーニングでもないんでもないただの関数と同じなので。

<重要用語>

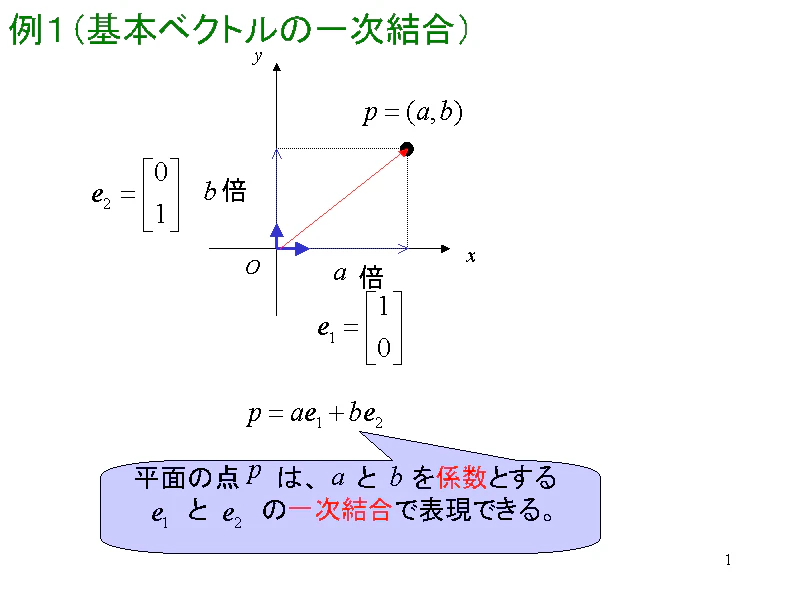

基底 ・・ 全体を表現するのに、必要最低限のベクトル (※基本ベクトルともいう)

線形結合 ・・いくつかのベクトル(or関数)がある時、それぞれの定数倍したものの和

※ 2次元空間は互いに平行でないベクトルが2つあれば、その線形結合で全ての平面を表すことができる

線形空間(ベクトル空間)とも呼ぶ

<ベクトルを使う意味・心得>

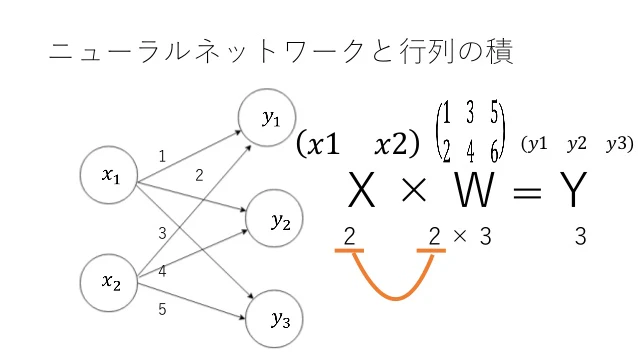

機械(コンピューター)が扱う数字の形式の中で、相性というものが有る。

機械の大好物が処理が早い表現が行列(orベクトル)です。

これにより、GPUの処理を高速にできるので、ディープラーニングには必須の知識となっています。

画像もRGBの数値で表せるので、結局相性が良いいのは、行列(ベクトル)です。

この1次方程式 (y = wx + b)は、行列で表すことができるので、

1次方程式ではなく、機械が好きな行列で表現しましょう! という感じです。

まとめ

① 入力層→隠れ層のフェーズ

【目的 (x→u) を求める】

1次方程式 u = Wx + b

② 1次方程式の出力→活性化 フェーズ (ニューロンが発火するかしないか、決める = 0,1か決める)

【目的 (u→z)を求める】

非線形関数 (ex sigmoid,Relu)

③ 出力フェーズ (マシンが最終的な数値(答え)を発表するフェーズ)

目的 (z→y) を求める

ベクトル基礎2

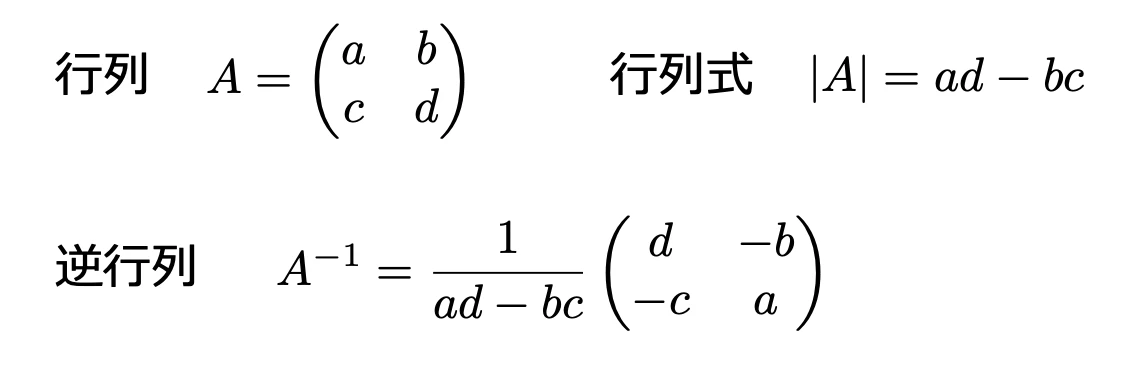

逆行列と行列式

逆行列

逆行列は 元の行列と掛け合わせると、単位行列となる行列

行列式(determinant)

行列式は上で定義される式です。

<ポイント>

1 行列式 = 0 の時、 逆行列は存在しない。

2 行列式 ≠ 0 の時、 逆行列が存在する

ここで、一次変換の話です。