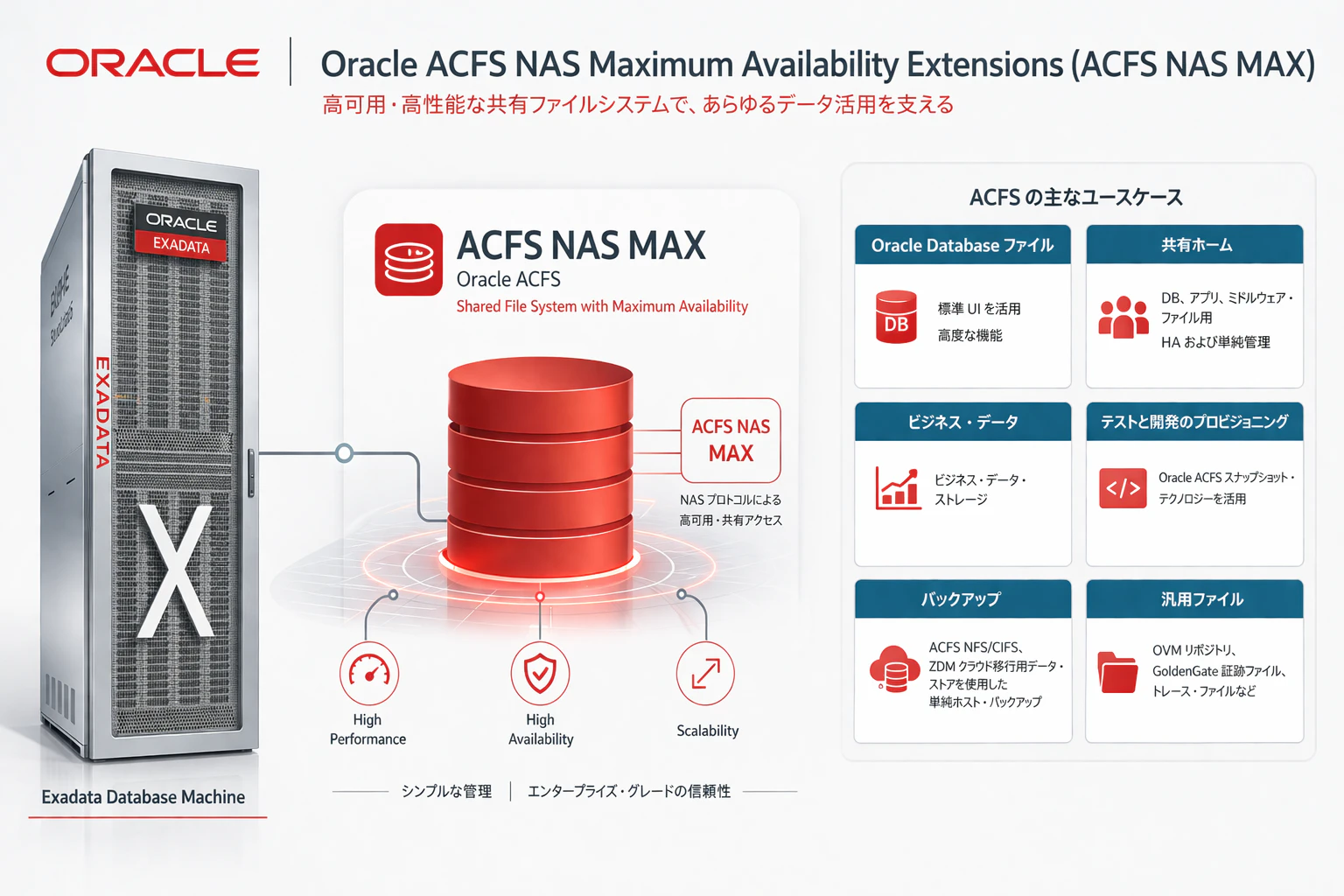

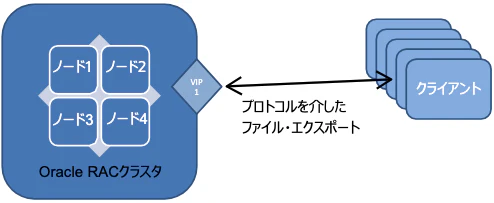

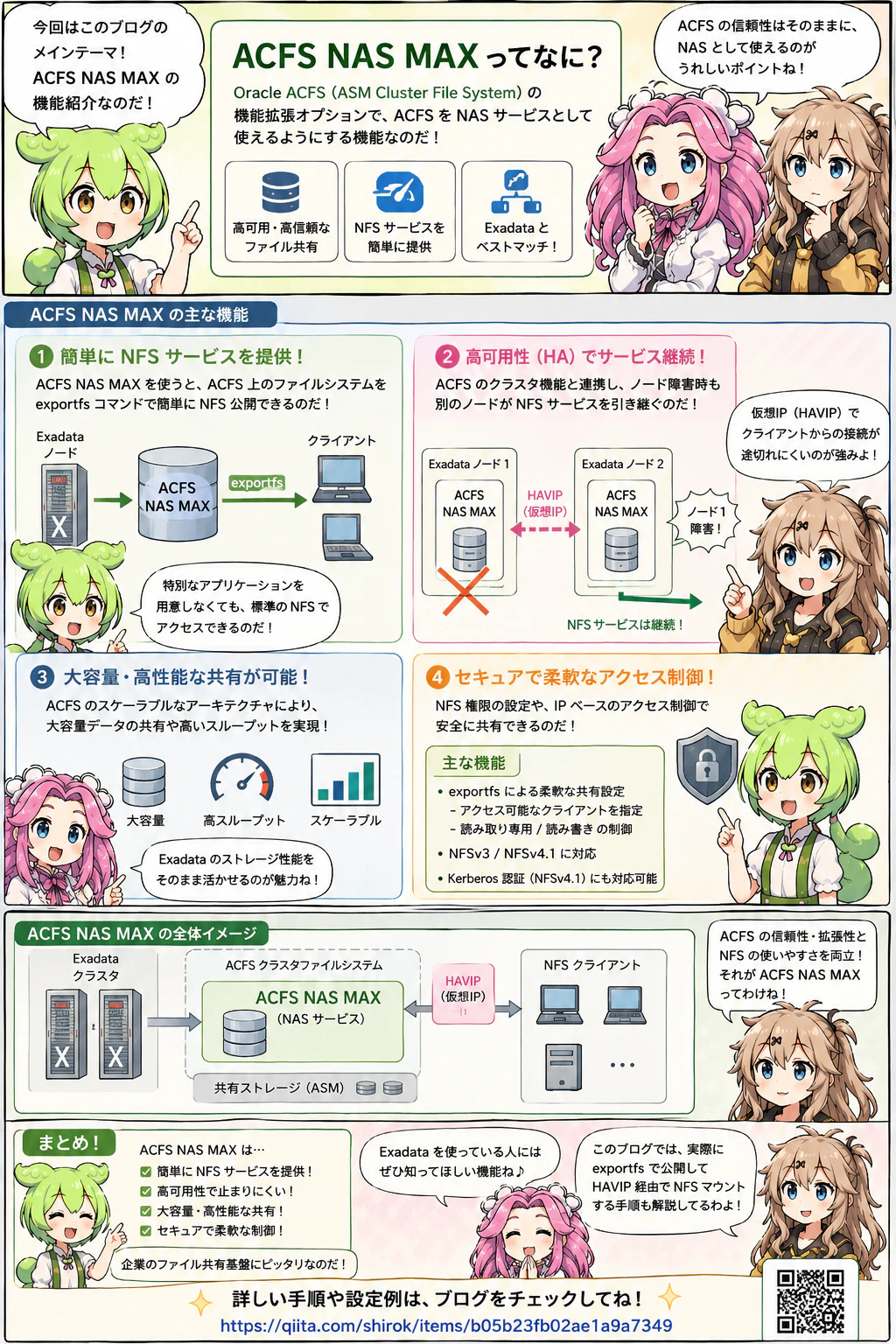

Oracle ACFS NAS Maximum Availability eXtensions(Oracle ACFS NAS MAX) は、Oracle ACFS 上で NFS や SMB の共有を高可用化できる機能です。

Oracle RAC クラスタ内で VIP とエクスポートをクラスタ管理できるため、ノード障害時や再配置時にも、クライアントは同じ仮想IP経由で継続してアクセスできます。

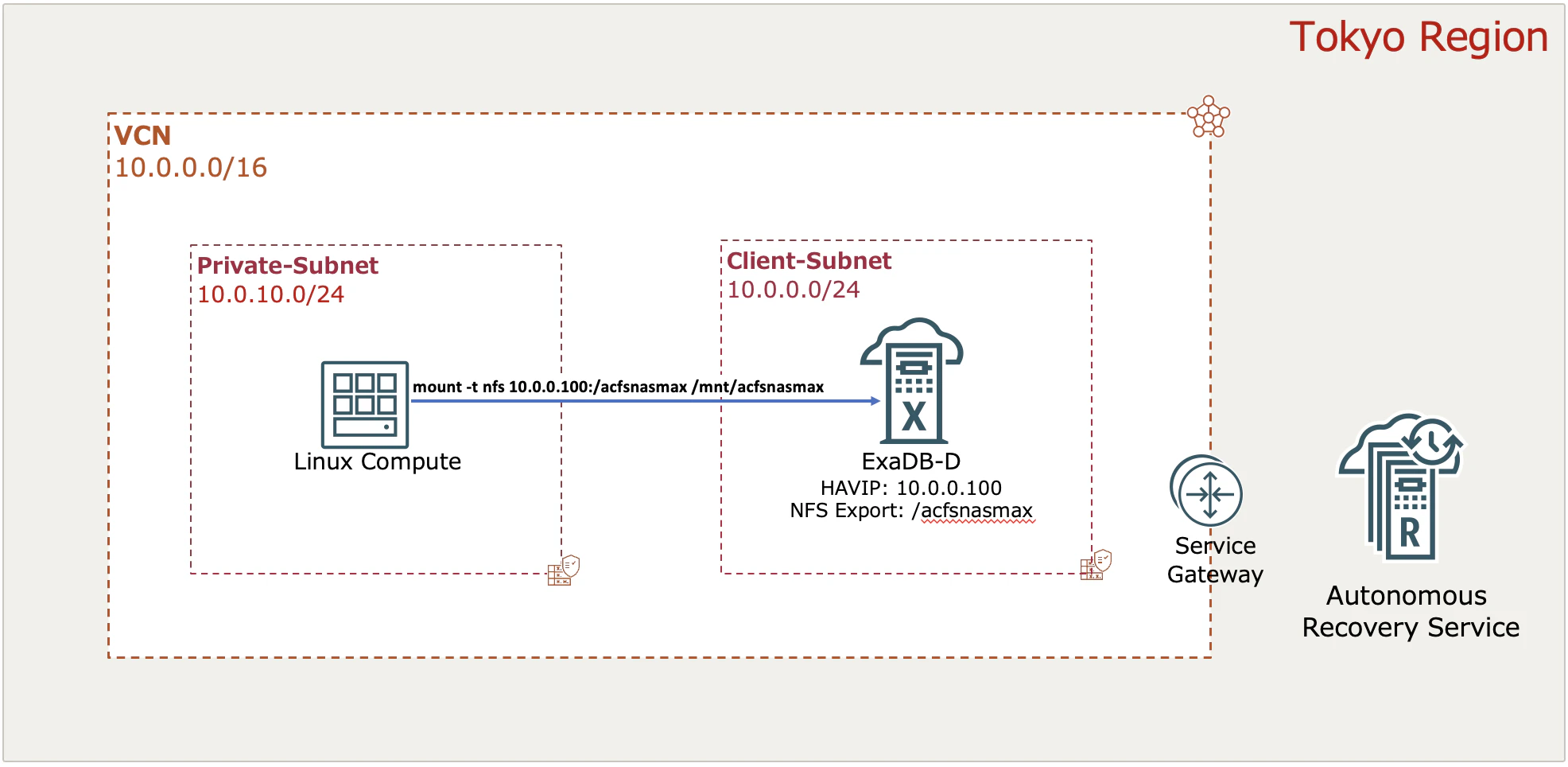

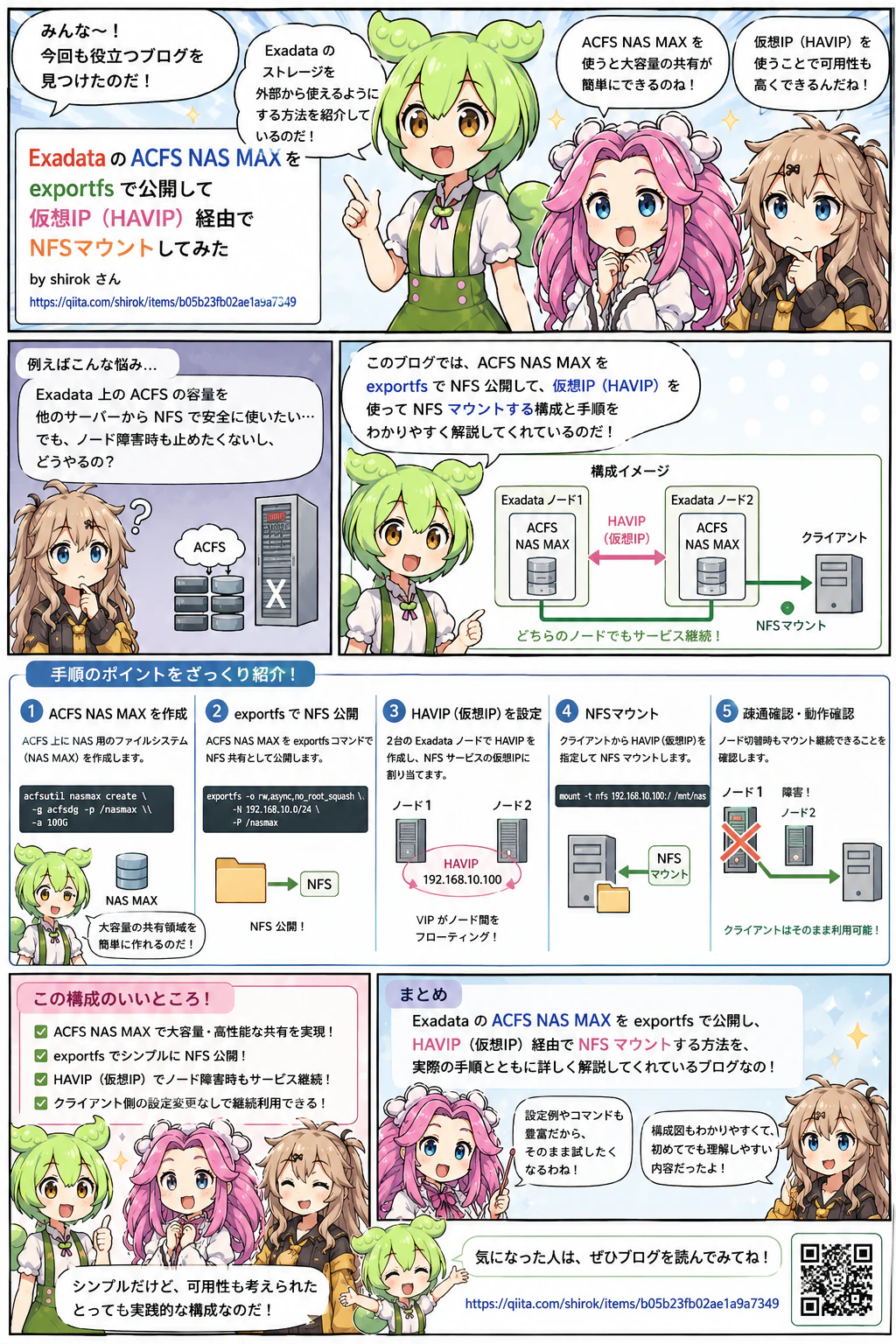

今回は、Oracle Cloud Exadata Database Service on Dedicated Infrastructure 上に作成済みの ACFS ファイルシステム /acfsnasmax を利用し、Oracle ACFS NAS MAX の HA-NFS 構成を実際に設定してみます。あわせて、Exadata VM クラスタ側の仮想IPアドレス設定と組み合わせることで、OCI の VCN レイヤーでも追従できる構成を確認します。

Exadata Database Service on Dedicated Infrastructure X11M は、最小構成でも 2 台の DB サーバーと 3 台のストレージサーバーから始まり、合計使用可能ディスク容量は 240TB です。

この大規模な専有ストレージを、データベース用途だけでなく ACFS NAS MAX による共有ストレージ基盤としても活用できれば、用途によっては別途 NAS サービスや専用ファイルサーバーを持たずに済み、構成の集約やコスト最適化にもつながります。

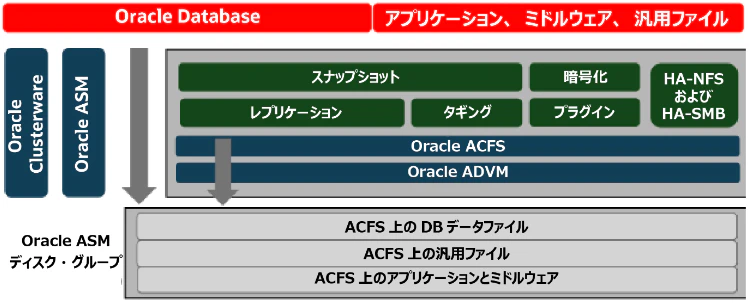

Oracle Advanced Cluster File System (Oracle ACFS)は、マルチプラットフォームのスケーラブルなファイル・システムであり、Oracle Automatic Storage Management (Oracle ASM)の機能を拡張して、すべてのカスタマ・ファイルをサポートするストレージ管理テクノロジです。

アプリケーション・ファイル(実行可能ファイル、データベース・データファイル、データベース・トレース・ファイル、データベース・アラート・ログ、アプリケーション・レポート、BFILEおよび構成ファイルなど)がサポートされています。他にも、ビデオ、オーディオ、テキスト、イメージ、設計図、その他の汎用アプリケーションのファイル・データがサポートされます。Oracle ACFS は、Linux および UNIX の POSIX標準に準拠しています。

Oracle ACFS NAS MAXはクラスタ・ファイル・システム Oracle ACFS の上に構築されており、NFS共有および SMB共有で Oracle ACFSの管理インタフェースとメリットを活用できるようにします。

Oracle ACFS NAS MAX の主なメリットは次のとおりです。

- Oracle ACFS 上の NFS 共有および SMB 共有を高可用化できます。

- Oracle RAC クラスタ内のすべてのノードから同じデータを利用できます。

- VIP を介してアクセスするため、クライアントはバックエンドのノード切替えを意識せず利用できます。

- ACFS スナップショット、レプリケーション、暗号化、圧縮などの機能を活用できます。

- クライアントがファイル・システムをマウント中でもファイル・システムのサイズを自動的に変更できます。

これらの機能およびOracle ACFSのその他の機能について、詳しくは Oracle Advanced Cluster File Systemの管理者ガイドを参照してください。

Oracle RACクラスタ内のノードが使用可能である限り、VIP経由でエクスポートが引き続き論理的に使用可能で、どのOracle RACノードがVIPへのアクセスを提供しているかを、クライアントは認識しません。

ということで、Exadata Database Service へ ACFS NAS/MAX を設定してみます。

■ 構成イメージ

今回はクライアント側で NFSv4 によるマウント確認を行いました。

一方で、NFSv3 クライアントも利用できるようにするため、事前に rpcbind と nfs-utils を有効化しています。

- NFSv4:

nfs-utils - NFSv3:

nfs-utils,rpcbind

■ NFSとサーバーの基本的セットアップ

Exadata へ HA-NFS をセットアップします。

NFSv4 と NFSv3 でセットアップが異なり、NFSv4 と NFSv3両方利用できるようにするには、nfs-utils, rpcbindをセットアップします。

NFSv4: nfs-utils

NFSv3: nfs-utils, rpcbind

● rpcbind 確認

NFSv3 も利用できるようにするには rpcbind を有効化します。

1) rpcbind 起動確認

次のように停止している場合は、起動します。

[root@exadata-node1 ~]# /bin/systemctl status rpcbind

● rpcbind.service - RPC Bind

Loaded: loaded (/usr/lib/systemd/system/rpcbind.service; disabled; vendor preset: enabled)

Active: inactive (dead)

Docs: man:rpcbind(8)

You have new mail in /var/spool/mail/root

2) rpcbind 起動

[root@exadata-node1 ~]# /bin/systemctl start rpcbind

3) rpcbind 起動確認

[root@exadata-node1 ~]# /bin/systemctl status rpcbind

● rpcbind.service - RPC Bind

Loaded: loaded (/usr/lib/systemd/system/rpcbind.service; disabled; vendor preset: enabled)

Active: active (running) since Wed 2026-03-11 21:46:03 JST; 2s ago

Docs: man:rpcbind(8)

Main PID: 198017 (rpcbind)

Tasks: 1 (limit: 319999)

Memory: 972.0K

CGroup: /system.slice/rpcbind.service

└─198017 /usr/bin/rpcbind -w -f

Mar 11 21:46:03 exadata-node1 systemd[1]: Starting RPC Bind...

Mar 11 21:46:03 exadata-node1 systemd[1]: Started RPC Bind.

4) rpcbind自動起動設定

[root@exadata-node1 ~]# systemctl enable rpcbind

[root@exadata-node1 ~]# systemctl is-enabled rpcbind

enabled

● nfs-utils 設定

1) nfs-utils インストール

[root@exadata-node1 ~]# yum install nfs-utils

Last metadata expiration check: 3:12:22 ago on Wed Mar 11 18:35:17 2026.

Package nfs-utils-1:2.3.3-64.0.1.el8_10.x86_64 is already installed.

Dependencies resolved.

=======================================================================================================================================================================

Package Architecture Version Repository Size

=======================================================================================================================================================================

Upgrading:

nfs-utils x86_64 1:2.3.3-68.0.1.el8_10 ol8_baseos_latest 518 k

Transaction Summary

=======================================================================================================================================================================

Upgrade 1 Package

Total download size: 518 k

Is this ok [y/N]: y

Downloading Packages:

nfs-utils-2.3.3-68.0.1.el8_10.x86_64.rpm 9.9 MB/s | 518 kB 00:00

-----------------------------------------------------------------------------------------------------------------------------------------------------------------------

Total 9.0 MB/s | 518 kB 00:00

Running transaction check

Transaction check succeeded.

Running transaction test

Transaction test succeeded.

Running transaction

Preparing : 1/1

Running scriptlet: nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64 1/1

Running scriptlet: nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64 1/2

Upgrading : nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64 1/2

Running scriptlet: nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64 1/2

Running scriptlet: nfs-utils-1:2.3.3-64.0.1.el8_10.x86_64 2/2

Cleanup : nfs-utils-1:2.3.3-64.0.1.el8_10.x86_64 2/2

Running scriptlet: nfs-utils-1:2.3.3-64.0.1.el8_10.x86_64 2/2

Verifying : nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64 1/2

Verifying : nfs-utils-1:2.3.3-64.0.1.el8_10.x86_64 2/2

Upgraded:

nfs-utils-1:2.3.3-68.0.1.el8_10.x86_64

Complete!

2) nfs-server 起動

[root@exadata-node1 ~]# systemctl start nfs-server.service

3) nfs-server 起動確認

[root@exadata-node1 ~]# systemctl status nfs-server.service

● nfs-server.service - NFS server and services

Loaded: loaded (/usr/lib/systemd/system/nfs-server.service; disabled; vendor preset: disabled)

Active: active (exited) since Wed 2026-03-11 21:49:54 JST; 21s ago

Process: 233253 ExecStart=/bin/sh -c if systemctl -q is-active gssproxy; then systemctl reload gssproxy ; fi (code=exited, status=0/SUCCESS)

Process: 233235 ExecStart=/usr/sbin/rpc.nfsd (code=exited, status=0/SUCCESS)

Process: 233233 ExecStartPre=/usr/sbin/exportfs -r (code=exited, status=0/SUCCESS)

Main PID: 233253 (code=exited, status=0/SUCCESS)

Tasks: 0 (limit: 319999)

Memory: 0B

CGroup: /system.slice/nfs-server.service

Mar 11 21:49:54 exadata-node1 systemd[1]: Starting NFS server and services...

Mar 11 21:49:54 exadata-node1 systemd[1]: Started NFS server and services.

4) nfs-server自動起動設定

[root@exadata-node1 ~]# systemctl enable nfs-server

[root@exadata-node1 ~]# systemctl is-enabled nfs-server

enabled

■ エクスポート対象となる ACFS ファイル・システムの準備

次を参考に Exadata へ ACFS ファイルシステムを作成します。

今回は、ACFS を /acfsnasmax へ設定しました。

[root@exadata-node1 ~]# df -hT | grep acfs

/dev/asm/acfsvol01-343 acfs 100G 55G 46G 55% /acfs01

/dev/asm/nfsmax-343 acfs 10G 570M 9.5G 6% /acfsnasmax

■ ACFS スナップショットの作成(オプション)

この手順はオプションですが、スナップショットを作成することをお勧めします。

1. 複数のスナップショットで同じ ACFS ファイルシステムを共有できます。HANFS は ACFS ファイルシステム全体ではなく、スナップショットごとに構成できます。異なるスナップショットを異なる DB System ホストと共有できます。

2. ACFS ファイルシステムの最小ボリュームサイズは 512MB です。より大きな ACFS ファイルシステム上に複数のスナップショットを作成する方が、DB System に接続するための専用の小さな ACFS ファイルシステムを作成するよりもスペース効率が優れています。

3. 管理と監視が容易になります。

4. 読み取り専用スナップショットを使用して、簡単かつ容易にバックアップできます。

5. 親スナップショットの読み書き可能なスナップショットを使用して、簡単かつ容易にクローンできます。

次を参考に設定します。

1) スナップショット作成

Oracle ACFSファイルシステムの読み取り専用または読み書き可能なスナップショット、あるいは既存のスナップショットを作成します。

[root@exadata-node1 ~]# acfsutil snap create -w snap-acfsnasmax /acfsnasmax

acfsutil snap create: Snapshot operation is complete.

2) スナップショット作成確認

Oracle ACFSファイルシステムのスナップショットに関する情報を表示します。

[root@exadata-node1 ~]# acfsutil snap info /acfsnasmax

snapshot name: snap-acfsnasmax

snapshot location: /acfsnasmax/.ACFS/snaps/snap-acfsnasmax

RO snapshot or RW snapshot: RW

storage interest tracking: Enabled

parent name: /acfsnasmax

snapshot creation time: Sun Mar 15 14:59:39 2026

file entry table allocation: 393216 ( 384.00 KB ) ( 96 entries )

storage added to snapshot: 393216 ( 384.00 KB )

number of snapshots: 1

kilosnap state: Enabled

storage interest tracking: Enabled

snapshot space usage: 393216 ( 384.00 KB )

■ シンプルなOracle ACFS HA-NFSシナリオの構成(ロックなし)

● rootユーザーへGI_HOME環境変数設定

ここからは、gridユーザーが保有する srvctlコマンドは、rootユーザーで設定します。

そのため、rootユーザーへ GI_HOME環境変数として gridユーザーの ORACLE_HOME設定しておきます。

[root@exadata-node1 ~]# sudo su - grid

[grid@exadata-node1 ~]$ env | grep ORACLE

ORACLE_SID=+ASM1

ORACLE_HOME=/u02/app/23.0.0.0/gridhome_1

ORACLE_HOSTNAME=exadata-node1

[grid@exadata-node1 ~]$ exit

[root@exadata-node1 ~]# export GI_HOME=/u02/app/23.0.0.0/gridhome_1

[root@exadata-node1 ~]# env | grep GI_HOME

GI_HOME=/u02/app/23.0.0.0/gridhome_1

● HAVIPの登録

システムに新しいHAVIPを追加するには、コマンド‘srvctl add HAVIP’を使用します。このHAVIP を HA-NFS とHA-SMB の両方に使用できます。

次の参考情報でコマンドの詳細を確認してください。

・参考: srvctl add havip

1) HAVIP登録

srvctl add havipコマンドで、HAVIPを登録します。

・ srvctl add havip コマンドのパラメータ

| パラメータ | 今回の設定 | 説明 |

|---|---|---|

| -id havip_name | HAVIP-ACFSNAS | HAVIPリソースの一意のIDを指定 |

| -address {host_name | ip_address} | 10.0.0.100 | 作成するHAVIP用のホスト名またはIPv4 IPアドレスを指定 |

| -netnum network_number | 1 | デフォルト値は1、必要に応じてHAVIPが依存するネットワーク・リソースを指定 |

| -description "<text>" | "HAVIP-ACFSNAS" | 必要に応じて、HAVIPのテキスト説明を指定 |

| -skip | null | 必要に応じて、このパラメータを指定して、IPアドレスの到達可能性の確認をスキップできます。 |

| -homenode | null | 必要に応じて、優先ノードまたは空の文字列を指定して、ホーム・ノードをクリアできます。 |

[root@exadata-node1 ~]# $GI_HOME/srvctl add havip -id HAVIP-ACFSNAS -address 10.0.0.100 -netnum 1 -description "HAVIP-ACFSNAS"

PRKZ-1058 : HAVIP exists for address 10.0.0.100

2) HAVIP登録確認

HAVIPには1つまたは複数の構成済みのExportFSが必要です。ExportFSがないと、HAVIPは

開始されません。クライアントがExportFSをマウントしており、使用可能なExportFSがない状態でHAVIPが開始された場合、クライアントは

ESTALEエラーを受け取ります。

[root@exadata-node1 ~]# $GI_HOME/srvctl status havip -id HAVIP-ACFSNAS

HAVIP ora.havip-acfsnas.havip is enabled

HAVIP ora.havip-acfsnas.havip is not running

[root@exadata-node1 ~]# $GI_HOME/srvctl start havip -id HAVIP-ACFSNAS

PRCE-1026 : Cannot start HAVIP resource without an Export FS resource.

● ExportFSの登録

Oracle Clusterwareでエクスポート・ファイル・システムの構成を作成します。

次の参考情報でコマンドの詳細を確認してください。

・参考: srvctl add exportfs

1) EXPORTFS登録

Oracle Clusterwareでエクスポート・ファイル・システムの構成を作成します。

・ srvctl add exportfs コマンドのパラメータ

| パラメータ | 今回の設定 | 説明 |

|---|---|---|

| -name unique_name | EXPORT-ACFSNASMAX | 作成するエクスポート・ファイル・システムの一意の名前を入力 |

| -id havip_name | HAVIP-ACFSNAS | srvctl add havipコマンドで指定した既存のHAVIPを識別する番号または名前を入力 |

| -path path_to_export | /acfsnasmax | エクスポートするOracle ACFS パスを入力 |

| -clients export_clients | null | 必要に応じて、ファイル・システムのエクスポート先クライアントのカンマ区切りリストを入力。ネット・グループおよびワイルドカードを入力できます。たとえば: -clients @netgroup1,*.example.com,16.140.0.0,hostname1 |

| -type | NFS | エクスポート・タイプ(NFSまたはSMB)を指定 |

[root@exadata-node1 ~]# $GI_HOME/srvctl add exportfs -path /acfsnasmax -id HAVIP-ACFSNAS -name EXPORT-ACFSNASMAX

2) EXPORTFS登録確認

エクスポート・ファイル・システムの構成のステータスを表示します。

[root@exadata-node1 ~]# $GI_HOME/srvctl status exportfs -name EXPORT-ACFSNASMAX

export file system export-acfsnasmax is enabled

export file system export-acfsnasmax is not exported

3) EXPORTFS構成情報確認

Oracle Clusterwareのエクスポート・ファイル・システムの構成情報を表示します。

[root@exadata-node1 ~]# $GI_HOME/srvctl config exportfs -name EXPORT-ACFSNASMAX

export file system export-acfsnasmax is configured

Exported path: /acfsnasmax

Export Options: rw,no_root_squash

Configured Clients: 10.0.0.0/24

Export Type: NFS

Export file system is enabled.

Export file system is individually enabled on nodes:

Export file system is individually disabled on nodes:

4) EXPORTFS構成を起動

エクスポート・ファイル・システムの構成を起動します。

[root@exadata-node1 ~]# $GI_HOME/srvctl start exportfs -id HAVIP-ACFSNAS

[root@exadata-node1 ~]# $GI_HOME/srvctl status exportfs

export file system export-acfsnasmax is enabled

export file system export-acfsnasmax is exported on node exadata-node2

5) エクスポート中情報確認

エクスポート中またはエクスポート解除中のファイルシステムに関する詳細情報が表示されます。

[root@exadata-node1 ~]# exportfs -v

/acfsnasmax 10.0.0.0/24(sync,wdelay,hide,no_subtree_check,fsid=787625048,sec=sys,rw,secure,no_root_squash,no_all_squash)

● 付録: 初期化 HAVIP と ExportFSの登録解除

$GI_HOME/srvctl stop havip -id HAVIP-ACFSNAS

$GI_HOME/srvctl stop exportfs -id HAVIP-ACFSNAS

$GI_HOME/srvctl remove exportfs -name HAVIP-ACFSNAS

$GI_HOME/srvctl remove havip -id HAVIP-ACFSNAS

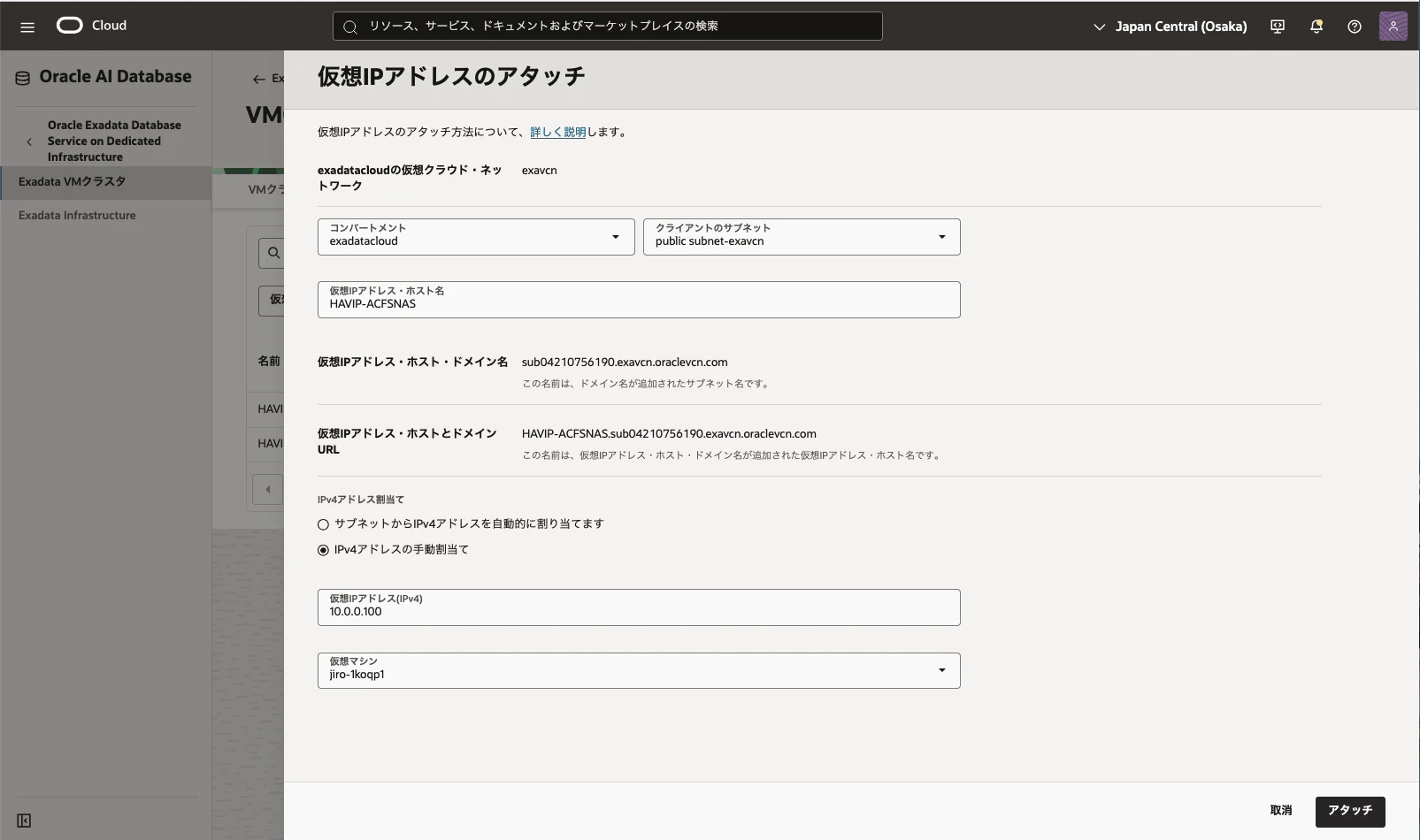

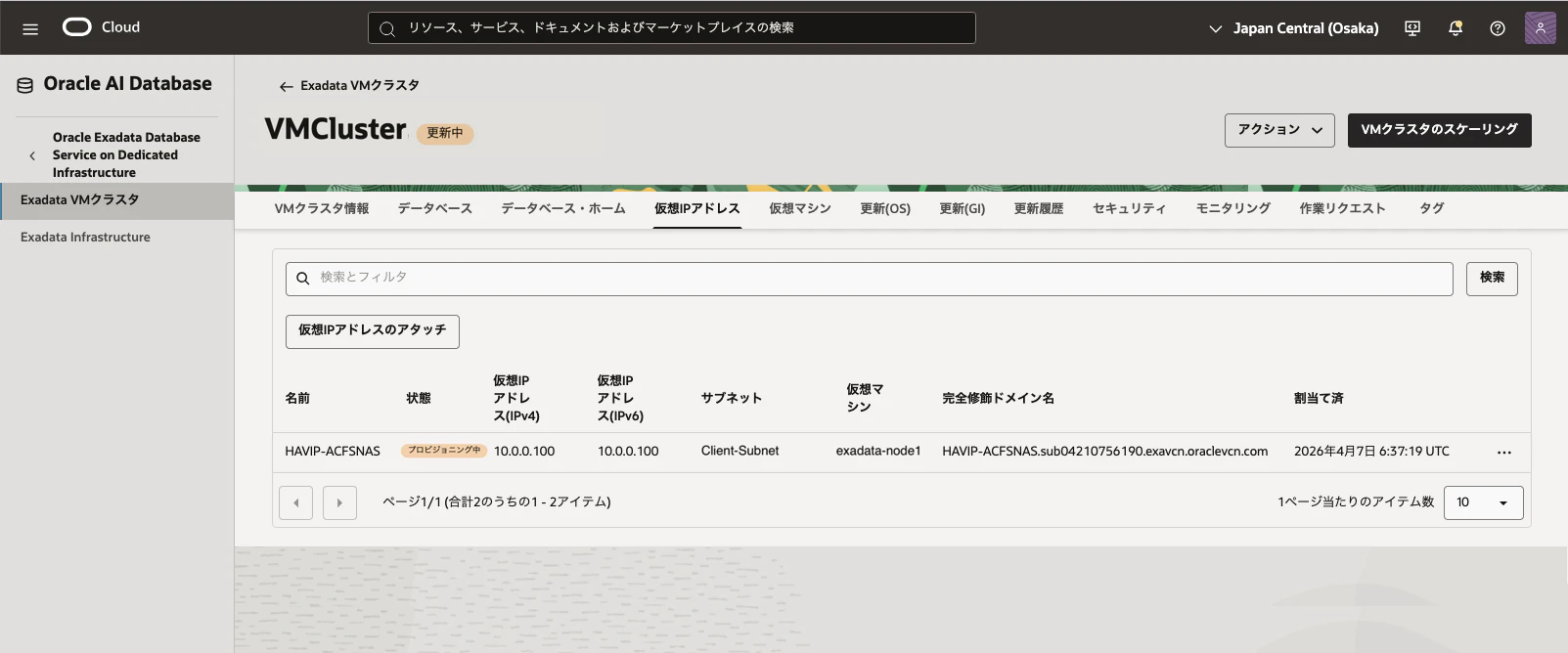

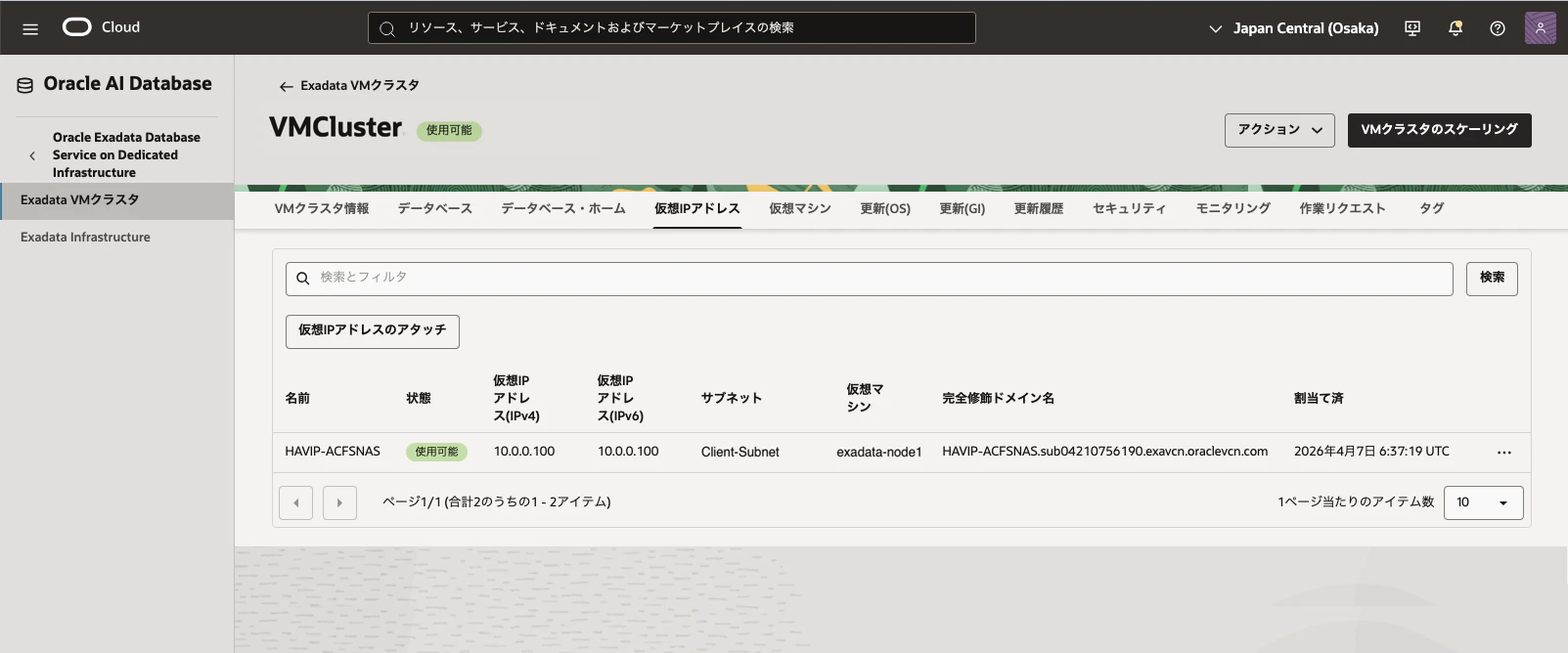

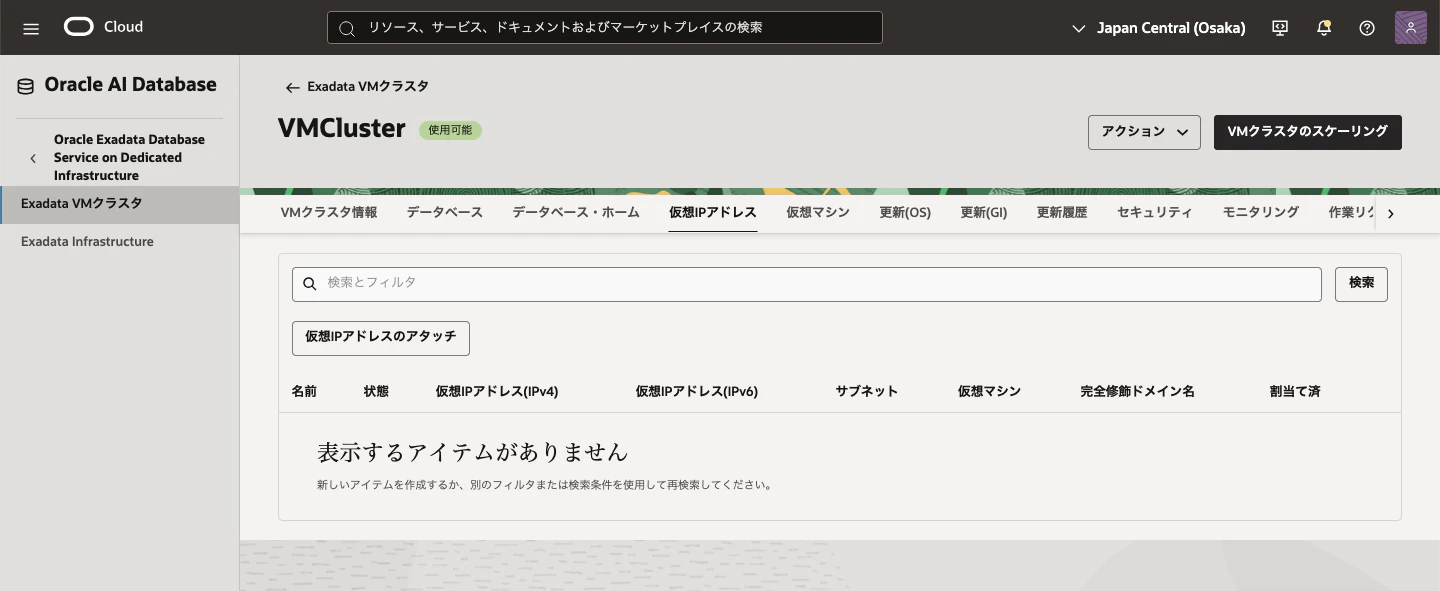

■ Exadata Database Service へ 仮想IPアドレスを設定

Oracle Exadata Database Service on Dedicated Infrastructureは、Exadata VMクラスタでの追加の仮想IPアドレスの作成を完全にサポートしています。

Oracle ACFS NAS MAXはクライアントが仮想IP(VIP)に接続するためのアーキテクチャを提供します。

現在のノードでサービスが利用できなくなった場合、このVIPはCRSリソースによって制御されて、クラスタ内を移動します。

ほとんどの場合、クライアントはサーバーが別のサーバーに置き換わったことを認識せず、VIPがホストされている新しいサーバーとの間でトランザクションを続行します。

Exadata VMクラスタでアプリケーション・フローティングIPアドレス・オブジェクトをアタッチして、フローティングIPの知識をVCNレイヤーに追加します。

バックエンド・アプリケーションVIPを作成したものと同じサブネット(通常はクライアント・サブネット)を選択していることを確認します。

1) 仮想IPアドレス画面

Exadata VMクラスタ画面から、[仮想IPアドレス]画面にある[仮想アドレスのアタッチ]をクリック

2) 仮想IPアドレスのアタッチ画面

仮想IPアドレスのアタッチダイアログで次の内容を設定し、[アタッチ]をクリック

・ サブネット: Exadata クライアント・サブネットを選択

・ 仮想IPアドレス・ホスト名: 仮想IPアドレスのホスト名を入力

・ IPv4/IPv6アドレス: 手動割当てを選択する場合、必要なIPアドレスを入力

・ 仮想マシン(オプション): デフォルトでアタッチする仮想マシン名を入力

■ VIPのノード再配置

VIPの再配置をテストします。 VIPは使用可能なまま(pingを介してこれをテスト)し、フローティングIPも別のホストに移動している間、ユーザー・インタフェースは少し後に表示されます。

ノードの再配置に使用するコマンドは、'srvctl relocate HAVIP'です。

高可用性VIP (HAVIP) (高可用性NFSおよびSMBエクスポートに使用)をクラスタ内の別のノードに再配置します。

1) 事前確認

・ crsctl

[root@exadata-node1 ~]# $GI_HOME/crsctl stat res -t|grep ".havip\|.export" -A1

ora.export-acfsnasmax.export

1 ONLINE ONLINE exadata-node2 STABLE

ora.havip-acfsnas.havip

1 ONLINE ONLINE exadata-node2 STABLE

・ srvctl

[root@exadata-node1 ~]# $GI_HOME/srvctl status exportfs

export file system export-acfsnasmax is enabled

export file system export-acfsnasmax is exported on node exadata-node2

2) VIPのノード再配置

-force 無しで実行した場合、次のように force option が必要な出力が出た場合は、force オプション付けて実行します。

[root@exadata-node1 ~]# $GI_HOME/srvctl relocate havip -id HAVIP-ACFSNAS -node exadata-node1

PRCR-1105 : Failed to relocate resource ora.havip-acfsnas.havip to node exadata-node1

PRCR-1089 : Failed to relocate resource ora.havip-acfsnas.havip.

CRS-2805: Unable to start 'ora.havip-acfsnas.havip' because it has a 'hard' dependency on resource type 'ora.havip-acfsnas.export.type' and no resource of that type can satisfy the dependency

CRS-2525: All instances of the resource 'ora.export-acfsnasmax.export' are already running; relocate is not allowed because the force option was not specified

[root@exadata-node1 ~]# $GI_HOME/srvctl relocate havip -id HAVIP-ACFSNAS -node exadata-node1 -force

HAVIP was relocated successfully

[root@exadata-node1 ~]#

3) VIPのノード再配置確認

[root@exadata-node1 ~]# sudo $GI_HOME/srvctl status havip -id HAVIP-ACFSNAS

HAVIP ora.havip.havip is enabled

HAVIP ora.havip.havip is running on nodes exadata-node1

[root@exadata-node1 ~]# $GI_HOME/crsctl stat res ora.havip-acfsnas.havip -t

--------------------------------------------------------------------------------

Name Target State Server State details

--------------------------------------------------------------------------------

Cluster Resources

--------------------------------------------------------------------------------

ora.havip-acfsnas.havip

1 ONLINE ONLINE exadata-node1 STABLE

--------------------------------------------------------------------------------

[root@exadata-node1 ~]# $GI_HOME/crsctl stat res ora.export-acfsnasmax.export -t

--------------------------------------------------------------------------------

Name Target State Server State details

--------------------------------------------------------------------------------

Cluster Resources

--------------------------------------------------------------------------------

ora.export-acfsnasmax.export

1 ONLINE ONLINE exadata-node1 STABLE

--------------------------------------------------------------------------------

[root@exadata-node1 ~]# $GI_HOME/crsctl stat res -t

ora.export-acfsnasmax.export

1 ONLINE ONLINE exadata-node1 STABLE

ora.havip-acfsnas.havip

1 ONLINE ONLINE exadata-node1 STABLE

■ NFS Client 設定

Exadata に設定された ACFS NAS を クライアントにマウントします。

HANFS によってエクスポートされたファイル・システムをクライアントにマウントする際、次のマウント・オプションが推奨されています。

hard,intr,retrans=10000

この設定は、サーバー障害時や HAVIP のフェイルオーバー時に、クライアントが一時的な応答停止を吸収しやすくするためのものです。

Oracle ACFS NAS MAX では、NFS エクスポートは VIP を介して提供されるため、バックエンドのノードが切り替わっても、クライアントから見える接続先は同じです。(docs.oracle.com)

そのため、クライアント側では I/O をすぐにエラーにせず、一定時間は再試行しながら待機できる設定にしておくのが有効です。

特に hard は、サーバー応答が戻るまで NFS 要求を継続して再試行するため、ノード障害や VIP の再配置中でも、アプリケーションが即時に I/O エラーになりにくくなります。Linux の NFS マニュアルでも、hard マウントはサーバーが応答するまで再試行を続ける動作として定義されています。(man7.org)

また、retrans=10000 は再試行回数を大きくする設定で、Oracle ACFS NAS MAX の資料でも、障害発生時にクライアントが何度も再試行することで、ネットワークの一時的な異常や HAVIP のフェイルオーバーが解消されるまで待てるようにする意図が説明されています。(oracle.com)

つまり、この推奨オプションは、クラスタ内でエクスポート先ノードが切り替わる瞬間でも、クライアントがすぐ失敗せず、フェイルオーバー完了まで待ちやすくするための設定と考えると分かりやすいです。

※補足

Oracle ACFS NAS MAX の資料では hard,intr,retrans=10000 が推奨されていますが、Linux の nfs(5) では intr は後方互換用オプションであり、kernel 2.6.25 以降では無視されるとされています。

そのため、Oracle Linux 8 では実質的には hard と retrans=10000 の意味合いが中心になります。(man7.org)

1) mount実行

[root@vm-tokyo mnt]# mount -t nfs -o hard,intr,retrans=10000 10.0.0.100:/acfsnasmax /mnt/acfsnasmax

2) マウント確認

マウントされたOSディレクトリを確認

[root@vm-tokyo mnt]# df -hT | grep acfs

10.0.0.100:/acfsnasmax nfs4 10G 569M 9.5G 6% /mnt/acfsnasmax

3) mount情報確認

マウントしたACFSと実測されているマウント・オプションを確認できます。

[root@vm-tokyo ~]# mount | grep acfs

10.0.0.100:/acfsnasmax on /mnt/acfsnasmax type nfs4 (rw,relatime,vers=4.2,rsize=1048576,wsize=1048576,namlen=255,hard,proto=tcp,timeo=600,retrans=10000,sec=sys,clientaddr=10.0.0.133,local_lock=none,addr=10.0.0.100)

今回は、Oracle Cloud Exadata Database Service on Dedicated Infrastructure 上に作成した ACFS ファイルシステムを使って、Oracle ACFS NAS MAX の HA-NFS 構成を実際に試してみました。

単に ACFS を作成するだけでなく、HAVIP・exportfs・Exadata VM クラスタ側の仮想IPアドレスを組み合わせることで、OCI 上でもクラスタの再配置に追従できる構成になることが確認できました。

Exadata Database Service on Dedicated Infrastructure X11M は最小構成でも 240TB の使用可能ディスク容量を持つため、この大容量をデータベース用途だけでなく NAS MAX による共有基盤としても活用できれば、専用 NAS サービスを別途用意しなくてよいケースもあり、構成の集約やコスト最適化の選択肢としても面白いと感じました。

Exadata と Oracle ACFS の組み合わせは、データベース基盤にとどまらず、高可用性を備えた共有ストレージ基盤としても非常に魅力があります。

Oracle Database は主に Data Guard で異なるリージョンへ保護するとしても、ACFS 上の非DBファイルは別途レプリケーションを考える必要があります。

次は Oracle ACFS Replication を使って、Exadata 上の ACFS ファイルをリージョン間でどう保護できるのかを試してみたいと思います。

■ 参考

-

Documents

- アプリケーションVIPについて

- Oracle® Advanced Cluster File System管理者ガイド

- srvctl add exportfs

- Exadata Cloud Infrastructureインスタンスのネットワーク設定

- VMクラスタの管理

- 互換性属性設定により使用可能になるOracle ACFS機能

- Oracle ACFS NAS Maximum Availability eXtensions

- Oracle ACFS Command-Line Tools for Snapshots -

Oracle White Paper

- Oracle Advanced Cluster File System (Oracle ACFS) 23ai

- Oracle Zero Downtime Migration(ZDM)およびOracle Advanced Cluster File System

- Oracle ACFS スナップショットのベスト・プラクティス

- Oracle ACFS スナップショットベースのレプリケーション セットアップ・ガイド

- Oracle ACFS NAS Maximum Availability Extensions -

Oracle Blog

- Snapshots and Clones using ACFS and Exascale Volumes

- ASM Cluster File System Snapshots on Exadata

■ 技術解説

■ おまけ

今回の内容を、ずんだもん達に紹介してもらう漫画も作ってみました。 技術記事の補足として、少しでも楽しく読んでもらえたらうれしいです。

※ 本漫画は筆者による非公式の二次創作です。

※ 使用キャラクター:ずんだもん / 四国めたん / 春日部つむぎ

※ キャラクターの権利は各権利元に帰属します。

※ クレジット

- ずんだもん / 四国めたん:東北ずん子・ずんだもんプロジェクト関連ガイドラインに基づいて利用

- 春日部つむぎ:公式利用規約に基づいて利用