目標であった衛星画像をセグメンテーションを行うことで,建物地図(マスク地図)を作ることを目的に勉強しています.

調べてみると,Segmentationを自分で学習できるモデルを行っている方がいたので,そちらのページを参考に,衛星画像のSegmentationを行います.(感謝!)

参考:Uネット構造で,画像セグメンテーションをしてみた.(2)

1.環境構築.

GPU付きのLinuxパソコンに以下の環境を構築しました.

OS:Ubuntu 16.04LTS

GPU:GepForce 1070

Python 3.5

tensorflow 1.7.0

tensorflow-gpu 1.5.0

Keras 2.1.5

numpy 1.13.3

matplotlib 2.2.2

Kerasをつかうときは,GPUのバージョンを注意したほうが良い,との記事を見たいので,このバージョンにダウングレードして構築しています.

では,この環境でSegmentationを行います.

2.処理方針

Segmentationはいくつかの方法が研究されており,全般的な比較紹介は以下が参考になると思います.

ディープラーニングによるセマンティックセグメンテーションのガイド2017年版

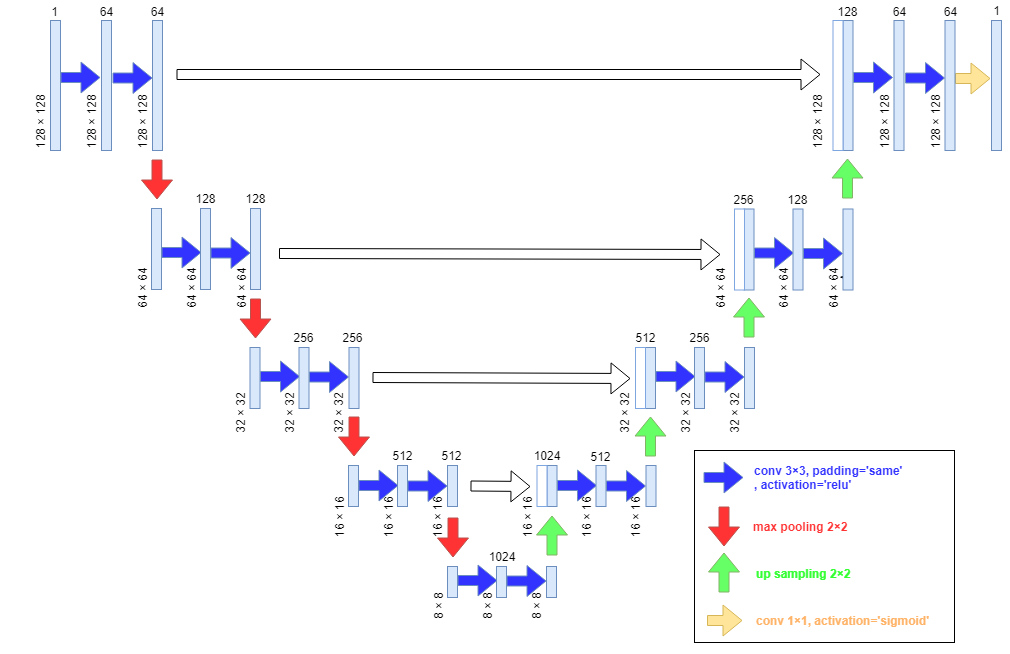

今回は,この中でも一般的なU-NETモデルを用います.

KaggleのDSTLでチャレンジがありましたが,3位の方はどんなアイデアを出して試していたのか,U-NETも含めて詳しく紹介されています.一読の価値あります.

Dstl Satellite Imagery Competition, 3rd Place Winner's Interview

U-NET©Uネット構造で,画像セグメンテーションをしてみた.(1)

私のハードのスペックにより,インプットデータの画像は512☓512になりました.

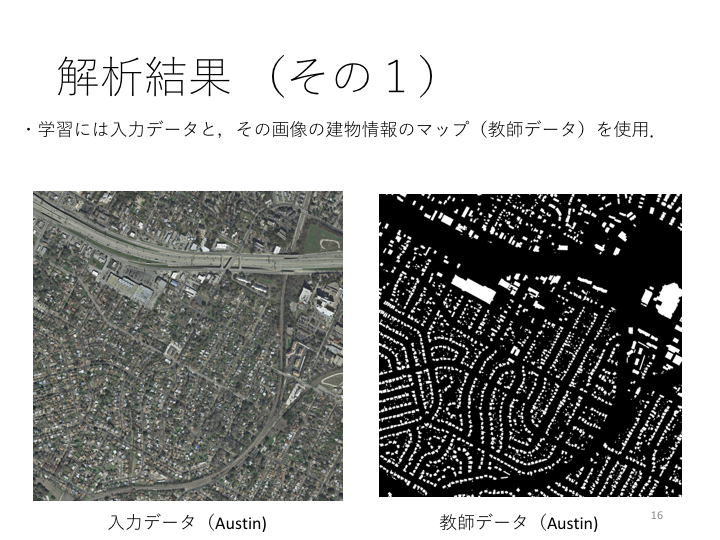

用いた画像は,衛星画像ではなく,以前紹介したInria Satellite image setの高分解能の航空画像になります.

画像1枚のサイズは5000x5000あるため,2048x2048サイズにリサイズし,それを512x512にImageMagicのCropで分割して処理しました.学習後のアウトプットデータはマージ(結合)し,一つの画像に戻しています.

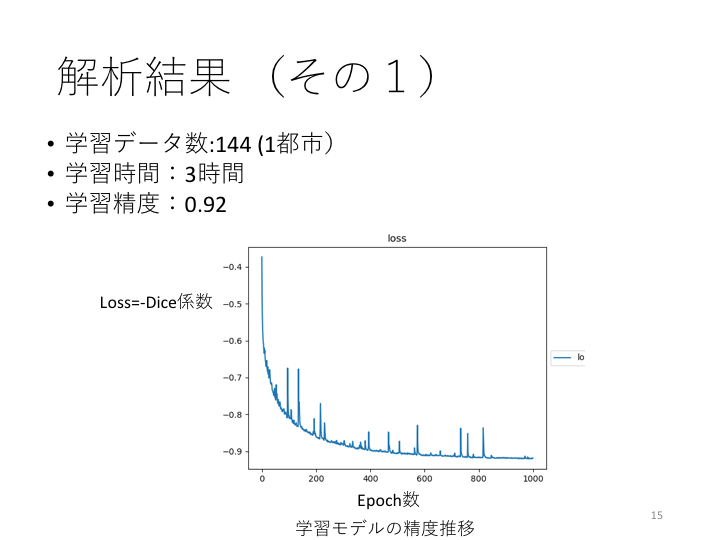

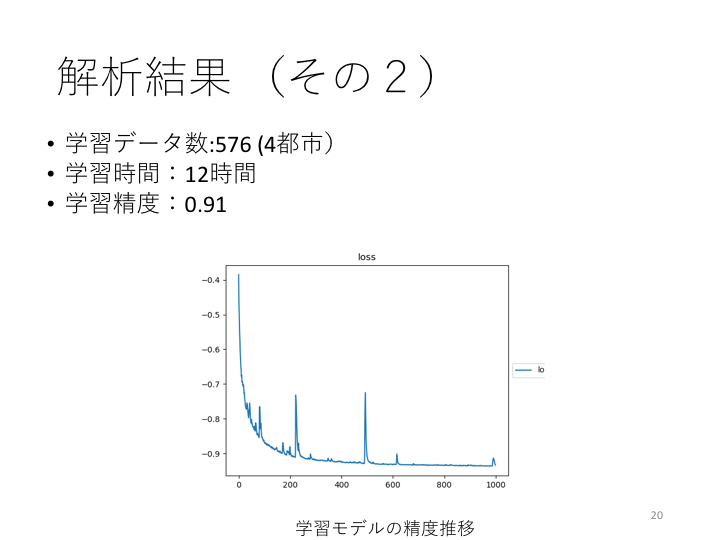

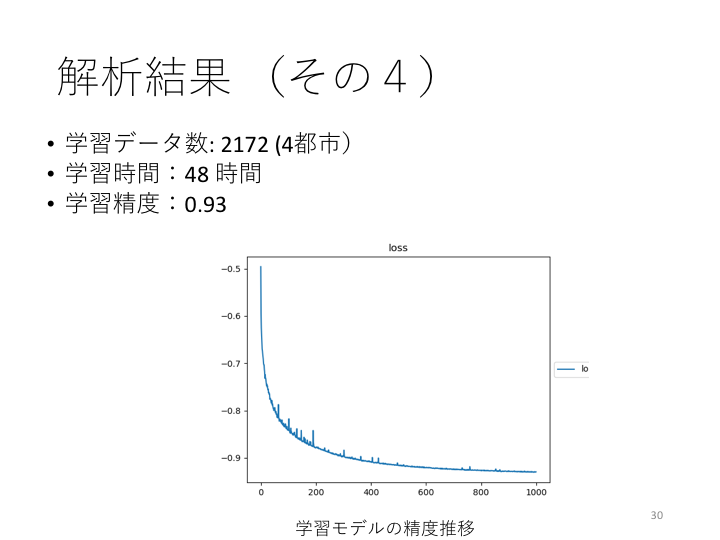

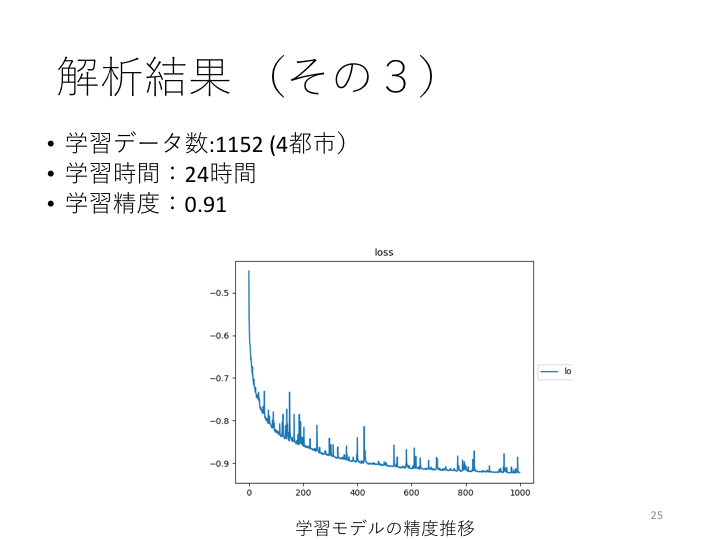

処理は,10データを1単位とし,1000回繰り返して学習させます.

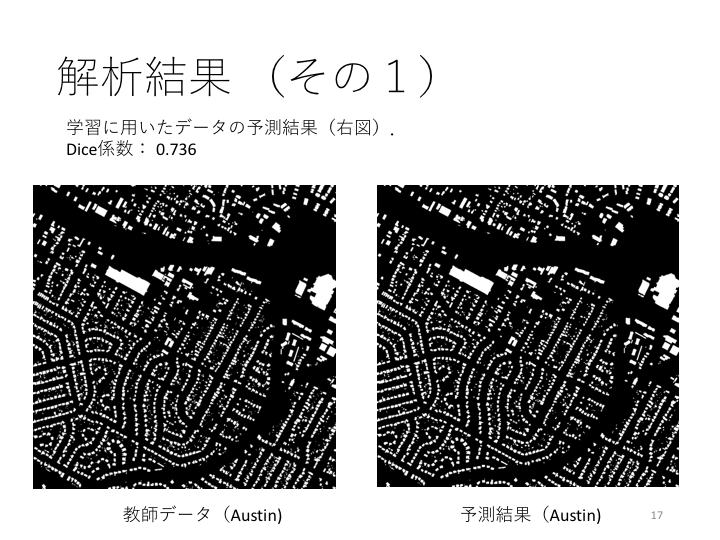

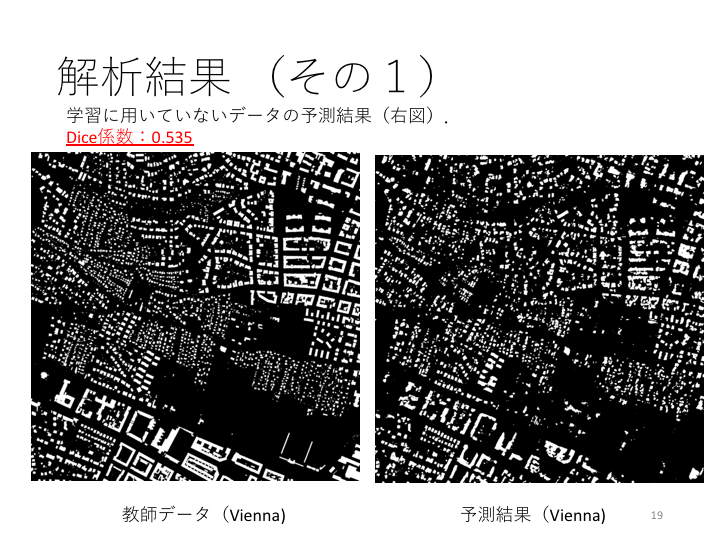

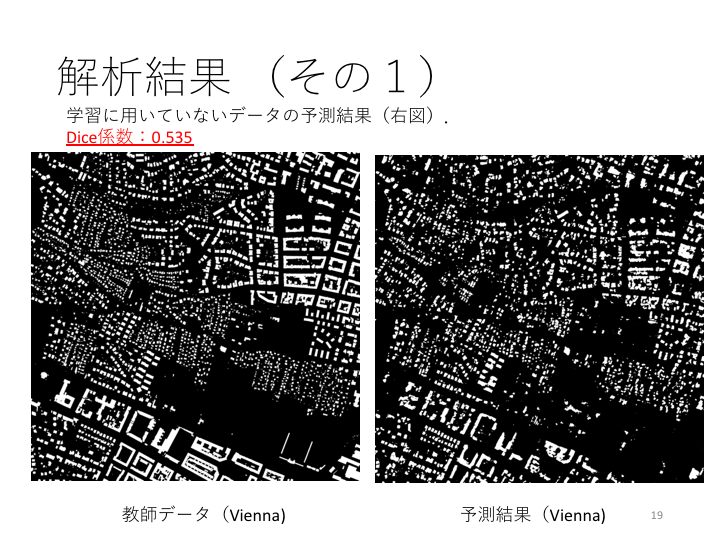

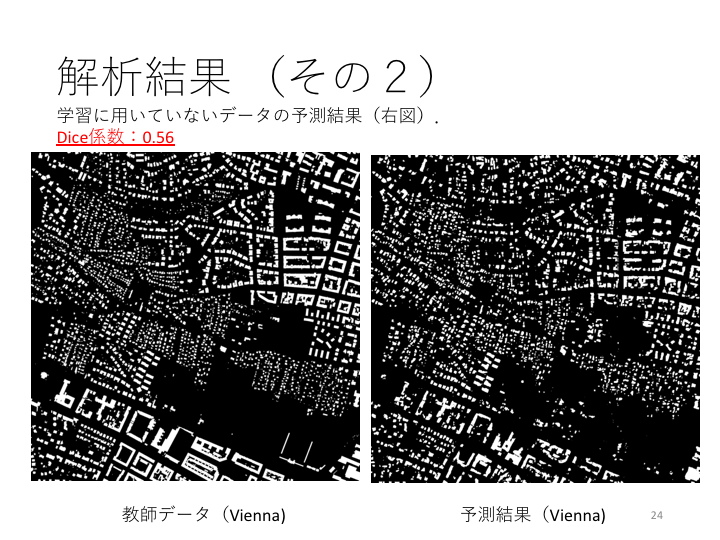

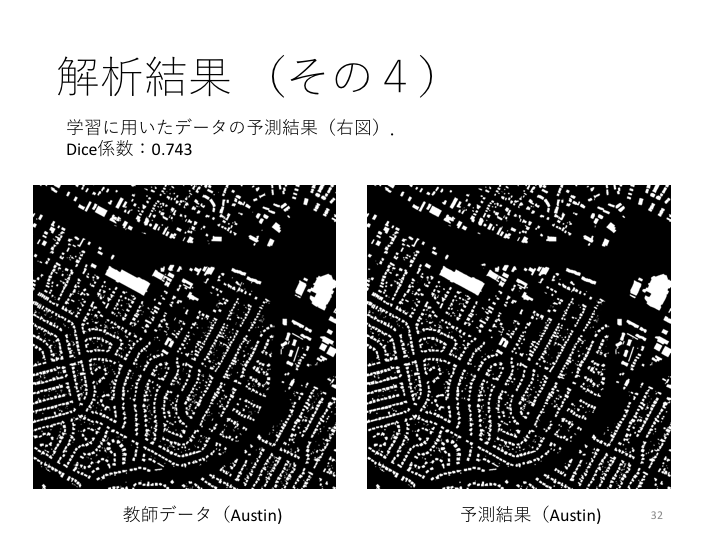

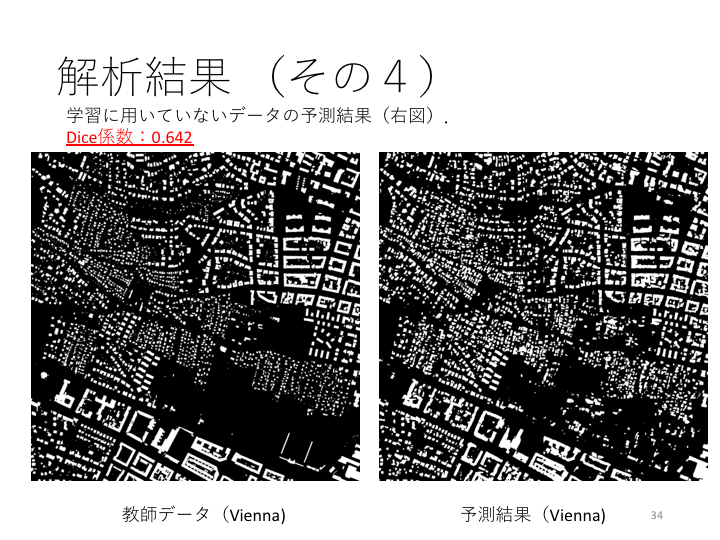

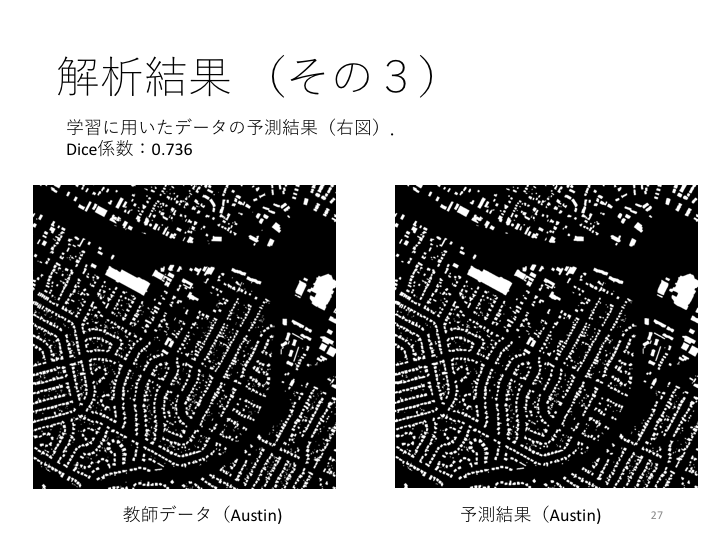

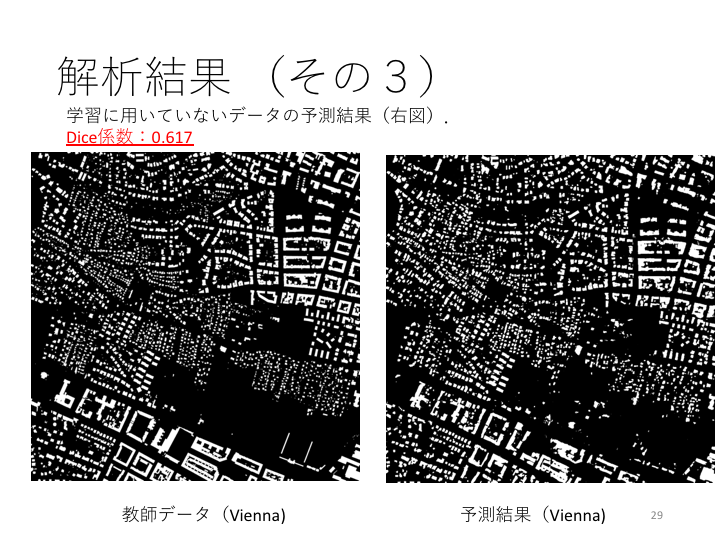

精度評価は,モデルデータと,学習モデルを用いが学習後のデータの重なり率の評価であるDice係数を用いました.

3 学習コード

コードとインプット画像,教師画像,サンプル画像,学習後の画像,は以下の構成でフォルダにいれます.

home

|

|-Inputs :学習用の衛星画像

|

|-Teachsers:上記の学習画像のマスク画像(建物のみを抽出)

|

|-TestData:学習済みモデルを用いて、衛星画像から建物のみを抽出。その対象の衛星画像。

|

|-Outputs:学習済みモデルを用いた、識別結果。

|

|-Model:学習モデルを生成、もしくはここのモデルを使用

|

|-src :各コードがはいる。

ここで,srcに学習コードがはいります.その関係は以下となります.

srcに入る学習コードはこちらになります.

元のコードを,自分の使いやすいようにモディファイしています.

学習済みのモデルもあったほうが,気軽に試せる(遊べる)のですが,モデルのファイル容量が200MBほどあり,どこに永続的に共有できるかわからなかったので,諦めました.

どこかよいサイトを御存知でしたら,教えてください.

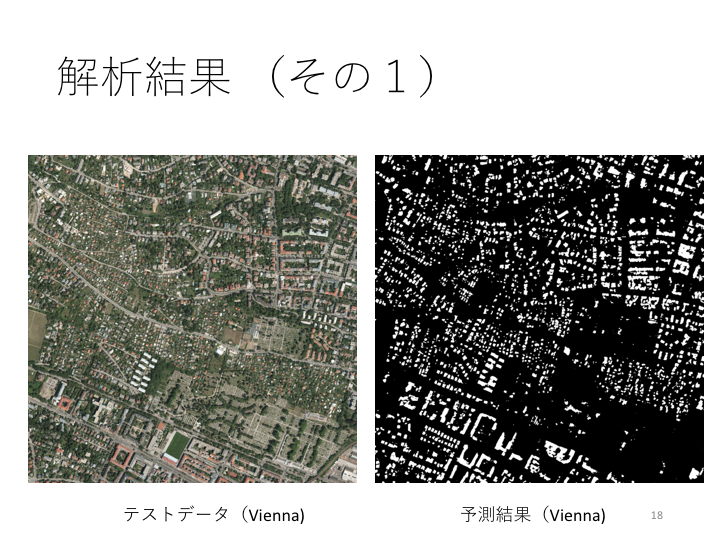

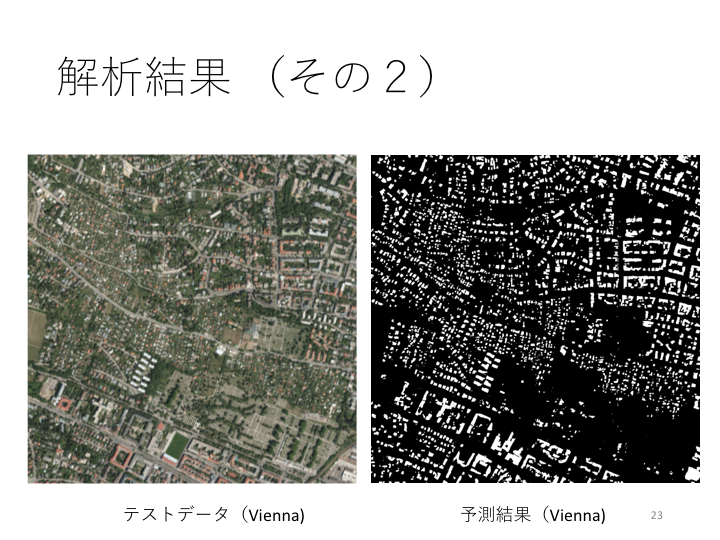

では解析結果です.

仲間と共有用にPPTでまとめてしまったので,それを画像変化して記載します.

3 解析結果

3-1 ケース1

小さな建物(家)がうまく検知できていないように見えます.

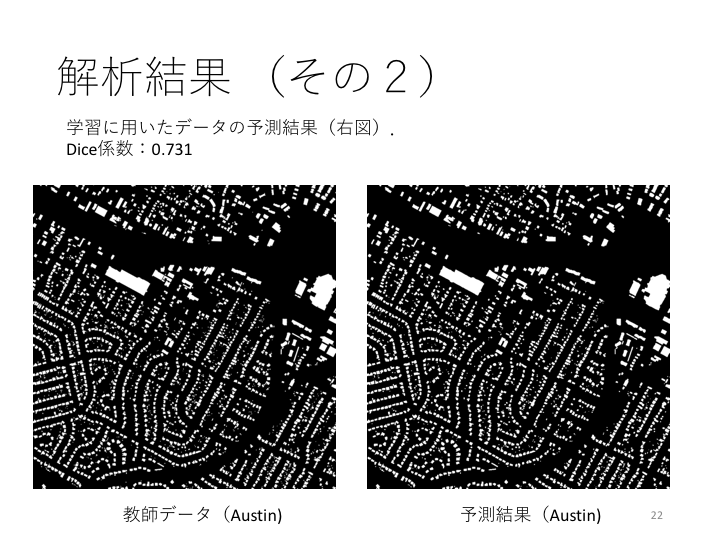

3-2 ケース2

学習データ数を4話にしたけども,それほど変わっていないかな.

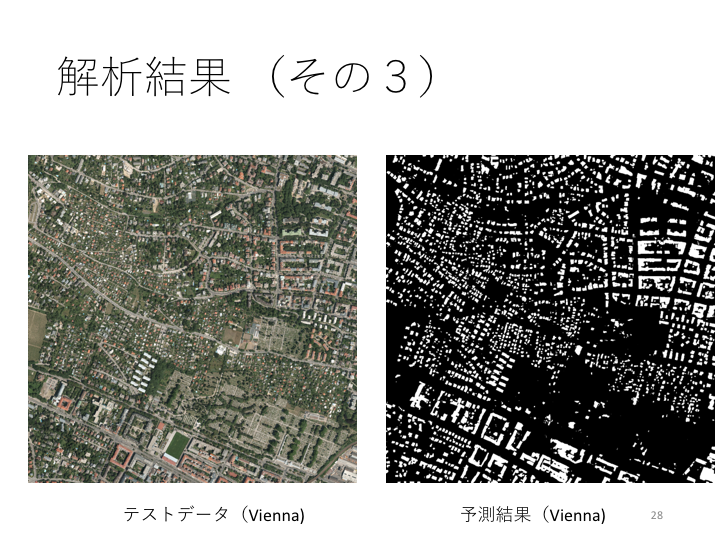

3-3 ケース3

学習数を10倍に増やしたので,ようやくモデルに近づいてきたかな.ただ,建物でないところが,建物といってしまっています.

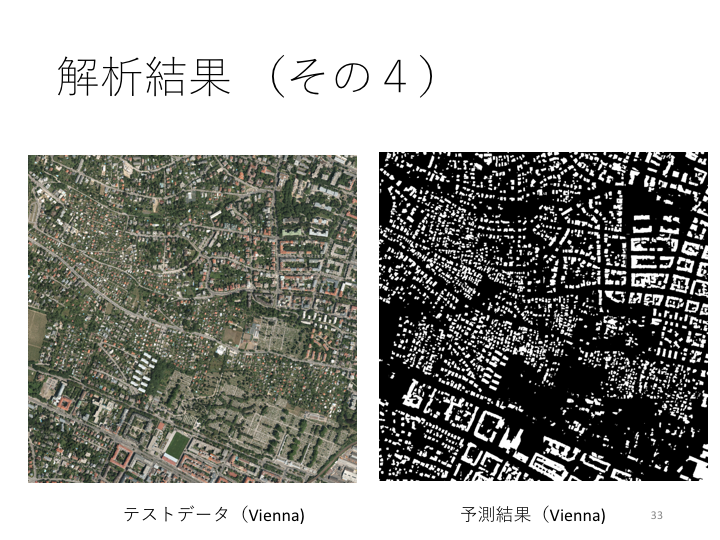

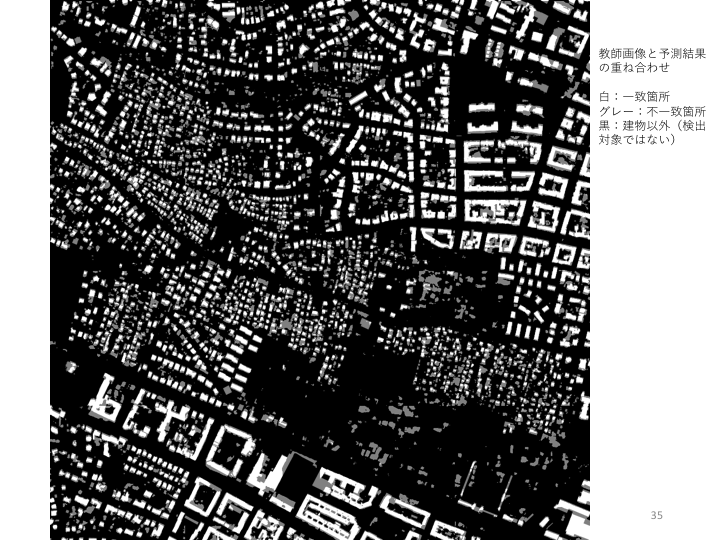

3-4 ケース4

こうみると,長屋のような形が一定の建物はしっかり検出できていますが,複雑な形状になると誤検知が多く思えます.建物域が広くでています.

衛星画像を販売しているDigital Globeの話では,米国の高分解能光学衛星であるWorldViewの衛星画像からDeep Learningで算出した建物モデルの一致度は95%だそうです.

汎用性もあり確度が高いのは,さすがプロです.

4 応用例

衛星画像から建物検出をしてかったのは,災害前後での被害場所の自動検知をこの手法でできないかと考えたからです.

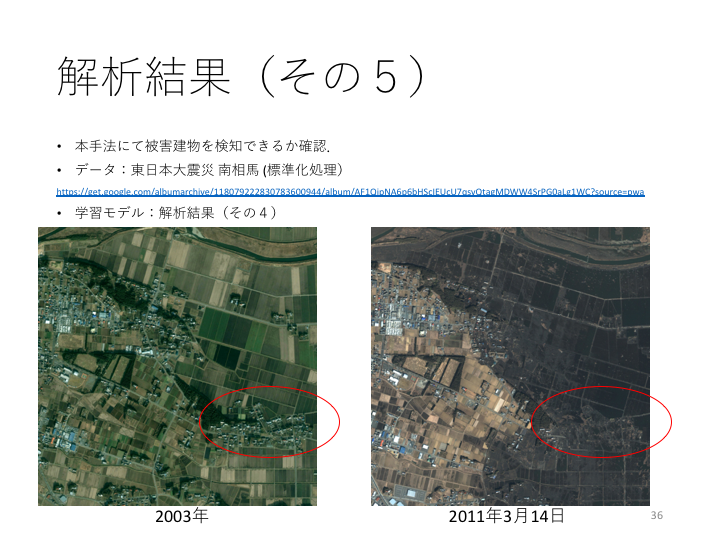

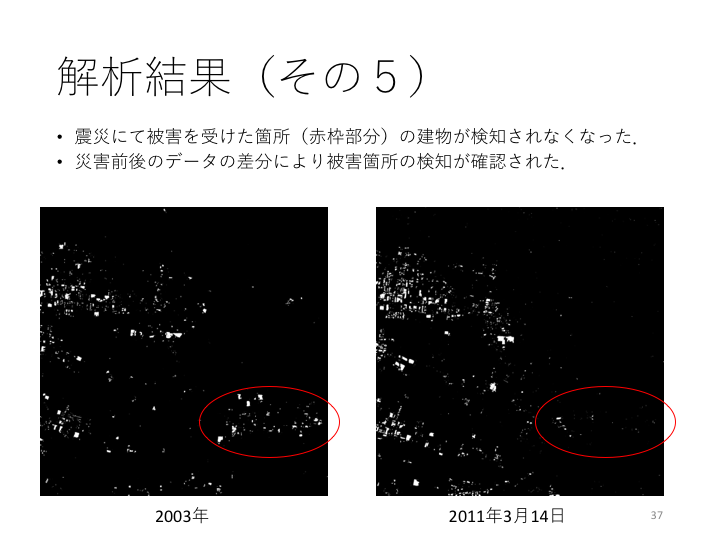

公開されている,東日本大震災の災害前後の画像から,ケース4の学習モデルを用いて試してみました.

災害前の画像は2003年ということで,かなり古いデータになってしまいますが,それでも建物の被害箇所が検出できているように見えます.

被害抽出が目的であれば,これぐらいのモデルでも適用できそうです.

5 まとめ

目的であった衛星画像のセグメンテーションによる建物検知を,公開されているコードをベースにU-NETを用いて実験してみました.

サンプル数が1000程度と,それほど多くない中でもそこそこの精度を出すことができました.

ただ,同じ航空画像のみであり,色々な種類の衛星画像をつかって,より汎用性が高く,また確度の高いモデルがつくることを次の目標にします.

紹介したSentinel-2の画像でもいいのですが,分解能が10mしかないため,そもそも建物を識別することができません.

どこかにコンペがあって,そこに教師データモデルがオープンになりましたら,トライしてみます.