きっかけ

MBTIや性格診断を受けたことがある人は多いと思う。

結果を見て「当たってる」と思う。でも、それが「自分」かと言われると、なんか違う。

「そう解釈されるのはわかる。でも自分はそのつもりじゃない」というギャップがある。

外から与えられた「答え」は、どこか他人事なのだ。

一方で、過去の経験と今がふとつながる瞬間がある。

「あ、これが自分だ」と腹落ちする瞬間。

それは誰かに教えてもらったわけじゃない。自分で気づいた瞬間だ。

この違いは何だろう?

仮説

答えをもらっても、人は変わらない。

自分で気づいたとき、人は変わる。

だとしたら、AIの役割は「答えを出すこと」ではなく「気づきを促すこと」なのでは?

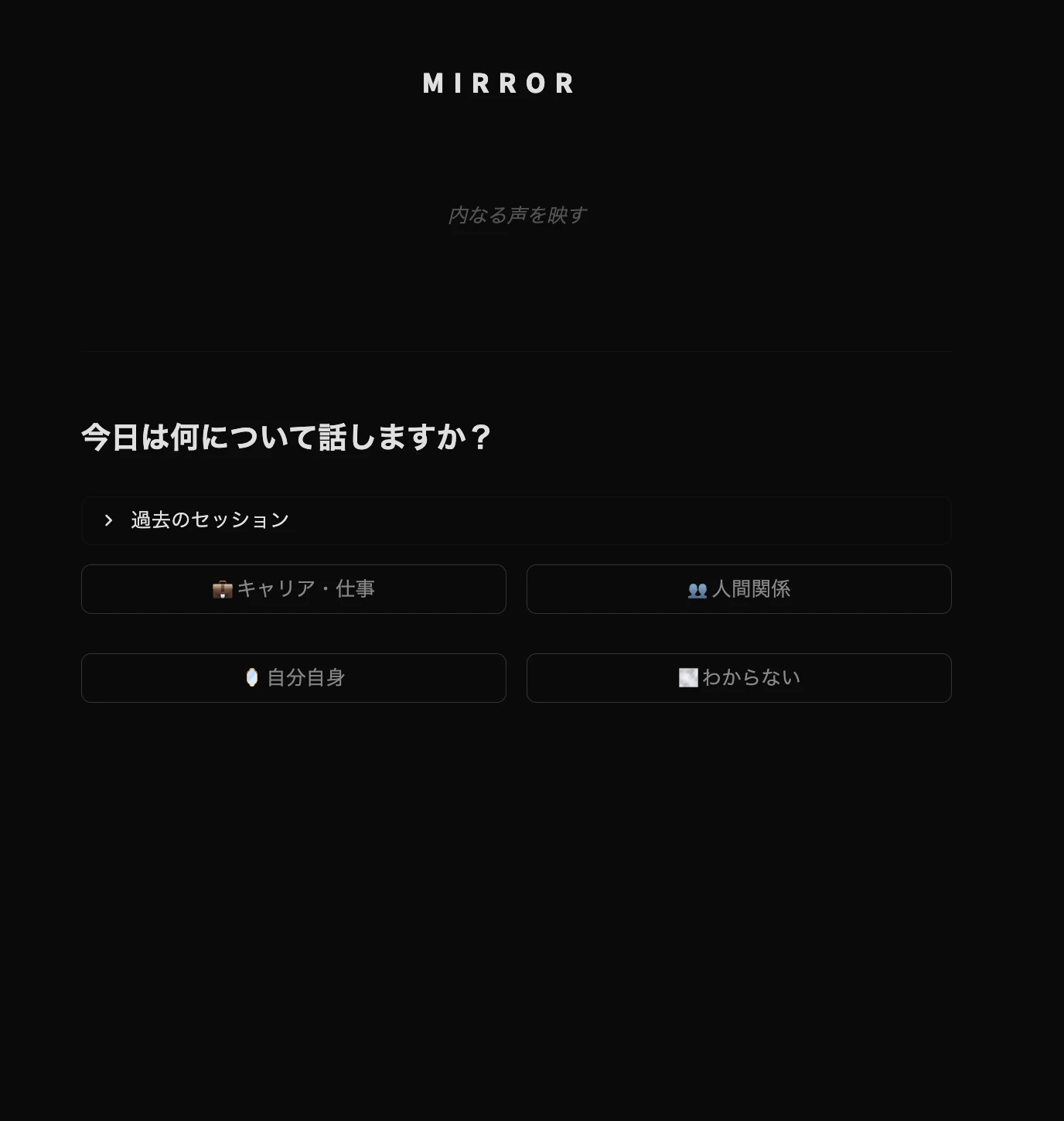

作ったもの

「Mirror」という対話AIを作った。

特徴は一つ。答えを出さない。

【従来のAI】

ユーザー: 「仕事がつらい」

AI: 「こうすればいいですよ」 ← 答えを出す

【Mirror】

ユーザー: 「仕事がつらい」

AI: 「そのつらさは、いつ頃から感じていますか?」 ← 問いを返す

解決策を提示しない。励まさない。共感しすぎない。

ただ、問いを投げる。

対話例

User: 転職しようか迷ってて

Mirror: 何が迷わせていますか?

User: 今の会社、嫌いじゃない。でもこのままでいいのかなって

...なんか関係ない話していいですか

Mirror: どうぞ。

User: 昔からそうなんですよ。周りが動くと気になる。でも自分からは動けない

Mirror: それはずっとあるパターンなんですね。

User: ...あー、そうかも。言われてみると

答えは出していない。脱線もする。でも、ユーザーは自分で何かに気づいていく。

なぜ「答えを出さない」のか

心理学の研究に面白いデータがある。

心理療法において、39-46%の患者が「突然の改善」を経験する。

— Change is Not Always Linear (PMC)

変化は線形の積み上げで起きるのではない。ある瞬間、一気に起きる。

そのトリガーは「答え」ではなく「直面」だ。

自分の内面を見つめ、逃げずにそこにいること。

Mirrorは、その「直面」を助ける装置として設計した。

なぜMirrorか

「カウンセラーに話せばいいのでは?」

人には話せないことがある。判断される、弱みを見せたくない、相手の時間を取る申し訳なさ。AIにはこれがない。深夜3時でも「どうぞ」と言う。

「ChatGPTでいいのでは?」

ChatGPTに愚痴ってる人は多い。でも、こうなる。

User: 仕事つらい

ChatGPT: それは大変ですね。いくつか対処法を提案しますね。

1. 上司に相談してみましょう

2. タスクの優先順位を...

Mirror: つらいんですね。何がつらいですか?

ChatGPTは解決しようとする。Mirrorは問いを返す。

あと、ChatGPTはセッション単位で文脈がリセットされる。Mirrorはセッションを跨いで保持する。1週間前に話した「周りが動くと気になる」を、今日のセッションで拾える。

技術的なポイント

プロンプト設計

核心はシステムプロンプト。禁止事項を明確にした。

禁止事項:

- 答えを出さない

- 解決策を提示しない

- 感情を上書きしない(「大丈夫」「頑張って」は言わない)

- 評価しない(「いいですね」「素晴らしい」は言わない)

- 長く話さない(2-3文以内)

問いの技法

カウンセリングの技法を参考にした。

- クリーン・ランゲージ: 相手の言葉をそのまま使う

- フォーカシング: 「体のどこで感じますか?」

- ナラティブ: 「その物語はいつ頃から始まりましたか?」

構成

Mirror/

├── app.py # Streamlit UI

├── prompts.py # システムプロンプト

└── requirements.txt

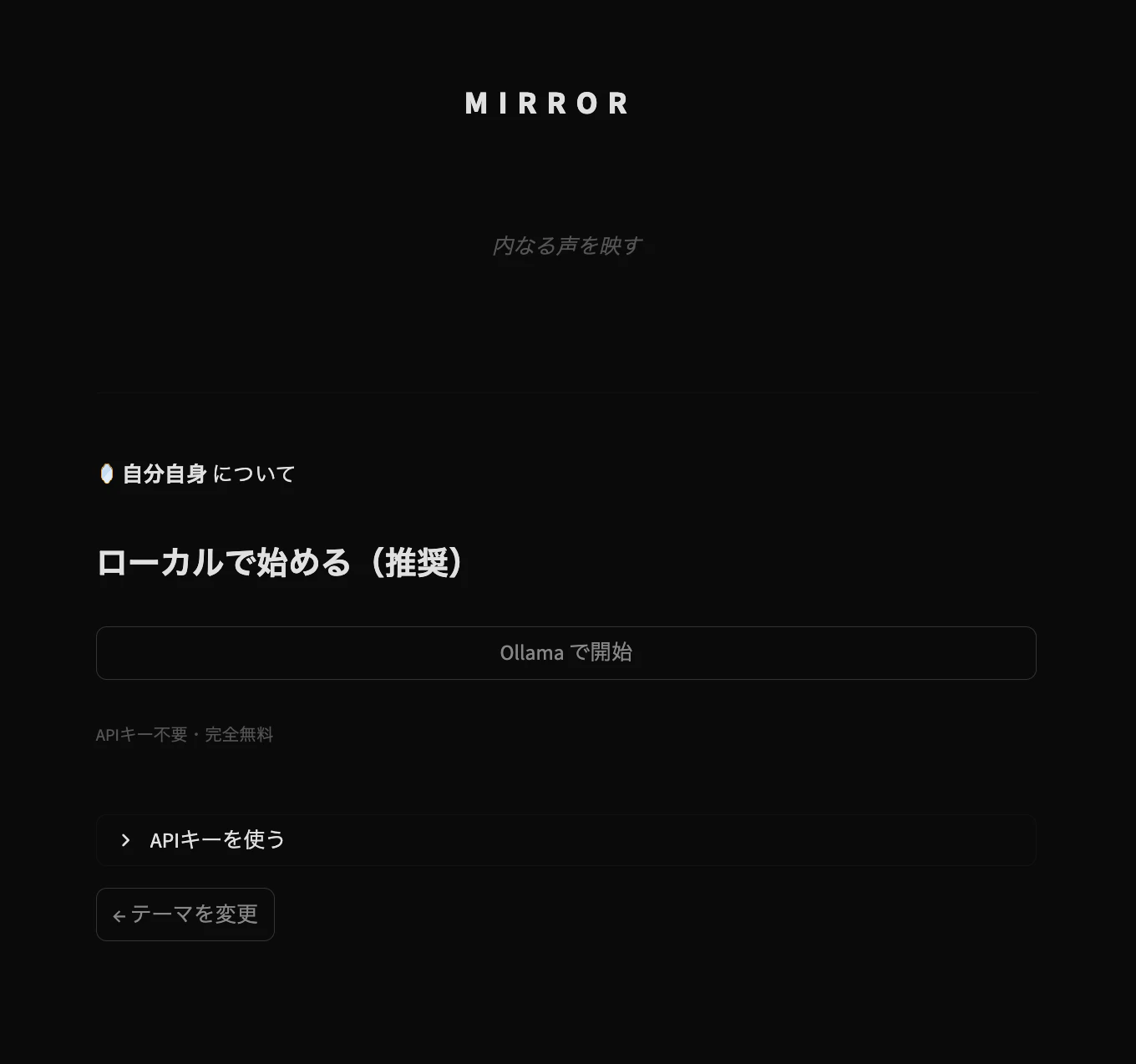

技術スタック

| 項目 | 選定 |

|---|---|

| UI | Streamlit |

| LLM | Ollama + ELYZA-JP-8B(ローカル推奨) |

| 代替LLM | Groq / Claude / GPT-4o (工事中) |

| 感情分析 | oseti(日本語) |

ローカルで動く。Ollamaを入れればAPIキーなしで使える。

所感

作ってみて気づいたこと。

「答えを出さない」のは難しい。

LLMは答えを出したがる。励ましたがる。解決したがる。

それを抑え込むプロンプト設計が、このプロダクトの核心だった。

うまくいかなかったこと

- 問いが連続すると尋問になる - 3回連続で問いを返すと「責められてる感」が出た。間を置く設計が必要

- 沈黙に弱い - ユーザーが「...」だけ打つと、AIが焦って長文を返す。沈黙を許容するプロンプトが要る

- 深くなりすぎる - 5分で核心に触れてしまうことがある。そこまで準備できていないユーザーには逆効果

もう一つ。

AIツールの進化で「どう作るか(How)」は爆速になった。

Codex、Claude Code、Cursor、Copilot...

でも、「何を作るべきか(What)」は出てこない。

そして、「どう使わせるか(UX)」も変わりつつある。

答えを出すUIから、問いを返すUIへ。

Context-Aware UIが2025年のトレンドとして語られ始めている。

Mirrorは「What」から始めた。

痛みを見て、直面を設計して、それから実装した。

AIが「答えを出す」方向に進化し続けるなら、

人間は「問いを立てる」側に回るしかない。

Mirrorは、その未来への一つのアンサーかもしれない。

「答えを出すAI」と「問いを出すAI」。両方があっていい。

最初に書いた問いに戻る。

外から与えられた「答え」は、どこか他人事だ。

自分で気づいた瞬間は、腹落ちする。

Mirrorは、その「自分で気づく」を助けるAIだ。

次回

来週は、このプロンプト設計の詳細と、実際に動かして見えた課題を書く。

シリーズ

- 思想編(本記事): 「答えを出さないAI」を作った話

- 実装編(来週): プロンプト設計の詳細

- 応用編(再来週): キャリア・メンタル・学習への応用