この記事は vExperts Advent Calendar 2025 21 日目の記事です。

vExpert の Advent Calendar なのに vSphere から Proxmox に乗り換えてしまった話です。けっして vSphere が嫌になったのではなく、私のいろいろな問題で vSphere のライセンスを維持できなくなったので断腸の思いで Proxmox VE に乗り換えています。そうしないと自宅の IT 環境が全滅してしまいますので...。

まぁ、簡単に言えば早く VCP-VCF を取れということです。

なお、この環境は VMware が Broadcom に買収される前からずっと VMUG Advantage のライセンスで維持していました。

VMUG Advantege のライセンスが 2025 年 8 月末までだったので、それに合わせて環境の移行作業をしています。ライセンス切れ 1 週間前くらい前の作業でした。

当時の資料の記録が曖昧なのでだいぶ記憶に頼っています。ある程度再現して確認したものの再現が困難なものもあるので一部不正確かもしれませんがご了承ください。

乗り換えるために共有ストレージの構成変更が必須

我が家のストレージは FreeBSD 上の zfs で構成しています。実効容量は 5TB 程度で RAIDZ2 + Stripe になっています (RAID60 相当)。

vShere から Proxmox VE に乗り換えるために必須なのは、共有ストレージの構成変更でした。

vSphere の時は zvol としてブロックボリュームとして確保した領域を iSCSI で接続して VMFS で使用していました。しかし、 Proxmox VE は当然 VMFS を使えません。これをファイルシステムとして領域を確保し直して NFS でマウントできるようにする必要があります。

ファイルシステム領域を確保する

どうやって確保するか

現在の VM イメージを消さずにブロックデバイスからファイルシステムに変更するには、

- 6TB 程度の HDD を買ってきてそれに全データを避難する

- ブロックデバイスの領域を削除する

- ファイルシステムを作る

- vSphere から Proxmox VE に移行したあとにファイルシステムに書き戻しする

- 買った退避用 HDD の使い道を考える

という手順が王道です。

しかし、この時点でライセンスが切れるまでの有余は 7 日ほどとなっており、あまり時間はかけられません。

zfs はオーバーコミットできる!!

改めて zfs の設定状況を見ると、このブロックデバイスは sparse volume として作成されていました。 3 年前に共有ストレージをリプレースした時にどうやら sparse volume として作成したようです。移行時点で使ってない VM を整理すれば 40% 程度の使用率に抑えられそうですので、ブロックデバイスとファイルシステムと共存できそうです。 3 年前の自分えらい!!

> zfs get reservation,refreservation vmstorage01/lun0

NAME PROPERTY VALUE SOURCE

vmstorage01/lun0 reservation none default

vmstorage01/lun0 refreservation none default

Proxmox VE 用の領域を作成する

既存のブロックボデバイス領域を気にすることなくファイルシステムを作成できることが分かったのでサクッと作ってしまいます。

sudo zfs create -o mountpoint=/extdisk/vmstorage01/vmnfs01 -o normalization=formD vmstorage01/vmnfs01

プール側で最低限必要な設定をしてあるので基本的に継承させてデータセットでは個別設定しません。

> zfs get atime,compress,dedup vmstorage01/vmnfs01

NAME PROPERTY VALUE SOURCE

vmstorage01/vmnfs01 atime off inherited from vmstorage01

vmstorage01/vmnfs01 compression lz4 inherited from vmstorage01

vmstorage01/vmnfs01 dedup off default

この後に NFS の設定もサクッとやってしまいましょう。

Proxmox の設定をする

細かい設定は割愛しますが以下の設定をしています。

- 共有ストレージの NFS マウント

- ネットワークの設定

- 2 台のホストのクラスタ化

ネットワークまわりは vSphere と同じように VLAN を設定します。幸い vSphere の運用環境は手の込んだことをしないで VSS で運用していたのでほぼそのまま移行できました。 2 台同じ設定をするので面倒なのでコンソールから手動で書き換えています。書式は netplan ですね。

ただし、Proxmox VE は VLAN 1 を Trunk で流すことができないの要注意です。

その他は特に設定を変えていません。初期値のままです。

VM の移行をする

NFS でストレージをマウントしてネットワークまわりの設定ができたら vShpere 環境から移行をします。2 台の PC があるので 1 台ずつ移行しました。

ESXi ごとマウントできる

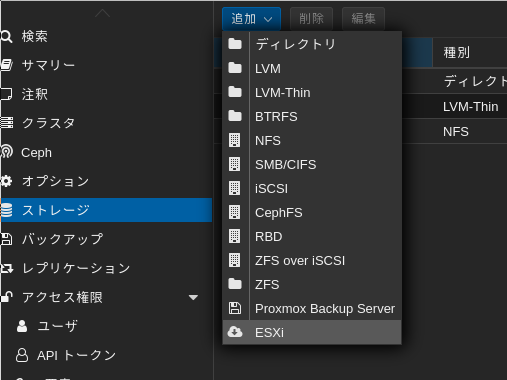

Proxmox は ESXi をマウントできます。ストレージの追加に ESXi の項目があります。

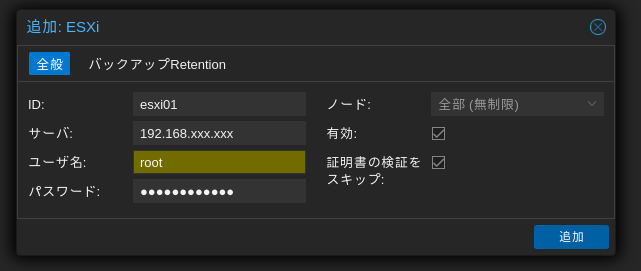

ESXi にログインするような設定がありますので入力してマウントしてみます。

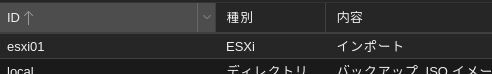

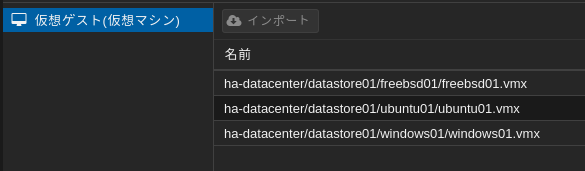

マウントすると内容がインポートということでインポート専用として見えるようになります。

インポートする

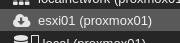

マウントできたら各ノードでストレージとして見えるようになります。

一覧として vmx ファイルが見えるようになります。

ここからインポートします。

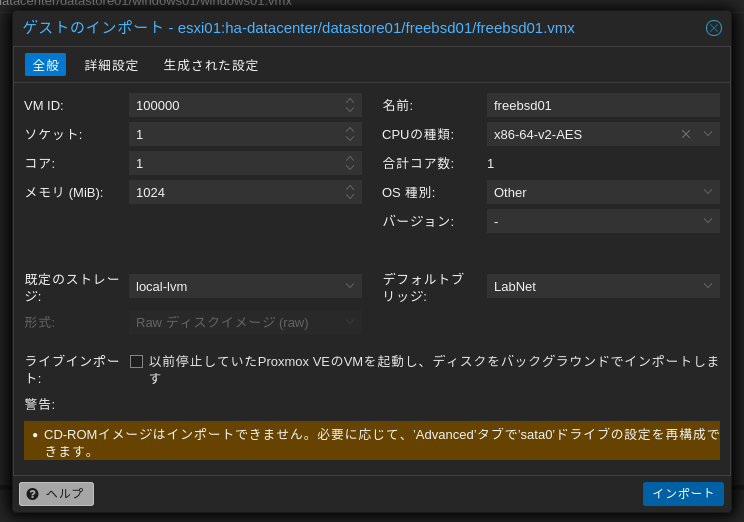

MAC アドレスも含めてハードウェア設定は元の設定が引き継がれます。

ネットワークとストレージは引き継ぎようがないので設定をします。

これがあるので VM の移行はまったく問題がなくひたすらインポートボタンを押すだけの作業となりました。

ストレージが激遅なんですけど...

移行中にも気になっていましたが、 Disk の書き込みが異常に遅いのです。 ストレージは zil を NVMe に割り当てているので nfs でも性能は確保できているはずです。そうすると nfs 自体の設定になるのですが...

Linux と FreeBSD の組み合わせの NFSv4 は遅い

調査を進めると、やはり nfs に問題がありました。ストレージ側で NFSv4 の設定が残っていたのでそのまま使用して Proxmox VE で NFS マウント時も NFSv4 を指定しました。これが原因でした。

Linux と FreeBSD の NFSv4 の組み合わせは相性が悪くすごく遅くなるという資料を発見しました (ソース失念)。そういえば、 ESXi から NFSv4 でこのストレージをマウントした時もすごく遅くてこの組み合わせで使うのをやめた記憶があったような...それで NFSv3 で一時期使っていたのだと。

ということで NFSv3 の設定をストレージ側にも入れて Proxmox VE 側も NFSv3 でマウントし直して解決です...?

いや、移行速度は上がったが VM の Disk が遅い...。pkg upgrade にすごく時間がかかる...。

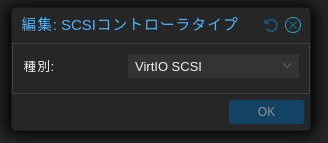

SCSI コントローラとかキャッシュの設定が必要

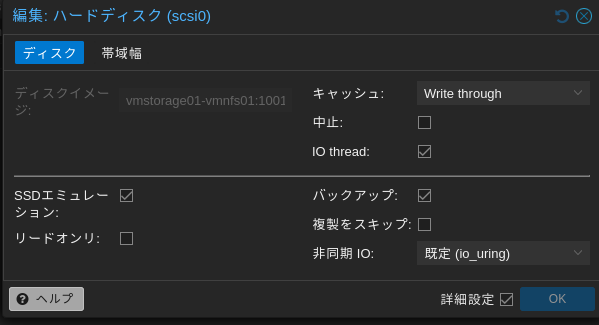

ESXi から移行した直後は SCSI コントローラが LSI Logic でキャッシュは効かないようになっていたと思います。

これを修正して遅い問題は解決しました。

キャッシュは安全性を考えて Write through にしました

移行完了

各 VM で VMwareTools を削除して qemu-agent を入れます。

NIC は vmxnet3 のままにしてあります (一部 virtio に変更)。

これで vSphere の時とほぼ同じように使えるようになって移行完了です。

ストレージ問題は性能含めて発生を想定済みでしたので、思ったより手間がかかりませんでした。

まとめ

単純な構成の vSphere から Proxmox VE への移行は簡単であるというのが分かりました。

ESXi そのものをマウントできるとは思ってなかったのでこれが非常に便利でした。

クラスタにすれば VM のライブマイグレーションができますので vSphere の時とほぼ同じ運用ができるようになりました。

ただ、 ストレージのライブマイグレーションはできますが書き込みが多いとなかなかマイグレーションが終わらないという現象が発生しています。ストレージマイグレーションは普段ほぼ使わないので影響は少ないですが気になります。

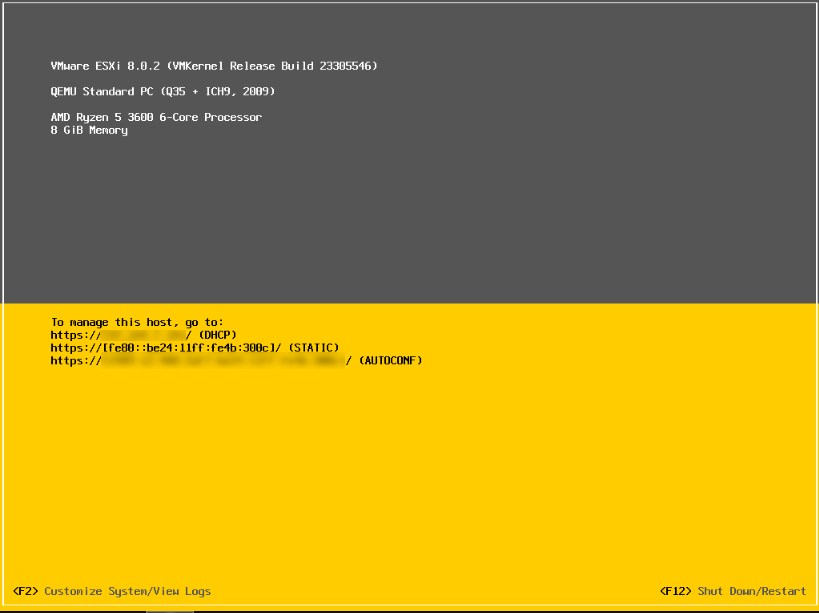

Proxmox の上で ESXi が動くことも確認できたので、このままでも VCF の検証ができるかもしれません。

とはいっても、 VCP-VCF を取得しないことには何も始まりませんので、まずはここからです。