能力の抽出が映す鏡と、IT技術者が留意すべきこと

2026年2月、米国のAnthropicが中国のAI企業3社(DeepSeek、Moonshot AI、MiniMax)による大規模な蒸留(distillation)攻撃を公表し、米中AI競争の焦点が「モデルを守る」だけでなく 「能力の抽出をどう防ぐか」 に移りつつあることが、改めて浮き彫りになりました。Euronewsの報道やCNNが伝えるように、AIの能力の抽出をめぐる攻防は、そのままアメリカと中国のAI競争の現在地を映す鏡になっています。本記事では、まずいま何が起きているかを事実ベースで押さえ、そのうえで米中AI競争の二層構造と、IT技術者として何に留意すべきかを、一次ソースや分析に基づいてわかりやすくまとめます。

蒸留攻撃の技術的な中身や防御の考え方は、「蒸留攻撃」とは何か——APIを正しく使われているのに奪われる、IT技術者が押さえる新たな脅威で詳しく扱っています。あわせて読んでいただくと、脅威モデルと実務のチェックリストまで一通り押さえられます。

いま何が起きているか——蒸留攻撃の事件

事件の概要

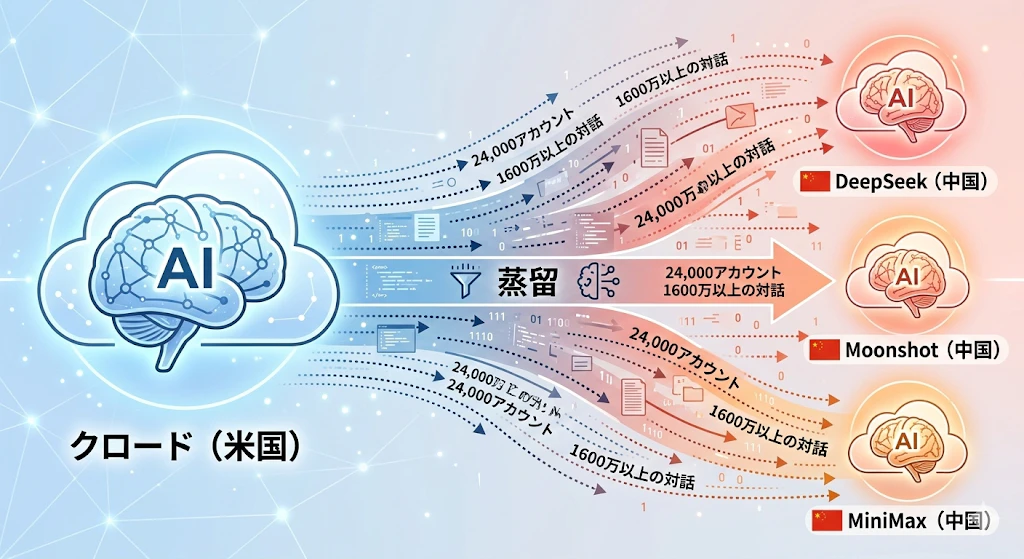

Anthropicが公表した内容によれば、中国のAI開発企業3社(DeepSeek、Moonshot AI、MiniMax)が、約2万4千の偽アカウントを使い、対話型AI「クロード」に対して1,600万回を超える対話を行い、得られたデータを自社モデルの学習に転用していた、とされています。この数字と構図はAnthropicの発表を基に、Euronews、ニューヨーク・タイムズ、GIGAZINEなどが報じています。手法は蒸留——高性能なモデルの出力を教師データとして、より小さなモデルに学習させる技術——と呼ばれます。Euronewsが伝えるとおり、蒸留は自社内で小型・安価なモデルを作るなど正当な用途でも広く使われますが、他社のフロンティアモデルを無断で対象に、組織的・大規模に実行したことが、今回問題とされている点です。

では、攻撃の「手口」はどうだったでしょうか。TechStartupsの報道では、API侵入ではなく、正規利用に見えるトラフィックを分散させて集め、推論過程やコーディング、エージェント挙動まで体系的に吸い上げていたと説明されています。つまり、脆弱性を突いたのではなく、「仕様どおりに叩き続ける」ことで能力を抽出する——そんな新しい脅威の形が、現実のものとして報告されているのです。

攻撃の質が示すもの

規模だけでなく、何を狙って抽出していたかも重要です。とくにDeepSeekについては、Business Insiderなどが報じるように、チェーン・オブ・ソート(推論のステップを言語化する手法) 的な思考過程や、検閲回避用の応答パターンの抽出を狙っていたとされています。Euronewsによれば、中国国内でAnthropicへのアクセスが禁止されているなか、プロキシ経由で通信を迂回し、複数プラットフォームにまたがる偽アカウント群「ヒドラ・ネットワーク」を管理していたとされる点も、組織的運用を示す事実として報じられています。いずれにせよ、生成能力だけでなく、安全応答のクセや検閲回避のパターンまでが模倣の対象になっており、「危険な出力をさせない」ためのセーフガードの設計そのものが、悪用側に学習・再現されるリスクがある、という構図です。

Anthropicは、こうした蒸留で安全ガードが剥がされた能力が、監視国家・軍事・サイバー攻撃・偽情報に使われるリスクを、国家安全保障上の懸念として強調しています(Fortune)。Googleの脅威分析チーム(GTIG)も、Geminiに対するモデル抽出・蒸留攻撃の増加を「実質的な知的財産窃取」と位置づけています。

アメリカ vs 中国:AI競争の現在地

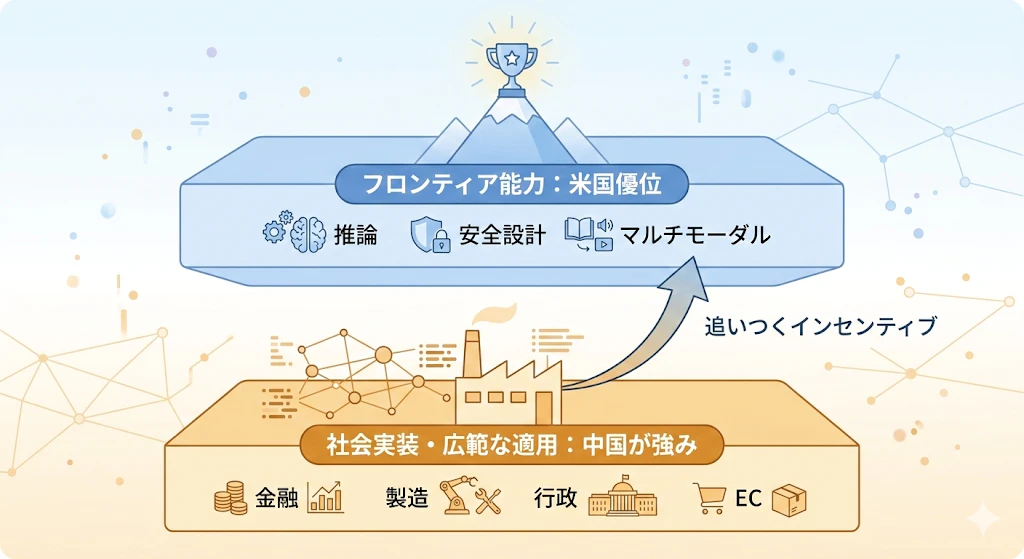

こうした蒸留攻撃をなぜそうした行為が行われるのかという視点で見ると、その背景に米中AI競争の二層構造があることが見えてきます。AI Frontiersなどが分析するように、両国は「同じレース」をしているのではなく、強みの置きどころが違う構図になっています。以下、その二層を押さえたうえで、蒸留攻撃がどのようなインセンティブのなかで起きているかを整理します。

フロンティア能力:米国優位

第一の層は、フロンティア能力です。Epochの分析によれば、2023年以降、主要な能力指標(Epoch Capabilities Index)でフロンティアに立ったモデルはすべて米国企業製で、中国モデルは平均約7か月程度遅れているとされています。OpenAI、Anthropic、Googleなどが巨大なGPUクラスタと資本を背景に、最先端の推論能力・安全設計・マルチモーダル対応でリードしている、という評価です(Who's Winning in AI: China or America?)。

この「遅れ」を埋める手段の一つとして、最新フロンティアモデルの出力を大量に取得し、自社モデルの学習に転用する——いわばショートカット——が選ばれやすい、という見方ができます。TechStartupsが報じるように、今回の蒸留攻撃は、そのようなインセンティブのなかで起きている、と解釈する論調があります。

社会実装・広範な適用:中国が強みとする領域

第二の層は、社会実装と広範な適用です。一方で、CSISやAI Frontiersの分析では、中国はクラウド資源やハイエンドGPUへの制約を背負いつつも、効率化と特定産業への垂直統合で勝負している、とされています。米国が「最前線のモデル能力」に重心を置くのに対し、中国は金融・製造・行政サービス・ECなどへの広範な導入で、国内経済全体の生産性向上を狙う路線を取っている、という見方です。規制面でも、米国がフロンティア・セーフティやガバナンスの国際標準づくりで主導する一方、中国は自国市場内での高速な実装ルール整備に強みがある、という評価があります(Wuab)。

二層構造が生むインセンティブ

この 「フロンティアは米国・実装とスピードは中国」 という二層構造があるからこそ、「フロンティア能力をどうやって埋めるか」というインセンティブが強く働き、今回のような蒸留攻撃につながっている、という解釈が可能です(GIGAZINE)。能力の抽出をめぐる攻防は、単なるセキュリティ事件ではなく、米中AI競争の最前線として理解する必要がある、ということです。次に、この蒸留攻撃を脅威の性質と政策との接続の面から整理します。

蒸留攻撃は「AI競争」のどこに位置するか

競争の構造を踏まえたうえで、蒸留攻撃を脅威の性質と政策との接続の面から整理すると、IT技術者が何を前提に設計すべきかがはっきりしてきます。

脆弱性攻撃ではなく、正規機能の濫用

まず、攻撃の性質です。蒸留攻撃は、脆弱性(CVE)を突く攻撃ではありません。APIやプロダクトを仕様どおりに叩き続け、その出力を大量に集めることで「能力」を吸い出す——つまり、 正規機能の濫用(API Abuse) として理解すべきフェーズに入っています。Google Cloudの脅威知見でも、蒸留は正当な技術手法だが、他社フロンティアモデルの出力を集中して集め、利用規約や地域制限を回避して学習資産として利用する行為は、「産業スパイ」「知財窃取」に近いとする論調が強まっている、と整理されています。

国家安全保障・輸出管理との接続

次に、政策との接続です。Backbox NewsやFortuneが報じるように、Anthropicは声明のなかで、蒸留を通じて得られた能力がサイバー攻撃・偽情報・監視国家インフラに使われる可能性を指摘し、国家安全保障課題として扱うべきだと主張しています。OpenAIもCNBCなどが伝えるとおり、米議会向け文書でDeepSeekによる米フロンティアモデルの不正利用を警告しており、輸出管理・制裁・ライセンス制といった政策議論と直結しつつあります。

グレーゾーンとしての蒸留

一方、線引きはまだ固まっていません。Google Cloudのブログが触れているように、どこまでがスクレイピングやベンチマークとして許される評価研究で、どこからが違法な抽出なのかという点は、各国で揺れているのが実情です。とはいえ、Anthropicの発表やEuronewsが伝える2万4千アカウント・1,600万回超の対話という規模と、プロキシ経由・偽アカウント群(ヒドラ・ネットワーク)による組織的運用は、単なる「研究利用」の範囲を超えている、と見る見方が強まっています。以上を前提に、現場のIT技術者が何に留意すべきかを五つのポイントにまとめます。

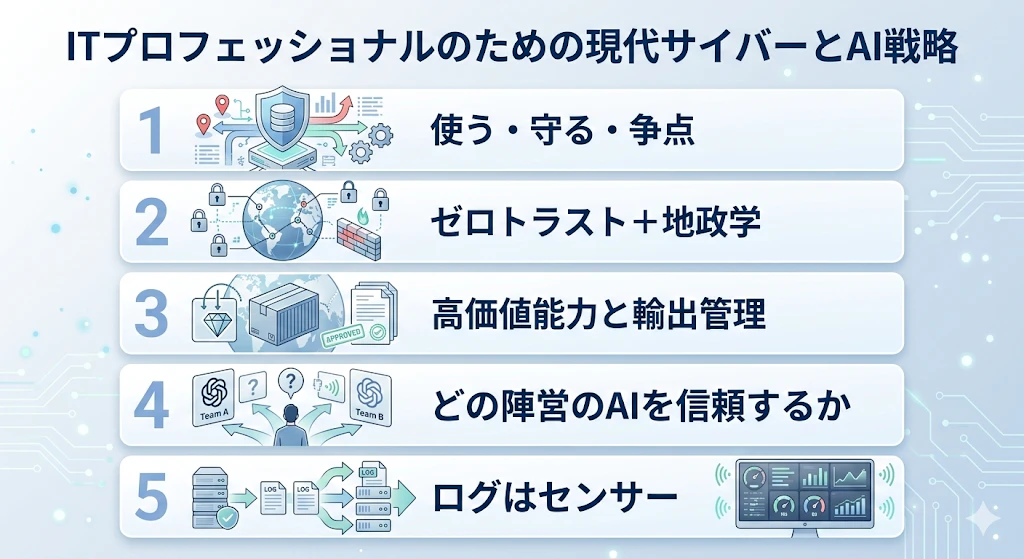

IT技術者が留意すべき五つのこと

事実と競争構造、そして脅威の性質を踏まえると、IT技術者として何に留意すべきかがはっきりしてきます。以下、五つのポイントに整理します。

AIは「使うもの」であり「守るもの」かつ「争点」でもある

フロンティアモデルの出力そのものが、国家間で争奪される知財・安全保障資産になりつつあります(CSIS)。自社でLLMやAI APIを提供する場合、 「モデル」だけでなく「出力」 を守る対象として設計に組み込む必要があります。蒸留攻撃の検知・抑止の具体的な考え方は、先に挙げた蒸留攻撃の記事のチェックリストを参照してください。

ゼロトラストは地政学込みで設計する時代

単に不正ユーザー対策をするだけでなく、どの法域・どの産業プレイヤーに、どの能力をどこまで委ねるかという地政学的な判断を、認可・監視・レート制御に織り込む必要が出てきています(Fortune)。「誰がアクセスしているか」に加えて、「どの国・どの組織に、どのレベルの出力を渡すか」をポリシーとして持っておくことが、これからは重要になります。

高価値能力の提供は、技術設計+輸出管理の問題になる

コード生成やエージェント指向の機能を、むき出しでグローバルに公開することは、事実上のデュアルユース技術の輸出と同義になりつつあります(GIGAZINE・Google蒸留)。技術設計だけでなく、利用規約・地域制限・監査ログの保持が、そのまま実装・運用の責務になる時代感が強まっています。

社内導入でも「どの陣営のAIをどこまで信頼するか」が問われる

他国のフロンティアモデルに機密や重要業務を預けることは、単なるプライバシーや企業秘密の話ではなく、どの国の法制と情報エコシステムのなかに載せるかという選択になっています(Wuab)。社内でAIを選定・導入する際も、「性能」だけでなく法域・データ所在地・サプライチェーンのリスクをセットで検討する習慣が、これからは求められます。

AI利用ログは、セキュリティ+地政学リスクのセンサーになる

どの地域から、どのASN・プロキシ経由で、どんな能力だけが異常に利用されているかは、「どのプレイヤーが何を欲しがっているか」を示すインテリジェンスになりつつあります(TechStartups)。ログ設計の段階から、クラスタ検知や異常パターンの分析に使えるメタデータを残しておくことが、将来のインシデント対応や政策対応にもつながります。

まとめ——能力の抽出の先にあるもの

本記事の内容を一言でまとめます。AI時代のセキュリティは、「モデルを守る」だけでなく 「能力の抽出をどう防ぐか」 に進んでいます。そして、その能力の抽出をめぐる攻防が、そのまま米中のフロンティア競争と安全保障リスクの最前線になっている——それが、2026年時点の状況を一言で表した整理です(GIGAZINEなど)。

IT技術者としては、米中AI競争の二層構造(フロンティアは米国・実装とスピードは中国)を前提に、出力を「守る資産」として扱うこと、ゼロトラストに地政学の視点を織り込むこと、社内AI選定で法域とサプライチェーンをセットで考えること、そしてログをセキュリティと地政学リスクのセンサーとして設計することを、日々の設計・運用のなかで意識しておくとよいでしょう。蒸留攻撃の技術的な脅威モデルと防御のチェックリストは、「蒸留攻撃」とは何か——APIを正しく使われているのに奪われる、IT技術者が押さえる新たな脅威で詳しく扱っています。あわせて参照してください。

作成日: 2026年3月1日