はじめに

こんにちは。今回はストレージ技術の基礎をテーマにしてみました。

インフラ基盤の世界ではパブリッククラウドが当たり前になりましたが、オンプレミス基盤の需要がまだまだあることを仕事をしながら感じます。オンプレミス基盤のエンジニアを集めて、さぁ設計していくかというと時に意外と見つからないのがストレージエンジニアだったりします。なので、上流工程は自分でストレージ設計やサイジングを進めつつ、案件内のメンバにストレージ技術を継承していくと言うことが何度かありました。若手からもストレージ技術について聞かれることが増えてきたので、今回、この記事にまとめてみようと思った次第です。

※ 今回の記事からやたら絵が多用されているのは、ストレージの理解に絵がないとわかりづらいこともありますが、生成AIのお陰でもあります。今後の記事は生成AIを使った絵を活用していきます。

本記事におけるストレージ技術

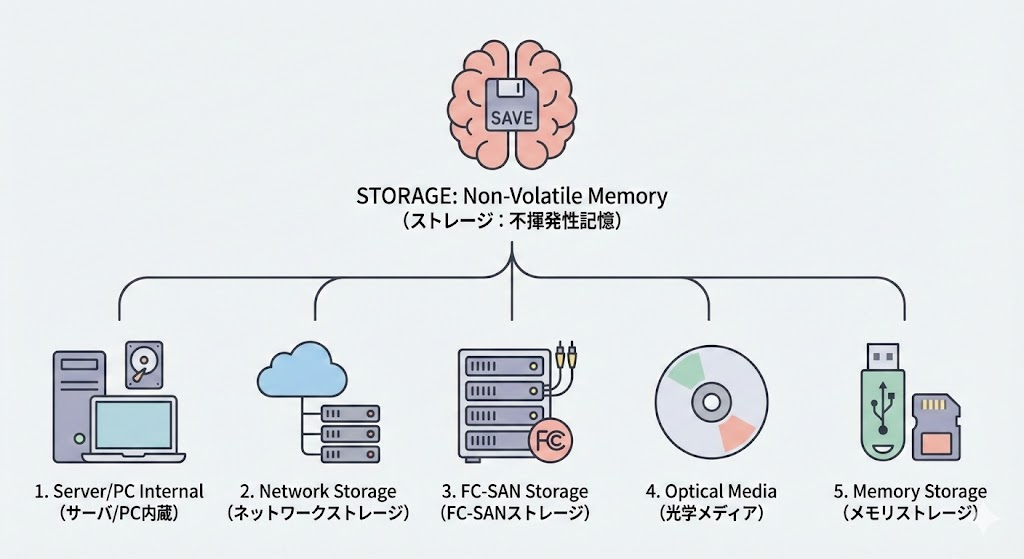

ストレージ技術は不揮発性の記憶媒体を提供する技術です。不揮発性というのは通電していなくても記憶をとどめておける特性を指します。不揮発性の記憶媒体というと主に以下があります。

- サーバやPCの内蔵ストレージ

- ネットワークストレージ

- FC-SANストレージ

- 光学メディア

- メモリストレージ

今回は 3. FC-SANストレージ を取り上げていきます。

このストレージの特徴はFC(Fibre Channel)という光を使った通信ケーブルをFCスイッチを経由してストレージ装置を複数のホストから共有できることにあります。メリットとしては以下が挙げられます。

- 部品を多重化、動作させながら部品の交換ができ、可用性を高められる (高信頼)

- RAIDやキャッシュなどの技術を使って性能向上ができる (高性能)

- 記憶領域を仮想的に分割でき、効率的に利用可能 (高効率)

- 高度な監視機能を持たせることができ、障害をいち早く検知できる (高信頼)

- 上記の機能を1台の筐体に集約し、コスト効率を高めることができる (高効率)

- サイジングが変わり容量を増やす際にも、ホストの構成に縛られづらい (拡張性)

- 1つの記憶域を複数のホストで共有できる、クラスタウェアなどを組み合わせれば、同期機能を介さずとも同じデータに複数のホストからアクセスできる (高効率)

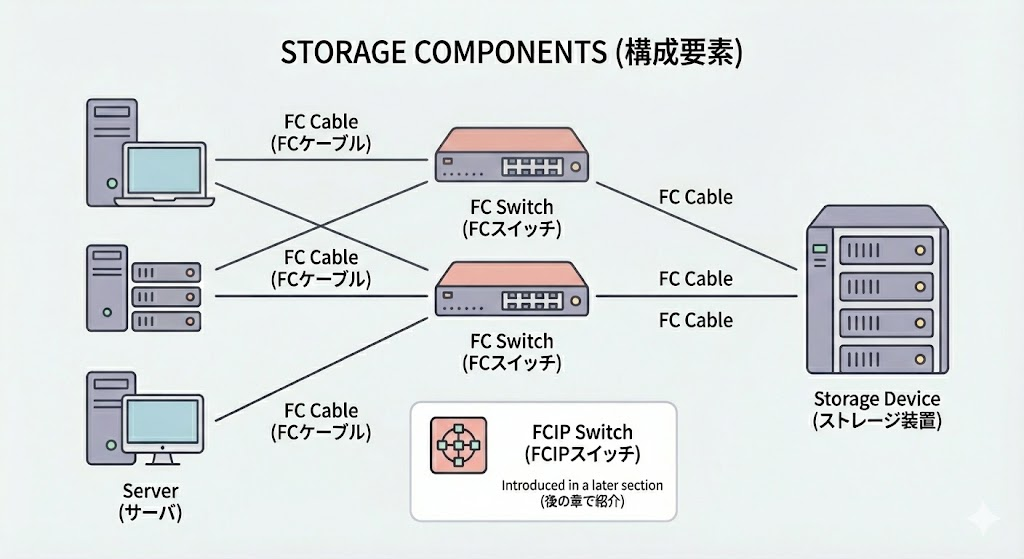

構成要素

ストレージ技術を支える構成要素として主に以下が挙げられます。

- ストレージ装置

- FCスイッチ

- FCケーブル

- FCIPスイッチ

ストレージ装置をFCスイッチ経由し複数サーバで共有するというのが、基本的な利用形態となります。各機器の接続をFCケーブルで行います。FCIP(Fibre Channel Internet Protocol)スイッチは少し特殊なので、後の章で紹介します。

各機能の説明

ここまで全体像を説明してきました。つづいて、ストレージ装置をはじめとした構成要素それぞれの説明をしていきます。

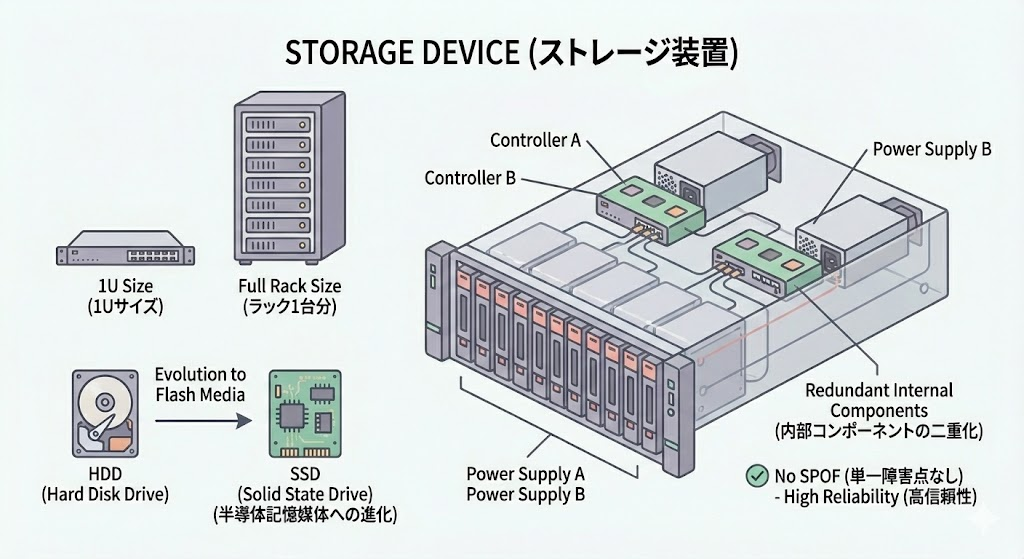

ストレージ装置

ストレージ技術の中心となる装置。大きさは1Uからラック1台分など様々あります。ここ最近はSSD(Solid State Drive)をはじめとした半導体記憶媒体が主流になってきたため、記憶容量や性能あたりの小型化が進んでいます。エントリモデルといえども、ストレージ装置は往々にして筐体内部がすべて二重化されており、SPOF(Single Point of Failure: 単一障害点)が存在せず信頼性は高いです。

ストレージ装置の構成要素としてそれぞれ物理と論理があります。

物理構成要素

- 筐体

- 電源装置

- コントローラ

- エンクロージャ

- ドライブ

- FAN

- 管理ポート

- FCポート

論理構成要素

- RAIDボリューム

- 仮想プール

- LUN(Logical Unit Number: 論理ユニット番号)

物理構成要素詳細

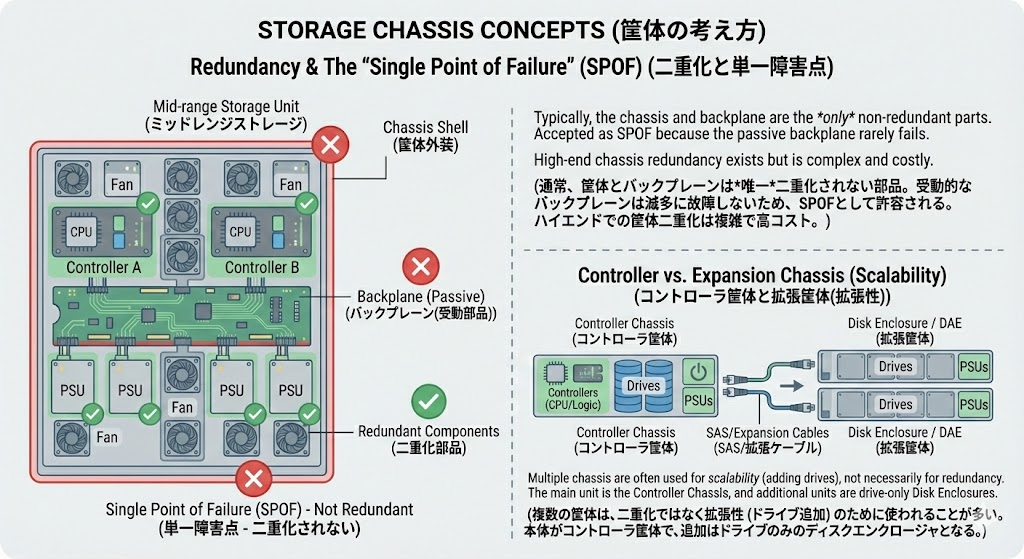

筐体

ストレージ装置の外装であり入れ物です。(エントリ-ミッドレンジモデルでは、)ストレージ装置の中で唯一二重化されない部品となります。

厳密には内部に「バックプレーン」と呼ばれる各パーツを接続する基板がありますが、これは受動的な部品であり滅多に故障しないため、可用性対策の中で筐体をあえて考慮しない(SPOFと見なさず許容する)という考え方が一般的です。

一部のハイエンドストレージの中では、筐体またぎのクラスタ構成などで筐体の二重化を実現している製品もあります。しかし、個人的には構成要素が増大し設計も複雑化するため、製品開発の観点でもSIer(System Integrator)の観点でも、(筐体の二重化は)コストの割にあまりメリットがないと思います。事実、複雑化させたことによるファームウェアのバグも少なくないです。

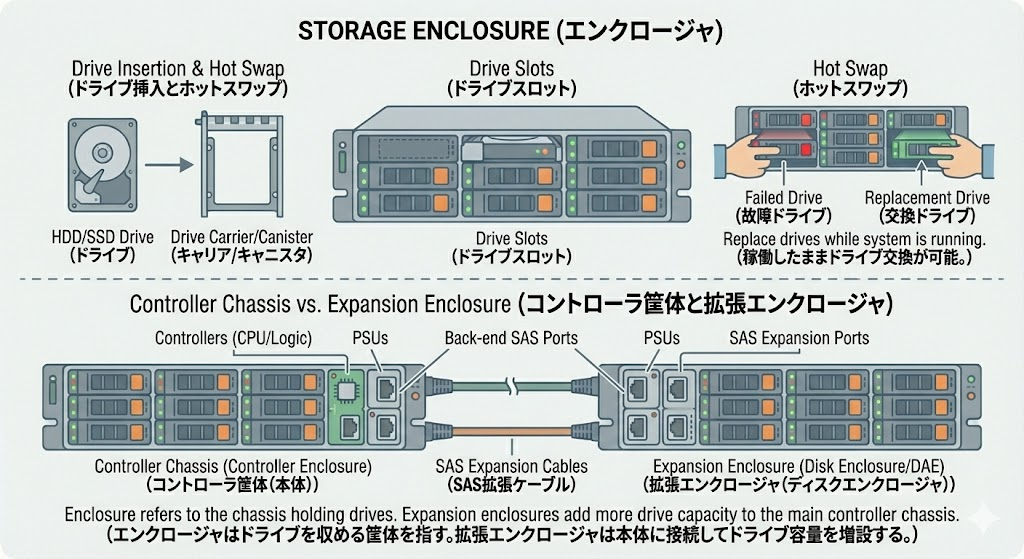

また、可用性対策とは別に拡張性のために筐体が複数に分かれている場合もあり、本体(コントローラ筐体)に対して、ディスクエンクロージャ(拡張筐体/DAE)と呼び分けます。ディスクエンクロージャはコントローラを持たず、ドライブを入れる箱として本体に接続されます。

電源装置

ストレージ装置に電源を供給するユニットです。同じものを2個以上搭載し、一つの電源装置が壊れてもストレージ装置全体の動作に影響を与えない(縮退)。動かしながらも交換も可能(ホットスワップ: 電源以外も含むほとんどの部品で可能)ですので、無停止で元の冗長構成(縮退から回復した状態)に戻すことが出来ます。

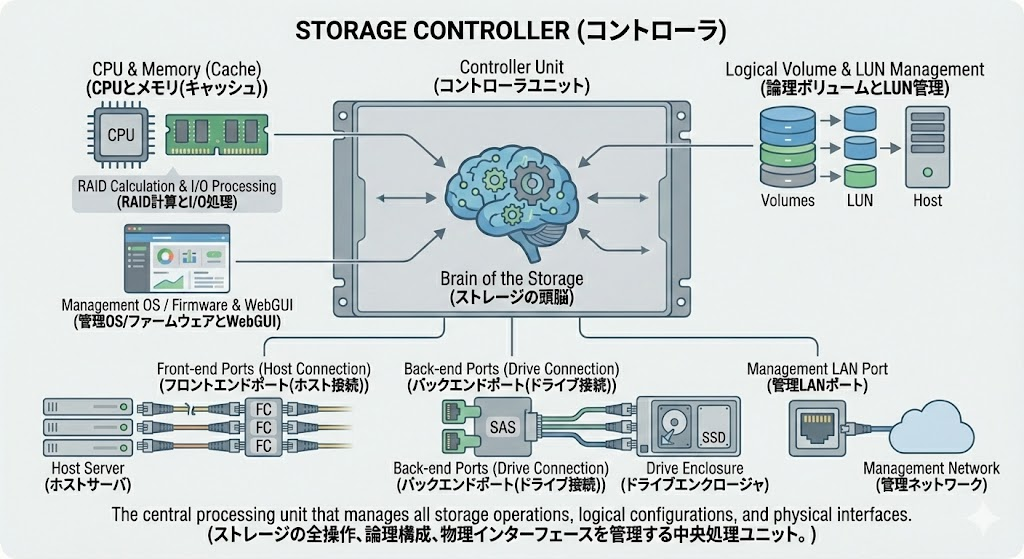

コントローラ

ストレージ装置の頭脳と呼べるユニットです。内部にはCPUやメモリ(キャッシュ)を搭載しており、RAID計算やデータの読み書き(I/O処理)を行います。

論理的な世界でボリュームを構成してLUNとしてホストに提供したり、管理画面(GUI)や監視機能といったソフトウェア的な機能も、このコントローラ上のOS/ファームウェアで動作します。

物理的なインターフェースとして、ホスト接続用のFCポート(フロントエンド)や、ドライブ接続用のSASポート(バックエンド)、管理LANポートなどもここに集約されています。

エンクロージャ

広義にはドライブを搭載するための「箱(筐体)」そのものを指します。

前面には多数のドライブスロットが並んでおり、ドライブは「キャリア(またはキャニスタ)」と呼ばれる専用の金具/マウンタに取り付けられた状態でスロットに挿入されます。これにより、電気的な接続を確実にするとともに、ストレージ装置を動かしたまま故障したドライブを交換する 「ホットスワップ(活性交換)」を実現しています。

なお、ストレージ本体(コントローラ筐体)とは別に、ドライブを増設するためだけの専用筐体のことを「拡張エンクロージャ(またはディスクエンクロージャ/DAE)」と呼び分けます。

ドライブ

HDD(Hard Disk Drive)やSSDなど、記憶媒体そのものを指します。現場では親しみを込めて 「玉(たま)」 と呼称することもあります。

一般的なPCであれば、OSが物理的なドライブを直接認識し、そこにファイルシステムを作ってデータを記録します。一方、ストレージ装置では、コントローラが複数のドライブを束ねて管理し、RAID(Redundant Arrays of Independent Disks) という技術を用いて、データを複数のドライブに分散して書き込みます。

単体のドライブに書き込むのではなく、チームでデータを守りながら保存するイメージです。RAIDの仕組みについては後述します。

ドライブには以下の通りいくつか種類があります。

- HDD

- SSD

- Nearline-SAS

大きくは上記の3種です。

HDDはプラッタと呼ばれる金属の円盤に磁性体を塗布し、その上にデジタルデータを書き込みます。回転する部品ですのでランダムアクセス性、耐久性共に劣ります。ただしコストは安いです。性能の指標は回転数であり、5,400rpm(Revolutions Per Minute)、7,200rpm、10,000rpm、15,000rpmと性能が上がっていきます。最高性能でも最近のSSDには遠く及びません。

SSDはNAND(Not AND)半導体素子にデータを記録します。回転部品を持たないため振動に強いです。モータなどの動作部品の消耗もありません。複数の記録素子を同時に扱えるために連続読み書きも、ランダム読み書きどちらもHDDの非にならないほど高速です。ただしコストも高いです。昔、SSDはその電気特性から長期保管に向いてないなどと言われていましたが、これは長く電源を入れてない場合に限られ、通常のストレージ装置の利用法では問題にならないでしょう。性能の指標としてSLC(Single Level Cell)、MLC、TLC、QLCとありますが、後ろに行くほど速度・品質は落ちますが、記録密度と費用対効果が向上します。エンタープライズ用途では高級品でMLC、一般用途ではTLCが主流でしょう。QLCはコンシューマ用途で利用が広がっていますが、品質と速度が著しく悪いです。

Nearline-SASはアーカイブ(長期保管、バックアップ)用の低速かつやや品質的に劣るが低価格のHDDだと覚えておけばよいです。

さて、このための種類ですが上記の記録方式以外にも性能に影響を与える要素があります。それは接続コネクタ形状と接続方式です。

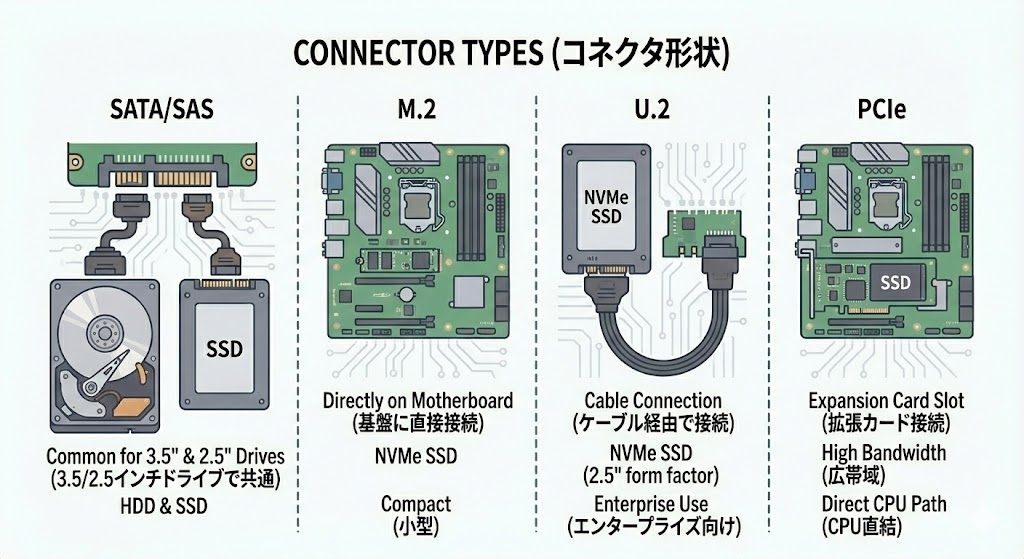

コネクタ形状

- SATA/SAS

- M.2

- U.2

- PCIe

コネクタ形状も含めて利用できるドライブが指定されるストレージ装置ではあまり意識しないかもですが、接続コネクタにも種類があります。通常はSATAとSASで共通して利用されるものが利用されます。3.5インチか2.5インチの箱に入っているドライブはこの形式のコネクタを利用します。HDDはこの形式しか選択肢がありません。エンタープライズ用途ではSATAは安価ですが品質に劣るためほぼ利用されません。SASコネクタはSATAと互換性はありますが、逆はありません。

M.2、U.2は接続方式のNVMeでよく利用されるコネクタです。前者は基盤に直接記録媒体を接続し、後者はケーブルを介して接続できます。ストレージ装置ではあまり意識させないかもしれません。

最後はマザーボードに拡張カードを接続するためのコネクタで、それをストレージ専用で利用するというというものです。広帯域が特徴です。

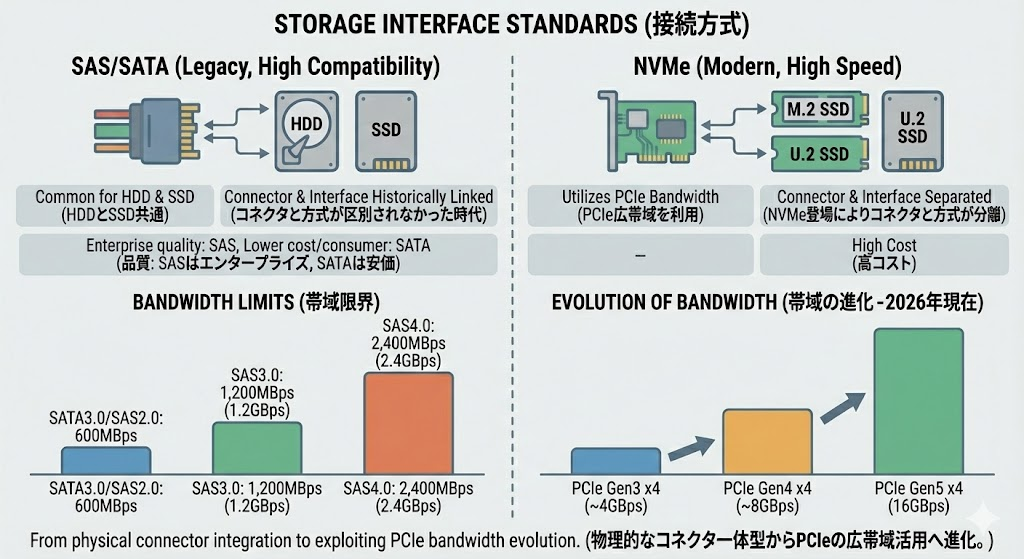

接続方式

- SAS/SATA

- NVMe

SAS/SATAはHDDとSSD共通で利用されます。コネクタと同名なのは、コネクタ形状と接続方式を区別されない時代があったからですね。後述するNVMeが登場したことにより、コネクタと接続方式が一意ではなくなりました。

SATA/SASはNVMeと比較して安価で互換性は高いですが接続帯域の限界はSATA3.0/SAS2.0の場合600MBpsです。SAS3.0は1,200MBps(1.2GBps)、SAS4.0は2,400MBps(2.4GBps)です。また、SATAとSASの違いは品質です。エンタープライズ製品ではSASが利用されます。

NVMeはPCIeの広帯域を利用する方式です。PCIe規格の進化と共に帯域が向上していきました。2026年現在で最高帯域は16GBps(PCIe Gen5 x4)にも達します。SAS方式と比較すると高コストです。

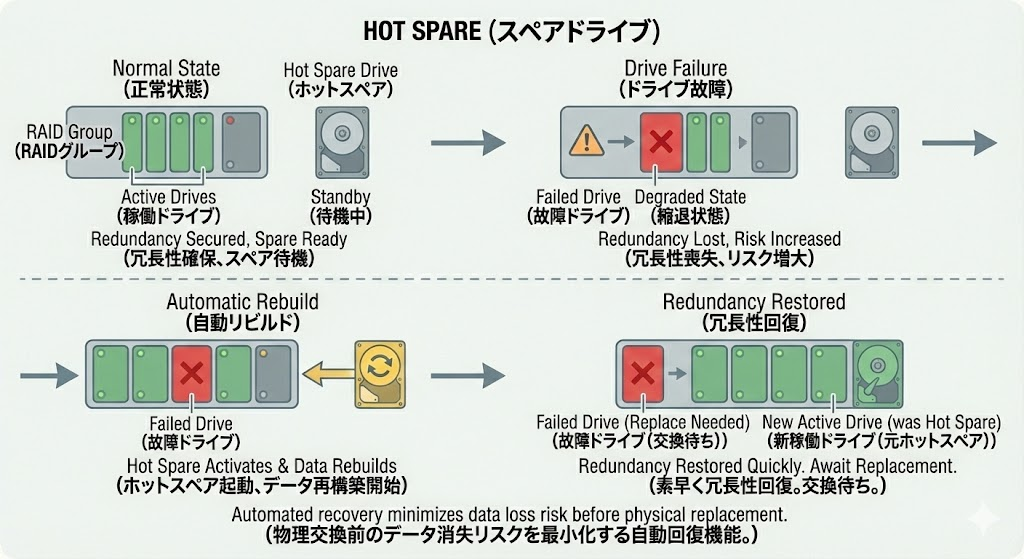

ホットスペア (スペアドライブ)

ドライブの冗長性を維持するための予備のドライブです。一般的には**「ホットスペア」と呼ばれます。

ボリュームの可用性はRAIDによって担保されますが、ドライブ故障時には冗長性が失われた(または低下した)「縮退(デグレード)状態」**となります。この状態で、交換を待っている間に追加で別のドライブが故障すると、データ消失(ロスト)に至るリスクがあります。

これを防ぐため、ホットスペアをあらかじめ搭載しておきます。ドライブ故障を検知すると、即座にこのホットスペアが起動し、失われたデータの復元・再構築処理(リビルド)が自動的に開始されます。エンジニアが駆けつけて物理的に交換するよりも早く冗長性を回復させ、データロストのリスクを最小限にします。

最近のストレージでは、予兆検知を行い完全にドライブが故障する前にスペアドライブと切り替えるということが行えるようになっています。

FAN

空冷による冷却装置です。回転する部品は消耗や故障が多いため交換しやすくなっています。

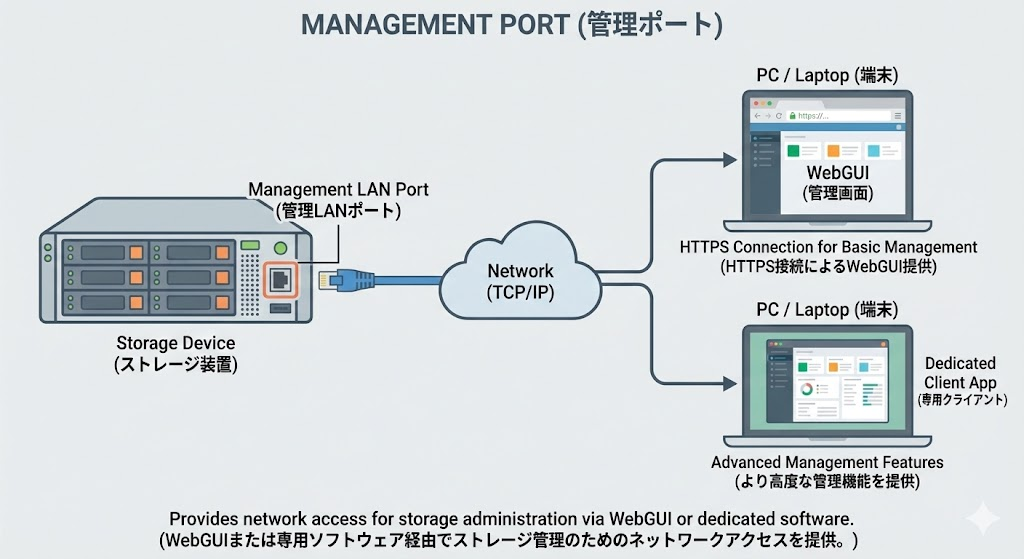

管理ポート

ストレージの管理画面に接続するためのLANポートです。TCP/IPで接続でき、HTTPS接続によるWebGUIを提供します。ストレージ装置によっては端末にインストールした専用のクライアントを本ポート経由で利用することで、より高度な管理機能を提供します。

FCポート

サーバにストレージ機能を提供するためのポート。2026年現在の最高帯域は128Gbpsとなっています。主流としては32Gbpsとなっています。

同ポートはコントローラ内、コントローラごとに拡張でき、サーバに導入したパス制御ソフトによって振り分けを行い、更なる広帯域、可用性を実現します。パス制御ソフトについては後述します。

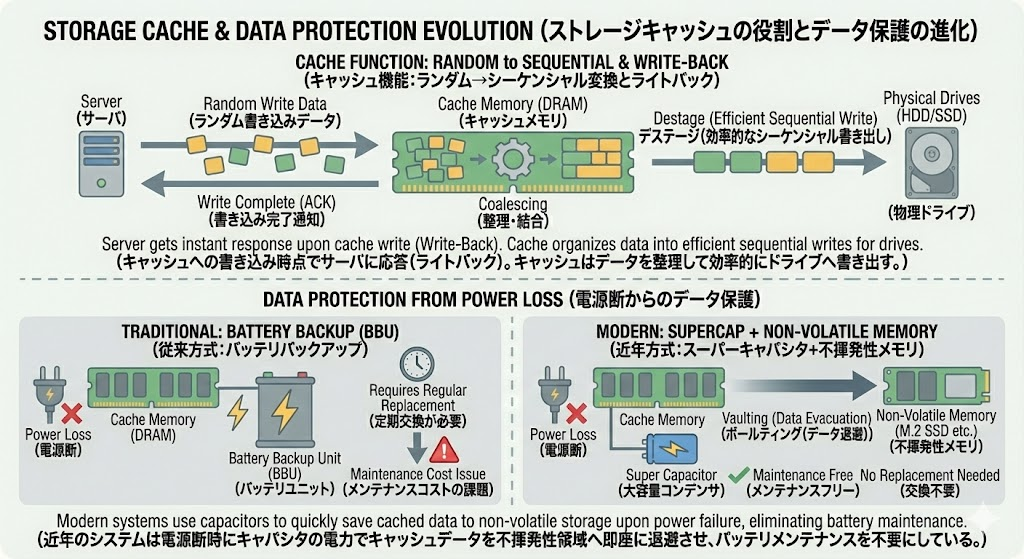

キャッシュ

多くのストレージは、データの書き込みを高速化するライト・キャッシュを備えています。

HDDなどの物理ドライブは、飛び飛びの場所にデータを書く「ランダムアクセス」が苦手です。ライト・キャッシュは、サーバからのランダムな書き込みデータを一旦メモリ上で受け取り、 整理・結合(コアレッシング)して、効率的なシーケンシャルなデータとしてまとめてドライブに書き出す(デステージする) ことで、ドライブの負荷を軽減し、全体的な処理速度を向上させます。

通常、ストレージは「ライトバック方式」で動作し、キャッシュにデータが入った時点でサーバに「書き込み完了」を通知するため、物理ドライブの速度に依存しない高速な応答が可能です。

しかし、キャッシュ(DRAM)は揮発性メモリであるため、そのまま電源が落ちるとデータが消失します。

これを防ぐため、かつては バッテリ(BBU) を搭載してメモリへの給電を維持する方式が主流でしたが、バッテリの定期交換コストが課題でした。

近年は、 スーパーキャパシタ(大容量コンデンサ) と 不揮発性メモリ(M.2 SSD等) を組み合わせた方式が主流です。電源断を検知すると、キャパシタの電力を使ってキャッシュデータを即座に不揮発性領域へ退避(ボールティング)させる仕組みで、これによりバッテリの定期交換を不要(メンテナンスフリー)にしています。

ストレージキャッシュについては以下の記事が詳しいです。

論理構成要素詳細

ストレージの理解にはボリュームをはじめとした論理的な考え方を理解することが肝要です。ここを理解しておけば、ストレージエンジニアの唱えてくる念仏の意味が理解できます。

先述したようにストレージ装置は搭載されたドライブをそのままサーバやその上のOSに渡すのではなく、一度論理的に結合と分離がなされます。

なぜわざわざそのようなことをするのかというと、可用性、性能性、拡張性を獲得するためです。

可用性や性能性はRAIDによって実現されます。拡張性はプールやLUNによって実現されます。

ストレージ装置は複数のドライブをRAIDによってまとめられ、さらにプールによって仮想的な塊に合成されます。それを使いやすいサイズに切ってLUNとしてサーバに渡します。このLUNが通常のPCのHDDやSSDのようにOSから見えるようになります。

RAIDボリューム

複数のドライブを一つの塊にします。その目的は可用性と性能性と述べました。

RAIDの可用性は大きく2種類の機能で実現します。ひとつはミラーリングです。ミラーリングはその名の通り別のドライブにデータを丸々コピーすることです。データ容量あたりのドライブ容量が2倍必要になります。

もう一つはパリティと呼ばれる方式で、1つのドライブが故障したときに復旧するためのデータを構成するドライブ全部に分散配置するという方式です。こちらは構成によっては可用性のために必要な追加のドライブを1つだけにできます。パリティは計算にプロセッサパワーを使うため、ミラーリングよりも性能が落ちます。※最近はハードウェア支援で性能低下は軽減されています。

続いて性能性です。こちらはストライピングという技術を利用します。複数箇所にデータを散らして記録するために、複数のドライブからの同時読み出しができることによる性能向上を期待します。なお読み取りほどではないですが、書き込み性能も増加します。

RAID種類と特製を以下に挙げます。

| # | 名前 | ミラー | ストライピング | パリティ | 可用性 | 特徴 |

|---|---|---|---|---|---|---|

| 1 | RAID0 | × | ○ | × | × | 可用性はないがストライピングで性能が高い |

| 2 | RAID1 | ○ | × | × | ○ | ミラーリングによる可用性。容量効率は良くない |

| 3 | RAID5 | × | ○ | ○ | ○ | ストライピングと可用性を備える。1台までの故障に耐える。パリティDISK+1で構成できるため容量効率が最も高い |

| 4 | RAID6 | × | ○ | ○ | ◎ | ストライピングと可用性を備える。パリティDISKを2台必要とするが2台までの故障に耐える |

| 5 | RAID10 | ○ | ○ | × | ○ | ストライピングと可用性を備える。 |

| 6 | RAID50 | × | ○ | ○ | ○ | RAID5をRAID0でストライピングする。RAID5の書き込み性能を改善するが、RAID5の塊ごとにパリティDISK分の追加玉が必要 |

RAID2、RAID3、RAID4、RAID0+1は性能、容量効率が上記より劣るため、実質利用されない。詳細は以下を参照のこと。

エンタープライズ製品ではではデータベースなら性能重視でRAID10、可用性・容量効率重視ならRAID6が主流となります。

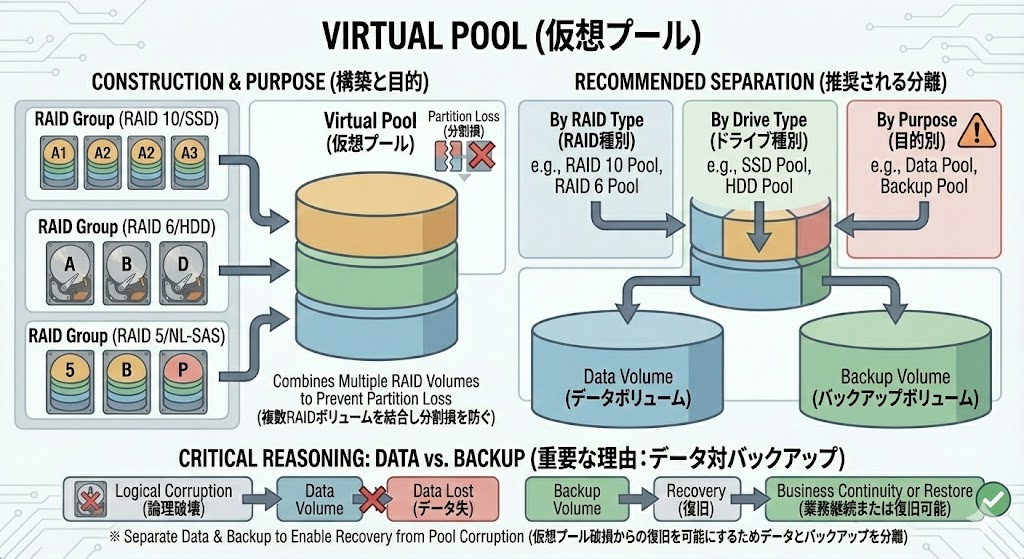

仮想プール

複数RAIDボリュームを固めて仮想プールを作り出す。目的はRAIDボリュームが特定ドライブの台数パターンに固定されるため、分割損が出ることを防ぐためです。プールは以下の目的別に分けることが推奨されます。

- RAID種

- ドライブ種

- データやバックアップなど目的別

そもそもRAIDは異なる種別のドライブで構成することは大幅な性能低下をもたらすため、ドライブ種はRAIDボリューム内で統一されます。RAID種とドライブ種を分けることは意識しない。重要なのはデータボリュームとバックアップボリュームを必ず分けることです。確率は決して高くないですが、仮想ボリュームの論理破壊が起こると仮想ボリュームの単位でデータが失われるためです。その際、データボリューム、バックアップボリュームどちらかが残っていれば、運が良ければ業務が継続され、最悪バックアップデータから復旧できるためです。

LUN

ストレージ装置によって論理的かつ最終的にサーバに渡されるドライブの単位です。受け取ったサーバ、OSはそこに直接パーティンション・ファイルシステムを書き込んだり、LVM(Logical Volume Manager)で更に仮想ボリュームを構成したりします(RAWとして使う場合もある)。LVMについてここで語ると長いため割愛します。

その他ストレージの機能

LUNマスク

特定LUNを特定ホストの特定パスにだけにしか見せない機能です。セキュリティ的な意味もありますが、ホストに余計なドライブを見せないことで事故を防ぐ目的もあります。ベンダごとに読み方が異なります。いずれもグルーピングやエイリアスを付けるかどうかなど細かい違いはあれどLUNとサーバのWWPNを紐付けます。

LUNマスクに限らないですが、以下の表のようにベンダによって機能の呼び方が違います。

| # | ベンダ | 主な用語/概念 | 特徴・補足 |

|---|---|---|---|

| 1 | デル (PowerStore/PowerMax/Unity) | Host Mapping / LUN Mapping | |

| 2 | HPE (Alletra/Primera/3PAR) | Export / Host Set | |

| 3 | NetApp (ONTAP) | LUN Mapping / igroup | |

| 4 | IBM (FlashSystem/DS8000) | Host Mapping / Mapping | |

| 5 | Hitachi Vantara (VSP) | LUN Mapping (LUマッピング) |

WWN/WWPN

ストレージ関連する機器やポートを特定するためのIDです。ゾーニングやLUNマスクなどで特定のポートを指定する際に利用します。

ストレージレプリケーション

ストレージ内のデータをLUN単位でコピーします。様々な方式がありますが、大きく以下の違いがあります。

- 筐体内

- 筐体間

前者はサイト内バックアップの用途で利用します。後者は遠隔地保管などで利用します。遠隔地保管する場合はFCケーブルでは長距離接続が出来ないため、FCIPスイッチなどでTCP/IP通信に変換して、LAN(Local Area Network)を通じてWAN接続をして長距離通信を実現します。

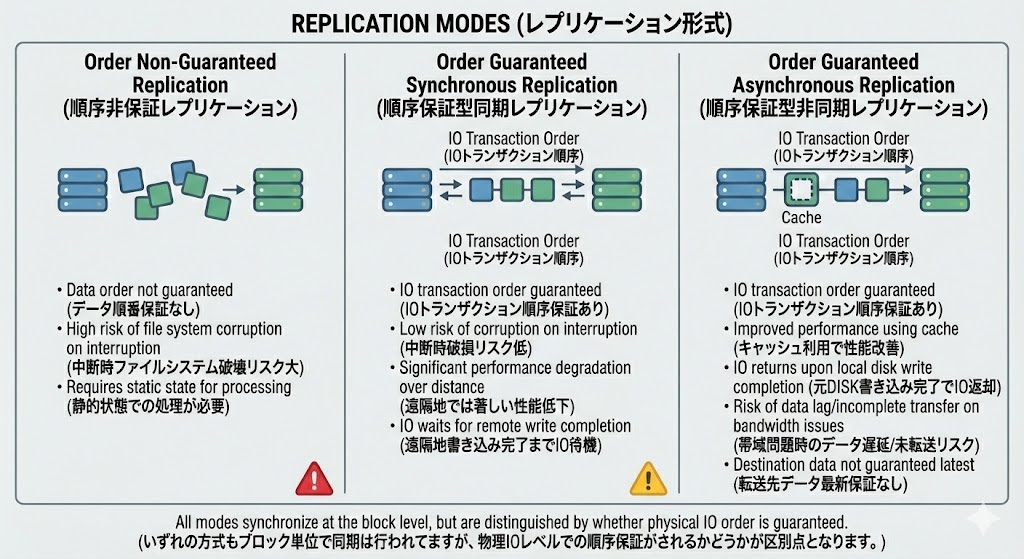

また、コピー、すなわちレプリケーション形式には以下の方式があります。

- 順序非保証レプリケーション

- 順序保証型同期レプリケーション

- 順序保証型非同期レプリケーション

順序非保証レプリケーション方式は、データ順番が保証されません。故にデータ書き込み最中にレプリケーションが中断すると、ファイルシステムがほぼ確実に破壊されます。故に静的な状態にしてからの処理が必要になるという制約があります。

順序保証型同期レプリケーションはストレージのIOトランザクション順序が保証されます。よって、途中でレプリケーションが分断されても、ファイルシステムが(滅多に)破壊されません。ただし、遠隔地でこの機能を利用すると、遠隔地側の書き込みが終了するまでIOが返ってこなくなるため、性能が著しく低下します。

順序保証型非同期レプリケーションは、上記の同期レプリケーションの順序性を残しつつ、性能改善を図ったのがこの非同期方式です。転送元IOデータをキャッシュしておき、レプリケーション元DISKの書き込みが完了した瞬間、IOを返します。性能の犠牲は最低限抑えられますが、非同期でデータが転送されるため、転送のための帯域が極端に遅かったり、切れたりすると、データが送りきれない状態になります。また、転送先のデータが最新であるかどうか保証されないというデメリットもあります。

いずれの方式もブロック単位で同期は行われてますが、物理IOレベルでの順序保証がされるかどうかが区別点となります。

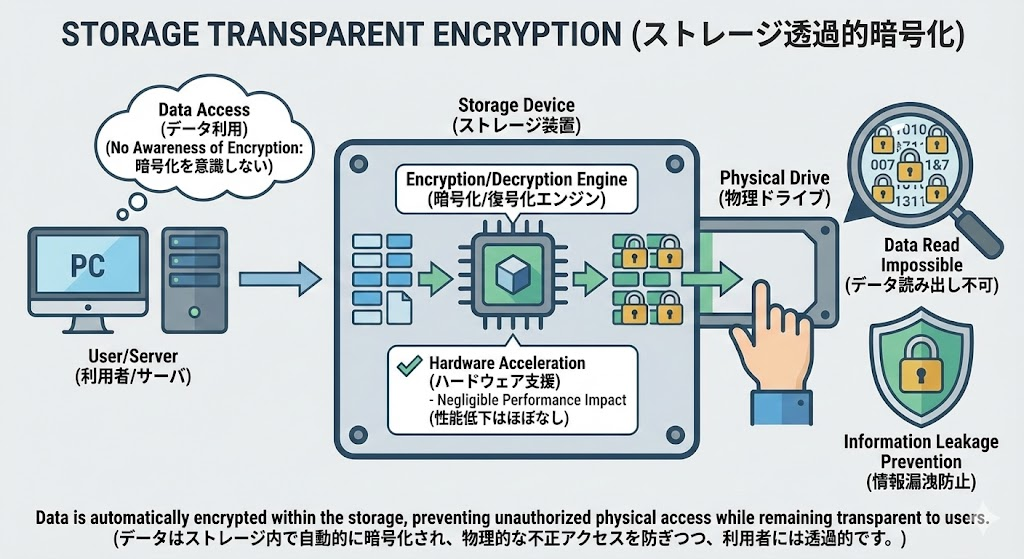

暗号化

ストレージでは透過的暗号化が行われます。データを利用する側は暗号化されていることを意識しないですが、例えば、特定の物理ドライブを引っこ抜かれて持って行かれても、物理レイヤのデータは暗号化されるため、データの読み出しが出来ず、情報漏洩を防ぐことが出来ます。昔は暗号化による性能低下がありましたが、ここ最近はハードウェアによる支援により暗号化による性能低下はほぼ気になりません。

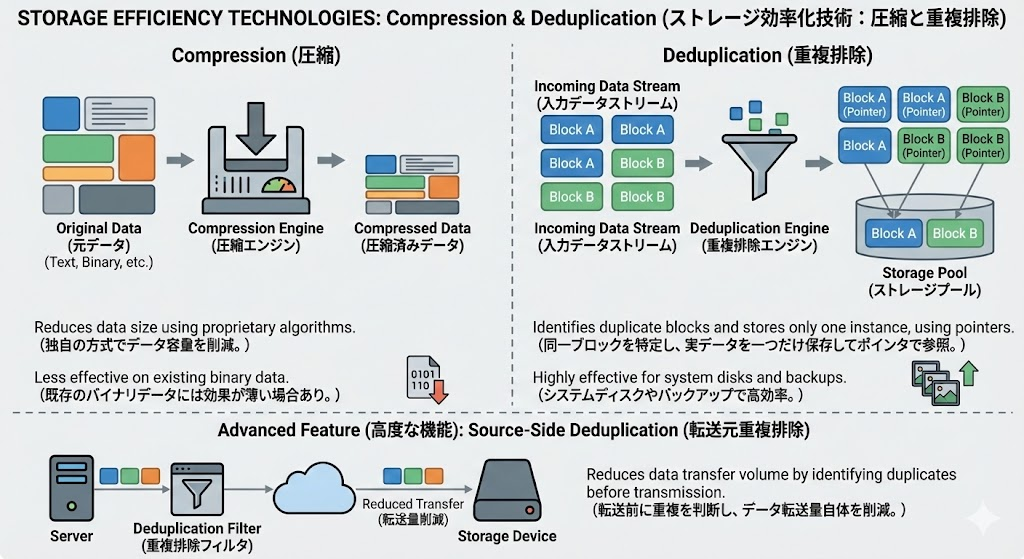

圧縮・重複排除

ミドルレンジ以上のストレージに備わっていることがあるデータ容量の効率性を挙げるための技術です。

圧縮は、その名の通りデータを独自の方式で圧縮する機能です。格納するデータがバイナリデータの場合、圧縮効率がそれほど上がらない場合あります。

重複排除は、少し概念が難しいですが、ブロック単位で同じデータがある場合はフラグだけ立てておいて、実データを一つだけしか持たないという技術です。システムディスクやシステムディスクのバックアップなど同じデータ配置・ブロックのものが大量に保存されるボリュームの場合、高効率でデータ容量の節約出来ることがあります。高度なストレージになると、データ転送前に重複排除対象のブロックかどうか判断してデータ転送自体を削減できるものもあります。

以上がストレージ装置の主な機能群でした。

FCスイッチ

続いての構成要素FCスイッチです。ストレージ装置とサーバの間に設置されます。ストレージに接続できるFCコネクタは数が限られているため、このFCスイッチで接続ポートを拡張します。

サーバ台数が極端に多くない限り、冗長化したいパス単位でFCスイッチを用意します。可用性対策を実現したいのであれば、最低2台用意します。

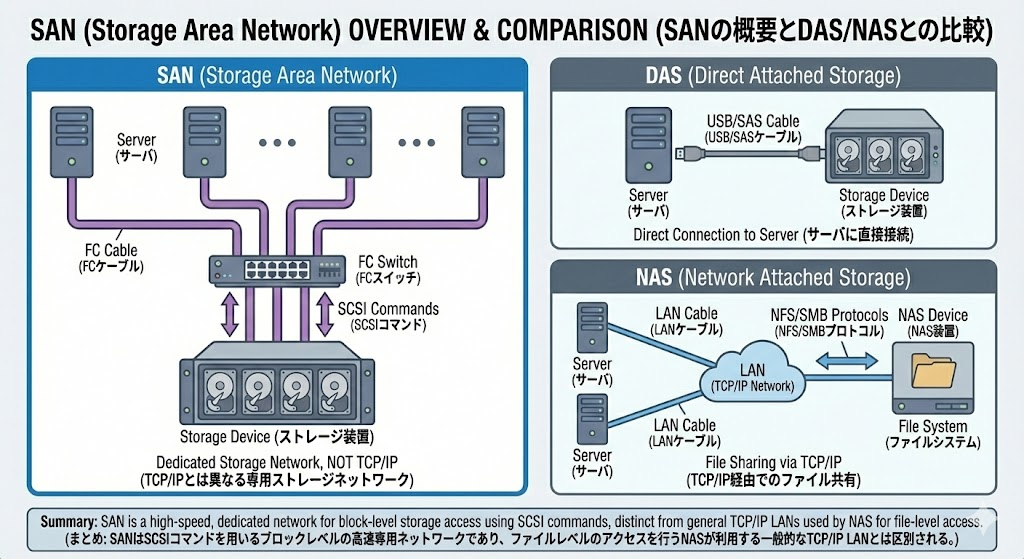

SAN

FCスイッチとストレージ装置とサーバの関係性を理解するにはSAN( Storage Area Network)を理解します。ネットワークを名乗っていますが、TCP/IPが流れるネットワークとは明確に区別され、いわゆるネットワークではなくストレージ技術に分類されます。SANではTCP/IPの代わりにSCSIコマンドがやりとりされます。

対比される言葉として、DAS(Direct Attached Storage)、NAS(Netork Attached Storage)がありますが、前者はストレージ装置を直接USB等でサーバに接続する方式で、後者はTCP/IP上にNFSやSMBプロトコルを使って直接ファイルシステムを操作します。

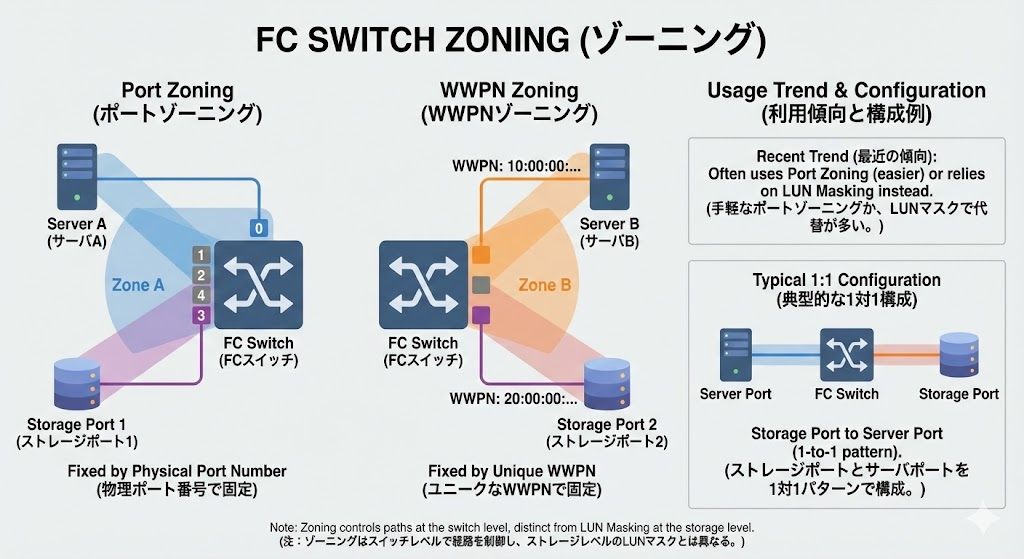

ゾーニング

LUNマスクと似たような技術ですが、FCスイッチ上でポートごとの経路を限定させます。方式にはポートゾーニングとWWPNゾーニングがありますが、前者はゾーニング対象をFCスイッチのポートで固定させて、後者はFCスイッチのポートが持つWWPNで固定します。ここ最近は手軽なポートゾーニングか、LUNマスクがあるためそもそも利用しないということが多いようです。利用する場合はストレージパス向けポートとサーバ向けのポートを1対1パターンごとに構成します。

ゾーニングについては以下の記事が詳しいです。

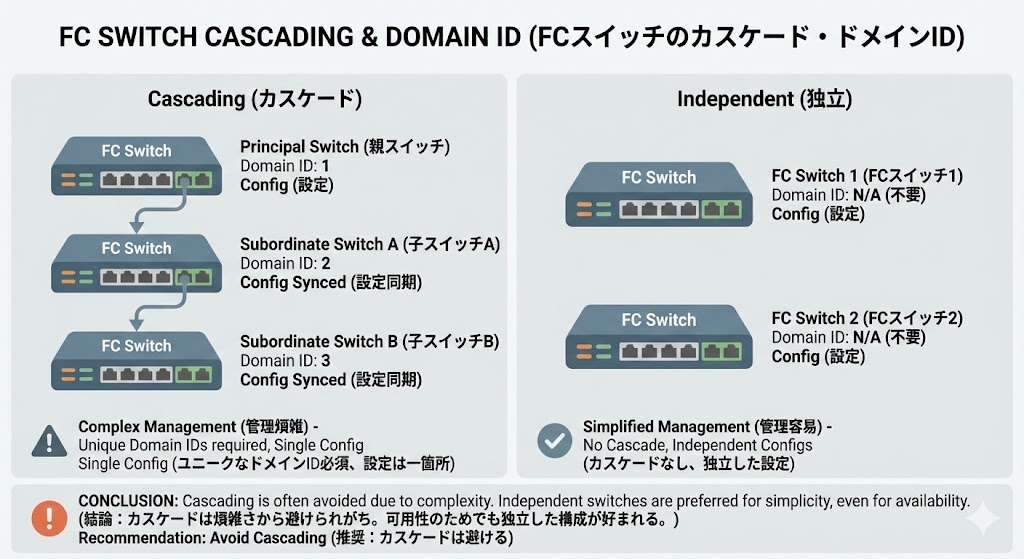

カスケード・ドメインID

結論だけ言うと、管理が煩雑になるため極力避けます。FCスイッチ同士を接続する場合、FCスイッチごとにドメインIDを意識させてどのスイッチが親になるかを決めます。各スイッチのドメインIDはユニークでなければなりません。スイッチの設定をするためのconfigは親だけ持ちます。

可用性対策のためスイッチを複数台用意してもFCスイッチ同士を接続せず独立させておけば、このカスケード・ドメインIDは意識せずに済みます。カスケードによる集合管理やトランキングは便利な機能ですが、管理の煩雑性から避けるエンジニアが多いです。

市場の大部分はBrocade社(Broadcom)のOEM製品ですが、Cisco Systems社もMDSシリーズというFCスイッチを提供しています。ほとんどのシチュエーションに於いて、コマンドや機能などの知識を使い回せます。

FCケーブル

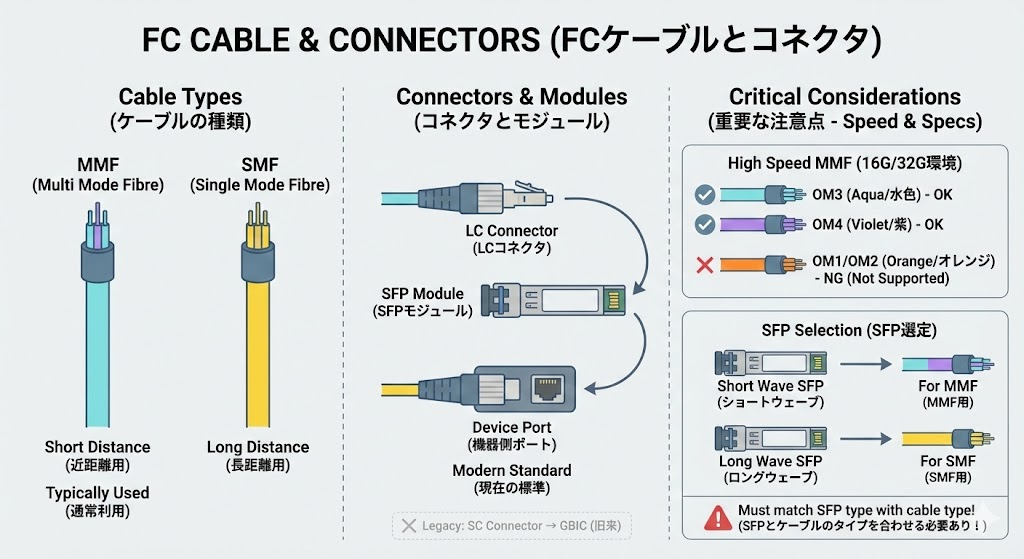

専用のケーブルを利用すると思いきや、ネットワークで利用するMMF(Multi Mode Fibre: 近距離用)やSMF(Single Mode Fibre: 長距離用)ケーブルが利用できます。通常はMMFを利用します。

ケーブル側のコネクタはLC(Lucent Connector)を用い、ストレージ装置やホストのFC-HBA側はSFP(Small Form Factor Pluggable)モジュールタイプが利用されます(昔はSC(Subscriber Connector)を用いて、GBIC(Gigabit Interface Converter)に接続していた。SFPはかつてMini-GBICと呼ばれていた)。

注意点として、昨今の高速なFC環境(16G/32G)では、MMFケーブルの中でも広帯域に対応した「OM3(水色)」や「OM4(紫)」規格のものを選ぶ必要があります。古い「OM1/OM2(オレンジ色)」のケーブルは使用できません。また、挿入するSFPモジュールもケーブルに合わせて「ショートウェーブ(MMF用)」か「ロングウェーブ(SMF用)」かを選定する必要があります。

FCIPスイッチ

先述した遠隔地筐体間レプリケーションに利用します。FC通信をTCP/IP通信に変換します。具体的にはSCSIコマンドをTCPでカプセル化して通常のネットワークを超えられるようにします。ストレージ装置によってはストレージ内にこの機能を有している場合があり、その場合、FCIPスイッチは不要になります。

FC-HBA

先の一覧には登場していませんがおまけです。ホスト側のFCインタフェースを提供するのがこのFC-HBA(Host Bus Adaptor)です。通常サーバあたり2枚搭載して、カード単位の故障に備えます。カードは高度なファームウェアを持ち、速度を固定するか、自動認識するか、SANブート設定などが行えます。

FCスイッチと同様、FC-HBAもQLogic社(現Marvell)とEmulex社(現Broadcom)による寡占状態です。

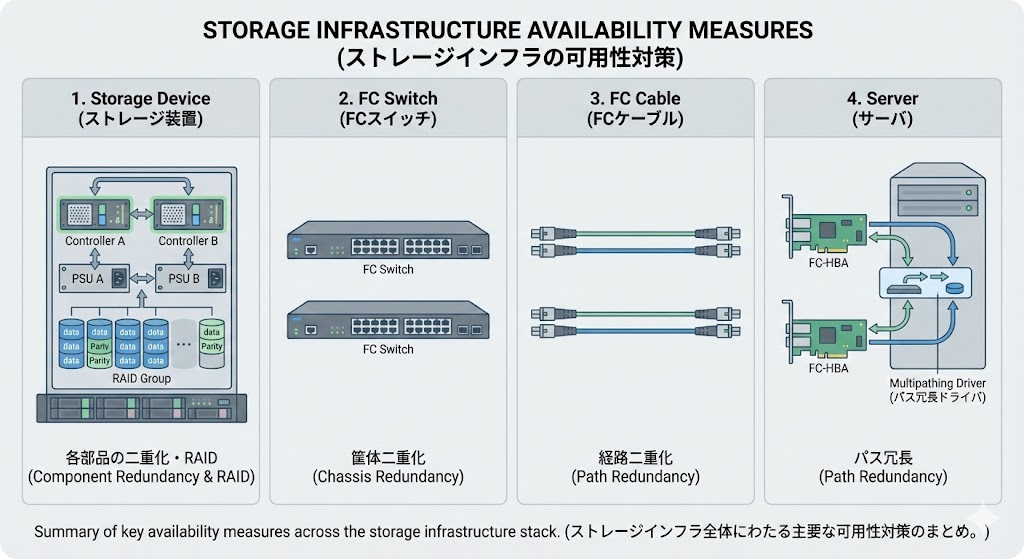

可用性対策

ストレージ技術を支える可用性対策はこれまでの章でも語られてきましたが、改めて以下に整理します。

| # | 名前 | 機能名 |

|---|---|---|

| 1 | ストレージ装置 | 各部品の二重化・RAID |

| 2 | FCスイッチ | 筐体二重化 |

| 3 | FCケーブル | 経路二重化 |

| 4 | サーバ | パス冗長 |

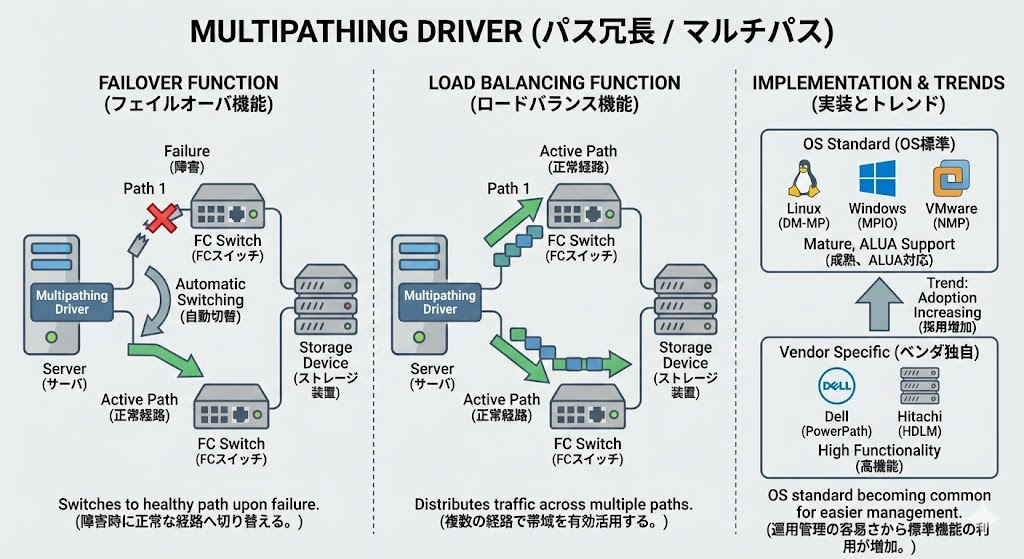

パス冗長 (マルチパス)

サーバのOSや仮想化基盤のハイパーバイザにインストールするドライバソフトウェアです。

FCスイッチやケーブルの障害時に、別の正常な経路へ通信を即座に切り替える「フェイルオーバ機能」と、複数の経路を同時に使って帯域を有効活用する「ロードバランス機能」を提供します。

実装には、OS標準のもの(LinuxのDM-MP、WindowsのMPIO、VMwareのNMP)と、ストレージベンダが提供する独自のもの(Dell PowerPath、Hitachi HDLMなど)があります。

かつては高機能なベンダ独自製品が必須とされることが多かったですが、近年はOS標準機能も成熟し(ALUAなどの最適パス制御に対応)、OSアップデート時の運用管理を容易にするため標準機能を利用するケースも増えています。

ここで語りきれなかった要素

入門編を超えてしまう内容、あるいは運用設計に踏み込む内容になるため割愛しましたが、現場では以下のキーワードも頻出です。

- 効率化・性能機能: シンプロビジョニング、QoS、自動階層化制御(Tiering)

- データ保護: スナップショット(CoW/RoW)、イミュータブル(ランサムウェア対策)

- 高度な制御: SCSIリザベーション(排他制御)、コンシステンシ・グループ(整合性維持)

- 新しい接続方式: NVMe-oF、CSI (コンテナ連携)

おわりに

そんなに要素がないだろうと思って記事を書いてみましたが、意外と大作になってしまいました。現代的な技術を含めてすべては説明し切れていないですが、ストレージ技術で最低限知っておくべき内容は網羅できていると思います。ストレージサイジングについても語るべきことはたくさんあるので、改めて記事にしたいです。

皆様が今後ストレージ装置の設計・構築をする際の参考になれば幸いです。

以上