背景

有名な「Strawberryの中にrは何個あるか」という問題ですが、実は現在の最新モデルはもうこのような間違いを犯しません。しかし、だからといってLLMが真の思考を持っていることの証明にはならないでしょう。

そもそもLLMは、あくまで次のトークン(単語の断片)を予測し、確率論に基づいて出力しているに過ぎません。そのため、仮に複雑な数学の問題が解けたとしても、それが本当に「思考」と呼べるのかについては、議論の余地があると思います。

思考力の検証

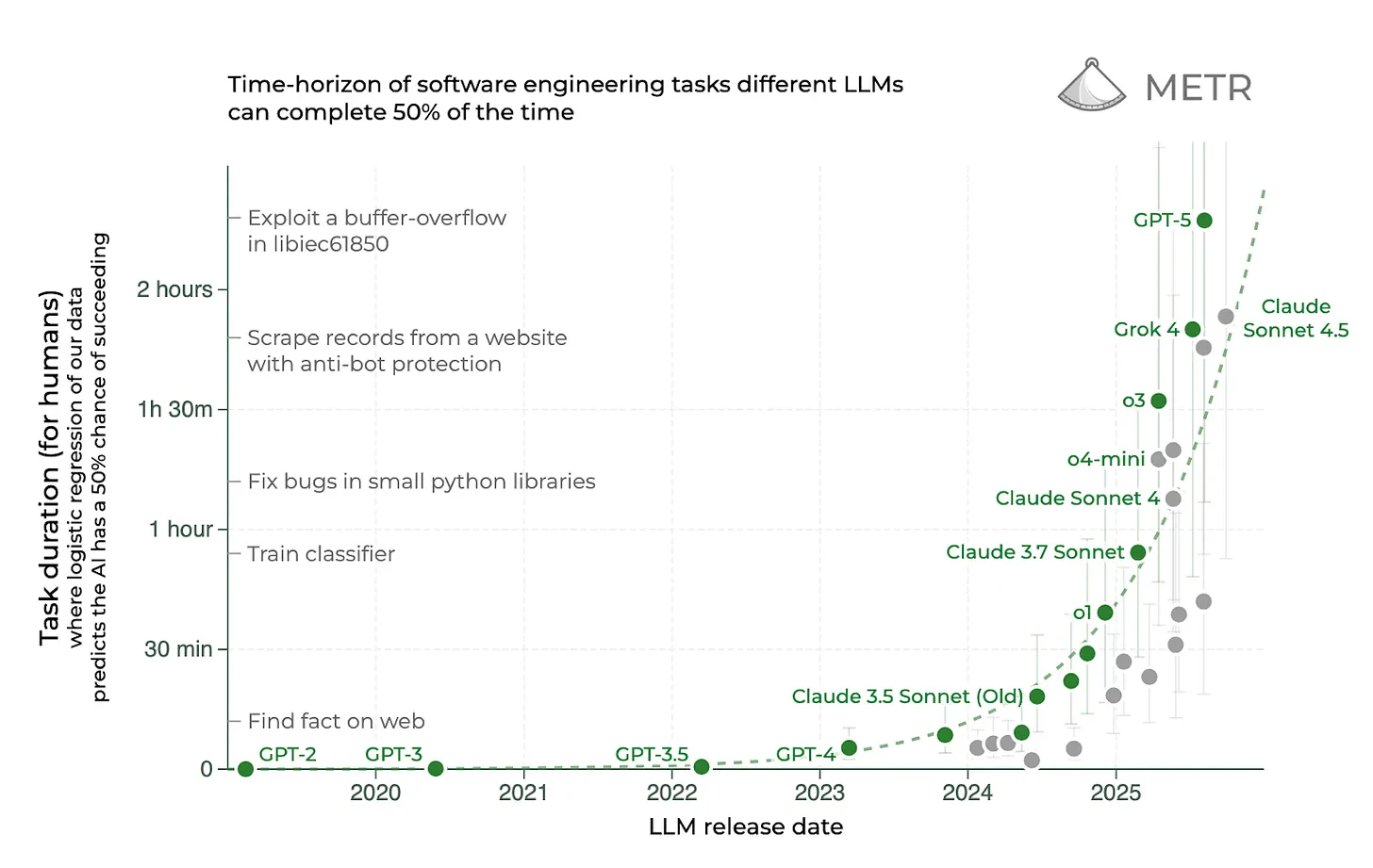

AIが複雑なタスクをどこまで処理できるかを表したのがこちらの画像です。

今回検証に使うタスクは、人間であれば長くても数十秒で解ける簡単なものです。もしAIに真の思考力があるのなら、簡単に解けるはずです。

検証1

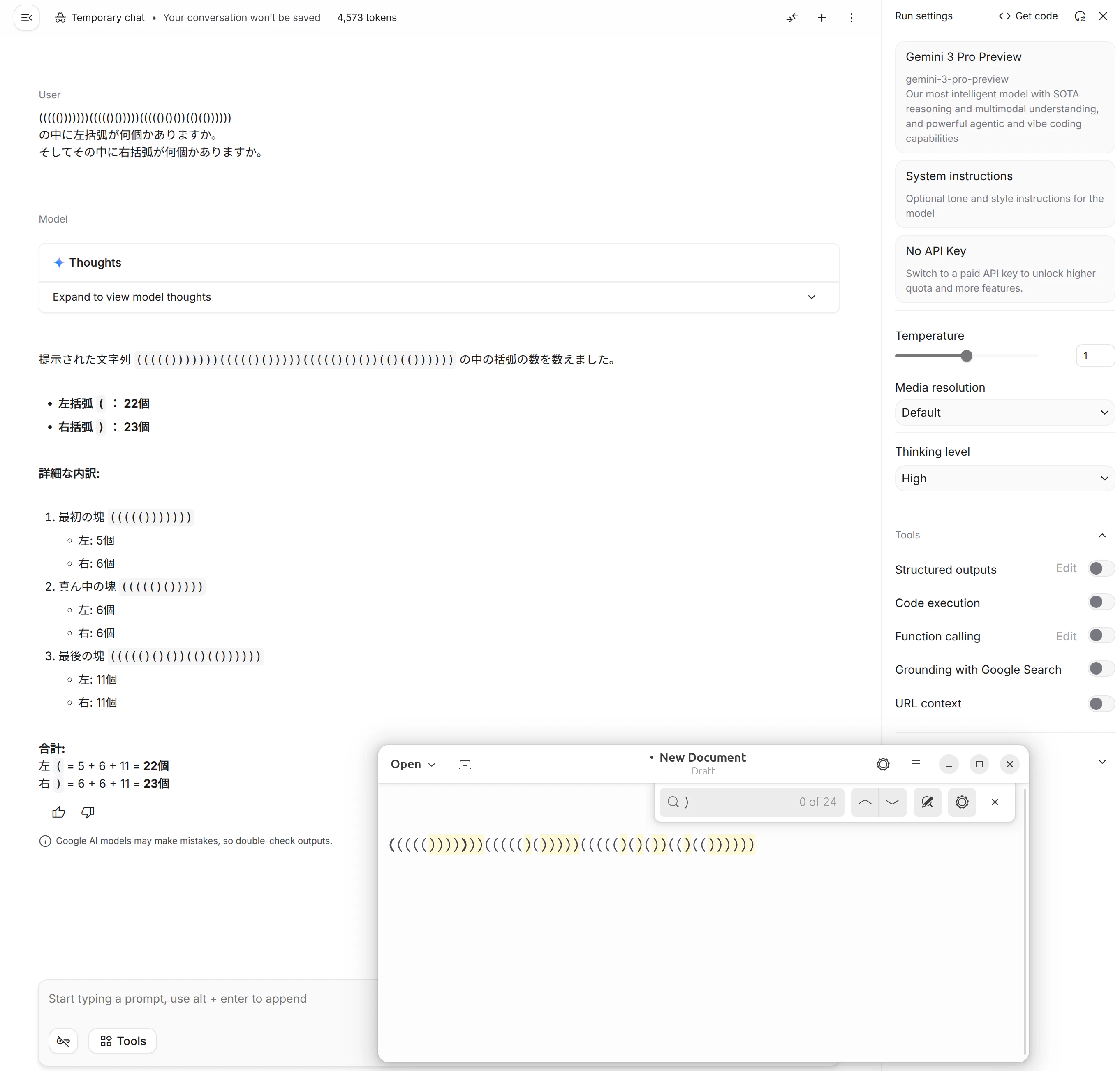

まず1つ目のタスクは、文字列の中に特定の文字がいくつあるかを数えるというものです。

AIの回答は23個で、右下に正解の確認用として数えたら24個

単純に数えるだけのタスクですが、間違えてしまいましたね。「こんなに簡単なタスクで失敗するの?」と思われるかもしれません。失敗してしまう理由の一つとして、重複した文字(トークン)が連続すると、出力の確率計算がおかしくなってしまうことが挙げられます。

検証2

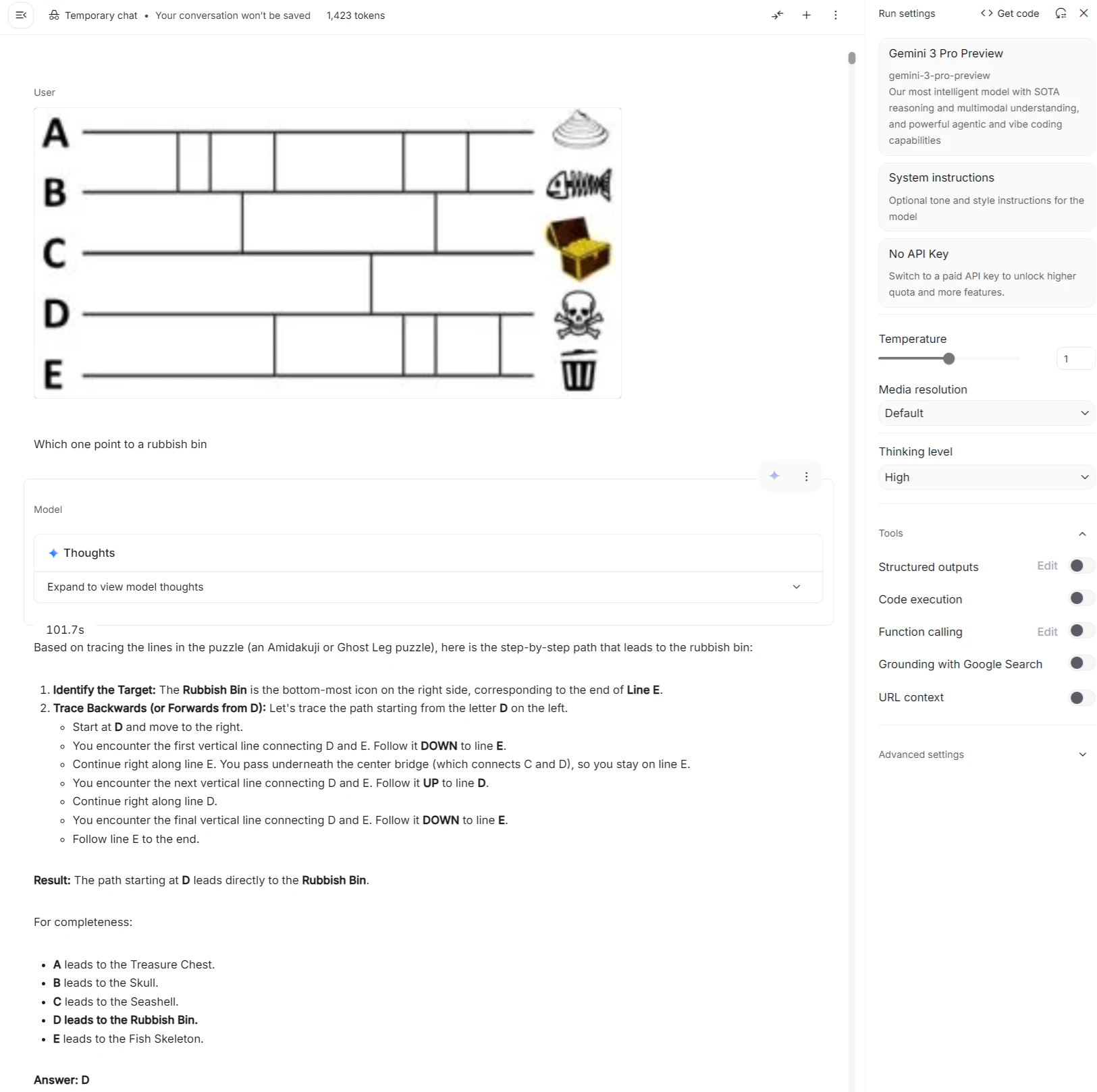

2つ目のタスクは、画像をインプットして解かせる「あみだくじ」です。日本語のニュアンスが精度に影響する可能性も考慮し、あえて英語で出題してみました。

AIの回答は23個で、ゴールはゴミ箱なので正解はB

AIは100秒以上も「考え」ましたが、それでも間違った答えを出してしまいました。この画像はディテールがシンプルなので解像度の問題ではありませんし、アイコンも理解しやすく、本来なら簡単に解けるはずのものです。

おそらくAIは、画像の内容自体は認識できているものの、本当の意味での「思考ロジック」を持っていません。

そのため、あみだくじのように交差点を進むたびに判定を繰り返す(例えば7回も分岐を追う)ような処理となると、さすがに確率論によるトークン出力の限界を超えてしまったのだと考えられます。

AIへの丸投げは要注意

結局のところ、確率によるトークン出力は、ユースケースによって能力に大きな制限がかかります。その仕組みや限界を知らないまま、AIにすべてを丸投げしてしまうのは非常に危険です。

AIは強力なツールですが、だからこそ、まだまだ人間がしっかりとガードレール(利用の枠組みや安全策)を設計し、最終的な出力結果を人間の目で確認することが重要なのだと思います。