はじめに

ブロックチェーン上には取引の記録を始めとした無数のデータが存在します。

データがあれば分析したくなるのが人の性、海外ではCrypto Data Analystが生まれ始めています。

ブロックチェーンは柔軟に分析できるデータの持ち方をしておらず初歩的な集計でも長時間を要します(About The Graph)。

分析のためには、ブロックチェーン外(オフチェーン)にデータを保持するデータ分析サービスを利用するのが一般的です。

後述しますがDune Analytics、The Graph...といったサービスが存在します。

データ分析のユースケース

C向けもB向けも問わず様々なユースケースが考えられます。

- 投資を検討するVCやヘッジファンドの意思決定サポート

- DAppsを運営する企業がKPIモニタリングに利用

- トークングラフ等のマーケティングへの活用、レコメンド

- ブロックチェーン上の犯罪追跡

- いわゆる「勝ってる」投資家の保有銘柄の閲覧

- ブロックチェーンの学習

- 様々な切り口で眺めることで、従来は研究か取引でしか把握できなかった細かい部分まで理解できます

- その他色々

サービス一覧

それではブロックチェーンのデータ分析サービスはどういったものがあるのでしょうか。

有名どころだと下記のようなサービスがあります。

| クエリの発行方法 | Web APIの対応 | データのエクスポート先 | |

|---|---|---|---|

| 自前でフルノード運用 | 実装次第 | 実装次第 | 実装次第 |

| Dune Analytics | SQL | ✗ | CSV(有償) |

| Nansen | ✗ | ○ | CSV(有償) |

| The Graph | GraphQL | ○ | 実装次第 |

| BigQuery | SQL | ✗ | 実装次第 |

A Comparison of Crypto Data Providers and APIs / Querying Ethereum Blockchain / Blockchain analytics

まず最も素朴な選択肢は自前でブロックチェーンのフルノードを運用する方法です。

フルノードを手元に落としてくるか、ノードホスティングサービス(ex. Quicknode)を利用します。

データ分析の自由度はありますがコストはとても高いです。

自前はトゥーマッチなので、一般的にはDune Analytics等のSaaSを利用します。

これらは従来のデータ分析同様、クエリ(ex. SQL)を発行することでデータ分析が可能です。

今回の記事では、日本でも紹介記事の多いBigQuery / Dune Analytics / The Graphをピックアップしてご紹介いたします。

補足:他のデータ分析サービスも気になる方向け

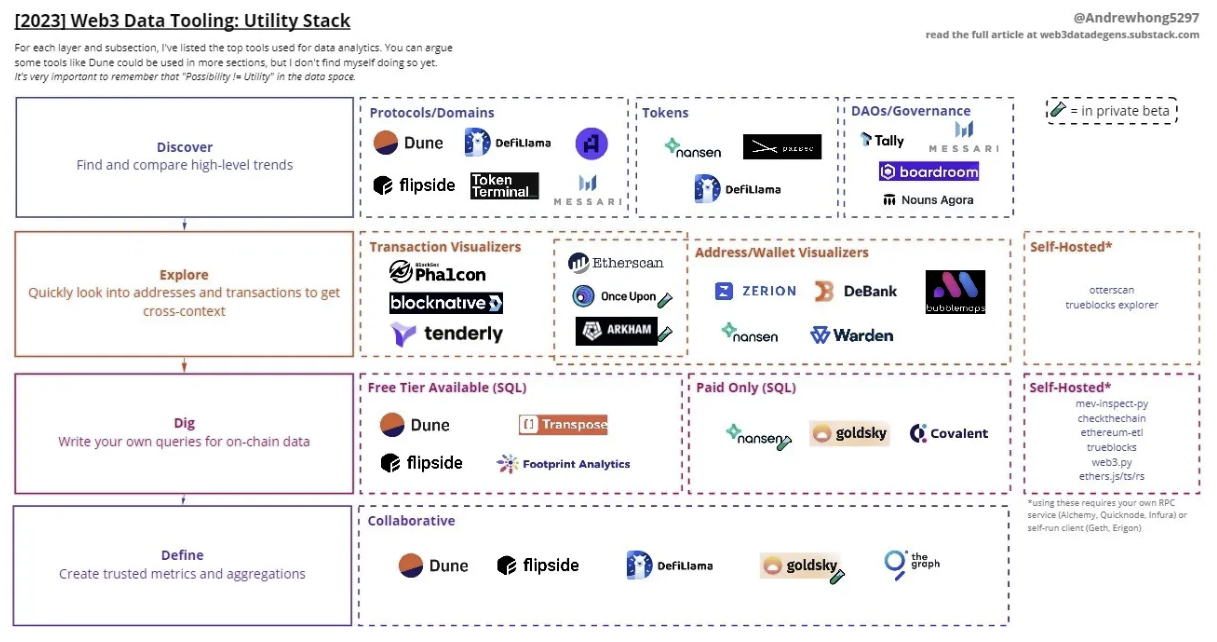

Andrew Hongのブログ記事中の図がデータ分析における川上から川下まで俯瞰しやすくオススメです。

今回紹介するサービスの他にも様々なものが網羅されています。

1. BigQueryで分析する

説明不要、Google CloudのDWHサービスです。

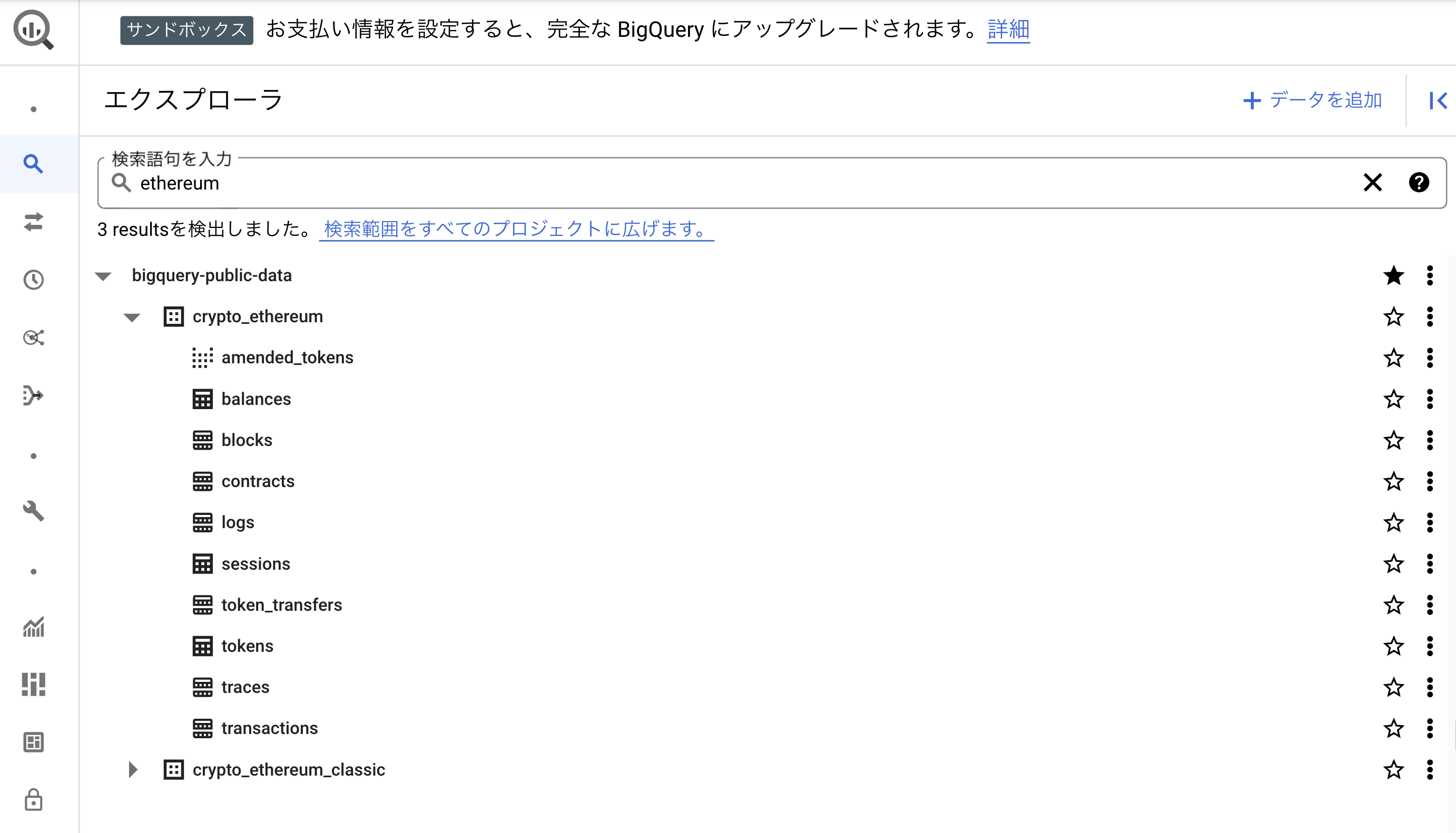

BigQuery(BQ)にはイーサリアムの公開データセットが備わっています。

多少の遅延はありつつリアルタイムで更新されており、通常のBQ同様SQLを発行して分析できます。

普段からBQやSQLに慣れ親しんでいる場合、新たに環境を準備する必要がなくすぐに利用できるメリットがあります。

一方で生に近いデータセットしかないことやクエリの従量課金については注意が必要です。

BQについてはデータセットを利用するだけなので細かい説明はしません。

試したい方はQuery Ethereum Blockchain with SQL in Google BigQueryが詳しいです。

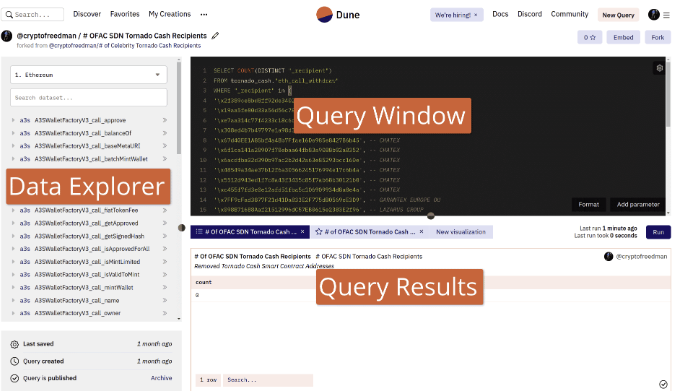

2. Dune Analyticsで分析する

ブロックチェーン上のデータについてSQLを用いて分析できるサービスです。

個人的に最もオススメです。

ブラウザ上でSQLを記述し実行可能なGUI、グラフィカルなダッシュボード作成機能が付いています。

「BigQueryとLooker Studioのブロックチェーン版」のような操作感です。

他にも作成したクエリやダッシュボードを共有可能な機能もあります。

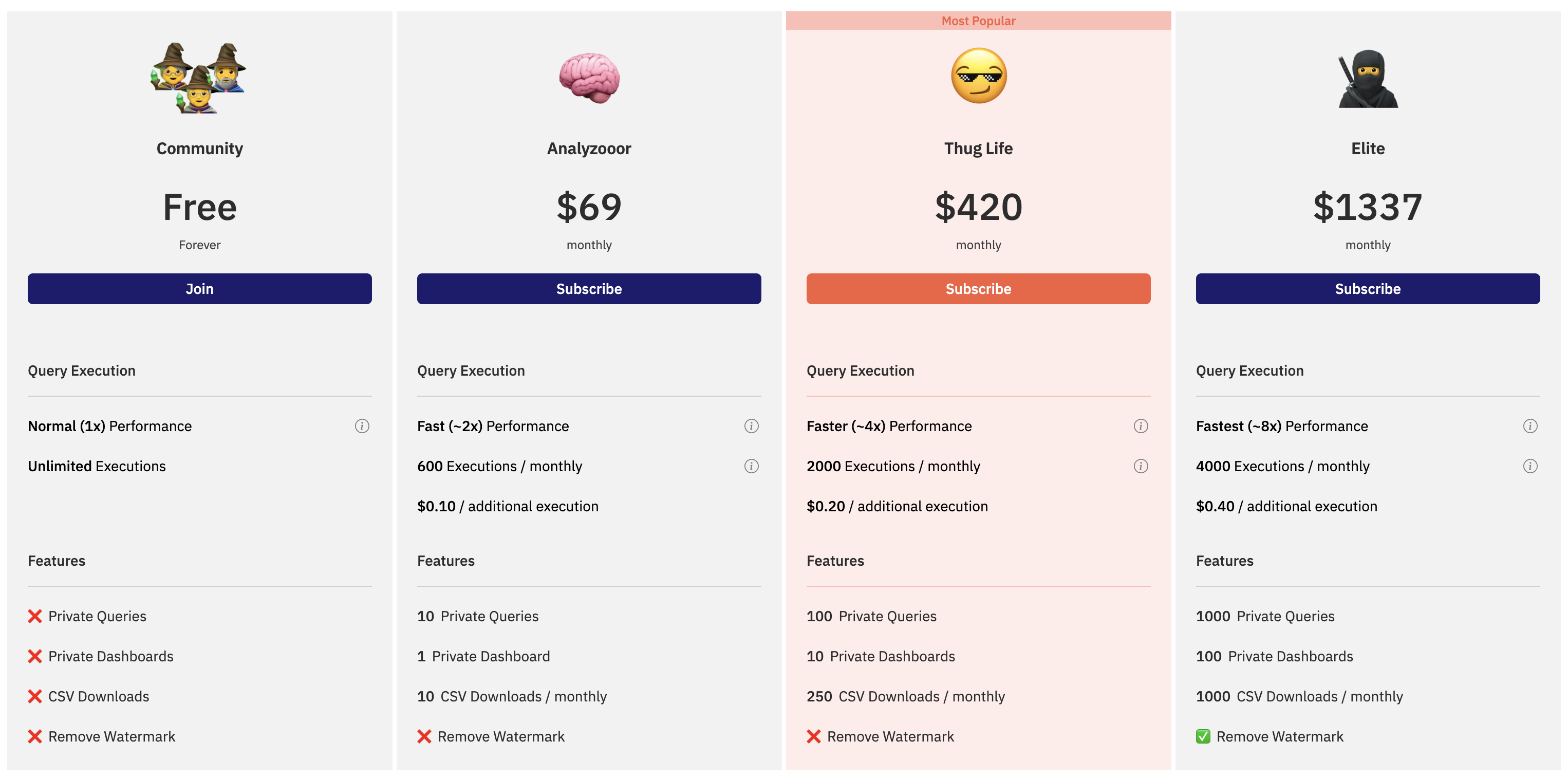

データ分析するだけなら、無料かつ無制限に利用可能です!

CSVダウンロードを行う場合やマッチョなインスタンスを利用する際は別途オカネが必要です。

利用方法

Dune Analyticsのホームページからメールアドレスで会員登録すれば準備完了です。

ログイン後Menu > New QueryでDune AnalyticsのGUIが開きます。

ここにSQLを記述し実行します。

Queries are the heart of Dune's magic

詳細は公式ドキュメントをご参照ください。

実際にデータ分析してみる

それでは実際に使ってみましょう。

今回は山古志村NFT保有者を抽出するクエリを作ってみます。

山古志村NFTは山古志地域の「電子住民票」を兼ねたもので、正式名称はNishikigoi NFTです。

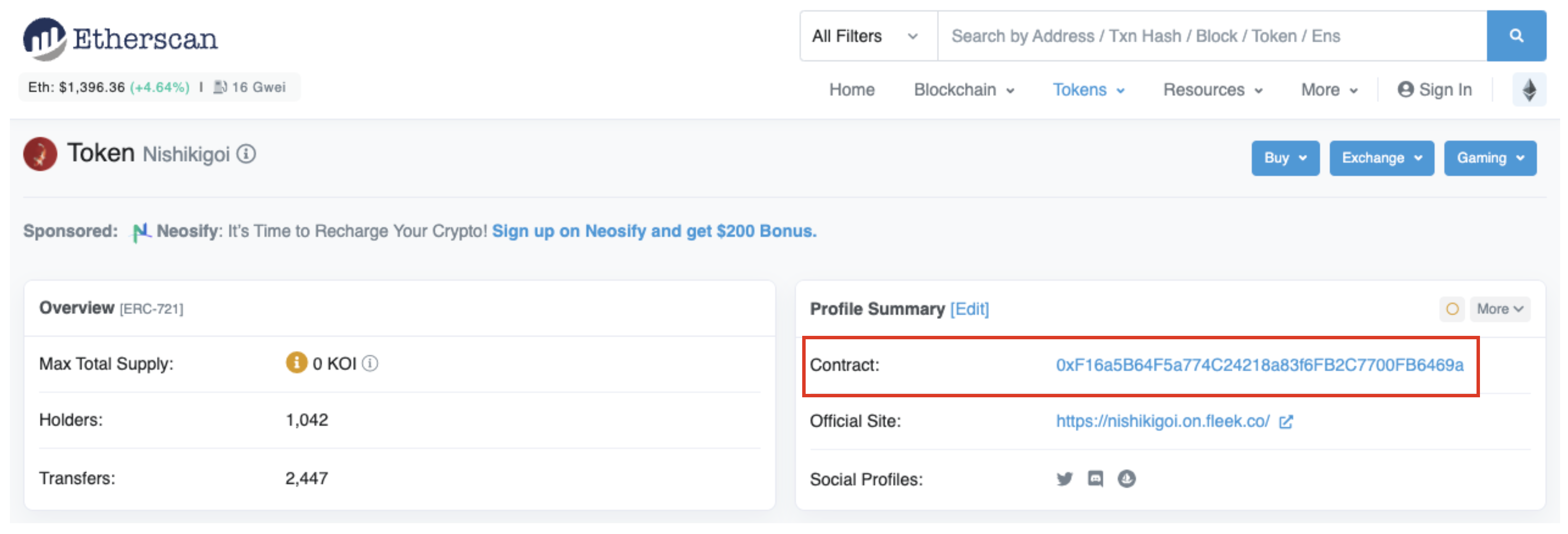

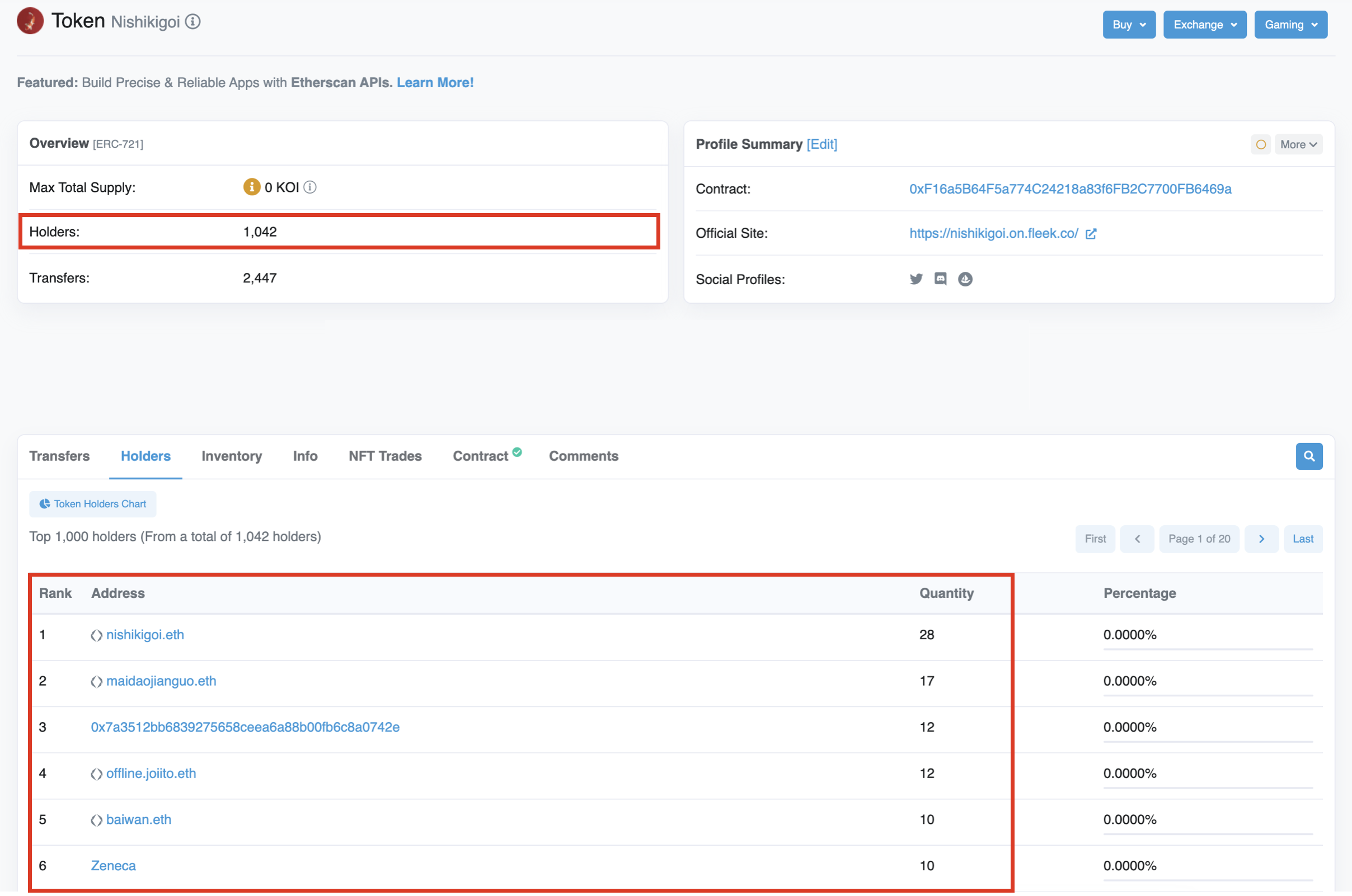

ブロックチェーンエクスプローラーEtherscanで検索します。

赤枠で囲ったContractがNishikigoiを表すアドレスなのでコピーします。

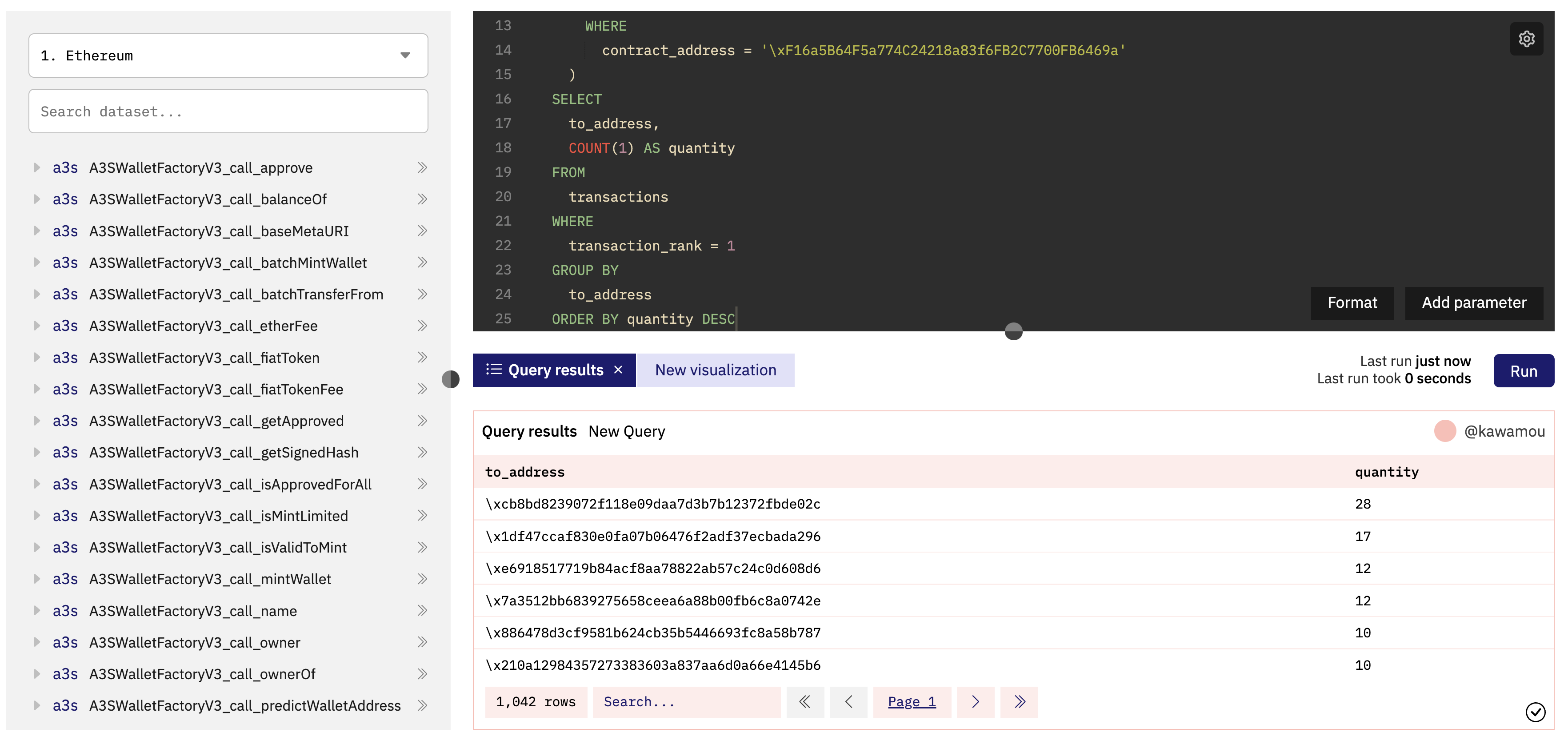

「現在のNishikigoi NFT所有者」を取得するべく、各トークンID毎にランク付けし、最新アドレスのみを抽出します。

Blockchain Analytics 101 — Dune Queries for On-Chain NFT Analysisを参考にしました(FROM句に何を書くか等、既存のクエリを参考にして進めると分かりやすいです)。

WITH

transactions AS (

SELECT

"tokenId" AS token_id,

"to" AS to_address,

ROW_NUMBER() OVER (

PARTITION BY "tokenId"

ORDER BY

evt_block_time DESC

) AS transaction_rank

FROM

erc721."ERC721_evt_Transfer"

WHERE

contract_address = '\xF16a5B64F5a774C24218a83f6FB2C7700FB6469a'

)

SELECT

to_address,

COUNT(1) AS quantity

FROM

transactions

WHERE

transaction_rank = 1

GROUP BY

to_address

ORDER BY quantity DESC

Dune AnalyticsのGUI上にクエリを書きCtrl + Enterで実行します。

重たいクエリだと相応の時間がかかるのですが今回はすぐに返ってくるかと思います。

ページ下部に1,042 rowsと記載があり、クエリの実行結果は「現在のNishikigoi NFT保有者は1042アドレス」だと示しています。

Etherscanで答え合わせをしてみましょう。

下記の図で赤枠で囲った通り、確かにHoldersは1042なので正しい分析結果が取得できていそうです。

山古志村NFTの保有者一覧が取得できました。

例えばこちらのリストをもとに「山古志村NFT保有者が持っているNFT」を抽出する等、様々な切り口で分析していけそうです。

更に詳しく知りたい方向け

Dune Analyticsに入門したい方は、まずは充実のチュートリアルをやってみるのをオススメします。

また、Dune Analytics上に共有されたクエリを読むのも勉強になります。

- The general process for surfacing data with Dune

- Blockchain Analytics 101 — Dune Queries for On-Chain NFT Analysis

- Dune Analytics: A Guide for Complete Beginners

- Want to become a crypto data analyst?

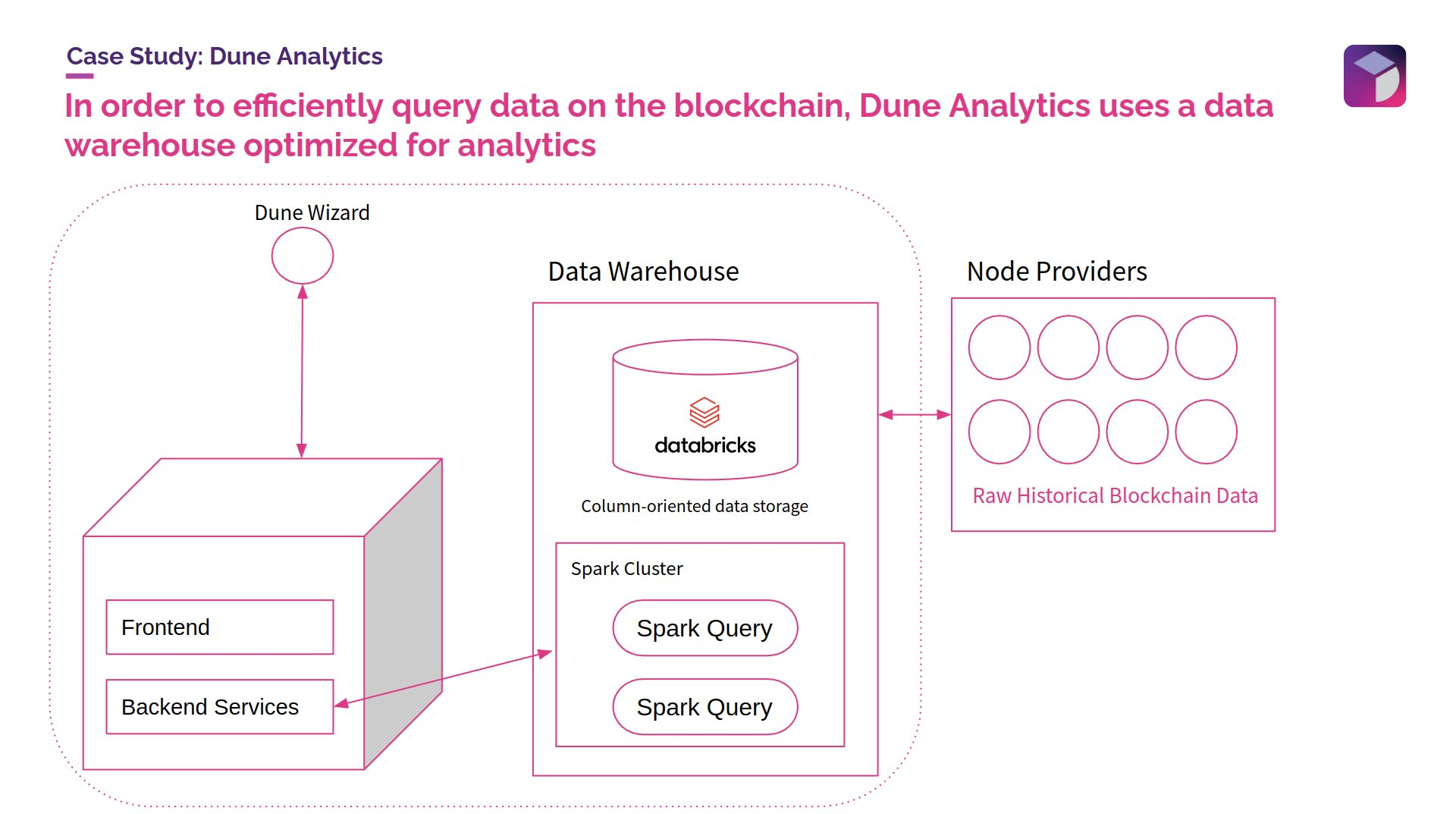

補足:インフラアーキテクチャ

裏側のアーキテクチャはコチラのスレッドが詳しいです。

Quicknode上に構成したアーカイブノードから定期的にデータを取得、ELT処理後にSpark上のDWHに格納しています。

Dune Analyticsはv2に移行しつつあるのですが、v1はPostgreSQLで構成されています。

補足:テーブル構造

Dune Analyticsを触っていると、Raw / Decoded / Spellbook...といったテーブルを目にします。

Rawテーブルはそのままずばり生データで、イーサリアム上のトランザクション等がそのまま格納されています(ex. ethereum.transactions)。

DecodedテーブルはRawテーブルをデコードし、人間が分かりやすい形式にしたもので、スマートコントラクトやイベント毎のテーブルが該当します。

SpellbookテーブルはRawやDecodedテーブルをSQLで加工したテーブルです。

A Basic Wizard Guide to Dune SQL and Ethereum Data Analytics / Dune Analytics: A Guide for Complete Beginners

3. The Graphで分析する

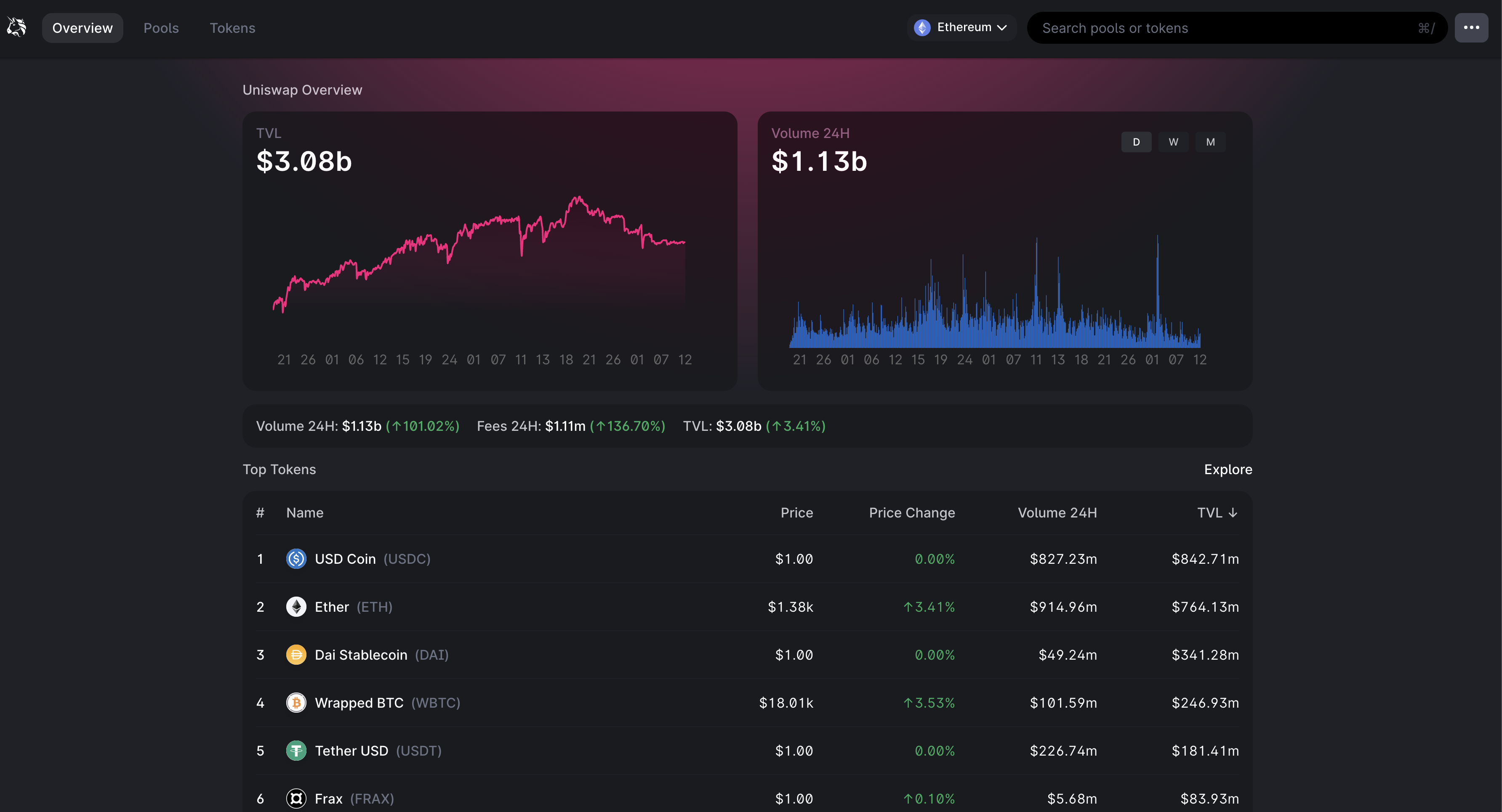

最後に紹介するThe GraphはGoogle of Blockchainsと称されるサービスです。

Dune Analytics同様クエリを発行しイーサリアムのデータにアクセスできます。

GraphQL APIのみを持つため、人間が直接クエリを実行するだけでなくDAppsのバックエンドに利用する用途も多いかもしれません。

導入事例として、Uniswapら取引所が表示する情報(ex. トークン価格や過去の取引量、流動性)を毎月40億件以上捌いている実績があります。

The Graph GRT Token Economics / The Journey of a Subgraph Query

サービス誕生の背景

Dune Analyticsのように独自サーバを構築すればデータ分析サービスの提供はできますが、運営元都合でサービスを停止することも造作ありません。

The Graphは非中央集権的に運営されるオフチェーンな分散ネットワーク(Graph Node)上で動くので単一障害点を持ちません。

ブロックチェーンに近い思想を持って生まれたサービスです。

動作の流れ(簡略版)

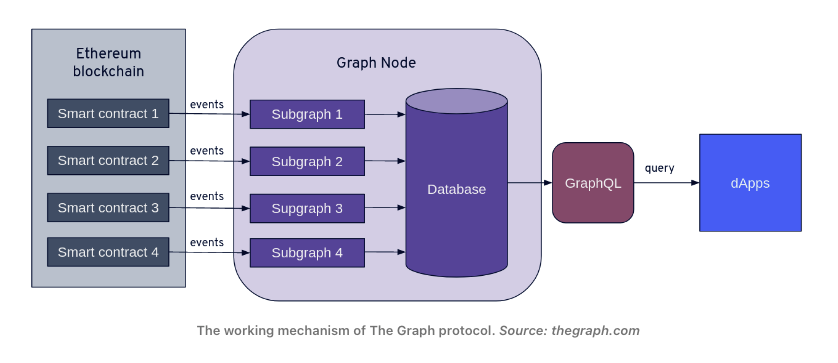

EVM系(ex. イーサリアム)のスマートコントラクトはトランザクションの処理中にイベントログを出力します。

The Graphユーザは「どのイベントをキャプチャするか / イベントをどんなスキーマに変換するかの定義(サブグラフ)」を書きデプロイします。

デプロイされたGraph Nodeは過去のブロックに遡ってイベントを収集しつつ新たなイベントを監視し、定義したスキーマ通りデータベース(PostgreSQLらしいです)に格納します。

格納したデータに対しGraphQL APIを用いたクエリで分析を行います。

Introduction to The Graph - The "Google" of Web3

イベントはスマートコントラクト毎だけではなく、例えばERC-721(NFT)全体に対しても取得可能です。

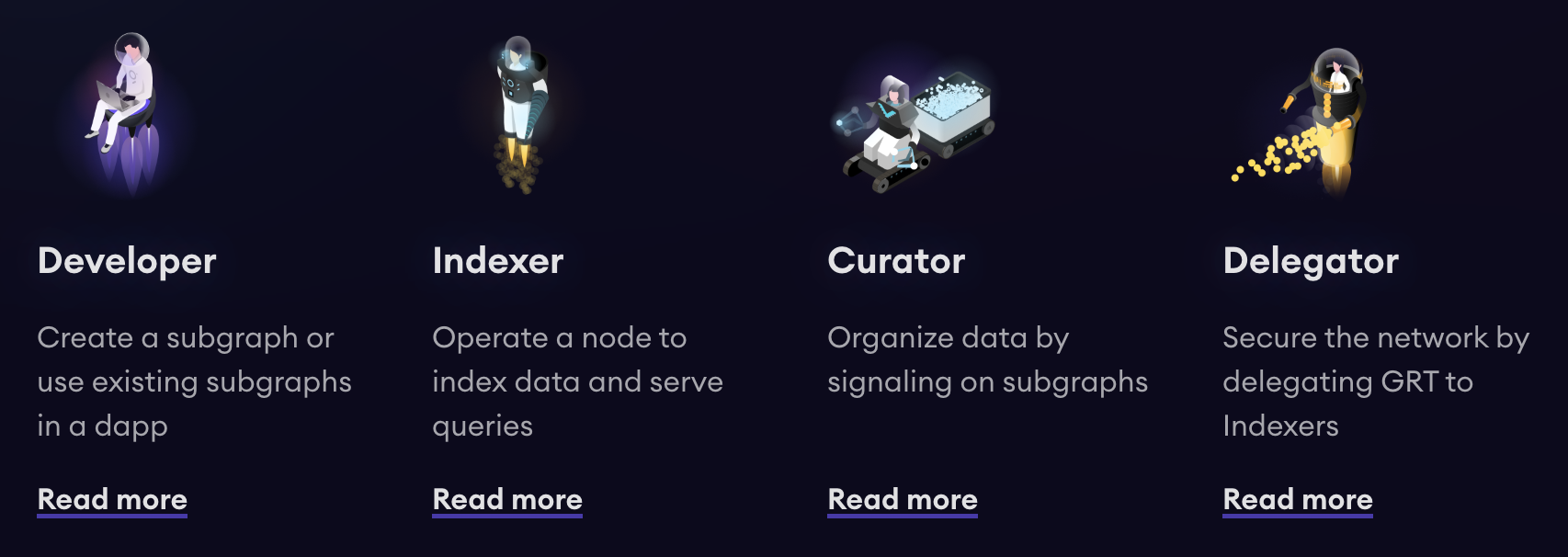

補足:The Graphとの関わり方

The Graphに関係する人や組織は主に4グループあります。

後述しますが、The Graphは分散ネットワークであり、インセンティブや不正防止のため複数のステークホルダーが存在します。

ただし、データ分析する上ではDeveloperとIndexer以外は知識として留めるので良いと思います。

- Developer

- The Graphにデータ収集を依頼したりクエリを発行する主体です。データ分析する場合はこちらに該当します

- Indexer

- Graph Nodeを運用します。データ(インデックス)を生成し、クエリに回答することでインセンティブを受け取ります

- Curator

- このサブグラフオススメだよ!とIndexerに働きかけます

- Delegator

- GRTをステークしてIndexerを支持し報酬を得ようとします

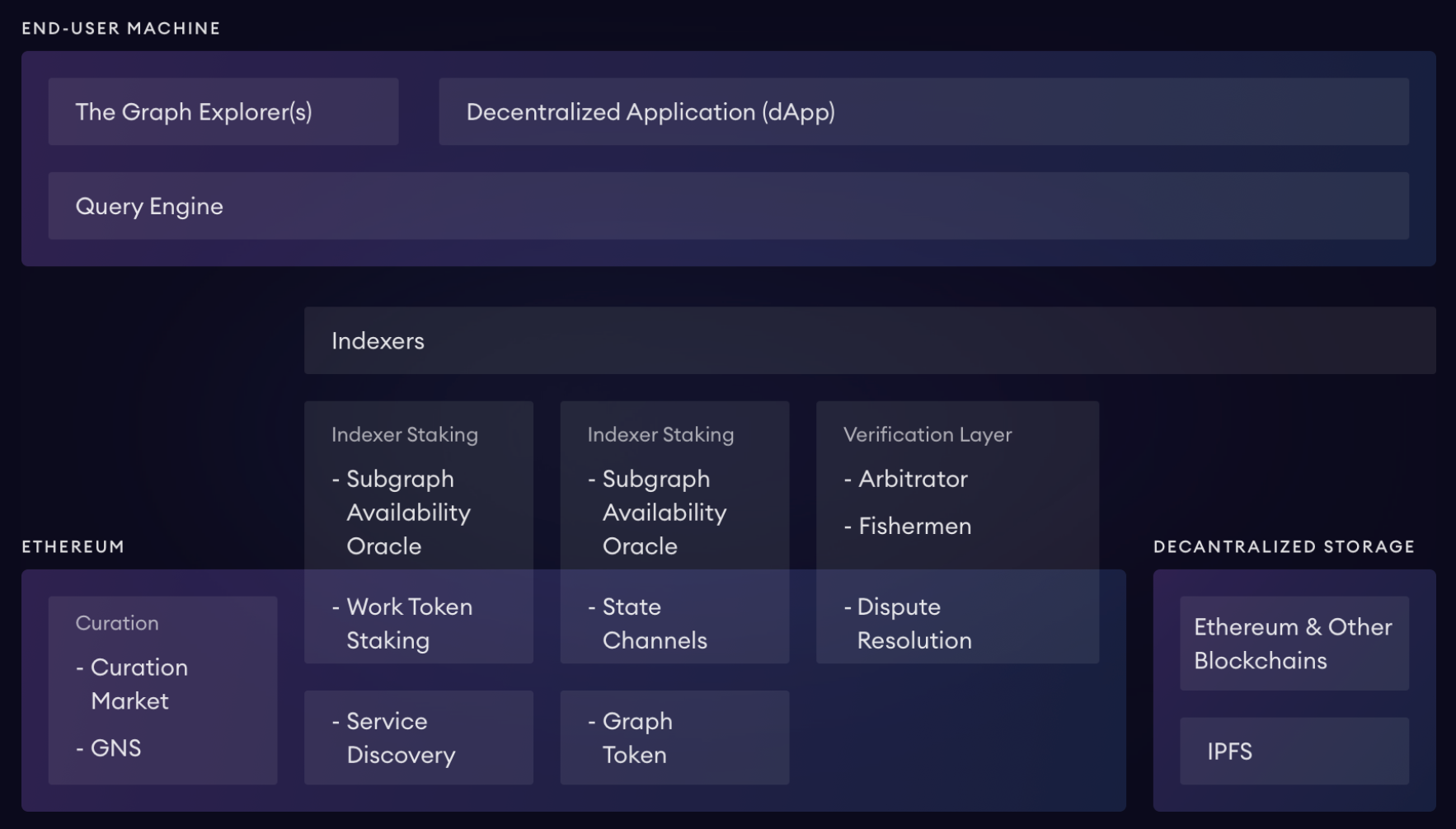

補足:The Graphの複雑さの根源

The Graphはイーサリアム上で動作するスマートコントラクトと、オフチェーンで動作するネットワークが組み合わさったサービスです。

詳しく仕組みを理解するためにはオンチェーンとオフチェーンを行き来する必要がありなかなかタフです。

The Graphは基本的にオフチェーンな分散ネットワークです。

ただし、インセンティブや不正防止の観点からオンチェーン上にスマートコントラクトやトークン(GRT)を準備しています。

例えばIndexer(Graph Node)になるためには、GRTを一定数保有する必要があります。

DeveloperがGraph Nodeを検索するための機能(Service Discovery)はスマートコントラクトであり、GRT保有者しかリストアップされないためです。

また、もし悪さをした場合GRTを召し上げられる構造になっており不正を防止しています。

The Graph Network In Depth - Part 1

実際にデータ分析してみる

工事中👷♂️

下記にトライしています。

終わりに

ブロックチェーンを対象にデータ分析する方法をまとめました。

既存技術(ex. SQL)でデータ分析できるのが分かり解像度が上がりました。

[2023.02.21 追記]

こちらのサイトかなりまとまっており良さそう👀