週刊AWS – 2026/3/16週

週刊生成AI with AWS – 2026/3/16 週

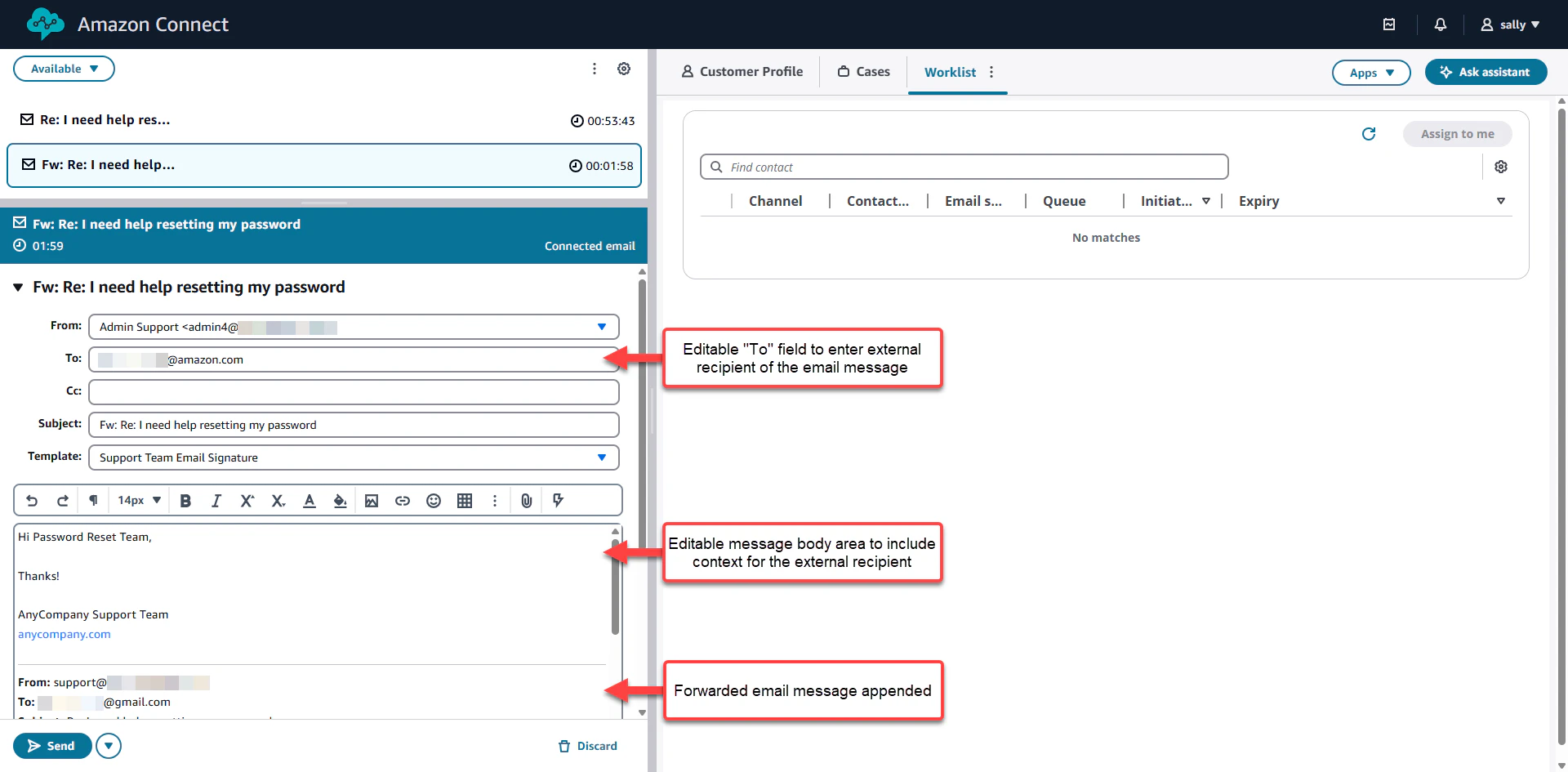

Amazon Connect でオペレーターが外部メールアドレスにメール連絡先を転送可能に

Amazon Connectでは、エージェントがエージェントワークスペースやコンタクトセンターパネルから、メールコンタクトを外部メールアドレスや配布リストへ転送できるようになりました。

メールを転送しても、元の問い合わせに対するエージェントの所有権とコミュニケーション履歴は保持されるため、エージェントはお客様との一貫した窓口であり続けながら、バックオフィスチームや専門家、パートナーなどをシームレスに巻き込むことができます。

対応リージョン

米国東部(バージニア北部)、米国西部(オレゴン)、アフリカ(ケープタウン)、アジアパシフィック(ソウル、シンガポール、シドニー、東京)、カナダ(中部)、ヨーロッパ(フランクフルト、ロンドン)

転送の概要

■ 転送手順(概要)

1.CCP(Contact Control Panel)で転送したいメールを開く。

2.Forward(転送)を選択。

3.To フィールドに転送先アドレスを入力。(1件のみ可)

4.追加宛先が必要な場合は CC に入力。

5.必要に応じて本文にメッセージを追記し、添付ファイルを追加する。

6.元メールのスレッド+追加メッセージ を確認。

7.Send をクリックして送信。

送信後も、コンタクトは CCP 上に残り、エージェントが対応完了または「Done」で終了するまで保持される。

SageMaker HyperPod が動的クラスター利用のためのアイドルリソース共有をサポート

Amazon SageMaker HyperPod のタスクガバナンスに 動的リソース共有(dynamic resource sharing) が追加され、チームが自分たちの保証クォータを超えて未使用の計算リソースを借用できる ようになりました。

機能概要

HyperPod クラスター内の 未割り当て(idle)リソースを自動検出し、チームがベストエフォートで利用可能。

エージェントや管理者は手動で再設定する必要がなく、HyperPod が クラスター状態やクォータ変更に応じて自動計算。

対象には GPU のパーティション構成を含む、スケジューリング可能なインスタンスが含まれる。

ガバナンス

・GPU・vCPU・メモリ単位で借用上限を設定

・割合ベース または 絶対値ベース の借用上限を指定

・チーム間の公平性を保ちつつ、未使用リソースを最大限活用

・各チームの 保証クォータの隔離(isolation) は維持される

Amazon CloudWatch が組織全体での EC2 詳細モニタリング有効化を導入

Amazon CloudWatch が、AWS Organizations 全体で EC2 の詳細モニタリング(Detailed Monitoring)を自動的に有効化できる機能を提供開始しました。

CloudWatch Ingestion にルールを作成することで、指定した条件に一致する 既存および新規作成の EC2 インスタンスに対して 1 分間隔の詳細メトリクス収集を自動適用できます。

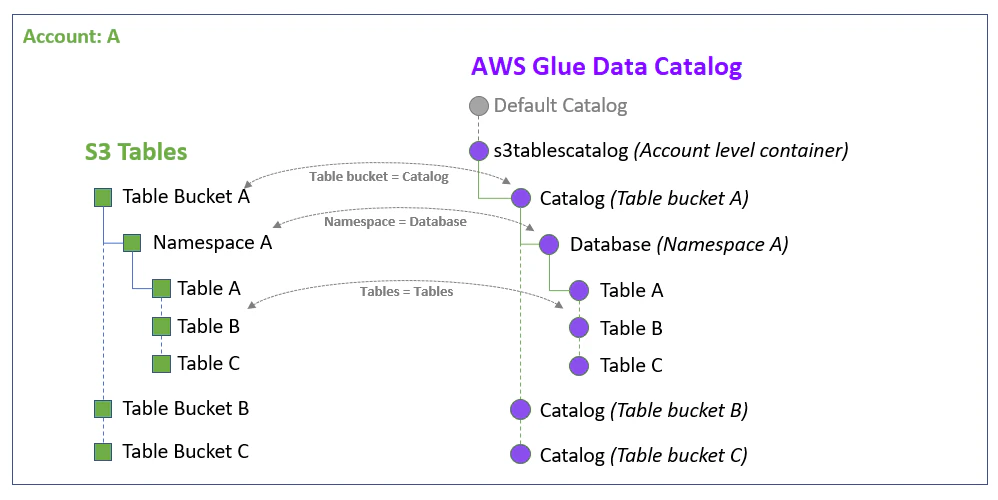

Amazon S3 Tables と Iceberg マテリアライズドビューの権限管理を簡素化

AWS Glue Data Catalog が、Amazon S3 Tables と Apache Iceberg マテリアライズドビュー向けに IAM ベースの認可(authorization)をサポートしました。

このアップデートにより、ストレージ、カタログ、クエリエンジンの権限を 1 つの IAM ポリシーで統合管理できるようになります。

統合の仕組み

✔ Glue Data Catalog への自動登録

S3 Tables を統合すると、現在のリージョンの Glue Data Catalog に s3tablescatalog というカタログが自動追加されます。

このカタログにより、以下の通り登録される。

・テーブルバケット → サブカタログ

・ネームスペース → データベース

・テーブル → Glue のテーブル

引用

✔ 登録はリージョンごとに1回だけ

一度統合設定を行えば、その後に作成されるテーブルバケット・ネームスペース・テーブルも自動的に登録されます。

Amazon RDS の SQL Server Developer Edition 向け機能強化

Amazon RDS for SQL Server は以下の機能を新たにサポートしました。

1. Additional Storage Volumes(追加ストレージボリューム)

Developer Edition インスタンスに利用可能。

最大 256 TiB(従来の 4 倍) のストレージを提供。

大規模データを扱う開発・検証環境の要件に対応しやすくなる。

2. SQL Server Resource Governor

CPU やメモリ使用を リソースプール/ワークロードグループで制御可能。

負荷制御による 実運用に近いパフォーマンステストが実現。

3. SQL Server 2019(CU32 GDR - 15.0.4455.2)サポート

Developer Edition で SQL Server 2019 が利用可能に。

本番環境と同じバージョンで開発・テストを実行できるため、互換性確認が容易。

Amazon Bedrock AgentCore Runtime でシェルコマンド実行がサポート開始

Amazon Bedrock AgentCore Runtime で InvokeAgentRuntimeCommand API が新たにサポートされ、

実行中の AgentCore Runtime セッション内でシェルコマンドを直接実行できるようになりました。

実現できること

・シェルコマンドを送信

・HTTP/2 経由でリアルタイムに実行結果(stdout/stderr)をストリーミング取得

・コマンド終了コード(exit code)も受け取り可能

・コンテナ内に独自のコマンド実行ロジックを実装する必要がなくなる

Amazon OpenSearch Service が OpenSearch バージョン 3.5 をサポート開始

バージョン3.5で以下2つの機能が強化されています。

1. エージェント向け AI 機能の強化

OpenSearch 3.5 では、エージェントアプリケーション構築を支援する機能が大幅に向上しました。

・エージェント会話メモリ

会話内容やツール実行時の推論を永続ストレージに保持し、マルチターン対話でも一貫性・正確性の高い応答が可能に。

・コンテキスト管理の自動最適化

LLM に送信するコンテキストを自動で切り詰め・要約し、トークンコストを削減しつつ応答品質を維持。

・ノーコードのエージェント UI の刷新

Model Context Protocol(MCP)対応、検索テンプレート、会話メモリ、単一モデル構成

→ コードを書かずに高度なエージェントを構築可能。

2. 検索関連機能(Search Relevance)の強化

検索品質向上のためのツールがさらに拡張されました。

・LLM を使った自動評価

独自プロンプトで検索結果の関連性を自動評価し、手動評価の負荷を大幅に削減。

・スケジュール評価(定期テスト)

毎日・毎週・毎月のテストが可能になり、検索品質の推移や劣化(リグレッション)を早期発見。

・単一クエリ比較の強化

エージェント生成の検索クエリと要約を並べて表示し、エージェント主導の検索体験の検証・最適化が容易に。

Amazon Redshift がダッシュボードと ETL ワークロードの新しいクエリのパフォーマンスを最大 7 倍向上

Amazon Redshift は、新規クエリの実行準備(コンパイル)を高速化する最適化を導入し、

BI ダッシュボードや ETL ワークロードなどにおける新しい SQL クエリの処理が最大 7 倍高速化されました。

追加コストなしで自動的に有効化されます。

これにより、以下のような低レイテンシを求めるユースケースで大幅な応答速度改善が得られます。

・ほぼリアルタイム分析

・BI ダッシュボード

・ETL パイプライン

・自律型 AI エージェントによるクエリ実行

“composition(コンポジション)” について

・新規クエリ向けに 軽量な既存ロジックの組み合わせ(composition)を即座に生成

・並行して、最適化されたクエリ専用コードをバックグラウンドでコンパイル

・クエリは コンパイル完了を待たずに即時実行

・後続のクエリ実行と同等レベルのパフォーマンスを維持

Amazon Inspector がエージェントレス EC2 スキャンを拡張し、Windows KB ベースの検出結果を導入

Amazon Inspector は、エージェントをインストールせずに EC2 の脆弱性スキャンができる機能を強化しました。

以下が新たにサポートされています。

・Windows OS の脆弱性スキャン(エージェント不要)

・WordPress

・Apache HTTP Server

・Python パッケージ

・Ruby gems

設定変更は不要で、対応範囲拡大により 自動的に新たな検出結果が反映されます。

従来は、Microsoft の 1 つのパッチに含まれる CVE が個別の検出結果として多数表示される問題がありました。

今回のアップデートで、KB(Knowledge Base)単位の統合結果として 1 つにまとめて表示されます。

各 KB 結果には、以下の情報が集約されます。

・最高 CVSS スコア

・EPSS スコア

・利用可能なエクスプロイト情報

関連する Microsoft KB 記事への直接リンクがついてきます。

Amazon RDS Custom for SQL Server にOSアップデートの表示とスケジュール機能を追加

Amazon RDS Custom for SQL Server では、RDS が提供するエンジンバージョン(RPEV)向けに、利用可能な OS アップデートを確認・適用・スケジュールできる機能が追加されました。

RPEV は SQL Server がプリインストールされた AMI を使用する方式で、

新しい OS アップデートが公開されると、ユーザーは次の操作が可能です。

describe-pending-maintenance-actions API

・アップデート内容の確認

apply-pending-maintenance-action API

・アップデートの即時適用

・次回メンテナンスウィンドウでの自動適用をスケジュール

Amazon Redshift が複数の AWS リージョンで IAM Identity Center との連携権限をサポート

Amazon Redshift は、AWS IAM Identity Center (IdC) を利用したフェデレーテッドパーミッションを複数の AWS リージョンでサポートするようになりました。これにより、IdC をプライマリリージョンから他のリージョンへ拡張でき、ユーザーに近いリージョンでのパフォーマンス向上や信頼性向上を実現できます。

主なポイント

・マルチリージョンでのアクセス管理が簡素化

追加リージョンでは、既存のIDをそのまま利用して、Redshift のテーブル/カラムレベルのきめ細かなアクセス制御を簡単に管理できます。

・ID の複製は不要

新たなリージョンを IdC に追加した際、プライマリリージョンから ID を複製する必要はなく、新規追加リージョンで Redshift および Lake Formation の Identity Center アプリケーションを作成できます。

これにより、既存のユーザーが新リージョンの Redshift データウェアハウスへクエリ可能になります。

・どのリージョンでも細粒度のアクセス制御が自動適用

クエリを実行する Redshift ウェアハウスがどのリージョンにあっても、

行レベル・列レベル・マスキングルールが自動で適用され、コンプライアンスを維持できます。

・SSO によるアクセスもマルチリージョンで可能

以下のツールで シングルサインオン (SSO) による Redshift へのアクセスがサポート

Amazon QuickSight

Amazon Redshift Query Editor

サードパーティ SQL クライアント

AWS DataSync がすべてのロケーションタイプで AWS Secrets Manager をサポート

AWS DataSync は、HDFS、Amazon FSx for Windows File Server、Amazon FSx for NetApp ONTAP を含むすべてのロケーションタイプで AWS Secrets Manager を利用した認証情報管理をサポートしました。

これにより、これまでは一部ロケーションで必要だった API やコンソールでの直接入力が不要になります。

認証情報管理には、以下の2つから選べます。

・自分で管理する Secret ARN を指定

ローテーション、監査、アクセス制御を完全にカスタマイズ可能

・DataSync による自動生成・管理

設定を簡素化したい場合に便利

Amazon Bedrock AgentCore Runtime がリアルタイム双方向ストリーミング用の WebRTC サポートを追加

Amazon Bedrock AgentCore Runtime が、既存の WebSocket に加えて WebRTC を新たにサポートし、クライアント(ブラウザ・モバイル)とエージェント間での低遅延・双方向ストリーミングが可能になりました。

WebRTC 対応でできること

・音声・映像のリアルタイム双方向ストリーミングが可能に

・ピアツーピアかつ UDP ベースの低遅延通信により、自然な会話体験を実現

・ブラウザ・モバイル向けの 音声エージェントアプリの構築が容易に

Amazon Bedrock にて Minimax M2.5 および GLM 5 モデルが利用可能に

Amazon Bedrock は新たに GLM 5 と MiniMax M2.5 をサポートし、利用可能なモデルの選択肢が拡大しました。

GLM 5 とは

GLM 5 はフロンティアクラスの汎用大規模言語モデルで、特に以下の用途に最適化されています。

・複雑なシステムエンジニアリング

・長期的な推論を伴うエージェントタスク

・マルチステップ推論

・高度な数学(AIME風ベンチマーク対応)

・高度なコード生成・ツール連携ワークフロー

・長大なコンテキストへの対応

MiniMax M2.5 とは

MiniMax M2.5 は、エージェントタスクに特化した agent-native frontier model で、

以下を重視した設計になっています。

高速かつ効率的な推論

最適なタスク分解

現実的な時間・コスト制約下での高効率ワークフロー実行

トークン効率の高い推論(強化学習による最適化)

先進モデルと同等かそれ以上のタスク完了速度

特に、スループットとコスト効率のバランスが優れており、現実的なエージェント運用に向いています

NVIDIA Nemotron 3 Super が Amazon Bedrock で利用可能に

Amazon Bedrock は新たに NVIDIA Nemotron 3 Super をサポートしました。

Nemotron 3 Super は 複雑なマルチエージェントアプリケーション向けに設計されたオープンなハイブリッド Mixture‑of‑Experts (MoE) モデルです。

Nemotron 3 Super の特徴

・マルチエージェント・長いタスクシーケンス向けに最適

→ 長いマルチステップ処理でも、コンテキストを失わずに精度を維持。

・高速かつコスト効率の高い推論を実現

→ エージェントのリアルタイム性や生産性向上に寄与。

・完全オープン(モデルウェイト、データセット、レシピ公開)

→ カスタマイズやセキュアなデプロイが容易で、企業・スタートアップ・個人開発者向け

Amazon Bedrock AgentCore Runtime にて AG-UI プロトコルをサポート

Amazon Bedrock AgentCore Runtime が、Agent-User Interaction(AG-UI)プロトコルを新たにサポートしました。

これにより、開発者は ユーザー向けアプリにリアルタイムで応答性の高いエージェント体験を提供する AG-UI サーバーを簡単にデプロイできます。

AG-UI は AI エージェントとユーザーインターフェース間の通信を標準化する、オープンなイベントベースのプロトコルです。

・MCP:エージェント ↔ ツール

・A2A:エージェント ↔ エージェント

・AG-UI:エージェント ↔ ユーザー UI(今回追加)

AG-UI が提供する主な機能

・テキスト生成の逐次ストリーミング(チャンク単位)

・推論ステップのリアルタイム表示

・ツール呼び出しと結果の可視化(UI が透明性を持って表示可能)

・進捗バーやダッシュボード等のリアルタイム同期

・Server-Sent Events(SSE)と WebSocket 両方の双方向通信に対応

SageMaker Training Plans にて既存のキャパシティコミットメントの延長が可能に

Amazon SageMaker AI は Training Plans(GPU 予約枠)を延長できる新機能を発表しました。

これにより、AI トレーニングが予定より長引いた場合でも、ワークロードを中断することなく実行し続けることができます。

予約済み GPU キャパシティの延長

Training Plans は、最大 64 インスタンスの GPU クラスターを 指定期間で予約できる機能。

今回のアップデートで、トレーニングが予定より長くかかる場合に期間延長が可能に。

・1日単位で最大 14 日まで

・7日単位で最大 182 日(26 週間)まで

延長は API または SageMaker コンソール から実行可能。延長を購入した後は、再設定なしでトレーニングがそのまま継続される。

AWS にて NIXL と EFA の統合により大規模 LLM 推論を高速化

AWS は、Amazon EC2 で NVIDIA Inference Xfer Library(NIXL)を Elastic Fabric Adapter(EFA)と組み合わせて利用可能になりました。

これにより、大規模言語モデル(LLM)の分散(disaggregated)推論性能が大幅に向上します。

主な改善点(3つの性能向上)

NIXL + EFA の統合により、以下が改善されます

・KV キャッシュ(Key-Value Cache)のスループット向上

・トークン間レイテンシ(inter-token latency)の削減

・KV キャッシュのメモリ利用最適化

これらにより、大規模 LLM の高速・低遅延推論が可能になります。

技術的効果と特徴

NIXL と EFA を組み合わせることでプレフィル(prefill)ノード ↔ デコード(decode)ノード間の KV キャッシュ転送が高速・低遅延になります。

異なるストレージ層間での KV キャッシュ移動も効率化、NVIDIA Dynamo、SGLang、vLLM などのフレームワークにネイティブ統合され、EFA 対応 EC2 インスタンスすべてで動作します。

これにより、ユーザーは 任意の EC2 インスタンス構成や推論フレームワークと柔軟に組み合わせることが可能です。

AWS Neuron にて Amazon EKS の Dynamic Resource Allocation をサポート

AWS は、Amazon EKS 向け Neuron Dynamic Resource Allocation(DRA)ドライバーを発表しました。これにより、AWS Trainium ベースのインスタンスに対する Kubernetes ネイティブなハードウェア認識スケジューリングが可能になります。

Kubernetes上でAIワークロードをデプロイするには、MLエンジニアがモデル開発に直接関係しないインフラストラクチャ上の決定を行う必要があります。

Neuron DRAドライバーは、インフラストラクチャの課題をMLワークフローから分離することで、この負担を解消します。インフラチームは、デバイスのトポロジー、割り当て、およびネットワークポリシーを定義した再利用可能なResourceClaimTemplatesを作成します。

AWS Security Agent にてペネトレーションテストレポートのダウンロードをサポート

AWS Security Agent に、ペネトレーションテスト(Pentest)レポートをダウンロードできる新機能が追加されました。

この機能により、利用者はレポート内容を柔軟にカスタマイズし、PDF 形式で保存・共有できるようになりました。

ダウンロード可能なレポートの内容

生成されるレポートには以下が含まれます:

・エグゼクティブサマリー(全体のセキュリティ状況と主要な指摘事項)

・テスト対象の範囲(Scope)

・テスト手法(Methodology):使用したアプローチや技術、タスク詳細など

・詳細な検出内容(Findings):脆弱性情報、リスク評価(Risk Assessment)

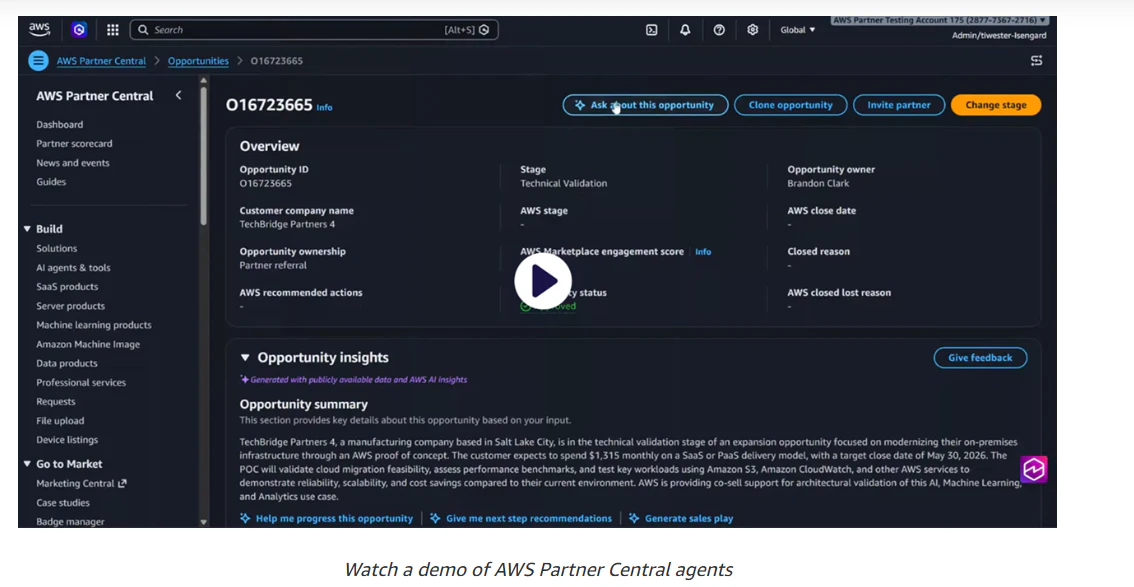

AWS Partner Central にて AI エージェント機能を一般提供開始

AWS は Amazon Bedrock AgentCore を基盤とした「AWS Partner Central エージェント」を発表しました。

これは、パートナーが AWS と共同でビジネスを進める際の 業務効率化・商談推進・資金活用の最適化を支援する “エージェント体験” です。

1. パイプライン・商談インサイト

売上パイプラインの状況をリアルタイムに分析し、注意が必要な商談・期限が近い案件・全体サマリ を会話形式で返答。

パートナーは必要なアクションをすぐに把握できる。

2. 商談の加速(Deal Progression)

会議ノート・メール・議事録をアップロードすると、エージェントが 商談フィールドを自動入力。

各商談に対し 最適な次のアクション(Next-Step) を提案。

カスタマイズされた セールスプレイ(Sales Plays) を自動生成し、商談速度を大幅に向上。

3. 資金(Funding)の最適化

商談の内容から、利用可能な AWS ファンディングプログラムを自動判定。

利用可能な資金・要件不足・必要アクション を案内。

必要事項を 自動入力した資金申請書(Fund Request) を生成し、申請プロセスを大幅に短縮。

4. 既存ツールとの統合(MCP Integration)

Model Context Protocol (MCP) 経由で、CRM や既存の業務ツールと直接つなげることができる。

パートナーは 普段使っているアプリからエージェント機能を利用可能。

Migration Guideに従い、移行が必要。