この記事は株式会社ドットログによる

コンストラク体操日記 Advent Calendar 2025 の 11日目 の記事です。

はじめに

「MAS」について調べていたら、「MoA」と「MAS」がごちゃついて頭の整理のメモ程度で記事を書いてみました。

正直に言うと、私はこの2つの用語を完全に混同していました。どっちも「マルチエージェント」っぽいし、どっちも「複数のAIが協力する」みたいな話っぽく感じました。調べていくうちに**「あ、これって親子関係なんや」**ということがわかったりして整理できてスッキリしたので、同じように混乱している人はなかなか少ないと思いますが、MoAとMASのどちらか一方でも分かっていない人には、input材料として焼くだけていただければ幸いです。

この記事でわかること

- MASとMoAの違い(結論:親子関係)

- ついでにMoEとの違いも整理

- 2025年時点での具体的な活用事例

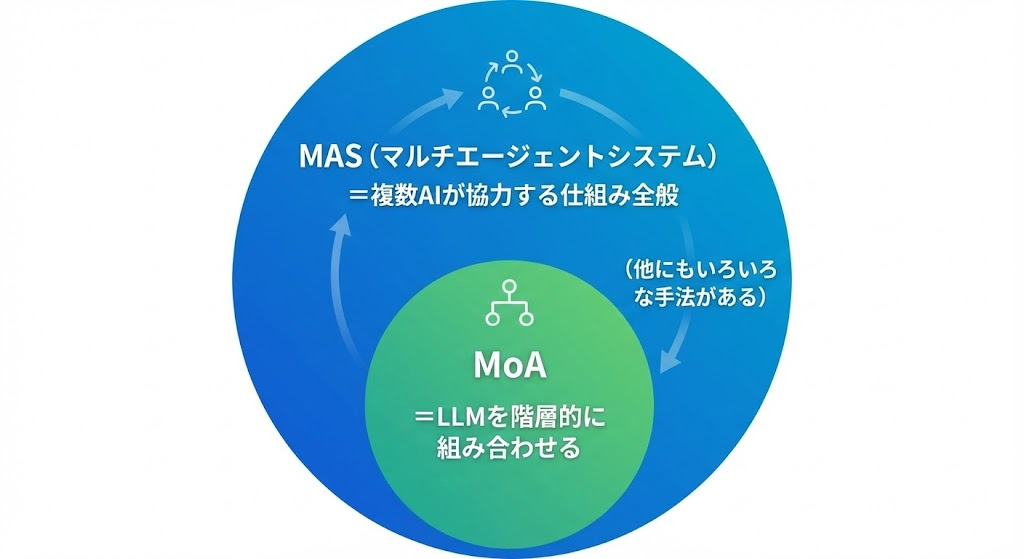

結論:MASが親、MoAが子みたいな感じ→ MASがでかい要素、MoAがその中の一部

先に結論を言うと、この2つの関係はシンプルでした。

MASは「広い概念」、MoAは「具体的な手法」。MoAはMASの一種。

| 用語 | 正式名称 | 一言で言うと |

|---|---|---|

| MAS | Multi-Agent System | 複数AIが協力する仕組み全般 |

| MoA | Mixture of Agents | LLMを階層的に組み合わせる具体的な手法 |

| MoE | Mixture of Experts | モデル内部で専門家を選ぶ仕組み(別物) |

※MoEについては最後くらいに軽く触れます、、

MAS(マルチエージェントシステム)って何?

ざっくり言うと

複数のAIエージェントが協力して問題を解決するシステムの総称です。

1970年代から研究されている歴史ある分野で、「生成AIの時代に急に出てきた概念」ではありませんでした。

私が勘違いしてたこと

MASは「最近のLLMブームで生まれた概念」だと思ってましたが、50年近い歴史がありました。ロボット工学や交通システムなど、LLM以外の分野でも昔から使われていたようです。

特徴

- 複数のエージェントがいる:1つじゃなくて、複数のAIが動く

- それぞれが自律的:各エージェントが自分で判断して動く

- 協力・分担する:情報を共有したり、役割分担したりする

2025年時点での具体例

調べてみると、最近はこんなサービスがMASを使っているようです。

- Gemini Enterprise:Googleの汎用マルチエージェントシステム

- Microsoft Magentic-One:Microsoftの汎用MAS

- OpenAI Operator:ブラウザ操作などを行うAIエージェント

- Anthropic Claude Computer Use:PCを操作できるAIエージェント

他にも、自動運転車同士の連携とか、Amazonの倉庫ロボットの協調動作なんかもMASの一種らしいです。

ポイント

MASは「考え方・設計思想」です。AIにおいてでいうと、MASは「複数のAIを協力させよう」という大きな枠組みであり、具体的なやり方は色々あります。

MoA(Mixture of Agents)って何?

ざっくり言うと

複数のLLM(大規模言語モデル)を階層的に組み合わせて、より良い回答を作る手法です。

2024年6月にTogether AIという会社が発表しました。MASの中でも、LLMに特化した具体的なやり方の1つ。

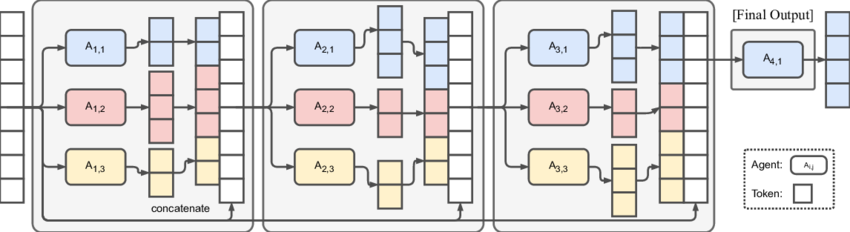

仕組み

ステップ1:複数のLLMがそれぞれ回答を作る(Proposer)

↓

ステップ2:それらの回答を参考に、さらに良い回答を作る(中間層)

↓

ステップ3:最終的に1つの回答にまとめる(Aggregator)

出典:Wang et al., 2024 "Mixture-of-Agents Enhances Large Language Model Capabilities"

なぜこれで性能が上がるのか

LLMには「他のモデルの出力を見ると、より良い回答ができる」という性質があることがわかっっているらしいです。これを「協調性(collaborativeness)」と呼ぶそうです。人間で言うと、他の人の意見を聞くと考えが深まるみたいな感じ。

実績(※2024年発表時点で古いかもです)

- AlpacaEval 2.0というベンチマークで**65.1%**を達成

- 当時のGPT-4oの**57.5%**を上回った

- オープンソースのモデルだけでこの性能を実現

注意

GPT-4oは2024年時点のモデルです。今はGPT-5とか出てるので、単純比較はできないかもしれません。「当時すごかった」という文脈で理解してください。

2025年の活用事例

調べてみると、実際にMoAを使っているサービスがいくつかありました。

- GenSpark MoA:MoA技術を採用したAI検索エンジン。検索・画像生成・翻訳などを統合

- 医療分野:放射線科、ゲノム、薬剤治療など専門分野のエージェントが協調して診断支援

- 金融分野:リスク分析などで複数エージェントが協調

メリット・デメリット

| メリット | デメリット |

|---|---|

| 単体のLLMより高品質な出力が得られる | 処理に時間がかかる(複数のLLMを順番に動かすため) |

| 既存のモデルをそのまま使える(再学習不要) | コストが高い(複数回の推論が必要) |

MoAとMASの関係を図で整理

ここまで読んで「結局どういう関係なの?」と思った人向けに、図で整理します。

↑ nano bananaで作成

MASは「広い概念」、MoAは「具体的な手法」くらいで覚えておけばOKです。

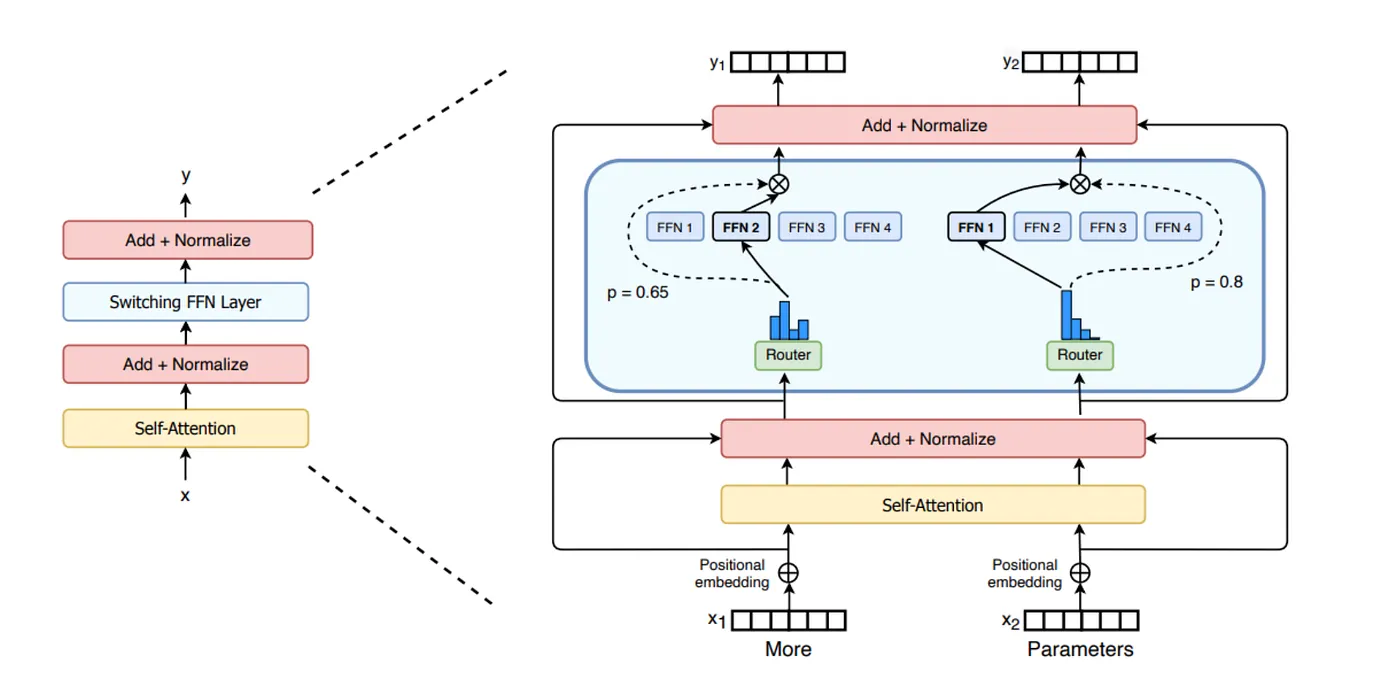

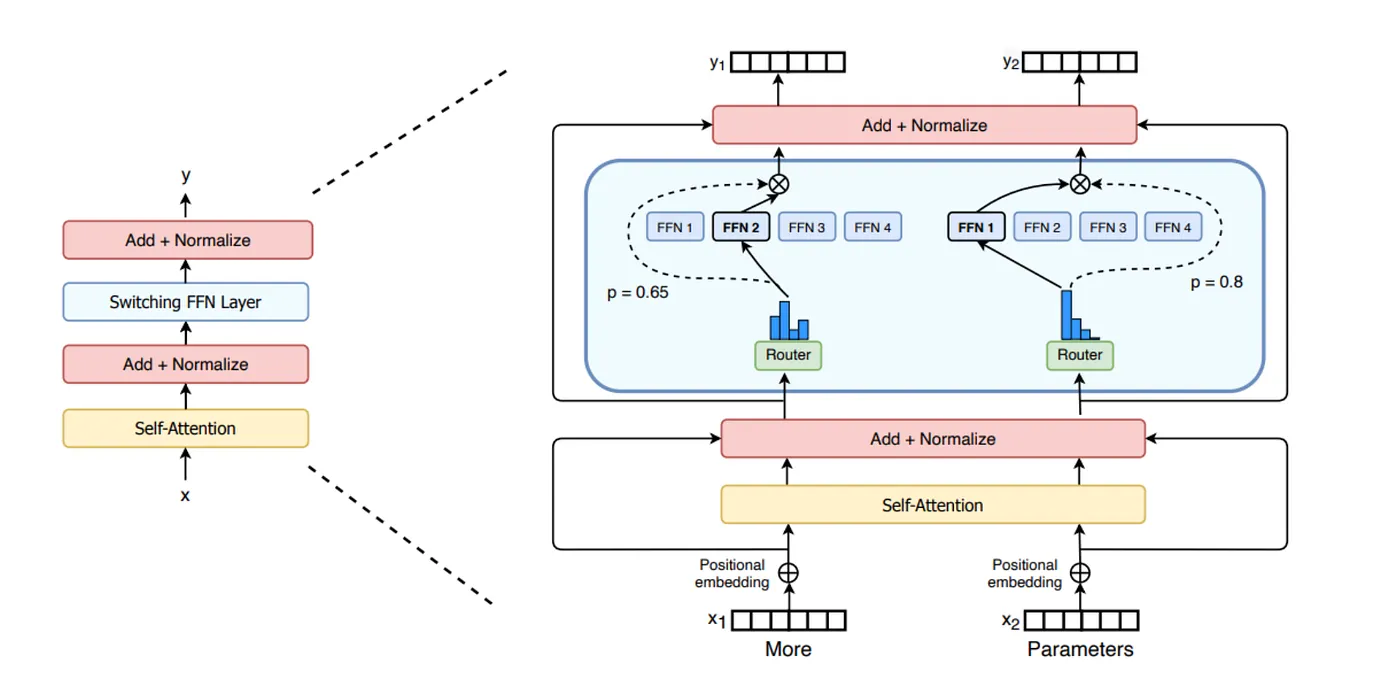

「MoEも似てない?」問題

ここで、私が最初に混乱したもう1つの用語について触れておきます。

MoE(Mixture of Experts)という用語、MoAと1文字違い。

MoEは別物です

名前は似てますが、やってることは全然違います。

| 項目 | MoA | MoE |

|---|---|---|

| 正式名称 | Mixture of Agents | Mixture of Experts |

| 何をするか | 複数LLMの出力を合成 | 入力に応じて専門家を選択 |

| レベル | アプリケーション層 | モデル内部の構造 |

| 目的 | 回答の質を上げる | 計算効率を上げる |

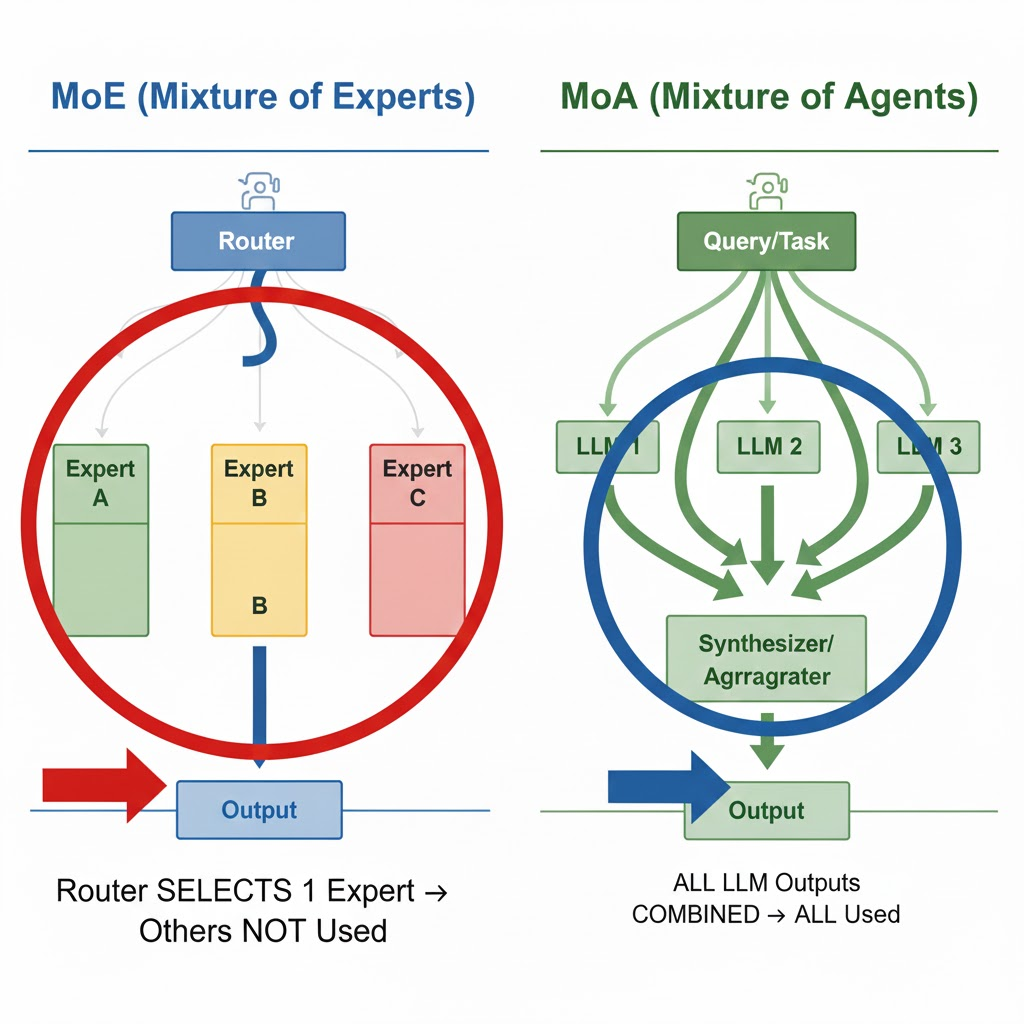

MoA vs MoE 比較図

参考記事:

もっとわかりやすくするためにnano banana proに投げてみた画像

ざっくり言うと

- MoA:みんなの意見をまとめて良い答えを作る

- MoE:得意な人に任せる(他の人は休んでる)

全然違いますね。名前が似てるだけで別物でした。

実装したい人向け:フレームワーク

「自分でもMASやMoAを試してみたい」という人向けに、使えるフレームワークも調べてみました。

| 名前 | 開発元 | 特徴 |

|---|---|---|

| LangGraph | LangChain | グラフ構造でワークフローを定義。細かい制御が可能 |

| AutoGen | Microsoft | 会話ベースで複数エージェントを協調させる |

| CrewAI | CrewAI Inc. | 役割を定義してチームのように動かす。初心者向け |

| OpenAI Agents SDK | OpenAI | 2025年3月リリース。MAS構築に特化 |

OpenAI Agents SDKで私ものちのちに手を動かそうかなと思います。情報が多そう、この辺りは、あまり調べてません。

まとめ

MoAとMASの違い、整理できましたか?

今回わかったこと

- MASは複数AIが協力する仕組み全般(広い概念、1970年代〜)

- MoAはLLMを階層的に組み合わせる具体的な手法(MASの一種、2024年〜)

- MoEは別物。モデル内部で専門家を選ぶ仕組み

- MASが親、MoAが子という関係

覚え方

- MAS = Multi-Agent System = 複数エージェントのシステム

- MoA = Mixture-of-Agents = エージェントの混合

- MoE = Mixture-of-Experts = 専門家の混合

少しでも、参考になれば幸いです。