はじめに

LLMの推論コストを支配する要因のひとつが KVキャッシュ(Key-Value Cache) のメモリ消費である。コンテキスト長が伸びるほどKVキャッシュは線形に膨張し、GPUメモリを圧迫してバッチサイズやスループットを制限する。

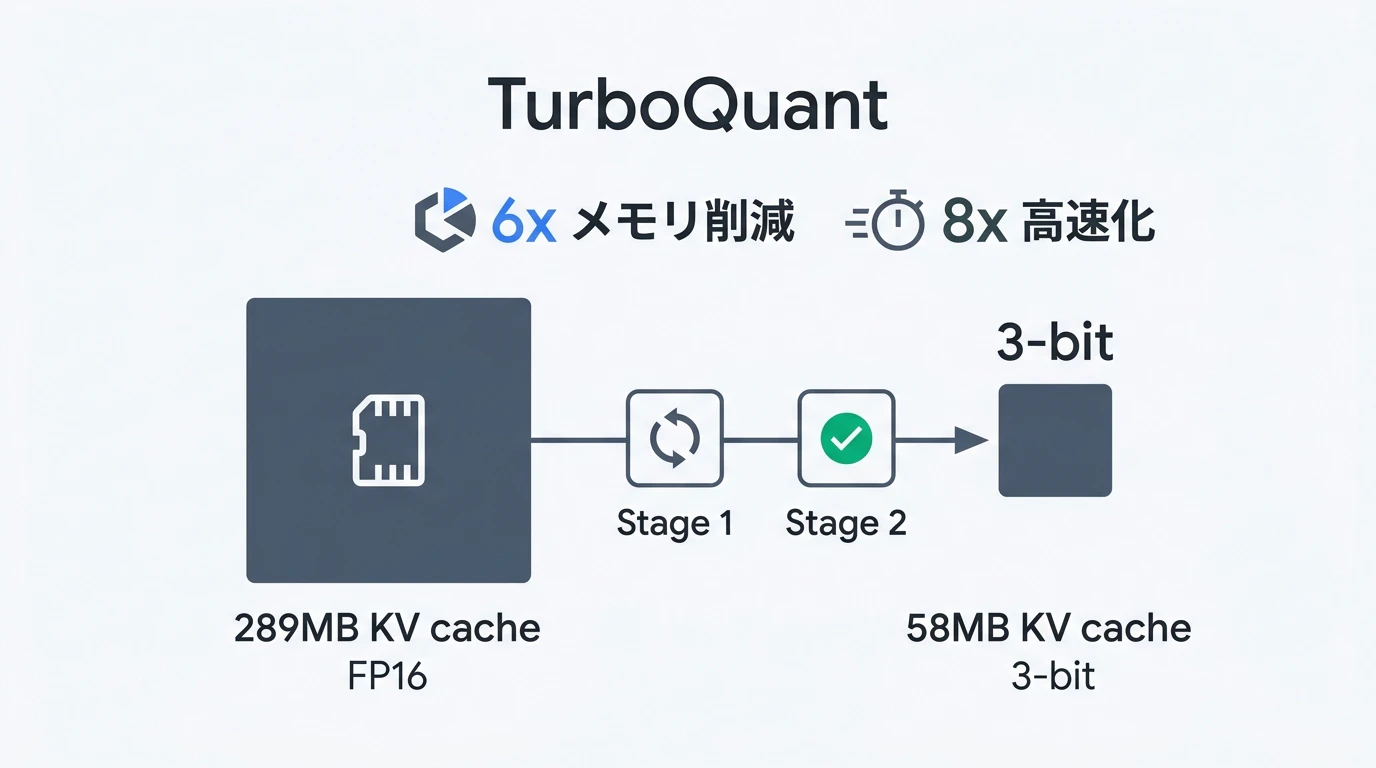

2026年3月25日、Google Researchは新しい圧縮アルゴリズム TurboQuant を公式ブログで発表した。KVキャッシュを 3ビットに圧縮しながら精度損失ゼロ を実現し、メモリ使用量を 6倍削減 、NVIDIA H100上で注意機構の計算を 最大8倍高速化 する。論文は ICLR 2026 で発表される。

この記事では、TurboQuantの技術的な仕組みからベンチマーク結果、コミュニティ実装を使った導入方法までを解説する。

この記事で学べること

- KVキャッシュがLLM推論のボトルネックになる理由

- TurboQuantの2段階圧縮アルゴリズム(PolarQuant + QJL)の仕組み

- ベンチマーク結果と既存手法との比較

- PyTorchコミュニティ実装を使った導入手順

対象読者

- LLMの推論コスト削減に取り組むエンジニア

- KVキャッシュの最適化に関心がある方

- モデル量子化の最新動向を追いたい方

TL;DR

- TurboQuantは PolarQuant(極座標変換+Lloyd-Max量子化) と QJL(1ビット誤差補正) の2段階でKVキャッシュを3ビットに圧縮する

- 再学習・ファインチューニング不要で 精度損失ゼロ を実現

- H100上で メモリ6x削減・最大8x高速化 を達成

- Gemma・Mistral・Llama-3.1-8Bで検証済み。LongBench・RULER等のベンチマークでスコア劣化なし

- コミュニティによるPyTorch実装がMITライセンスで公開済み

KVキャッシュとは何か — LLM推論のメモリボトルネック

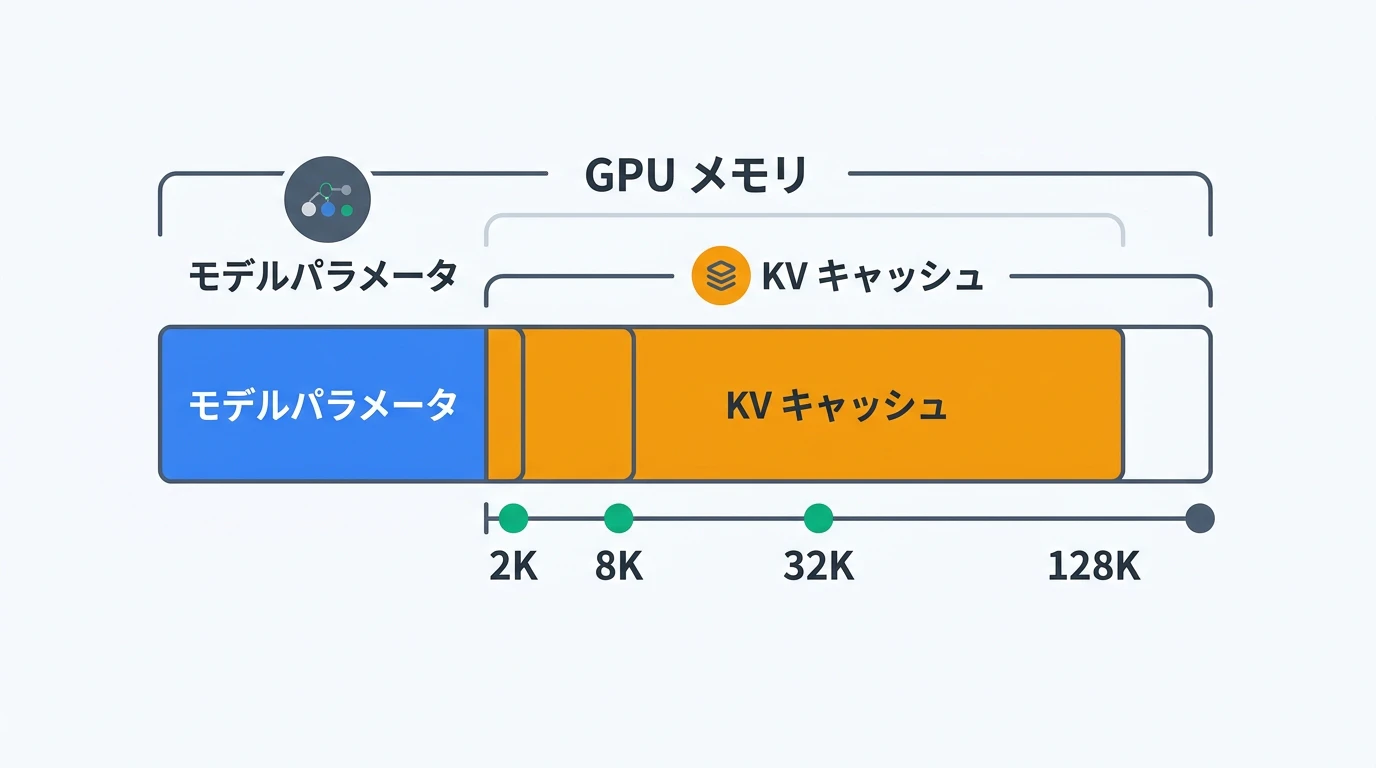

Transformerベースのモデルは、自己回帰的にトークンを生成するたびに過去の全トークンのKey(キー)とValue(バリュー)を参照する。この過去のKey/Valueを再計算せずに保持するメカニズムが KVキャッシュ である。

KVキャッシュのメモリ消費量は以下の式で概算できる。

KVキャッシュサイズ ≈ 2 × レイヤー数 × ヘッド数 × ヘッド次元 × シーケンス長 × バイト数

たとえばLlama-3.1-8Bで8,192トークンのコンテキストを処理する場合、FP16でKVキャッシュだけで約289MBを消費する1。コンテキスト長を128Kまで拡大すると数GBに達し、モデル本体のパラメータと合わせてGPUメモリの大半を占有する。

この問題を解決するため、KVキャッシュを低ビットに量子化する研究が進んでいる。しかし従来手法には精度劣化や追加の学習コストが伴うケースが多かった。TurboQuantはこの課題を根本的に解決するアプローチである。

TurboQuantの仕組み — 2段階圧縮アルゴリズム

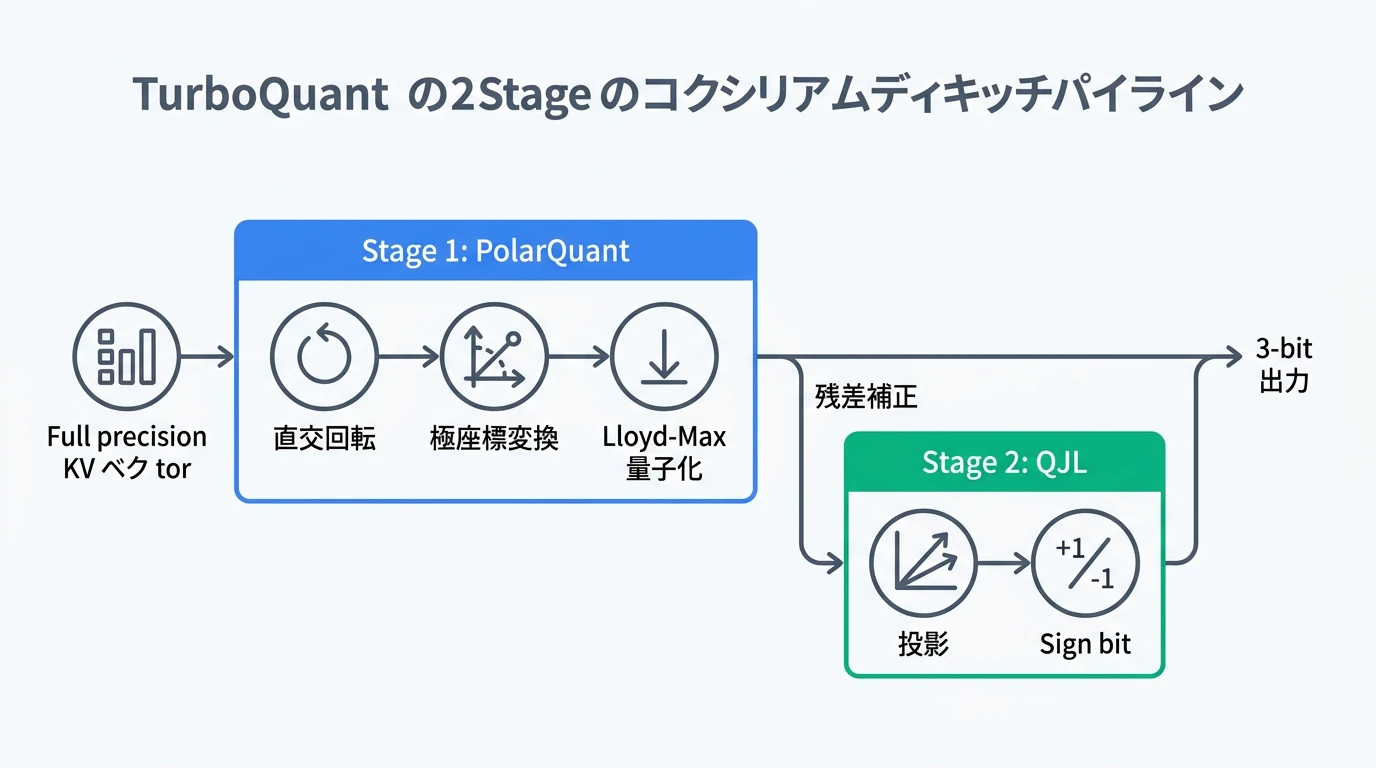

TurboQuantは Stage 1: PolarQuant と Stage 2: QJL の2段階で構成される。それぞれが独立した学術貢献であり、PolarQuantはAISTATS 2026、QJLはAAAI 2025、TurboQuant全体はICLR 2026で発表されている。

Stage 1: PolarQuant — 極座標変換による高効率圧縮

PolarQuantのプロセスは以下の3ステップで進む。

1. ランダム直交回転(QR分解)

入力ベクトルにランダム直交行列を適用し、データの分布を均一化する。これにより特定の次元にエネルギーが集中する問題を解消し、後段の量子化効率を向上させる。

2. デカルト座標から極座標への変換

回転後のベクトルを、従来のX-Y-Z座標(デカルト座標)から半径と角度のペア(極座標)に変換する。ベクトルの対を取り、再帰的に極座標変換を繰り返すことで、最終的に単一の半径と角度の集合に蒸留する。

3. Lloyd-Max量子化

極座標空間上でLloyd-Maxアルゴリズム(MSE最小化に最適なスカラー量子化器)を適用し、各座標を低ビット表現に圧縮する。角度パターンは集中的かつ予測可能であるため、従来の正規化ステップを省略でき、高い圧縮効率を達成する。

Stage 2: QJL — 1ビット誤差補正

PolarQuantによる量子化には微小な残差誤差が残る。QJLはこの残差を わずか1ビット で補正し、数学的にバイアスのない内積推定を保証する。

QJLの仕組みは Johnson-Lindenstrauss変換に基づく。高次元の残差ベクトルをランダム射影行列で低次元に射影し、各成分の 符号(+1 / -1)のみ を保持する。この符号ビットから元の内積を復元する式は以下の通りである。

<q, k> ≈ <q, k_mse> + ||residual|| × √(π/2) / m × <S·q, sign(S·residual)>

ここで k_mse はStage 1の量子化結果、 S はランダム射影行列、 m は射影次元数を表す。第2項が残差補正にあたり、メモリオーバーヘッドはほぼゼロである。

再学習不要という利点

TurboQuantの大きな特徴は、 モデルの再学習やファインチューニングが一切不要 という点である。推論時にKVキャッシュの書き込みフェーズで圧縮を適用するだけで動作するため、既存のモデルにそのまま適用できる。

ベンチマーク結果 — 精度損失ゼロの実証

検証対象モデル

Google Researchの公式ブログによると、TurboQuantは以下のモデルで検証されている2。

- Gemma

- Mistral

- Llama-3.1-8B-Instruct

評価ベンチマーク

長文コンテキスト処理能力を測定する5つのベンチマークで評価されている。

| ベンチマーク | 評価内容 |

|---|---|

| LongBench | 長文の要約・QA・コード補完など多タスク |

| Needle In A Haystack | 長文中の特定情報検索精度 |

| ZeroSCROLLS | ゼロショットでの長文理解 |

| RULER | 合成タスクによるコンテキスト長スケーリング |

| L-Eval | 長文評価の統合ベンチマーク |

公式ブログでは、3ビット圧縮において これらのベンチマーク全体で精度劣化が観測されなかった と報告されている。

ハードウェア性能

Tom's Hardwareの報道によると、NVIDIA H100 GPU上での実測値は以下の通りである。

| 指標 | 値 |

|---|---|

| KVキャッシュメモリ削減率 | 6x以上 |

| 注意機構の計算高速化(4bit、32bit比) | 最大8x |

| 圧縮ビット幅 | 3ビット(精度損失ゼロ) |

| 再学習の要否 | 不要 |

コミュニティ実装のベンチマーク

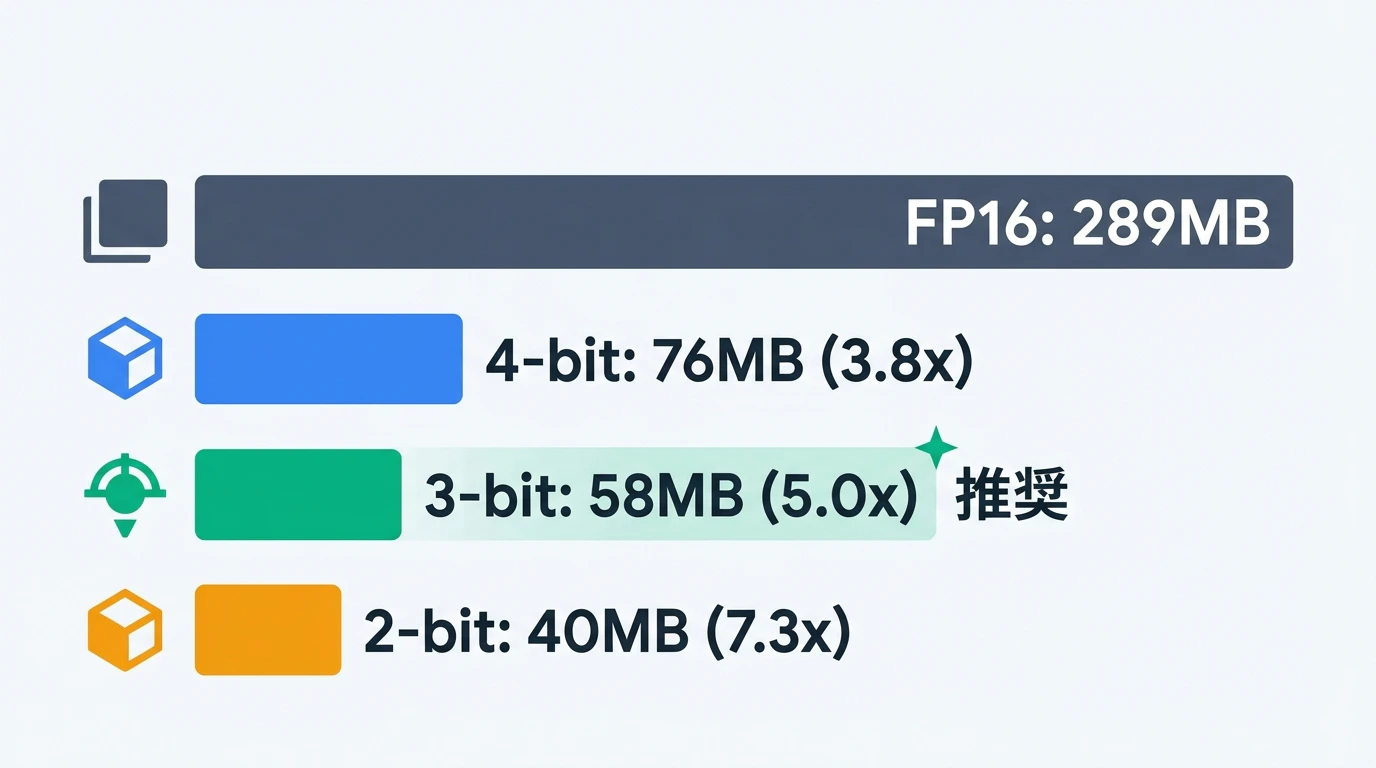

PyTorchコミュニティ実装 turboquant-pytorch では、Qwen2.5-3B-Instructモデルで以下の結果が報告されている3。

圧縮率(8Kコンテキスト、FP16ベースライン289MB)

| ビット幅 | 圧縮後サイズ | 圧縮率 |

|---|---|---|

| 4-bit | 76MB | 3.8x |

| 3-bit | 58MB | 5.0x |

| 2-bit | 40MB | 7.3x |

注意機構の忠実度(3-bit、36レイヤー・72 KVヘッド)

| 指標 | 値 |

|---|---|

| コサイン類似度 | 0.9945 〜 0.9961 |

| Top-1トークン一致率 | 75 〜 86% |

| Top-5トークン一致率 | 88 〜 94% |

3ビットが「圧縮率と精度のバランスが取れた実用的なスイートスポット」とされている。

既存手法との違い

KVキャッシュ圧縮の既存手法としては KIVI や GEAR などが知られている。TurboQuantが既存手法と異なる主なポイントを整理する。

| 観点 | 既存手法(KIVI・GEAR等) | TurboQuant |

|---|---|---|

| 理論的保証 | 経験的に良好 | 理論的下界に近い最適性が証明済み |

| 精度損失 | 低ビットで劣化が見られる場合あり | 3ビットで精度損失ゼロ |

| 追加学習 | キャリブレーションデータが必要な場合あり | 完全に不要 |

| 適用範囲 | KVキャッシュ専用 | KVキャッシュ + ベクトル検索にも適用可能 |

| 構成 | 単一手法 | PolarQuant + QJLの2段階(各段階が独立論文) |

特筆すべきは理論的な裏付けの強さである。Google Researchブログでは、TurboQuant・PolarQuant・QJLの各手法が 理論的下界に近い証明可能な効率性 を持つことが強調されている2。

PyTorchコミュニティ実装を使った導入手順

Google公式の実装は2026年3月時点で未公開だが、コミュニティによるPyTorch実装がMITライセンスで公開されている。以下に導入手順を示す。

環境要件

- Python 3.10以上

- PyTorch 2.0以上(CUDA対応)

- scipy、transformers、accelerate、bitsandbytes

インストール

git clone https://github.com/tonbistudio/turboquant-pytorch.git

cd turboquant-pytorch

pip install -r requirements.txt

GPU用のPyTorchが未インストールの場合は追加で以下を実行する。

pip install torch --index-url https://download.pytorch.org/whl/cu128

基本的な検証実行

合成データによるアルゴリズム検証(CPU可)を実行する。

python -m turboquant.test_turboquant

GPUで実モデルを使った検証を行う場合は以下を実行する。最低6GB VRAMのCUDA GPUが必要で、初回は約2GBのモデルダウンロードが発生する。

python -m turboquant.validate

APIの構成

コミュニティ実装では、以下の主要クラスが提供されている。

| クラス | 役割 |

|---|---|

TurboQuantMSE |

Stage 1: 回転 + Lloyd-Max量子化 |

TurboQuantProd |

Stage 2: QJL残差補正を追加した内積推定 |

TurboQuantKVCache |

KVキャッシュのラッパーインターフェース |

TurboQuantCompressorV2 |

Keyベクトル圧縮 + asymmetric_attention_scores()

|

TurboQuantCompressorMSE |

Valueベクトル圧縮 |

この実装はコミュニティによる非公式実装であり、Google Research公式の実装ではない。本番環境への適用前に十分な検証を行うことを推奨する。

市場へのインパクト — メモリ半導体株が下落

TurboQuantの発表は技術コミュニティだけでなく金融市場にも波紋を広げた。The Next WebやSeeking Alphaの報道によると、Micron(MU)・Western Digital(WDC)・SanDisk(SNDK)などのメモリ半導体株が発表直後に下落した。AIデータセンターのメモリ需要が減少するとの見方が売り圧力を生んだ形である。

TechCrunchの記事では、シリコンバレーのドラマ「Pied Piper」の圧縮アルゴリズムになぞらえるコメントがSNSで拡散し、「Pied Piper」がトレンド入りしたことも報じられている。

ただし、TechCrunchは現時点では「ラボ実験段階」であることも指摘している。本番環境への広範な適用にはvLLMやHugging Face等のエコシステムとの統合が必要であり、これはQ2 2026以降になると予想されている。

今後の展望

TurboQuantの今後に関して注目すべきポイントを整理する。

エコシステム統合: llama.cppでは既にTurboQuantサポートのFeature Requestが起票されている。vLLM・Hugging Face Transformersへの統合も期待されており、公式サポートが入ればLLM推論パイプラインに手軽に組み込めるようになる。

ベクトル検索への応用: TurboQuantはKVキャッシュだけでなくベクトル検索の圧縮にも適用可能であることが論文で示されている。RAGパイプラインのベクトルデータベースにおけるメモリ効率化にも貢献し得る。

Google公式実装の公開: 現時点ではコミュニティ実装のみだが、ICLR 2026での正式発表後にGoogle公式のリファレンス実装が公開される可能性がある。

まとめ

- TurboQuantは PolarQuant + QJL の2段階でKVキャッシュを3ビットに圧縮し、精度損失ゼロ・メモリ6x削減・最大8x高速化を実現する

- 再学習不要 で既存モデルにそのまま適用可能

- Gemma・Mistral・Llama-3.1-8Bの長文ベンチマークで精度劣化なしを確認

- コミュニティ実装が既にMITライセンスで利用可能

- 本番環境への広範な適用はエコシステム統合待ちだが、LLM推論コスト削減の有力な手段として注目に値する

参考リンク

- TurboQuant: Redefining AI efficiency with extreme compression — Google Research Blog(2026年3月25日) — 記事全体の主要ソース

- TurboQuant論文(arXiv) — ICLR 2026採択論文

- PolarQuant論文(arXiv) — AISTATS 2026、Stage 1の詳細

- QJL論文(ACM DL) — AAAI 2025、Stage 2の詳細

- tonbistudio/turboquant-pytorch — GitHub — コミュニティPyTorch実装(MIT License)

- Tom's Hardware: Google's TurboQuant compresses LLM KV caches to 3 bits — ハードウェア性能セクションの出典

- MarkTechPost: Google Introduces TurboQuant — 技術概要の出典

- llama.cpp TurboQuant Feature Request — エコシステム統合の展望

-

tonbistudio/turboquant-pytorch のベンチマーク結果より ↩

-

TurboQuant: Redefining AI efficiency with extreme compression — Google Research Blog(2026年3月25日) ↩ ↩2

-

tonbistudio/turboquant-pytorch — GitHub(MIT License) ↩