はじめに

2026年3月11日、Anthropicは社内研究機関「The Anthropic Institute」の設立を公式発表しました。

単なる組織改編ではなく、AI開発企業が自社の技術リスクを研究・発信する「内部シンクタンク」という新しいモデルを打ち出した点が注目されています。既存の3つの研究チームを統合し、研究成果を外部の研究者・一般市民が参照できる形で積極的に公開していく方針を掲げています。

この記事では、以下の点を公式発表と報道をもとに整理します。

- Anthropic Instituteの設立背景と組織構造

- 3つの研究チームが担う具体的なテーマ

- Frontier Red TeamによるAIセキュリティ評価の内容

- Claude APIを利用する開発者が知っておくべき影響

対象読者

- Claude APIを利用している開発者・エンジニア

- AIシステムのセキュリティ・安全性に関心があるエンジニア

- AIの社会的影響を把握しておきたい技術者

TL;DR

- Anthropic Instituteは2026-03-11設立のAnthropicの内部シンクタンク

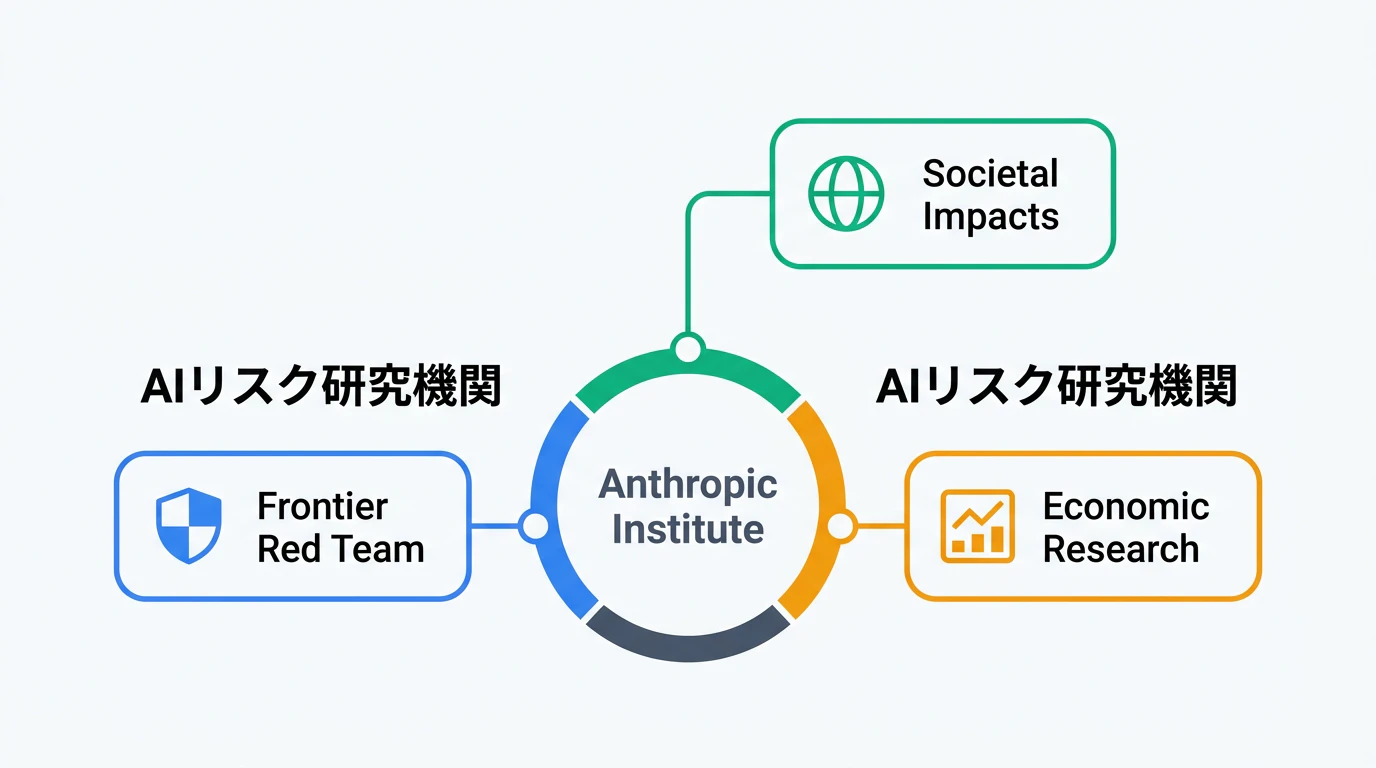

- Frontier Red Team・Societal Impacts・Economic Researchの3チームを統合

- Frontier Red Teamはサイバーリスク評価(Firefox脆弱性スキャン等)を担当

- Anthropic Economic Indexなど研究成果はすでに公開中

- DC事務所を2026年春に開設し、AI政策立案への関与を強化

Anthropic Instituteとは

設立の背景

Anthropic Instituteは、AnthropicのAI研究とその社会影響を体系的に調査・発信するための組織です。公式の設立声明では、以下のミッションが掲げられています。

"powerful AIが社会に及ぼす最も重大な課題に立ち向かうこと"

設立の背景として、以下の文脈があります。

AI能力の急速な進展:

大規模言語モデルの能力向上により、AIエージェントが自律的に複雑なタスクを実行できるようになりました。この能力向上に対して、リスク評価の体制を整備する必要性が高まっていました。

外部への透明性確保:

Anthropicはこれまでも安全性研究を行ってきましたが、研究成果の外部公開を組織的・継続的に行う仕組みが必要でした。Instituteの設立により、研究ファーストの姿勢を組織として明確化しています。

政策立案への積極参加:

DCに事務所を開設し、AIガバナンスの政策立案に直接関与する体制を整えます。元Stripe幹部の Sarah Heck をPublic Policyのリードとして採用しています。

リード: Jack Clark

Anthropic Instituteを率いるのは共同創業者のJack Clark(Head of Public Benefit)です。Clark氏はAnthropicの共同創業者の一人として創業当初からAI政策・公益分野を担当してきており、今回新たにHead of Public Benefitの役割を引き受けた形です。

3つの研究チーム

Anthropic Instituteは、既存の3つの研究チームを統合した組織です。各チームの担当領域と実績を整理します。

1. Frontier Red Team — AIのサイバーリスク評価

担当領域: AI能力の限界評価、サイバーセキュリティリスクの定量化

Frontier Red Teamは、「AIが実際に何ができるか・何ができないか」を厳密にテストするチームです。特にサイバーセキュリティの文脈で、AIが自律的に脆弱性を発見・悪用できるかの評価に取り組んでいます。

実績例: Firefox脆弱性スキャン

ClaudeをMozilla Firefoxのコードベースに適用し、AIが自律的にセキュリティバグを発見・悪用できるかを検証しました(article 029でも解説)。この種の研究結果は今後Anthropic Institute経由で外部研究者向けに公開される方針です。

開発者への影響:

Frontier Red Teamの評価基準が、ClaudeのSystem Promptポリシーや利用規約に影響する可能性があります。研究成果の公開により、Claudeの能力境界についての透明性が高まることが期待されます。

2. Societal Impacts — 現実世界でのAI利用調査

担当領域: Claude.aiの実際の利用状況・AIエージェントの自律タスク研究

Societal Impactsチームは、AIが実際の社会でどのように使われているかを調査します。Claude.aiのユーザーとの相互作用データを収集・分析し、AIエージェントが自律的にタスクを実行する場面の調査も行っています。

主な研究テーマ:

- AIエージェントが自律実行するタスクの種類と頻度

- ユーザーがAIとどのようなやり取りをしているか

- AIが人間の作業を代替・補完する具体的なパターン

このチームの知見は、Anthropicの製品開発方針や、APIの利用制限・ガイドラインの策定にも反映されます。

3. Economic Research — 雇用・経済への影響追跡

担当領域: AIが雇用と経済全体に与える影響の定量化

Economic Researchチームは、AI普及が労働市場・産業構造にどのような変化をもたらすかを継続的に調査します。すでに Anthropic Economic Index として定期レポートを公開しており、2026年1月から継続的に発行されています。

主要メンバー:

| 氏名 | 前職 | 専門領域 |

|---|---|---|

| Anton Korinek | バージニア大学 経済学教授(休職中) | トランスフォーマティブAIが経済活動を再構成するメカニズム研究 |

| Zoë Hitzig | 元OpenAI リサーチサイエンティスト | 経済研究とモデルトレーニング・開発の接続 |

| Matt Botvinick | 元Google DeepMind シニアリサーチディレクター / Yale Law School レジデントフェロー | AIと法の支配(Rule of Law)の関係 |

Anthropic Economic Indexとは:

Claudeを通じた実際の業務データに基づき、AIが現実の労働市場にどのような影響を与えているかを定量分析したレポートです。研究成果は anthropic.com/research で公開されています。

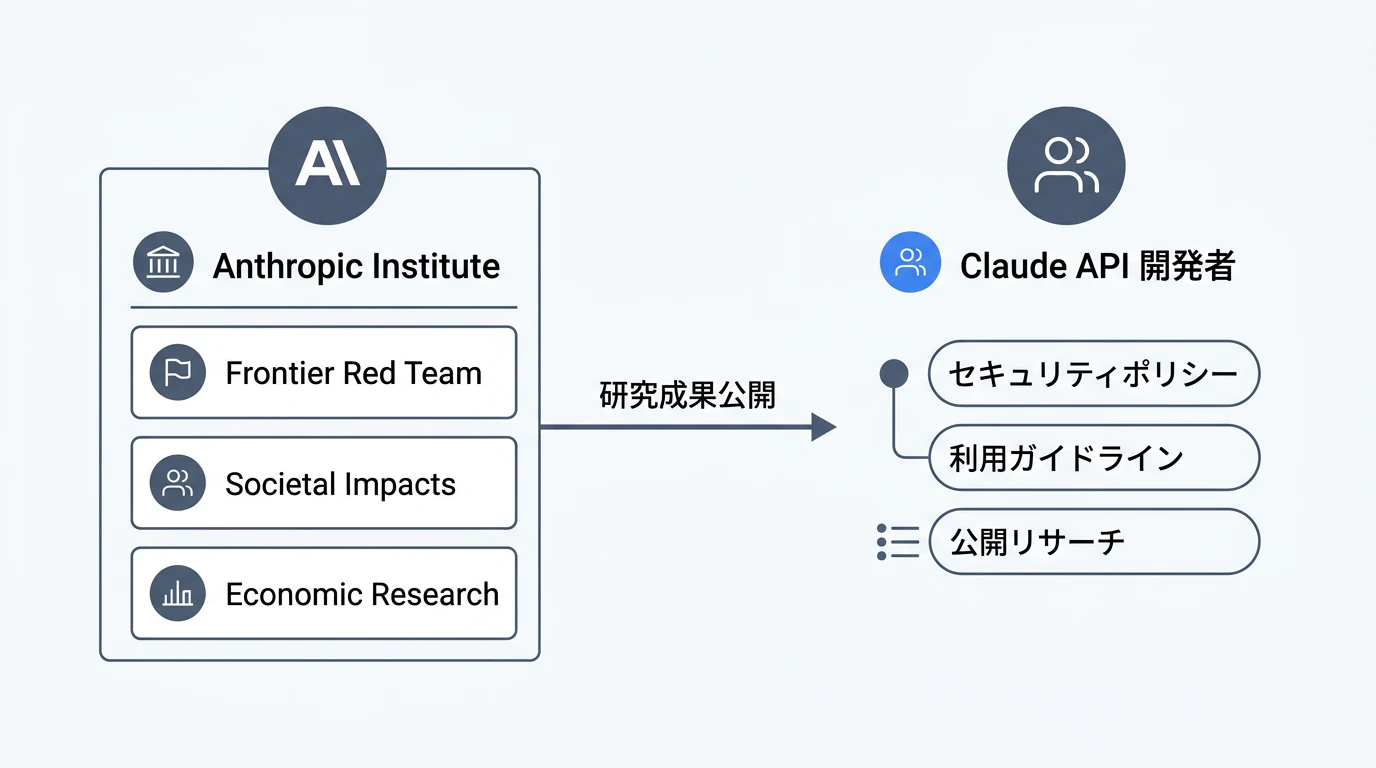

開発者が把握すべき影響

Anthropic Instituteの設立は、Claude APIを利用する開発者にも以下の観点で影響があります。

セキュリティ評価基準の透明化

Frontier Red Teamの研究成果が外部公開されることで、Claudeがどのような悪用パターンに対して制限をかけているか、またどの範囲のタスクを実行可能かについての透明性が向上します。

セキュリティ要件を持つシステムにClaudeを組み込む場合、Frontier Red Teamのレポートは参照価値の高い一次情報になります。

APIポリシーへの間接的影響

Societal Impactsチームが収集する実利用データは、今後のAPIの利用ポリシー・レート制限・コンテンツフィルタリングの改定に反映される可能性があります。特にエージェント型の自律実行タスクに関するガイドラインの整備が進む見通しです。

公開リサーチの活用

以下のリソースはすでに参照可能です。

| リソース | 内容 | URL |

|---|---|---|

| Anthropic Economic Index | AIによる労働市場への影響分析 | anthropic.com/research |

| Anthropic Institute公式発表 | 設立の詳細・研究方針 | anthropic.com/news/the-anthropic-institute |

| Anthropic Fellows Program | AI安全性研究者向けフェローシップ | alignment.anthropic.com |

研究テーマの追加

公式発表では、今後以下のテーマについての研究を新たに追加する予定が明示されています。

- AI進展の予測研究: 今後のAI能力の進化をどう予測・評価するか

- テクノロジーと法制度の相互作用: AI規制・法整備の方向性に関する研究

これらの研究成果は、企業がAIシステムを設計・運用する際のリスク管理指針として活用できる情報になります。

組織展開: DC事務所開設

Anthropic Instituteは2026年春にワシントンD.C.事務所を開設します。AI規制・倫理・政策立案に関与する政府機関・シンクタンクとの協力体制を強化するのが目的です。

日本を含む各国のAI規制の動向に関心があるエンジニアや企業担当者は、Anthropic Instituteからの公開情報を定期的にフォローすることをおすすめします。

まとめ

Anthropic Instituteの設立は、AI開発企業が「自社技術のリスクを自ら研究・公開する」体制を組織的に整備した事例として注目されます。

- Frontier Red Team: Claudeのサイバーリスク評価。Firefox脆弱性スキャン等の研究成果が今後公開予定

- Societal Impacts: AIエージェントの現実利用状況調査。API利用ポリシーに間接的に反映

- Economic Research: Anthropic Economic Indexとして労働市場への影響を定量公開中

- DCオフィス開設: 2026年春、AI政策立案への直接関与を強化

Claude APIを利用するエンジニアとして、Anthropic Instituteが公開する研究成果は、AIシステムの設計・運用判断における信頼できる一次情報として活用できます。