はじめに

2026年2月13日、OpenAIはGPT-5.3-Codex-Sparkをリサーチプレビューとして公開しました。Codex-Sparkは、GPT-5.3-Codexの軽量版として設計されたリアルタイムコーディング特化モデルです。

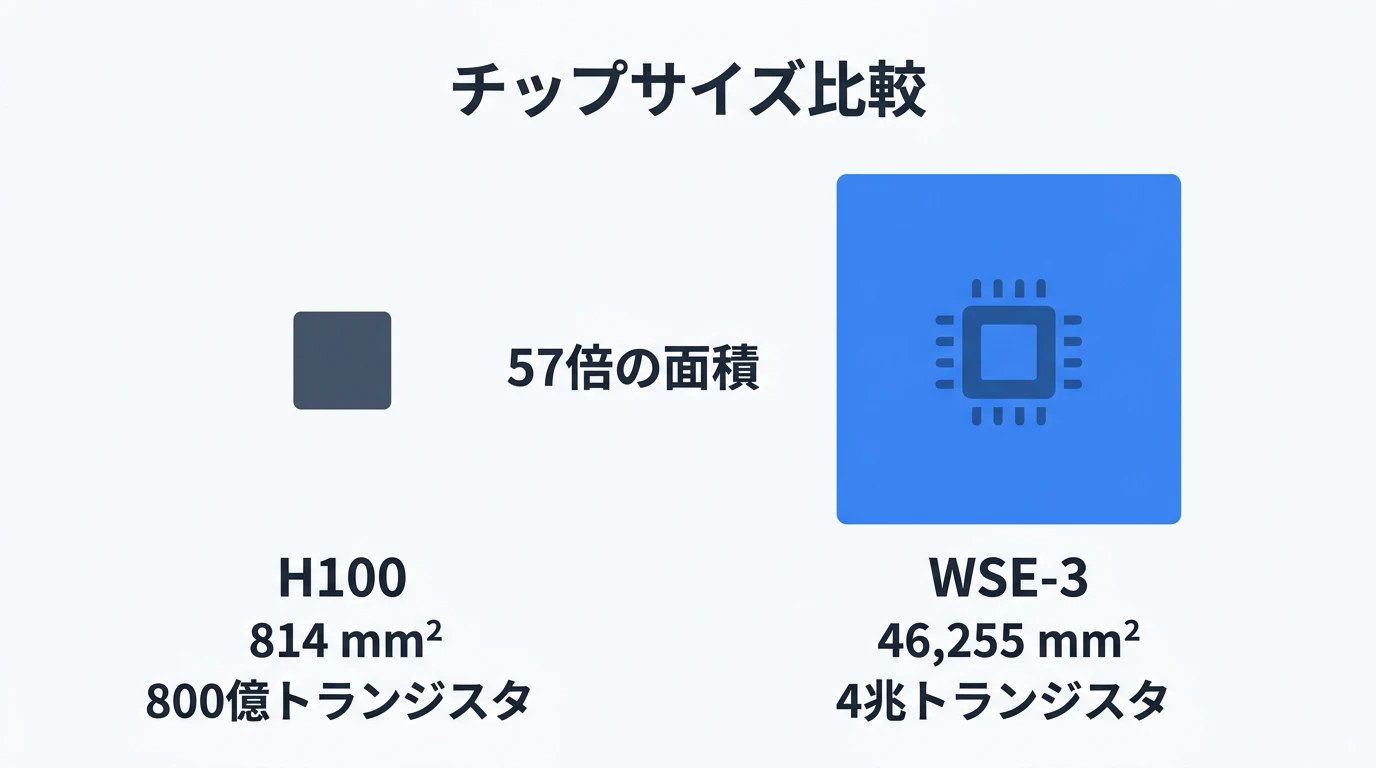

最大の特徴は1,000トークン/秒以上の推論速度です。これはフルサイズのGPT-5.3-Codex(約65トークン/秒)の約15倍にあたります。この高速化を実現しているのが、Cerebras社のWafer Scale Engine 3(WSE-3)チップです。OpenAIにとって初めてのNvidia以外のハードウェアでの本番デプロイメントとなります。

この記事で学べること

- GPT-5.3-Codex-Sparkの概要と特徴

- 超高速推論を支えるCerebras WSE-3の技術

- ベンチマーク結果と既存AIコーディングツールとの比較

- 利用方法とアクセス条件

対象読者

- AIコーディングツールを活用している開発者

- OpenAI Codexの利用を検討している方

- AI推論ハードウェアの動向に興味がある方

TL;DR

- GPT-5.3-Codex-Sparkはリアルタイムコーディングに特化した軽量モデルで、1,000トークン/秒以上の推論速度を実現

- Cerebras WSE-3チップ(4兆トランジスタ、ウェハー1枚丸ごとの巨大チップ)により超低レイテンシを達成

- ChatGPT Proユーザー向けにリサーチプレビューとして利用可能(Codex App / CLI / VS Code拡張)

GPT-5.3-Codex-Sparkとは

Codex-Sparkは「リアルタイムの対話的コーディング」を目的に設計された、GPT-5.3-Codexの小型・高速版です。

フルサイズCodexとの位置づけ

| 項目 | GPT-5.3-Codex | Codex-Spark |

|---|---|---|

| 用途 | 大規模リファクタリング、設計、セキュリティ監査 | リアルタイム編集、クイックフィックス、ペアプログラミング |

| 推論速度 | 約65トークン/秒 | 1,000トークン/秒以上 |

| コンテキストウィンドウ | 非公開 | 128Kトークン |

| 入力形式 | テキスト | テキストのみ(マルチモーダル非対応) |

| 推奨比率 | 複雑な20%のタスク | 日常的な80%のタスク |

OpenAIが公式に推奨するのは「日常のコーディング作業の80%をSparkで、深い推論が必要な20%をフルCodexで」という使い分けです。

主な特徴

- 超低レイテンシ: Time-to-first-token(最初のトークン生成までの時間)が従来比50%短縮

- 高速生成: 1,000トークン/秒以上で、コード補完がほぼ瞬時に返る

- 実用的な精度: SWE-Bench Proではフルサイズと同等水準の精度を維持

- 128Kコンテキスト: 大規模なファイルやプロジェクトコンテキストに対応

なぜ1,000tok/sが可能なのか — Cerebras WSE-3の技術

Codex-Sparkの速度を支えるのが、Cerebras社のWafer Scale Engine 3(WSE-3)です。通常のGPU/チップとは根本的に異なるアーキテクチャを採用しています。

WSE-3の主要スペック

| スペック | Cerebras WSE-3 | Nvidia H100(参考) |

|---|---|---|

| トランジスタ数 | 4兆個 | 800億個 |

| ダイサイズ | 46,255 mm²(ウェハー1枚分) | 約814 mm² |

| オンチップメモリ | 44GB SRAM | 80GB HBM3 |

| AIコア数 | 90万コア | 非公開 |

| ピーク性能 | 125 PFLOPS | 約4 PFLOPS(FP8) |

| プロセス | TSMC 5nm | TSMC 4nm |

WSE-3のオンチップメモリは44GB SRAMで、H100の80GB HBM3と比べると容量は小さいですが、SRAMはチップ上に直接搭載されているため、HBM(High Bandwidth Memory)と比べてアクセスレイテンシが桁違いに低いという特徴があります。

なぜ速いのか

通常のAI推論では、複数のGPUチップ間でデータをやり取りするオーバーヘッドが発生します。WSE-3はウェハー1枚をまるごと1つのチップとして利用する「ウェハースケール」設計により、チップ間通信のレイテンシを完全に排除しています。

GPUベースのシステムでは、トークン生成のたびにチップ間のデータ転送が発生しますが、WSE-3ではすべての演算がオンチップで完結します。これが1,000トークン/秒以上という速度の根本的な理由です。

OpenAI × Cerebrasパートナーシップ

2026年1月に発表されたこのパートナーシップの概要は以下のとおりです。

- Codex-SparkはOpenAI初の非Nvidiaハードウェアでの本番デプロイメント

- 100億ドル超の契約規模で、2028年までに750MWのCerebras対応コンピュートをフェーズ的に稼働予定

- 低レイテンシ推論に特化したインフラストラクチャの構築(世界最大規模の高速AI推論デプロイメント)

これはAI業界にとって「推論最適化は専用ハードウェアがGPUに勝てる領域がある」というシグナルでもあります。

ベンチマーク・性能比較

コーディングベンチマーク

| ベンチマーク | GPT-5.3-Codex | Codex-Spark | 備考 |

|---|---|---|---|

| SWE-Bench Pro(精度) | 56.8% | 同等水準 | 実用的な精度を維持 |

| SWE-Bench Pro(速度) | 15〜17分 | 2〜3分 | 5〜8倍高速 |

| Terminal-Bench 2.0 | 77.3% | 58.4% | 複雑なタスクでは精度トレードオフあり |

SWE-Bench Proは実際のソフトウェアエンジニアリングタスクを測定するベンチマークです。Codex-Sparkはフルサイズと同等の精度を保ちつつ、処理時間を大幅に短縮しています。一方、複雑なターミナル操作を測定するTerminal-Bench 2.0では精度差が見られ、タスクの複雑さに応じた使い分けが求められます。

推論速度の比較(他社モデル)

| モデル | 推論速度(トークン/秒) | Codex-Sparkとの差 |

|---|---|---|

| GPT-5.3-Codex-Spark | 1,000以上 | — |

| Gemini 3 Flash | 約300 | 約3.3倍差 |

| Claude Haiku 4.5 | 約200 | 約5倍差 |

| DeepSeek Coder V3 | 約180 | 約5.5倍差 |

| GPT-5.2 Instant | 約150 | 約6.7倍差 |

推論速度ではCodex-Sparkが他のコーディングAIモデルを大きく引き離しています。ただし、これはCerebras WSE-3という専用ハードウェアの恩恵が大きく、汎用GPUベースの他モデルとは前提条件が異なる点に留意が必要です。

上記の他社モデルの推論速度は、サードパーティのベンチマーク記事(NxCode, 2026年2月)に基づく参考値です。各モデルの速度はインフラ構成や負荷状況により変動します。

使い方・アクセス方法

2026年3月時点では、ChatGPT Proサブスクリプション(月額200ドル)が必要です。以下の3つの方法でアクセスできます。

1. Codex App(Web)

ChatGPTのCodexインターフェースからモデル選択でSparkを指定できます。

2. Codex CLI

ターミナルからCodex CLIを使用する方法です。

# Codex CLIのインストール

npm i -g @openai/codex

インストール後、codex コマンドで対話型TUI(Terminal UI)セッションが起動します。セッション内で /model コマンドを使用してSparkモデルに切り替えることができます。

CLIでは、インタラクティブモードでは自動的にSparkが選択され、自律タスクモードではフルCodexが選択される仕組みになっています。

3. VS Code拡張

- VS CodeでOpenAI Codex拡張をインストール

- 設定画面でモデルを「Codex-Spark」に変更

- インライン補完やサイドバーからコード生成を利用

アクセス条件まとめ

| 項目 | 内容 |

|---|---|

| プラン | ChatGPT Pro(月額200ドル) |

| ステータス | リサーチプレビュー |

| 対応ツール | Codex App / CLI / VS Code拡張 |

| API | 一部のデザインパートナーに限定提供中 |

| Plus/Teamプラン | プレビュー期間中は利用不可 |

注意点・制限事項

Codex-Sparkは強力なツールですが、以下の制限を理解した上で活用する必要があります。

精度のトレードオフ

Terminal-Bench 2.0ではフルCodexの77.3%に対してSparkは58.4%と、複雑なタスクでは精度が低下します。大規模なリファクタリングやアーキテクチャ設計など、深い推論が求められるタスクにはフルCodexの使用が推奨されます。

コスト

ChatGPT Proサブスクリプション(月額200ドル)が前提となるため、個人開発者にとってはコストバリアが存在します。Plus/Teamプランへの展開時期は未発表です。

コンテキストウィンドウ

128Kトークンのコンテキストウィンドウは多くのユースケースに十分ですが、モノレポや巨大なコードベースを一括で扱う場合には制約となる可能性があります。

リサーチプレビュー

現時点ではリサーチプレビューのため、本番環境での利用には注意が必要です。レート制限も通常のOpenAIモデルとは別枠で設定されています。

まとめ

- GPT-5.3-Codex-Sparkはリアルタイムコーディングに特化した軽量モデルで、Cerebras WSE-3チップにより1,000トークン/秒以上の推論速度を実現

- SWE-Bench Proでフルサイズと同等の精度を維持しつつ、処理速度を5〜8倍に向上

- OpenAI初の非Nvidiaデプロイメントであり、AI推論ハードウェアの多様化を示す転換点

- 現在はChatGPT Pro向けリサーチプレビュー。API一般提供やPlusプラン対応は今後に期待

「日常のコーディング80%をSparkで、深い推論20%をフルCodexで」という使い分けが、今後のAIコーディングワークフローの標準になるかもしれません。

参考リンク

- Introducing GPT-5.3-Codex | OpenAI

- Introducing GPT-5.3-Codex-Spark | OpenAI

- Introducing OpenAI GPT-5.3-Codex-Spark Powered | Cerebras

- GPT-5.3-Codex-Spark Guide | NxCode

- A new version of OpenAI's Codex is powered by a new dedicated chip | TechCrunch

- OpenAI partners with Cerebras | OpenAI

- Cerebras Wafer Scale Engine 3 | Cerebras