はじめに

2026年3月4〜5日、Lightricksがオープンソースの動画生成モデル LTX-2.3 を公開しました。LTX-2ファミリーの最新版で、4K解像度・最大20秒・最大50FPSの動画生成に対応しています。

この記事では、LTX-2.3の主な改善点・システム要件・セットアップ手順・Pythonコードサンプル・他モデルとの比較を公式ドキュメントをもとに整理します。

この記事で学べること

- LTX-2.3のアーキテクチャと前バージョンからの改善点

- セットアップ手順(GitHub / ComfyUI / fal.ai API)

- テキストから動画を生成するPythonコードサンプル

- 商用クローズドモデルとの性能・ポジショニング比較

対象読者

- AI動画生成に興味があるエンジニア

- ローカル環境でオープンソースモデルを動かしたい方

- Sora・Veo・Runwayなど商用サービスと比較検討している方

前提知識・環境

- Python 3.12以上

- NVIDIA GPU(推奨: VRAM 32GB以上)

- uv(Pythonパッケージマネージャー)

TL;DR

- LTX-2.3は22B DiTモデル。4K・20秒・50FPSに対応するオープンソース最高峰の動画生成モデル

- VAEとテキストコネクタの刷新によりプロンプト追従精度が大幅に向上

- ComfyUIがDay-0サポート済みで、ノーコードでも利用可能

- VRAM 32GB未満の環境はfp8量子化版・蒸留版での対応が現実的

- ライセンスは

ltx-2-community-license-agreement(Apache 2.0ではない)ため商用利用前に原文確認が必要

LTX-2.3とは

LTX-2.3は、Lightricksが開発する LTX-2ファミリー の2026年3月版アップデートです。アーキテクチャ自体を刷新するのではなく、VAE・テキストコネクタ・ボコーダーという3つのコアコンポーネントの品質改善に特化しています。

モデル概要

| 項目 | 仕様 |

|---|---|

| アーキテクチャ | Diffusion Transformer (DiT) |

| パラメータ数 | 22B |

| 最大解像度 | 4K(2160p) |

| ネイティブポートレート | 1080×1920(9:16) |

| フレームレート | 24 / 25 / 48 / 50 FPS |

| 最大動画長 | 20秒 |

| 生成速度 | 1.22秒/ステップ(H100) |

| ライセンス | ltx-2-community-license-agreement |

公式モデルページ: ltx.io/model/ltx-2-3

HuggingFace: Lightricks/LTX-2.3

LTX-2からの主な改善点

1. VAEの刷新

高品質なトレーニングデータで再学習した新しいVAE(Variational Autoencoder)により、潜在空間の表現精度が向上しました。生成される動画のテクスチャがシャープになり、エッジのクリーンさが改善されています。

2. テキストコネクタの4倍大型化

テキストプロンプトをモデルに伝えるコンポーネントが4倍のサイズに強化されました。これにより、複雑な動きの記述やシーン遷移の指示へのプロンプト追従精度が大幅に向上しています。

3. ネイティブポートレートサポート

従来は横向き(16:9)で生成してからクロップする方式でしたが、LTX-2.3では 1080×1920(9:16) をネイティブに生成できるようになりました。TikTokやInstagram Reelsなどの縦型コンテンツ制作に適しています。

4. 音声品質の改善

フィルタリングされたトレーニングデータと新しいボコーダーにより、生成動画の音声品質が向上しています。

5. テキストレンダリングの改善

動画内に文字を描画する精度が向上しました。字幕・タイトル・ロゴなどのテキスト要素を動画に含める際の視認性が高まっています。

6. 蒸留版の強化

LTX-2.3には8ステップで動作する蒸留版(distilled version)も含まれています。Classifier-Free Guidance(CFG)値1で実行でき、フルモデルと比べて大幅な高速化が可能です。

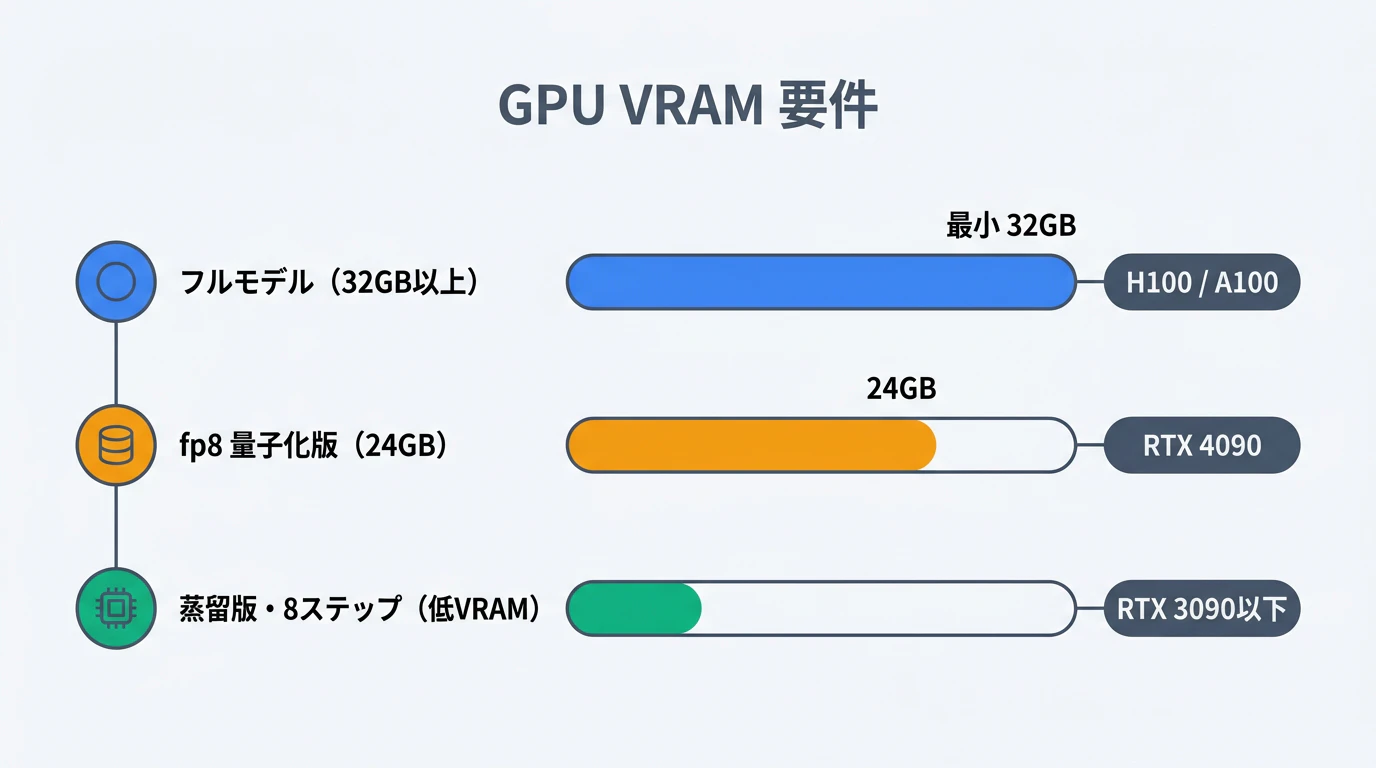

システム要件

| 項目 | 最小構成 | 推奨構成 |

|---|---|---|

| GPU VRAM | 32GB(NVIDIA) | 80GB(A100 / H100) |

| システムメモリ | 32GB | 64GB以上 |

| ストレージ | 100GB | 200GB SSD以上 |

| CUDA | 11.8以上 | 12.1以上 |

| Python | 3.12以上 | — |

| PyTorch | 2.7 | — |

VRAM 24GB以下の環境では、fp8量子化版または蒸留版を使うことで動作する報告があります。8GB GPUでも低解像度・少フレームでの動作は可能とされていますが、公式サポート外の構成です。詳細は公式ドキュメントを参照してください。

セットアップ手順

方法1: GitHubリポジトリから(推奨)

公式リポジトリをクローンして実行します。現時点でdiffusersライブラリ経由のインストールは未サポートのため、この方法が主流です。

git clone https://github.com/Lightricks/LTX-2.git

cd LTX-2

uv sync --frozen

source .venv/bin/activate

モデルウェイトをHuggingFaceからダウンロードします。

huggingface-cli download Lightricks/LTX-2.3 --local-dir ./models/ltx-2.3

方法2: ComfyUIで利用

ComfyUIはLTX-2.3のDay-0サポートを提供しています。専用の拡張機能とワークフローが利用可能です。

# ComfyUI-LTXVideoをカスタムノードとしてインストール

git clone https://github.com/Lightricks/ComfyUI-LTXVideo

# ComfyUI/custom_nodes/ 配下に配置後、ComfyUIを再起動

GUIで操作可能なため、コーディングなしで動画生成を試せます。

方法3: fal.ai API(クラウド)

ローカルGPUがない場合、fal.aiが提供するAPIを通じてLTX-2.3を利用できます。

APIエンドポイント: https://fal.ai/ltx-2.3

Pythonコードサンプル

公式リポジトリをセットアップした後、テキストから動画を生成する基本的な使い方です。

import torch

from ltx_video.pipelines.pipeline_ltx_video import LTXVideoPipeline

from ltx_video.utils.conditioning_utils import get_conditioning_data

# パイプラインの初期化

model_dir = "./models/ltx-2.3"

pipe = LTXVideoPipeline.from_pretrained(

model_dir,

torch_dtype=torch.bfloat16,

)

pipe = pipe.to("cuda")

# テキストから動画を生成

prompt = (

"A serene mountain landscape at sunset, "

"with golden light reflecting off a calm lake, "

"gentle wind rippling through pine trees, "

"4K cinematic quality, 24fps"

)

result = pipe(

prompt=prompt,

negative_prompt="blurry, low quality, distorted",

width=1280,

height=720,

num_frames=97, # 約4秒(24fps)

num_inference_steps=50,

guidance_scale=3.0,

seed=42,

)

# 動画を保存

video_frames = result.frames[0]

# export_to_video は別途 imageio 等を利用

蒸留版(高速生成)を使う場合はモデルパスを蒸留版に変更し、num_inference_steps=8 に設定します。

注意: 上記はLTX-2.3の公開APIをもとに構成したサンプルです。実際の関数シグネチャは公式リポジトリの

examples/ディレクトリで最新版を確認してください。

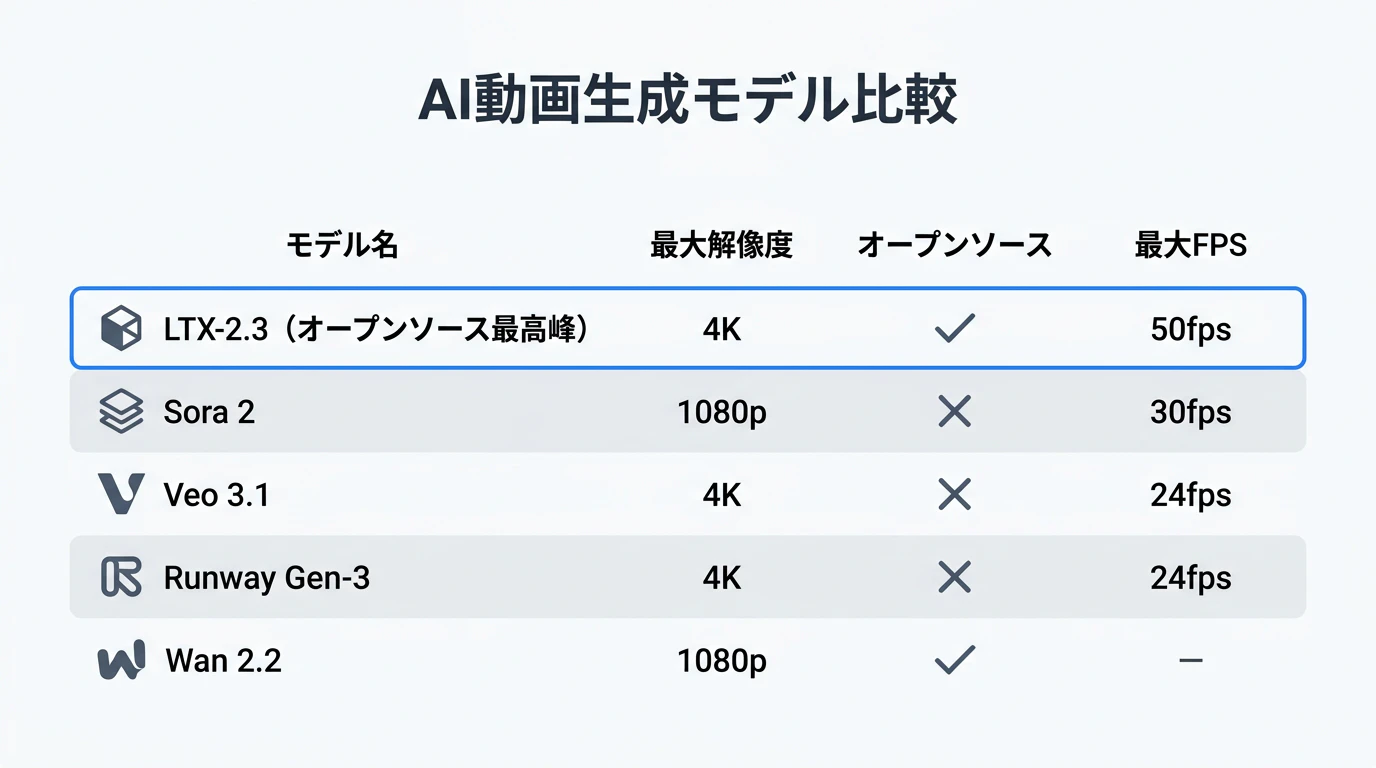

他モデルとの比較

| モデル | 提供形態 | 最大解像度 | 最大FPS | オープンソース | コスト |

|---|---|---|---|---|---|

| LTX-2.3 | セルフホスト / API | 4K | 50fps | ✅ | ローカル無料(GPU必要) |

| Sora 2 | API(OpenAI) | 1080p | 30fps | ❌ | 有料API |

| Veo 3.1 | API(Google) | 4K | 24fps | ❌ | 有料API |

| Runway Gen-3 | SaaS / API | 4K | 24fps | ❌ | サブスクリプション |

| Seedance 2.0 Pro | API(BigMotion) | 2K | — | ❌ | 先行アクセス中 |

| Wan 2.2 | セルフホスト | 1080p | — | ✅ | ローカル無料 |

LTX-2.3の強みは オープンソース最高クラスの解像度とFPS の組み合わせです。シネマティック品質ではSora 2・Veo 3.1が優位ですが、ローカル実行・カスタマイズ・API制約なしという観点ではLTX-2.3が突出しています。

公式はArtificial Analysisのオープンソース動画モデルランキングで1位と主張しています(2026年3月時点)。

注意点・制限事項

ライセンスについて

LTX-2.3のライセンスは ltx-2-community-license-agreement です。Apache 2.0ではないため、商用利用・プロダクト組み込みの際は原文を必ず確認してください。

ライセンス原文 はHuggingFaceのモデルカードから参照できます。

VRAM要件が高い

フルモデルの公式最小要件はVRAM 32GBです。コンシューマー向けGPU(RTX 4090: 24GB)では量子化版または蒸留版の利用を検討してください。

diffusers未対応(2026年3月時点)

from diffusers import ... という形式のシンプルなインポートは現時点で未サポートです。公式リポジトリ(github.com/Lightricks/LTX-2)を直接クローンして使う必要があります。diffusers対応は今後のロードマップに含まれています。

生成速度はGPU依存

H100での1.22秒/ステップというベンチマークは最高級GPUでの数値です。RTX 4090等のコンシューマー向けGPUでは当然低速になります。実際の生成時間は使用するGPU・解像度・ステップ数によって大きく変わります。

まとめ

LTX-2.3は、オープンソース動画生成の新しい水準を示すモデルです。

- 4K・50FPS・20秒という商用モデルと競合するスペックをオープンソースで実現

- VAEとテキストコネクタの刷新によりプロンプト追従性が向上

- ComfyUIのDay-0サポートでノーコードでの利用も可能

- fal.ai API経由でローカルGPUなしでも試せる

一方で、VRAM 32GB以上という高い要件はハードルになります。まずはfal.aiのクラウドAPIで動作を確認し、ユースケースに合わせてセルフホスト環境を整えるアプローチが現実的です。

オープンソース動画生成の選択肢として、商用APIの制約を避けたい開発者にとって有力な候補になるモデルです。