はじめに

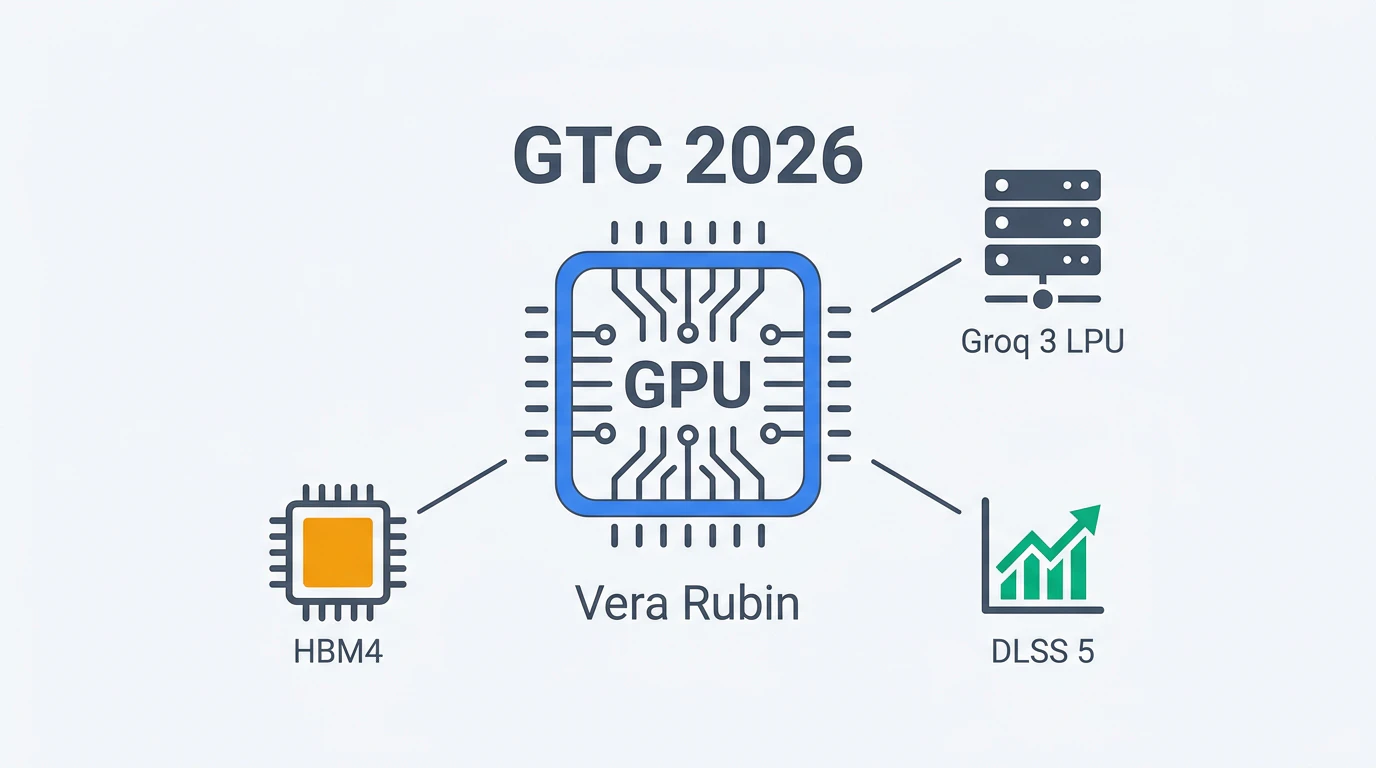

2026年3月16日、NVIDIAはサンノゼで開催中のGTC 2026カンファレンスで、Jensen Huang CEOによる2時間のキーノートを実施した。次世代AIチップ「Vera Rubin」アーキテクチャの正式発表、$20B(約3兆円)で買収したGroqの推論チップ統合、そしてグラフィックス技術 DLSS 5 など、AI基盤インフラの大型発表が相次いだ。

この記事では、GTC 2026キーノートの主要発表をエンジニア視点で整理し、AI推論コストやクラウド提供時期など、開発者が押さえるべきポイントを解説する。

この記事で学べること

- Vera Rubin GPUアーキテクチャのスペックとBlackwellからの進化点

- Groq 3 LPU統合がAI推論にもたらすインパクト

- NVL72ラックシステムの構成と性能数値

- クラウド提供スケジュールと推論コスト見通し

- DLSS 5・NemoClaw・Dynamoなど周辺発表の要点

対象読者

- AI/MLモデルの推論基盤を設計・運用するエンジニア

- クラウドGPUインスタンスのコスト最適化に関心がある方

- NVIDIA GPUロードマップを追っている方

TL;DR

- Vera Rubin GPU: 336Bトランジスタ、TSMC 3nm、HBM4 288GB/GPU。Blackwell比で推論5x高速・トークンコスト最大10x削減

- Groq 3 LPU: SRAM 500MB/チップ、150TB/sの内部帯域幅。256基搭載のLPXラックで超低レイテンシ推論を実現

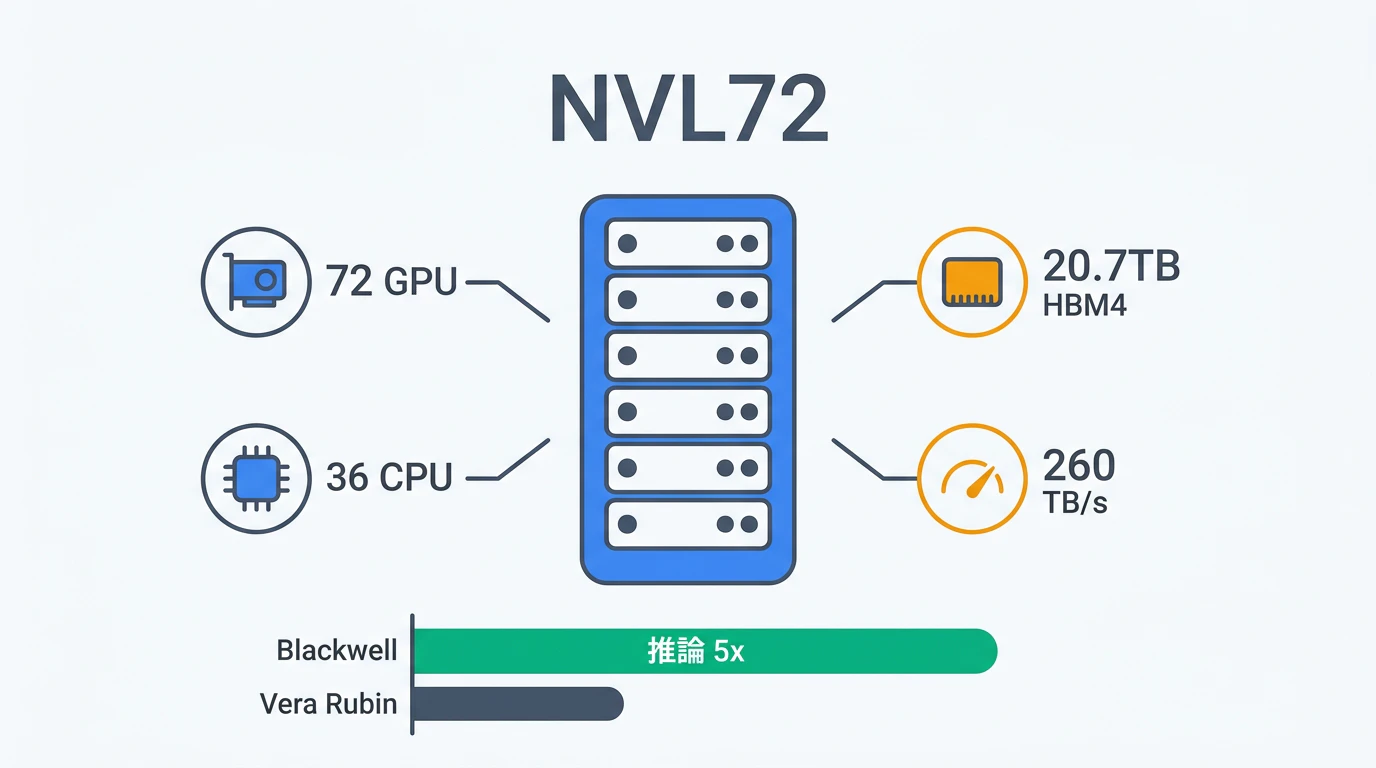

- NVL72: 72 Rubin GPU + 36 Vera CPU、3.6 EFLOPS FP4推論、260 TB/s NVLink 6

- クラウド提供: AWS・Google Cloud・Microsoft Azure・OCIで2026年後半に提供開始

- DLSS 5: 3D-guided Neural Renderingによる生成AIベースのグラフィックス革新、2026年秋リリース

Vera Rubin GPUアーキテクチャ

チップスペック

GTC 2026の中心は、Blackwell世代の後継となるRubinアーキテクチャだ。NVIDIAの公式発表に基づく主要スペックを以下に示す。

| 項目 | Rubin GPU | Blackwell GPU(参考) |

|---|---|---|

| トランジスタ数 | 336B(2ダイ構成) | 208B |

| プロセス | TSMC 3nm | TSMC 4nm |

| メモリ | HBM4 288GB | HBM3e 192GB |

| メモリ帯域幅 | 約22 TB/s | 約8 TB/s |

| NVFP4推論性能 | 50 PFLOPS | 10 PFLOPS |

| NVFP4訓練性能 | 35 PFLOPS | 10 PFLOPS |

NVIDIAの公式スライドでは、Blackwell比で推論5x・訓練3.5xの性能向上と位置付けられている。メモリ帯域幅は約3倍に拡大しており、大規模言語モデル(LLM)のKVキャッシュ処理やMixture-of-Experts(MoE)モデルの推論で特に効果が大きい。

HBM4メモリの進化

Rubinが採用するHBM4は、HBM3e比でインターフェース幅が2倍になった。GPU1基あたり288GBのメモリ容量は、1Tパラメータ級のMoEモデルをより少ないGPU数で推論できることを意味する。NVIDIAの発表によれば、同等のMoEモデル訓練に必要なGPU数がBlackwell比で4分の1に削減される。

Vera CPU

Vera Rubinプラットフォームにはカスタム設計のArm CPUも含まれる。

| 項目 | Vera CPU |

|---|---|

| トランジスタ数 | 227B |

| コア構成 | 88コア / 176スレッド(Spatial Multi-Threading) |

| メモリ | 最大1.5TB LPDDR5x(SOCAMM) |

| メモリ帯域幅 | 最大1.2 TB/s |

GPU前段のデータ前処理やオーケストレーション処理をCPU側でオフロードし、GPU稼働率を最大化する設計だ。

NVL72ラックシステム

ラック全体スペック

Vera Rubinの導入単位となるNVL72は、72基のRubin GPUと36基のVera CPUを液冷ラック1台に収めた構成だ。

| 項目 | NVL72 |

|---|---|

| GPU数 | 72基(Rubin GPU) |

| CPU数 | 36基(Vera CPU) |

| FP4推論性能 | 3.6 EFLOPS |

| FP4訓練性能 | 2.5 EFLOPS |

| HBM4容量 | 20.7 TB |

| LPDDR5x容量 | 54 TB |

| HBM帯域幅 | 1.6 PB/s |

| NVLink 6帯域幅 | 260 TB/s(スケールアップ) |

NVLink 6はGPU間で双方向3.6 TB/sの帯域を提供する。ラック全体のスケールアップ帯域260 TB/sは、NVIDIAの発表によると「グローバルインターネットの総帯域の2倍以上」に相当する。

推論コスト削減の根拠

NVIDIAが公式に掲げる「トークンコスト10x削減」は、Kimi-K2-Thinkingモデルの特定シーケンス長における測定値に基づく。すべてのワークロードで一律10xの削減が実現するわけではない点に留意が必要だ。ただし、MoEモデルの推論において、HBM4の広帯域とNVLink 6のスケールアップ性能が組み合わさることで、大幅なコスト改善が見込まれる。

Groq 3 LPU — SRAM推論チップの統合

買収の経緯

NVIDIAは2025年12月に約$20B(約3兆円)でGroqの技術資産を取得した。Google TPUの設計者であるJonathan Ross氏(Groq創業者)やSunny Madra氏(社長)を含む主要人材も移籍している。

LPUアーキテクチャの特徴

Groq 3 LPUはGPUとは根本的に異なるアプローチで推論を高速化する。

| 項目 | Groq 3 LPU | GPU(参考) |

|---|---|---|

| 主記憶 | SRAM 500MB(オンチップ) | HBM(オフチップ) |

| 内部帯域幅 | 約150 TB/s | 約22 TB/s(Rubin HBM4) |

| レイテンシ特性 | 確定的(deterministic) | 変動あり |

| 最適ワークロード | 推論(特にリアルタイム) | 訓練 + 推論 |

LPUの核心は「オンチップSRAMによる超高帯域・低レイテンシ」だ。HBMを使わずSRAMだけでモデルの重みを保持するため、メモリアクセスの遅延が極めて小さい。NVIDIAの発表によると、Llama 2 70Bモデルで241〜750トークン/秒の推論速度を実現する。

LPXラック構成

GTC 2026では、Groq 3 LPUを256基搭載するLPXラックも発表された。LPXラック全体で128GBのオンチップSRAMと640 TB/sのスケールアップ帯域を持ち、Vera Rubinプラットフォームと組み合わせることで「訓練はGPU、推論はLPU」という明確な役割分担が可能になる。Q3 2026の出荷が予定されている。

クラウド提供スケジュールと開発者への影響

提供タイムライン

NVIDIAの公式発表に基づく提供スケジュールは以下のとおりだ。

| 時期 | マイルストーン |

|---|---|

| 2026年 Q1 | Vera Rubin量産開始(NVIDIAの発表による) |

| 2026年 H2 | AWS・Google Cloud・Microsoft Azure・OCIでの初期展開 |

| 2026年 Q4〜2027年 Q1 | クラウドでの一般提供(GA) |

| 2027年 | Vera Rubin Ultra(次世代ラック)出荷 |

クラウドパートナー

NVIDIAが発表した初期展開パートナーは以下のとおりだ。

ハイパースケーラー: AWS、Google Cloud、Microsoft Azure、Oracle Cloud Infrastructure

NVIDIAクラウドパートナー: CoreWeave、Lambda、Nebius、Nscale

AWSとの提携では、LPUを含む100万基以上のNVIDIA GPUがAWSのグローバルリージョンに展開される計画が発表された。Microsoftは、Azureが最初にVera Rubin NVL72を稼働させたハイパースケールクラウドであると発表している。

推論コスト見通し

NVL72ラックの推定コストは$350万〜$400万とされている。GPU時間あたりのオンデマンド価格は公式未発表だが、過去の価格推移から$6〜$10+/GPU時間と予測されている。ただし、開発者にとって重要な指標は「トークンあたりのコスト」であり、NVIDIAはMoEワークロードでBlackwell比最大10x削減を主張している。

これが実現すれば、現在Blackwellベースのクラウドインスタンスで$0.01/1Kトークン程度のLLM推論コストが、$0.001/1Kトークン水準まで下がる可能性がある。エージェント型AIの長時間マルチターン会話や、大量のバッチ推論タスクを抱える開発者にとって、インフラ選定の判断基準が大きく変わる。

その他の主要発表

DLSS 5

NVIDIAはDLSS 5を「レイトレーシング以来最大のグラフィックス技術革新」と位置付けた。従来のアップスケーリングに加え、「3D-guided Neural Rendering」と呼ばれる生成AIベースのレンダリング技術を統合する。手作りの3Dレンダリングと生成AIを融合し、フォトリアリズムの大幅な向上を実現するとしている。Bethesda、Capcom、Tencent、Ubisoftが対応を表明しており、2026年秋のリリースが予定されている。

NVIDIA Dynamo(推論ソフトウェア)

Triton Inference Serverの後継となるオープンソース推論ソフトウェア「NVIDIA Dynamo」も発表された。disaggregated servingにより、LLMのプリフィル(処理)フェーズと生成フェーズを異なるGPUに分離し、各フェーズを独立に最適化できる。NVIDIAの発表によれば、同じGPU数でLlamaモデルの推論性能とトークン収益を2倍にし、DeepSeek-R1モデルではGPUあたりのトークン生成を30x以上向上させる。PyTorch、SGLang、TensorRT-LLM、vLLMに対応し、完全オープンソースで公開されている。

NVIDIA Dynamoについては、記事078「NVIDIA Dynamo入門」で詳しく解説している。

NemoClaw(エージェントプラットフォーム)

NemoClaw は、企業向けAIエージェントの構築・デプロイ・管理を行うオープンソースプラットフォームだ。ポリシー適用、ネットワークガードレール、プライバシールーティングを統合したOpenShellランタイムを含み、DGX SparkやDGX Stationと組み合わせてローカル環境でのエージェント開発が可能になる。

NemoClawについては、記事075「NVIDIA NemoClaw入門」で詳しく解説している。

$1T購買発注見通し

Jensen Huang CEOは、BlackwellとVera Rubinの合計購買発注が2027年までに$1T(約150兆円)に達する見通しを示した。2025年のGTCで示した$500Bの収益機会予測から2倍に引き上げた形だ。

Blackwellからの移行判断

移行を検討すべきケース

- 大規模MoEモデルの推論: HBM4の3倍の帯域幅とNVLink 6により、MoEのエキスパート切り替えが高速化

- リアルタイム推論が必要なサービス: Groq 3 LPU(LPXラック)による確定的低レイテンシ

- 推論コストがボトルネック: トークンあたりコスト10x削減(MoEワークロード)

現行Blackwellで継続すべきケース

- 2026年後半までに本番投入が必要: Vera Rubinのクラウド一般提供は2026年Q4以降

- 訓練ワークロードが中心: 訓練性能の向上幅は3.5x。推論ほどの劇的改善ではない

- 既存のBlackwellインスタンス契約がある: リザーブドインスタンスの契約期間を考慮

まとめ

GTC 2026の発表は、NVIDIAが「推論の時代」に本格シフトしたことを示している。Vera Rubin GPUによるハードウェア性能の飛躍、Groq 3 LPUによるSRAMベース推論の統合、そしてDynamoによるソフトウェア最適化が三位一体で推論コスト削減を推進する構図だ。

開発者が今取るべきアクションは以下のとおりだ。

- 2026年後半のクラウド提供開始に向けて、自社の推論ワークロード(モデルサイズ、トークン量、レイテンシ要件)を棚卸しする

- MoEモデルを使用している場合、Vera Rubinのコスト削減効果を見積もる

- リアルタイム推論が要件にある場合、Groq 3 LPU(LPXラック)の適用可能性を評価する

- NVIDIA Dynamoへの移行を検討し、disaggregated servingによる既存GPU活用も視野に入れる