はじめに

こんにちは、mori (@morimori) です。Qiitaでは初めてのブログ投稿となります。よろしくお願いします。

さて、早速ですが、最近「キーボードを打たずに仕事ができないか」に挑戦しています。AIを使って音声入力をしながら、AIと対話しながら仕事をこなせるようになりたい——そんな思いで試行錯誤しています。

きっかけは、勉強会でみのるんさんがClaude Codeに対して音声で指示を出しているのを見たことでした。

お!キーボードを使わず、自分の声でAIに指示を出してコードを書かせている。その光景を見た瞬間、「これ、アイアンマンじゃん」と思いました。

もともとアイアンマンのJARVISのような、声やホログラムで仕事をこなすスタイルに憧れていました。男の人なら誰でも一度は「こんなふうに働いてみたい」と思ったことがあるんじゃないでしょうか。子どもと一緒に映画を観ながら「こんなふうに仕事してみたいな」なんて話をしていたくらいです。映画の中の話だと思っていたそれが、目の前で実現されていた。

「自分もこれを体験してみたい」——そんな思いで、まず一歩踏み出してみました。

SuperWhisperとは

実ははじめに試したのはAqua Voiceでした。評判も良く利用されている方が多いようでしたので音声入力ツールで気になっていたのですが、Windowsではうまく動かず断念。いろいろ試行錯誤した末にたどり着いたのがSuperWhisperです。

SuperWhisperは音声入力ツールです。マイクに向かって話すと高精度でテキストに変換してくれます。さらに生成AI(LLM)を活用して文章を補完してくれる機能も備えており、話した内容をそのまま出力するだけでなく、自然な文章に整えてくれます。任意のアプリやテキストフィールドに対して使えるのが特徴で、Claude Codeのような開発ツールとも相性が良いです。

カスタムモードで使い方を最適化する

SuperWhisperにはカスタムモードがあり、LLMへの指示(プロンプト)を自分でカスタマイズできます。私は以下のようなスクリプトを設定して使っています。

内容は要約せず、話した言葉のニュアンスを最大限に維持したまま、誤字脱字と専門用語の修正だけを行ってください。

私はITエンジニアです。用語はITに関する変換を優先してください。

不要な言葉の除去: 「えー」「あのー」などのフィラーや言い間違いは、文脈を損なわない範囲で完全に削除してください。

このプロンプトのポイントは「要約しない」という指示です。LLMに任せると内容を勝手にまとめてしまうことがありますが、Claude Codeへの指示は意図をそのまま伝えたいので、ニュアンスを維持しつつ余計なフィラーだけ除去してもらうようにしています。

滑舌に自信がない私にとって、このやり方が今のところ一番しっくりきています。

実際の使い方 — Claude Codeとの組み合わせ

音声でClaude Codeに指示を出す

SuperWhisperの「Push to Talk」モードを使っています。左Altキーを押している間だけマイクが有効になり、離すと音声認識が走って、選択中のテキストフィールドに入力される仕組みです。

この操作感がとても気に入っています。キーを押す→話す→離すという動作が直感的で、意図せず音声が入力されてしまう心配もありません。

あとは音声入力された内容を確認して、Enterを押すだけです。

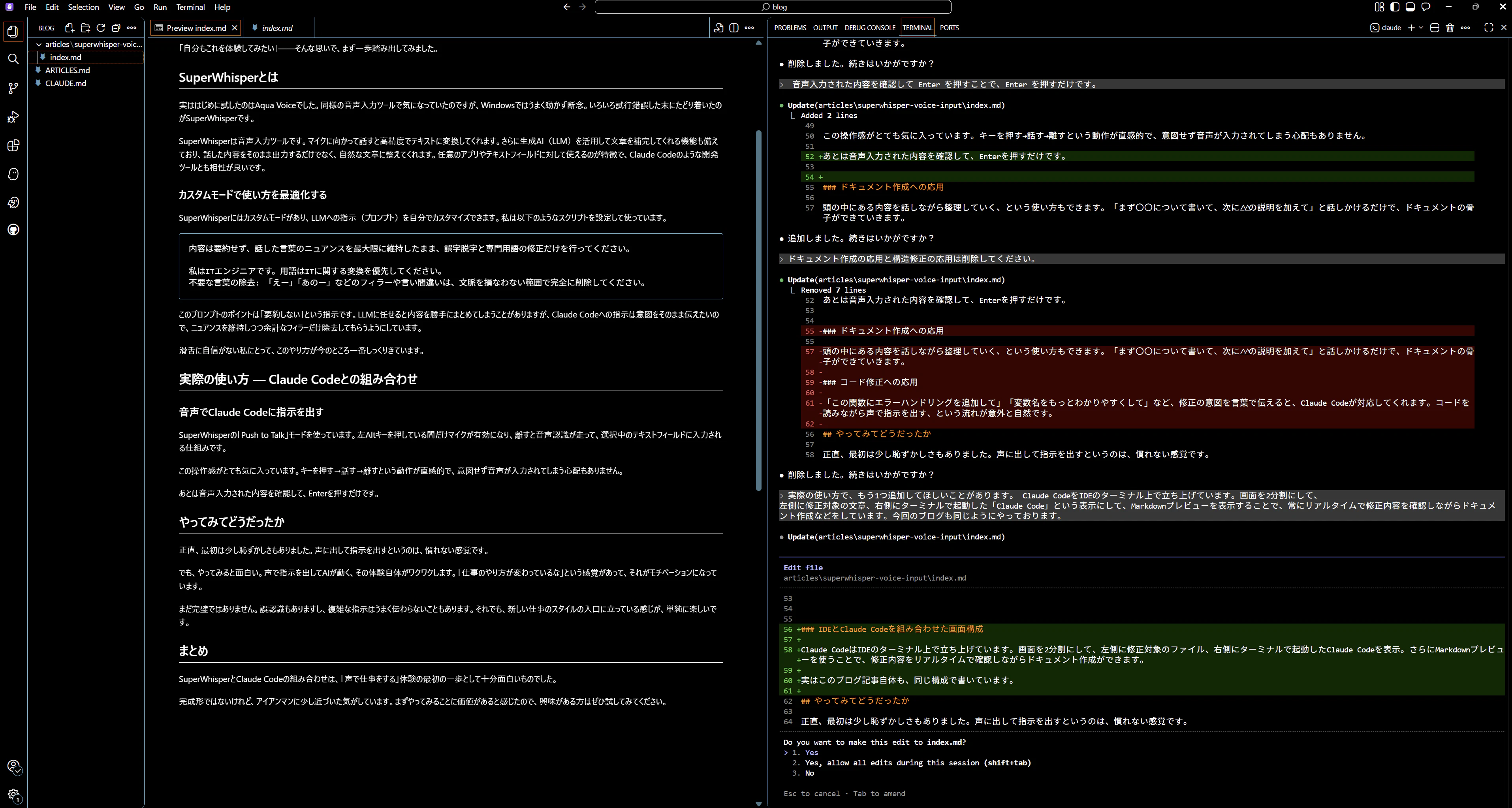

IDEとClaude Codeを組み合わせた画面構成

Claude CodeはIDEのターミナル上で立ち上げています。画面を2分割にして、左側に修正対象のファイル、右側にターミナルで起動したClaude Codeを表示。さらにMarkdownプレビューを使うことで、修正内容をリアルタイムで確認しながらドキュメント作成ができます。

実はこのブログ記事自体も、同じ構成で書いています。

やってみてどうだったか

まず感じたのは、人と話すときとは感覚がかなり違うということです。会話では自然に言葉が出てくるのですが、AIへの指示となると要件を整理しながら話す必要があり、途中でつまずいて言い直すことが何度もありました。「話す」というより「考えながら話す」という感じで、これが思いのほか難しかったです。

また、生成AIが文章を補完してくれるのは便利な反面、良い方向にも悪い方向にも働くので、意図通りに伝わらないことも少なくありませんでした。自分の言いたいことが違うニュアンスで出力されてしまうと、確認と修正の手間が増えてしまいます。このコントロールはまだまだ課題です。

IT用語などはなかなかうまく変換されないこともありましたが、SuperWhisperのボキャブラリー機能に単語を登録していくことで、よく使う言葉については精度が上がってきました。使い続けることでSuperWhisper自体がどんどん自分用にカスタマイズされていくのは、地味ながらうれしいポイントです。

慣れの問題もあるとは思いますが、正直まだ手でタイピングするほうが早いと感じています。また、通常の音声入力と違いLLMを挟む分、入力までに少しタイムラグがあるのも気になります。Windowsではうまく動かなかったので試せていませんが、Aqua Voiceなどはレイテンシーが少ないと聞いているので、機会があれば比較してみたいと思っています。

まとめ

やってみて気づいたのは、自分のボキャブラリーの少なさです。声に出して指示を出していると、言葉が出てこなかったり、うまく表現できなかったりする場面が多くありました。ただ、AIが相手とはいえ、こうして声で話し続けることで、いろんな場面でうまく喋れる人になれるのかな、と前向きに捉えています。

ちなみに、今回のこのブログ自体もほとんど音声入力のみで作成しています。多少の誤記の修正や画像作成などは手作業でやっていますが、それ以外はすべて声で書き上げました。実際にやってみることで、課題も面白さも両方リアルに感じられました。

トニー・スタークのようにAIと会話をキャッチボールしながら、とまではいきませんでしたが、声だけで仕事ができる感覚はとても面白いものでした。完全な「アイアンマン体験」には、AIエージェントを組み合わせるなど、まだまだ先がありそうです。それでも、アイアンマンの映画の世界に一歩近づいた気がしています。興味がある方はぜひ試してみてください。