この記事では、Raspberry PiとMIDIインターフェースを組み合わせて一つの独立したデバイスを作ります。

Raspberry Piによる各センサーやインターフェース(ボタン・スイッチ・Webなど)のコントロールについては、多くの情報が比較的簡単に入手できますが、

それらを一つの製品としてくみ上げる過程を重点的に記載したいと思います。

コードの解説については比較的少なめになりますが、ご容赦ください。

シリーズ目次

- Raspberry PiとMIDIインターフェースでデバイス開発をする]

- RtMidiライブラリを使って、MIDIインターフェースを作成する

- SMF (Standard Midi Format)を解析し、MIDIインターフェースに流し込む(プロトタイプ編)

- SMF (Standard Midi Format)を解析し、MIDIインターフェースに流し込む(クラス編)

やりたいこと

- Raspberry PiにMIDIオーディオを演奏させる

- MIDIキーボードを接続し、1のオーディオを伴奏として演奏する

- 演奏しながら音色や伴奏の種類を変更できる

簡単なシーケンサだと思ってもらえればいいです。

必要な機能を列挙する

- MIDIファイルの解析

- オーディオ出力

- MIDIインターフェースのコントロール

- スイッチのコントロール

実現する方法を考える

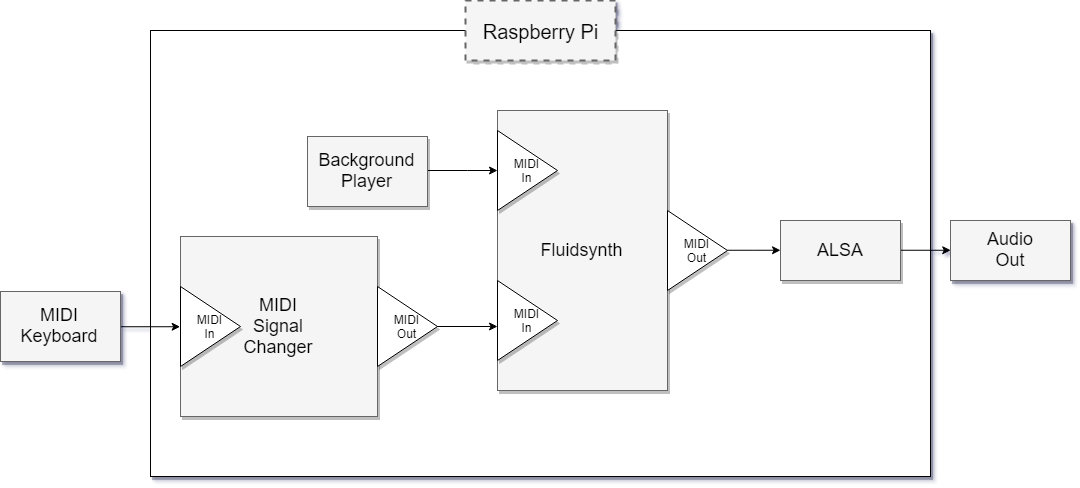

今回の開発デバイスの中核として FluidSynth を選びました。

FluidSynthはオープンソースのソフトウェアシンセイザーで、これを選択した理由は次の通りです。

- コンソールベースで動作する

- 動作が軽い

- 起動後にコンソールでインタラクティブに、音量・音色の変更などの操作ができる

FluidSynthを核として、不足した機能を実現する方法を考えます。

- 接続するMIDIインターフェースとFluidSynthを中継するMIDIインターフェースエミュレータを実装する

- MIDIファイルを読み取り、エミュレータからMIDI信号をFluidSynthに流す

- MIDIインターフェースから信号を読み取り、FluidSynthに流す

※MIDIインターフェースエミュレータはMIDIインプット、MIDIアウトプットの両方を実装します。

この時点の(想定)システム図

実装する

MIDIインターフェースエミュレータを作成するためにRtMidiというライブラリを使います。

このライブラリを使いたいため、言語はC++を使うことにしました。

実際のコードは第2回に続きます。

ここまでの振り返り

ここまでの流れはRFLPという開発の流れに沿っています。

R: Requirement

F: Function

L: Logic

P: Physical(, Program, Product, ...)

開発の経験が多い人ほど、この流れが早く頭のリソースを使わずにこなせます。

特に今回は、MIDIへの理解が浅く、FluidSynthを核にするという方法に確定するまでにたくさんの試行錯誤を繰り返しました。

ナビ

| 前 | 次 |

|---|---|

| なし | RtMidiライブラリを使って、MIDIインターフェースを作成する |