Neural Network Consoleとは

SONYが開発したディープラーニングツールで、初心者でも簡単に実装などができるとのことなのでやってみました。

環境はWindows10の64bitで、私の格安ラップトップにはGPUがないのでCPUで動かしてみます。さて、持ち堪えてくれるのか。。。

Windowsアプリ版をダウンロード

クラウド版もあるようですが、軽く調べたところみんなWindows版でやっていた上に、クラウド版でも結局CPUで動かすことになるみたいなので、今回はWindowsアプリをダウンロードします。メールアドレスの登録のみでOKです。

メールで送られてきたzipファイルをダウンロードし、解凍します。その後、neural_network_console.exeを実行します。

サンプルプロジェクトを実行してみる

とりあえずホーム画面の一番上にある「01_logistic_regression.sdcproj」をダブルクリックして実行してみます。

ダウンロードが終わったら、F5ボタンで学習を開始します。

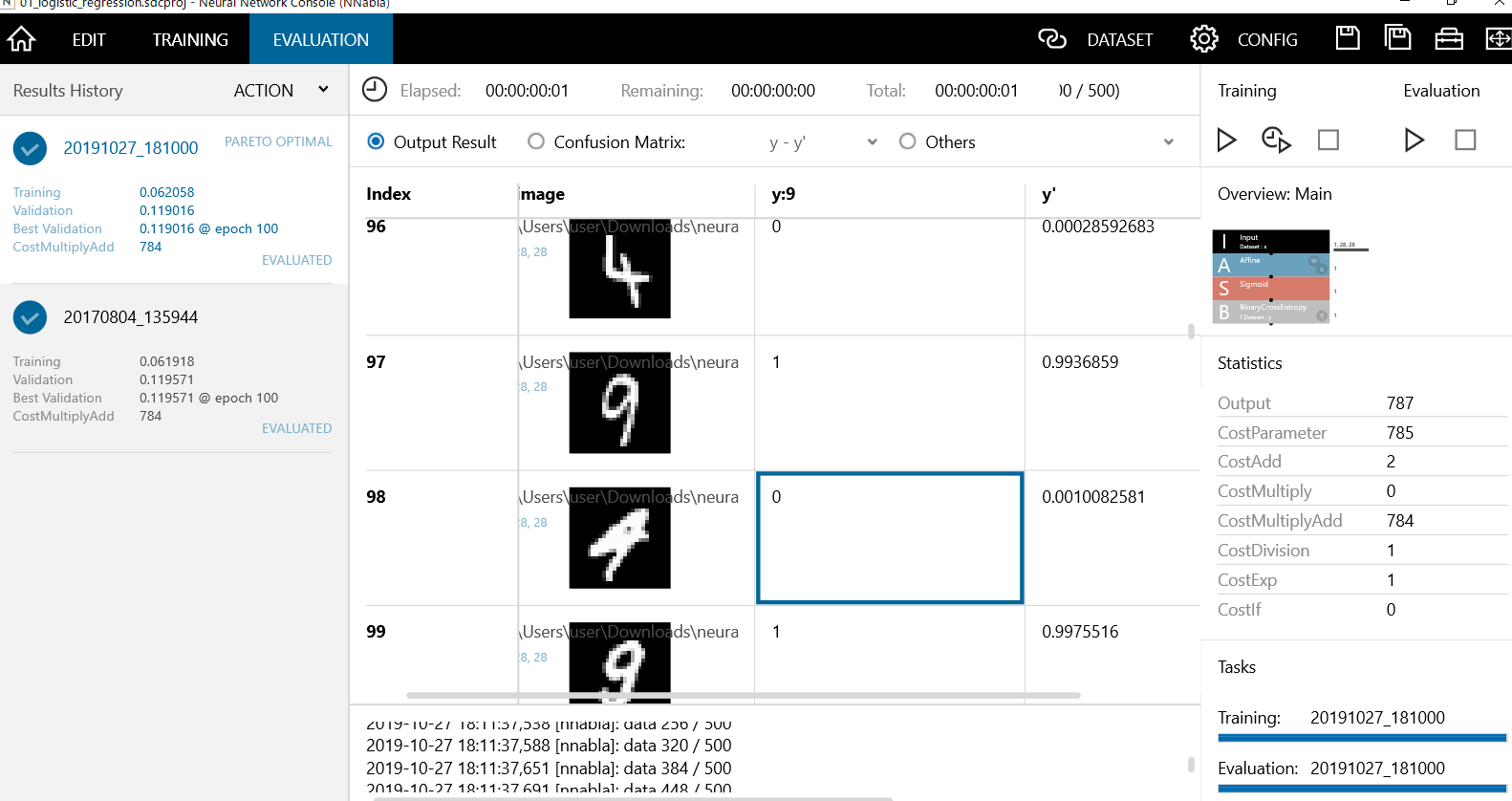

サンプルプロジェクトに関しては、CPUを使った計算でも割とすぐに終わります。その後、実際に評価してみると「4」か「9」か手書きの文字を判断した結果が出力されます。

「y:9」の列が1だったら「画像の文字が9である」ことを、0だったら「画像の文字が9ではない」ことを表していて、右端のy'がその確率を表しています。ちなみに精度は95.2%でした。

というわけで、あっさりとディープラーニングを試すことができてしまいました!楽!

雑多な感想

ちなみにこの学習は「Input」→「Affine」→「Sigmoid」→「BinaryCrossEntropy」という始めから構築されていた1層のネットワークを使用しています。もっと複雑な画像を判別するとなったら、ここら辺を編集できる知識が必要になりそうです。

今回使われている画像データたちは、解凍したフォルダ下の「samples/sample_dataset」で用意されています。

ちなみにYOLOのNCCを使って軽くディープラーニングを試したこともありますが、普通にUbuntu環境に慣れていれば、YOLOとかのPythonスクリプトを使う方が画像認識する分には楽かもしれないなぁとも思いつつ。。。

これを使いこなすには、新しくデータセットを作るとかデータセットを探してくるとかしないといけなくて、ちょっと時間がかかりそうなので、とりあえず今日はここまでで。