— 人間が指示する時代は、もう終わるのかもしれない

ここ数年、AIコーディングは急速に「当たり前のもの」になった。

かつては実験的だったツールも、いまや多くの開発者が日常的に使っている。

- Cursor

- GitHub Copilot

- Claude Code

気がつけば、AIを横に置いてコードを書くことが普通になった。

最近SNSを見ていると、話題はほぼ一色だ。

「Claude Codeがすごい」

確かに、それは事実だと思う。

実際かなり優秀だ。

だが、複数のAIツールを並行して使いながら開発していると、

もう少し違う景色が見えてくる。

今日はその話をしたい。

結論から言うと、

次のAI開発環境は「AIが指揮する開発」になる可能性が高い。

AIがPRを投げてくる時代

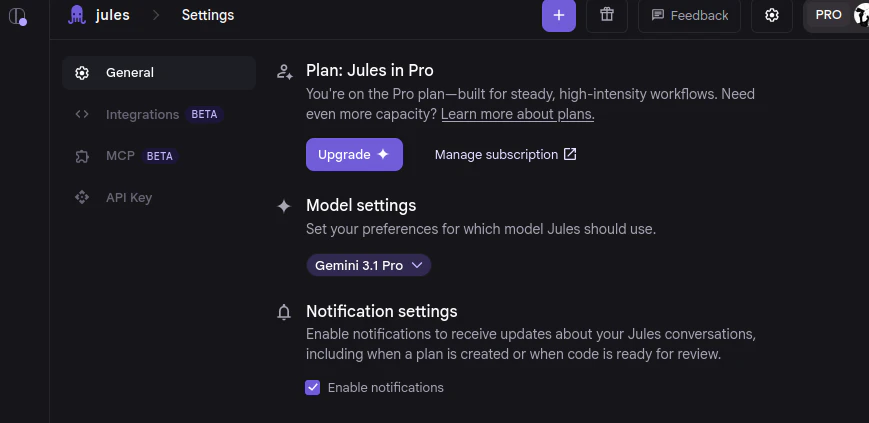

現在、自分は主に次の環境で開発している。

- Antigravity

- Codex

- Google Jules

開発の中心はGitHubだ。

その中でも最近よく使っているのが

Google Julesのサジェスト機能である。

これがかなり面白い。

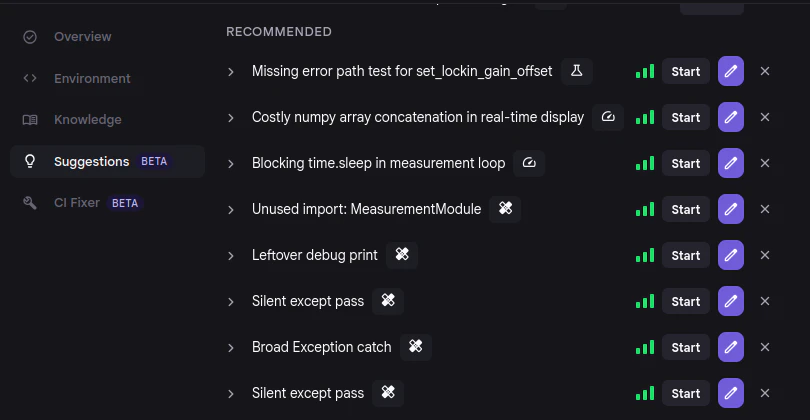

Google Julesのサジェスト機能

AIがプロジェクトを解析し、修正すべき点を見つけてPRを作る機能だ。

AIが勝手に考え出した変更(AIサジェスト機能)で修正を行っている。

ただし大胆な変更ではなく、軽微なリファクタリングが中心。

最近では、Google AI Proプランに加入していると

Gemini 3.1 Pro などのモデルも有効になったようだ。

この機能は何をするのか。

AIがプロジェクトを解析し、修正すべき点を見つけてPRを作る。

つまりこうなる。

AI → コードを読む

AI → 改善案を作る

AI → PRを作る

人間 → レビューする

開発者(というよりクレーマー役)としては

かなり便利だ。

……ただし。

ときどきヤバいPRが飛んでくる。

レビューするとAIはこう言う。

問題ありません。

だが実際に動かすと

「いやこれ普通に壊れてるだろ」

ということがある。

ここが、今のAI開発の難しいところだ。

AIレビューはまだ信用できない

この問題を解決しようとして

自分はMCPを導入し、AIレビューワーを追加してみた。

結果はどうだったか。

ほぼ毎回こう言われる。

問題ありません。

……いや、ある。

実際には危険な変更もある。

つまり現状では

AIが書いたコードをAIがレビューしても、まだ精度が足りない。

ここで必要なのは何か。

自分は以前の記事でこう書いた。

AIコーダーではなく

AIクレーマーが必要だ

つまり

- 粗探しをするAI

- 破壊テストをするAI

- 意地悪なレビューをするAI

こういう存在だ。

これは冗談ではなく、本当に重要だと思っている。

セキュリティの世界を見ればわかる。

そこでは常に

クラッカー vs セキュリティ

という構図がある。

つまり

クレーマーが進化させる。

AI開発でも同じことが起きるはずだ。

実際、今の自分の役割はほぼこれだ。

AIが書いたコードに文句を言う係。

開発者というより

クレーマーである。

AIクレーマーとの仁義なき戦い

もしこの流れがさらに進むと、

開発環境はちょっと面白いことになるかもしれない。

例えばこんな構図だ。

超ポジティブな実装AI

「完璧なリファクタリングです!PRを作りました!」

すると1秒後。

超絶悲観的レビューAI(クレーマー)

「このコードは2026年問題を考慮していません。」

「変数名の美しさが足りません。」

「このロジックには魂がない。」

そしてレビューコメントが

100件くらい並ぶ。

実装AIはそれに対して必死に反論する。

「いや、それは仕様です。」

「それは最適化です。」

「それは美学の問題です。」

ログは延々と伸び続ける。

その様子を人間はどうするのか。

ただ眺める。

コーヒーを飲みながら。

「まあ……どっちもどっちだな。」

気がつくと人間の役割は

開発者ではなく

AIチームの中間管理職

になっている。

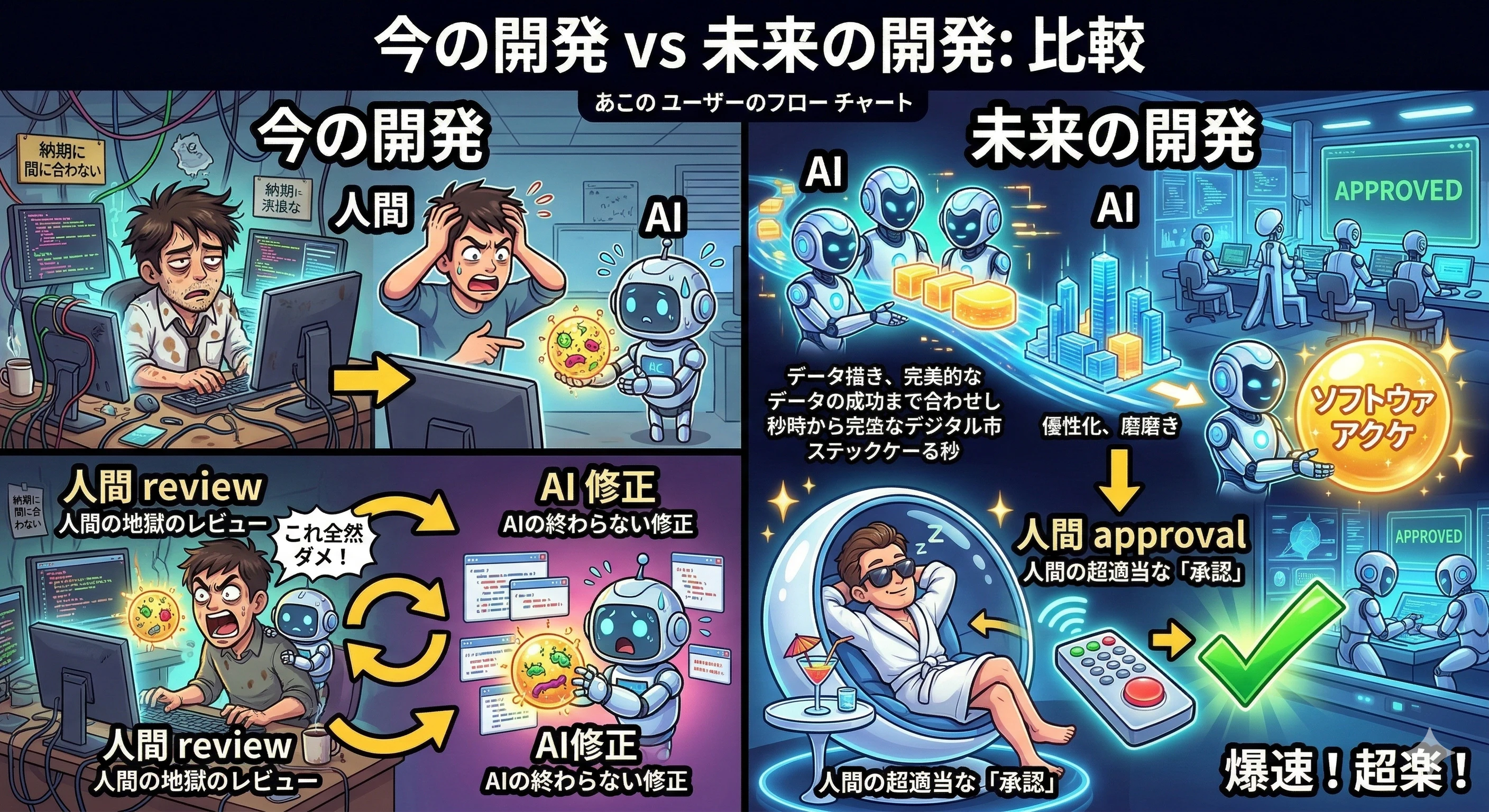

次のAI開発環境は「完全自律」

さて、ここからが本題だ。

最近いろいろなAIツールを触っていて

はっきり見えてきたことがある。

それは

AI開発の次の段階は「完全自律開発」になる

ということだ。

いまの開発はこうなっている。

人間 → 指示

AI → コードを書く

人間 → 確認

人間 → 修正指示

AI → 再修正

つまり

人間がヘッドになっている。

しかしこの構造には

大きな問題がある。

遅い。

AIは並列でコードを書ける。

だが

- コードを読む

- テストする

- 実行する

この部分はほとんど人間がやっている。

ここがボトルネックになる。

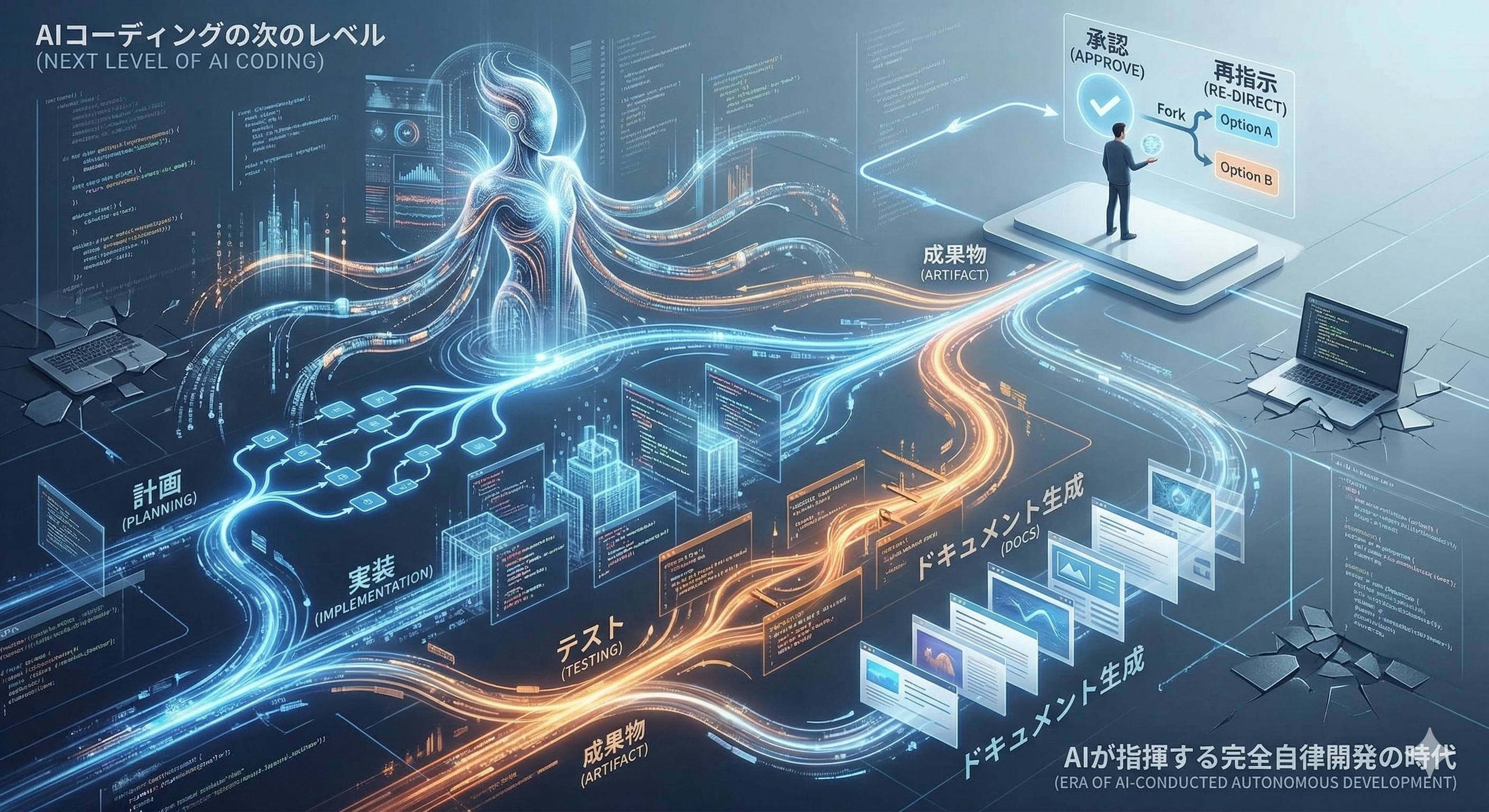

未来の開発ループ

では未来はどうなるのか。

おそらくこうなる。

AI → 計画

AI → 実装

AI → テスト

AI → 修正

AI → ドキュメント生成

人間 → 承認

つまり

AIが開発の指揮を取る。

人間は何をするのか。

意思決定だけする。

AIはこう聞いてくるだろう。

Aの方向とBの方向があります。

どちらの方針にしますか?

これは

「どちらが正しいか」

ではない。

どちらが好みか

である。

AIは

- 特徴

- メリット

- デメリット

- パフォーマンス

を資料付きで説明してくる。

人間は

Aで

と答えるだけ。

その間もAIは開発を進め続ける。

Nano Banana2で作った画像です。手がパソコンから生えてたり、なんか文字変ですけど、イメージだけ受け取って下さい。OTL

人間は「開発ループの外」に出る

ここが重要なポイントだ。

未来の開発では

人間は開発ループの外側にいる。

AIは24時間動き続ける。

- コードを書く

- テストする

- 修正する

- PRを作る

そしてある程度まとまったところでだけ

人間に聞く。

この方向でいいですか?

つまり人間は

ぼんやり方向を決める存在

になる。

細かい作業には関与しない。

これは圧倒的に速い。

IDEも変わる

このレベルになると

IDEの形も変わるはずだ。

いまの開発環境は

- CLI

- エディタ

- ターミナル

が中心だ。

しかしこれからはもっと違うだろう。

例えば

- AIが画面をキャプチャして説明

- テストURLを自動生成

- UIを画像付きで提案

- 実行環境をクラウドで構築

インターフェースは

シンプルなチャット

または

極端に洗練されたIDE

になるはずだ。

個人的には

CLI中心の開発環境は、いずれ過去のものになる

と思っている。

次の勝者は誰か

もしこの予測が正しいなら

次の勝者はおそらくこういう会社だ。

「完全自律開発環境」を作った会社。

つまりAIが

- 計画する

- 実装する

- テストする

- 修正する

このすべてを回す環境だ。

重要なのは

モデル性能だけではない。

むしろ

AIチームの設計

だと思う。

- メモリが優秀なチーム

- 調査能力が高いチーム

- テスト能力が高いチーム

それらが

チームとして協調するシステム

それが次世代の開発環境になる。

今はまだ断片的だが

- Claude Code

- Antigravity

- Jules

- Codex

それぞれが、その方向へ進み始めている。

モデル性能はもう横並び

最近のモデル

- Claude Opus 4.6

- GPT-5.4

- Gemini 3.1 Pro

正直なところ

ほぼ同レベル

に感じる。

むしろ問題は

人間側の評価能力

だ。

AIが提案してきたコードを

これは正しいのか?

と判断する能力が

人間に求められている。

しかし将来、

数十万行のプロジェクトが

AIエージェントのチームによって管理されるようになれば

人間は

変更内容の要約だけを読む存在

になるかもしれない。

そして未来

これからの開発は

もっと曖昧になるかもしれない。

「仕様を書く」

というより

好みを伝える。

するとAIは

- 複数のブランチを作り

- 複数の実装を試し

- 最適な方向を提案する

ソフトウェアは

意思の分岐から生まれる

ようになる。

2026年の初春。

まだ少し宙に浮いた話に聞こえるかもしれない。

だが、今のAIの進化速度を見ると

今年の夏頃にはこの景色が見え始めても不思議ではない。

もしかすると数年後、

「昔は人間がコードを書いていた」

そんな時代があったこと自体が

ちょっとした昔話になっているのかもしれない。

そしてそのとき、開発者の仕事はきっとこう呼ばれる。

プログラミングではなく、

“意思決定” と。

未来の開発者はコードを書かない。

方向を決めるだけだ。

そしてAIが、その世界を実装する。

上の記事ももちろん草稿を渡して、AIに書いてもらっています。

今はまだAIペアプログラミングとAIエージェントの間くらいですが

これからどうなるでしょうね。 デジタル貧乏人より