最近、AIエージェントに関する話題を見ていて、ふと思ったことがあります。

それは、

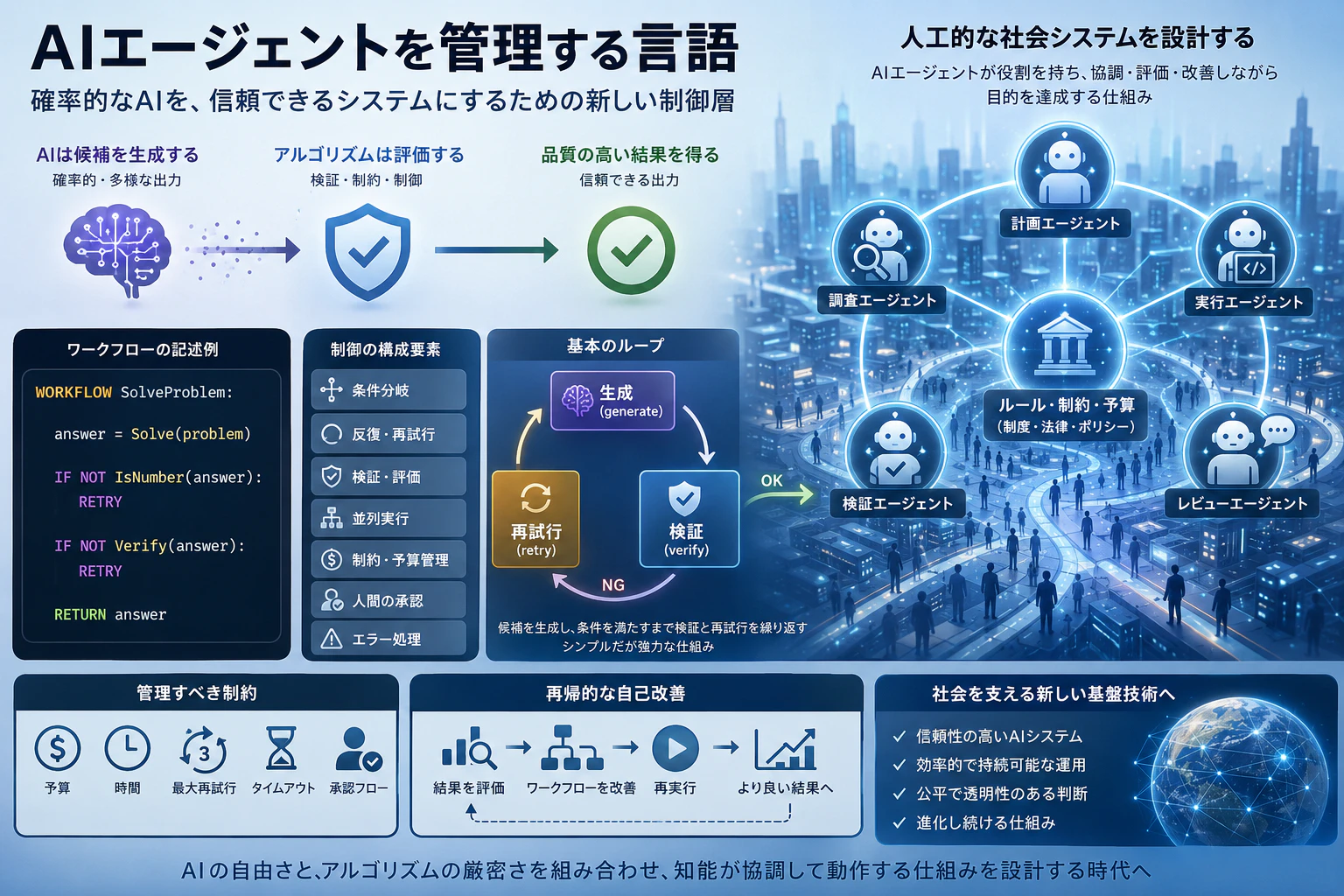

AIエージェントを管理するための専用言語が必要になるのではないか?

ということです。

一見すると少しレトロな発想です。

「新しい技術に対して、結局またプログラミング言語を作るのか」という印象もあります。

しかし、AIが本格的に複雑なタスクを実行するようになると、この考え方はむしろ自然なのかもしれません。

AIは便利だが、必ずしも決定的ではない

現在の大規模言語モデル(LLM)は非常に高性能です。

- 文章を書く

- コードを書く

- 調査する

- 設計する

- 問題を解く

といった知的作業を高いレベルで実行できます。

しかし、その振る舞いは従来のプログラムとは異なります。

同じ指示を与えても、

- 少し違う答えを返す

- 期待した形式で出力しない

- 正しそうだが誤った内容を含む

といったことが起こります。

つまりAIは、

「必ず正しい答えを返す関数」ではなく、「妥当な候補を生成する装置」

として考えたほうが適切です。

問題はAIそのものではなく、制御方法にある

例えば「数値だけを返してください」という指示を出したとします。

期待する出力:

42

しかし実際には、

答えは42です。

のような結果になることがあります。

このような振る舞いは、AIが壊れているわけではありません。

単に、

- 出力形式の制約

- 検証方法

- 再試行の条件

が十分に定義されていないだけです。

つまり問題は、

AIの性能不足ではなく、AIを使うアルゴリズムが未成熟である

という見方ができます。

従来のプログラミングとの類似

従来のプログラミングでは、

ifforwhile- 関数

- 例外処理

などを使って処理を制御します。

AIエージェントの世界でも、実際に必要になるものはよく似ています。

- 条件分岐

- 反復処理

- 並列実行

- エラー処理

- 検証

- 承認

違うのは、実行する対象が決定的な関数ではなく、

- LLM

- ツール

- サブエージェント

になることです。

「関数呼び出し」が「知的作業の委託」になる

従来:

result = calculate(x)

AIエージェント時代:

result = AskAgent("x を計算してください")

このとき重要なのは、エージェントが返す結果をそのまま信用するのではなく、

- 形式を確認する

- テストする

- 別のエージェントで検証する

- 必要なら再実行する

という制御を組み込むことです。

エージェントを管理する言語

そこで考えたのが、

AIエージェントを制御するための専用言語

というアイデアです。

例えば次のような記述です。

WORKFLOW SolveProblem:

answer = Solve(problem)

IF NOT IsNumber(answer):

RETRY

IF NOT Verify(answer):

RETRY

RETURN answer

ここで、

-

SolveはAIエージェント -

IsNumberは決定的な検証 -

Verifyは意味的な検証

です。

AIは「候補生成器」、アルゴリズムは「品質保証器」

この考え方では、

- AIは候補を生成する

- アルゴリズムは候補を評価する

という役割分担になります。

つまり、

AIの自由さと、アルゴリズムの厳密さを組み合わせる

という発想です。

確率的探索と決定的検証

この構造は非常にシンプルです。

generate → verify → retry

- 候補を生成する

- 条件を満たすか検証する

- ダメなら再試行する

この流れだけで、システムの安定性は大きく向上します。

意味的な検証も可能

形式的なチェックだけでは不十分な場合もあります。

例えば、

- 本当に仕様を満たしているか

- 内容に矛盾がないか

- 説明として適切か

といった評価が必要です。

これらは、

- 別のAI

- ルールベース

- テストコード

によって判定できます。

予算や時間も管理対象になる

AIエージェントにはコストが発生します。

そのため、

- 最大予算

- 最大実行時間

- 再試行回数

- 人間の承認

といった制約を記述できることも重要です。

BUDGET $5

TIMEOUT 10m

MAX_RETRY 3

スキーマやDSLとして実現できる

この仕組みは必ずしも新しいプログラミング言語である必要はありません。

- YAML

- JSON

- Markdown

- 独自DSL

のような形式でも十分実現できます。

重要なのは構文そのものではなく、

エージェントの振る舞いを構造的に定義すること

です。

既に似た取り組みは存在する

現在も、

など、近い方向性の仕組みがあります。

ただし、より広い意味では、

「AIのための制御記述」

そのものが重要になると感じています。

再帰的自己改善への可能性

この仕組みが整うと、

- 結果を評価する

- ワークフローを改善する

- 再実行する

というループを構築できます。

つまり、

エージェント自身が、自分の作業手順を改善する

ことも可能になります。

なぜ「言語」が必要なのか

AIの能力が高くなるほど、

「何をさせるか」だけでなく、

「どのような手順で実行し、どう検証するか」

が重要になります。

そしてその手順を明確に記述するためには、

構造化された表現方法、すなわち言語が必要になる

というわけです。

まとめ

AIは非常に強力ですが、出力は本質的に確率的です。

そのため、信頼性の高いシステムを作るには、

- 候補生成

- 検証

- 再試行

- 制約管理

- 承認

といった処理を構造的に記述する必要があります。

これは、従来のプログラミングにおける

ifforwhile

に相当する、新しい制御層と言えるかもしれません。

そして将来的には、

AIエージェントを管理するための言語やスキーマ

が、当たり前のように使われる時代が来るのではないかと感じています。

終わりに

今後、このようなエージェント管理言語やスキーマが整備されることで、社会のさまざまな仕組みが「プログラマティックなエージェント群」によって支えられていく可能性があります。

従来のソフトウェアは、決定論的なルールに従って動作する仕組みでした。入力に対して、あらかじめ定義された処理を実行し、決められた結果を返します。

一方で、AIエージェントを組み込んだシステムでは、プログラムの内部に「知能」を配置することになります。そこでは単なる固定的な手続きではなく、状況を解釈し、判断し、検証しながら動作する主体がアルゴリズムの一部として機能します。

これはある意味で、現実の社会そのものに似ています。社会は、多くの人々がそれぞれの役割を担い、相互に連携し、評価し合いながら成り立っています。法律や制度が基本的な枠組みを定め、その中で個々の人間が判断し、行動し、必要に応じて修正を重ねています。

エージェント管理言語によって構築されるシステムもまた、こうした社会的構造をソフトウェアの中に実装する試みと見ることができます。すなわち、知能を持つ主体がルールの中で協調し、全体として目的を達成する「人工的な社会システム」を設計することになるのかもしれません。

そして重要なのは、その仕組み自体も固定されたものではなく、常に評価され、改善され続ける必要があるという点です。より良い結果を生み出し、より効率的で、より公平で、より信頼できるシステムへと進化していくことが求められます。

もしこのような枠組みが広く普及すれば、AIは単なる便利なツールにとどまらず、社会を支える基盤技術の一部になっていくでしょう。そして私たちは、プログラムを書くという行為を通じて、単なる処理手順ではなく、「知能が協調して動作する仕組み」そのものを設計する時代に入っていくのかもしれません。