AWS re:Invent 2019 で発表された AWS DeepComposer というサービスが 2020年4月5日 に一般ローンチされました!

https://aws.amazon.com/jp/blogs/news/aws-deepcomposer-now-generally-available-with-new-features/

AWS DeepComporser ってなあに?

機械学習を触って学ぶことができる AWS Deep シリーズ1 の最新作である、 AWS DeepComposer は、機械学習のうち、敵対的生成ネットワーク(GAN)モデルを利用して、オリジナルの楽曲を作り出すことができるものです。

敵対的生成ネットワーク(GAN) ってなあに?

GANsは生成ネットワーク(generator)と識別ネットワーク(discriminator)の2つのネットワークから構成される。例として画像生成を目的とするなら生成側がイメージを出力し、識別側がその正否を判定する。生成側は識別側を欺こうと学習し、識別側はより正確に識別しようと学習する。このように2つのネットワークが相反した目的のもとに学習する様が敵対的と呼称される所以である

ざっくりいってしまえば、元になるデータ(例:画像)の特徴を含んだ新しいデータ(画像)を生み出すことができる技術とイメージすればよいでしょう。古い画像に対して色を付けたり、古く低画質な画像を高画質にしたり・・・

AWS DeepComposer では結局何ができる?

AWS DeepComposer では元になるデータが音、楽曲になっています。

AWS DeepComposer キーボードやマネージメントコンソールのソフトウェアキーボードなどで奏でた旋律に対して、機械学習の力で伴奏を付けることができ、ポップスやロック、ジャズ、シンフォニーといったモデルを使って簡単に作編曲が行えます。

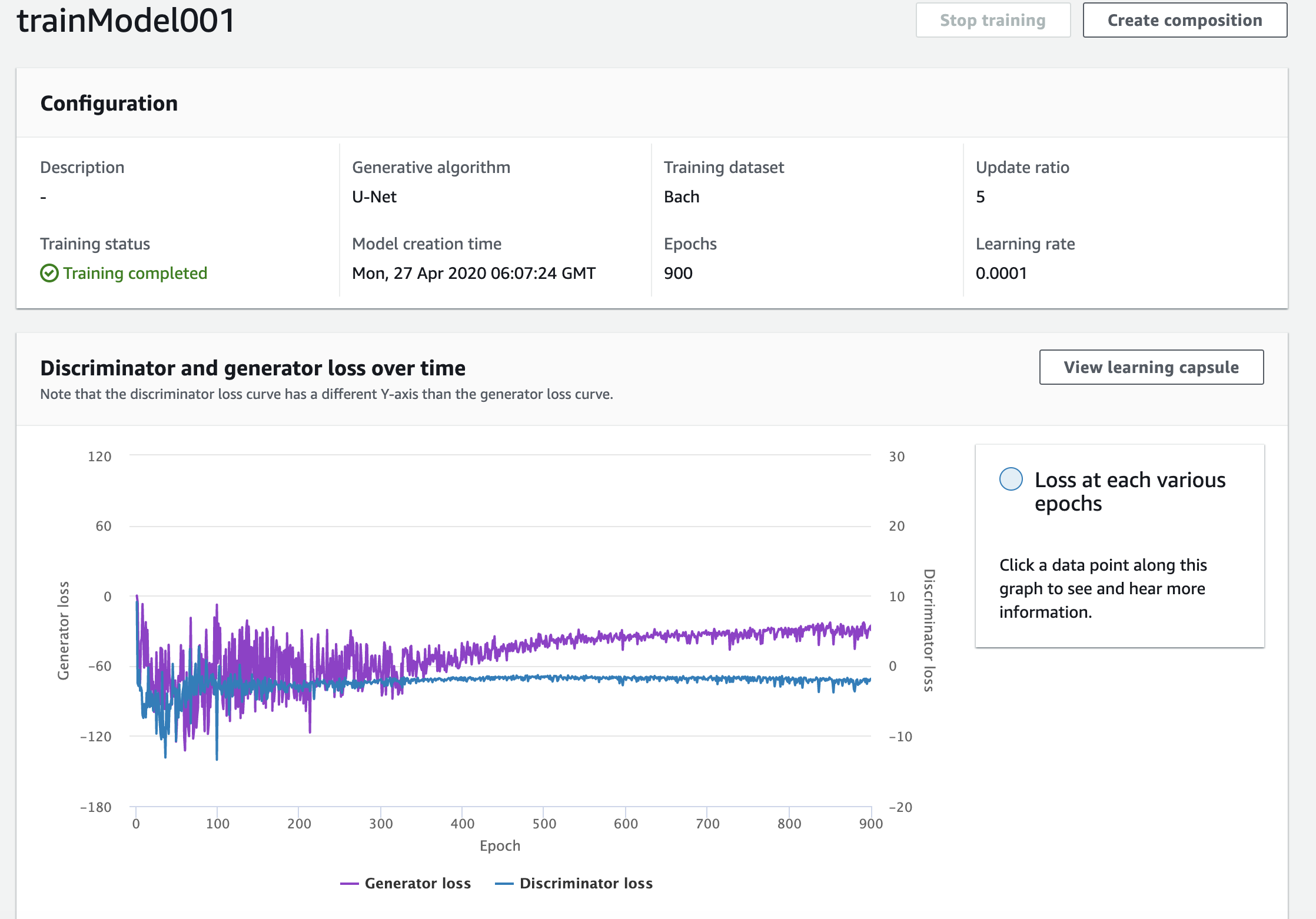

また、曲ジャンル(データセット)を選び、GAN アーキテクチャやハイパーパラメータを指定し機械学習を実行することで、サンプルとは異なるモデルを構築することも可能です。このモデルを使っての楽曲出力も可能です。

生成した楽曲については、midi や mp3 での出力、 SounCloudでの共有が行えます。

さあ、はじめてみよう!

というわけで、 AWS re:Invent 2019 で頂いた AWS DeepComposer キーボードを利用して試してみました。

Amazon.com が発送してくれる地域、手段があればここから購入することも可能です。

※残念ながら、執筆時点では日本への配送は不可でした。

しかし、手に入れることができなくても、AWS DeepComposer に用意されているソフトウェアキーボードを利用したり MIDI に対応したキーボードをお持ちであれば利用可能です。

AWS DeepComposer キーボード開封の儀

右上の aws ロゴがクールですね。

AWS DeepComposer を使うには・・・

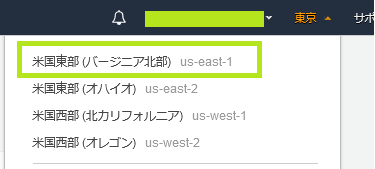

AWS マネージメントコンソールへログイン後、使用するリージョンを「米国東部(バージニア北部) us-east-1」に設定します。

画面上部のサービスを開き、開いたメニューをスクロールさせ、 Machine Learning のセクションにある AWS DeepComposer を選択します。

もしくは、検索エリアに AWS DeepComposer と入力して表示させて、選択します。

メニューを確認

AWS DeepComposer ではどんなことができるのかを学びたい方は、 [Get started] ボタンをクリックして始めるとよいでしょう。

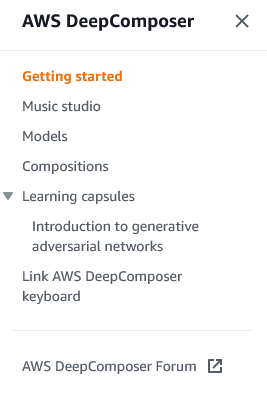

とりあえず、さくっと触ってみたい場合は、画面左のハンバーガーアイコン[Ξ]をクリックするとメニューが表示されます。

執筆時点では以下のメニューが存在しています。

Getting started

AWS DeepComposer のトップ画面にある「Get started」ボタンをクリックした先と同じ画面が表示されます。

ここでは、順を追って 敵対的生成ネットワーク(GAN)や AWS DeepComposer の使い方(始め方)を学ぶことができます。

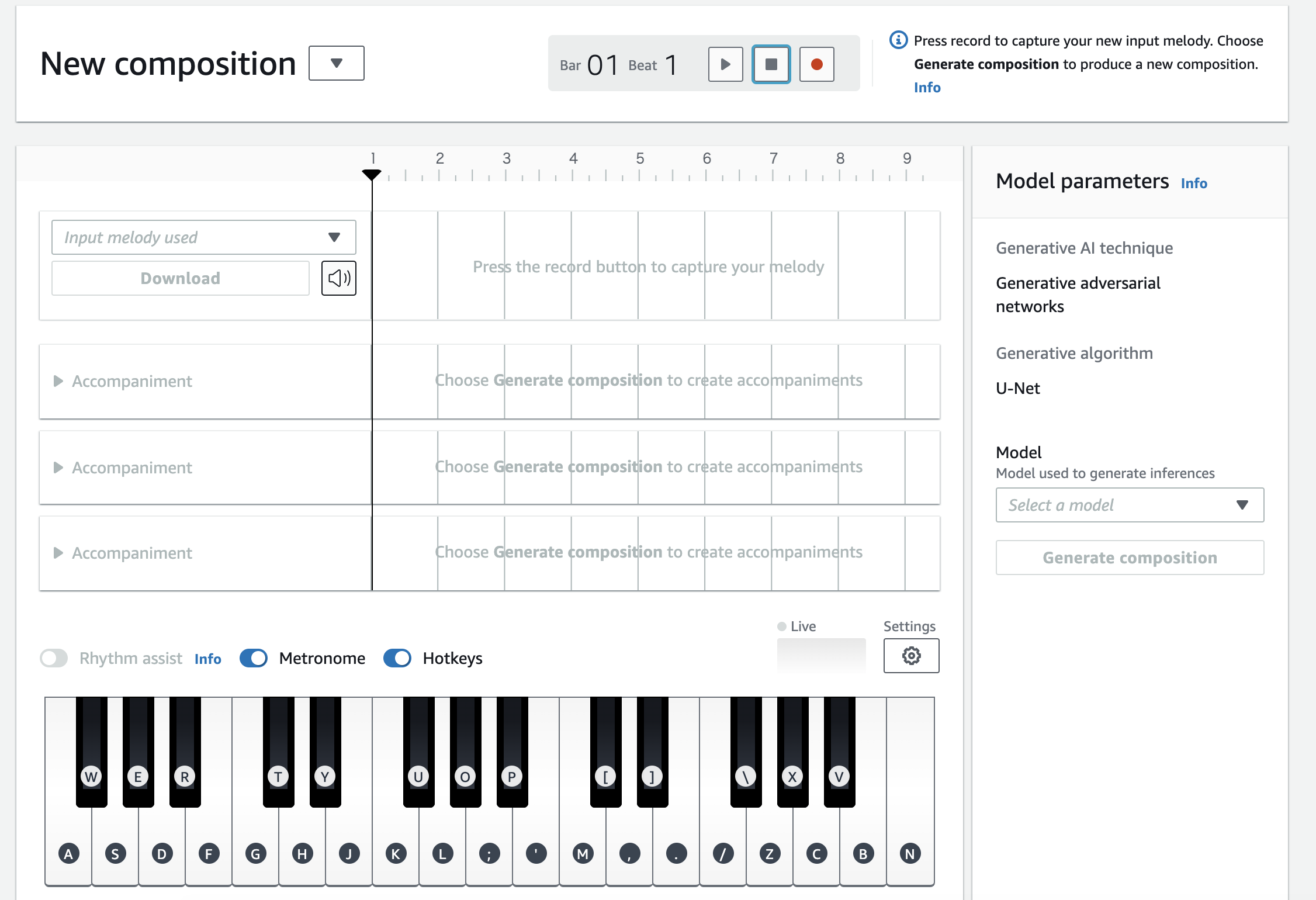

Music studio

ここでは、接続した AWS DeepComposer キーボードや画面上のソフトウェアキーボードを通して奏でたメロディを録音したり、学習済みモデルを指定して楽曲を生成したりすることができます。

MIDI 機器を接続すると以下の画面が表示されます。

音が出ない場合は、いったん別のメニューに飛んでから Music studio を表示し直すと音が出るようになりますよ。

Models

サンプルモデルの確認やモデルの構築、構築済みモデルの管理が行えます。

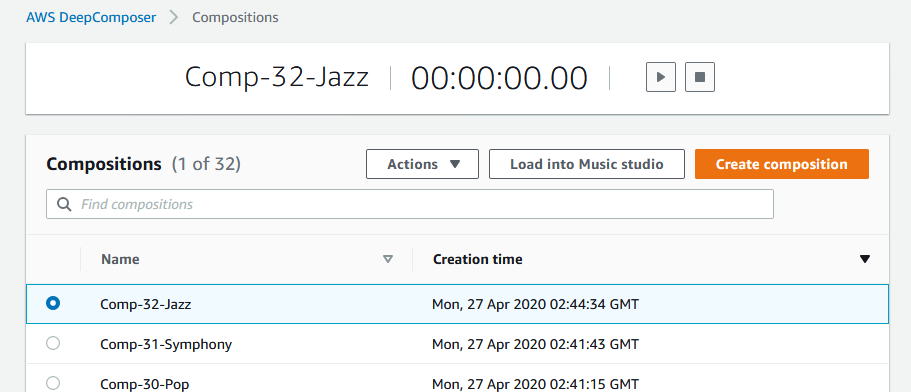

Compositions

生成した楽曲を管理することができます。

初期執筆時点では削除できませんでしたが、2020/5/7に確認したところ、削除操作が行えるようになっていました。

Learning capsules

ラーニングカプセルとは、 AWS re:Invent 2019 での発表時にはなかった新機能のひとつで、AWS DeepComposer で利用可能なアーキテクチャやトレーニングパラメーター、モデル評価ツールの詳細を学ぶことができます。

このコンテンツは今後も増えていくようです。

Introduction to generative adversarial networks

敵対的生成ネットワーク(GAN)について学ぶことができます。

Link AWS DeepComposer keyboard

Amazon.com で購入した AWS DeepComposer キーボードを登録することができます。

登録することで、以下の特典が得られます。

- 3か月間の無料体験

- 毎月4つのカスタムモデルの構築

- 構築したモデルを用いて40回までの楽曲生成

ちなみに、これとは別に、AWS DeepComposer では12か月の無料体験枠が存在ます。

そちらでは、 サンプルモデルを利用した 500回までの楽曲生成が行えます。

コードの登録に成功すると以下のメッセージが画面上部に表示されます。

Firefox で表示すると、なぜかここで限定サポートのブラウザである旨ののメッセージが出力されました。

Firefoxをご利用の方はご注意ください。

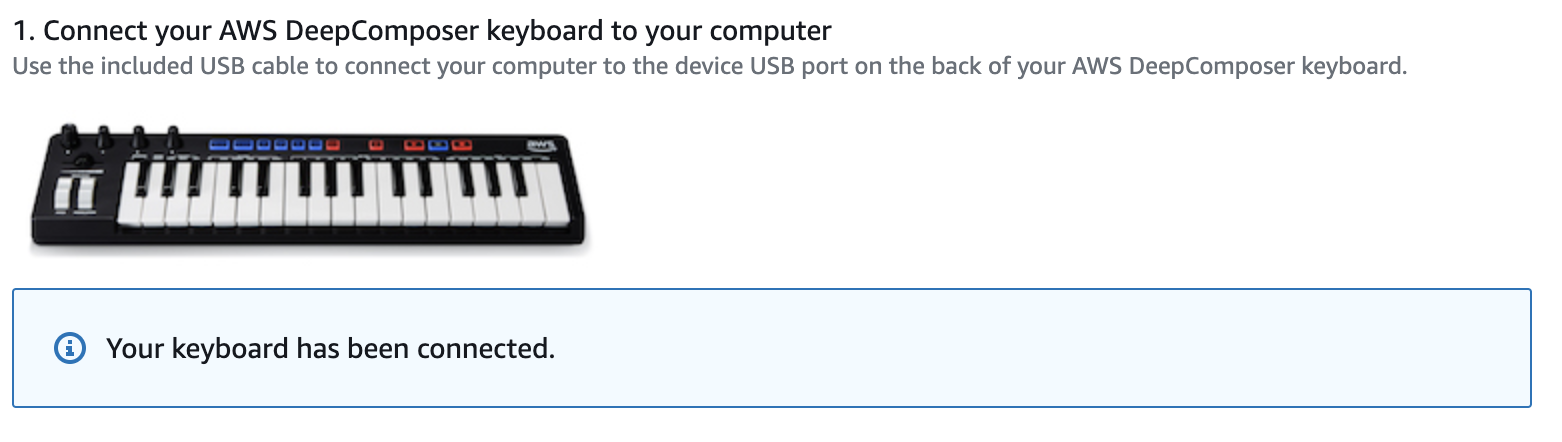

また、登録する際には AWS DeepComposer キーボードの接続が必須のようです。

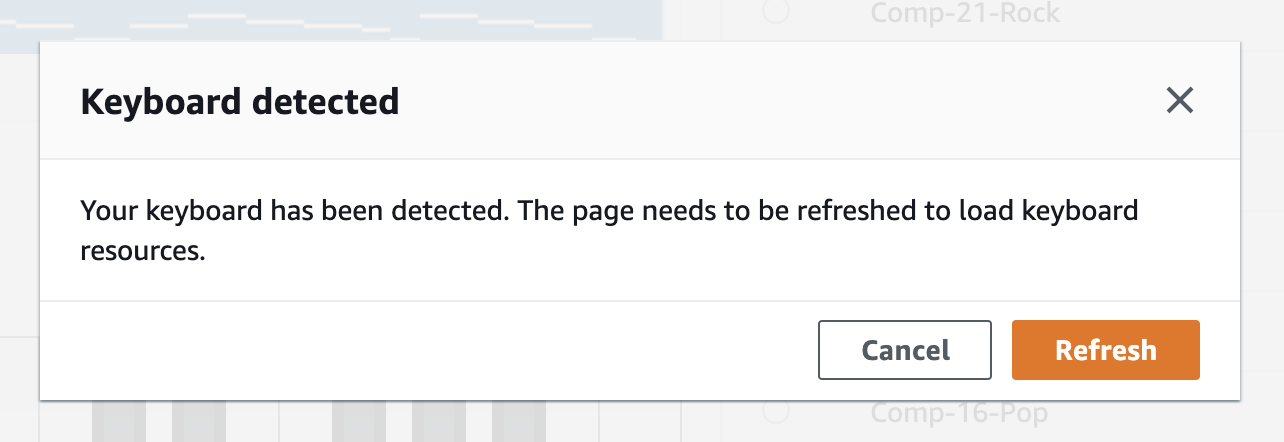

接続し、ブラウザが認識してくれると以下のような表示がなされます。

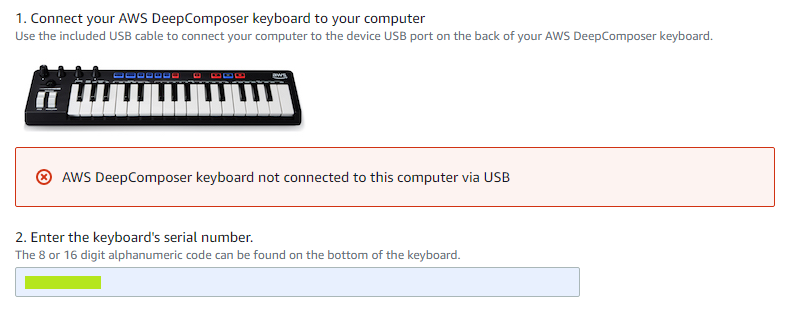

接続していても、ブラウザが認識してくれないと以下のメッセージが表示されます。

Firefox のように限定サポートのブラウザの場合はメッセージが異なります。

AWS DeepComposer Forum

AWS 公式の DeepComposer フォーラムへのリンク。質問事項や要望、動作不具合などはこちらにポストするようです。

弾いてみた

色々な入力ソースで試し弾きをしてみました。

ドーレーミーのように上がっていき、ドーシーラーと下がっていくようにしました。

入力した際の音源と、サンプルモデルの Rock で伴奏を付けたものを youtube にアップしました。

入力ソースによって操作性が異なるため、拍などが異なるのはご了承ください。

ソフトウェアキーボード

マウスクリック

うん、むずかしい!!笑

この一言に尽きます。

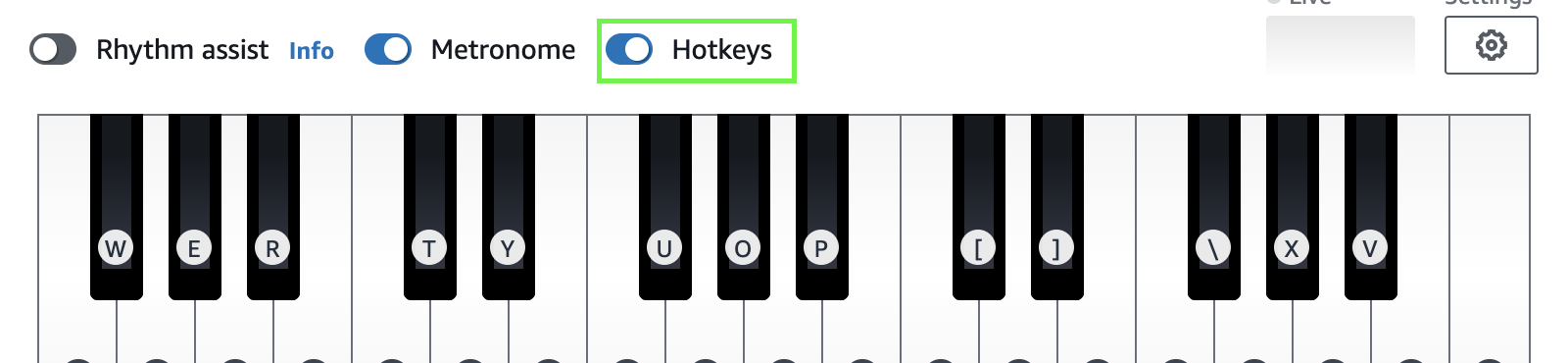

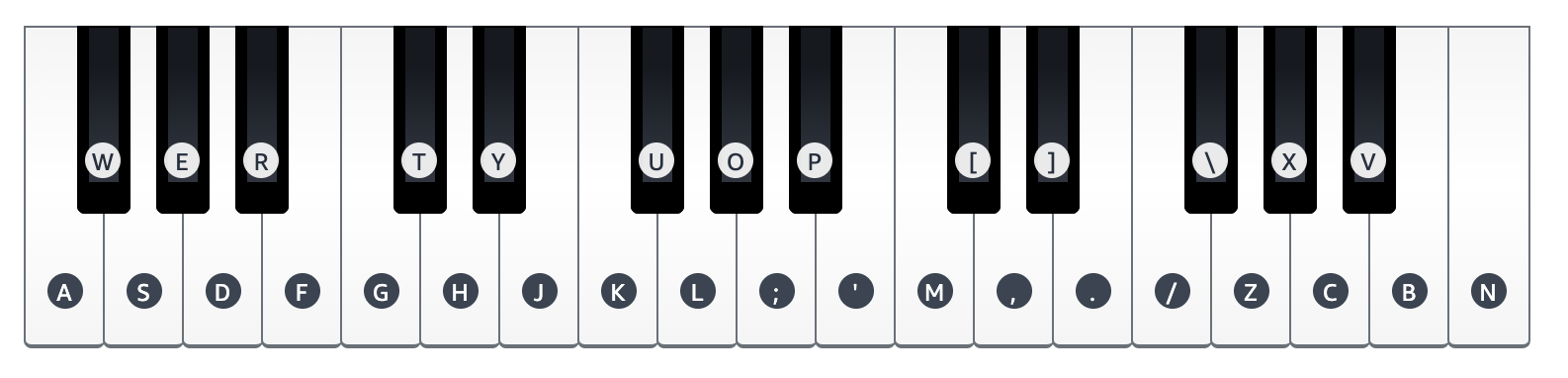

キーボード(文字入力装置)

文字入力用のキーボードでも弾くことは可能です。当初執筆時は設定を自分でしないとなりませんでしたが、2020/5/7に確認した際には、デフォルトで有効状態になっていました。

もし、有効ではなく文字入力用キーボードで弾けない場合は以下から設定できます。

Music studio のソフトウェアキーボードのちょっと上にある Hotkeys をクリックします。

すると、ソフトウェアキーボードの各鍵盤に文字入力用キーボードに対応した文字が表示されます。

日本語キーボードだと「シ」(上記画像でいうところの ; と M の間)が打てません。

macOS で確認したところ、入力ソースとして「イギリス」を選ぶとよさそうでした。

手っ取り早く試すにはよい選択肢かもしれません!

ハードウェアキーボード

AWS DeepComposer キーボード

専用キーボードなので前述のマウスクリックや文字入力用キーボードと比較すると弾きやすい(入力しやすい)です。

ただ、 MIDI キーボードのためか意識して強めに弾かないと音が出ないことがありました。

MIDI キーボード(Alesis VORTEX)

こちらも弾きやすいですが、 AWS DeepComposer キーボードと同様に、意識して強めに弾かないと音が出ないことがありました。

MIDI ウインドシンセ(AKAI EWI USB)

F1 の曲の楽器!といえば理解が早いのではないでしょうか。

ウインドシンセサイザーと呼ばれる楽器です。

「キーボード」ではないですが、 MIDI 対応楽器のため参戦させました。

久しぶりに吹いたので難しかったですが、入力認識としては、次のクラビノーバに次いでよかったです。

MIDI 対応電子ピアノ(YAMAHA クラビノーバ)

YAMAHA の電子ピアノ! MIDI に対応しており、USB ケーブルで mac などと簡単に接続できました。

ガチな楽器なため、弾き心地は最高でした。※演奏者の腕前が良ければ最高なのですが...

まとめ

AWS DeepRacer のように報酬関数(Python 言語によるプログラミング)を必要とせずに、自分が弾いた旋律に伴奏を付けてくれることに感動を覚えました。

また、検証した通り、入力ソースとして MIDI に対応している機材であればなんでも使えそうなので、 DeepComposer キーボードがすぐに手に入らない状況でも楽しんで学ぶことができるかと存じます。

そして、機械学習に慣れ、モデルをがっつりと構築できれば、例えば、歌手の○○のようなアレンジやサンプルにはないジャンル(例えばデスメタルや演歌など)での生成といったことができそうですね。ワクワクします。

-

AWS DeepLens, AWS DeepRacer, AWS DeepComposer ↩