RMDL: Random Multimodel Deep Learning for Classification 要約

読んだ論文

RMDL: Random Multimodel Deep Learning for Classification

Kamran Kowsari • Mojtaba Heidarysafa • Donald E. Brown • Kiana Jafari Meimandi • Laura E. Barnes

https://arxiv.org/abs/1805.01890

上記の論文を読んだので簡単にまとめます.Best Paper award ACM ICISDMらしいです.現在のMNISTのState-of-the-artな手法らしいので読むことにしました.

3行でまとめる

- 画像とテキスト分類に適用可能なRMDL(Random Multimodel Deep Learning)の手法を提案した.

- DNN,RNN,CNNを並列使用する手法である.

- 様々なBaseline手法と公開データセットで性能評価を行った.

余談

関連研究の末尾で紹介されていた,複数の深層構造の組み合わせとしてRCNN(Recurrent Convolutional Neural Network)が挙げられていた.紹介記事もあるので,時系列分類問題に実際に適用してみたい.もちろん本稿のRMDLも使えそうなのでやってみたい.

提案手法

使用モデル

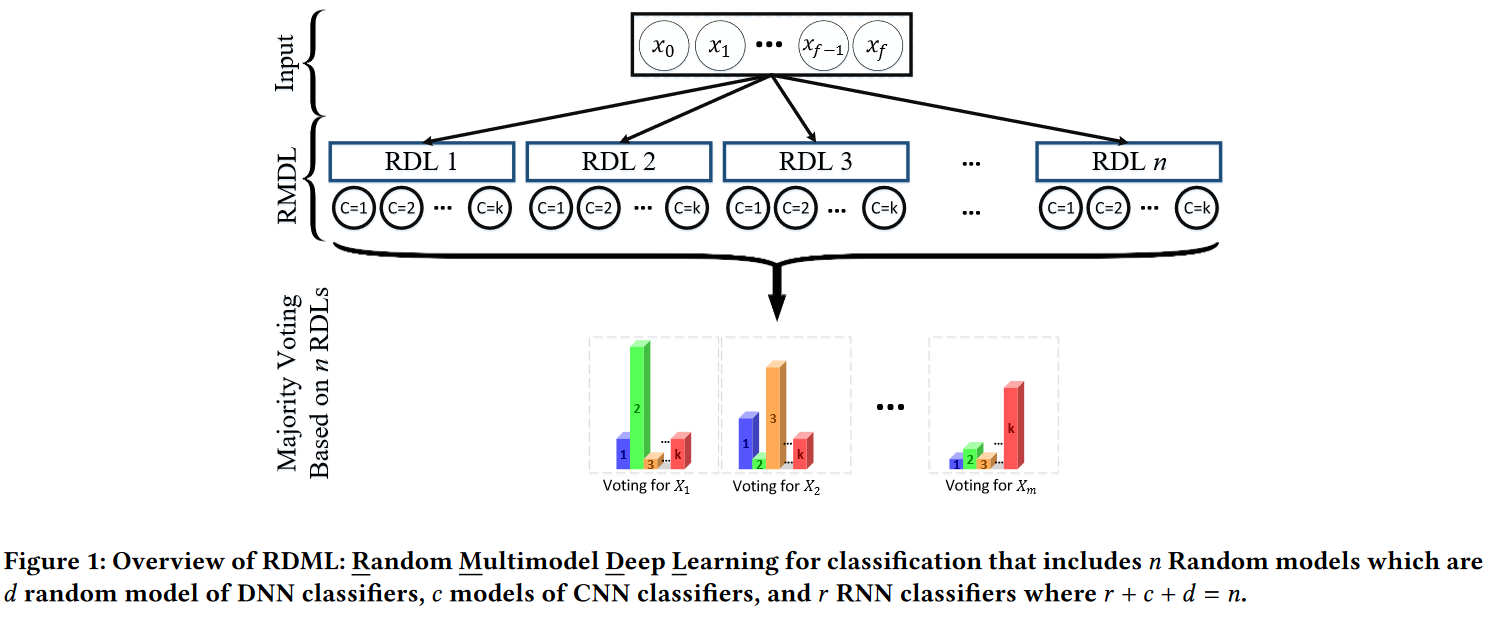

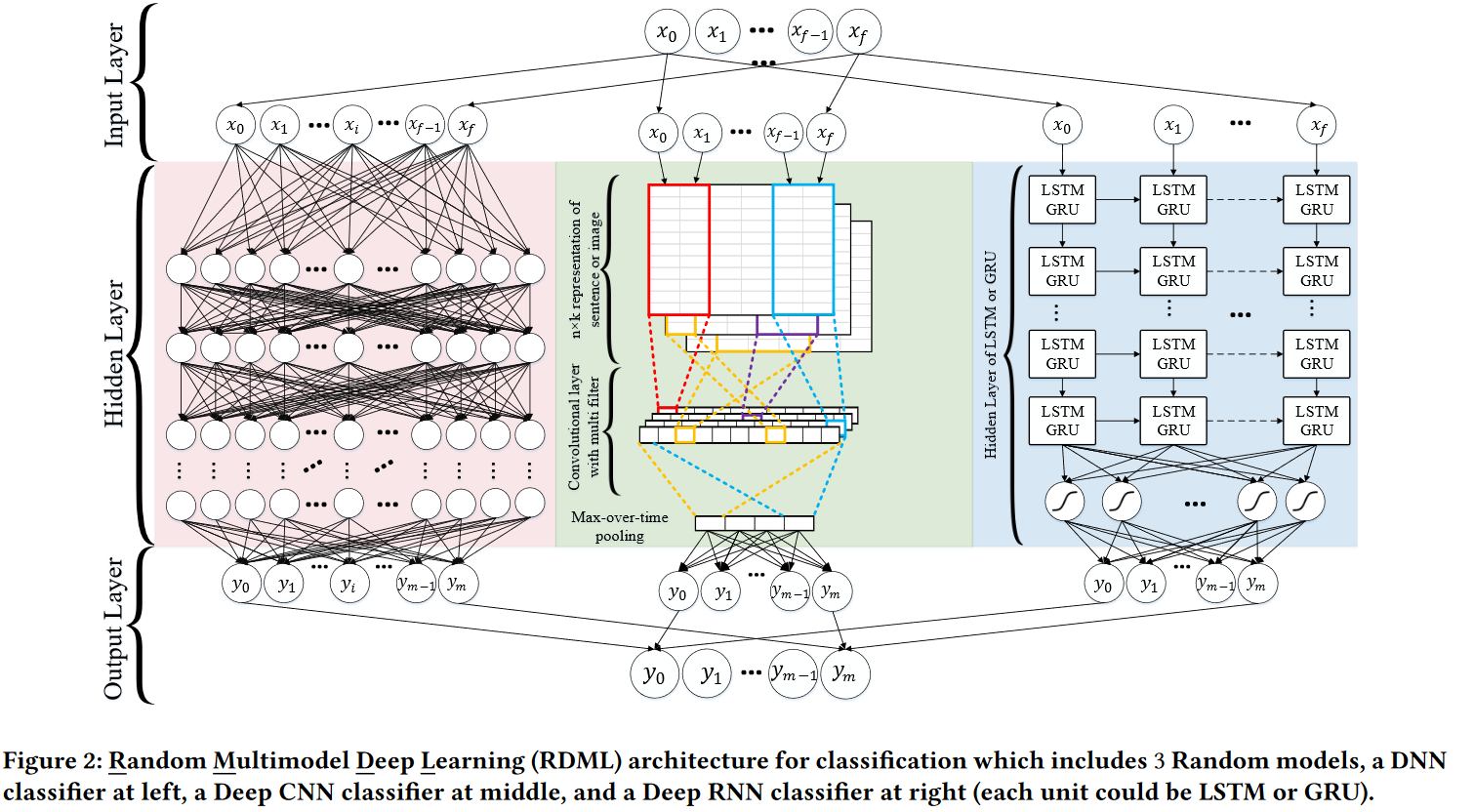

- 提案手法の概要はFig.1とFig.2が全てを示している.

- Fig.1のように入力に対してランダムに複数のDLモデルを構築し,多数決をとる.

- 各モデルの層数やユニット数等はランダムに生成され,各モデルでユニークになる.

- 恐らく,特徴抽出に関する記述があったので,DNNとRNNはHand-craftedな特徴量を使用している.

- Random Forestのようにブートストラップな感じかと思ったが,モデルだけがアンサンブルな様子.

- 以上...従来手法やDNN,RNN,CNN,最適化などについて詳細に説明してくれているので紙面を使っているが,教科書に書いてある話なので提案手法自体はシンプル.

評価実験

実験設定

- テキスト分類

- 評価用のデータセットは4種類でWOS,Reuters,IMDB,20newsgroups.

- Baseline手法はDNN,CNN,RNN,NBC,SVM,SVM(TF-IDF),Stacking-SVM,HDLTex.

- 画像分類

- 評価用のデータセットは2種類でMNIST,CIFAR

- Baseline手法はDeep L2-SVM,Maxout Network,Binary Connect,PCANet-1,gcForest

- 実験環境

- CPU: Xeon E5-2540

- 64GB Memory (DDR3)

- 3 GPU: GTX 1080Ti*2, Tesla K20c

- ライブラリ

- TensorFlow + Kearsらしい.

実験結果

- 上記全てのデータセットにおいて提案手法の推定精度の方が高かった(すごい).

- 特にMNISTのErrorRateが0.18(精度99.82%).

まとめ

- DLモデルをランダムにアンサンブルするだけで高い精度が出るという不思議な論文である.

- CNNにはどこまでのテクニックを導入しているのかが気になる.

- 簡単に実装できそうではあるが,ランダムの範囲等が不明なので結構チューニングが大変かもという印象を受けた.

- あと,学習に時間がかかりそうだがその辺の評価が気になるところではある.

所管

手法は簡単だったが色々読んでると結局論文の選定含めて2時間くらいかかっている.全然時間節約ができていない...60GPUの論文を読んだ後だったので,3GPUが意外としょぼかったが,色々な検証を行っていて素晴らしいと思います.