はじめに

三年と少し前、自分は一日で俺の嫁を作る方法 ~一日で自分の好きな声・キャラ・見た目でおしゃべりしてくれるAIキャラクターを作ろう~という記事を書いて、アプリとともに公開しました。

こんなやつです。

会話の情報を記録する pic.twitter.com/s0wImLHEuk

— 玉露 (@ororo33) December 18, 2019

この時はAI部分と音声認識部分と音声合成部分にNTTドコモのAgentcraftとSEBASTIENを使っていたのですが、自由にその場で会話や音声を生成してくれる、Whisper APIとChatGPT API、VoiceVox APIが公開されたので、以前作成したこれをそれらに換装してみました。

その結果、それまでの会話を覚えていて、その時の会話によって感情が生成され、それによって表情も変わるようになりました。

そしてその結果が以下のものです。

以前の、会話とその反応のすべてを自分で手作業しないといけなかったときとは大違いです。

自分で話す内容を考えてくれるAIにひどい言葉を言って、傷ついた表情をされると作り物だと分かっていてもなかなか心が痛みますね……

本記事ではこのアプリの紹介と、システムの仕組み、簡単な作り方を説明したいと思います。

(noteにも同じ内容の記事を置きました。そちらには有料部分ですが、このアプリのプロンプトやそれをUnityに組み込む方法も載せています。もしきょうみがあればご覧ください。

note版:【ChatGPTで感情・表情を生成・表現するAIキャラクター】一日で俺の嫁を作る方法・続

構成図

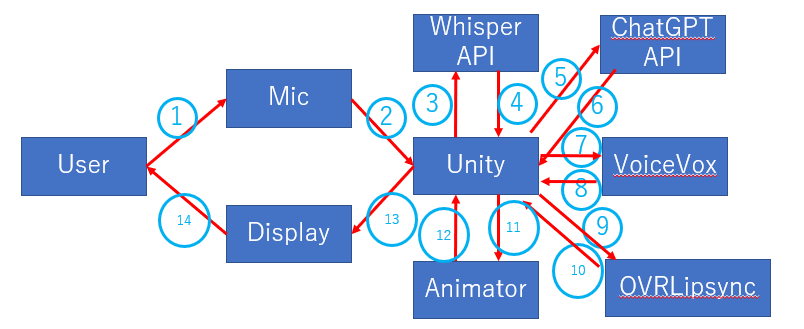

構成図はこんな感じ。

【Whisper APIとChatGPT APIを使用して、超速で返答してくれるAIキャラクターを作ったよ!】の構成図のアバターを3Dモデルにして、合成音声用にVoiveVoxを、アバターの口パク用にOVRLipsyncを、表情を動かすためにAnimatorを追加した、って感じですね。

あと構成図には書かれていませんが、会話の記憶保持のための処理と感情を生成するための処理も追加しています。

作り方

図の番号に沿って順番に説明していくと、

1. ユーザーがマイクに音声を発話して、音声情報を入力します。

2. マイクはユーザーの音声を常に把握していて、一定以上の音量の音声が入ると、録音して、音声ファイルに保存します。

この時の音声ファイルは、Whisper APIが対応している以下の形式に限定されます。

mp3, mp4, mpeg, mpga, m4a, wav, and webm.

3. 保存した音声ファイルをWhisper APIに投げます。

この時のコードは昨日書いた記事に載せているので、良ければ参考にしてください。

4. Whisper APIから音声の認識結果が超速で返ってきます。

5. ChatGPTのAPIに音声の認識結果を投げます。

ChatGPTへのAPIの投げ方や使い方は記事:ChatGPT API の使い方が参考になります。

またUnity上でChatGPTのAPIを使う方法は記事:Unity上でChatGPT「text-davinci-003」APIを実行する話を参考にしました。

6. ChatGPTのAPIから投げかけた文に対する返答が返って来ます。

7. 自分のPCで起動したVoiceVoxのサーバーにAPIを投げます。

VoiceVoxのサーバーの起動方法やAPIの投げ方はGPT-3とVoiceVoxを活用してAIエージェントを作る!【Unity】という記事を参考に作りました。

8. サーバーから合成された音声が返ってきます

ここで、Unityに合成された音声を登録します。

9. OVRLipsyncに合成音声に合わせて3Dモデルの口を動かしてもらいます。

動かし方は【一日で俺の嫁を作る方法 ~一日で自分の好きな声・キャラ・見た目でおしゃべりしてくれるAIキャラクターを作ろう~】の作り方5を参考に。

10. OVRLipsyncが3Dモデルの口を音声に合わせて動かします。

11. UnityのAnimatorに、感情に合わせた表情を作ってもらいます。

Animatorの動かし方については【UnityC#講座】ユニティちゃんの表情を替える【SetLayerWeight】を参考に表情を変化させます。

感情生成周りについては【ChatGPTに感情回路を埋め込んだら、やべぇ感じになった】の記事などを参考に、ChatGPTに投げるプロンプトを工夫してChatGPTに作成してもらっています。

ちょっと工夫するだけでその時の会話に合った感情生成とかしてくれるChatGPTすごい。

12. Animatorが3Dモデルの表情を変化させます。

13. ChatGPTから返ってきた文から必要な部分だけ抜き取り、その時の会話にあった表情で発声します。

14. Userが発生された音声を聞き、また応答を返します。

おわりに

作ってみて思うのですが、声と表情がつくだけで、だいぶ人間味が増しますね。

どういう言葉を言ったらどんな感情を生成するのかを実験するためにけっこういろんな言葉を、ひどい言葉を含めてAIに投げてみたのですが、悲しい顔をされながら健気な言葉を言われるとけっこう罪悪感がわきます。

今後の商品広告とか営業がこういうAIに置き換わると、なかなか断りづらさが増す気がしますね……

では本記事はここまで。

次は以前書いた【即興魔法を使おう ~自然言語処理技術で自分の考えた詠唱に合った効果の魔法を使うシステム~】の自然言語処理部分をChatGPTに置き換えることで、より柔軟に即興魔法を使えるようなシステムを作ってみたいと思います。