「Google1位を取れば勝ち」はもう終わった。

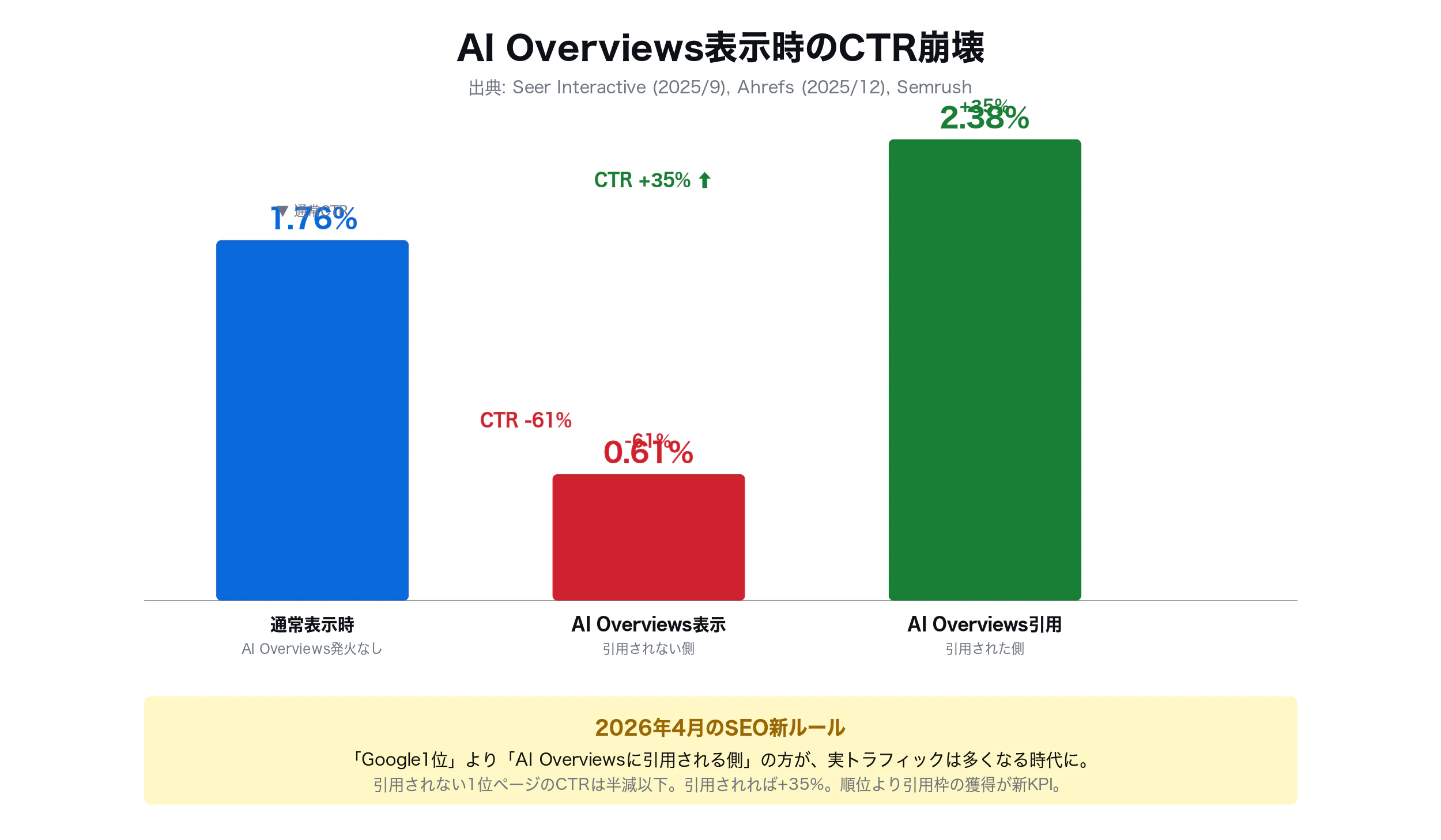

AI Overviewsが表示されると、1位ページのCTRは58%落ちる。

戦場は「順位」から「AIに引用される側」へ移った。

2026年4月、SEOは静かに、しかし決定的にルールが書き換わった。日本のAI検索利用率は8か月で3.5倍。検索結果の上部はAIの回答が占有し、青いリンクをクリックする習慣そのものが崩壊しつつある。

この記事は、その変化を実データで突きつけたうえで、マーケターが今日から打てる7つの新ルールにまとめる。

この記事でわかること

- AI検索(ChatGPT/Perplexity/Google AI Overviews)が起こした実測のCTR変化

- 「掲載」から「引用」へとSEOのKPIが変わった理由

- GEO(Generative Engine Optimization)の具体的な実装テクニック

- 日本市場で2026年に押さえるべき7つの新ルール

- 今日・今週・今月のアクションプラン

対象読者

- BtoB/BtoC問わずSEOで集客しているマーケター

- コンテンツ責任者・編集長・ディレクター

- 「AI検索でうちのサイトはどうなる?」と社内で聞かれて答えに詰まっている人

- インハウスSEO担当者・SEO支援会社のコンサルタント

目次

- 何が起きたのか——2026年4月のSEO地殻変動

- 日本市場の現在地——8か月で3.5倍に膨張したAI検索

- 新ルール1:「掲載」より「引用」を取りに行く

- 新ルール2:8語以上のロングテールに張る

- 新ルール3:被リンクよりブランド言及

- 新ルール4:構造化データは複合で実装する

- 新ルール5:llms.txtを置いてAIクローラーをbot単位で制御する

- 新ルール6:E-E-A-Tの「経験」を可視化する

- 新ルール7:KPIを「流入量」から「CV率4.4倍」へ移す

- 今日・今週・今月のアクションプラン

- まとめ

何が起きたのかー2026年4月のSEO地殻変動

まず実測のCTRデータから見る。

| 調査機関 | 調査時期 | 対象 | CTR変化 |

|---|---|---|---|

| Ahrefs | 2025年12月 | 1位ページ全体 | -58.0% |

| Ahrefs(日本市場) | 2025年12月 | 日本サイト | -37.8% |

| Seer Interactive | 2025年9月 | 実トラフィック | オーガニック -61% / 有料 -68% |

| Semrush | 2025年通年 | 1,000万キーワード | AI Overviews表示時 -61% |

| Pew Research | 2025年 | 6.8万実検索 | クリック率 15% → 8% |

ぶっちゃけ、これは「微妙にCTR下がった」とかいう話じゃない。1位を取っても流入が半減する世界が、もう始まっている。

しかも面白いのは、AI Overviewsに「引用された」ページは逆にクリックが伸びる点だ。

💡 引用された側のメリット

- AI Overviews引用ページのオーガニッククリック: +35%

- 引用されたブランドの有料広告CTR: +91%

(Seer Interactive 2025/9)

つまりゲームのルールは「順位を上げる」から「AIに引用される側になる」へ完全に変わった。順位を1位にする努力は、引用されなければ単なるコストになってしまう。

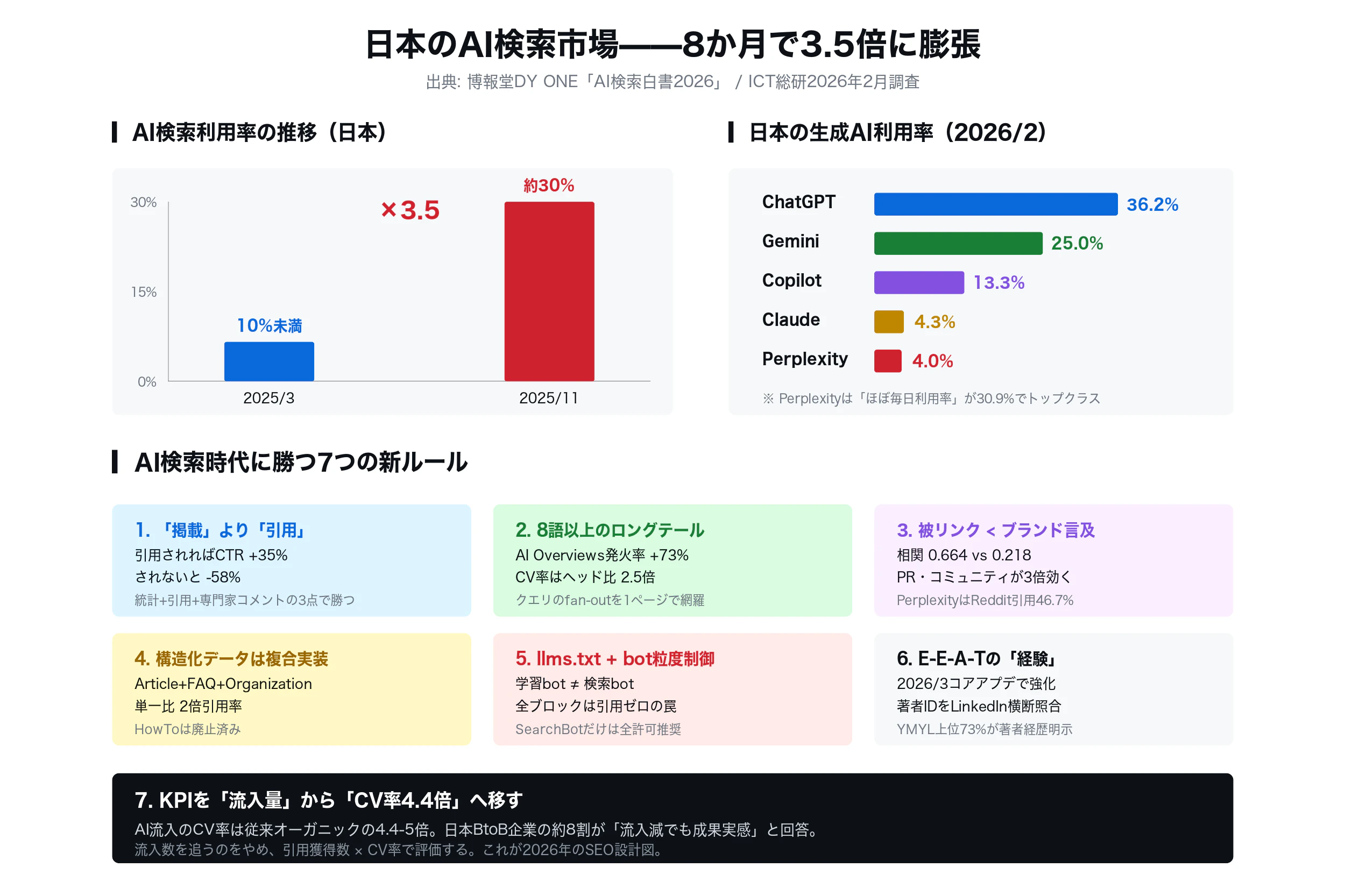

日本市場の現在地ー8か月で3.5倍に膨張したAI検索

「これは米国の話でしょ?」と思った人、データを見てほしい。

日本のAI検索利用率の推移

博報堂DY ONE「AI検索白書2026」(2026年3月発表)によると、日本のAI検索利用率は2025年3月の10%未満から、2025年11月には約30%へ。たった8か月で3.5倍になった。

| 用途 | 利用率 |

|---|---|

| プライベート利用 | 27.6% |

| ビジネス利用 | 29.9% |

日本の生成AI利用率(ICT総研 2026年2月調査)

| サービス | 利用率 | ほぼ毎日利用 |

|---|---|---|

| ChatGPT | 36.2% | 28.8% |

| Gemini | 25.0% | 27.6% |

| Microsoft Copilot | 13.3% | - |

| Claude | 4.3% | 26.1% |

| Perplexity | 4.0% | 30.9% |

**Perplexityの「ほぼ毎日利用率」が30.9%**ってのが地味に効いてる。利用者数は少なくても、ヘビーユーザーが日常的にAI検索をデフォルトにしている。

Z世代の検索行動

- 約40%のZ世代がTikTok/Instagramで検索を開始(Google調査)

- 10代のTikTok利用率: 65.7%

- ただし最終的な信頼性確認はGoogle検索と公式サイトに戻る(アウトオブザボックス調査)

つまり、Z世代は「SNS→AI検索→Google→公式サイト」という4ステップの新しい導線を持っている。各ステップで離脱されないコンテンツ設計が必要になる。

ここからが本題。じゃあどうすれば勝てるのか? 7つの新ルールに落とし込む。

新ルール1:「掲載」より「引用」を取りに行く

これが2026年最大の発想転換。

なぜ「引用」がKPIなのか

AI Overviewsが発火するクエリでは、検索結果ページの上部はAIの回答ボックスが占有する。ユーザーはAI回答を読んで、そこに「出典」として表示されたサイトを選ぶ。つまり順位より「引用枠に入れたかどうか」がトラフィックを決める。

実データ:

- AI Overviews引用ページのオーガニッククリック: +35%

- 引用ページの有料広告CTR: +91%

- 引用されない1位ページのCTR: -58%

引用される側になる3つの条件(Princeton GEO論文より)

KDD 2024で発表されたPrinceton/Georgia Tech/AI2/IIT Delhiの共同論文では、AIに引用されやすくする要素を実測で計っている。

| 要素 | 引用率向上 |

|---|---|

| オリジナル統計データの追加 | +40% |

| 権威ソースからの引用挿入 | +40% |

| 専門家の引用文(コメント) | +28% |

つまり「自分の言葉で書く」「他者の権威データを連れてくる」「現場の声を入れる」の3点セットが、AIに引用される確率を倍近く上げる。

具体的な書き方

# AI検索向けの記事構造(最強パターン)

## H2: 質問形式の見出し(例: 「AI検索のCTRはどれくらい下がる?」)

【最初の40-60語で1文の直接回答】

AI検索が表示されると、1位ページのCTRは58%下がる。

ただし引用されると逆に+35%上昇する。

【続けて根拠を統計+引用+専門家コメントで補強】

- Ahrefs 2025年12月調査では...

- 元GoogleのSEO担当〇〇氏は「...」と述べている

- 自社の3か月実装データでは...

💡 Tips: H2は「〜とは」より「〜はどれくらい?」「なぜ〜?」と質問形にする。AIが回答を抽出するときに、Q&A形式を最も拾いやすい。

新ルール2:8語以上のロングテールに張る

「ヘッドキーワードで1位」という従来戦略は、AI時代に逆効果になりつつある。

数字で見るロングテールの優位性

| 指標 | データ |

|---|---|

| 8語以上クエリのAI Overviews発火率 | 短いクエリより +73% |

| AI Overviewsが21-30位を引用する率 | 従来の +400% |

| AI Overviewsが31-100位を引用する率 | 従来の +200% |

| ロングテールの平均CV率 | ヘッド比 2.5倍 |

何が起きているか

AI Overviewsは「ユーザーの曖昧な質問」を「複数の細かい質問」に分解して回答を組み立てる(クエリのfan-out)。短いキーワードより、質問の意図に直接答える長文の専門記事を引用しやすい。

しかも面白いことに、引用元は1位ページから来るとは限らない。21-100位のページも普通に引用される。これは「ヘッドで1位より、ロングテールで広い網」が効く根拠だ。

実装の方針

旧戦略: ヘッド10本に集中投資(例: 「SEO」「マーケティング」)

新戦略: ロングテール1,000本の網(例: 「BtoB SaaSのSEOで2026年に効く施策」)

100本書く工数を1,000本に分割するのは現実的じゃないので、1記事の中で派生質問を網羅するのが現実解。

# 親記事: AI検索時代のSEO戦略

## H2: AI Overviewsとは?

## H2: AI OverviewsのCTRはどれくらい下がる?

## H2: AI Overviewsに引用される条件は?

## H2: AI OverviewsとGoogle検索の違いは?

## H2: ChatGPTとAI Overviewsで対策は同じ?

...

1ページ内でクエリのfan-outを再現すれば、複数のロングテールクエリで引用候補に入る。

新ルール3:被リンクよりブランド言及

長年SEOの王座にいた「被リンク」が、ついに2位に降りた。

相関係数の比較

Wellows 2026年調査による、AI引用との相関係数:

| 要素 | 相関係数 |

|---|---|

| ブランドメンション(リンクなし言及含む) | 0.664 |

| 被リンク(バックリンク) | 0.218 |

つまりブランド言及は被リンクの3倍効く。

なぜブランド言及が強いのか

AIは「このブランドはどれだけ語られているか」をエンティティ評価の中心に置く。被リンクは作為的に作られやすい(昔の有料リンクの記憶)が、第三者がリンクなしで自然に名前を出すのは作為性が低く、信頼シグナルとして強い。

マーケターの打ち手

| 旧打ち手 | 新打ち手 |

|---|---|

| 被リンク獲得(記事寄稿、相互リンク) | PR・プレスリリースで第三者言及を増やす |

| ドメインオーソリティの数値追跡 | 指名検索数を追跡 |

| ナチュラルリンクの量 | ポッドキャスト・YouTube出演でブランド露出 |

| ディレクトリ登録 | G2、Capterra、Reddit、LinkedInでのレビュー獲得 |

特にPerplexityは引用元の46.7%がReddit(Demandsage 2026)。Reddit/note/Qiitaなどコミュニティでの言及が、AI検索の引用源として直接効く。

💡 Tips: 「弊社のサービスはこういう用途に向いている」と書いた自社オウンドより、「私が使った所感だと〇〇社のツールが一番良かった」と書いた第三者ブログ・Q&Aの方がAIに引用されやすい。

新ルール4:構造化データは複合で実装する

「FAQPage貼っとけば良い」は2026年では不十分。3〜4種を組み合わせるのが新標準。

2026年の構造化データ実情

| Schema | 2026年ステータス |

|---|---|

| Article | 現役・最重要 |

| FAQPage | リッチリザルトは政府/医療系のみ。ただしAI引用には有効 |

| HowTo | 完全廃止(Google 2023/8) |

| Organization | ナレッジパネル連動で重要度UP |

| Person / ProfilePage | 著者E-E-A-T評価で必須化 |

実測の引用率差

Conductor AEO/GEOベンチマーク2026より:

- FAQPage単独実装: 引用率約 41%(未実装サイトの15%の2.7倍)

- 3〜4種の複合実装: 単一実装の 約2倍 引用率

推奨の組み合わせ

Article + FAQPage + Organization + BreadcrumbList

これをJSON-LD一択で実装する(マイクロデータ・RDFaは古い)。

実装サンプル(Article + Person著者ネスト)

<script type="application/ld+json">

{

"@context": "https://schema.org",

"@type": "Article",

"headline": "2026年版 構造化データ実装ガイド",

"image": ["https://example.com/og-1200x675.jpg"],

"datePublished": "2026-04-25T09:00:00+09:00",

"dateModified": "2026-04-25T09:00:00+09:00",

"author": [{

"@type": "Person",

"name": "山田 太郎",

"url": "https://example.com/author/yamada",

"jobTitle": "SEO Lead",

"sameAs": [

"https://www.linkedin.com/in/yamada",

"https://x.com/yamada"

]

}],

"publisher": {

"@type": "Organization",

"name": "Example Inc.",

"url": "https://example.com",

"logo": {

"@type": "ImageObject",

"url": "https://example.com/logo.png"

}

},

"inLanguage": "ja"

}

</script>

HowToスキーマは完全廃止された。実装してても無駄になるので削除しよう。Search Consoleの拡張レポートからも消えている。

新ルール5:llms.txtを置いてAIクローラーをbot単位で制御する

これは2026年に新登場した必須ファイル。

llms.txtとは何か

LLM(大規模言語モデル)がサイト構造を効率的に読むための、Markdownベースの目次ファイル。https://example.com/llms.txt に配置する(仕様: llmstxt.org)。

robots.txtが「クロール許可マップ」なら、llms.txtは「LLM向け推奨コンテンツマップ」だ。

実装サンプル

# Example Inc.

> 日本のBtoB SaaS向けマーケティング支援を専門とする会社。

## 主要ドキュメント

- [製品概要](https://example.com/docs/product.md): プロダクト全体像

- [API仕様](https://example.com/docs/api.md): REST API完全リファレンス

- [構造化データガイド](https://example.com/docs/schema.md): JSON-LD実装例

## ブログ記事

- [2026年版SEOチェックリスト](https://example.com/blog/seo-2026.md)

- [GEO実践ガイド](https://example.com/blog/geo-guide.md)

## Optional

- [古いドキュメント](https://example.com/legacy.md): v1時代の資料

H1(サイト名)→ blockquote(一言説明)→ H2(カテゴリ)→ リンクリスト、の構造。

robots.txtでのAIクローラー粒度制御(2026年版)

学習用botと検索用botは分けて制御する。検索用botはトラフィックを連れてくるので開けるのがコツ。

# === 検索エンジン ===

User-agent: Googlebot

Allow: /

# === OpenAI(3種類を個別制御) ===

User-agent: GPTBot # 学習用

Disallow: /private/

User-agent: OAI-SearchBot # ChatGPT検索用 → 流入見込めるので許可

Allow: /

User-agent: ChatGPT-User # ユーザー手動取得

Allow: /

# === Anthropic(3種類を個別制御) ===

User-agent: ClaudeBot # 学習用

Disallow: /private/

User-agent: Claude-SearchBot # Claude検索用

Allow: /

User-agent: Claude-User # ユーザー質問時の取得

Allow: /

# === Perplexity ===

User-agent: PerplexityBot

Allow: /

User-agent: Perplexity-User

Allow: /

# === Google AI学習をオプトアウト(検索は維持) ===

User-agent: Google-Extended

Disallow: /

Sitemap: https://example.com/sitemap.xml

robots.txtでAIボット全ブロックするのは2026年最大のミス。学習bot(GPTBot/ClaudeBot/Google-Extended)だけ私有領域でブロックし、検索bot(〇〇-SearchBot)は全許可するのが現状の最適解。引用ゼロになっている企業の多くはこのミスをしている。

新ルール6:E-E-A-Tの「経験」を可視化する

2026年3月のGoogleコアアップデートで、E-E-A-Tの「Experience(経験)」と「Authoritativeness(権威性)」の重みが大幅に増した。

何が変わったか

- 匿名コンテンツがリスク化(YMYLジャンルだけじゃなく、全ジャンルで)

- GoogleがLinkedIn・他媒体・SNSで著者IDを横断照合してKnowledge Graphノード化

- YMYL上位ページの**73%**が検証可能な著者クレデンシャルを表示

「経験」の可視化チェックリスト

著者ページに以下を構造化データ + 文章で書く:

<script type="application/ld+json">

{

"@context": "https://schema.org",

"@type": "Person",

"name": "山田 太郎",

"jobTitle": "SEOコンサルタント",

"url": "https://example.com/author/yamada",

"image": "https://example.com/author/yamada.jpg",

"description": "上場企業10社のSEO支援。Web担当者Forum寄稿者。",

"alumniOf": "東京大学",

"worksFor": {

"@type": "Organization",

"name": "Example Inc."

},

"sameAs": [

"https://www.linkedin.com/in/yamada-seo",

"https://x.com/yamada_seo",

"https://qiita.com/yamada"

]

}

</script>

記事本文での「経験」表現

抽象論じゃなく、実体験ベースで書く:

| ❌ ダメな例 | ✅ 良い例 |

|---|---|

| 「AI検索はSEOに大きな影響を与えると言われています」 | 「自社サイトで3か月測ったところ、AI Overviews発火クエリのCTRが平均41%下がった」 |

| 「構造化データの実装が重要です」 | 「FAQPage単独からArticle+FAQPage+Organizationに変えたら、Perplexity引用数が2週間で2.3倍になった」 |

| 「ロングテールキーワードを狙いましょう」 | 「20本のヘッド記事を、80本のロングテールに分解したら3か月で流入が1.7倍になった」 |

数字が入った実体験は、AIにも人間にも刺さる。逆に「〜と言われています」「〜が重要です」だけの記事は、もうAIに引用されない。

新ルール7:KPIを「流入量」から「CV率4.4倍」へ移す

最後のルールは、事業側のKPI設計の話。

AI流入の質的優位性

| 指標 | 従来オーガニック | AI流入 | 倍率 |

|---|---|---|---|

| CV率 | 約1.0% | 4.4-5.0% | 4.4-5倍 |

| YoY流入伸び率 | -33% | +527% | - |

| LLMリード前年比 | - | +1,850% | - |

[出典: Previsible 2025 AI Traffic Report / Semrush / HubSpot]

なぜCV率が高いのか

AI検索を使うユーザーは、質問が具体的。「〇〇のおすすめ」ではなく「BtoB SaaSの月額10万円以下で使える顧客分析ツールでSlack連携できるもの」みたいな絞り込み済みクエリで来る。AIが「これに該当する候補は〜」と答え、ユーザーはほぼ意思決定済みでサイトに来る。

つまり**「流入数×CV率」で見ると、流入数が半減してもCV数は伸びる**ケースが普通にある。

日本市場の傾向

日本SPセンター 2026年4月調査によると:

BtoB企業の**約8割が「流入減でも成果実感」**と回答。流入の質が上がっている。

KPIシートの書き換え

| 旧KPI | 新KPI |

|---|---|

| 月間オーガニック流入数 | AI参照流入数 + AI Overviews引用数 |

| 検索順位(1位獲得数) | 引用獲得数(プラットフォーム別) |

| 被リンク数 | ブランドメンション数 |

| 直帰率 | AI流入経由のCVR |

| 滞在時間 | 指名検索数の推移 |

KPIを変えないと、施策の優先度がぐちゃぐちゃになる。これが地味に一番難しい変更ポイント。

今日・今週・今月のアクションプラン

今日(30分でできる)

- robots.txt を確認: AIボット全ブロックしてないか? 検索bot(OAI-SearchBot, Claude-SearchBot, PerplexityBot)は全許可になっているか?

- HowToスキーマを削除: 残ってたら無駄なペイロード。Search Consoleで拡張レポートを確認

- Google Search Console + Bing Webmaster Tools: AI Overviews発火クエリの動向を見る習慣をつける

今週(5時間で着手)

- JSON-LDを複合実装: Article + FAQPage + Organization + BreadcrumbList をテンプレ化

- 著者ページに Person schema + LinkedInのsameAsリンクを追加

- llms.txt をルートに配置(H1+blockquote+H2リンクリスト)

- 既存記事の H2 を質問形にリライト(10記事だけ試す)

今月(事業判断レベル)

- KPIを書き換え: 「流入量」から「AI引用獲得数 + CV率」へ

- PR・第三者言及の予算配分: 被リンク予算をブランド言及(PR・ポッドキャスト・コミュニティ)にシフト

- 記事の構造を「クエリのfan-out」前提でリプランニング: 1ページ内で派生質問を網羅

- AI検索順位モニタリングツールを1つ導入(ミエルカ、Keywordmap、Profound、Otterly等)

まとめ

2026年4月、SEOは「順位を上げるゲーム」から「AIに引用されるゲーム」に変わった。

押さえるべき7つの新ルール:

- 「掲載」より「引用」を取りに行く — 引用されればCTR+35%、されないと-58%

- 8語以上のロングテールに張る — AI Overviews発火率+73%、CV率2.5倍

- 被リンクよりブランド言及 — 相関係数0.664 vs 0.218

- 構造化データは複合で実装 — Article+FAQPage+Organizationで2倍引用率

- llms.txtを置いてbot単位で制御 — 学習botは絞り、検索botは全開

- E-E-A-Tの「経験」を可視化 — 実体験+数字+著者IDが必須

- KPIを「流入量」から「CV率4.4倍」へ — 流入半減でもCV増の世界

「Google1位」を取りに行く時代は、もう終わった。AIに引用される構造化されたコンテンツを作る側に立つしかない。

この変化、半年前ならまだ「先進企業の話」だった。今はもう普通の会社の今期予算に入る話だ。明日の会議で「うちのrobots.txt見直そう」と言うところから始めるのが、一番安いスタートになる。

参考ソース:

英語ソース

- AI Overviews Reduce Clicks 58% - Ahrefs (2025/12)

- 76% of AI Overview Citations Pull From the Top 10 - Ahrefs

- AIO Impact on Google CTR - Seer Interactive (2025/9)

- Google AI Overviews Drive 61% Drop in CTR - Search Engine Land

- Mastering Generative Engine Optimization 2026 - Search Engine Land

- GEO Framework Paper (Princeton/Georgia Tech) arXiv:2311.09735

- llms.txt 公式仕様

- LLM Optimization - Ahrefs

- How to Optimize Content for AI Search - Semrush

- Semrush AI Overviews Study

- Conductor AEO/GEO Benchmarks 2026

- AI Search Citation Benchmarks 2026 - Averi

- Perplexity AI Statistics 2026 - Demandsage

- Anthropic Claude Bots Granular Controls - Search Engine Journal

- Long-tail SEO in AI Era - Search Engine Land

- Wellows AI Overviews Ranking Factors

日本語ソース