はじめに

LM Studioを触っていると、「KVキャッシュ」という単語を見かけました。

これをきっかけに、Transformerをきちんと1から学ぼうと思いました。

この記事では、自分が理解するまでの過程を記録します。

参考にした動画

主にYouTubeを用いて学びました。

- 3Blue1BrownJapan

深層学習のシリーズで、ニューラルネットワークの仕組みから丁寧に解説されています。

Transformer以前の内容からつながっているため、1から理解することができました。

- 数理の弾丸⚡️京大博士のAI解説

『圧倒的図解で学ぶ「Transformer」徹底解読【Attention is All You Need】』、『圧倒的図解で学ぶ「Attention」の最前線【Transformerのその先】』の動画で解説されています。

一人が解説し、他の二人ほどが聞き手として適宜質問する形式で、聞きやすく、図もあってわかりやすいです。

個人的におすすめです。

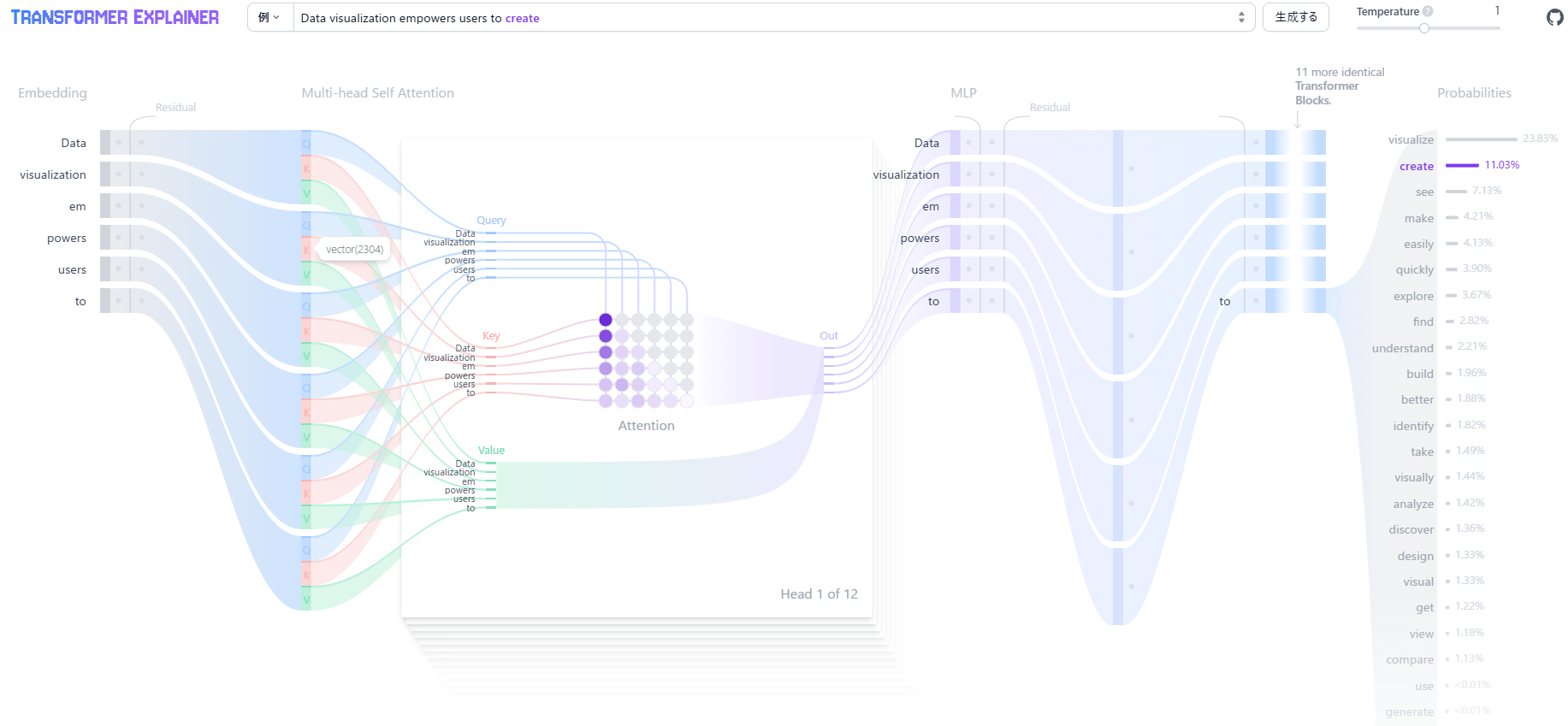

Transformer Explorer

Transformer Explorerという、Transformerの仕組みを可視化するツールを調べて知りました。

Transformerを一通り学んだ後だったので、この画面を見てなんかすごいな、で終わることはありませんでした。

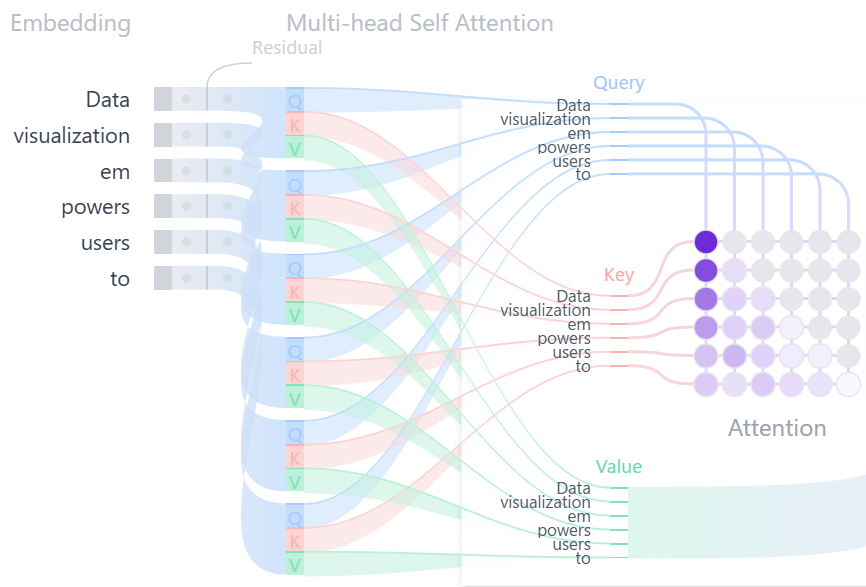

EmbeddingやMulti-head Self Attention、MLPといった要素も、それぞれがどのような役割を持っているのかを意識しながら見ることができました。

また、当初の目的だったKVキャッシュについて照らし合わせてみると、既に生成された単語のKeyとValueは変わらず、再利用できるということが可視化を通して改めて理解できました。

まとめ

KVキャッシュのように、中身を知らないとつまずいてしまう用語は、今後も出てくるかもしれません。

そうした用語に振り回されないためにも、また、AIをただ使うだけでなく、ある程度仕組みを理解したうえで使っていくためにも、Transformerの構造を学んでおくことは大切だと感じました。