Google AI Studioを初めて触ってみた

はじめに

MYJLab Advent Calendar 2025の1日目を担当する3年のKO KURODA(こう)です。

俺がトップバッターだ!12月1日だ!ウェーイ!!!クリスマスまであと24日じゃん!サンタさん来るかなぁ

冗談はここまでとして(?)、去年の先輩の記事を見ていたら、「初日を選んだ過去の自分をタコ殴りにしたい」と書いてありました。

今度は私がその意志を引き継ぐことにしたのだ!

それにしても、なぜ自分もこのイバラの道を選んでしまったのか……。

書くネタない…どうしよ

【お詫びと訂正】

ここまでふざけてしまい、大変申し訳ございません。

トップバッターとしてのプレッシャーで錯乱しておりました。

以下はまじめに技術的な内容を書いていますので、どうかブラウザバックせずにお読みください。

現在、ゼミの研究で「プレゼンの練習サービス」の開発に取り組んでいる関係で、最近AI周りを触ることが増えてきました。

今回はその一環として、以前から気になっていた 「Google AI Studio」 を触ってみたので、その備忘録として残します。

トップバッターとして技術的に高尚な記事を書くべきか迷いましたが、ハードルを上げすぎると後に続くみんなが困ると思うので(優しさ)、今回はツールを使ってサクッとプロトタイプを作ってみた系の記事でいきます。

(※本当は準備が間に合わなかっただけです‥ごめんなさい)

Google AI Studioとは

Google AI Studioは、Googleが提供する生成AIモデル「Gemini」を使ったプロトタイプ作成ツールです。

ブラウザ上で簡単にプロンプトを試したり、APIキーを発行して自分のアプリに組み込んだりできます。

今までChatGPTやGeminiの通常のWeb画面(チャット画面)でポチポチやっていたのですが、使いこなせていないせいか、いまいち効率的にサービス開発に繋げられずにいました。

そこで、同じゼミにいる友人に自分の作りたいものを熱弁したところ、「それならGoogle AI Studioで簡単に作れそうだよ」とアドバイスをもらいました。

開発者向けの設定(System Instructionsなど)を細かく弄れる上に、API化も早いとのことなので、今回初めて使ってみることにしました。

今回作ったもの:質問・フィードバック要約AI「声マト」

ただ触るだけだと面白くないので、Google AI Studioの 「System Instructions(システム指示)」 という機能を使って、プレゼンの質疑応答などで発生するダラダラとした長い質問やフィードバックを、簡潔に要約してくれるAIを作ってみました。

名付けて、「声マト(声のまとめ)」。

この機能を作ろうと思った背景は2つあります。

1つ目は、現在開発している「プレゼンの練習サービス」において、ユーザーへのフィードバックが長文になりがちなので、これをスッキリさせたいという狙いです。自分でも自分の質問やフィールドバックの仕方が下手だなと実感しています。

そして2つ目は、個人的な事情なのですが、自分は聴覚障がいを抱えています。

人工内耳と補聴器をつけていて、一応聞こえはするのですが、おそらく(絶対と言える自信がある)みんなよりは聞こえづらいと思います。日常会話や質疑応答の場面で、相手が何を言っているのか聞き取れないことがありました。あとは、何を言っていたのか忘れてしまうことも…

「相手の言っていることを瞬時に要約して文字で見せてくれるツールがあれば、発表やコミュニケーションがもっとスムーズになるのではないか」

そんな自分の課題を解決したいという思いも込められています。

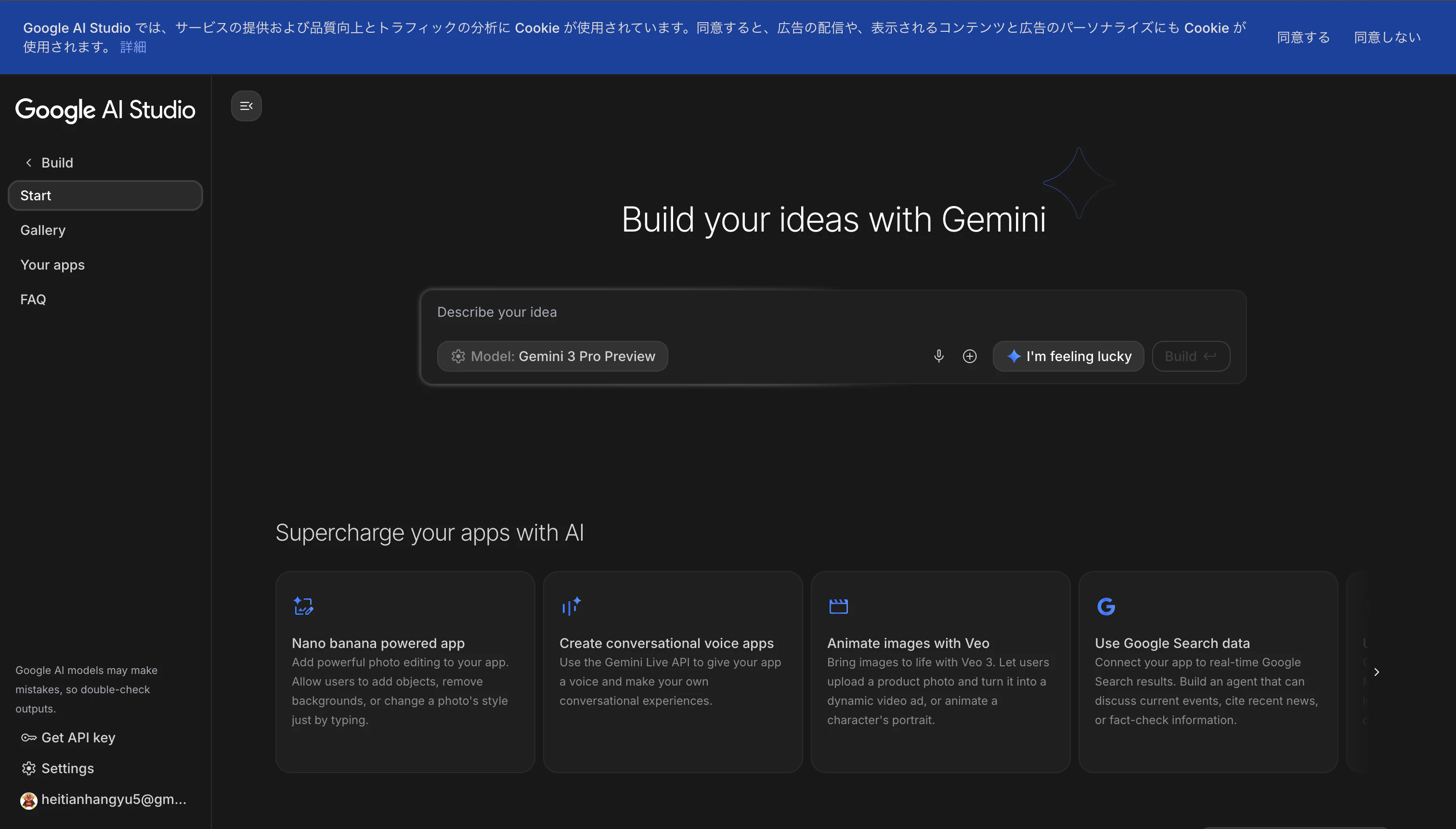

Google AI Studioを開くと、「Describe your idea(あなたのアイデアを記述してください)」 という入力欄があります。

細かい設定(System Instructionsなど)を弄るつもりだったのですが、とりあえずここに日本語でやりたいことをそのまま書いてみました。

モデルはデフォルトのままです。

入力したプロンプト:

質問を文字起こししてそれを要約してくれるサービスを作って

たったこれだけです。

これを入力して実行した結果……。

結果:一発で完成した

やばくね?

本当に一瞬で、自分が想像していた通りの挙動をするアプリ(のプロトタイプ)が出来上がってしまいました。

こちらの意図を汲み取り、音声入力の受付から、文字起こし、そして要点だけの要約表示まで、完璧に構築されています。

実際の挙動イメージ:

- マイクに向かってダラダラ話す(質問など)

- Geminiがそれを認識し、文字起こしを表示

- 同時に「要するに何が言いたいか」を箇条書きで表示

「もうプログラマーいらないじゃん……」

正直、そう思ってしまうくらいの衝撃でした。

今までコードを書いて、APIを叩いて、UIを調整して……とやっていた工程が、自然言語の指示一つでショートカットされてしまいました。

コードの取得

さらに驚いたのが、この生成された挙動をすぐにコードとして取得できる点です。

画面右上の < > Get code を押すだけで、実装に必要なコードが表示されます。

今回生成されたコードはGitHubに上げておきました。

よかったら参考にしてください。

※APIキーはご自身のものを発行して「.env.local」に設定してください

GitHubリンク:Geminiで作った「声マト」のソースコード

おわりに

Google AI Studio、初めて触ってみましたが、「高性能すぎて引く」 レベルでした。

UIが直感的で、APIキーの発行も一瞬。何より「日本語でやりたいことを書くだけ」でここまで動くものが作れるとは思いませんでした。

自分の作りたい「誰もが使いやすいプレゼン練習サービス」や「コミュニケーション支援ツール」にとって、このGeminiの力は大きな武器になりそうです。

(プログラミングの勉強も続けますが、AIを使いこなすスキルの方が重要になるかも……?)

初日としてはかなり衝撃的な体験共有になってしまいましたが、MYJLab Advent Calendar 2025、ここから約1ヶ月間面白い記事がたくさん投稿されるはずなので、みなさん続きをお願いします!(プレッシャー&応援)

最後まで見ていただきありがとうございました!